基于改进U-net网络的腺体细胞图像分割算法应用研究

2022-10-20周涛

周涛

(广州商学院,广东 广州 511363)

0 引 言

医学图像处理在临床应用方面有着不错的效果,医学图像主要通过X-射线成像、核磁共振成像、核医学成像和超声波成像等医学成像技术获取。在医学图像处理方面,主要包括病变检测、图像分割、图像配准及图像融合等多个方面。

近年来,腺癌发病率和死亡率逐年上升,在没有腺体细胞分割技术之前,评估腺体细胞样本完全都是由医学专家完成的,这样就导致工作量大,耗费时间,易出错等问题。为了精确分割肿瘤区域,掌握腺体细胞分割技术可以帮助形态学统计信息,分析腺癌信息情况。随着计算机的高速发展,利用计算机进行图像分割处理,分析病理学资料。这样不但能提高效率,还能推动腺体细胞分割技术发展。结合图像分割技术可以辅助医生诊断和评估病人的病情结果并制定相应的诊疗安排。在医学图像分割中,腺体细胞的图像分割因为其流动性以及细胞中存在杂质较多成为难点问题,而腺癌细胞的图像分割问题则更为复杂。使用U-net 网络的图像分割算法去处理腺体细胞图像会损失部分图像信息,在复杂环境下的识别效果较差。为了解决这些问题,本文将重点研究改进U-net 网络的腺体细胞图像分割算法,结合深度学习技术分析组织病理学图像中的腺体结构。

1 基于改进U-net 网络的腺体细胞图像分割算法

1.1 改进U-net 模型

U-net 网络对于医学图像预处理和腺体细胞分割已经取得了很好的效果,不过在实际运用中依然存在不少问题。例如图像模糊,存在噪点,信息残缺,收敛速度缓慢,精确度低、过拟合、限制分类等问题。本文基于改进U-net 网络解决对腺体细胞图像分割问题,网络框架如图1所示。该结构为端到端的深度学习网络,输入的图像为电子显微镜下的切片腺体细胞图像,输出的图像为分割后的图像。在U-net 网络中加入空洞残差网络模块,通过调整通道数和空洞比率来进行优化。经过多次卷积和池化操作以及添加残差模块获得多目标的腺体细胞特征图。获得特征图之后进行上采样操作,为了得到更多图片信息,将腺体细胞的多个特征进行融合操作,再通过Soft-max 层将输出的特征图结果转换成分类问题。

图1 改进U-net 网络框架

1.2 空洞残差模块

腺体细胞流动性强,分割难度大,需要经过多层网络进行多次卷积和采样操作,才能获取出图像的特征信息,但是强行追求多层操作会让图像丢失一些特征信息,同时训练的时间也会成倍增加。所以在网络模型中添加空洞残差模块,能够很好地解决多层操作带来训练困难问题。空洞残差模块如公式(1)所示:

其中[]表示空洞卷积输出值,表示空洞卷积比率。为了将空洞残差模块应用在二维图像特征上,空洞卷积的输出[]依然可以按照上述公式表示,只需要通过调整相对应的空洞比率大小。

传统的卷积神经网络通过卷积和池化操作增加感受野,但是池化操作容易导致信息丢失,影响分割效果。空洞卷积操作在一定程度上领先于传统卷积操作,空洞卷积能在不改变参数配置下增加感受野的大小,同时输出相同大小特征图像。使用空洞算法与U_Net 网络模型相结合,将替换后的空洞卷积合并到残差网络中,最后组合成空洞残差网络模块。

2 实验结果与分析

2.1 实验环境

本实验所使用的操作系统Windows 10,运行环境为Python3.6,基于Tensorflow 和Keras 的深度学习框架,电脑显卡为GeForce GTX1080 8 GB,内存为16 GB。同时使用CUDA 和cuDNN 架构,提高图像处理速度。其次需要设置训练参数,定义训练集和验证集的数量以及进行迭代的次数。

2.2 实验数据准备

2.2.1 数据集

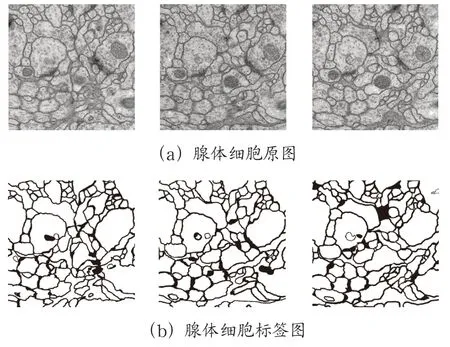

本次实验的数据是从ISBI 数据集中获取,只有30 张512×512 的Image 和Label,训练数据是来自果蝇第一龄幼虫腹侧腹侧神经索(VNC)的连续切片透射电子显微镜(ssTEM)数据集的30 个切片的集合。微立方体的尺寸约为2×2×1.5 微米,分辨率为4×4×50 纳米/像素。对应的二进制标签以从内到外的方式提供,即对于分割对象的像素为白色,对于其余像素(主要对应于膜)为黑色。部分数据集如图2所示。

图2 ISBI 部分数据集

2.2.2 数据预处理

由于ISBI 数据集中的数据图像数量较少,为了更好的分割实验图像样本,在实验之前需要进行预处理操作。预处理流程图如图3所示。首先将标签图像与原始图像进行系统划分并按照对应的格式重命名,然后根据目标区域所在的位置对图像与标签进行统一裁剪,以提取目标区域,接着将裁剪后的图像进行像素处理,统一设置为512×512 大小,最后需要对图像进行二值化,用于进一步避免医学标注干扰,另外由于图像本身都带有一定的噪声,为此还需要对其图像进行去噪处理。

图3 预处理流程图

2.2.3 数据增强

对于深度学习的研究,深度学习的结果与数据的质量和数量有很大关系,但医学样本难采集,数据量较少。为了增加数据量,避免出现过拟合,提高分割精度,需要采用数据增强的方式,解决小样本数据的缺陷。在医学图像分割领域,图像增强属于常见的处理图像操作类型。图像增强的目的是增加训练数据的数据量。主要采用旋转变换与水平翻转变换。数据增强主要是为了减少网络在训练过程中出现过拟合现象,将训练出来的特征图与实际应用场景接轨。实现图像增强有两种方法:

一种是给原始图像和标签图像同时设置一个生成器,并设置相同的种子点,图像就会进行相同变化。另外一种是将标签图像作为原始图像的第二通道,进行合并,然后对图像进行数据增强后,再将原始图像和标签图像分离。本文实验使用的是第二种方法。

2.3 Dice 系数评估标准

在目标检测评估标准中,选择Dice 系数作为评估标准,Dice 系数是一种集合相似度度量函数,用于计算两个样本的相似度,取值范围在[0,1]。设定M 是属于真实目标的像素,设定N 是属于分割结果的像素,则Dice 系数定义公式(2)为:

同理Dice Loss 系数则定义公式(3)为:

Dice 系数的取值范围是0~1,Dice 系数越高,代表分割结果越相似,当为1 时,则与目标完全一致,但是基本上只能无限趋近于1。从公式我们可以得出结论,图像处理的精确度与原目标图像和分割结果图像有关。

2.4 实验结果

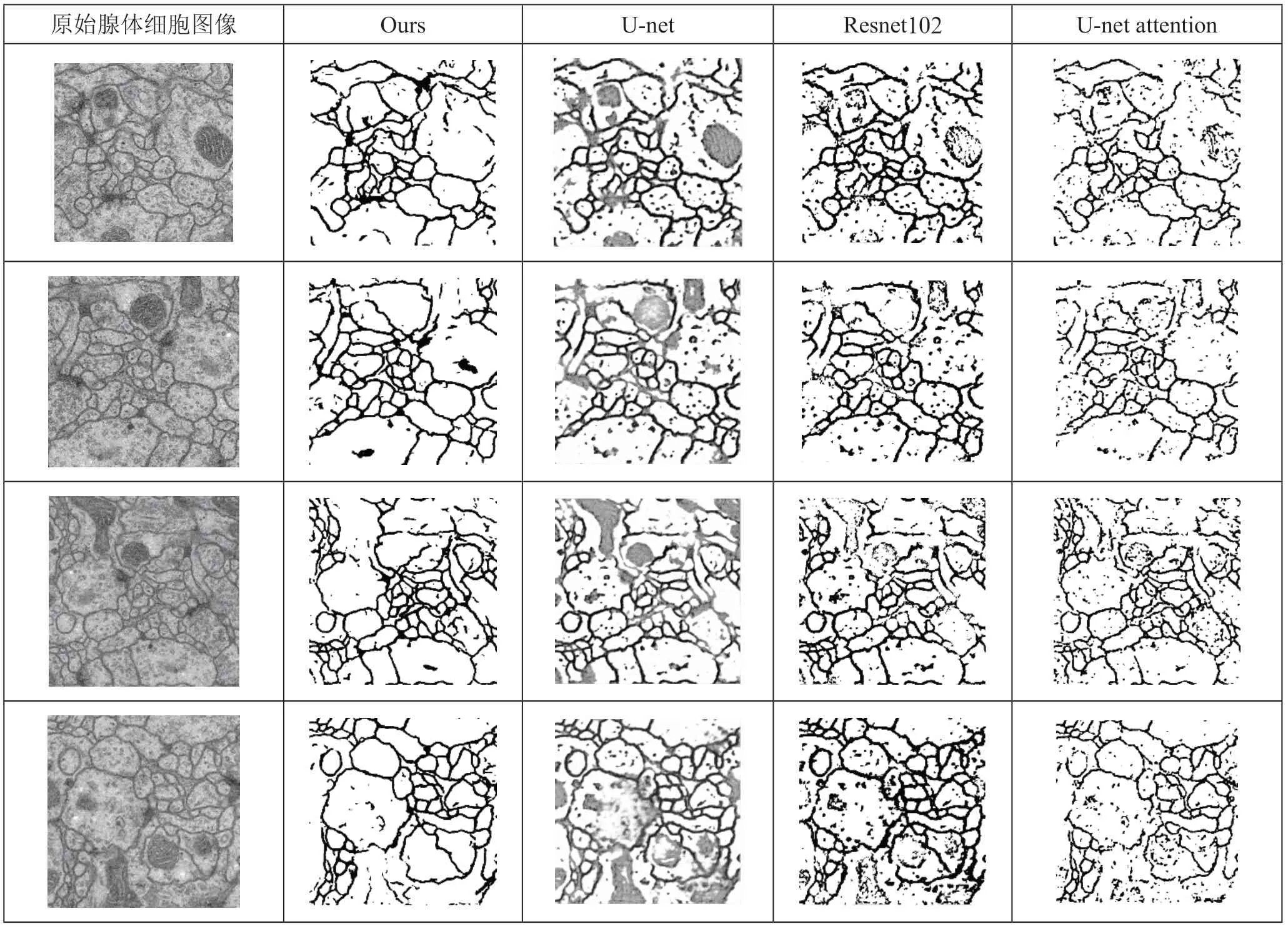

本次实验的原始图像和标签图像都是设置为512×512大小的图片。首先将图片转换成Numpy 数组并将多张图片合到一起,此时变成了三维的数组:×512×512。同时由于数据用于训练时还需要一维的通道,所以在原有基础上再次增加一维。本次实验选取5 张图片用上述的方法形成5×512×512×1 的Numpy 数组测试样本,进行预测。同时也对预测的图片进行不同区域上色,其中OpenCV 的Draw Contours 函数可以实现区域上色功能,而且通过对区域中轮廓线进行分别处理,可以将预测图片中的干扰信息去除。多个腺体细胞图像分割结果对比图像如图4所示。同时随着训练次数的增加,训练成功率能达到95%以上。预测结果曲线图如图5所示。

图4 分割结果对比图像

图5 网络训练过程中的acc 值和loss 值的变化情况

其次通过图像分割中常用的分割性能评价指标 Dice 对本实验所使用的模型进行评价分析,从表1中所给出的实验结果可知U-net、U-net+cbam、Resnet102、Resnet152、U-net attention、U-net+non_local、Ours 等7 种模型进行对比。发现本文改进的网络模型,能够有效地提高网络的训练效率,同时该模型在所有模型中的Dice 系数最高,其Dice 系数为0.925。

表1 模型对比数据

通过表2能够对比不同模型分割效果,改进过后的U-net算法能够去除细胞核以及细胞中的其他杂质,减少相应的干扰信息,且分割后的图像轮廓清晰,为医学专家提供诊断依据。

表2 不同模型分割效果对比

3 结 论

本文提出一种基于改进U-net 网络的腺体细胞图像分割算法,采用基于Tensorflow 和Keras 的深度学习框架,对原始腺体细胞数据集进行预处理,将处理后的腺体细胞数据集输入到改进的U-net 网络中进行训练,实现腺体细胞的提取与分割。使用OpenCV 对腺体细胞图像进行颜色处理,方便医学专家进行诊断和评估。该算法与多种网络模型进行对比,Dice 系数达0.925,同时采用ISBI 数据集进行验证,证明本文提出的算法更具可靠性和实用性。