基于相机标定的纹理映射方法

2022-09-26北方工业大学信息学院童立靖杨鑫坡

北方工业大学信息学院 童立靖 杨鑫坡

人体形状重建是一个广泛的研究领域,通常与位姿重建共同进行。许多应用需要自动生成个性化的3D人体模型,包括虚拟现实和增强现实、娱乐、电话会议、虚拟试穿、生物识别或监控。许多人类重建方法尝试从一个或多个图像中估计几何形状,所以被拍摄物体表面细节的成像效果对人体重建有着关键性的影响。但是受到输入图像成像效果的影响,导致丢失人体关键的图像特征信息等影响。另外一方面,实验所采用的模型主要使用各种深度扫描工具进行直立扫描获取,透视投影较弱,这就会造成重建误差、重建质量降低。

针对目前三维人体重建方法对于图像成像效果影响,以及特定场景、模型扫描等限制,本文给出了基于相机标定的纹理映射方法。首先增加相机标定模块,求解相机透视投影成像过程。推导出相机透视投影方程,计算图像坐标系中的像素点与相机坐标系中的三维点之间的映射关系。对输入的纹理图像进行畸变校正,消除相机透视投影过程中造成的空间几何变形,得到世界坐标系中待重建的真实人体位置、形状和比例。最后通过单眼预测三维模型曲面和纹理预测,得到一个表面真实感更强的带纹理特征的人体模型。

1 相关工作介绍

1.1 参数化人体三维重建国内外研究现状

BodyNet[1]首先展示了使用SMPL[2]作为约束,仅需单张图像作为输入即可重建三维人体的技术。DeepHuman[2]采用SMPL[3]作为体积初始化,对复杂姿态获得稳定的结果。在早期的工作中,2D姿态已经完全或部分手动点击,后来的过程是自动,从深度神经网络进行2D地标检测。在最近的工作中,SMPL模型已经被集成到网络架构中。这进一步地改进了自动化的这个过程。这些工作主要集中在鲁棒姿态检测上。形状的估计通常局限于表面与骨长度的相关性。最重要的是,其形状仅限于SMPL模型空间。

1.2 穿衣人体三维重建国内外研究现状

从单张图像重建三维模型时,很难从单张照片中提取到我们重建所需的纹理数据,尤其是对于图像中物体的不可见区域,但是可以很容易地从输入中对模型可见区域进行采样取得可见区域的纹理。对于遮挡区域的纹理,由于不可通过输入图像采样获得,为了重建模型的完整纹理,只可设计另外的方法处理不可见区域[4]。引入了一种视图合成技术对人体网格的纹理进行推理,能够实现从单一视图预测不可见区域视图,然后融合两个区域的视图。但是这种方法的缺点是不能处理模型侧视图纹理,不能完美融合各个视图之间的拼接区域。

2 基于相机标定的纹理映射方法

2.1 相机内外参数获取

本项研究为消除透视效应对三维姿态估计的影响,通过张正友棋盘相机标定方法获取相机内外参数。增加相机透视投影成像过程,我们设计利用相机位姿参数,对纹理图像进行校正。提升三维人体曲面重建和纹理映射的精度。该方法对观看条件具有鲁棒性,并且不需要一个详细的场景模型。

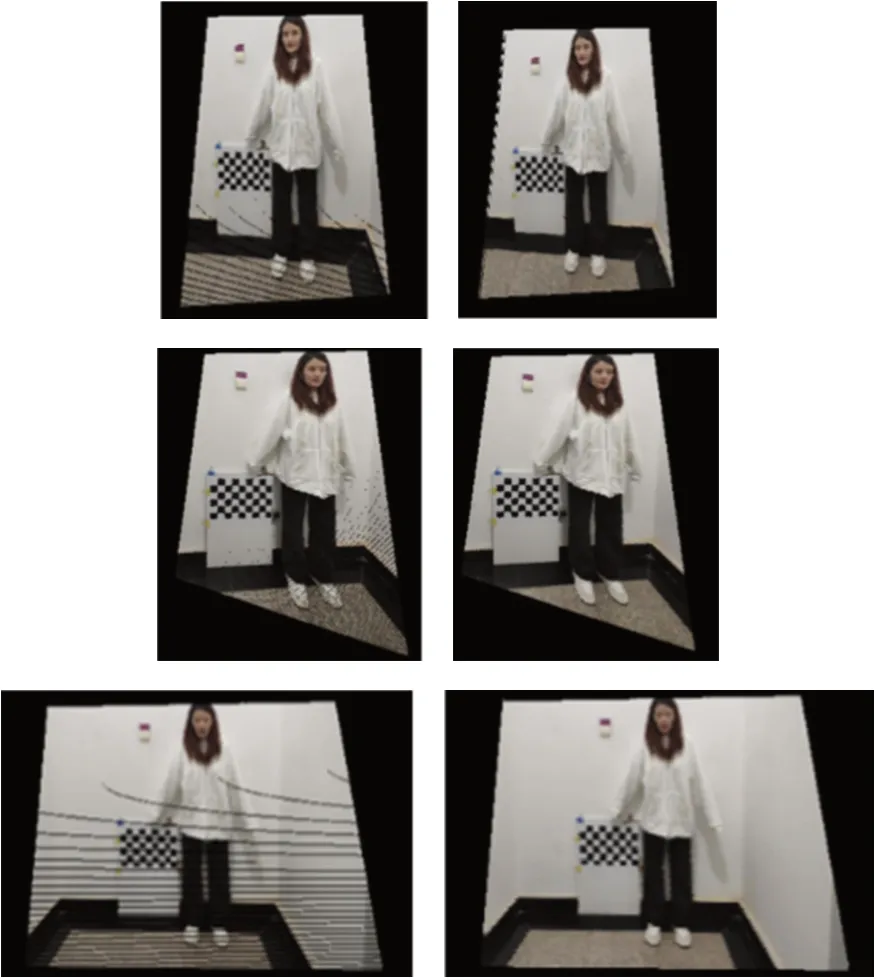

由于世界坐标系被定义在棋盘格上,所以已知棋盘格标定板平面上的任意一点的Z轴坐标值为0。为图

图1 图像校正并填充后结果展示图Fig.1 Result images after image correction and filling

2.3 基于相机标定的纹理映射方法实验结果与分析

如图2所示,为基于相机标定的纹理映射方法对不同视角的标定图像进行人体表面网格的重建结果对比图。从左到右:实验过程中拍摄的标定图像;三维人体网格重建和纹理映射整体效果;人体头部、腿部、衣服表面等细节部分的网格重建效果。

图2 俯视图、侧视图人体表面纹理重建结果对比图(上:[5]中单视图重建方法,下:本文方法)Fig.2 Reconstruction results of human body surface texture in top view and side view(above:single view reconstruction method, next: our method)

图2中展示了不同视角对人体表面进行网格重建的结果对比。明显看出对于侧视角和俯视角的网格重建结果,人体形变更加严重。而本文提出的基于相机标定的纹理映射方法,通过对俯视角、侧视角的成像图像进行校正,恢复人体真实比例和姿态等重要几何特征,可以很明显的看出重建后的人体比例更加接近真实情况。

3 总结与展望

通过实验证明本文设计的基于相机标定的纹理映射方法,人体网格重建结果包含更多的局部表面细节。即使图片中的人体身着的衣服款式各种各样,设计的模型依然能够相当精准的重建对应的3D模型。并且对于高度偏离训练数据的输入图像,基于相机标定的纹理映射方法可以在三维人体重建的过程中校正图像的畸变。解决了输入图像由于相机透视投影效应对纹理映射的影响,更进一步验证了本文设计的基于相机位姿估计的纹理映射方法的有效性。未来的工作可能包括合并人类特定的先验(例如,语义分割、姿态和参数三维人脸模型),并添加隐式表面的二维监督,以进一步支持野外输入。

引用

[1] VAROL G,CEYLAN D,RUSSELL B,et al.Bodynet:Volumetric Inference of 3d Human Body Shapes[C]//Proceedings of the European Conference on Computer Vision(ECCV),2018:20-36.

[2] ZHENG Z R,YU T,WEI Y X,et al.Deephuman:3d human reconstruction from a single image[C]//Proceedings of the IEEE/CVF International Conference on Computer Vision,2019:7739-7749.

[3] LOPER M,MAHMOOD N,ROMERO J,et al.SMPL:A Skinned Multi-person Linear Model[J].ACM Transactions on Graphics(TOG), 2015,34(6):1-16.

[4] HSU S C.Blending 3D Model Textures by Image Projection:US,US201213479952[P].2015-12-29.

[5] SAITO S,HUANG Z,NATSUME R,et al.PIFu:Pixel-Aligned Implicit Function for High-Resolution Clothed Human Digitization[C]//Proceedings of the IEEE/CVF International Conference on Computer Vision,2019:2304-2314.