基于激光雷达及特征匹配的室内场景设计重建

2022-09-25谷晓龙张文松

谷晓龙,张文松

(1.石家庄职业技术学院,河北 石家庄 050081;2.石家庄铁道大学,河北 石家庄 050081)

1 引 言

室内场景重建是采用虚拟现实技术结合采集到的建筑物信息,对室内场景建模的过程。室内场景重建主要由图像获取、摄像机标定、特征提取、立体匹配以及三维重建等五方面组成[1-3]。室内场景重建不仅可以设计出满足人们需求的室内环境,还可让用户直观地了解到设计师对室内场景的设计布局[4-5],帮助用户提出建议,协助设计师去完善室内场景。激光雷达扫描技术通过向目标发射探测信号(激光束),经过适当处理获得目标的相关信息,从而实现目标的探测及识别。由于室内场景中存在布局复杂及光照变化较大的问题,会导致图像采集的准确性较差,影响室内场景重建的效果[6]。

相关领域学者对室内场景重建方法已经有了一定的研究,文献[7]设计了基于双视系统的室内三维场景重建方法,通过双目立体匹配算法SGBM和RGB-D深度图像实现点云三维重建,并利用ORB对采集到的信息实现快速特征点提取,结合迭代最近点实现室内场景的全景三维重建。但室内图像重建后的覆盖率较差,影响室内三维场景重建的效率。文献[8]设计了基于RealSense的室内3D场景重建方法,采用RealSense摄像头获取数据信息,通过OpenVINO构建硬件平台,增强了数据运算速度,结合ICP算法,缩小数据的运算量,优化了室内3D场景重建方法。但没有对采集的图片进行降噪处理,会导致采集到的图像模糊不清,影响室内三维场景重建的精准性。

针对上述问题,设计了基于激光雷达扫描及关键点特征匹配的室内场景设计重建,通过Deleta-2B型激光雷达传感器全方位测量并获取室内图像的三维点坐标信息,通过点云配准整合重合的数据集得到三维点云数据,利用主成分分析法对形状特征进行投影,完成关键点特征匹配,提升采集场景的分辨率,保证场景采集的完整性;将尺度因子引入ICP算法,精确配准点云,通过配准的点云数据建立德洛内三角网,得出三维网格模型,重建室内场景,通过wallis滤波器变换目标某部位的平均灰度值以及方差,提升室内场景的视觉效果,实现室内场景的重建。

2 基于激光雷达扫描及关键点特征匹配的室内场景设计重建

采用Deleta-2B型二维激光雷达传感器采集室内场景图像,为提升采集图像的分辨率,通过最小二乘拟合的滤波算法对图像进行去噪,基于关键点特征匹配算法进行室内场景图像关键点特征匹配,引入尺度因子精确配准多尺度的点云,实现室内场景图像高效配准;

通过德洛内三角化算法处理室内场景图像的点云数据,可以将混沌室内场景图像的点云数据以网格的形式进行网格连接,实现室内场景图像的高精度重构。通过wallis滤波器实现目标部位的平均灰度值以及方差变换,提升室内场景的光线分布规整性,提升室内场景重建的视觉效果。

2.1 基于激光雷达扫描的室内场景图像配准

激光雷达单次投射仅可获取待检测对象某侧的点云数据,重建室内场景图像应构建三维室内模型,需要通过多角度扫描目标物体,将所有外部数据整合,确保待检测对象的完整性。点云配准是将存在重合的数据集进行比对整合,调整不同视场所得三维信息至相同坐标系,获取具有丰富完整信息的目标三维点云数据,得出点云之间的欧拉变换关系。

通过激光雷达扫描技术直接采集自然光条件下室内场景图像的三维点坐标信息,利用反馈激光强度信号的差异识别出光束在所有层之间穿梭时其内部具有的关系。采用二维激光雷达传感器采集室内场景图像点云信息,选用Deleta-2B型激光雷达传感器,其激光波长为780 nm,半径范围在0.2~8 m之间,能够实现360°全方位测量。由于激光雷达采集到的室内场景图像存在缺损、模糊等问题,需要对其展开处理,以便实现室内场景图像噪声的消除、空缺信息的补充[9]。根据激光雷达扫描室内场景图像的类别以及所获取的点特征,利用数字图像的表示方法提取灰度室内场景图像的灰度值,通过基于最小二乘拟合的滤波算法曲线拟合灰度值,实现室内场景图像去噪,得到的直线方程为:

yi=axi+b

(1)

式中,i=1,2,…,m,m为测量点个数;a,b都表示待计算数值;a0,b0表示其估计值,测点坐标描述为(xi,yi)。

当室内各点反射率差异较大时,需要对采集数据分层处理,设a=a0+δa,b=b0+δb,δa、δb均为参数,自、因变量分别通过x、y描述,获取分层后的误差公式为:

(2)

数据分层后,根据最小二乘准则可得出:

(3)

则单位权重误差为:

(4)

得到拟合时的直线公式:

xi=k1yi+k2(i=1,2,…,m)

(5)

通过基于最小二乘拟合的滤波算法可有效消除基于激光雷达扫描技术的室内场景图像所存在的光照等方面的差异以及室内场景图像的噪声[10],并补充室内场景图像的空缺信息。

通过激光雷达扫描室内N次得出N个视场点云数据,任意选取同一目标在不同视角下的两组相邻点云数据,设两组点云中各采样点为h,并以该点坐标为球心,以全部点云信息为球体内半径r,利用局部表面矩阵对其进行描述[11-12],得到:

Lj=[xj,yj,zj]T(j=1,2,…,m)

(6)

在局部表面通过霍特林变换建立局部坐标系,将各局部表面矩阵变换至局部坐标系中并令其与所得两个主轴方向对齐,曲线拟合变换后的局部表面矩阵所含数据,将所得拟合曲面进行n×n采样并提取室内场景图像的特征向量[13],基于其自身性质将其作为特征输入,两组形状特征分别为Np、Nq。由于形状特征的向量维数较高,导致内存占用量与时间耗费量大,所以需要通过主成分分析法降维两组形状特征,并在主成分分析子空间中对其进行投影,完成室内场景图像的关键点特征匹配。形状特征Np与Nq之间的误差公式为:

er=arccos(Np(Nq)T)

(7)

其中,误差分布区间为0~π/2,0与π/2分别代表两组形状特征向量完全相同与完全不同[14],在er的取值为最小的情况下其匹配情况为最佳。

为精确配准多尺度的点云,将尺度因子引入ICP算法,令目标、参考的点云相减,以其误差之和输入为目标函数,同时使目标函数值最小,求取两组点云的各项最优参数。目标函数的公式为:

(8)

其中,xk与yk分别表示目标点云以及参考点云中对应目标点云的点,目标点云数量描述为f。

利用所获得目标特征比对的相同点计算两组点云的各项最优参数,在初始值确定之后通过多次迭代完成精确配准点云,迭代过程如下:

步骤一:初步调整目标点云的各项参数,得出完成调整的目标点云。

步骤二:寻找调整参考点云中与目标点云最接近的点,分别计算两组点云的各项参数,降低目标函数误差至最低,其公式为:

(9)

步骤三:描述两次迭代之间的参数变化关系得到:

(10)

设Si+1、Ri+1、Ti+1为初始值,返回并重复步骤一、二,在尺度因子、旋转矩阵以及平移向量的变化量(分别表示为ΔS=Si+1-Si、ΔR=Ri+1-Ri以及ΔT=Ti+1-Ti)都比设定阈值小的情况下,结束迭代并输出最优参数项。

步骤四:通过均方根误差对配准的精度进行分析评价,均方根误差的计算公式表示为:

(11)

2.2 三维网格模型构造及可视化纹理映射

通过点云数据构建三维网格模型完成室内场景重建,其实质上是建立与真实室内模型表面层相贴近的空间网格模型[15]。通过德洛内三角化算法处理室内场景图像的点云数据,能够将杂乱无序的室内场景图像点云数据以网格的形式串联起来[16],实现室内场景图像的高精度重建。通过德洛内算法构造三维网格模型的主要步骤如下:

第一步,规划一个包括了该面上全部离散点的外壳;

第二步,在外壳与其最靠近的部位构成一个三角网,以此为第一内圈,然后在该圈的基础上,不断与其他点构建新型三角网,重复操作,直至所有点均完成生成[17]。

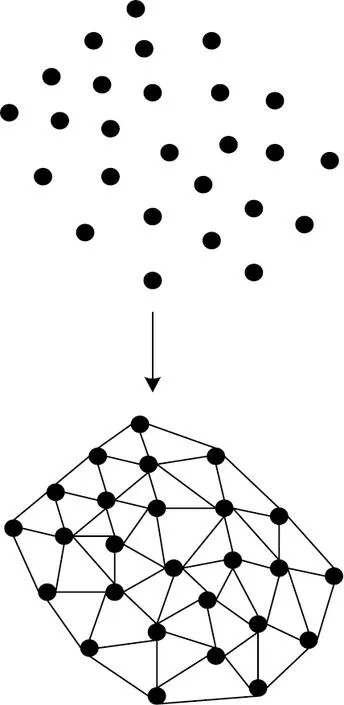

通过实现配准的点云数据建立德洛内三角网,得出三维网格模型完成室内场景图像重建,如图1所示。

图1 按照点云形成三角网络

激光雷达的点云数据仅具有数据点的空间坐标及回波反射强度值[18-20],为提升三维模型完成室内场景重建后的可辨识度以及视觉效果,通过wallis滤波器变换目标某部位的平均灰度值以及方差[21],令室内场景的光线均匀,其公式表示为:

(1-d)mg

(12)

其中,g(x,y)与f(x,y)分别描述室内场景的原灰度值以及滤波器变换后的灰度值;mg与mf分别表示室内场景的原局部灰度均值以及结果局部灰度均值的目标值[22];sg与sf分别描述室内场景的原始目标某部位的标准灰度偏差以及最终目标某部位的标准灰度偏差指定值,c∈[0,1]与d∈[0,1]分别表示室内场景的拓展与亮度系数,前者跟随处理窗口的增大而增加,后者在d→1的情况下室内场景的目标某部位的平均灰度值被强制到最终目标某部位平均灰度值的指定值,在d→0的情况下被强制到原始目标某部位平均灰度值。

3 实验分析

为检验基于激光雷达扫描及关键点特征匹配的室内场景设计重建的性能,在MATLAB仿真平台中进行实验。实验对象选取某建筑的室内场景,本实验激光雷达扫描的每秒点数为655360,分析本文方法使用前后的室内场景图像匹配结果,见图2。

图2中,图像正确匹配点对以及错误匹配点对分别用不同颜色线条描述。对比分析图2(a)和(b)能够直观得出,未使用本文方法的图像匹配结果中存在较多的错误匹配点,而使用本文方法的图像匹配结果中都是正确匹配点。上述结果表明本文方法具有较高的室内场景重建效果,可辨识度较高。

(a)未使用本文方法的图像匹配结果

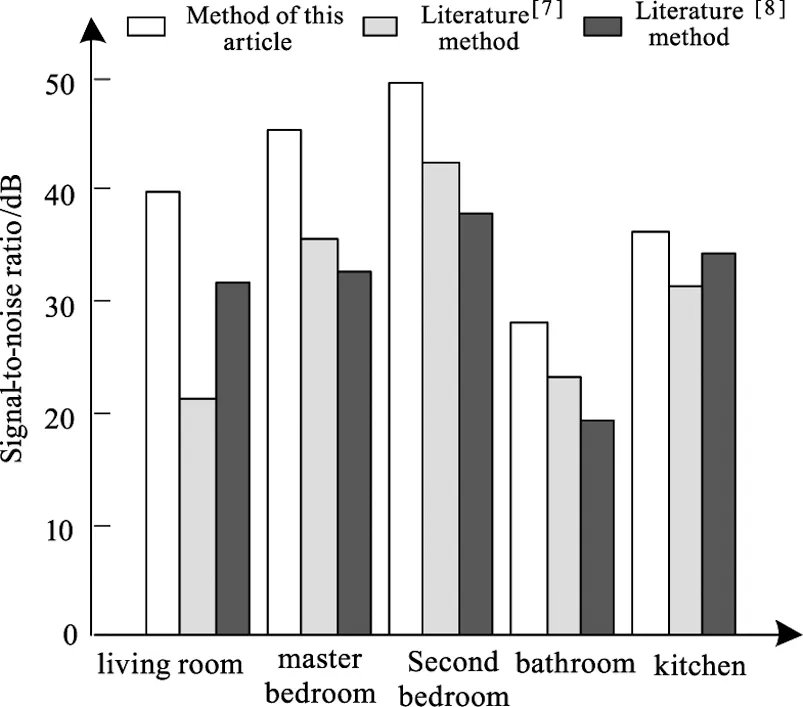

采用文献[7]方法(基于双视系统的室内三维场景重建方法)与文献[8]方法(基于RealSense的室内3D场景重建方法)作为实验对比方法,对比三种方法重建室内场景图像的信噪比,图像信噪比可以直观展示图像中的噪声大小,其与图像内的噪声大小成反比,噪声随着信噪比的增大而减小,与之相对的图像的质量越高;噪声随着信噪比的减小而增大,与之相对的图像的质量越低。结果如图3所示。

图3 三种方法输出图像信噪比对比

采用三种方法对客厅、主卧室、次卧室、浴室以及厨房的图像进行信噪比测定,通过图3可知,使用本文方法输出图像信噪比范围在28.4~49.8 dB之间。使用文献[7]方法输出图像信噪比范围在21.1~41.7 dB之间。使用文献[8]方法输出图像信噪比范围在19.7~37.9 dB之间。并且本文方法重建的室内图像信噪比均高于其他两种对比方法,因为本文方法通过最小二乘拟合的滤波算法减小场景所存在的光照等方面的差异以及室内图像的噪声,证明应用本文方法重建的室内图像质量最好,具有较高的图像清晰度与较强的视觉表达力。

测试三种应用方法下的室内场景重建覆盖率,结果如图4所示。

图4 三种重建方法的室内场景图像覆盖率对比

通过图4可知,应用本文方法重建的室内场景图像覆盖率最高,平均都在90 %以上;应用文献[7]方法重建的室内场景图像的覆盖率最低,最高仅为85.02 %;应用文献[8]方法重建的室内场景图像覆盖率取值范围为85 %~90 %之间。应用本文方法重建的室内场景图像覆盖率最高,因为本文采用多角度扫描目标物体,并将所有外部数据整合,确保待检测对象完整,从而提高了室内场景图像覆盖率。

对比三种方法重建室内场景后的结构相似度,结果如表1所示。

通过测试场景结构的类似程度来评价场景重建的效果,该值越接近1,说明重建的场景结构极为接近实际,重建的场景效果的结果更好,分析表1可知,应用本文方法重建的室内场景结构相似度整体均优于文献[7]方法与文献[8]方法,本文方法重建的室内图像边缘保持得较好,边缘锐度较其他两种方法存在明显改善,整体图像更加清晰,因此场景重建精度较为准确。

表1 三种方法重建场景的结构相似度对比

场景重建时间可有效体现出重建方法的效率,对比三种方法室内场景重建时间,结果如图5所示。

图5 三种方法的场景重建时间对比

分析图5可得,采用三种方法分别对客厅、主卧室、次卧室、浴室以及出厨房的场景时间进行对比,本文方法、文献[7]方法、文献[8]方法的场景重建时间最长是次卧室,重构时间分别为59.2 h、68.4 h、62.5 h。且本文方法的场景重建时间均小于实验对比方法,因为本文方法采用德洛内三角化算法将室内场景的点云数据以网格的形式串联起来,证明了本文方法的重建效率与实时性。

4 结 论

本文提出基于激光雷达扫描及关键点特征匹配的室内场景设计重建,从激光三维重建技术入手,获取室内场景图像的点云、对其进行匹配、实现三角网构建等操作。实验结果表明,该方法的重建室内图像信噪比最高可达到49.8/dB,室内场景图像覆盖率均在90%以上,重建场景的结构相似度接近1,场景重建时间最短为59.2 h。上述实验结果证明了该方法具有较好的重建效果,对室内场景的重建完整度很高。该方法在一定程度上为三维目标的点云数据配准与重建等工作提供了理论指导,具有较好的实际应用效果,但未来还可以从影响图像品质参数的角度出发,进一步提升室内场景重建的精度。