面向时变复数西尔维斯特方程的有限时间神经网络研究①

2022-08-31高畅孔颖

高 畅 孔 颖

(浙江科技学院信息与电子工程学院 杭州310023)

0 引言

矩阵方程求解广泛应用于科学研究和实际工程领域中。其中,西尔维斯特方程的求解是工程领域和数字应用中的一个主要问题,例如图像处理[1]、机器人应用[2]和特征值分配[3]。线性矩阵方程A(t)X(t)-X(t)B(t) +C(t)=0 被称为西尔维斯特方程[4-5],它与动力学系统理论紧密相关。该方程的系数一般情况下为时变矩阵A(t)、B(t)和C(t),X(t)为所要求解的未知矩阵。目前,求解西尔维斯特方程主要有两种方法。第一种方法源于串行处理,例如传统的数值算法[6]。该方法通常用于求解静态情况下的西尔维斯特方程,而不适用于时变情况。另外,由于串行计算会导致采样率过高并且使得每个计算周期更为复杂,因此无法实时求解规模较大的时变问题以及更为复杂的时变复数问题。第二种方法源于并行处理,例如一些神经网络算法[7-8],它们可以被用来求解时变情况下的西尔维斯特方程(简称时变西尔维斯特方程)。由于神经网络算法拥有并行计算的能力而且容易在电子硬件中实现,因此具有较高的性能,可以实时计算大量数据。基于传统梯度法的梯度神经网络(gradient neural network,GNN)是一种典型的神经动力学方法,可以被用来求解西尔维斯特方程。但是,该方法对于实时问题的求解基本上都是考虑定常(即静态)情况的,或将时变问题借助于短时不变性假设而近似为定常问题去处理。换句话说,在求解过程中,由时变因素引起的影响经常被忽略。因此在求解时变问题时,它的估计误差可能不会收敛到0,故该方法在求解时变西尔维斯特方程时,计算精度不高。

针对时变问题的求解,文献[9,10]提出了一类新型的递归神经网络(zeroing neural network,ZNN)。ZNN 是解决时变问题的一种系统方法,在它的设计过程中,与GNN 相比,ZNN 采用了不同的设计公式、误差函数和动力学方程。在它的实现过程中,ZNN 充分利用了时变系数的导数信息,能够准确有效地求解时变问题。另外,作为一种新型的递归神经网络,它成功地解决了传统的递归神经网络在求解时变西尔维斯特方程时普遍存在的估计误差问题。根据文献[11],与传统的梯度神经网络相比,ZNN 的优势是随着时间的推移,其估计误差会逐渐减小到0。

ZNN 一般用于解决实数域中的时变问题,对复数域中的时变问题研究较少。许多时变问题需要考虑到复数,如信号处理领域中频域的在线识别问题[12]和包含幅值相位信息的输入信号[13]。为解决上述问题,提出了用于求解复数问题的递归神经网络 (complex-valued zeroing neural network,CVZNN)[14-16]。这种实时求解复数域时变问题的神经动力学方法可以认为是实值ZNN 的扩展,它们不仅可以作用于实数域,也可以作用于复数域。但现有的用于求解复数问题的神经网络收敛速度较慢、计算精度较低。根据文献[14],神经网络的收敛情况与初始状态、激励函数的选取和设计参数有关。本文考虑寻找合适的激励函数来提高神经网络的收敛速度和计算精度。

基于以上分析,本文为求解复数域中时变西尔维斯特方程,选取了一种非线性激励函数。根据非线性激励函数在复数域中2 种等价的处理方法,构建出了2 种有限时间神经网络(finite-time neural network,FTNN)模型。将有限值激励函数应用到2种FTNN 模型中,进一步提高了2 种FTNN 模型的收敛速度和计算精度。在求解时变复数西尔维斯特方程时,采用有限值激励函数的2 种FTNN 模型收敛速度更快、计算精度更高。并通过稳定性与收敛性的证明验证了2 种FTNN 模型的有效性。最后,通过2 个仿真实例来验证理论推导。

本文的创新点如下。

(1)在ZNN 网络模型的基础上,通过复数域中2 种处理非线性激励函数的方法,构建出2 种FTNN模型,并用它们来求解时变复数西尔维斯特方程。

(2)与已有的周期神经网络模型相比,FTNN 模型具有有限时间收敛的特性。用它们求解时变复数西尔维斯特方程时效率更高。

(3)探索了一种有限值激励函数并应用到2 种FTNN 模型上,提高了FTNN 模型的收敛性和稳定性。采用有限值激励函数更易于在实际应用中实现。

1 问题描述和FTNN 模型

本节首先阐述了一个时变复数西尔维斯特方程的求解问题,然后基于ZNN 模型在实数域中的设计方法[14,17-18],再根据非线性激励函数在复数域中2种等价的处理方法,构建出了2 种FTNN 模型。最后引入了有限值激励函数来提高2 种FTNN 模型的收敛速度和计算精度。

1.1 问题描述

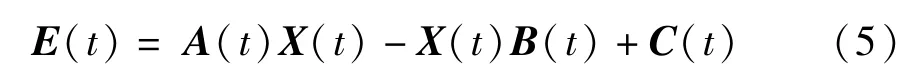

首先,给出光滑的时变复数矩阵A(t)∈Cn×n、B(t)∈Cn×n和C(t)∈Cn×n,求解出满足下列方程的未知复数矩阵X(t)∈Cn×n,方程如下:

其中t表示时间。与普通矩阵不同,矩阵A(t)、B(t)、C(t)和X(t)中的每个元素都是复数,并且会随时间的变化而变化,因此每个元素的实部与虚部都会随时间变化。为实时求解出未知的复数矩阵X(t),需要任意时刻t都满足式(1)。神经网络的输入是时变复数矩阵A(t)、B(t)、C(t),经过一段时间的演化后,网络中神经元的状态最终会收敛到时变复数西尔维斯特的理论解X∗(t)。

基于文献[15]中给出的求解复数域中时变问题的过程,可以将2 种FTNN 模型的设计分为以下3个步骤。为方便阐述,本文将所构建的2 种FTNN模型分别命名为FTNN-I 模型和FTNN-II 模型。

1.2 FTNN-I 模型

矩阵A(t)、B(t)、C(t)和X(t)都是由复数构成,每个复数都有各自的实部与虚部。根据第一种处理复数域中非线性激励函数的方法,同时激励复数输入的实部与虚部,按以下步骤构建出FTNN-I模型。

步骤1为实时监测实际解X(t)与理论解X∗(t)之间的计算误差,引入动态误差矩阵E(t)。随着时间的变化,当E(t)趋向于0 时,此时方程中的X(t)就是方程的解,E(t)如下:

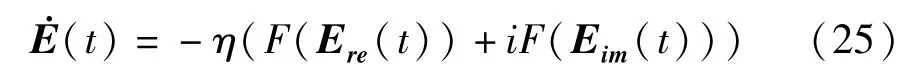

步骤2为保证动态误差矩阵E(t)最终能收敛到0,定义E(t)的动态变化公式为

其中η>0,F(·) :Rn×n→Rn×n表示实数域中定义的非线性激励函数,表示虚数单位,Ere(t)∈Rn×n和Eim(t)∈Rn×n分别表示误差矩阵E(t)∈Cn×n的实部与虚部。

步骤3联立式(2)和E(t)的动态变化式(3),得到FTNN-I 模型:

1.3 FTNN-II 模型

矩阵A(t)、B(t)、C(t)和X(t)都是由复数构成,每个复数都有各自的模量与辐角。根据复数域中第二种处理非线性激励函数的方法,激励复数输入的模量,按以下步骤构建出FTNN-II 模型。

步骤1与FTNN-I 模型式(4)的设计过程类似,引入动态误差矩阵E(t):

步骤2为保证动态误差矩阵E(t)最终能收敛到0,定义E(t)的动态变化公式为

其中η、i和F(·) 与上述定义相同,° 表示矩阵之间的Hadamard 乘积,Θ(t) ∈Rn×n和Δ(t) ∈(-π,π]n×n分别表示误差矩阵E(t) 的模量与辐角。

步骤3联立式(5)和E(t)的动态变化式(6),得到FTNN-II 模型:

从FTNN-I 模型式(4)和FTNN-II 模型式(7)的设计过程中可知,FTNN 是一种与ZNN 相似的递归神经网络。式(3)和式(6)分别描述了FTNN-I 模型式(4)和FTNN-II 模型式(7)中误差矩阵的动态变化过程。从上述2 个公式中可以看出,每个时间点估计的误差会实时反馈给神经元,从而最终使动态误差矩阵E(t)收敛到0。由于这种实时反馈的特性,通过2 种FTNN 模型求解时变复数西尔维斯特方程问题时,效率很高。

注1复数的模量与辐角,如一个复数为a+bi,那么它的模量为,辐角为辐角有无数个,但一般选用辐角主值(在区间[-π,π]内的辐角)。

1.4 有限值激励函数

根据文献[14],求解复数域中的时变问题时,使用非线性激励函数的CVZNN 模型可保证误差能以指数级的速度收敛。此外,根据文献[18],使用符号双幂激励函数可以提高CVZNN 模型的收敛速度,并且能使其在有限时间内收敛。这表明特殊的非线性激励函数可以减少CVZNN 模型的收敛时间。为进一步提高2 种FTNN 模型的收敛速度与计算精度,尝试了一种非线性激励函数(简称有限值激励函数)F(·):

其中q和p都为奇数。有限值激励函数在线性激励函数的基础上,加了一个指数。根据数学定义,有限值激励函数仍然是单调递增的奇函数,所以将它应用到2 种FTNN 模型时仍然可以保持全局收敛[18]。

2 算法的收敛性证明

根据文献[15],如果使用单调递增的奇函数作为激励函数,使用CVZNN 模型来求解时变复数西尔维斯特方程时,能收敛到理论解。因此,首先要证明应用有限值激励函数的2 种FTNN 模型在求解时变复数西尔维斯特方程时,能收敛到理论解。然后,证明其能在有限时间收敛。最后,计算出收敛时间上界。

2.1 稳定性分析

对于FTNN-I 模型式(4),有以下定理。

定理1给定光滑的时变复数矩阵A(t)、B(t)和C(t),如果将有限值激励函数式(8)应用到FTNN-I 模型式(4)中,通过FTNN-I 模型式(4)求解的未知矩阵X(t)从任意初始状态X(0)开始,最终能收敛到时变复数西尔维斯特方程的理论解X∗(t)。

证明根据FTNN-I 模型式(4),得到其等价形式:

其中E(t)=A(t)X(t)-X(t)B(t) +C(t),(t)是E(t)的一阶导数,Ere(t)∈Rn×n和Eim(t)∈Rn×n分别表示复数误差矩阵E(t)的实部与虚部。将(t)的实部和虚部分开:

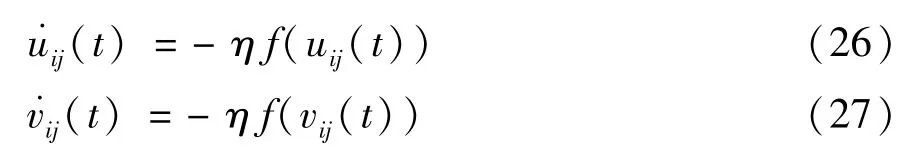

取实部与虚部中的各个元素,得到另一种形式:

其中,uij(t)和vij(t)分别表示Ere(t)和Eim(t)的第i行第j列元素,分别表示uij(t)和vij(t)的一阶导数,f(·)是处理矩阵各个元素的有限值激励函数。定义李亚普诺夫函数,对其求导可得。因为f(·)是单调递增的奇函数,所以有:

因此,恒小于等于0。根据文献[18]中的李亚普诺夫定理,可以得出,对于任意的i、j,uij(t)都能全局收敛到0。对于误差矩阵E(t)的虚部,与上面的证明类似,也可以证明出Eim(t)中的任意元素vij(t)最终也都能收敛到0。也就是说,误差矩阵E(t)随着时间的增加最后都能全局收敛到0。根据误差矩阵E(t)的定义,当E(t)全局收敛到0 时,通过FTNN-I 模型式(4)求出的未知矩阵X(t)与初始状态X(0)无关,并最终能收敛到时变复数西尔维斯特方程的理论解X∗(t)。

证明成立。

定理2给定光滑的时变复数矩阵A(t)、B(t)和C(t),如果将有限值激励函数式(8)应用到FTNN-II 模型式(7)中,通过FTNN-II 模型式(7)求解的未知矩阵X(t)从任意初始状态X(0)开始,最终能收敛到时变复数西尔维斯特方程的理论解X∗(t)。

证明根据FTNN-II 模型式(7),得到其等价形式:

证明成立。

注2从定理1 和定理2 的证明过程来看,下面的这些激励函数同样满足F(·)的要求(单调递增的奇函数),并可以应用到FTNN-I 模型式(4)和FTNN-II 模型式(7)上。

线性激励函数:

幂函数:

双S 型函数:

幂-S 型函数:

符号双幂函数:

在下文的仿真部分,将这些激励函数与有限值激励函数式(8)应用到2 种FTNN 模型中,再分别进行比较。

2.2 收敛性分析

根据文献[18],在实数域内,如果使用符号双幂激励函数,那么就能在有限时间内求解出时变西尔维斯特方程,并且可以计算出理论解的收敛时间上界。本节将有限值激励函数从实数域扩展到了复数域,以便能在有限时间内求解出时变复数西尔维斯特方程,并计算出理论解的收敛时间上界。

定理3给定光滑的时变矩阵A(t)、B(t)和C(t),如果将有限值激励函数式(8)应用到2 种FTNN 模型上,则通过2 种FTNN 模型求解出的未知矩阵X(t)无论从任意初始状态X(0)开始,最终能在一段时间后收敛到时变复数西尔维斯特方程的理论解X∗(t)。FTNN-I 模型式(4)和FTNN-II 模型式(7)的收敛时间上界分别如下所示。

对于FTNN-I 模型式(4),它的收敛时间上界t1为

其中,m(0)=max{|uij(0)|,|vij(0)|},uij(0)和vij(0)分别表示误差矩阵的初始状态E(0)中第i行第j列元素的实部与虚部。

对于FTNN-II 模型式(7),它的收敛时间上界t2为

其中,n(0)=max{|eij(0)|},eij(0)表示误差矩阵的初始状态E(0)的第i行第j列元素。

证明考虑到2 种FTNN 模型,证明过程分以下2 种情况。

情况1对于FTNN-I 模型式(4),根据式(9),可得:

再根据式(12)和式(13),可得:

在初始时间中选取uij(t)和vij(t)中较大的一个作为m(t)的初值,m(0)=max{|uij(0)|,|vij(0)|}。在任意时刻t中,取uij(t)和vij(t)中绝对值相对较大的一个作为m(t)。通过比较定理,可以得到:-|m(t)|≤uij(t)≤|m(t)|、-|m(t)|≤vij(t)≤|m(t)|。换句话说,当m(t)等于0 时,Ere(t)和Eim(t)中所有的元素都会等于0。因为f(·)是一个单调递增的奇函数,(t)中所有的元素uij(t)都满足式(26),(t)中所有的元素vij(t)都满足式(27),所以可以得到m(t)的动态表达式为

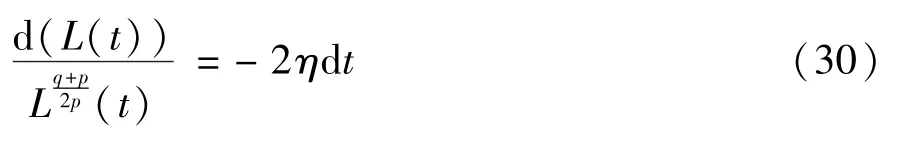

定义李亚普诺夫函数L(t)=|m(t)|2,对它求导,得到:

解上述微分方程式(29),得到:

将微分方程式(30)从0 积分到t,可得:

因为L(t)=|m(t)|2,所以L(t)≥0,故:

因此可以解出:

情况2定义李亚普诺夫函数L(t)=|n(t)|2,其中n(0)取E(t)所有元素中模数的最大值,且初始状态n(0)=max{|eij(0)|}。可以得出结论,当n(t)趋于0 时,E(t)中所有的元素都会等于0。因此,如果计算出了n(t)的收敛时间,就能相应地估算出FTNN-II 模型式(7)的收敛时间上界。根据式(6),取矩阵中的各个元素,可以得到n(t)的动态表达式为

类似式(17)的推导,可以得出:

与情况1 的证明类似,FTNN-II 模型式(7)的收敛时间上界计算结果为

证明成立。

3 数值仿真

本节给出了2 个具体实例,首先将有限值激励函数式(8)应用到FTNN-I 模型式(4)和FTNN-II 模型式(7)中;然后将其他单调递增的奇函数与有限值激励函数式(8)进行比较;最后为证明有限值激励函数式(8)能减少FTNN-I 模型式(4)和FTNN-II模型式(7)的收敛时间,本文单独将有限值激励函数式(8)与符号双幂激励函数式(22)进行比较。

仿真1求解时变复数西尔维斯特方程:A(t)X(t)-X(t)B(t) +C(t)=0,其中A(t)、B(t)和C(t)的系数如下,求未知矩阵X(t)。

此时,X(t)的逻辑解为

图1 描述了当FTNN-I 模型式(4)使用有限值激励函数式(8),并用来求解时变西尔维斯特方程时,未知矩阵X(t)的阶段性变化(FTNN-I 模型式(4)中设定η=50,)。其中实线表示实际解的状态变化,虚线表示理论解X∗(t)的状态变化。图中实线与虚线会在一段时间后重合,这说明X(t)从初始状态X(0)开始(仿真中初步设定初值X(0)=[1 +i,1 +i;0,0],最终能在一段时间后收敛到时变复数西尔维斯特方程的理论解。

图1 X(t)的理论解(虚线)和实际解(实线)

一般情况下,实际解X(t)与理论解X∗(t)之间存在计算误差,用‖A(t)X(t)-X(t)B(t) +C(t)‖F来近似估计实际解与理论解之间的计算误差。然后,将线性激励函数、幂激励函数(k=3)、双S 型激励函数(m=3)、幂-S 型激励函数(k=3,m=3)、符号双幂激励函数(r=3)与有限值激励函数进行比较。为进行对比验证,将FTNN-I 模型式(4)中的设计参数η统一设置为50。如图2 所示,当这些激励函数应用在FTNN-I 模型式(4)时都能使计算误差逐渐减小。这验证了前面的理论推导:即如果激励函数是单调递增的奇函数,那么就能保证全局收敛。此外,从图中可以看出,采用有限值激励函数式(8)的FTNN-I 式(4)模型的误差收敛速度比其他激励函数要快,这说明在求解时变复数西尔维斯特方程时,有限值激励函数的效果要更好。

图2 激励函数的收敛性比较

因为符号双幂激励函数式(22)与有限值激励函数式(8)是指数级的函数,误差的收敛速度较快,并且容易计算出收敛时间上界,所以在FTNN-I模型式(4)中,单独将符号双幂激励函数式(22)与有限值激励函数式(8)进行比较。为计算出收敛时间上界,使用的是特定的初始状态而不是随机产生的初始状态。设定X(0)=[1 +i,1 +i;0,0],误差矩阵的初始状态E(0)=A(0)X(0)-X(0)B(0) +C(0),计算为E(0)=[i,1 +i;-1-i,-2-i],则式(23)中定义的最大项m(0)=3。将有限值激励函数式(8)(设定η=50,)应用到FTNN-I 模型式(4)中,根据式(23),计算出使用有限值激励函数的FTNN-I 模型式(4)的收敛时间上界t1=。再将符号双幂激励函数式(22)(设定η=50,)应用到到FTNN-I模型式(4)中,根据文献[14]中的定理3,计算出其收敛时间上界(r取0.3时,符号双幂激励函数的收敛情况较好)。

如图3 所示,在FTNN-I 式(4)模型中,使用符号双幂激励函数式(22)的理论收敛时间上界为0.0928 s,而仿真实际运行时间为0.0586 s。使用有限值激励函数式(8) 的理论收敛时间上界为0.0476 s,而仿真实际运行时间为0.0467 s,符合理论分析。当FTNN-I 模型式(4)使用有限值激励函数式(8)时,误差收敛速度要比使用符号双幂激励函数式(22)时更快。这也证明了在FTNN-I 模型式(4)中,用有限值激励函数式(8)来求解时变复数西尔维斯特方程时,效果更好。

图3 符号双幂激励函数与有限值激励函数的收敛性比较

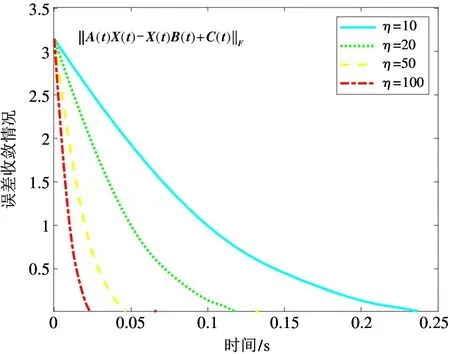

接下来讨论设计参数η对模型的影响,先固定,再判断不同的η对收敛性能的影响。

图4 描述了用FTNN-I 模型式(4)来求解时变复数西尔维斯特方程时,设计参数η对误差收敛速度的影响。当增加η的值时,可以提高模型误差的收敛速度。

图4 设计参数η 的收敛性比较

仿真2为进一步验证理论的有效性,举第2个仿真实例。求解时变复数西尔维斯特方程:A(t)X(t)-X(t)B(t) +C(t)=0,其中A(t)、B(t)和C(t)的系数如下,求未知矩阵X(t)。

此时,X(t)的理论解为

类似于仿真1,图5 描述了当FTNN-II 模型式(7)使用有限值激励函数式(8),并用来求解时变西尔维斯特方程时,未知矩阵X(t)的阶段性变化(FTNN-II 模型式(7)中设定η=50,)。图中实线(实际解)与虚线(理论解)会在一段时间后重合。这说明X(t)从初始状态X(0)开始(仿真中初步设定初值X(0)=[0.5i,0;0,0],最终能收敛到时变复数西尔维斯特方程的理论解。

图5 X(t)的理论解(虚线)和实际解(实线)

图6 描述了在FTNN-II 模型式(10)中,使用一些激励函数与有限值激励函数式(8)进行收敛性比较,其中这些激励函数的设计参数与仿真一完全相同。从图中可以看出,使用有限值激励函数式(8)的FTNN-II 模型式(7)的误差收敛速度比使用其他激励函数时要更快。

图6 激励函数的收敛性比较

在FTNN-II 模型式(7)中,单独将符号双幂激励函数式(22)与有限值激励函数式(8)进行误差的收敛性比较。设定初始状态X(0)=[0.5i,0;0,0],误差矩阵的初始状态E(0)=A(0)X(0)-X(0)B(0) +C(0),计算为:E(0)=[1.5i-0.5,-0.5i-1.5;-1.5i-1.5,0.5i+1],则式(24)中定义的最大项,将有限值激励函数式(8)(设定η=50,)应用到FTNN-II 模型式(7)中,根据式(24),计算出使用FTNN-II 模型式(7)的收敛时间上界。再将符号双幂激励函数式(22)(设定η=50,r=0.3)应用到FTNN-II 模型式(7)中,通过文献[14]中的定理3,计算出收敛时间上界0.0967 s。

如图7 所示,在FTNN-II 式(7)模型中,使用符号双幂激励函数式(22)的理论收敛时间上界为0.0967 s,而仿真实际运行时间为0.0577s。使用有限值激励函数式(8) 的理论收敛时间上界为0.0495 s,而仿真实际运行时间为0.0484 s,符合理论分析。当FTNN-II 模型式(7)使用有限值激励函数式(8)时,误差收敛速度要比使用符号双幂激励函数式(22)更快。这也证明了在FTNN-II 模型式(7)中,使用有限值激励函数式(8)时,效果更好。

图7 符号双幂激励函数与有限值激励函数的收敛性比较

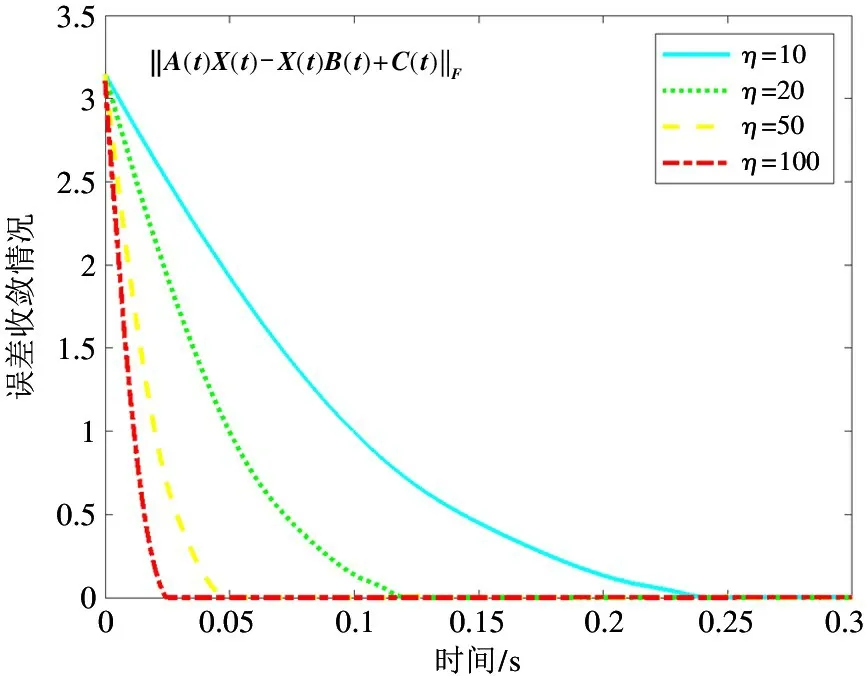

图8 描述了用FTNN-II 模型式(7)来求解时变复数西尔维斯特方程时,设计参数η对误差收敛速度的影响。如图所示,η越大,误差的收敛速度越快。

图8 设计参数η 的收敛性比较

4 结论

本文针对时变复数西尔维斯特方程的求解,首先基于复数的运算规则,设计了2 种改进的有限时间神经网络模型。理论分析表明,当使用任意单调递增的奇函数作为激励函数时,这2 种FTNN 模型都可以实现全局收敛性。然后使用有限值激励函数来提高2 种FTNN 模型的收敛速度与计算精度。最后将符号双幂激励函数与有限值激励函数应用到2种FTNN 模型中,与符号双幂激励函数相比,应用有限值激励函数的FTNN 模型收敛时间上界更小。数值算例与仿真结果验证了所提出的2 种基于有限值激励函数的FTNN 模型在求解时变复数西尔维斯特方程时的优越性。然而,由于2 种FTNN 模型中需要用到非线性激励函数并进行数值运算,因此FTNN 模型比应用线性激励函数的CVZNN 模型具有更高的复杂度,未来的工作可能会优化FTNN 模型的结构,并进一步推广到实际应用中。