空基下视多角度红外目标识别*

2022-07-21刘彤杨德振宋嘉乐傅瑞罡何佳凯

刘彤 ,杨德振,宋嘉乐,傅瑞罡 ,何佳凯

(1.华北光电技术研究所 机载探测中心,北京 100015;2.中国电子科技集团公司电子科学研究院,北京 100015;3.国防科技大学 电子科学学院ATR 重点实验室,湖南 长沙 410073;4.北京真空电子技术研究所 微波电真空器件国家重点实验室,北京 100015)

0 引言

采用多个复合翼无人机集群的空基红外目标探测识别系统进行协同态势感知是地面远程红外制导的有效辅助手段。其中舰船和车辆目标的智能识别算法作为当代陆海防务系统中关键技术,对于保障我国的国防安全具有重要的应用价值。红外图像具有对比度高、作用距离远、穿透力强等特点,热成像不需要借助外界光源,隐蔽性好,可以全天时工作。目前多数车载系统的视角为平视,平视视场受限,而使用机载系统可以获得更大的下视视场角,在实战中能有效探测和拦截低空突防的威胁目标。

传统目标识别算法难以对下视视场角的图像进行特征提取,作为端到端学习的深度学习,能够自动提取图像特征,具有较好的目标识别能力。北京理工大学的王旭辰等[1]提出基于深度学习的无人机载多平台目标检测算法,使用Darknet-53 网络作为检测器,在公开数据集UAV123 和实测数据集中进行检测,验证得到该算法在视角旋转、目标尺度变化以及障碍物遮挡下能进行稳定检测。但文中仅使用了YOLOv3 目标检测算法,并未对其进行改进,检测精度没有得到提高。电子科技大学的刘瑞[2]针对空中目标存在目标尺度及疏密程度变化大、存在重叠、遮挡等问题,提出四级复杂度的航空图像目标检测算法,采用复合扩张主干网深度和宽度的方法构建出四级复杂度的主干网络,再将主干网分别与FPN+PAN 网络、输出头网络相结合,得到空中目标检测算法。在VisDrone-DET2020 训练集下对提出的网络进行训练,将算法的mAP@[.5:.95]累计提升了0.65%,mAP@0.75 累计提升了1.41%。但仅在公开数据集上进行训练与检测,该公开数据集仅为可见光数据集,不具备红外数据集所具备的优点。严开忠等[3]针对小型无人机载平台算力受限、检测速度慢的问题,提出了一种改进YOLOv3 的目标检测算法,引入深度可分离卷积对主干网络进行改进,降低网络的参数和计算量,从而提高检测速度。此外使用K-means 生成先验框的初始聚类中心,在边界框回归中使用CIoU 损失,同时将DIoU 与NMS相结合,提高算法的检测精度。在自定义数据集中的mAP 为82%,检测速度从3.4 f/s 提高到16 f/s。但算法的检测精度和速度仍有待提高。上海交通大学的朱壬泰等[4]针对目前深度学习中多目标检测算法占用资源量大,无法在中小型无人机平台上实时运行的问题,提出了基于卷积神经网络计算优化的算法。采用深度可分离卷积对计算量进行优化,将主干网Resnet18 中的卷积层替换为深度可分离卷积,对改进的算法在公开数据集PASCAL VOC 2007 进行验证,得到在检测精度不变的条件下,检测速度达到56 f/s。但该算法在航拍数据集上的检测精度由于与公开数据集分布的差异有所下降,对航拍目标的适应性不强。周子衿[5]针对深度学习网络结构复杂,机载平台计算资源有限,以及航拍视角中小目标数量大,难以对图像特征进行提取,容易出现漏检和错检现象,对YOLOv3 网络进行轻量化处理,在网络稀疏化训练后进行BN 层的通道剪枝,此外使用K-maens++算法对先验框进行重定义,将改进后的算法在自定义的DOTA-like 数据集上进行测试,算法权重模型大小下将98.7%,使得推理时间加快了60.5%,检测速度提高了32.9%,检测精度提高1.14%。但无人机的飞行高度较低,局限于超低空域附近,所看到的视场角受限。

上述文章中均不存在多角度的空基下视红外目标,且该类目标所在环境复杂多样,为保证较高的精度和实时性,提出了一种基于单阶段的多角度空基下视红外目标识别算法。主要研究内容包括单阶段目标检测算法、针对空基下视多角度红外目标所提出的改进、多角度下视红外数据集的构建以及所提改进算法与单阶段算法的对比实验。

1 单阶段算法

根据深度学习算法是否需要经过候选框的步骤,将目标检测算法分为单阶段和双阶段两类。双阶段检测算法虽然检测精度较高,但运行速度慢,无法满足多角度空基下视红外目标实时识别的需求[6]。常用的单阶段算法有SSD[7]、RetinaNet、YOLO 等,SSD 算法检测精度较低,RetinaNet 算法检测精度得到了提升,但检测速度无法达到实时性需求。YOLO 算法在拥有较高检测精度的同时兼顾检测速度。YOLOv3 借助残差网络思想[8],将YOLOv2特征提取网络的Darknet-19 改为Darknet-53[9]。主要由1×1 的卷积层和3×3 的卷积层组成该特征提取网络。为防止过拟合,在每个卷积层之后加入一个批量归一化层和一个Leaky ReLU。Darknet-53 中的基本单元DBL 包含卷积层、批量归一化层和Leaky ReLU 三个组成部分。Darknet-53中共有53个DBL基本单元。res unit为残差单元,输入通过两个DBL,再与原输入相加。该单元能够让网络提取到更深层次的特征,并且能避免出现梯度的消失或梯度爆炸。

为实现多尺度特征融合的目的,把Darknet-53 的中间层和后面某一层的上采样进行拼接,对张量的维度进行扩充。从而得到三种不同尺度的输出Y1、Y2、Y3。Darknet-53 相比于Darknet-19,不再采用最大池化层,而是使用步长为2 的卷积层进行下采样。将BN 层和一个Leaky ReLU 加在每个卷积层后,以防止过拟合现象的发生。同时,为提取到更深层次的特征,引入残差网络的思想,可以同时避免梯度消失或梯度爆炸。为了能够进行多尺度特征融合,将网络中间层和后面某一层的采样结果进行张量拼接。

在多尺度预测方面,YOLOv3 选择三种不同形状的Anchors,每种Anchors 拥有三种不同的尺度,得到共计9种不同大小的Anchors,达到预测多尺度目标的目的。

在损失函数方面,YOLOv3 相比于YOLOv1 的损失函数,其位置损失部分仍使用sum-square error 的损失计算方法。但对于置信度损失和类别预测将原来的sumsquare error 计算方法改为交叉熵损失计算方法。

2 YOLOv3-SF

2.1 网络结构的改进

由于复合翼无人机在不同时刻采集红外图像时所处的高度不同,导致获得的图像尺寸有所差异。图像空间金字塔池化(Spatial Pyramid Pooling,SPP)[10]结构能够解决因图像区域裁剪、缩放一系列操作导致的图像失真问题,并能解决卷积神经网络对图像特征的重复提取,极大地提升了产生候选框的速度,同时节约计算成本。SPP 模块结构如图1 所示。

图1 SPP 模块结构图

SPP 模型由kernel size 为5×5、9×9、13×13 的最大池化和一个跳跃连接四个并行分支组成。借鉴空间金字塔池化思想,对YOLOv3 网络结构进行改进。在原YOLOv3网络的第5、6 层卷积之间加入一个SPP 模块,不同的池化操作组成该模块。改进后的网络结构如图2 所示。

图2 改进后的网络结构图

通过检测头前的第5 卷积层和第6 卷积层之间集成的SPP 模块获取网络中的SPP,经过SPP 模块池化后的特征图重新按通道进行拼接传入到下一层侦测网络中。该模块借鉴了空间金字塔思想,利用SPP 模块实现局部特征和全局特征,特征图经局部特征和全局特征融合后,能够丰富特征图的表达能力,有利于提升待检测图像中目标大小差异较大情况下的检测精度。使用SPP 模块优化主干网络Darknet-53 的算法用YOLOv3-S 表示。

2.2 损失函数的改进

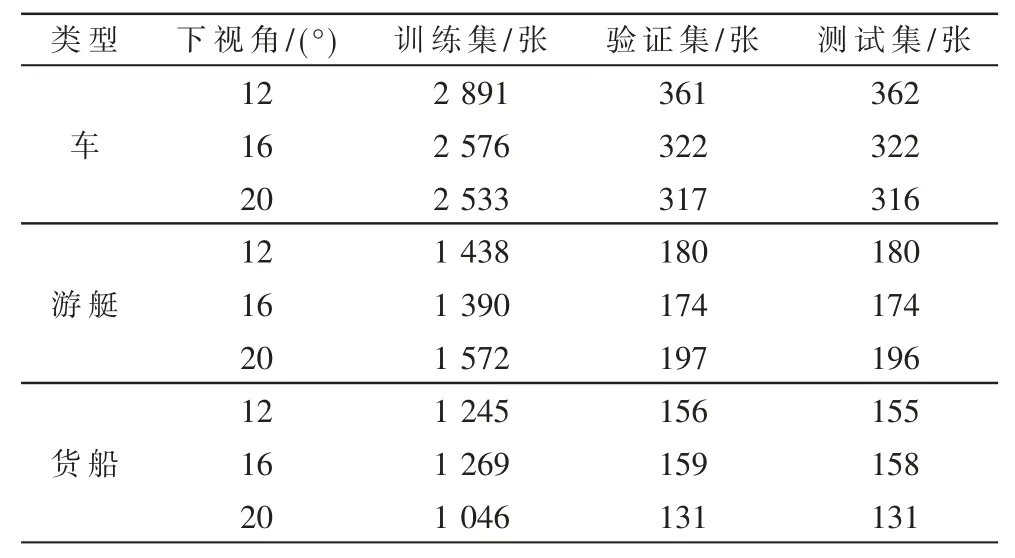

在所得的空基下视多角度红外图像中,目标较背景的占比很小,存在正负样本不平衡的现象。在训练密集目标检测器时出现严重的前景-背景类别不平衡,一步检测算法精度无法超过两步网络。但RetinaNet 的提出使得一步网络的检测精度能够首次超越两步网络,因此借鉴RetinaNet 的思想对YOLOv3 进行改进,使得改进后的算法在拥有较快检测速度的同时检测精度也得到了相应的提高。原有交叉熵损失无法抵抗类别极不平衡,易导致分类器训练失败,因此使用Focal loss[11]代替YOLOv3 中使用的交叉熵误差。在正负样本匹配方面,针对每一个Anchor 于事先标注好的GT 进行匹配,计算其IOU。若某一个Anchor 与其GT box 的IOU≥0.5,则将Anchor 标记为正样本;若某一个Anchor 与所有的GT box的IOU 值都<0.4,则将其标记负样本;若IOU∈[0.4,0.5),则将其舍弃。对于二分类而言普通的交叉熵损失(CE)计算公式如式(1)所示。

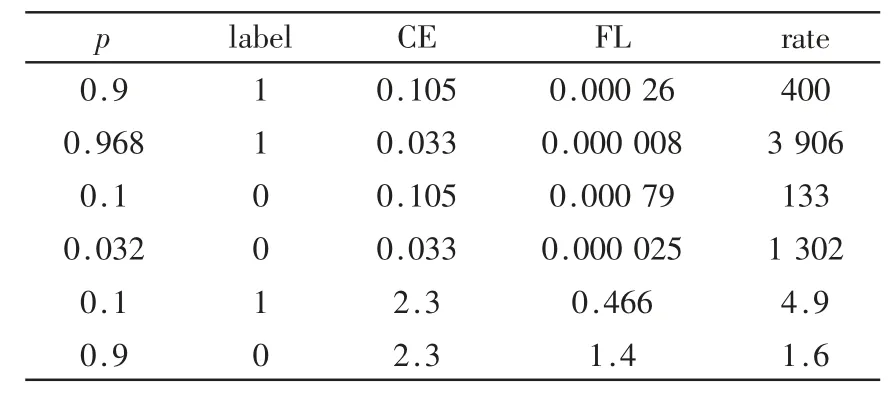

将CE 进一步简化得到式(3)。

引入针对于正样本而言的超参数α∈[0,1]和针对于负样本而言的参数1-α,以此平衡正负样本的权重,CE 的表达式可改写为式(4)。

α 虽可以平衡正负样本的权重,但不能区分困难的样本和容易的样本。因此提出能够降低简单样本的权重,从而聚焦于一些难分的负样本。引入新元素(1-pt)γ,定义Focal loss 如式(5)所示:

(1-pt)γ能够降低易分样本的损失贡献。加入(1-pt)γ平衡的超参数αt得到Focal loss 的最终形式如式(6)所示:

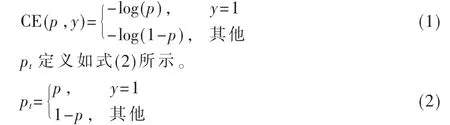

Focal loss 与交叉熵对于难分样本和易分样本对比如表1 所示。

表1 Focal loss 与交叉熵在难分/易分样本对比

其中p 为预测目标概率;laebl 为对应的真实标签,1表示正样本,0 表示负样本;CE 为针对二分类的交叉熵损失;FL 为Focal loss;rate 为采用CE 计算得到的损失和采用Focal loss 计算所得到损失的比值。由表1 可知第1,2 行正样本预测概率为0.9 和0.968 属于易分样本,p=0.9 时,其Focal loss 约为原来的CE 损失的1/400,p=0.968 时,其Focal loss 约为原来的CE 损失的1/3906;第3,4 行负样本预测概率为0.1 和0.032 也属于易分样本,p=0.1 时,其Focal loss 约为原来的CE 损失的1/133,p=0.032 时,其Focal loss 约为原来的CE 损失1/1302;第5 行对应为正样本,网络预测概率为0.1,该样本比较难学习,其Focal loss 约为原来的CE 损失的1/4.9,第6 行为负样本,网络预测概率为0.9,同样为难分样本,其Focal loss 约为原来的CE 损失的1/1.4。使用Focal loss后更加专注于训练难分的样本,而对于易分样本起到降低损失权重的作用。

总损失函数分为分类损失和回归损失两部分,见式(8):

分类损失针对所有的正负样本计算,回归损失针对所有的正样本计算。其中Lcls为Sigmoid Focal Loss,Lreg为L1损失,NPOS为正样本个数,i 为所有的正负样本,j 为所有的正样本。使用Focal loss 优化损失函数的YOLOv3 算法用YOLOv3-F 表示。同时使用SPP 模块和Focal loss函数的算法用YOLOv3-SF 表示。

3 实现与结果分析

3.1 实验平台环境

系统由复合翼无人机作为光电探测设备的空中移动平台,通过图传设备进行无线数据传输,地面配备图像处理计算机[12]。训练网络模型使用硬件平台为R7-4800H锐龙处理器,GPU 采用NVIDIA GeForce RTX 2060,采用PyTorch 深度学习框架搭建该网络。

3.2 红外图像采集及数据集构建

使用某型复合翼无人机搭载的多波段光电吊舱,采集大量海上舰船和陆地车辆红外目标,图像分辨率为640×512,多尺度无人机图像采集系统现场如图3 所示。

图3 多尺度无人机图像采集系统现场图

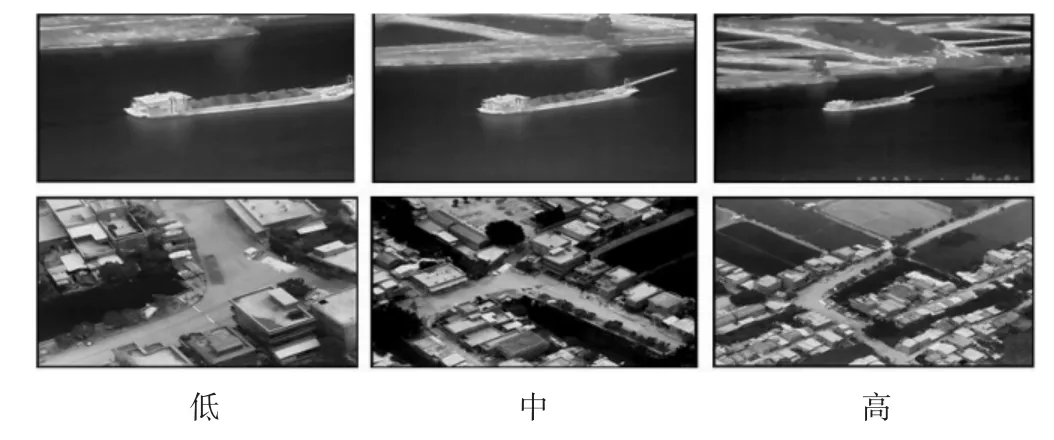

复合翼无人机分别从低(200 m)、中(300 m)、高(500 m)不同高度对复杂背景中的车辆(其中车类包含小汽车、卡车、公交车、货车)、海上的游艇、货船等多种不同类型的目标俯拍,其中包含了大、中、小三种不同尺度的红外图像。按8:1:1 的比例对数据集进行划分,为测试模型的鲁棒性,选取了一些复杂背景下不同运动速度的目标。

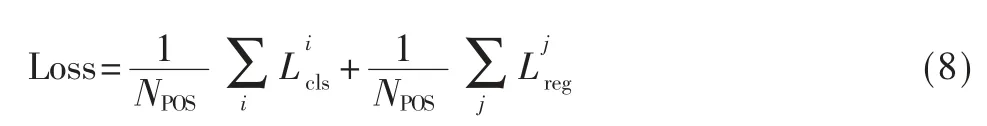

高度为200 m 的红外大图像数据集中,车类、游艇和货船的下视角为12°、16°、20°,训练集、验证集和测试集张数如表2 所示。

表2 高度为200 m 红外图像数据集

高度为300 m 的红外中型图像数据集中,车类、游艇和货船的下视角为24°、28°、32°,训练集、验证集和测试集张数如表3 所示。

表3 高度为300 m 红外图像数据集

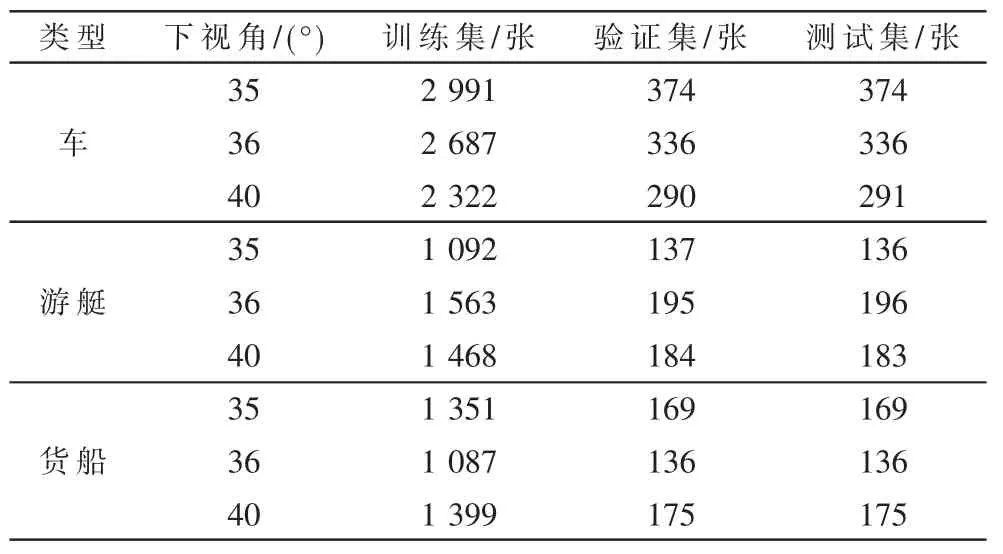

高度为500 m 的红外小图像数据集中,车类、游艇和货船的下视角为35°、36°、40°,训练集、验证集和测试集张数如表4 所示。

表4 高度为500 m 红外图像数据集

综上自定义红外数据集包括29 853 幅红外舰船图像和30 000 幅车辆红外图像。数据集的部分样本图像如图4 所示。对所采集图像中的车辆和舰船目标使用labellmg 标注软件进行标注,将标注好的带有车辆和舰船目标的红外图像送入YOLOv3-SF 网络中进行联合训练。

图4 不同高度拍摄的红外图像

3.3 评价指标

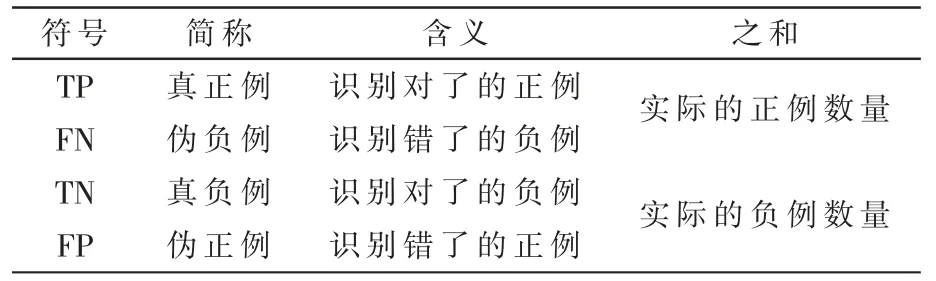

在评价指标方面选取准确率(Precision)、召回率(Recall)、AP、mAP、FPS 作为该目标检测算法的评价指标[13]。TP、FN、TN、FP 的含义如表5 所示。

表5 正、负例含义表

(1)准确率(Precision)/查准率

识别对了的正例占识别出正例的比例,其中识别出的正例等于识别对的正例加上识别错的正例,公式如下:

(2)召回率(Recall)/查全率

识别对了的正例占实际总正例的比例,其中实际总正例等于识别对的正例加上识别错的负例,公式如下:

(3)AP(Average Precision)

PR 曲线下的面积,表示召回率0~1 的平均精度。其中PR 曲线下面积越大,表示模型的性能越好。使用插值法计算PR 曲线下的面积得到AP,公式如下:

(4)mAP(mean Average Precision)

所有类别AP 的平均值,能衡量模型在所有类别上平均精度的好坏。该指标综合考虑了准确率P 和召回率R,能够解决P 和R 的单点值局限性,试算公式如下:

3.4 实验结果及分析

设置初始学习率learning_rate=0.001,迭代次数steps=100,训练过程中batch 设置为64,输入该网络的图像尺寸为416×416。在YOLOv3-SF 的训练过程中训练损失(train loss)、验证损失(val loss)的变化曲线如图5 所示,mAP 在不同模型下的变化曲线如图6 所示。

图5 损失函数变化曲线

如图5 所示损失函数总体呈下降趋势,前25 次迭代中训练损失快速下降,最后趋于稳定。对于模型的识别精度,以mAP 作为评价指标,如图6 所示YOLOv3-SF算法的mAP 最高,且变化曲线更为稳定。

图6 mAP 值在不同模型下的变化曲线

在自定义的红外图像测试集上分别选取低、中、高三种不同高度及下视角的舰船目标和车辆目标对SSD算法、YOLOv3 算法、RetinaNet 算法与YOLOv3-S、YOLOv3-F、YOLOv3-SF 算法进行测试,几种算法对比结果如图7~图10 所示。

由图7~图10 结果可以看到SSD 和YOLOv3[9]无法识别下视远距离小目标和被遮挡目标,且SSD 对于复杂背景下的红外目标识别漏检率最高;RetinaNet[14]对下视远距离小目标的识别有了一定的提升,但对遮挡目标的识别较差且存在一定的误检率;YOLOv3-SF 结合了YOLOv3-S 和YOLOv3-F 的优势,识别效果得到较大提升,对遮挡目标和小尺寸目标的识别效果最好。

图7 SSD 识别结果

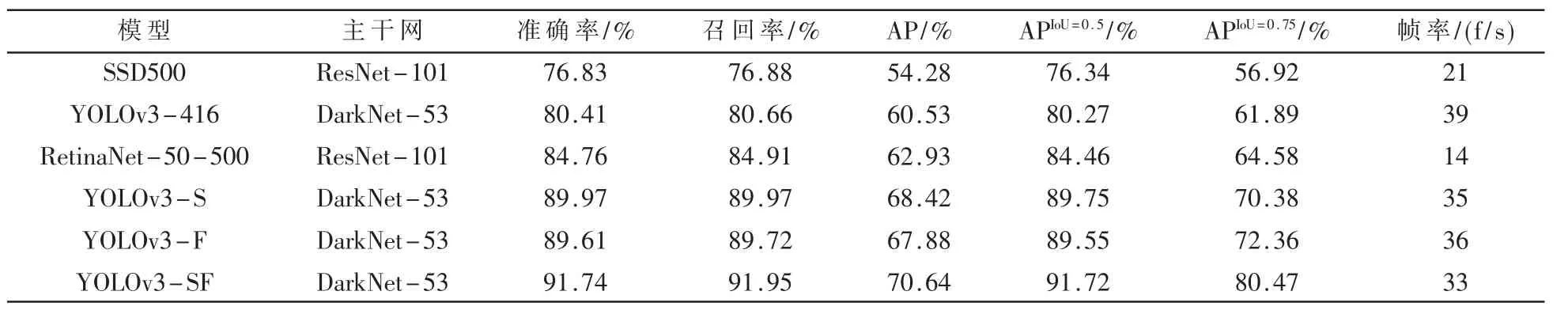

表6、表7 分别给出了红外舰船目标和车辆目标在6 种不同算法的输入图像尺寸和各类评价指标的检测结果。

在表6、表7 中的AP 为mAP 值;APIoU=0.5为IoU=0.5时的mAP 值,是voc 的评判标准;APIoU=0.75为较为严格的mAP 值,能够反映算法框的位置精准程度;FPS 为每秒帧率,即每秒内可以处理得到图片数量。

表7 红外车辆目标在不同模型上的检测结果

由各类算法的识别结果和表6、7、8 可知,在测试3 组低、中、高红外舰船图像和红外车辆图像时,YOLOv3-SF算法的识别精度最高,识别速度较RetinaNet 得到极大的提升,YOLOv3 算法识别精度较低,SSD 算法识别精度最低。说明YOLOv3-SF 算法相比于原有YOLOv3 算法在识别精度上得到较大提升,可以在提高识别精度的同时兼顾识别速度,从图10 第三列可以看出在下视背景复杂度较高的场景应用具有一定优势。

表6 红外舰船目标在不同模型上的检测结果

图8 YOLOv3 识别结果

图9 RetinaNet 识别结果

图10 YOLOv3-SF 识别结果

此外将改进算法应用于公开红外船舶数据集Maritime Imagery in the Visible and Infrared Spectrums 也得到较高的识别精度,同时保证识别速度,满足实时性的要求,识别结果如图11 所示。

图11 公开数据集识别结果

在民用目标中可以较为简单地利用无人机对目标进行多角度采集,但对于军用目标可能存在使用条件受限,无法获取多角度图像的情况。虽然识别速度会有一定提升,但识别精度会随无人机采集图像角度数量的减少有所下降。表9 给出了目标图像采集角度数量对6 种不同算法mAP 的影响。

表9 采集角度数量对不同算法mAP 的影响(%)

表8 三种尺度目标在不同模型上的mAP(%)

4 结论

复合翼无人机从低、中、高不同高度向下视角对海上舰船目标和复杂背景中的车辆目标俯拍得到红外图像。针对没有开源多角度下视红外图像数据集的特点,构建了自定义多角度下视目标数据集。同时,在原有单步检测主干网络Darknet-53 的基础上进行改进,提出了一种单阶段的多角度下视空基红外目标识别算法。借鉴空间金字塔池化思想,在原有主干网络Darknet-53 中增加SPP 模块。同时对损失函数进行改进,将原有的交叉熵损失改为Focal loss 损失,改进后的损失更加专注于训练难分的样本,对于易分样本起到降低损失权重的作用。利用构建数据集训练网络,对红外目标进行特征提取,确定目标的检测框并给出目标类型及检测精度。对SSD、YOLOv3、RetinaNet 与各改进算法进行对比测试。通过几种评价指标和识别结果的对比,提出的算法在提高识别精度的基础上,同时保证了识别速度,并且在复杂背景的目标识别方面具有一定的优势,适合于多种类型的红外目标图像识别。改进的算法可移植于机载目标识别系统中,只需向地面融合处理系统传输识别后的目标信息,在传输带宽一定的条件下提高数据传输效率和增加无人机个数,有效提高了系统稳定性,为后续空基红外目标探测识别系统的多尺度多角度目标识别提供理论和实验依据。