基于视觉SLAM的动态图像处理方法研究

2022-07-07刘文杰刘小娇姚玉波

刘文杰 ,刘小娇,付 猛,姚玉波

(中国地质调查局廊坊自然资源综合调查中心,河北 廊坊 065000)

0 引言

随着科学技术的高速发展,智能感知、移动定位等技术慢慢渗透到人们的日常生活中,SLAM技术是其中之一。SLAM技术通过系统定位,可以迅速拟定图像,完成对场景的初步构建。这种技术大多应用于不易发现、无法定位的条件,辅助安防、巡航、救援等活动,通过视觉传感技术进行环境数据的采集分析处理。因为其独到的图像处理能力,在构建动态场景及模拟地图方面具有巨大的发展前景,未来可将这种技术应用在物流运输、安保、医疗等多个基本民生行业。SLAM的构建时间很短,但该技术在获取环境信息的行业中应用广泛,例如,航天航空、无人机、航天探测等行业,其效果好、效率高,是目前对于环境处理的热门技术。

当下SLAM技术经常应用于静态的环境,但在现实条件下静态场景处理呈现效果一般,而且在工作环境中动态场景占据比重大于静态场景。为了更好地适应动态场景工作中的视觉提取,通过采用SLAM在建图过程中进行精准的定位精度调动,确保前一帧与后一帧的细化处理达到百分之八十的贴合程度。具体来看,就是在动态场景固定误差下使地图精度得到提升。

1 基于视觉SLAM的动态图像处理方法

1.1 构建ORB-SLAM2线程

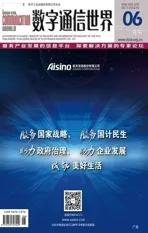

构建ORB-SLAM2线程是针对特征点进行的图像处理。ORB-SLAM2拥有较好的环境监测稳定性,可以通过ORB抓取跟踪目标的数据模型[1]。若跟踪成功则采取恒速运动模型进行追踪。若跟踪失败,将重新定位跟踪目标数据,通过对局部地图的提取,进行关键帧的决策生成,最终实现整个ORB数据处理。特征点定位的前端视觉技术,可以确保计算过程中图像提取的效率。ORB-SLAM2中ORB图像特征提取还需要相对均匀地进行数据处理,这种处理方式可以减少误差。关键帧的识别一般选择最近的地图点,创建新点后再整体进行闭环的检测和修正。通过系统的运行提取数据,确保视觉识别的精确程度。同时,对ORBSLAM2线程的优化可消除动态物体运作过程的影响。具体的线程模式如图1所示。

图1 ORB-SLAM2线程搭建

在进行ORB-SLAM2线程构建中,数据的识别可以通过对相机拍摄后的位置进行计算,通过数据库信息比对进行识别。也可以依靠视觉编辑表进行处理,根据跟踪目标的运动帧数选择相应的模型分析数据。关键帧的生成与跟踪状态和运动速度有关[2]。ORBSLAM2对关键帧的选取较宽松,在具体操作中,关键帧在选择上所满足的条件必须要达到跟踪目标的有效特征点。图像关键帧之间的间隔频率、新观测点数据、特征占比等相关因素都会影响到关键帧的选择。

关键帧选择完成后进入局部地图构造,地图初始化公示图也会进入循环监测中。循环的闭环监测融合完成后与循环结合,确保地图的全局更新,最终实现整个闭环运作的线程部署。

1.2 引入PSP网络进行图像分割

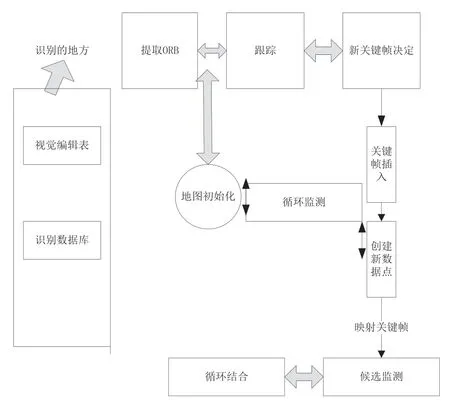

在完成图像帧数对比后进行PSP网络引入。PSP网络可以针对匹配好的图像帧来对应点数,从而达到对数据信息的站位计算,进而模拟出相应的结构化环境草图。通过根据点的深入信息探测结构环境与非结构环境的不同站位,采用 AGV相机进行深度探测。AGV摄像机能够获取多种点云数据,从而获得更好的匹配效果。若要进行对比,则可以通过不同的点云数据实现不同区域的上下优化,进而统筹全局[3]。采用PSP网络的图像网络分割技术可以有效对人体像素进行识别,并且通过分割归类。具体的神经网络在图像识别与分割的应用如图2所示。

图2 PSP图像分割

神经网络在对运动中的物体进行轮廓分割时,需要考虑不同物体运动属性的差异。在进行物体运动图像分割时,要考虑每个物体的状态[4]。例如,有的人处于静止状态,而有的人处于运动状态,要按不同类型去对待。通用的图像分割网络通过ORB抓取增加信息,预留出不同区域的图像信息对齐层,再对目标进行像素分割。

1.3 剔除动态点

在ORB采集原始图像数据后,再输入SLAM线程和PSP网络进行图像分割。这时,最基本的关键帧处理完毕,动态点在跟踪中的特征提取时,将人作为动态图像目标。经过PSP分割过的图像与在人身上的特征点进行对比。在实际操作中,剔除人的动态特征进行站位模拟分析,结合ORB-SLAM2进行局部动态帧匹配[5]。

基于此的动态点能获得优化后的空间整体的SLAM框架。获得优化后的物体位姿和空间点通过回环检测来跟踪线程。剔除动态点需要精准计算插入关键帧的时间,并且判断估算的帧数的图像站姿是否能在局部构图下实现最优化重建。

用于估算图像的相机位姿在局部建图程序下进行闭环监测,在监测中判断关键帧与剔除的动态点形成回环的程度。对通过局部优化的图像序列可以进行物体运动处理,达到深度图像分割的稀疏识别的目的[6]。稀疏识别方法是在全局控制的线程下利用物体积累动态数据进行消除漂移的。

2 实验

为了验证本文设计的基于视觉SLAM的动态图像处理方法的有效性,将与传统的技术动态图像处理方法进行比较,验证哪种方法在精度上更准确。

2.1 实验准备

在本次实验中,选用标准的T U M RG B 数据集。数据集中的图像包含3个实验动态场景,分别用A1、A 2、A 3代表。每个动态场景都匹配了高精度的数值信息。具体包括真实站姿信息和预位站姿信息。这些数据信息可以通过传感器获取。将设计构建的ORB-SLAM2线程结合SLAM技术进行了分析,在ORB处理下,数据集运行产生的测试轨迹误差。与传统对于动态图像处理方法的运行的轨迹误差进行对比分析。获取的数据大部分应用在算法实践操作。具体的操作过程如下:

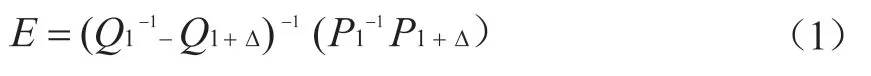

式中,Q是真实站姿;P是预位站姿;1代表时间参数; 代表时间间隔。在进行传感器获取动态数据的同时,利用动态选择的时间间隔计算出相对的站姿误差。不同计算产生的数值在衡量下分为不同的局部精度。

2.2 实验结果

本次实验主要选取传感器感应的数值进行计算,根据对不同局部区域图像数据精度产生的轨迹误差,分析具体改进方法应用后提高的百分比,具体计算公式见上文。

在视觉动态的SLAM分析处理中,一般会比较估计绝对轨迹误差、相对轨迹误差和相对旋转误差,通过将这些误差与真实轨迹的误差进行对比,哪种误差指标的偏差性小,那么其精确度就会更大。在具体分析中一些误差指标采用定量分析的方法处理数据。

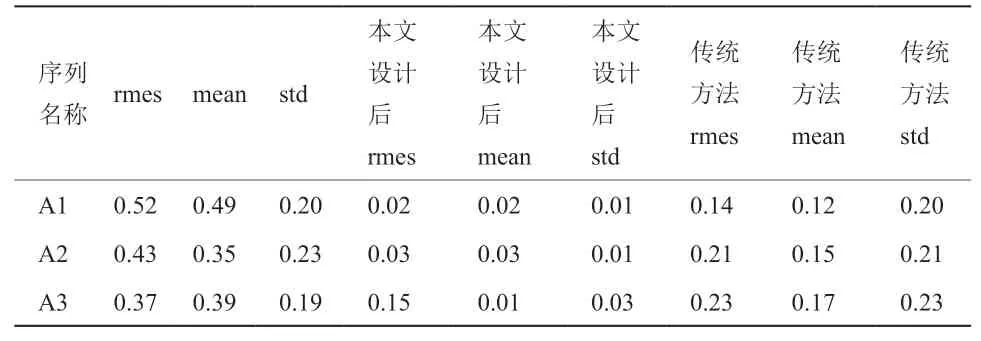

可以根据如下方式定义绝对轨迹误差和相对位姿误差。具体的数据如表1所示。

表1 绝对轨迹误差对比

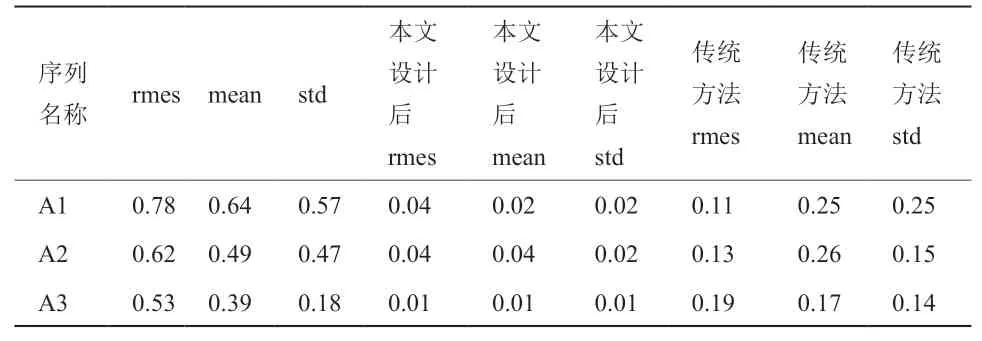

从表1和表2中的结果即可得出结论,在前三个动态场景序列下的环境下使用经过修正后的设计方式,得到的相对位姿偏差、绝对轨迹误差均出现明显下降。结合更新后的OR B-SLA M 2系统的R mes、Mean、std等数据进行了智能化处理,并进行了以下的比较。结果显示:本文设计的基于视觉SLA M的动态图像处理方法在精确程度上平均稳定数值更好,相对位姿误差和绝对轨迹误差更小,这说明设计的方法能够更好地做到动态图像的信息处理。

表2 相对位姿误差对比

3 结束语

本文为了验证基于视觉SLAM的动态处理方法的有效性,通过设计的ORB-SLAM线程和动态场景下结合PSP网络实现目标运作的图像切割技术,实现了对ORB-SLAM和图像分割的完美融合。虽然在对相对位姿误差、绝对轨迹误差在数据统计上可能做不到完全准确无误,但还是希望本文提出的研究方法能够在学术上提供一定的价值参考。■