基于通道注意力的多模态服装兼容性学习

2022-07-07魏雄闫坤

魏雄 闫坤

摘 要:针对服装图像特征提取不全面和服装兼容性难以建模等问题,提出了一种基于通道注意力的多模态服装兼容性模型ECA-RMCN。在特征提取网络CNN的残差模块上引入高效通道注意力模块ECA-Net来增强服装低级和高级等重要特征,抑制无效特征。采用组合损失函数处理服装正负样本不均衡的问题,达到更好的搭配效果。在公共的Polyvore数据集进行对比实验来验证模型有效性。实验结果表明,该算法对服装的兼容性预测和搭配性能优于其他方法,有很好的应用价值。

关键词:通道注意力;卷积神经网络;兼容性建模;组合损失函数

中图分类号:TP18 文献标识码:A文章编号:2096-4706(2022)04-0001-07

Multimodal Clothing Compatibility Learning Based on Channel Attention

WEI Xiong1,2,3, YAN Kun1,2,3

(1.Textile and Clothing Intelligent Hubei Provincial Engineering Research Center, Wuhan 430200, China; 2.Hubei Provincial Garment Informatization Engineering Technology Research Center, Wuhan 430200, China; 3.School of Computer Science and Artificial Intelligence, Wuhan Textile University, Wuhan 430200, China)

Abstract: Aiming at the problems of incomplete feature extraction of clothing images and difficult modeling of clothing compatibility and so on, a multimodal clothing compatibility model ECA-RMCN based on channel attention is proposed. The high-efficiency channel attention module ECA-Net is introduced on the residual module of the feature extraction network CNN to enhance important features such as low-level and high-level clothing, and suppress invalid features. The combined loss function is used to deal with the problems of unbalanced positive and negative samples of clothing to achieve better matching effect. Comparative experiments are performed on the public Polyvore dataset to verify the effectiveness of the model. The experimental results show that the algorithm is better than other methods in the compatibility prediction and matching performance of clothing, and it has good application value.

Keywords: channel attention; convolutional neural network; compatibility modeling; combined loss function

0 引 言

兼容性建模是服裝搭配推荐任务过程中必不可少的步骤,它直接影响了套装搭配的效果。随着网络服装业的快速发展,人们的消费观念也从线下转向线上。与实体店相比,网络平台则更加方便快捷,不受时空的制约,服装数量和种类也更多样化。但是繁多的服装数量使人们难以挑选出适合自己的衣服,降低了自己的购买欲望。利用计算机视觉技术来为用户推荐服装逐渐成为主流方法,常用的方法主要包括基于关联规则的智能搭配、基于服装视觉特征的智能搭配、基于协同过滤算法的智能搭配等[1],然而这些传统的推荐算法提取的颜色、纹理和形状特征不明显,也未考虑将图像信息和语义信息结合,影响了推荐的搭配效果,因此有必要采取更加有效的服装搭配推荐方法。

近些年,人工智能和机器学习技术在服装领域得到了很好的应用。现有的服装搭配方法主要基于深度学习的服装搭配和基于用户个性化的服装搭配。在深度学习服装搭配中,运用机器学习方法通过深入挖掘服装信息之间的交互行为等大量数据,从中学习服装之间的潜在联系。先前的工作主要研究成对服装[2-4]。他们认为服装的兼容性问题可以通过度量学习来解决,将服装特征映射到某个特定的风格空间,通过估计风格向量之间的距离来预测服装搭配效果。例如McAuley[4]等人利用CNN提取服装的视觉特征并将其嵌入潜在空间,接着将成对服装在潜在空间的距离作为服装间的搭配性度量。针对未考虑一整套服装之间的兼容性关系,Han[5]等人更关注序列对的服装搭配,他将上衣、裤子、鞋子和配饰看成一个有序的序列,训练一个Bi-LSTM模型通过学习上一件服装的特征信息有序的预测下一件服装并考虑套装之间的兼容程度。后来,一些学者认为一套服装之间更像一个集合,这些单品之间没有固定的序列关系,将它们看成一个序列也很难反映出单品间的复杂关系。针对这个问题,崔泽宇等人[6]用有向图表示服装,他认为图结构可以更好地反映服装单品之间的复杂关系。首先用一个子结构来表示一套服装,然后对节点间的交互进行建模并学习节点的信息交互。在用户个性化的服装搭配上除了考虑服装的兼容性关系外,还融入了用户的外在因素。在基于场景的服装搭配中,Ma等人[7]根据情境化的服装概念学习模块,获取场合、服装类别和属性之间的依赖关系。除此之外还引入了一个弱标签建模模块来减轻人工标注任务。考虑到根据自己的身材挑选合适的服装是不可忽视的穿衣技巧,与传统的研究体型和服装风格之间的关系和学习体型测量的嵌入方法不同,Hsiao等人引入了ViBE[8],该方法捕捉不同体型的特征,根据个人的体型选择特定的服装。由于不同的人对不同风格的服装有不一样的偏好,如何将用户偏好因素纳入搭配模型中得出良好的搭配效果也是一个挑战。现有的个性化推荐任务除了利用矩阵因子分解(MF)框架外,song等人[9]基于服装—服装和用户—服装间的交互,从总体美学和个人偏好的角度提出了一种综合的个人偏好建模方法。然而这些方法存在特征提取不精确和未考虑整体套装兼容性的缺陷。03E69849-66FA-488A-A3B1-77A92F2904C7

基于上述存在的问题,我们在MCN网络的基础上增加了几个模块。首先在CNN残差块上引入ECA模块来提升重要特征,加强对颜色、纹理、形状、风格特征的权重分配,以提升推荐精度;设计交叉熵损失和Dis损失相结合的组合损失函数来解决服装图像像素正负样本不平衡的问题,从而获得更好地搭配效果。

1 相关工作

1.1 注意力机制

注意力机制是增强深层CNN的有效手段,用来提升CNN的性能。其核心目标是从众多信息中选择出对当前目标任务更为关键的信息[10]。近几年,注意力模型(Attention Model)被广泛使用在自然语言处理、图像识别、语音识别等各种不同类型的深度学习任务中。注意力机制最初在2014年作为RNN(Recurrent Neural Network)中编码器—解码器框架的一部分来编码长的输入语句,后续被广泛运用在RNN中[11]。2018年hu等人提出了SE-Net(Squeeze and Excitation Network)网络结构,SE-Net中的关键结构SE-Net block利用了注意力机制的思想,显式地建模特征图之间的相互依赖关系,并通过学习的方式来自适应地获取到每张特征图的重要性[12]。后来Wang等人提出了ECA-Net[13](Efficient Channel Attention Network)来实现对SE-Net block的改进,提出了一种不降维的局部跨信道交互策略(ECA block)和自适应选择一维卷积核大小的方法,通过一维卷积层汇总跨信道信息的方法获取更加精确的注意力信息。Qing[14]等人提出了一种融合有效通道注意网络(MRA-NET)的多尺度残差卷积神经网络模型用于高光谱图像分类。Zhou[15]等人提出了一种用于烟雾车辆检测的高效空间注意网络(ESA-Net),通过权值组合得到每个ResNet块的特征空间表示。受到他们的启发,本文引入ECA-Net模块更好地提取服装的重要特征。

1.2 服装兼容性建模

研究服装兼容性的基础是服装识别。先前的工作通过服装分割方法和人体姿态信息相结合来解析、检索服装类型[16,17]。Wang等人为了解决用户照片和在线产品图像之间的领域鸿沟,提出一种在孪生深度网络中流行的对比损失来提高检索性能[18]。后来Al-Halah等人[19]提出一种非负矩阵分解方法将提取的服装特征投影到特定的服装风格空间。Lee等人[20]提出一种Style2Vec服装向量表示模型来学习服装上下文信息。Hisao等人[21]提出一种无监督的方法来学习服装风格,其方法基于主题模型将服装属性视为文字,服装视为文档,风格视为主题来学习潜在的服装风格一致性。

服装兼容性建模是研究服装搭配推荐的关键要素,其最终目的是根据服装的图像与文本信息来对套装的一个整体评价。Veit等人[22]提出了端到端的孪生神经网络通过进一步改进距离度量学习来预测服装的搭配度。Li[23]等人提出了一个层次时尚图(HFGN)框架通过构建基于用户-套装交互和套装-单品映射的层次结构来学习服装兼容性。Song等人[24]提出了一种基于内容的神经方案(BPR-DAE)用于上衣和下装匹配的兼容性建模,通过一个双重自动编码器网络联合建模时装不同形态之间的一致性关系与服装之间的隐含偏好。后来,Song等人[25]认为现有的研究忽视了服装搭配的规则,提出了一种基于注意知识提取的神经相容性建模方案,阐述了如何将丰富的服装领域知识整合到纯数据驱动学习中来增强兼容性建模的性能。

2 基于通道注意力的服装兼容性建模

2.1 MCN网络

多层比较网络(Multi-Layered Comparison Network,MCN)[26]通过端到端的方式学习服装兼容性,主要工作流程是先预测套装的兼容性,然后利用反向传播梯度进行搭配诊断。该网络主要分为四个部分:利用CNN的多个卷积层的深度连接特性来提取服装不同方面的特征;构建比较模块比较多个层次特征之间的成对相似性,有效的集合多特征的方法来学习服装的兼容性;运用多层感知器(Multilayer Perceptron,MLP)根据输入的成对相似性来计算服装的兼容性得分;采用反向传播梯度梯度来近似每对商品的相似度的重要程度,从而找出套装中不兼容的服装单品。MCN网络结构如图1所示。

2.2 残差模块

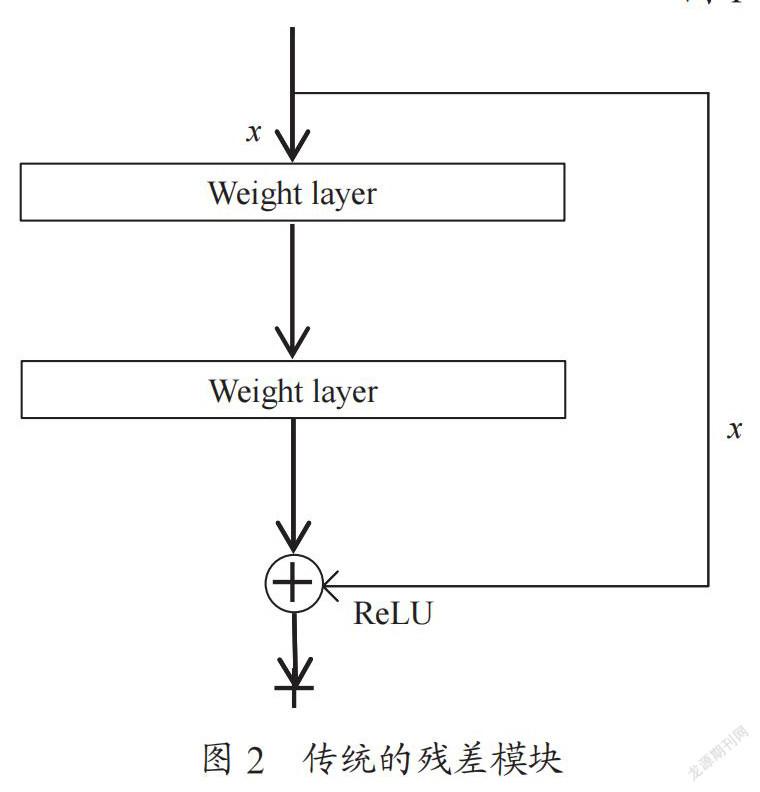

为了从服装图像中提取出更多细节特征,解决复杂图像中低对比度区域及细小纹理、颜色等欠识别的问题,引入改进的残差模块替代传统的残差模块(Residual Block)。引入残差模块的目的是防止后续随着神经网络的加深使得在利用小批量随机梯度下降法訓练网络时产生梯度消失,导致网络模型训练无法收敛的问题[27]。传统残差模块由两个卷积层和ReLU激活函数组成,本文为提高网络的泛化能力优化了残差模块,在每个卷积层之前加入批量归一化(Batch Normalization,BN)层和ReLU激活函数用于防止过拟合现象的发生。在卷积层中间加入ECA-Net层为每个特征分配不同的权重。传统的残差模块如图2所示。优化后的残差模块结构如图3所示。

2.3 ECA模块

虽然残差模块强化了特征的传播能力,有效地提取出更多服装纹理细节信息,但复杂背景下低层特征中缺少语义信息,分布不均衡,仍会对服装纹理的特征提取造成干扰。为了解决这个问题,我们通过引入通道注意力网络ECA模块(Efficient Channel Attention,ECA-Net)[28]来捕获复杂纹理信息,该模块的核心思想在于特征权重的学习,增强有效特征权重、抑制无效或者效果小的特征权重,从而增强了网络的特征提炼能力,提高模型的服装搭配精度。ECA-Net结构示意图如图4所示。03E69849-66FA-488A-A3B1-77A92F2904C7

在图4中,给定空间维度H×W×C特征图x经过全局平均池化(Global Average Pooling,GAP)压缩为1×1×C的特征图,然后通过执行大小为k的一维卷积生成每个通道的权重(其中k通过通道维数C的映射自适应确定),再经过ReLU激活函数将权重值控制在0到1之间,最后通过乘法逐通道加权至特征中,完成对原始特征的权重分配,输出新的特征图。ECA-Net是基于SE-Net的改进,在经过SE的全局均值池化后,ECA-Net会考虑每个通道及其k个近邻,通过一维卷积快速完成通道权重的计算。K代表了在一个通道权重的计算过程中参与的近邻数目,考虑到k值会影响ECA计算的效率和有效性,提出了自适应计算k的函数。在嵌入各种注意力模块的对比中,ECA-Net通过引入极少参数可明显提升模型的搭配效果,不会加大模型的计算复杂度。服装纹理图像较为复杂,利用该模块为输入特征图各特征通道赋予权重,增强任务相关像素权重,可以弱化背景和噪声影响,从而获得更精确的纹理特征。

2.4 改进的BOW模型的文本特征提取块图

词袋模型[29](bag of words,BOW)最早出现在自然语言处理与信息检索领域,近年来被广泛运用在计算机视觉中。传统的服装搭配任务只学习图像特征,然而视觉信息和文本信息是相辅相成的,将两者结合起来有利于更好地学习服装兼容性。BOW使用一组无序的单词来表示一段文字,将文本信息视为若干个词汇的集合,忽略其语法和语序等要素。由于提取到的文本特征不够完整,我们在原有的BOW模型后面添加了一个全连接模块,最后生成一个4×1 000维的文本特征向量。改进的BOW结构如图5所示。

2.5 改进的MCN兼容性学习方法

为了更好地预测服装的兼容性及对不兼容套装的搭配诊断,本文将ECA-Net和残差模块嵌入改进的MCN,提出了一种改进的服装搭配网络ECA-RMCN(Efficient Channel Attention Residual Network MCN)。模型总体架构如图6所示。ECA-RMCN网络结构与 MCN网络结构类似,其引入改进的残差模块替代传统的残差模块,然后在主干网络中引入ECA模块对输入特征映射进行重要特征的权重分配,然后输入下一层进行相似性比较。文本信息提取网络为BoW。

我们将上衣、裤子和鞋子等这些不同类型的成对类型组合投影到不同的子空间来学习他们的相似性。假设fij=y(wi,wj)表示wi和wj的相似性,投影相似性计算公式如下:

y(wi,wj)=d(Pi→(i,j)wi,Pj→(i,j)wj) (1)

其中Pi→(i,j)为配对组合(i,j)的第i项投影,d为余弦相似性。根据相似性计算公式,我们可以根据以下公式预测兼容性:

Pi→(i,j)wi=RELU(wi ? m(i,j))(2)

其中m(i,j)是和特征wi相同维度的掩码向量,线性整流函数(ReLU)作为激活函数。

采用反向传播梯度来近似每个关于不兼容的相似性的重要性。假设一套有N件单品的颜色特征集合,其中ci是第i项的向量。构造其特征间的成对相似性n×n的比较矩阵R,对k个不同特征的比较有k个不同的比较矩阵。通过将矩阵R中的所有元素输入到两层MLP中来计算服装的兼容性得分,其计算公式如下:

(3)

其中,S和矩阵R之间的非线性矩阵有更好的预测性能,我们用S的导数来近似表示每个输入相似性的重要性。假设我们标记不兼容套装为0,来解释与不相关的每个相似性的重要性。若不兼容套装为0,则使用相反的。我们使用所有相似性的梯度来计算每个套装的重要性:

(4)

其中wq是第q项的搭配重要性。在不改变原来的构图下通过替换导致服装最不兼容的单品使得套装更兼容。在训练过程中,我们使用sigmoid函数为兼容性概率的输出分数建模并使用二进制交叉熵作为损失函数:

Lc=y · logσ(s)+(1-y)· log(1-σ(s))(5)

3 实验

3.1 实验环境

本文实验环境在Ubuntu 16.04操作系统上进行相关实验,实验基于PyTorch的深度学习框架,Python版本在3.5.2及以上,硬件平台为Intel I9-9900X;Nvidia GTX2080Ti;96 GB内存。

3.2 数据集

本文使用Polyvore数据集对ECA-RMCN模型的评估。该数据集包含21 889套服装,其中17 316套用于训练,1 497套用于验证,3 076套用于测试。其中还包含164 379件服饰单品,每一件单品包含服饰图像和相对应文本描述。在训练过程中,一套服饰中的平均时装数量是6件。在文本描述上,我们删除出现次数少于30次的单词,从而生成2 757大小的文本词汇表。在Polyvore上服饰单品的顺序为上衣、裤子、鞋和配饰。

3.3 实验细节

在实验中,输入的服装图像大小是224×224。输入套装的可变长度大小从3到5,空白部分由该类型的平均图像处理。我们设置额外损失权重λ{1,2,3}分别为5e-3,5e-4,1。输入的每个batch有32套服装,初始学习率为1e-2,每10轮的衰减系数为0.2。采用动量为0.9的梯度下降算法。最后仅保留验证集上有最佳性能的模型参数。

3.4 评价指标

为了定量评估服装预测及搭配模型的性能,采用AUC(Outfit Compatibility Prediction)、FIFB(Fill-in-the-blank)作为评价指标。

AUC:服装兼容性预测任务的目标是通过模型得出一个分数判断其整体兼容性。本文提出的ECA-RMCN模型通过端到端的方式从輸入的服装图像中计算出套装兼容性预测分数。我们随机从测试集中选择6 000套服装,采用ROC曲线下面积来比较不同的方法性能。03E69849-66FA-488A-A3B1-77A92F2904C7

FIFB:服裝填空任务是从一组候选服饰单品中选择与服装空白处最为搭配的服饰单品,通过回答问题的准确性来评估模型性能。在实验中,每个问题有4个选项,对于空白部分,选择得分最高的选项作为答案。此任务的目标函数可表示为:

(6)

其中R是所有选项的集合,n是我们要填入的空白位置。

3.5 实验结果与分析

3.5.1 定性实验

为了可视化展示模型的训练效果,实验中服装搭配效果图如图7所示。由图可以看出经过残差模块、全连接模块、ECA-Net增强服装的有效特征对套装的搭配起到了良好的作用。

3.5.2 定量实验

Pooling[30]:使用平均池操作聚合输入特征的可变长度来预测兼容性Concatenation[31]:通过将5个单品特征连接为一个长度1 000×5的长向量,使用MLP作为二元分类器。这里设置隐藏层的大小为1 000。CSN[32]:一种度量成对兼容性的学习方法。根据不同类型组合条件下的投影嵌入距离计算兼容性。套装兼容性是所有成对兼容性的平均值。

Bi-LSTM+VSE[33]:通过每一步LSTM消耗一个CNN编码的特征输出一个隐藏状态和下一个单品的预测。兼容性得分是预测项与真实项之间的交叉熵。它联合优化了前向LSTM、后向LSTM损失和VSE损失。

Self-Attention[34]:采用自我注意机制来关联一套服装中的不同单品计算出该套装的表示形式。这里使用缩放的点乘注意力[35],其中查询、键和值是同一套装中的单品特征。

从表1中的数据可以看出,Bi-LSTM+VSE和Self-Attention这两个方法的AUC均低于80%,FITB精度均低于50%。本文的方法在AUC上提高到了91.6%,FITB精度则达到了61.5%,证明了我们方法的先进性。

4 结 论

本文基于MCN提出了一种改进的服装搭配模型ECA-RMCN,它在视觉语义嵌入、多模态特征提取模块、多层相似性比较与兼容性预测模块和服装搭配学习模块四个方面学习服装的整体兼容性关系。运用有效通道注意力(ECA)的多层特征提取图像—文本信息,有效地捕获服装的各个方面特征。通过比较CNN多层网络中的服装相似性预测服装的兼容性并对其不兼容的套装中的单品进行替换。在未来,我们将融入用户的个人偏好因素到模型中使得套装既符合日常搭配,还能满足个人的偏好需求。

参考文献:

[1] 纪丹丹,戴宏钦.服装搭配方法研究综述 [J].现代丝绸科学与技术,2020,35(4):31-35.

[2] VEIT A,KOVACS B,Bell S,et al.Learning visual clothing style with heterogeneous dyadic co-occurrences [C]//Proceedings of the IEEE International Conference on Computer Vision.2015:4642-4650.

[3] HE R,PACKER C,MCAULEY J.Learning compatibility across categories for heterogeneous item recommendation [C]//2016 IEEE 16th International Conference on Data Mining (ICDM).Santiago:IEEE,2016:937-942.

[4] MCAULEY J,TARGETT C,SHI Q,et al.Image-based recommendations on styles and substitutes [C]//Proceedings of the 38th international ACM SIGIR conference on research and development in information retrieval.New York:Association for Computing Machinery,2015:43-52.

[5] HAN X,WU Z,JIANG Y G,et al.Learning fashion compatibility with bidirectional lstms [C]//Proceedings of the 25th ACM international conference on Multimedia.New York:Association for Computing Machinery,2017:1078-1086.

[6] CUI Z,LI Z,WU S,et al.Dressing as a whole:Outfit compatibility learning based on node-wise graph neural networks [C]//The World Wide Web Conference.2019:307-317.

[7] MA Y,YANG X,LIAO L,et al.Who,where,and what to wear? Extracting fashion knowledge from social media [C]//Proceedings of the 27th ACM International Conference on Multimedia.New York:Association for Computing Machinery,2017:2019:257-265.03E69849-66FA-488A-A3B1-77A92F2904C7

[8] HSIAO W L,GRAUMAN K.ViBE:Dressing for diverse body shapes [C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition.Seattle:IEEE,2020: 11059-11069.

[9] SONG X,HAN X,LI Y,et al.GP-BPR:Personalized compatibility modeling for clothing matching [C]//Proceedings of the 27th ACM International Conference on Multimedia.New York:Association for Computing Machinery,2019:320-328.

[10] 朱豐,胡晓峰,吴琳,等.从态势认知走向态势智能认知 [J].系统仿真学报,2018,30(3):761-771.

[11] 梁斌,刘全,徐进,等.基于多注意力卷积神经网络的特定目标情感分析 [J].计算机研究与发展,2017,54(8):1724-1735.

[12] 耿磊,邱玲,吴骏,等.结合深度可分离卷积与通道加权的全卷积神经网络视网膜图像血管分割 [J].生物医学工程学杂志,2019,36(1):107-115.

[13] WANG X,SUN Z,ZHANG W,et al.Matching user photos to online products with robust deep features [C]//Proceedings of the 2016 ACM on international conference on multimedia retrieval.New York:Association for Computing Machinery,2016:7-14.

[14] QING Y,LIU W.Hyperspectral Image Classification Based on Multi-Scale Residual Network with Attention Mechanism [J].Remote Sensing,2021,13(3):335.

[15] ZHOU J,QIAN S,YAN Z,et al.ESA-Net:A Network with Efficient Spatial Attention for Smoky Vehicle Detection [C]//2021 IEEE International Instrumentation and Measurement Technology Conference (I2MTC).IEEE,2021:1-6.

[16] YAMAGUCHI K,KIAPOUR M H,BERG T L.Paper doll parsing:Retrieving similar styles to parse clothing items [C]//Proceedings of the IEEE international conference on computer vision.IEEE,2013:3519-3526.

[17] YANG W,LUO P,LIN L.Clothing co-parsing by joint image segmentation and labeling [C]//Proceedings of the IEEE conference on computer vision and pattern recognition.IEEE,2014:3182-3189.

[18] WANG X,SUN Z,ZHANG W,et al.Matching user photos to online products with robust deep features [C]//Proceedings of the 2016 ACM on international conference on multimedia retrieval.New York:Association for Computing Machinery,2016:7-14.

[19] AL-HALAH Z,STIEFELHAGEN R,GRAUMAN K.Fashion forward:Forecasting visual style in fashion [C]//Proceedings of the IEEE international conference on computer vision.Venice:IEEE,2017:388-397.

[20] LEE H,SEOL J,LEE S.Style2vec:Representation learning for fashion items from style sets [J/OL].arXiv:1708.04014.(2017-08-14).https://arxiv.org/abs/1708.04014.

[21] HSIAO W L,GRAUMAN K.Learning the latent” look”:Unsupervised discovery of a style-coherent embedding from fashion images [C]//Proceedings of the IEEE International Conference on Computer Vision.Venice:IEEE,2017:4203-4212.03E69849-66FA-488A-A3B1-77A92F2904C7

[22] VEIT A,KOVACS B,BELL S,et al.Learning visual clothing style with heterogeneous dyadic co-occurrences [C]//Proceedings of the IEEE International Conference on Computer Vision.Santiago:IEEE,2015:4642-4650.

[23] LI X,WANG X,HE X,et al.Hierarchical fashion graph network for personalized outfit recommendation [C]//Proceedings of the 43rd International ACM SIGIR Conference on Research and Development in Information Retrieval.New York:Association for Computing Machinery,2020:159-168.

[24] SONG X,FENG F,LIU J,et al.Neurostylist:Neural compatibility modeling for clothing matching [C]//Proceedings of the 25th ACM international conference on Multimedia.New York:Association for Computing Machinery,2017:753-761.

[25] HAN X,SONG X,YAO Y,et al.Neural compatibility modeling with probabilistic knowledge distillation [J].IEEE Transactions on Image Processing,2019,29:871-882.

[26] WANG X,WU B,ZHONG Y.Outfit compatibility prediction and diagnosis with multi-layered comparison network [C]//Proceedings of the 27th ACM International Conference on Multimedia.2019:329-337.

[27] 常惠,饒志强,赵玉林,等.基于改进U-Net网络的隧道裂缝分割算法研究 [J].计算机工程与应用,2021,57(22):215-222.

[28] WANG Q,WU B,ZHU P,et al.ECA-Net:efficient channel attention for deep convolutional neural networks [C]//CVF Conference on Computer Vision and Pattern Recognition (CVPR).Seattle:IEEE,IEEE.2020.

[29] ZHANG Y,JIN R,ZHOU Z H.Understanding bag-of-words model:a statistical framework [J].International Journal of Machine Learning and Cybernetics,2010,1(1-4):43-52.

[30] LI Y,CAO L,ZHU J,et al.Mining fashion outfit composition using an end-to-end deep learning approach on set data [J].IEEE Transactions on Multimedia,2017,19(8):1946-1955.

[31] TANGSENG P,YAMAGUCHI K,OKATANI T.Recommending outfits from personal closet [C]//Proceedings of the IEEE International Conference on Computer Vision Workshops.Venice:IEEE,2017:2275-2279.

[32] VASILEVA M I,PLUMMER B A,DUSAD K,et al.Learning type-aware embeddings for fashion compatibility [C]// Proceedings of the European Conference on Computer Vision (ECCV).Cham:Springer,2018:390-405.

[33] HAN X,WU Z,JIANG Y G,et al.Learning fashion compatibility with bidirectional lstms [C]//Proceedings of the 25th ACM international conference on Multimedia.New York:Association for Computing Machinery,2017:1078-1086.

[34] WANG X,GIRSHICK R,GUPTA A,et al.Non-local neural networks [C]//Proceedings of the IEEE conference on computer vision and pattern recognition.Salt Lake City:IEEE,2018:7794-7803.

[35] VASWANI A,SHAZEER N,PARMAR N,et al.Attention is all you need [J].NIPS17:Proceedings of the 31st International Conference on Neural Information Processing Systems.New York:Association for Computing Machinery,2017:6000-6010.

作者简介:魏雄(1974—),男,汉族,湖北武汉人,副教授,CCF 会员,博士,研究方向:并行计算、纺织服装大数据等;闫坤(1997—),女,汉族,湖北黄冈人,CCF 会员,硕士在读,研究方向:图像处理。03E69849-66FA-488A-A3B1-77A92F2904C7