改进区域建议的遥感图像目标检测方法研究

2022-06-09姜德文和晓军

姜德文,和晓军

(沈阳理工大学 自动化与电气工程学院,沈阳110159)

基于卷积神经网络(Convolutional Neural Network,CNN)的目标检测模型在自然场景数据集PASCAL VOC[1]、MS COCO[2]、ImageNet[3]等上已经取得了非常可观的检测效果。随着科技的发展,获得的遥感图像与自然背景图像在色彩上差异不大,分辨率差异也在不断缩小,这使得常用的目标识别算法应用到遥感图像检测成为可能[4]。但遥感图像在高空拍摄,高度不固定,图像存在视野大、背景复杂、目标尺度多样、目标方向任意的问题[5],直接将自然图像识别算法应用在遥感影像检测,达不到相同的检测精度。因此,在应用过程中需要对算法模型做针对性的改进以提高识别效果。

检测模型从结构上可分为两种:一种是基于区域建议的方法,包括Faster R-CNN[6]、R-FCN[7]、Mask R-CNN[8]等,该种方法先提出可能含有目标的区域建议,再基于这些建议进行分类和坐标回归;另一种是基于回归的方法,包括YOLO[9]、SSD[10]、RetinaNet[11]等,该种方法通过目标检测器对目标进行实例预测,把检测过程简化为一个回归问题。相比较而言,基于区域建议方法检测过程中对目标进行了两次筛选,在检测速度上不如基于回归的方法,但对于复杂的检测环境适应性好,检测准确率较高[12]。

殷文斌[13]在Faster R-CNN的基础上,融合级联算法,提高了对于飞机目标的检测准确率。Xu Y L等[14]将卷积网络提取的深层特征与浅层特征相融合,减少了识别过程中的小目标丢失。戴媛等[15]在Faster R-CNN基础上,加入旋转区域推荐,应对目标的任意方向问题。Yang X等[16]在Faster R-CNN的基础上加入多维注意力网络抑制背景噪声,并在损失函数中添加交并比因子,从而解决边界框回归问题。

从目前的检测效果看,目标的尺度多变是影响检测结果的一个重要因素,由于遥感图像中目标的大小不一且小目标较多,在检测过程中很容易漏检。本文基于常用的区域建议模型Faster R-CNN进行改进,通过对特征的深度提取和多尺度的融合,减少检测过程中小目标的丢失问题,同时更换特征提取网络,整体提高模型性能。

1 检测模型原理

Faster R-CNN共由四部分组成,包括特征提取层(Conv)、区域建议层(Region Proposal Network,RPN)、感兴趣区域池化层、分类层和区域回归层。具体流程是:先通过特征提取层由输入的图片得到特征图,并传入RPN层,该层在特征图上以每个像素点为中心,放置n个不同尺度的锚点框,通过分类预测和尺度回归预测获得每个框含有目标或背景的概率以及尺度的调整信息。接着利用建议算法在锚点框中挑选出可信度最高的2000个感兴趣区域(Region of Interest,ROI),完成第一阶段的区域建议输出。第二阶段使用感兴趣区域池化层对得到区域的尺度进行统一,将ROI平均划分为同样数量的子区域,对每个子区域实施池化操作,这样就使得每个子区域都映射为一个像素值。由于不同尺寸的ROI都划分了同样数量的子区域,最终使得所有ROI都变为同样大小,从而得到固定尺度的区域建议。最后,通过归一化指数函数层对区域中的目标进行具体分类,并再次使用坐标回归方法,对坐标框进行微调,得到输出结果。Faster R-CNN目标检测流程如图1所示。

图1 aster R-CNN目标检测流程图

2 检测算法改进

2.1 特征提取网络

在遥感图像中,单张图像均包含大量的背景信息,在很大程度上影响检测结果。如收费站、服务区等建筑在俯视图下与普通房屋相近。因此,需要提取更多的特征信息以更加准确地分辨目标。

在特征提取网络中,深层网络比浅层网络能够提取到更多复杂特征。Faster R-CNN原模型中使用特征提取网络VGG16,卷积层较少,难以充分获取图像中的目标特征。本文采用更深的特征提取网络ResNext[17]替换VGG16以提高模型的特征提取能力。

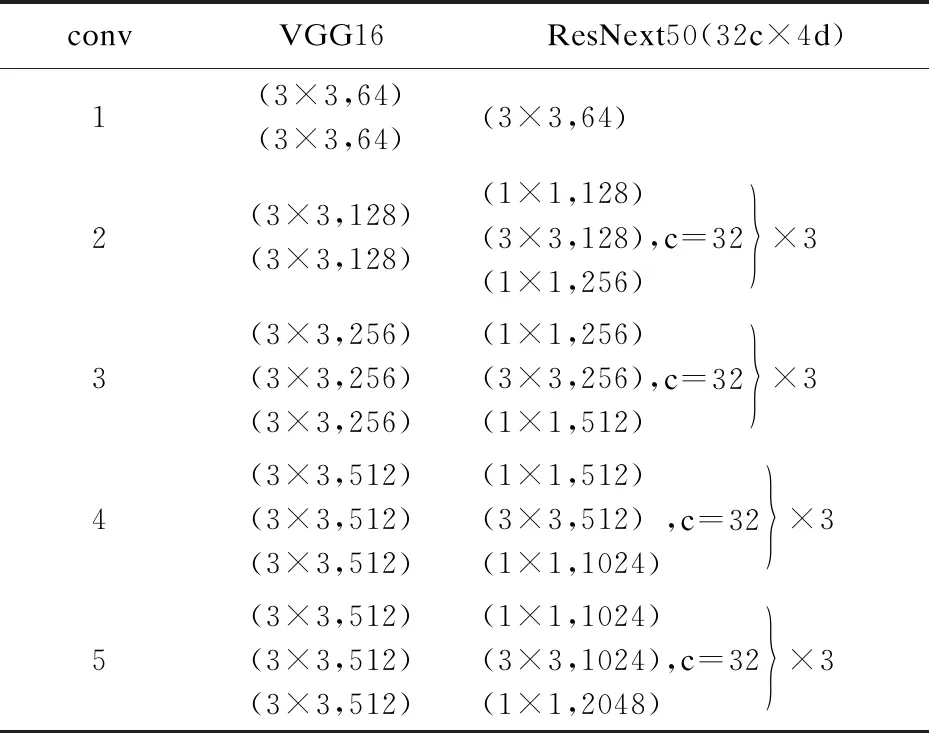

ResNext是以残差网络ResNet为基础的改进网络,在结构上增加并行卷积层加深网络,并行的拓扑结构都是相同的,不需要进行人为设计,并且残差结构能够有效解决网络加深后出现的退化问题。常用的ResNext层数有50、101、152,从性能上看,随着深度的不断增加,特征提取能力不断增强,考虑到训练和验证的时间成本,使用ResNext50(32c×4d)进行对比实验。特征提取网络的卷积层结构(卷积核尺寸,输出通道数)如表1所示。

表1 VGG16与ResNext50特征提取网络结构对比

表1中c为并行卷积块的个数,d是每个卷积块内部特征图传递的深度。为保证提取到的特征图尺度能够与Faster R-CNN检测模型相匹配,将conv1中的卷积核调整为3×3,由于需要完成检测任务,去掉了全连接层。网络主干由49个卷积层组成,每个卷积层之间包含激活函数和卷积核为2步长为2的卷积层的池化层。以800×800的输入图像为例,每层的特征图输出长宽分别为[800,400,200,100,50]。

2.2 特征信息融合

在遥感图像中,目标的尺度变化很大,在像素面积上可能相差上千倍,模型需要完成对不同尺度目标变化的分类和定位。通过对卷积网络不同层提取到的特征进行分析可知,浅层的特征图卷积和池化次数少,图像的分辨率较高,目标的位置和细节信息更多。深层的特征图经过了多次卷积与池化,目标的边界信息模糊,像素减少,但包含更多的语义信息。因此,按Faster R-CNN方法通过卷积的最后一层获得图像特征图进行识别会忽略掉许多小尺度目标信息,从而降低小尺度目标识别准确率。

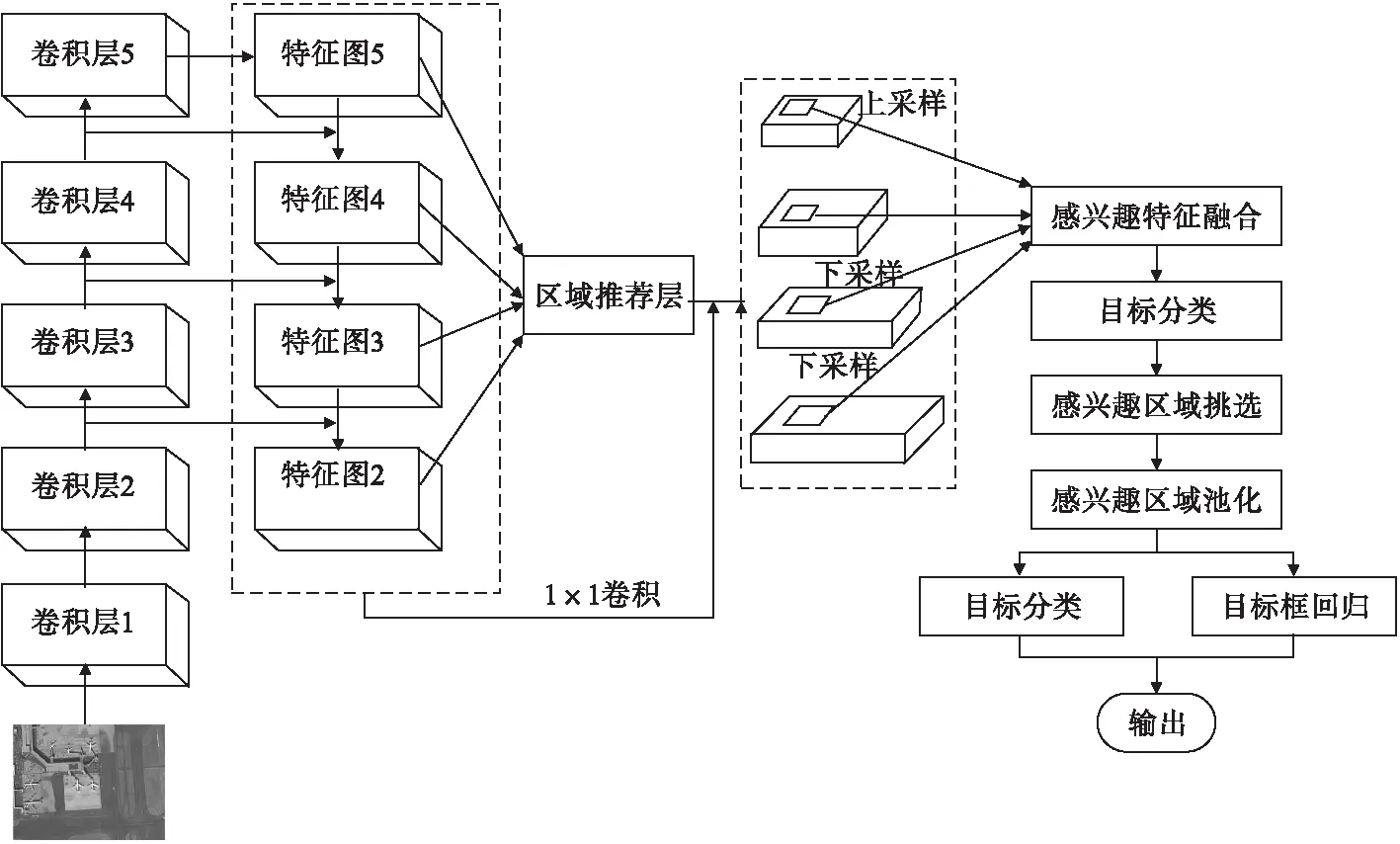

特征金字塔(Feature Pyramid Network,FPN)[18]方法利用卷积神经网络在正向传播过程中的尺度变化构建特征金字塔,通过自顶向下的融合方式得到不同尺度的特征图,再送入后续的检测层中分别进行检测。这种方法能够显著提高具有多尺度目标图像的检测精度,减少小目标丢失。然而,检测的目标都是在融合后的某一尺度的特征图上得到,并没有综合考虑该目标在其他尺度特征图上的信息,由此本文在FPN结构的基础上做如下调整:在模型中将每个尺度选出的目标框进行汇总,对于每个目标框,将其在不同尺度上对应位置的特征进行融合,融合后的目标框再一次使用二分类预测,然后使用感兴趣区域挑选层选出最终的区域建议。

具体过程是:首先,通过RPN层对不同尺度的特征图P2、P3、P4、P5分别进行预测,得到每个尺度下的建议区域。然后,获取每个建议区域在不同尺度上对应位置的特征。以P5层中8×8的区域建议为例,其在每层的对应区域的尺度分别为[8×8,16×16,32×32,64×64]。在特征融合时需要保证特征图在各维度上尺度统一,因此,先使用1×1的卷积核将特征通道数统一为512,然后,以P4特征图尺度为标准,将P5的特征使用双线性插值法进行上采样,P3、P2的特征使用平均值池化进行下采样。最后将融合各尺度特征的区域建议通过分类层进行重新分类,基于新的分类得分进行筛选,得到最终的区域建议。整体的改进模型结构如图2所示。

3 实验与结果分析

具体实验环境如表2所示。

表2 实验环境

图2 改进模型结构

3.1 数据集

遥感图像目标检测数据集[19]中包含800×800尺寸的23463张遥感图像,共有192465个水平框标注的目标,包括飞机、机场、车辆、船、桥、篮球场等共20种类别,图像对地分辨率为0.5~30m。数据集中图片在多种不同的天气、季节、成像条件和图像质量下采集,能够综合评估检测模型对于图像变化的鲁棒性。

实验使用的数据集各类别分布情况如图3所示,其中训练集共5862张图片,包含32591个实例目标;验证集共5863张图片,包含35434个实例目标;测试集共11738张图片,包含124440个实例目标。实验中使用训练集和验证集对模型进行训练,使用测试集测试模型性能。

图3 数据集类别数目统计图

3.2 评估指标

本文中以最常用的平均准确率(Mean Average Precision,mAP)值作为评估指标。mAP为各类别检测结果准确率(Average Precision,AP)的平均值,准确率由精确率和召回率计算得到。

精确率Precision和召回率Recall分别为

(1)

(2)

式中:TP为检测结果判定为正样本的正样本数;FP为判定为负样本的正样本数;FN为判定为负样本的负样本数。

AP值为

(3)

式中P(r)为Precision-Recall曲线函数。

3.3 网络训练与测试

训练中使用翻转和旋转操作进行样本增强,锚点框的尺度为[8,16,32],长宽比为[0.3,0.5,1,2]。动量优化器的学习率和动量值分别为0.001和0.9。

将改进后的各模型在相同的环境下进行实验,为保证实验数据的准确性,实验结果取5次结果的平均值,检测结果如表3所示。

表中A模型为Faster R-CNN原模型,B为在Faster R-CNN基础上将特征提取网络替换为ResNet50并加入FPN,C为在B的基础上加入了改进的FPN。D为本文的整体改进模型,在Faster R-CNN的基础上加入了改进的FPN,并使用ResNext50作为特征提取网络。

总体上看,改进方法有效提升了模型性能。

表3 各模型检测结果

从各类别的检测效果看,改进的FPN能够有效提高小目标的检测准确率,如飞机、船、车等,由C模型的结果可以看出,改进后的FPN在多个类别的检测准确率上比原方法有小幅提升。D模型加入ResNext后,由于特征提取能力的提升,在港口、收费站、网球场等多个类别检测准确率都有所提高,与A模型相比,mAP值提高了10.9%,与B模型相比,提高了1.6%。

图4为A模型与D模型对测试集中两张遥感图片的识别结果对比。

图4 模型检测结果对比

从图4可见,改进后的模型识别效果明显提升,小目标的识别率更高。

4 结论

根据目前遥感图像目标检测存在的问题,在aster R-CNN目标检测模型基础上,使用ResNext50替换原有特征提取网络,加入FPN算法并进行了改进。通过实验结果可以看出,修改后的模型对于小目标的检测效果有明显提升。

由于FPN的介入,使网络模型需要关注更多尺度的目标信息,在大尺度目标较多的体育场、服务区类别上,修改后的D模型不如原模型,今后可在此基础上做针对性的改进,进一步提高遥感图像数据集识别准确率。