航战座舱显控交互研究进展与人机协同发展趋势

2022-05-27吴晓莉张蓝牛佳然刘潇韩炜毅

吴晓莉,张蓝,牛佳然,刘潇,韩炜毅

【院士专栏:国防装备设计与制造】

航战座舱显控交互研究进展与人机协同发展趋势

吴晓莉a,b,张蓝a,牛佳然a,刘潇a,韩炜毅a

(南京理工大学 a.设计艺术与传媒学院 b.工业互联网研究院,南京 210094)

为了应对态势信息急速增长的复杂空战环境,人机协同作战应运而生,座舱显控交互是实现人机协同方式的通道,对快速取得战场优势,完成作战目标有着重要影响。梳理了航战座舱显控系统的发展、相关代表人物与研究成果;基于人机协同作战环境中面临的挑战,探究座舱显控的研究现状与趋势;从座舱显控界面信息表征设计和交互的实现形式方面归纳梳理人机协同作战下的座舱显控交互设计研究热点;提出未来座舱显控交互的发展趋势。航战座舱显控交互与人机协同作战密切相关。在智能技术支持与人机协作需求的共同驱动下,人机协同作战下的座舱显控交互向着任务相关、信息呈现、认知融合的界面设计与多通道的交互手段相结合的方向发展。

座舱显控设计;交互技术;人机协同

随着人工智能技术的迅猛发展,信息化战争和技术的发展使战机承担的任务进一步多样化和复杂化,感知能力、打击手段和防护技术日益信息化和智能化,无人智能军事装备需求也随之增加。人机协同作战应运而生,成为了一种既符合时代需求,又综合人机优势的新型作战方式[1]。在新型空战环境下的飞行员不仅是战斗人员,也是决策者,面临着完成包括态势感知、指挥决策、与无人机编队协同作战等任务。飞行员与无人系统形成良好的协作关系,对取得战场优势、完成作战目的至关重要。战机的座舱显控系统作为现代航空作战的重要工作系统,是进行信息输入和输出的重要交互通道。新型“人机协同”作战方式关系着显控交互界面信息呈现和视觉表征的变化,以及交互方式的演变。人机协同作战座舱显控交互研究从战机座舱显控系统的发展历程出发,基于人机协同作战所需要面临的挑战与相关现状研究,探究座舱显控交互的研究热点、前沿方向,为未来座舱显控交互发展提供参考与思路。

1 战机座舱显控系统的发展

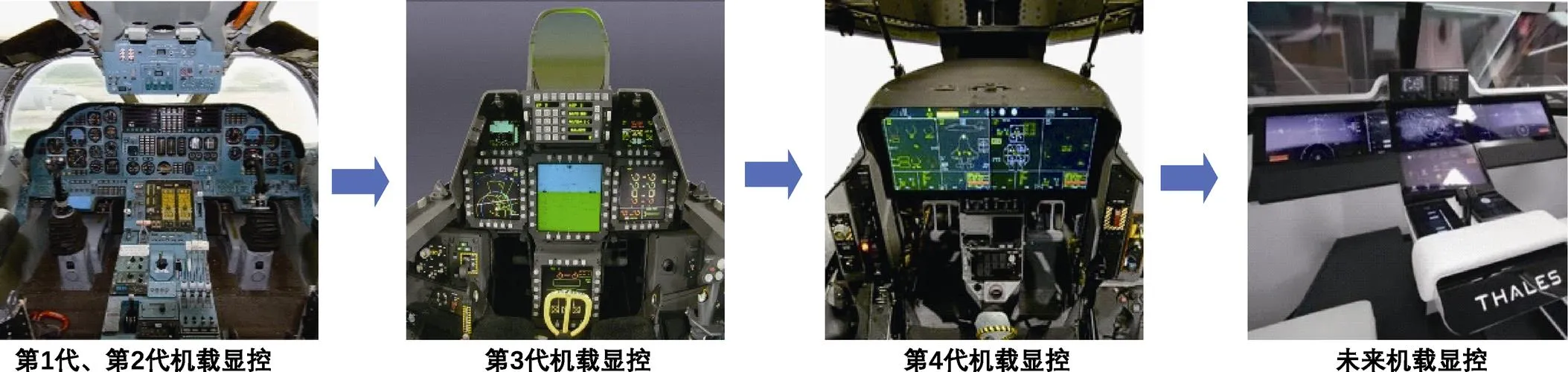

战机座舱显控系统人机交互的发展主要经历了以下阶段:以仪表盘显示为主的第1代、第2代纯硬件座舱显控系统;以电子显示器和综合控制系统形成的第3代座舱显控系统;综合运用计算机技术,采用大屏显示器、头盔显示器等多种显示设备形成的第4代智能座舱显控系统。

在20世纪40年代至70年代,第1代、第2代机载设备刚出现显控席位的分化。受技术限制,这一阶段的系统主要通过仪表、机械旋钮、开关等完成电台通讯、方位显示、敌我识别及火控瞄准等任务[2]。人机交互主要是仪表盘进行信息输出,机械按钮进行信息输入的模式。1973年,头盔显示系统(HMDS)第1次装备在美军当时的主战机上,先进的性能引起了世界各国的注意,头盔显示器的诞生给天空作战带来了新的技术革命[3-4]。随着现代人机工程学的发展,第2代战斗机后期开始重视仪表信息显示与操作按钮布局的一致性,机载显控系统的人机工效研究也逐渐得到了相关领域的重视。为了解决仪表板日益拥挤的问题,工程师在第2代机电伺服仪表的基础上对飞行仪表进行综合,也对指示相关信息的仪表进行综合,减少仪表数量;同时将无线电导航和其他经过计算机加工的指引信息综合进相关的显示器中,形成第3代飞机仪表,即综合指引仪表。综合指引仪表不但可以显示飞机综合的实时状态信息,同时还通过指引信息告诉飞行员如何正确操纵飞机,以达到预定飞行状态或目的地[5]。第3代头盔显示系统首次采用虚拟成像技术,可直接将虚拟画面投射到驾驶员的面罩上,配合计算机图像和数据处理运算技术,具备了实时呈现画面的能力。

以人工智能、大数据为代表的信息技术在军事领域广泛应用,现代战争形态演变不断突破,向着机械化、信息化、智能化的方向发展。进入21世纪,触屏及语音交互的方式取代了烦琐复杂的硬件按钮操作,更为清晰的数字化屏幕也为信息显示提供了更大的发展空间。第4代新型战斗机的机载设备通过更大、更清晰的数字化屏幕呈现出更加多样的信息内容。这一时期的人机交互主要通过数字屏幕进行信息输出,通过语音、触摸屏和简洁的按键等多通道进行信息输入。未来飞行员头盔的发展趋势是研制功能强大、集综合性防护于一体的头盔系统,全息投影技术也会逐渐发展成熟并应用于头盔显示器中[6]。历代战机座舱显控界面见图1。

对战机座舱显控系统的发展,各领域的研究人员针对人因工效、人机交互、座舱显示技术、人机协同等方面进行了一系列研究。总结20世纪80年代至今具有代表性的人物及研究成果,其研究成果引用量较高,为座舱显控发展提供了理论依据或技术支撑,见表1。

军事技术的发展促使战场环境复杂性的大幅提升,如F–35的大屏幕显示器将远不能满足飞行员获取信息数据流的显示需求,而未来战斗机为了隐身,会减小座舱空间,进而缩小座舱显示面积[25]。座舱内的系统控制器将尽可能简化,除了保留一些控制飞行的基本操作杆和少数与安全相关的控制器,其余的操控功能都将集成到显示器中。未来的显示器将采用一体化大屏幕显示,可以自动显示所需的相关信息,并能够连续调整数据信息的显示布局,大大提高飞行员的态势感知,降低其在控制显示、数据理解与融合的负荷。同时在座舱内运用多通道人机控制技术,采用按键控制、声音控制、触摸控制、手势控制和眼控等多维度控制方式,尽可能缩短飞行员的操作时间,提升飞行员操作的自由性与便捷性[26]。在战机头盔方面,由于头盔显示器加强了飞行员的肉眼态势感知能力,所以未来战机可以取消平显及其电源和光学系统,以加强大尺寸显示器上电子态势感知的显示空间,从而使战机座舱变得透明,成为不阻碍飞行员视野的“玻璃座舱”[27]。

图1 战机座舱显控界面发展历程

表1 座舱显控代表性研究成果

Tab.1 Representative research results of cockpit display control

由于四代机、五代机在软硬件和作战场景方面都有较大的变化,在有人机的任务环境中融入无人机协同作战,形成有人机/无人机智能协同作战体系,充分发挥人的决策优势与无人机本身优势的互补作用,将是未来空战的主要作战方式[28]。未来战机在新型战场环境中面临需要密切配合,完成包括态势感知、指挥决策与智能AI作战辅助打击的任务情境下,飞行员除了作为战斗人员外又充当决策者的身份,与无人机、人工智能协同作战。同时随着无人自主技术的发展,未来战机将在软硬件各方面都有更大的提升,无人装备将在未来战争中发挥越来越重要的作用,人机协同由此可拓展为人与机器协同、人与人工智能协同的基本形式。

2 战机座舱人机协同研究进展

2.1 人机协同作战面临的挑战

在新型作战概念、自主武器装备军事需求及人工智能技术驱动下,无人作战飞机的智能化程度和自主性均得到了显著提升,具备了较好的机动轨迹规划与跟踪控制等方面的能力。然而,在不确定、多任务、高威胁的现代强对抗作战条件下,现阶段无人作战飞机仍然面临程序规划决策的难题[29-30]。为了能快速占据作战优势,取得战斗成果,将具有战术宏观决策优势的有人机与具有技术微观规划和控制优势的无人机组合形成有/无人机协同作战,这将是未来空中作战的必然趋势。

随着现代战争形态的不断演变,空战战况复杂多变,敌我双方博弈激烈,战场信息瞬息万变。信息化的军事作战使战场观察和探测的范围急剧扩张,战场态势的信息容量爆发性增长,同时智能化军事装备使未来战争进入“秒杀”时代,意味着对飞行员完成战场态势认知与决策判断的速度提出了更高的要求。雷达探测与电子对抗的动态博弈进一步影响了作战过程中态势信息的获取能力,虚假和不完整的信息会降低飞行员态势认知的准确性和可靠性[31]。覆盖海、陆、空、天、电等多维空间的多军种联合作战形式使作战任务更加复杂,各种参战力量关系高度耦合并且相互关联,作战手段随着跨域力量的协同运作更加丰富多样[32]。飞行员不仅需要识别海量态势信息,同时要兼顾其他各方力量的能力需求,实现多方力量的同步协同作战[33]。然而面对“信息爆炸”与动态变化的作战态势信息显示,受限于飞行员生理、智力及心理极限,难以在极短时间内完成对海量战场态势信息的认知理解与任务的判断决策。在空战中,飞行员造成失误的主要原因是控制操作失误、错误判断、忽略显示数据等[34],因此在具有高度对抗特性的复杂动态现代空战中,建立合理的人机协同作战座舱显控交互机制显得尤为重要。

人机协同作战是指发挥作战人员与军事智能系统或者军事装备各方的优势,强调人机互补增能,在充分运用人的智能决策判断的基础上,发挥智能化无人作战力量的超限、精确、机动等优势,最终实现高效、精准完成作战任务的目的。在航空领域,人机协同作战出现了2种合作模式。

1)飞行员与智能辅助系统的人机协同模式。以美军的“飞行员助手”战术辅助决策系统[35]为代表,通过基于人工智能技术的智能辅助系统向飞行员整合战场态势信息,帮助飞行员快速做出关键性决策。

2)飞行员驾驶的有人机与无人机编队之间的有/无人机协同模式。以忠诚僚机[36]为代表,在多机编队中,有人机作为长机,带领无人机编队执行作战任务,负责无人机编队的规划决策等任务。有/无人机协同作战,利用无人机高机动性、低成本、隐身性能高的优势,充分发挥了飞行员的自主决策综合判断的能力,通过人机协作配合,既提高了有人机的生存能力,又延伸了战场态势的探测距离和攻击距离,大大提高了编队的作战效能。美国国防部[37[38]-39]认为有人机和无人机及其他无人装备联合组成的协同编队作战将成为未来战争作战模式的新趋势。

2.2 人机协同作战座舱的研究现状与趋势

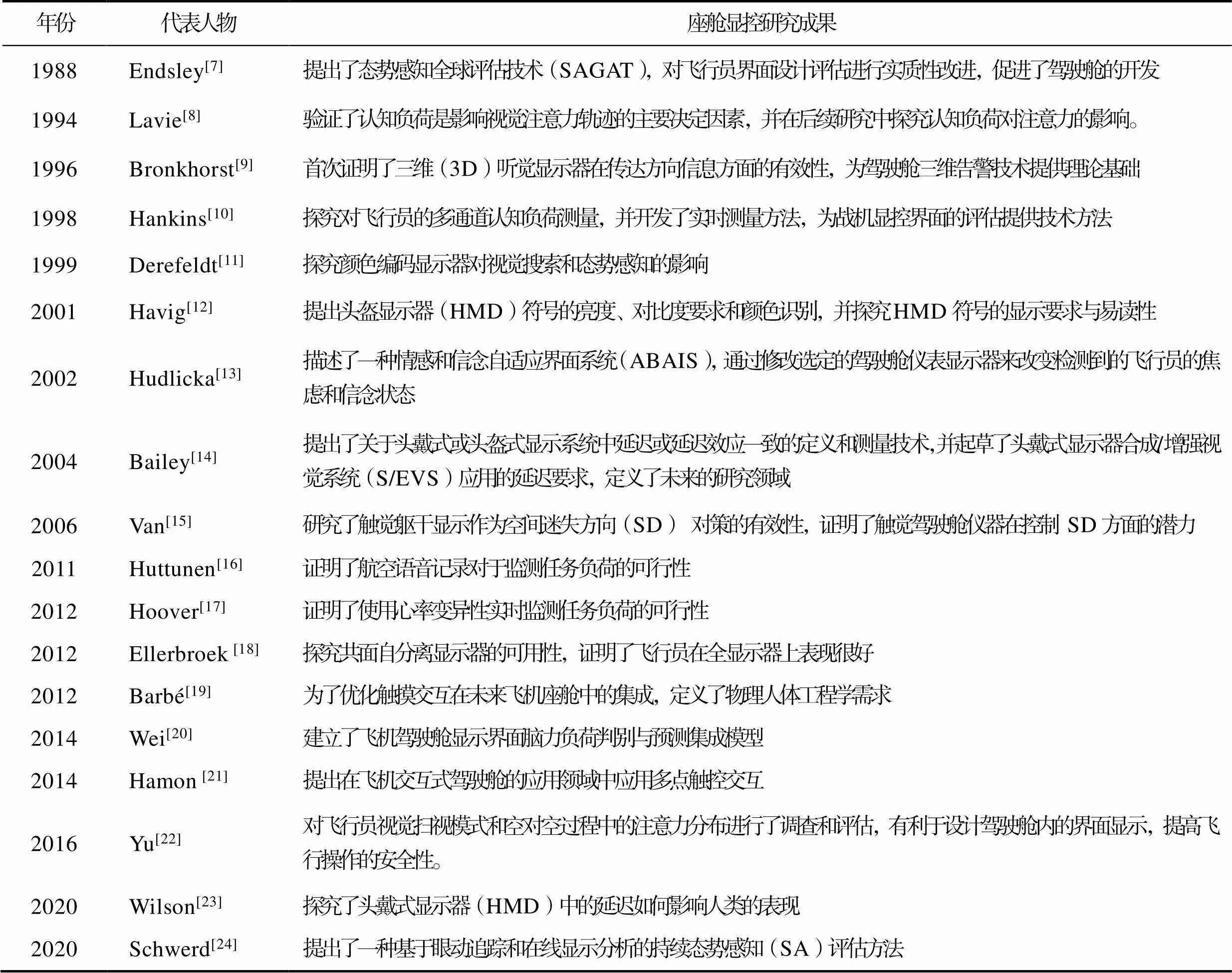

在“Web of Science”数据库中以“人机协同(Man-Machine Coordination)”“有/无人机协同(Manned/Unmanned Cooperative)”为关键词对近20年的文献进行检索,分别检索到403篇、70篇文献。“人机协同”的主要研究方向为工程科学、计算机科学、神经科学、行为科学、心理学等。“有/无人机协同”主要研究方向为工程科学、自动化控制系统、机器人、计算机科学等。对比两者研究方向可以发现,“有/无人机协同”与“人机协同”的研究是相似的,两者存在很多相同的研究方向,见图2。通过比较,“人机协同”受到各个领域的极大关注,并且进行了深入的调研,已经取得了一定的研究成果,而近年来关于“有/无人机协同”的研究相对较少,并且还未涉及神经科学、行为科学、心理学等人因学科领域。

随着分布式作战、马赛克战、联合全域作战等新型作战概念的提出,人机协同作战受到关注。战机座舱作为机载信息的汇总中心,是与飞行员进行信息互通、实现人机交互的重要通道,在人机协同作战过程中发挥着重要作用。Walsdorf等[40]研究座舱中的认知辅助系统用来帮助飞行员进行态势认知、计算决策等任务,减少人机协同作战过程中飞行员的认知负荷和心理负担。Onken等[41]提出认知辅助系统解决飞行员认知出错的问题,使座舱设计符合“以人为中心的自动化(Human-Centred Automation)”。Pitchammal等[42]基于以人为本的自动化技术,提出应用于座舱的中央控制器,实现人机之间的智能合作。Svenmarck[43]通过研究座舱传感器系统的目标跟踪、分类、识别能力,帮助提高飞行员人机协同作战的态势感知能力。Brand等[44]通过使用自适应学习技术来支持飞行员执行有人–无人团队任务。Ohlander等[45]基于团队合作模型,探究多机任务中团队合作要素的关系,为座舱显示系统设计提供指导。可以看出,人机协同作战座舱向智能化、人性化的方向发展。从人因工效角度,基于人工智能技术探究人机协同作战辅助系统的设计研发,帮助飞行员减少认知负荷,提高人机交互效率,以指导智能化座舱设计。

国内学者不断推进人机协同座舱的自主管理、协同作战的实现与效能评估验证体系的构建。王伟等[46]从时间、逻辑、功能3个维度对任务间的协同关系进行形式化描述,建立任务协同关系的综合度量模型。通过设置任务协同度阈值的方法,并对协同紧密的任务进行聚合,实现了任务分解的优化。张杰勇等[47]基于有人/无人机协同作战C2分析,分析了辅助决策、人机协同等关键技术,对协同作战指挥控制系统技术展开研究。王坦等[48]通过对有人/无人协同作战典型模型的分析,结合OODA任务环,建立了有人/无人协同作战效能评价指标体系。董彦非等[49]根据混合编队的作战过程和特点,提出了一种建立有人机/无人机协同空地攻击效能评估的综合指数模型。Fan等[50]通过分析抽象网络的特征参数,将指标体系与复杂网络相结合,提出了一种协同作战效果定性定量的评价方法。

图2 “人机协同”与“有/无人机协同”研究方向对比

and " manned/unmanned cooperative "

头盔显示器(Helmet-Mounted Display,HMD)是基于虚拟现实、增强显示等技术支持的先进显示设备,将飞行员的视觉认知行为的过程与装备显示相结合,实现实时呈现、实时观察,在现代空战显示设备中占据重要地位。针对HMD的研究,基于技术设备的支持展开了显示界面交互人因工效研究。Niklas等[51]针对夜间、眩光、大雾等环境下使用多传感器组合加强HMDs的视觉显示效果。Zhang等[52]基于增强现实技术改进了MHD的光学系统,为飞行员提供清晰的字符信息或视频图像。傅亚强等[53]针对HMD的符号系统评价进行了研究,提出的头盔显示器具有强化感知能力、提高作战效率、降低工作负荷等优势。王永生等[54]探讨了HMDs的任务特点,基于人因工效设计构建了HMDs的人机交互模型。

3 人机协同下的座舱显控交互设计研究

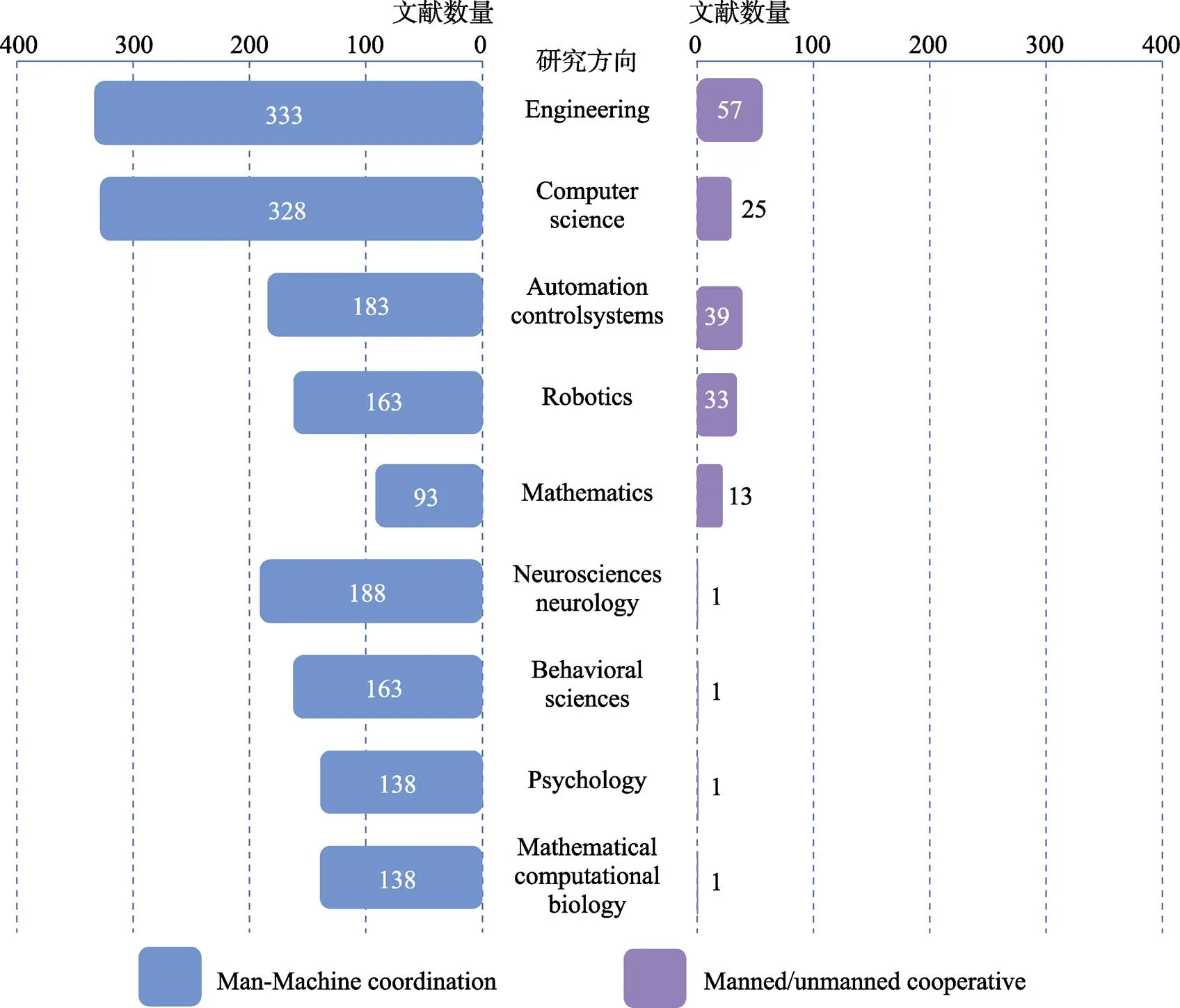

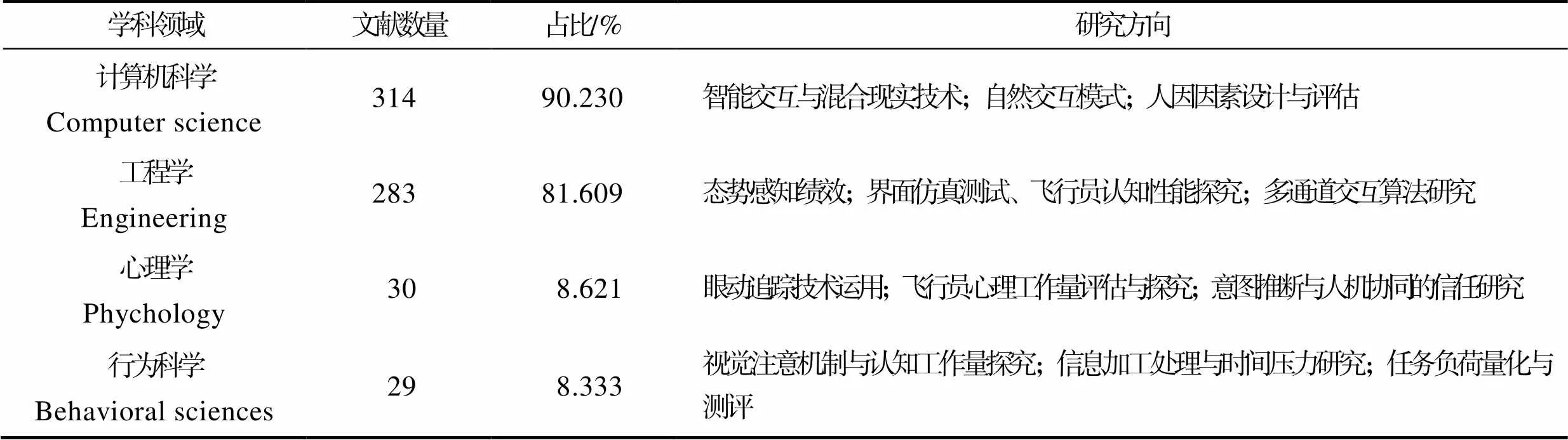

在“Web of Science”中以“Human-Computer Interaction”“Interactive Technologies”“Interaction Design”等为关键词进行检索,共查询到文献2 121篇,见图3。由图3可以看出在人机交互中研究最为广泛的领域为计算机科学,其次为工程、教育、数学等,其中与座舱交互相关的领域可以追溯和覆盖到计算机学、行为科学、心理学、神经科学等。从文献发表数量来看,排名靠前的国家有美国、中国、德国等;在航空座舱交互的领域内,可查阅到文献348篇,见表2。总结归纳后得出,其中大多从交互实现的技术、方法与交互形式等方面入手,采用的研究途径有生理实验测评、仿真测试、硬件设备开发与智能科技的研发。

航战座舱数字化界面是承载显控系统及态势信息的重要载体,在未来战场面临的智能协同作战任务情景下,无人机、人工智能系统的信息数据将不断融合。人机协同随着无人自主技术的快速发展将拓展出人与无人机作战协同、人与高自动化机械设备协同、人与AI人工智能体协同等形式。航空领域的人机协同共生模式探索是从人因规范、界面交互、系统设计与评估等方面展开的[55]。在人机协同作战环境下战机座舱在人机工效与智能化程度等方面有待加强,包含状态信息的显示方式[56]、合理的信息编码[57]、高度的自动化程度[58],以及对机组数据整合的作战需求。因此,基于新一代人机协同作战下的座舱交互研究,包含显控系统信息呈现机制与视觉表征设计、交互设计理论方法、交互手段,以及先进交互技术设备等方面的文献。

图3 “web of science”中人机交互的研究学科领域

表2 “座舱交互”在“web of science”中的研究进展(学科领域存在交叉)

Tab.2 Research progress of "Cockpit Interaction" in "web of science" (Interdisciplinary)

3.1 座舱显控界面信息表征设计

国内外针对人机界面的信息表征设计主要集中在研究信息的编码元素与呈现形式,以及界面信息的层级化设计、内容的一致性与认知上的关联性方面,通过认知科学、心理学与设计学的理论交叉融合分析,总体上而言在信息的可视化表征、感知与认知机制,以及系统架构的梳理方面已具有一定的研究基础。

首先在交互信息的视觉呈现与表征方面,国内外大多从人机界面设计理论出发,研究交互界面的图符、色彩、布局、风格样式等。Michalski等[59]研究了图形对象的电子屏幕界面设计及其几何特征对用户任务效率的影响。Chen等[60]研究了界面排列布局、距离和图标大小3个因素对用户搜索性能的影响。Cui[61]深入分析设计图标和认知的各种因素如何影响顾客的注意力分布和认知负荷分布,探索顾客的视觉搜索特征和策略,了解视觉注意力分布规律和视觉信息处理情况,形成与图标设计和认知影响因素相关的视觉搜索模型。Wu等[62]探究了雷达态势界面的信息形状与色彩组合特征对认知绩效的影响,通过实验发现特征物的颜色与性状对目标物体判断有显著影响。汪海波等[63]提出信息符号化的设计能够有效地实现人–系统的信息交互,并分别阐述了具象化、抽象化符号价值与传达优势,皆有利于操作者快速高效地认知。张慧姝等[64]采用匹配测试与排序测试实验,测评了飞机图标中针对友机、敌机与不明飞机的目标图符识别性绩效。邵将等[65]梳理了头盔显示界面的不同信息图标布局展现形式,设计了E–prime实验对不同特征的图标进行绩效测评。

在信息交互的逻辑架构与结构设计方面,Paas等[66]从图式理论出发,探究了信息结构和认知架构之间的交互作用与关系;Chen等[67]通过信息的分层、一致性设计和导航设计进行认知负荷的控制,提出以活动为中心的观点降低认知负荷;徐玮瞳等[68]运用层次分析与场景用例分析法,针对机载导航页面的信息内容设计展开分析,并进行样式、交互行为与接口设计。吴立尧等[69]针对有人/无人机编队协同作战的场景,分别从任务规划层、协调控制层、功能实现层将显控系统结构中的信息模块进行分类梳理,并最终通过仿真实验对典型任务进行验证。缪莹莹等[70]从特征整合的角度出发,通过分析认知习惯与信息特征梯度,总结出合适的体现视觉界面信息层级与次序关系的交互设计方式,提高视觉认知效率与易用性。

综上所述,近年来在对座舱人机交互信息的表征研究中,多从人因工效与界面设计原则理论角度出发,研究着重针对交互界面布局、色彩、图符元素研究其设计的合理性,以提高认知绩效。同时针对显控系统信息的层级化、次序化展现,从任务信息流的合理优化角度出发对界面信息架构进行设计分析。

3.2 座舱显控界面交互设计方法研究

针对交互设计方法在战机座舱中的应用,大多从设计方法、设计思维、设计理论等角度提出针对性的界面设计改进措施与设计系统方法。Guan等[71]利用UI分类和设计方法,对飞行训练关键交互操作与核心人机交互UI进行研究,并加以整合,完成UI模块的设计,有效地提升了飞行模拟训练的效率和效果。Shi等[72]分析了交互系统的多模态思维,提出飞机座舱的多模态交互系统应以“任务–人–机”为中心进行设计。Dam等[73]运用生态界面设计方法优化飞行轨迹的可视化描述,帮助飞行员提高信息理解和情境感知能力。冯传宴等[74]结合多资源负荷理论及信息认知加工理论,提出一种新的情境意识模型,来指导驾驶舱人机界面设计。邵将[75]基于视觉认知理论展开头盔显示器的界面信息编码设计研究。陆炎凯[76]基于视觉注意捕获理论提出复杂信息系统的视觉表征方法与交互设计策略。李佳益[77]从认知负荷理论和人机界面设计理论出发,总结复杂数字信息界面的设计要素对认知负荷的影响,提出可控认知负荷水平下的飞机驾舱数字界面可视化设计策略。王海燕等[78]以生态界面理论为依据抽象分析战机显控界面层级,结合图形用户界面的设计思想提出了布局设计的方法流程。

由此可以看出,近年来对战机座舱的交互设计方法研究中,大多从心理学、行为科学等领域的人因要素出发,运用视觉感知理论、认知负荷理论、生态界面理论等人机交互界面设计理论展开对战机座舱人机交互界面设计。

3.3 座舱显控交互实现形式与技术研究

现代化的座舱人机交互主要采用数字屏幕进行信息输出,采用语音交互、触屏按键等方式进行信息输入。在国内外对座舱复杂界面的交互设计研究方面,综合了视觉、听觉、触觉等多种认知通道,使飞行员在任何情况下依靠本能以更加舒适自由的方式操控飞机,达到缩短飞行员的判断、决策时间,减少操作错误,降低飞行员心理及生理负荷,提高作战效能的目的。Pauchet等[79]设计了一款“Gazeform”自适应触控界面,根据凝视方向提供一种自适应的交互手段,实验结果表明与仅使用触控模式相比,GazeForm产生了更低的主观心理负荷和更高的执行效率(快20%)。Fan等[80]从驾驶舱人机交互效率认知缺点和触屏在运行的交互特性为切入点,研究了天气页面的触摸控制和信息显示集成设计。Wambecke等[81]提出了融合眼动与微手势结合的协同交互模式,并通过实验证明在处理高优先级的任务时,此协同交互方式绩效更优。Jansen等[82]通过研究飞机座舱触觉显示技术,发现在视听受到严重干扰的环境中,信息的触觉呈现可减轻飞行员的视觉负担,并且飞行员的操作更准确、脑力负荷更小。以上研究对多通道人机交互技术在飞行驾驶任务中的可用性提供了理论支撑。

人机交互技术的支持使作战座舱中多种交互手段得到了极大的应用,进一步提高了人机交互效率。Caputo等[83]提出如沉浸式VR、MR等虚拟工具交互方式,通过模拟按钮、滑块、旋钮等交互组件,测试此类设计对实际操作的可能性及有效性。Qiao等[84]引入眼动、手势的自然交互模式,设计了用于飞行仿真的凝视手势交互系统,并将其与现有的主要交互方法进行了分析比较。Niermann[85]将空间音频作为额外的信息渠道,设计了3D音频的航空立体声耳机实验,研究音频跟踪作为驾驶舱辅助系统的发展潜力。Wang等[86]探究了在震动条件下,输入设备与目标大小对人机交互性能和感知工作量的影响,旨在优化人机系统在震动环境中的用户界面设计。Liu等[87]利用特有的网络技术解决传统显示器图形处理的问题,并提出基于红外触摸技术的人机交互方法以提高人机交互效率。

综上所述,近年来在对作战座舱的实现形式和技术研究中,多引入多通道交互手段,从视觉、听觉、触觉等多种认知通道展开人机交互效能的研究,其中研究内容有界面组件的动态交互形式、手势动作的交互、触摸反馈机制等。在创新思维与多模态理论等的指导下,通过现代化硬件与软件设施的测试模拟,对未来智能化作战座舱交互系统提供智能交互技术层面的支持,进而构建更加沉浸式、人性化与协同感知的系统性交互体系。

4 人机协同作战的座舱交互发展趋势

解决人机分工问题、促成人机对话是保证人机交互效率和系统综合效能的关键,也是促成人机智能协作的关键[88]。在高强度、强对抗的空战场景下,飞行员将面临人机协同作战的多方面考验,合理组织各类作战任务,梳理态势信息架构,将复杂数据转换为可以被迅速解读的界面信息至关重要。通过简化复杂任务流程,结合飞行员的使用需求,梳理逻辑合理、清晰明确的界面信息层级关系,并将信息内容与设计元素耦合,为有/无人机协同作战搭建一座沟通的桥梁。同时无人装备不仅是遵循飞行员指令的执行方,同时也是为飞行员提供作战建议的协同合作伙伴,信息的交互将成为未来人机协同作战的显控交互设计的重要内容。面对复杂多变的未来空战对抗,通过人工智能赋能的自适应学习,构建基于飞行员心理生理反馈响应的交互机制有助于实现人机深度协同。

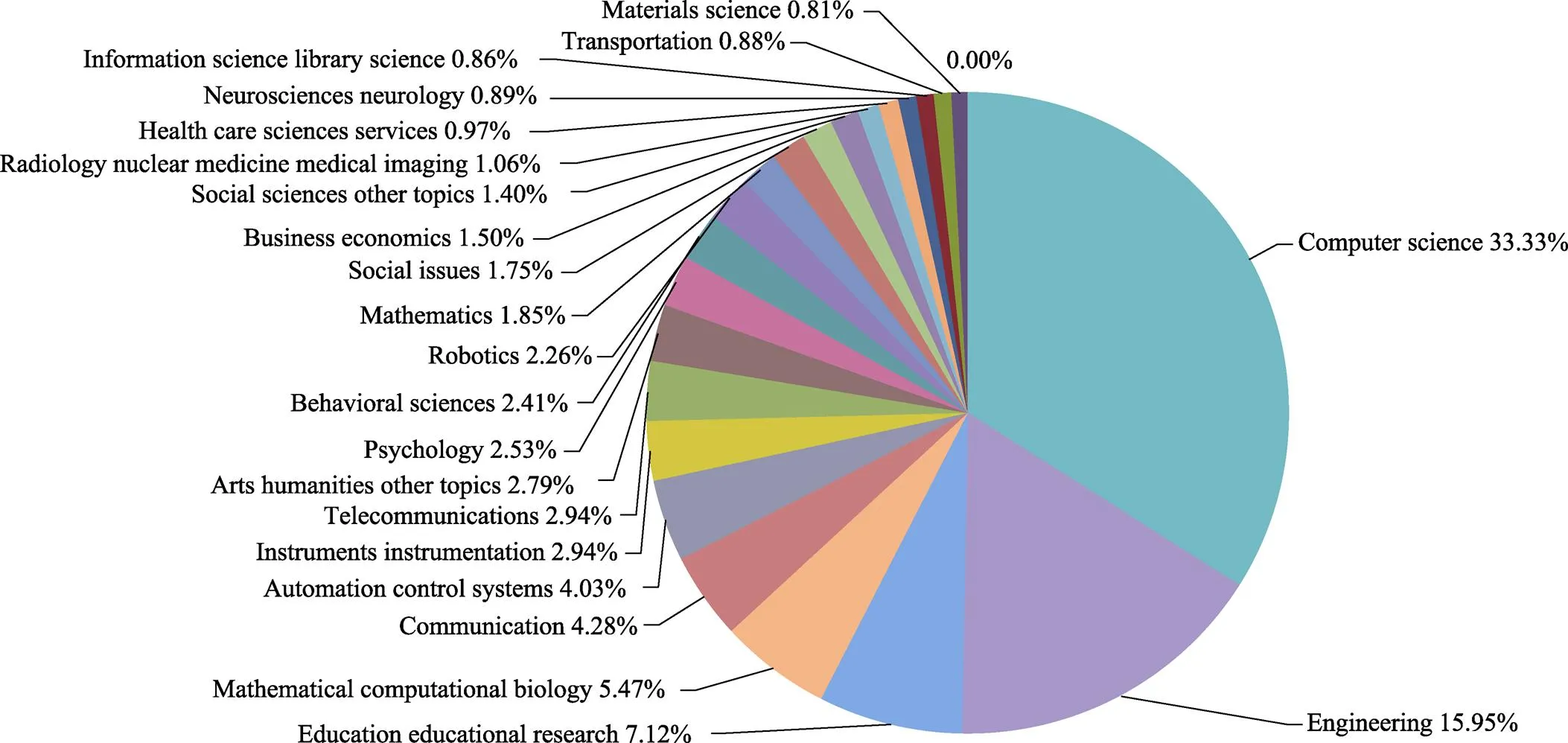

多通道融合的交互方式是人机协同作战发展的必然趋势。在人工智能、虚拟现实等技术进步和人机交互需求提升的驱动下,融合视觉、触觉、听觉等多个感知体验的多通道交互被认为是更自然的人机交互方式[89]。运用语音、手势、眼动等控制方式和视觉、听觉等多种感知通道实现对态势信息的认知及对战机的操纵控制,一方面弥补了单通道识别准确率的问题,减轻了作战人员认知负担,另一方面使人机对话以一种自然、并行、协作的方式进行,提高了人机协同作战的交互效率[90]。基于语音识别、视觉追踪、肢体语言和脑机接口等技术的多通道融通交互手段,展开关于人机交互意识识别、交互操作控制、认知负荷评估等方面研究,为提高人机协同交互效率提供理论依据和技术支持。在2021年,由行业发起以“未来”“科技”与“人因”为主题的首届未来座舱创新设计大赛,燃起国内学者对未来航战的思考。例如,“融合多通道感知与虚拟交互的未来战机座舱”尝试将虚拟现实技术与眼控交互结合,实现了头盔虚拟投射形成外视场的虚拟信息界面[91],见图4。

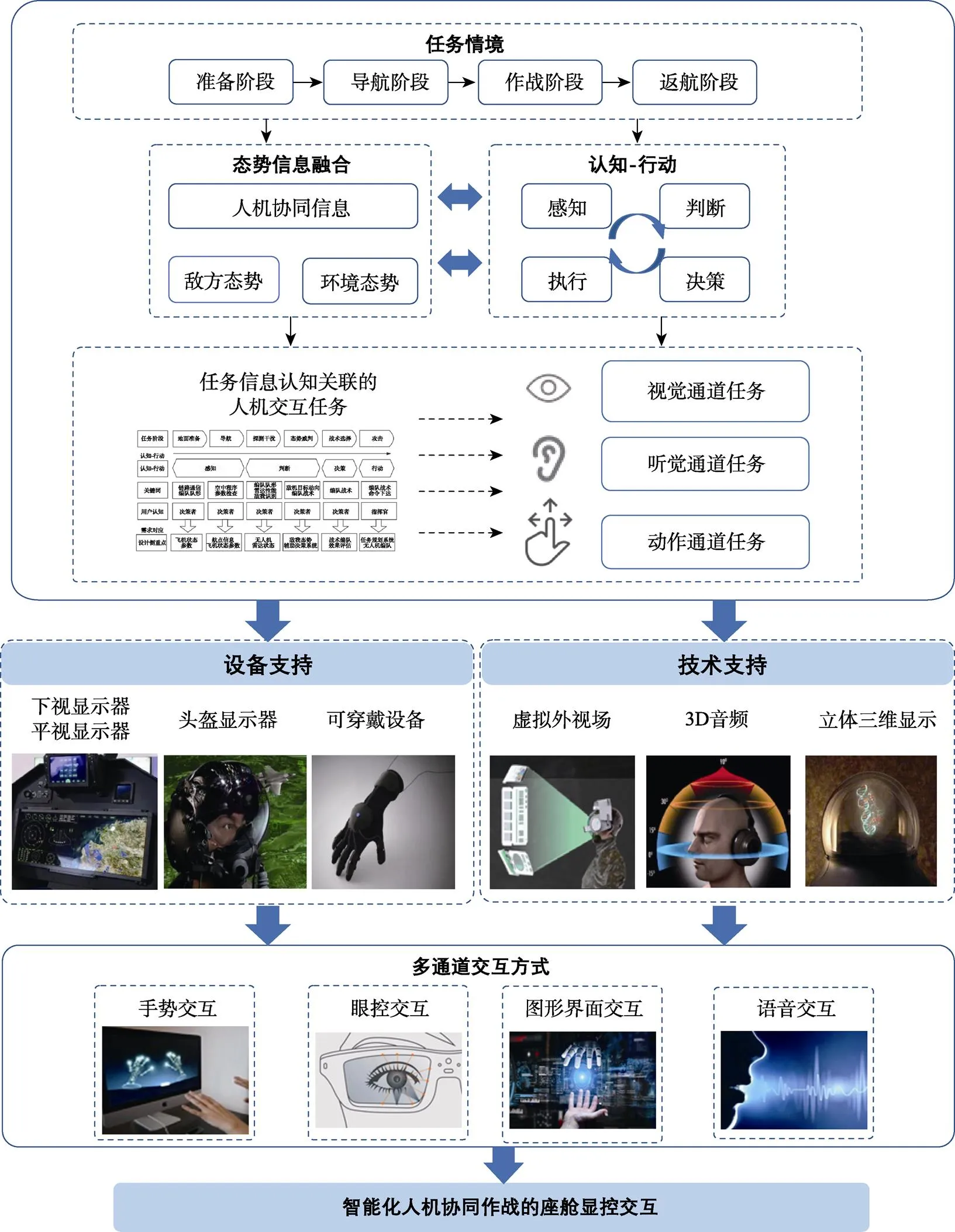

人机协同作战座舱显控交互研究是在多维度协同、多信息融合的新型空战环境下,对集合空军力量、深入人机协同展开的新命题,见图5。

图4 融合多通道感知与虚拟交互的未来战机座舱

图5 人机协同作战的座舱显控交互研究

5 结语

从国内外战机座舱显控系统的研究现状出发,聚焦面临复杂空战环境的人机协同作战发展趋势。从人机协同态势、人机交互界面等角度梳理了座舱显控的研究进展,发现多维度、多层次的态势信息显示需求推动了人机协同作战模式的发展,从而提出对未来人机协同座舱显控交互研究发展趋势的思考。面对愈发复杂的战场环境与动态多变的作战需求,座舱显控需要从任务–信息–认知关联与多通道融合的交互手段,加强人机对话,提高协作效能。未来智能化作战环境下的座舱显控研究,将逐渐深入地向人机协同的多通道融合交互发展。

[1] 丁达理, 谢磊, 王渊. 有人机/无人机协同作战运用及对战争形态影响[J]. 无人系统技术, 2020, 3(4): 1-9.

DING Da-li, XIE Lei, WANG Yuan. The Application of Manned/Unmanned Aerial Vehicle Cooperative Combat and Its Influence on War Form[J]. Unmanned Systems Technology, 2020, 3(4): 1-9.

[2] 张德斌, 郭定, 马利东, 等. 战斗机座舱显示的发展需求[J]. 电光与控制, 2004, 11(1): 53-55.

ZHANG De-bin, GUO Ding, MA Li-dong, et al. Requirements for Development of Cockpit Display on Fighters[J]. Electronics Optics & Control, 2004, 11(1): 53-55.

[3] HUA H, GAO C Y, SOC I C. A Polarized Head-Mounted Projective Display[C]// Proceedings of the 4th IEEE/ACM International Symposium on Mixed and Augmented Reality ( ISMAR 2005). Vienna, AUSTRIA: IEEE, 2005: 32-35.

[4] YAMAZOE T, KISHI S, SHIBATA T, et al. Reducing Binocular Rivalry in the Use of Monocular Head-Mounted Display[J]. Journal of Display Technology, 2007, 3(1): 83-88.

[5] 符积弘. 面向任务的现代飞机座舱人机界面信息显示机理研究[D]. 南京: 南京航空航天大学, 2017.

FU Ji-hong. Research on Task Oriented Information Display Mechanism of Modern Cockpit Human Machine Interface[D]. Nanjing: Nanjing University of Aeronautics and Astronautics, 2017.

[6] 张强. 头盔显示界面信息布局优化研究[D]. 南京: 东南大学, 2016.

ZHANG Qiang. Research of Hmd Interface Information Layout Optimizing[D]. Nanjing: Southeast University, 2016.

[7] ENDSLEY M R. Situation Awareness Global Assessment Technique (SAGAT)[C]// Proceedings of the Proceedings of the IEEE 1988 National Aerospace and Electronics Conference. Dayton: IEEE, 1988.

[8] LAVIE N, TSAL Y. Perceptual Load as a Major Determinant of the Locus of Selection in Visual Attention[J]. Perception & Psychophysics, 1994, 56(2): 183-197.

[9] BRONKHORST A W, VELTMAN J A H, VAN BREDA L. Application of a Three-Dimensional Auditory Display in a Flight Task[J]. Human Factors: the Journal of the Human Factors and Ergonomics Society, 1996, 38(1): 23-33.

[10] HANKINS T C, WILSON G F. A Comparison of Heart Rate, Eye Activity, EEG and Subjective Measures of Pilot Mental Workload during Flight[J]. Aviation, Space, and Environmental Medicine, 1998, 69(4): 360-367.

[11] DEREFELDT G, SKINNARS Ö, ALFREDSON J, et al. Improvement of Tactical Situation Awareness with Colour-Coded Horizontal-Situation Displays in Combat Aircraft[J]. Displays, 1999, 20(4): 171-184.

[12] HAVIG P R, GRIGSBY S S, HEFT E L, et al. Luminance Contrast and Color Recognition in Helmet-mounted Displays[C]// Proceedings of the Conference on Helmet and Head-Mounted Displays VI. Orlando: SPIE, 2001.

[13] HUDLICKA E, MCNEESE M D. Assessment of User Affective and Belief States for Interface Adaptation: Application to an Air Force Pilot Task[J]. User Modeling and User-Adapted Interaction, 2002, 12(1): 1-47.

[14] BAILEY R E, ARTHUR J J, WILLIAMS S P. Latency Requirements for Head-worn Display S/EVS Applications[C]// Proceedings of the Enhanced and Synthetic Vision 2004 Conference. Orlando: SPIE, 2004.

[15] VAN ERP J B F, GROEN E L, BOS J E, et al. A Tactile Cockpit Instrument Supports the Control of Self-Motion during Spatial Disorientation[J]. Human Factors, 2006, 48(2): 219-228.

[16] HUTTUNEN K, KERÄNEN H, VÄYRYNEN E, et al. Effect of Cognitive Load on Speech Prosody in Aviation: Evidence from Military Simulator Flights[J]. Applied Ergonomics, 2011, 42(2): 348-357.

[17] HOOVER A, SINGH A, FISHEL-BROWN S, et al. Real-Time Detection of Workload Changes Using Heart Rate Variability[J]. Biomedical Signal Processing and Control, 2012, 7(4): 333-341.

[18] ELLERBROEK J, BRANTEGEM K C R, VAN PAASSEN M M, et al. Experimental Evaluation of a Co-planar Airborne Separation Display[C]// Proceedings of the IEEE International Conference on Systems, Man, and Cybernetics (SMC). Seoul: IEEE, 2012.

[19] BARBÉ J, CHATRENET N, MOLLARD R, et al. Physical Ergonomics Approach for Touch Screen Interaction in an Aircraft Cockpit [C]// Proceedings of the 2012 Conference on Ergonomie et Interaction homme-machine. Biarritz, France: ACM, 2012.

[20] WEI Zong-min, ZHUANG Da-min, WANYAN Xiao-ru, et al. A Model for Discrimination and Prediction of Mental Workload of Aircraft Cockpit Display Interface[J]. Chinese Journal of Aeronautics, 2014, 27(5): 1070-1077.

[21] HAMON A, PALANQUE P, ANDRÉ R, et al. Multi-Touch Interactions for Control and Display in Interactive Cockpits: Issues and a Proposal[C]//. Proceedings of the International Conference on Human- Computer Interaction in Aerospace. Santa Clara: ACM, 2014.

[22] YU C S, WANG E M Y, LI W C, et al. Pilots' Visual Scan Patterns and Attention Distribution during the Pursuit of a Dynamic Target[J]. Aerospace Medicine and Human Performance, 2016, 87(1): 40-47.

[23] WILSON M L, BEADLE S C, KINSELLA A J, et al. Task Performance in a Head-Mounted Display: The Impacts of Varying Latency[J]. Displays, 2020, 61(1): 101930.

[24] SCHWERD S, SCHULTE A. Experimental Validation of an Eye-Tracking-Based Computational Method for Continuous Situation Awareness Assessment in an Aircraft Cockpit[C]// Proceedings of the Engineering Psychology and Cognitive Ergonomics Cognition and Design. Cham: Springer, 2020.

[25] 孔渊, 陆虎敏. 未来战斗机座舱显控系统发展动态[J]. 航空电子技术, 2006, 37(3): 33-37.

KONG Yuan, LU Hu-min. Development Trends of the Cockpit Display and Control System of Future Fighters[J]. Avionics Technology, 2006, 37(3): 33-37.

[26] 殷春霞, 陈晓刚. 作战飞机智能座舱研究[J]. 测控技术, 2021, 40(9): 1-6.

YIN Chun-xia, CHEN Xiao-gang. Intelligent Cockpit of Combat Aircraft[J]. Measurement & Control Technology, 2021, 40(9): 1-6.

[27] 赵国荣, 刘涛, 刘方正. 头盔显示器作为主飞行显示器的技术发展综述[J]. 海军航空工程学院学报, 2006, 21(1): 109-112.

ZHAO Guo-rong, LIU Tao, LIU Fang-zheng. Research on the Development of Key Technologies of HMD as PFR[J]. Journal of Naval Aeronautical Engineering Institute, 2006, 21(1): 109-112.

[28] 张旭东, 孙智伟, 吴利荣, 等. 未来有人机/无人机智能协同作战顶层概念思考[J]. 无人系统技术, 2021, 4(2): 62-68.

ZHANG Xu-dong, SUN Zhi-wei, WU Li-rong, et al. Research on the Fundamental and Grand Concept of Intelligent Cooperative Combat of Manned/Unmanned Aircraft[J]. Unmanned Systems Technology, 2021, 4(2): 62-68.

[29] HU X, YANG L, ZHANG J. The Design and Analysis of Hierarchical Decision-making for Manned/Unmanned Cooperative Engagement[C]// Proceedings of the 34th Chinese Control Conference (CCC). Hangzhou: IEEE, 2015.

[30] ROSALIE M, DANOY G, BOUVRY P, et al. UAV Multilevel Swarms for Situation Management[C]// Proceedings of the 2nd Workshop on Micro Aerial Vehicle Networks, Systems, and Applications for Civilian Use (DroNet). Singapore: ACM, 2016.

[31] 曹兰英, 郭明明, 罗美方. 雷达与电子战的认知博弈[J]. 雷达科学与技术, 2021, 19(5): 552-557.

CAO Lan-ying, GUO Ming-ming, LUO Mei-fang. Cognitive Game between Radar and Electronic Countermeasure[J]. Radar Science and Technology, 2021, 19(5): 552-557.

[32] XING JC, CHEN CX, CHEN XR, et al. Research Progress on Joint Operation Modeling Based on Complex Networks[C]// Proceedings of the 31st Chinese Control and Decision Conference (CCDC), Nanchang: IEEE, 2019.

[33] 李志彤,李徽.面向未来两栖作战的态势智能认知概念框架研究[J/OL].指挥控制与仿真, 2022: 1-5[2022-04-27]. http://kns.cnki.net/kcms/detail/32.1759.TJ.20211231.1313.004.html.

LI Zhi-Tong Li Hui. Research on Conpeptual Framework of Situation Intelligent Cognition for Amphibious Operations in future. [J/OL]. Command Control & Simulation: 2022: 1-5[2022-04-27]. http://kns.cnki.net/kcms/detail/32.1759.TJ.20211231.1313.004.html.

[34] 吴晓莉. 复杂信息任务界面的出错-认知机理: 由出错因子导入系统界面设计的新方式[M]. 北京: 科学出版社, 2017.

WU Xiao-li. Error-Cognition Mechanism of Task Interface Complex Information System—A New Design Method of System Interface by Introducing Error Factors[M]. Beijing: Science Press, 2017.

[35] 乔鑫, 孔繁峨, 冯星, 等. 单机超视距空战智能辅助决策方法[J]. 电光与控制, 2011, 18(6): 9-15.

QIAO Xin, KONG Fan-e, FENG Xing, et al. An Intelligent Decision-Making Method Used in Beyond-Visual- Range Air Combat[J]. Electronics Optics & Control, 2011, 18(6): 9-15.

[36] 赵鸿燕. 美国面向未来战争的导弹协同作战概念发展研究[J]. 航空兵器, 2019, 26(4): 1-9.

ZHAO Hong-yan. Concept Development of the United States Missile Cooperative Operations for Future War[J]. Aero Weaponry, 2019, 26(4): 1-9.

[37] 闫晔. 有人机/无人机协同中的交互控制技术研究[D]. 长沙: 国防科学技术大学, 2007.

YAN Ye. Research on Interactive Control Technology for Manned Vehicle-UAV Cooperative Mission[D]. Changsha: National University of Defense Technology, 2007.

[38] CAMBONE S, KRIEGR P P, Unmanned Aircraft System Roadmap2005-2030[R]. Washington DC: Office of the secretary of defense, 2005.

[39] WILSON J R. Unmanned Aerial Vehicles Get Ready for Prime Time[J]. Military & Aerospace Electronics, 2009, 20(7): 18, 20-25.

[40] WALSDORF A, ONKEN R, IEEE I. Cognitive Man-machine-Cooperation-Modeling Operators' General Objectives and Its Role within a Cockpit Assistant System[C]// Proceedings of the IEEE International Conference on Systems, Man and Cybernetics. Nashville: IEEE, 2000.

[41] ONKEN R, WALSDORF A. Assistant Systems for Aircraft Guidance: Cognitive Man-Machine Cooperation[J].Aerospace Science and Technology, 2001, 5(8): 511-520.

[42] PITCHAMMAL R, SADDA V. Making the Mission Computer Intelligent – a Step Ahead[J]. Defence Science Journal, 2013, 63(2): 174-180.

[43] SVENMARCK P. Human Engineering of Multisensor and Multisource Tracking Systems[C]// Proceedings of the Conference on Signal Processing, Sensor Fusion, and Target Recognition IX. Orlando: SPIE, 2000.

[44] BRAND Y, SCHULTE A. Design and Evaluation of a Workload-Adaptive Associate System for Cockpit Crews[C]// Proceedings of the 15th International Conference on Engineering Psychology and Cognitive Ergonomics (EPCE). Las Vegas: Springer, 2018.

[45] OHLANDER U, ALFREDSON J, RIVEIRO M, et al. A Teamwork Model for Fighter Pilots[C]// Proceedings of the 13th International Conference on Engineering Psychology and Cognitive Ergonomics (EPCE). Toronto: Springer, 2016.

[46] 王伟, 刘付显. 基于协同相关度的作战任务分解优化[J]. 火力与指挥控制, 2017, 42(11): 107-110.

WANG Wei, LIU Fu-xian. Operation Task Decomposition Optimization Based on Cooperative Correlation Degree[J]. Fire Control & Command Control, 2017, 42(11): 107-110.

[47] 张杰勇, 钟赟, 孙鹏, 等. 有人/无人机协同作战指挥控制系统技术[J]. 指挥与控制学报, 2021, 7(2): 203-214.

ZHANG Jie-yong, ZHONG Yun, SUN Peng, et al. Command and Control System and Technology for Manned/Unmanned Aerial Vehicle Cooperative Operation[J]. Journal of Command and Control, 2021, 7(2): 203-214.

[48] 王坦, 杨森, 齐晓慧, 等. 基于Hopfield网络的有人机/无人机协同作战效能评估[J]. 电光与控制, 2021, 28(10): 80-84.

WANG Tan, YANG Sen, QI Xiao-hui, et al. Effectiveness Evaluation of MAV/UAV Cooperative Operations Based on Hopfield Neural Network[J]. Electronics Optics & Control, 2021, 28(10): 80-84.

[49] 董彦非, 张旺, 崔巍. 有人机/无人机协同空地攻击效能评估的综合指数模型[J]. 火力与指挥控制, 2015, 40(2): 58-62.

DONG Yan-fei, ZHANG Wang, CUI Wei. Synthesized Index Model for Cooperation of Manned/Unmanned Fighters in Air-to-Ground Attacking Effectiveness Assessment[J]. Fire Control & Command Control, 2015, 40(2): 58-62.

[50] FAN Jie-ru, LI Dong-guang, LI Ru-peng, et al. Analysis on MAV/UAV Cooperative Combat Based on Complex Network[J]. Defence Technology, 2020, 16(1): 150-157.

[51] PEINECKE N, KNABL P M, SCHMERWITZ S, et al. An Evaluation Environment for a Helmet-Mounted Synthetic Degraded Visual Environment Display[C]// Proceedings of the IEEE/AIAA 33rd Digital Avionics Systems Conference (DASC). Colorado: Springs, 2014.

[52] ZHANG B, SUN C, ZHANG H, et al. An Aberration Correction Method and Circuit Implementation for AR Helmet Mounted Display Optical System[C]// Proceedings of the Conference on AOPC - Display Technology. Beijing: SPIE, 2021.

[53] 傅亚强, 许百华. 机载头盔显示器符号系统评价的原则与方法综述[J]. 航天医学与医学工程, 2013, 26(5): 415-419.

FU Ya-qiang, XU Bai-hua. Review of Principles and Evaluation Methodologies for Cockpit Helmet-Mounted Display Symbology[J]. Space Medicine & Medical Engineering, 2013, 26(5): 415-419.

[54] 王永生, 刘红漫. 机载头盔瞄准显示系统的人机工效综述[J]. 电光与控制, 2014, 21(7): 1-5.

WANG Yong-sheng, LIU Hong-man. A Summary on Human /System Performance of Airborne HMSDS[J]. Electronics Optics & Control, 2014, 21(7): 1-5.

[55] 吴晓莉, 方泽茜, 刘潇, 等. 工业系统的智能交互模式及人因工效研究综述[J]. 包装工程, 2022(4): 12-26.

WU Xiao-li, FANG Ze-xi, LIU Xiao, et al. Review of Intelligent Interaction Mode and Human Factors in Industrial System[J]. Packaging Engineering, 2022(4): 12-26.

[56] 张炜, 宋笔锋. 飞行器座舱状态信息显示方式的实验研究[J]. 人类工效学, 2004, 10(3): 1-2, 6.

ZHANG Wei, SONG Bi-feng. Analysis of Status Information Display in Cockpit Designing[J]. Chinese Ergonomics, 2004, 10(3): 1-2, 6.

[57] ZHANG Lei. Information Coding for Cockpit Human-Machine Interface[J]. Chinese Journal of Mechanical Engineering, 2011, 24(4): 707.

[58] ACKERMAN K, XARGAY E, TALLEUR D A, et al. Flight Envelope Information-Augmented Display for Enhanced Pilot Situational Awareness [C]// AIAA Infotech @ Aerospace. American Institute of Aeronautics and Astronautics. Kissimmee, Florida: AIAA, 2015.

[59] MICHALSKI R, GROBELNY J, KARWOWSKI W. The Effects of Graphical Interface Design Characteristics on Human-Computer Interaction Task Efficiency[J]. International Journal of Industrial Ergonomics, 2006, 36(11): 959-977.

[60] CHEN C H, CHIANG Shu-ying. The Effects of Panel Arrangement on Search Performance[J]. Displays, 2011, 32(5): 254-260.

[61] CUI Y. Advertising Icon Design and Communication Conception Under the Condition of EEG and Eye Movement Experiments-Taking the Lingmei Omnimedia E-Commerce Platform Mobile APP as an Example[C]// Proceedings of the International Conference on Cyber Security Intelligence and Analytics (CSIA). Shenyang: Springer, 2020.

[62] WU Xiao-li, LI Jing, ZHOU Feng. An Experimental Study of Features Search under Visual Interference in Radar Situation-Interface[J]. Chinese Journal of Mechanical Engineering, 2018, 31: 45.

[63] 汪海波, 薛澄岐, 史铭豪. 自动化影响下的复杂系统数字界面设计研究[J]. 包装工程, 2014, 35(4): 36-39.

WANG Hai-bo, XUE Cheng-qi, SHI Ming-hao. Digital Interface Design of Complex System under the Influence of Automation[J]. Packaging Engineering, 2014, 35(4): 36-39.

[64] 张慧姝, 庄达民, 马丁, 等. 飞机座舱显示界面目标图符的设计和评价[J]. 包装工程, 2011, 32(10): 89-92.

ZHANG Hui-shu, ZHUANG Da-min, MA Ding, et al. Design and Evaluation of Target Icons of the Cockpit Display Interface[J]. Packaging Engineering, 2011, 32(10): 89-92.

[65] 邵将, 薛澄岐, 王海燕, 等. 基于图标特征的头盔显示界面布局实验研究[J]. 东南大学学报(自然科学版), 2015, 45(5): 865-870.

SHAO Jiang, XUE Cheng-qi, WANG Hai-yan, et al. Experimental Study on HMDS Interface Layout Based on Icon Characteristics[J]. Journal of Southeast University (Natural Science Edition), 2015, 45(5): 865-870.

[66] PAAS F, RENKL A, SWELLER J. Cognitive Load Theory: Instructional Implications of the Interaction between Information Structures and Cognitive Architecture[J]. Instructional Science, 2004, 32(1/2): 1-8.

[67] JIANZHEN C. Reducing Cognitive Load in Mobile Learning: Activity-centered Perspectives[C]// Proceedings of the 2010 International Conference on Networking and Digital Society. Wenzhou: IEEE, 2010.

[68] 徐玮瞳, 孙远. 基于任务场景分析的机载导航页面人机界面设计过程研究[J]. 航空电子技术, 2020, 51(4): 20-25.

XU Wei-tong, SUN Yuan. Research on Human-Computer Interface Design Process of Airborne Navigation Page Based on Task Scenario Analysis[J]. Avionics Technology, 2020, 51(4): 20-25.

[69] 吴立尧, 韩维, 张勇, 等. 有人/无人机编队指挥控制系统结构设计[J]. 系统工程与电子技术, 2020, 42(8): 1826-1834.

WU Li-yao, HAN Wei, ZHANG Yong, et al. Structure Design of Command and Control System for Manned/Unmanned Aerial Vehicles Formation[J]. Systems Engineering and Electronics, 2020, 42(8): 1826-1834.

[70] 缪莹莹, 潘伟营, 姜斌. 战术显控系统人机交互中的特征整合设计研究[J]. 包装工程, 2021, 42(20): 85-91.

MIAO Ying-ying, PAN Wei-ying, JIANG Bin. Feature Integration Design in Human-Computer Interaction of Tactical Display and Control System[J]. Packaging Engineering, 2021, 42(20): 85-91.

[71] 关淯尹, 耿心. 飞行模拟系统人机交互设计[J]. 计算机工程与应用, 2017, 53(23): 230-235.

GUAN Yu-yin, GENG Xin. Design of Human-Computer Interaction for Flight Simulation System[J]. Computer Engineering and Applications, 2017, 53(23): 230-235.

[72] SHI YANBIN, LI XIAOQI, OUYANG DANTONG, et al. Multimodal Usability of Human-Computer Interaction Based on Task-Human-Computer-Centered Design[J]. Lecture Notes in Computer Science, 2017: 459-468.

[73] DAM S B J V, MULDER M, VAN PAASSEN M M. Ecological Interface Design of a Tactical Airborne Separation Assistance Tool[J]. IEEE Transactions on Systems, Man, and Cybernetics - Part A: Systems and Humans, 2008, 38(6): 1221-1233.

[74] 冯传宴, 完颜笑如, 陈浩, 等. 基于多资源负荷理论的情境意识模型与应用[J]. 北京航空航天大学学报, 2018, 44(7): 1438-1446.

FENG Chuan-yan, WANYAN Xiao-ru, CHEN Hao, et al. Situation Awareness Model Based on Multi-Resource Load Theory and Its Application[J]. Journal of Beijing University of Aeronautics and Astronautics, 2018, 44(7): 1438-1446.

[75] 邵将. 基于视觉认知理论的头盔显示界面信息编码方法研究[D]. 南京: 东南大学, 2016.

SHAO Jiang. Research on the Information Encoding Method of Helmet Mounted Display System Interface Based on Visual Perception Theory[D]. Nanjing: Southeast University, 2016.

[76] 陆炎凯. 基于视觉注意捕获的复杂信息系统界面可视化研究[D]. 南京: 南京航空航天大学, 2020.

LU Yan-kai. Research on Visualization of Complex Information System Based on Visual Attention Capture[D]. Nanjing: Nanjing University of Aeronautics and Astronautics, 2020.

[77] 李佳益. 飞机驾驶舱数字界面可视化设计及其认知负荷研究[D]. 南京: 南京航空航天大学, 2020.

LI Jia-yi. Visual Design of Airplane Cockpit Digital Interface and Its Cognitive Load Research[D]. Nanjing: Nanjing University of Aeronautics and Astronautics, 2020.

[78] 王海燕, 卞婷, 薛澄岐. 新一代战斗机显控界面布局设计研究[J]. 电子机械工程, 2011, 27(4): 57-61.

WANG Hai-yan, BIAN Ting, XUE Cheng-qi. Layout Design of Display Interface for a New Generation Fighter[J]. Electro-Mechanical Engineering, 2011, 27(4): 57-61.

[79] PAUCHET S, LETONDAL C, VINOT J-L, et al. GazeForm: Dynamic Gaze-adaptive Touch Surface for Eyes-free Interaction in Airliner Cockpits [C]// Proceedings of the 2018 Designing Interactive Systems Conference. Hong Kong: ACM, 2018.

[80] FAN R, ZHAO C, MA X, et al. Design of Touch Control Display Interface Based on Synoptic Page in Civil Aircraft Cockpit [C]//2021 IEEE Asia-Pacific Conference on Image Processing, Electronics and Computers (IPEC). Dalian: IEEE, 2021.

[81] WAMBECKE J, GOGUEY A, NIGAY L, et al. M[Eye]Cro: Eye-gaze+Microgestures for Multitasking and Interruptions[J]. Proceedings of the ACM on Human-Computer Interaction, 2021, 5(EICS):1-22.

[82] JANSEN C, WENNEMERS A, VOS W, et al. FlyTact: A Tactile Display Improves a Helicopter Pilot's Landing Performance in Degraded Visual Environments[C]// Proceedings of the 6th EuroHaptics International Conference. Madrid: Springer, 2008.

[83] CAPUTO A, JACOTA S, KRAYEVSKYY S, et al. XR-Cockpit: A Comparison of VR and AR Solutions on an Interactive Training Station[C]// IEEE International Conference on Emerging Technologies and Factory Automation(ETFA). Vienna: IEEE, 2020.

[84] QIAO Yuan-yuan, WANG Ji-hui, CHEN Jing, et al. Design and Realization of Gaze Gesture Control System for Flight Simulation[J]. Journal of Physics: Conference Series, 2020, 1693(1): 012213.

[85] NIERMANN C A. Potential of 3D Audio as Human-Computer Interface in Future Aircraft[C]// Proceedings of the 13th International Conference on Engineering Psychology and Cognitive Ergonomics (EPCE). Toronto, CANADA: Springer, 2016.

[86] WANG Hai-liang, DA TAO, CAI Jian, et al. Effects of Vibration and Target Size on the Use of Varied Computer Input Devices in Basic Human-Computer Interaction Tasks[J]. Human Factors and Ergonomics in Manufacturing & Service Industries, 2022, 32(2): 199-213.

[87] 刘硕, 李孟华, 张磊. 大尺寸机载智能多功能显示器的设计与实现[J]. 电讯技术, 2018, 58(4): 476-482.

LIU Shuo, LI Meng-hua, ZHANG Lei. Design and Implementation of an Intelligent Multi-Function Large-Screen Display for Avionics[J]. Telecommunication Engineering, 2018, 58(4): 476-482.

[88] 薛澄岐, 王琳琳. 智能人机系统的人机融合交互研究综述[J]. 包装工程, 2021, 42(20): 112-124.

XUE Cheng-qi, WANG Lin-lin. Review of Human-Computer Integration Interaction in Intelligent Human-Computer System[J]. Packaging Engineering, 2021, 42(20): 112-124.

[89] COHEN P R, MCGEE D R. Tangible Multimodal Interfaces for Safety-Critical Applications[J]. Communications of the ACM, 2004, 47(1): 41-46.

[90] 冯悦, 王言伟, 耿欢. 战斗机智能座舱人机交互方式发展及应用[J]. 飞机设计, 2020, 40(4): 54-58.

FENG Yue, WANG Yan-wei, GENG Huan. Development and Application of Human-Computer Interaction Mode of Fighter Smart Cockpit[J]. Aircraft Design, 2020, 40(4): 54-58.

[91] 李孟牛,吴晓莉,陈博宏, 等. 融合多通道感知的模拟战斗机飞行软件V1.0: 中国, 2021SR1212278[P].2021-08-16.

LI Meng-niu, WU Xiao-li, CHEN Bo-hong, etal. Flight Simulation Software Based on Fusion of Multi-Channel Sensing V1.0: China, 2021SR1212278[P]. 2021-08-16.

Review of Display Control Interaction and Man-machine Coordination in Fighter Cockpit

WU Xiao-lia,b, ZHANG Lana, NIU Jia-rana, LIU Xiaoa, HAN Wei-yia

(a. School of Design Art & Media b. Research School of Industrial Internet, Nanjing University of Science and Technology, Nanjing 210094, China)

Facing the complex battlefield environment and dynamic changeable combat demands, man-machine cooperative combat has become the inevitable trend of air combat. The cockpit display control interaction is a method to realize man-machine cooperation, which has an important influence on obtaining battlefield advantages and achieving combat targets quickly. Firstly, the development history of fighter cockpit display control system, representative figures and related research findings are reviewed. Secondly, based on the challenges in the man-machine cooperative combat, the paper analyzes the status and trend of fighter cockpit display control interaction; and concludes the research hotspots in the aspect of information representation design and interaction realization form. Finally, this paper prospects the development trend of fighter cockpit display control interaction. In order to cope with the complex air combat environment that have extremely large amounts situation information, man-machine cooperative warfare emerges as the times require, which is closed related to the fighter cockpit. The support of intelligent technology and the demand of man-machine cooperation combat urge the development of fighter cockpit display control interaction, which are the interface design mode of task-related, information presentation, cognitive integration and multi-channel interaction method.

cockpit display; interaction technology; man-machine coordination

TB472

A

1001-3563(2022)10-0001-13

10.19554/j.cnki.1001-3563.2022.10.001

2022-01-15

中央高校基本科研重大基础研究专项(30920041114);国家自然科学基金(52175469,71601068);江苏省社会科学基金(20YSB013);国家社会科学基金后期资助项目(20FGLB046);江苏省重点研发计划(社会发展)项目(BE2019647)

吴晓莉(1980—),女,博士,教授,博士生导师,主要研究方向为人因与设计工效学。

张蓝(1995—),女,博士生,主要研究方向为人因与设计工效学。

责任编辑:陈作