混合现实电子沙盘虚拟对象的手眼协同交互设计研究

2022-03-24胡勇何玉振熊梦涵沈旭昆

胡勇,何玉振,熊梦涵,沈旭昆

【院士专栏:国防装备设计与制造】

混合现实电子沙盘虚拟对象的手眼协同交互设计研究

胡勇ab,何玉振ab,熊梦涵ab,沈旭昆ab

(a.北京航空航天大学 新媒体艺术与设计学院 b.北京航空航天大学 虚拟现实技术与系统国家重点实验室,北京 100191)

面向混合现实电子沙盘虚拟3D对象,开展3D交互性能与用户体验研究与评估,提出交互设计原则和设计建议。针对混合现实环境下双手可触范围外的虚拟对象“选择”任务开展交互设计研究,引入虚拟对象布局排列方式作为评估变量,在3种典型的虚拟对象布局情况下,分别进行手控光线、头动、眼动与手势协同的3种交互方式性能及用户体验对比研究。通过设计原型实验系统,进行用户体验测试,实验数据分析与评估,验证交互设计原则,提出交互设计建议。实验结果显示眼动与捏合手势结合的手眼协同交互方式在时间、任务负荷及用户偏好方面都具有显著优势。手控光线与手势协同交互的准确性最优,并且这一优势在任何一种布局方式中都有所体现。建议混合现实环境下的“选择”任务交互设计要注重功用性、持续性和愉悦性原则,提出了降低“选择”任务交互的工作负荷与疲劳及增强新颖交互提升愉悦性的设计建议。

混合现实;3D交互;交互设计;体验设计与评估

沙盘是地理信息的立体化展示工具,被广泛应用于军事指挥、城市规划、大型赛事活动等领域,然而传统实体沙盘已经逐渐难以满足复杂动态变化信息的呈现需求。近年来,混合现实技术快速发展,通过在现实场景中叠加虚拟内容,令物理空间和虚拟空间相交叠,融合产生新的可视化环境,为用户提供增强全息实时数字内容,衍生出混合现实电子沙盘的应用形态。2021年,美国军方与微软签订了4.8亿美元的混合现实设备合同,从战略决策、战役规划、战术实施3个层次打造基于混合现实的新型协同作战系统。利用混合现实技术呈现战场的实时态势数据,通过预估预判对实际战争中的部队施加控制和调节,应用于战役层面的指挥决策和战术作战训练,未来将使战争进程和战争效果显性化,进而辅助战争决策的一种新理论和新技术。混合现实电子沙盘构建虚实融合的3D物理环境,利用3D图形进行数据信息可视化,使用户以自然交互的方式浏览数据并查询可视化的各个节点,帮助人们建立一种全新的空间信息理解与洞察。相较于传统实体沙盘,混合现实电子沙盘作为新型可视化操作平台,具有强沉浸式体验、展示效果丰富、展示内容多元等优势,以强交互性传递沙盘信息并为用户提供身临其境的体验。

1 混合现实电子沙盘及虚拟对象交互

1.1 混合现实电子沙盘

混合现实(Mixed Reality,简称MR)[1]是将物理世界和虚拟世界进行融合呈现,从而创造出高沉浸感、可自然交互的虚实融合环境,物理对象、虚拟对象与人共存,并可以实时相互作用,强调虚实对象融合的一致性、空间感知与定位的准确性、多通道交互与反馈的自然性。

混合现实电子沙盘是基于混合现实技术的数字化沙盘,由表示地形数据信息的虚拟地形模型、表达动态数据信息的虚拟态势模型、实现系统交互的3D用户界面组合而成,通过在现实场景中叠加虚拟内容,令物理空间和虚拟空间相交叠,融合产生新的可视化环境,为用户提供增强全息实时数字内容,并满足多人协同的实时自然交互。混合现实电子沙盘能够克服传统实体沙盘的诸多局限性(只能在固定的比例下向参观者展示,参观者无法了解沙盘内部的信息;制作周期较长,不能随意更改内容、不能重复利用,并且展示效果单一等),能够更直观地呈现空间信息,帮助用户观察场景方位,对地理位置形成清晰认知;能够提供更加全面丰富的信息动态呈现与交互形式,将不同维度的抽象信息具象化,对信息进行动态可视化呈现,并可以直接与虚拟对象进行自然交互;可以打破空间限制,使身处不同空间的用户佩戴混合现实头盔同步协同参与沙盘信息呈现与交互;为用户提供沉浸式体验环境,提高用户参与度,提升用户愉悦度,增强用户感知度,见图1。

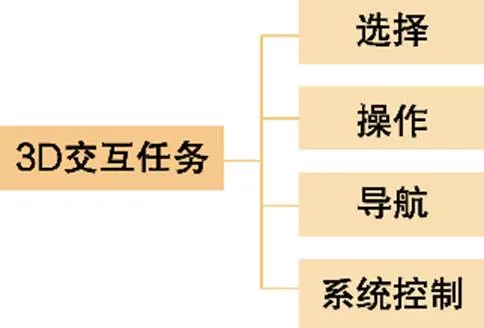

1.2 虚拟对象的3D交互

3D交互指的是一种有关用户如何在三维环境中执行不同类型任务的交互机制[2]。虚拟现实和混合现实领域常见的3D交互任务被分为以下4类:选择、操作、导航和系统控制[3],见图2。在混合现实电子沙盘环境中,用户在物理世界中移动位置并与虚拟对象进行交互,对导航任务的需求明显低于虚拟现实环境,且选择任务是操作虚拟对象或系统控制对象的前提,因此文中主要针对选择交互任务开展深入研究。

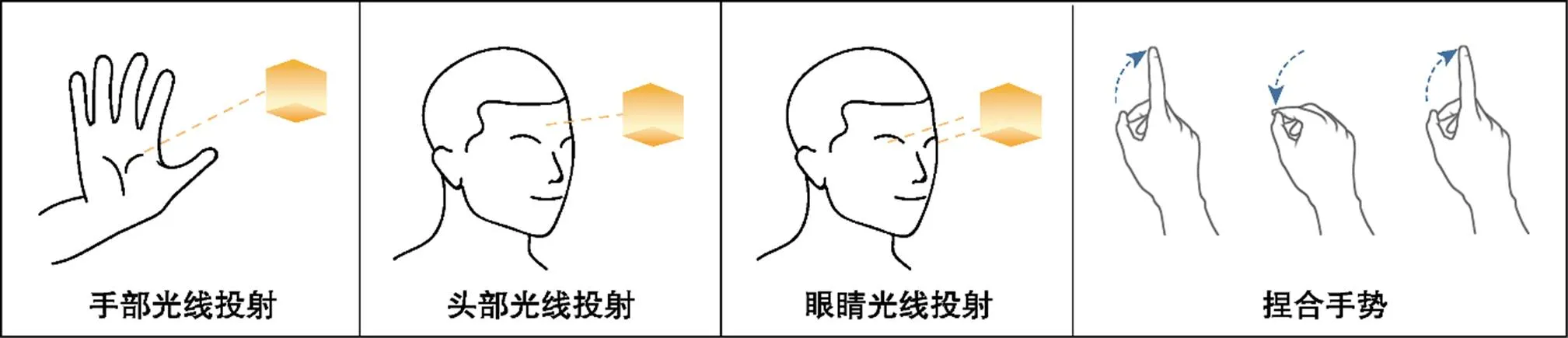

选择是3D交互中常见的基本交互操作,其含义是一种从虚拟对象全集中识别或选取出目标对象的任务,有时也称为目标获取任务[4]。选择任务的交互方式可以按照交互对象与用户的距离分为可触范围内的对象交互和可触范围外的对象交互[5]。与可触范围内对象进行选择任务交互,执行选择任务时可以直接触摸虚拟对象,是与物理世界相一致的最自然的人机交互方式。与可触范围外对象进行选择任务交互明显区别于物理世界中的交互,用户需要指向并瞄准目标物体,再完成确认,见图3。在选择任务中,交互过程由指向瞄准、确认选择、选择反馈3个过程组成,目前主要的指向操作技术是基于矢量光线投射技术,光线可以从手部、头部或眼睛投射,光线与虚拟物体相交处呈现光标;目前主要的确认操作为捏合手势,通过捏合(或张开)手指来完成确认,见图4。

图1 混合现实电子沙盘的多种应用场景

图2 混合现实环境中的3D交互任务分类

图3 可触范围内和可触范围外的选择任务

Fig.3 Selection tasks within and without direct touchable range

混合现实电子沙盘与一般的混合现实应用相比,更强调空间位置信息和用户观察方位,在用户周边可触范围内或远处可触范围外,都存在较多基于空间位置的标注信息呈现与交互,单纯的手部、头部或眼部的交互都难以满足良好的交互体验需求。针对混合现实电子沙盘中交互对象空间分布因素的影响,从手部交互和眼部交互协同的角度出发,如何设计效率高、用户体验良好的手眼协同选择任务交互方式是目前具有挑战性的问题。

图4 光线投射技术与捏合手势

2 研究现状分析

混合现实环境中的3D交互设计是连接虚实融合环境中人与虚拟对象、人与交互设备及人与人之间的桥梁。Joseph等人[3]在著作《3D用户界面设计与评估》中从设计师和开发人员的角度,系统地梳理了3D用户界面交互设计的相关内容,总结经过经验验证的设计指南,是目前关于3D交互设计较为全面的介绍。但是,混合现实3D交互技术快速发展、应用领域快速扩展,对交互方式在执行各类基础操作时的性能与用户体验评估,出现了较多新的研究问题,文中将聚焦混合现实环境下的选择交互任务,围绕交互性能和用户体验评估,总结近几年发表的最新学术成果。

在选择任务的3D交互设计与评估中,主要涉及2个方面,一是研究对象:绝大多数评估都涉及多种交互方式的对比;二是评估的度量:系统性能度量、任务性能度量和用户偏好度量,这3种评估度量在不同的研究中有不同的涉及,有些研究只进行其中一种度量的评估,有些研究则进行其中2种或3种度量的评估,其中任务性能和用户体验通常同时出现。Mutasim等人[6]从性能和用户体验的角度对比了执行选择任务时的3种交互方式,分别是基于眼动的捏合手势(Pinch)、基于眼动的单击按钮(Click)和基于眼动的停顿选择(Dwell)。结果表明,作为一种选择技术,停顿选择误差最小,但执行时间和吞吐量最差,单击按钮与捏合手势在性能上没有显著差异。参与者主观反馈更喜欢单击按钮,因为捏合手势会因为识别错误而令人沮丧,而且似乎会导致更多的身体和精神疲劳。研究建议,对基于眼睛凝视的虚拟现实系统,当控制器不可行时,使用眼动结合捏合手势执行选择任务。Ryu等人[7]提出了凝视-抓握交互(gaze-grasp pose interaction)新型交互方式,并将其与光线投射交互进行对比评估。结果表明在目标对象重叠的情况下,凝视-抓握交互比光线投射提供更好的性能。就时间和错误率而言,对象大小的波动对凝视-抓握交互的影响比对射线投射的影响小。用户反馈表明,凝视-抓握交互更为自然且易于使用。Blattgerste等人[8]从性能和用户体验的角度对基于眼睛注视的选择和基于头部注视的选择这2种交互方式进行了对比评估。评估实验中还将视野范围和交互的UI元素作为变量条件。结果表明,在各种条件下,眼睛注视在完成任务的时间、头部运动负荷和错误率方面都优于头部注视。Chen等人[9]开展了在虚拟现实环境中的消歧技术实验分析,从性能和用户体验的角度比较了3种输入方式(头部注视、语音和足部叩击)与3种不同的时间选择(交互前、交互中和交互后),研究如何解决歧义问题。结果表明,在与目标的交互过程中,使用头部注视进行消歧效果最好。Kang等人[10]提出了微缩世界(Worlds-in-Miniature)交互技术,对选择和操作交互,对比了眼动、直接抓取和在微缩世界里交互3种方式,其中微缩世界交互表现出最好的可用性和交互性能。但是,微缩世界中手部对虚拟物体的遮挡会降低交互性能,且不适用于只需要选择不需要操作的远距离虚拟对象交互。Linda等人[11]针对基于屏幕的视窗交互系统应用,对比了眼动交互与手势交互在选择任务中的性能,眼动交互效率更高且身体疲劳度较低。Kyto等人[12]从交互速度和准确度方面对比分析了头动和眼动2种交互方式,眼动交互速度更快,更符合人体工程学,但会受设备校准误差和眼动传感器的漂移误差的限制。其中,被选择对象的尺寸对两种交互均具有重要的影响。Weise等人[13]对虚拟现实环境中的选择和操作交互按照技术维度进行了分类,并从可用性和用户体验的角度进行了评估,对比分析了多种选择交互技术,并提供了一个工具帮助设计师根据应用场景确认合适的选择和操作任务交互技术。

目前,选择任务瞄准的方式主要有手部瞄准、头部瞄准和眼睛瞄准等,确认方式有注视时间、捏合手势和利用控制器设备等。其中捏合手势在大部分评估结果中具有优势,瞄准方式的评估结果则各不相同。因此文中将捏合手势作为确认方式,关注不同瞄准方式性能与体验评估。同时,被选择对象物体的空间布局对选择任务的影响尚未被研究,因此文中归纳现有的空间布局方式,并将其作为变量条件加入到评估实验中。

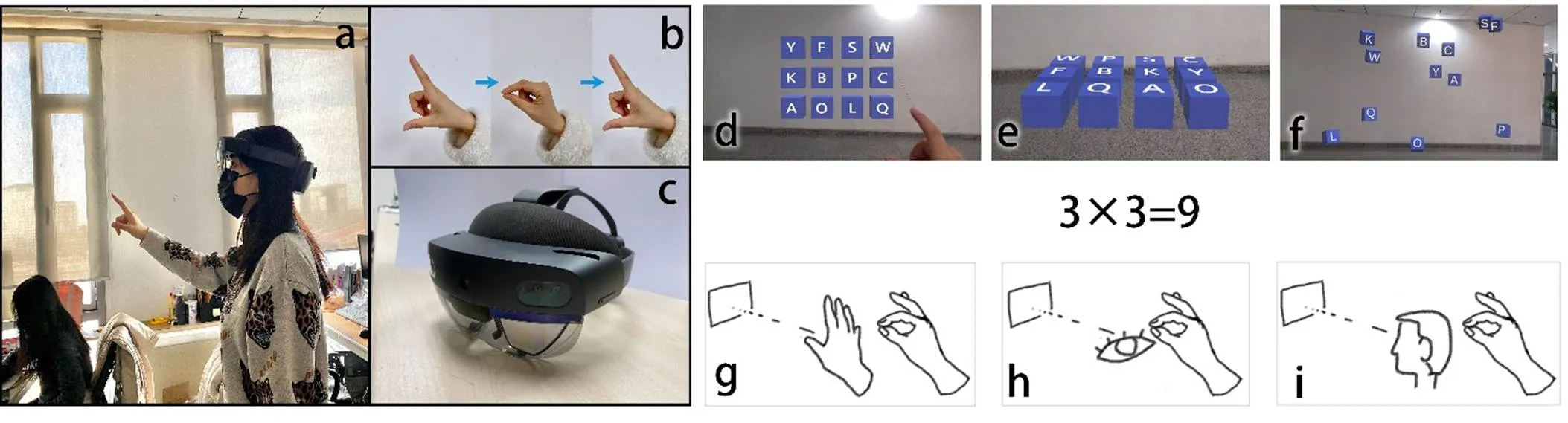

3 手眼协同的“选择”任务交互设计与评估

针对混合现实环境中的选择任务,设计原型实验,结合被选择对象的空间布局,进行手眼协同的交互性能和用户体验评估,以探究文中所提出的设计原则能否适用于各种空间布局类型的应用场景,以及不同的空间布局对交互方式的性能和用户体验的影响。实验设置了3种主流的选择任务交互方式:手控光线与捏合手势协同交互、头动与捏合手势协同交互及眼动与捏合手势协同交互;同时针对选择的对象设置了垂直布局、水平布局和分散布局3种不同的布局方式。将上述6个条件交叉组合成9个任务并进行对比实验研究(见图5),关注每种布局方式中3种交互方式的性能和用户体验。

图5 任务交互方式

评估标准:选择任务作为混合现实交互中最主要的任务,包含2种行为,一是瞄准,二是确认。如何提升人们执行选择任务时的性能及用户体验,需要从交互的功用性、持续性和愉悦性3个角度进行考虑,设计相应的瞄准和确认交互方式。功用性较高的交互方式能够在选择目标对象的准确性和效率上展现出优势,通过降低技术性疲劳提高完成选择任务效率;持续性较长的交互方式能够降低用户操作时的疲劳感,通过降低姿势性疲劳,较长时间保持舒适的交互状态,提升用户完成任务的概率;愉悦性较强的交互方式能够有助用户在进行选择交互时改善主观感受,通过选择新颖趣味的交互方式,调动积极探索情绪,增强用户体验感。

3.1 实验设计

1)手眼协同交互方式。此实验使用Hololens 2搭建混合现实环境。使用手控光线与捏合手势协同交互时,会有一条射线从用户手掌中心射出,将光标附着到光线的末端,以指示光线与目标对象相交的位置,见图6a。使用头动与捏合手势协同交互时,光标随着用户头盔的旋转而移动,并且仍然使用捏合手势来选择目标对象,见图6b。使用眼动和捏合手势协同交互时,光标跟随眼睛的凝视位置,并且仍然配合捏合手势合作来选择对象,见图6c。

2)被选择对象布局。三维交互对象的布局可分为两类:集中布局和分散布局。前者是指信息集中在某一区域,其两种主流的空间布局方式是:垂直布局和水平布局。此试验将垂直布局、水平布局和分散布局作为变量进行研究,见图5d、图5e、图5f。选择12个长、宽、高都是32 cm的立方体作为被选择对象,进行不同的布局测试。垂直布局:12个立方体三行四列排列,相邻间距为8 cm,整个矩阵与地面垂直,距离相机2.7 m。水平布局:12个立方体左右相邻间距为8cm,整个矩阵与地面平行,由近及远每行立方体与相机的距离分别为2.4 m、2.8 m和3.3 m。分散布局:将12个立方体随机分布在垂直面和水平面上。

图6 手势协同交互

3)参与者。共有14名参与者参加实验,其中6名男性和8名女性。参与者年龄在18~45岁,平均22岁(SD=6)。参与者包括13名艺术设计、计算机和自动化专业的本科生和研究生,1名IT从业者。2名参与者没有使用AR或MR的经验,4名参与者几乎没有使用AR的经验,8名参与者有使用AR或MR的经验。

4)任务与程序。参与者的任务是按照语音指令完成8个目标对象的选择。在每个布局中,参与者被要求分别使用3种交互方式完成选择任务,即每个参与者都需要进行九次任务。为了防止学习效应,每个参与者所执行任务的3种布局条件与交互方式的顺序均为随机设定。

5)实验评估方式与数据的采集。完成任务所需的总时间作为效率指标进行测量,选择目标对象的错误数被测量作为准确度的指标,每完成一种布局下的3种交互后,参与者通过回答问卷进行一次评估互动,包括SUS[14]、SEQ[15]、NASA-TLX[16]及关于享受和兴趣的问题(采用扩展技术接受模型[17]),共进行3次。完成所有任务和问卷后,参与者被邀请进行半结构化访谈,包括选择最喜欢的交互方式和最喜欢的搭配及其他感受。每位参与实验的用户参与过程大约花费50 min。

通过测量完成每项任务所需的时间检验交互模式的效率,通过误差数检验交互的准确性。为了更好地了解参与者在3种交互设计方面的经验,进行了半结构化访谈。访谈问题主要包括5个项目:你最喜欢哪种交互方式,为什么你更喜欢这种交互方式,你喜欢或不喜欢其他交互方式的哪些方面,你最喜欢哪种搭配,哪种搭配最难使用。

3.2 实验数据定量分析

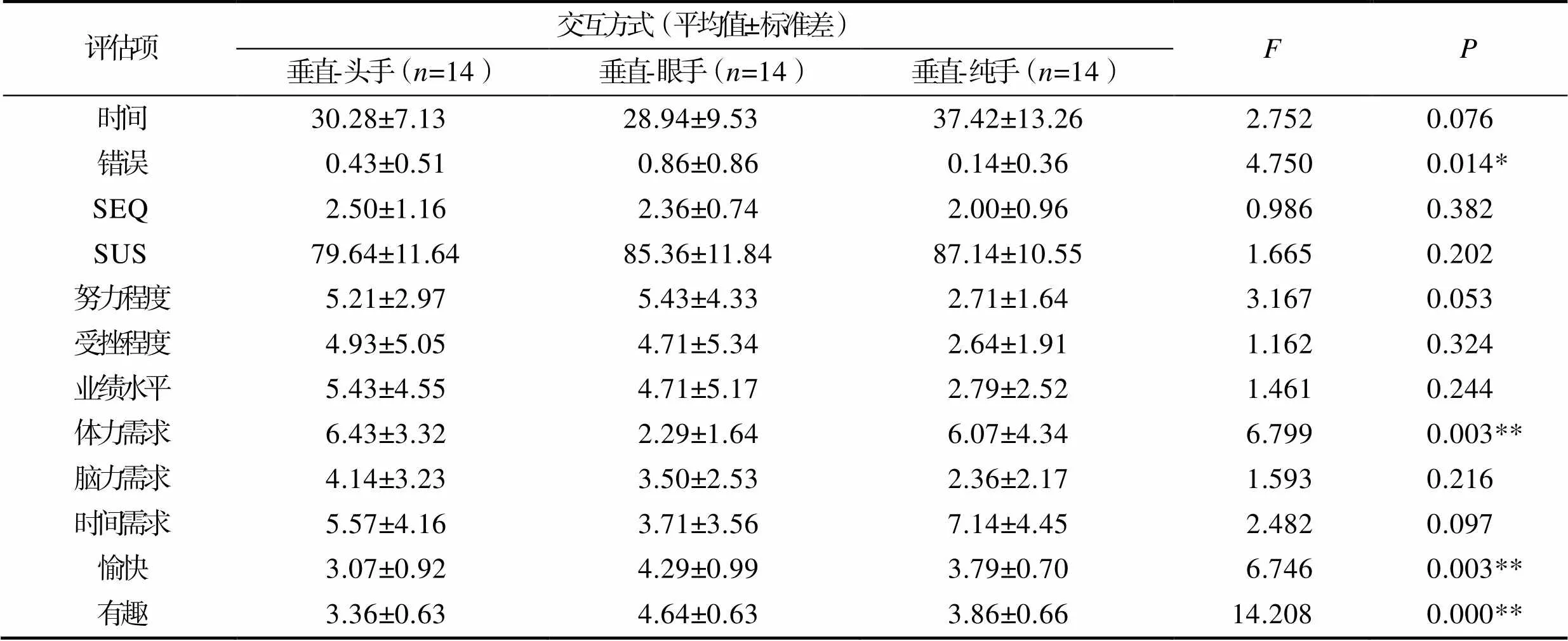

按照布局条件,对每种交互方式的数据进行方差分析,并对重点数据进行配对t检验,设置95%置信区间,数据处理分别见表1—3。可得出以下结果。

表1 垂直布局条件下的实验数据分析

Tab.1 Analysis of experimental data under vertical layout

注:*<0.05 **<0.01。

表2 水平布局条件下的实验数据分析

Tab.2 Analysis of experimental data under horizontal layout

注:*<0.05 **<0.01。

表3 分散布局条件下的实验数据分析

Tab.3 Analysis of experimental data under discrete layout

注:*<0.05 **<0.01。

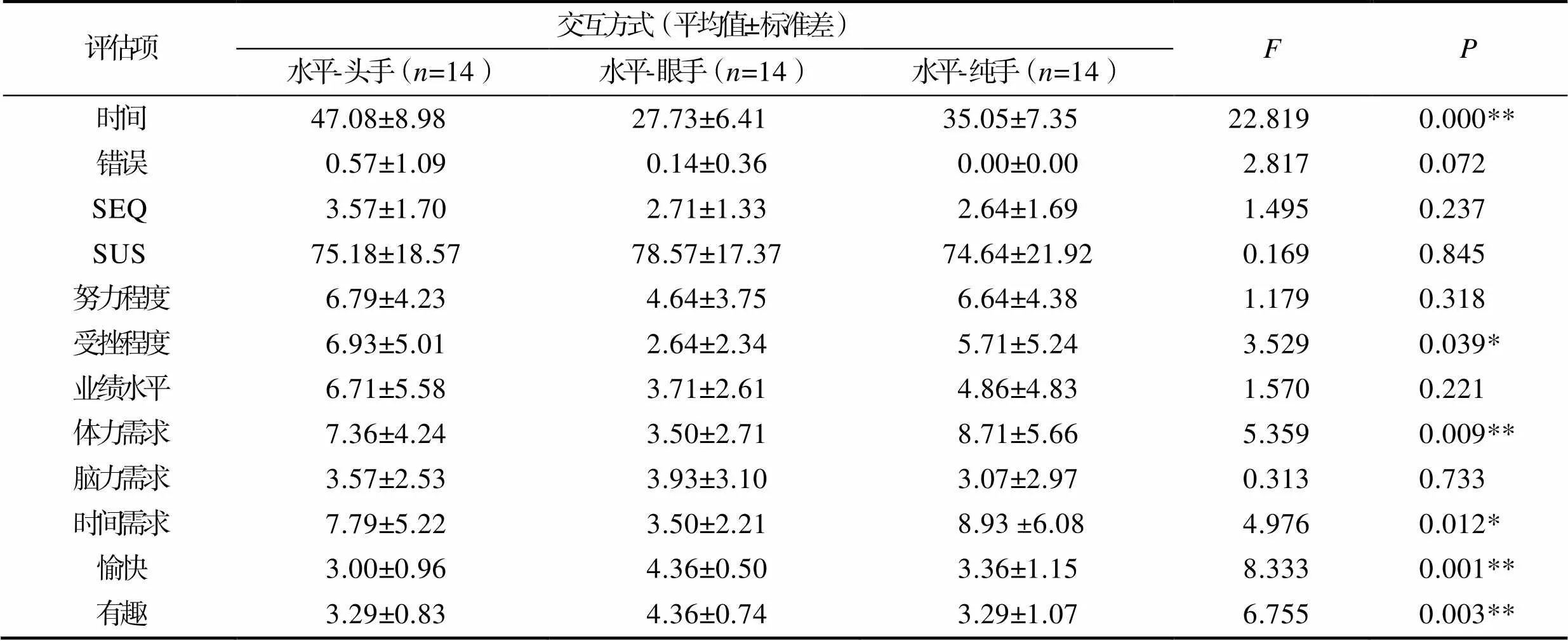

1)任务完成时间。方差分析表明在水平布局和分散布局中,不同交互方式对任务时长有显著影响。在水平布局中,交互方式对时间呈现出显著差异((2,39)=22.819,<0.001,2=0.539),以及具体对比差异可知,眼动+手势交互比手控光线+手势交互的用时更短(眼动+手势=27.73,眼动+手势=6.41;手控光线+手势=35.05,手控光线+手势=7.35;头动+手势=47.08,头动+手势=8.98)。在分散布局中,交互方式对时间呈现出显著差异((2,39)=8.389,<0.001,2=0.301),眼动+手势交互比手控光线+手势交互的用时更短(眼动+手势=40.99,眼动+手势=10.01;手控光线+手势=46.08,手控光线+手势=9.4;头动+手势=56.13,头动+手势=10.41)。在垂直布局中,3种交互方式的用时排序是眼动+手势交互的用时最短,头动+手势交互的用时中等,手控光线+手势交互的用时最长。分析结果,见图7。值得注意的是,眼动+手势交互无论在哪种布局中,耗时都是最短的。

2)错误率。方差分析表明,不同交互模式对垂直布局和分布式布局的准确性有显著影响(垂直布局(2,39)=4.75,=0.014,2=0.494;分布式布局(2,39)=5.364,=0.009,2=0.524)。尽管手控光线与捏合手势交互的速度很慢,但准确度在任何布局中都是最高的。眼动与捏合手势交互的稳定性较差,垂直布局中的平均错误次数为0.86,分布式布局中的平均错误次数为0.71,分析结果,见图7。

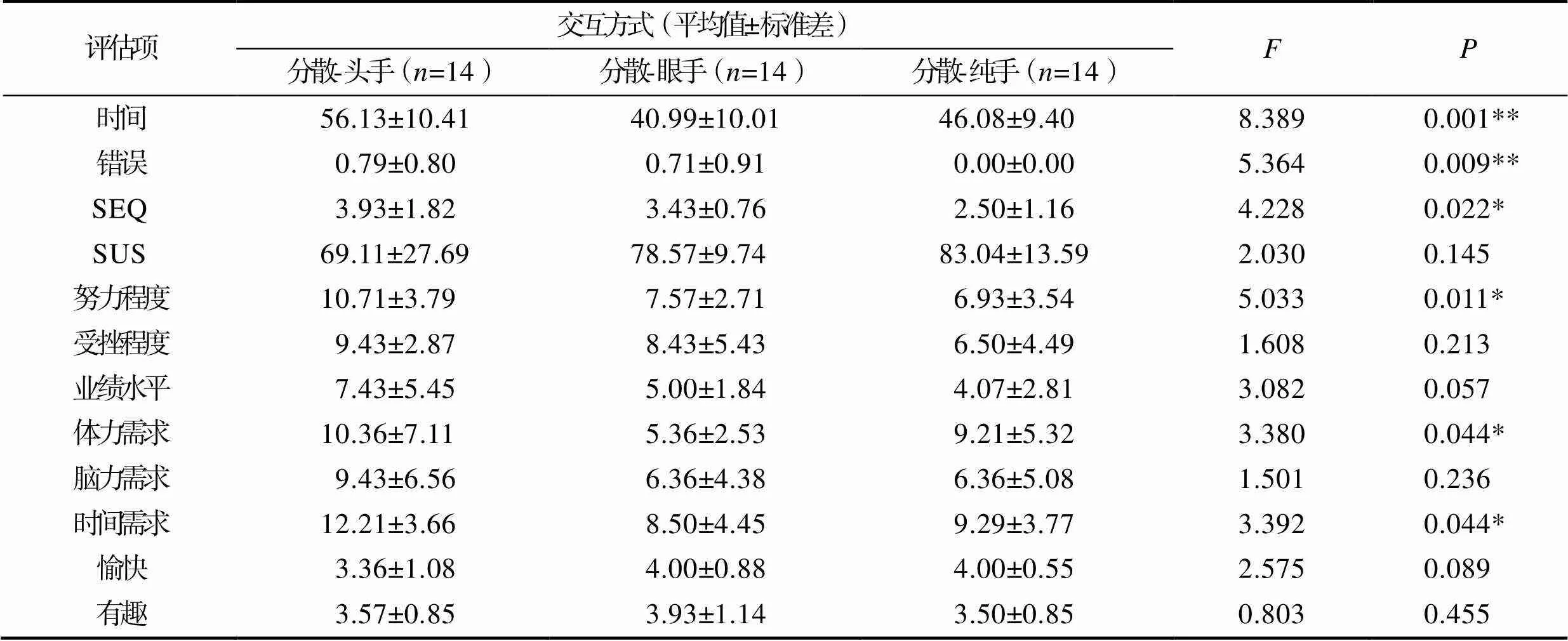

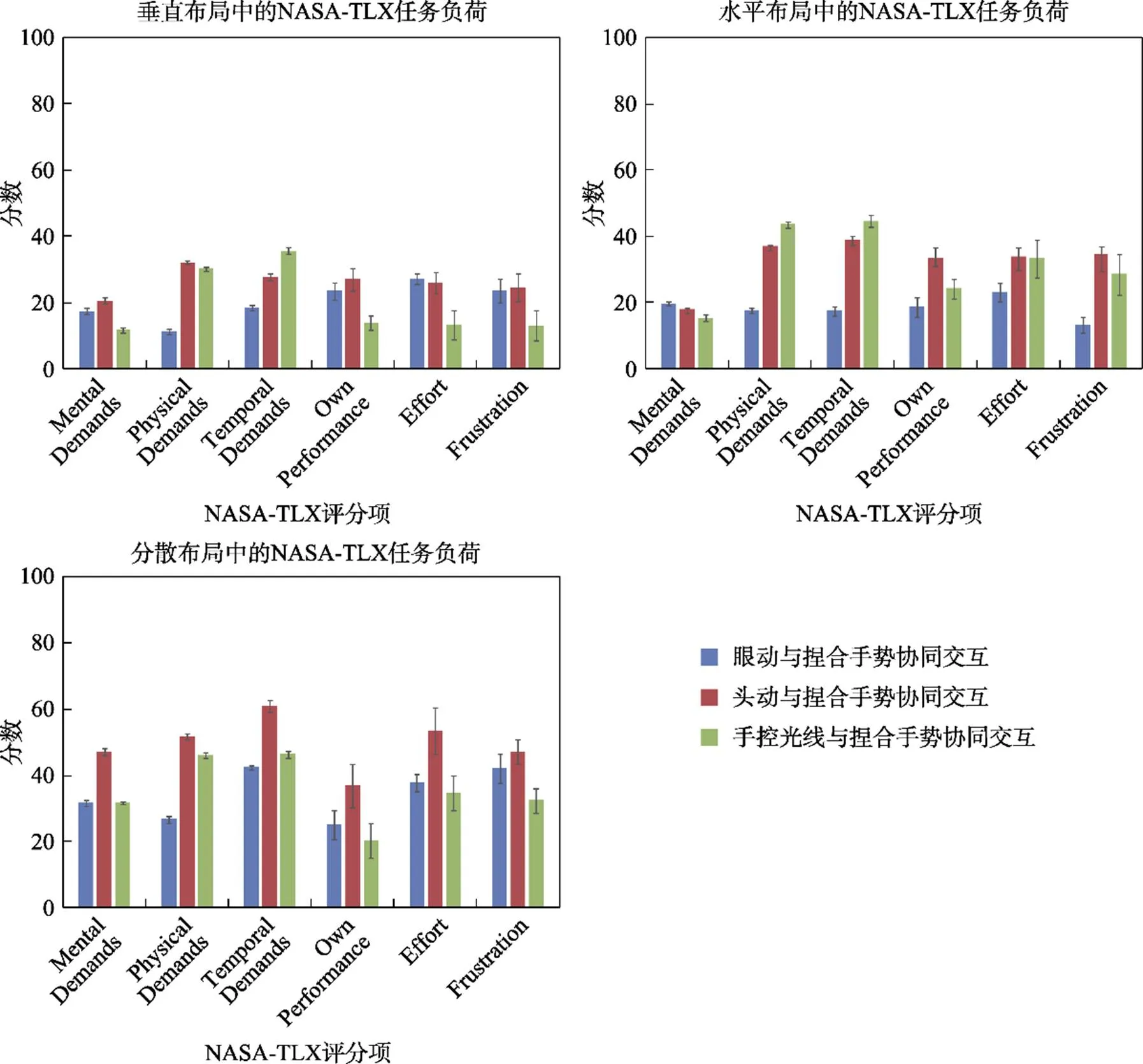

3)任务负荷。方差分析结果,见图8。在垂直布局中,交互方式对体力负荷有显著影响((2,39)=6.799,=0.003,2=0.259),眼动+手势交互呈现明显的优越性(眼动+手势=2.29,眼动+手势=1.64);在水平布局中,受挫程度((2,39)=3.529,=0.039,2=0.153),体力负荷((2,39)=5.359,=0.009,2=0.216),时间负荷((2,39)=4.976,=0.012,2=0.203)都具有显著差异,值得注意的是“眼动+手势”交互在这3个方面都呈现明显的优越性;在分散布局中,努力程度((2,39)=5.033,=0.011,2=0.205),体力负荷((2,39)=3.380,=0.044,2=0.148),时间负荷((2,39)=3.392,=0.044,2=0.148)存在显著差异,眼动+手势交互在体力负荷方面呈现明显的优越性,头动+手势交互在努力程度和时间负荷方面均呈现出明显的劣势。

图7 完成任务的时长和错误次数的数据可视化

图8 任务负荷量表结果的数据可视化

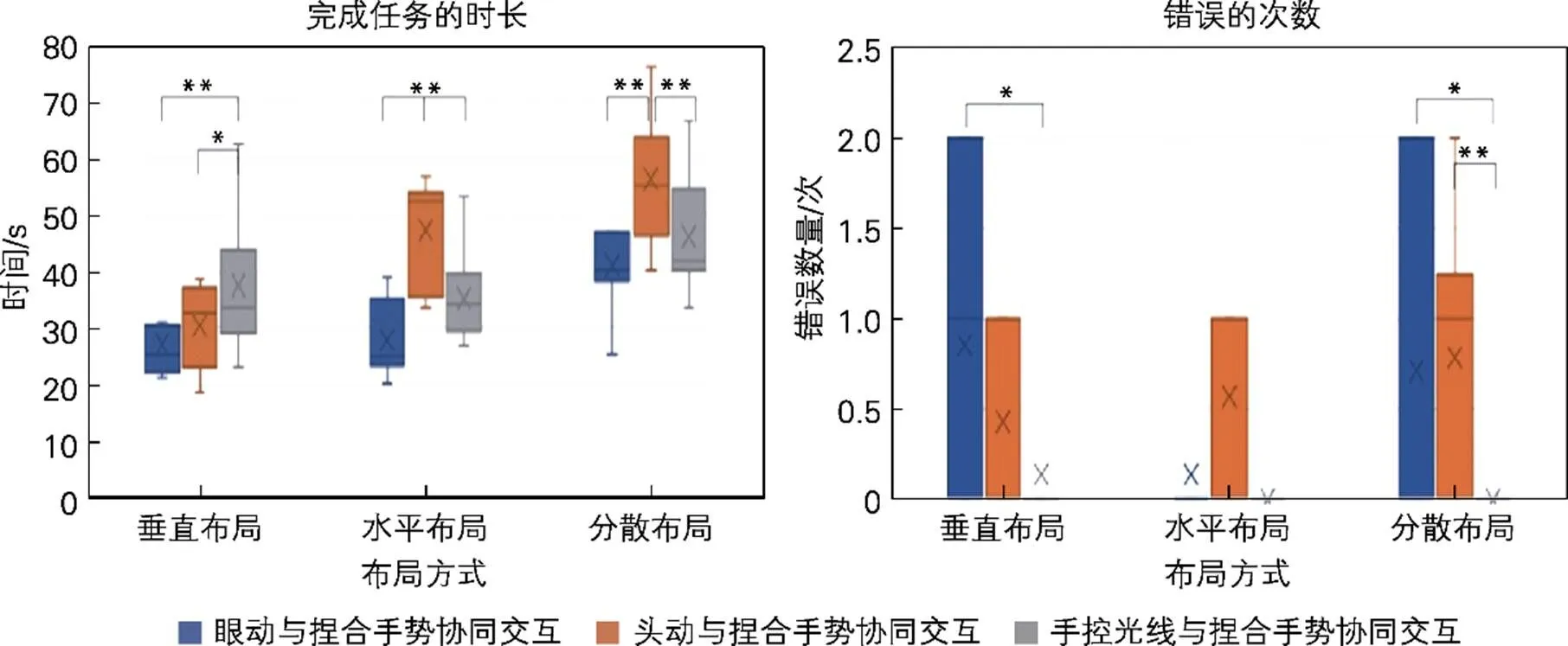

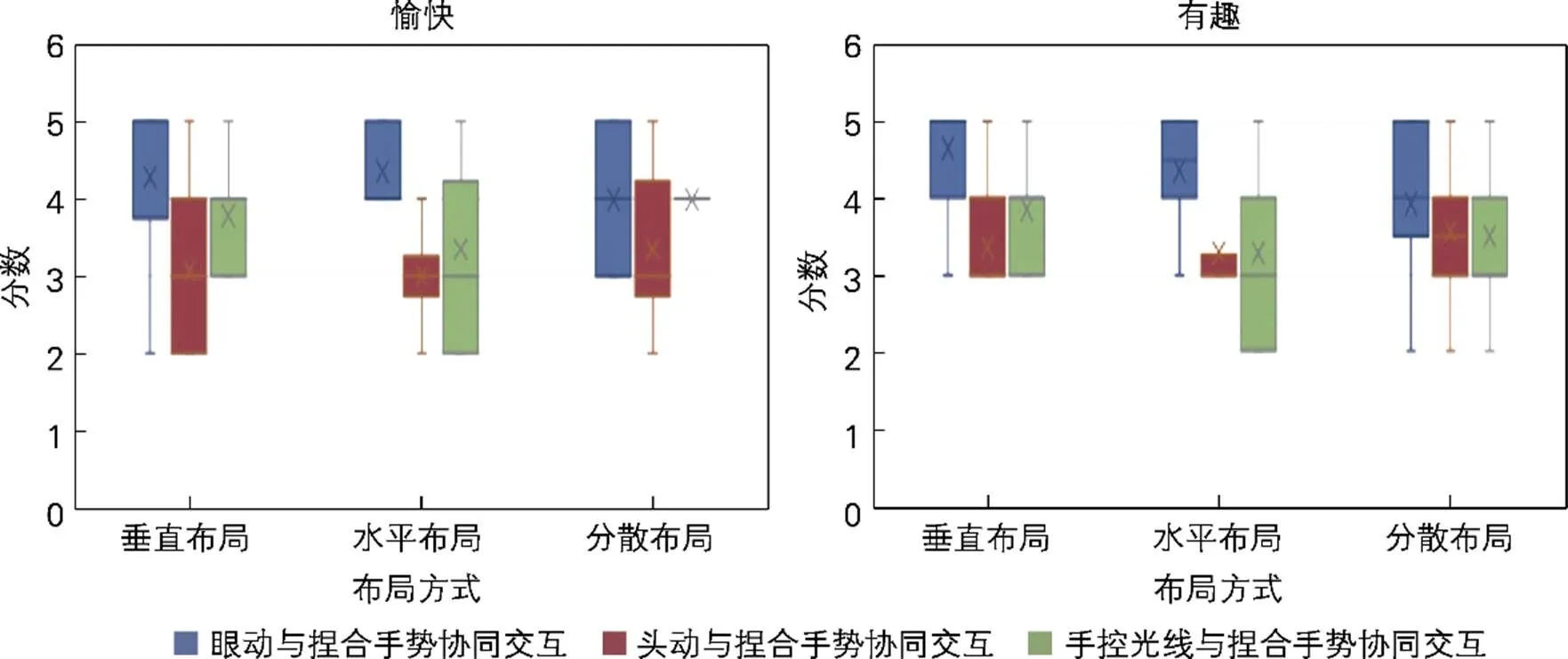

4)愉悦性。方差分析的结果,见图9。在垂直布局中,愉快((2,39)=6.746,=0.003)和有趣((2,39)=14.208,<0.001)都呈现出显著差异。在水平布局中,交互模式在愉快((2,39)=8.333,<0.001)和有趣((2,39)=6.755,=0.003)也呈现出显著差异。无论在哪种布局方式中,眼动+手势交互的得分都是最高的,并且在垂直布局和水平布局中有显著的优越性。这与访谈的结果一致。

图9 愉快和有趣结果的数据可视化

3.3 实验过程定性分析

1)交互方式分析。在整个交互过程中,记录了参与者在每个任务中做捏合手势的动作特点。结果发现瞄准方式对捏合手势的执行有一定影响。手控光线瞄准仅需要较少次数的捏合手势就能完成任务。导致这种现象的原因是为了用手控光线来指示方向时,参与者始终将手放在手跟踪识别较准确的范围内。然而当参与者用头或眼睛进行瞄准时,通常会忽略手的位置,经常还没有把手移动到手跟踪识别的有效范围内就不停地做捏合手势,从而产生无效的动作。有一名参与者认为,水平布局中的立方体都是位于视平线以下,需要低头去看,手的自然位置也位于视平线以下,所以手始终在有效跟踪识别范围内,不会出现手丢失的情况。

2)半结构化访谈。后续访谈更深入地回顾了每种交互方式的优缺点。超过1/3的参与者表示,他们最喜欢眼动与捏合手势协同交互,因为他们几乎不需要移动头和手。一些参与者认为“如果识别非常准确,我认为眼动与捏合手势协同交互是一种非常好的互动”。此外,3名参与者更喜欢头动与捏合手势协同交互,因为他们认为头部定位准确,并且很容易找到光标位置。然而,超过1/3的参与者会遇到头部疲劳的问题。虽然数据分析的结果显示,手控光线与捏合手势协同交互的准确度最高,但只有2名参与者选择它作为他们最喜欢的互动方式。他们大部分不喜欢的原因是手疲劳,手的位置让他们感觉不自然。

4 手眼协同选择任务交互设计原则与建议

根据“选择”任务交互方式在不同对象布局方式中的性能和用户体验数据分析与评估结果,文中给出了下列具体的设计建议。

1)眼动与捏合手势协同交互提供最快速的选择,手控光线与捏合手势协同交互提供最高的准确性和流畅性。在任务时间方面,眼动与捏合手势协同交互有绝对优势,这可以体现在用眼睛瞄准的效率高于头或手瞄准的效率。在错误率方面,手控光线与捏合手势协同交互的错误率最小。一方面是因为人们对手的控制最好,另一方面的原因是用手瞄准时会有一条射线从手中发出,就像手的延长,这使用户非常清楚地知道自己正在瞄准哪个物体。综上可知,眼动与捏合手势协同交互在效率方面具有优势,以及手控光线与捏合手势协同交互在准确性方面的优势适用于多种对象布局方式,在混合现实环境中的适用性比较广泛。

2)眼动与捏合手势协同交互的任务负荷最小,且随虚拟物体布局越分散其优势越显著。在任务负荷方面,通过对交互方式进行了精神负荷、体力负荷、时间负荷、自我满意度、努力和挫败六个维度的衡量,结果发现无论在哪种布局中,眼动与捏合手势协同交互在精神负荷方面都有显著的优越性。在水平布局中眼动与捏合手势协同交互带给用户的挫折感最小。在水平布局中,立方体之间有明显的远近距离差异,遵循近大远小的规律,并且近处的立方体对远处的立方体有遮挡,这导致远处的立方体可被瞄准的范围较小。此时用头或手去瞄准就变得困难,因为用户需要将头或手的移动控制在微小的范围内。用眼睛瞄准是人们自然的行为,在瞄准小物体时优势更明显。在分散布局中,头动与捏合手势协同交互在努力和时间负荷方面有显著的劣势。有参与者说,人们在环顾四周寻找目标物体时,很不容易找到头部的光标。光标是头部指示方向与物体的交点,物体离自己有近有远,所以光标也时近时远。参与者还表示他们认为用头瞄准非常不自然,并且感觉不够智能。分散布局比垂直布局和水平布局更接近现实世界物体的布局方式,但同时在分散布局中进行交互的整体任务负荷量更大,只有眼动与捏合手势协同交互在体力负荷这个单一维度上有显著优势,因为移动头或手比移动眼睛需要更多的能量。一个合理的预期是随着物体布局范围的增大,用眼睛瞄准的优势将会更加显著。

3)眼动与捏合手势协同交互的用户偏好最强。大多数参与者更喜欢眼动与捏合手势协同交互,并且表示用眼睛进行交互最符合他们对未来交互的想象。然而他们也指出了眼动追踪器的追踪质量问题,这在一定程度上影响了他们的问卷答案。

5 混合现实电子沙盘应用

文中将手控光线、头动、眼动与捏合手势协同3种交互方式的性能及用户体验评估结果,应用于“科技冬奥”重点专项课题“基于混合现实的冬奥会态势可视化与会商技术”所研发的“混合现实电子沙盘协同会商系统”,构建了单人、本地多人协同、异地多人协同3种应用模式,见图1。在混合现实电子沙盘协同会商系统中,可触范围外的可交互虚拟对象有两大类,一类为与地形数据有关的态势数据,属于分散布局,一类是与地形数据无关的浮动面板信息,属于垂直布局分布,见图10。

图10 混合现实电子沙盘协同会商系统中可交互对象的布局示意

基于文中对交互方式的研究和冬奥混合现实电子沙盘这一场景的需求,最终选择用直接触摸交互的方式选择可触范围内的虚拟对象。面向不同的用户群体,分别选用眼动与捏合手势协同或手控光线与捏合手势协同,完成系统中所有的可触范围外的对象选择任务。

1)眼动与捏合手势协同的交互方式具有操作速度快,任务负荷低的优势,在混合现实复杂的虚拟环境中仍能带来较为愉悦的用户体验,因此这种交互方式适用于已经具备了混合现实设备使用经验的用户和需要长期使用设备的用户,这类人群追求高效的操作和流畅的体验,同时能够长时间工作而不感觉疲劳。

2)手控光线与捏合手势协同的交互方式符合用户的认知,易学性较好,且无需进行任何校准设置就能保持比较稳定的准确率,因此适用于初次使用混合现实设备的新用户和临时使用设备的用户,这类人群的诉求是能够快速掌握操作方法,并自行使用。他们追求高准确性和低挫败感,但是使用系统的时间不会持续太久。

6 结语

混合现实环境下的3D交互设计研究,主要解决用户在混合现实环境下执行任务时的交互方式设计及用户体验评估,交互对象和交互技术受到空间属性和人体因素的影响,且硬件技术更新更快。随着混合现实应用场景的拓展和人机交互技术的发展,人机交互工程师和设计师迫切需要对混合现实环境下的3D交互进行设计与评估,丰富3D交互设计经验,引导3D交互技术研发,改善混合现实应用场景中3D交互方式的可用性和用户体验。文中以混合现实电子沙盘为应用场景,针对混合现实电子沙盘中的虚拟对象选

择任务,结合被选择对象布局方式,开展选择任务交互方式的性能与用户体验评估。设计并开展实验对手控光线与手势协同交互、头动与手势协同交互及眼动与手势协同交互这3种交互方式,执行选择任务时的性能和用户体验进行对比评估。实验创新性地融入了空间布局方式这一变量,评估结果显示眼动与捏合手势协同交互在时间、任务负荷及用户偏好方面都具有显著优势,尤其体现在分散布局的环境中。手控光线与手势协同交互的准确性最优,并且这一优势在任何一种布局方式中都有所体现。文中提出的是具有普适意义的设计原则与建议,对各种类型的混合现实系统的交互设计都具有参考价值。对设计师而言,此研究能够帮助设计师对种类繁多的交互方式进行快速且准确的筛选,在交互方式的选择层面最大程度上实现系统目标和满足用户需求。对用户,3D交互方式能够在非常大的程度上影响混合现实系统的使用体验,适宜的交互方式可以提高用户的操作能力和兴趣,激发用户持续使用混合现实的欲望,开启用户对未来人机交互的展望。

此研究针对混合现实电子沙盘中不同3D对象的布局开展了手眼协同交互模式的研究,然而在不同的应用中,布局会表现出多样性,一些布局的变化或各种布局的组合可能会影响交互效果。此研究提出的设计建议可供混合现实3D交互设计参考,当涉及特定的应用场景时,需要进行更有针对性的用户研究,以选择最合适的交互方式。此外,实验的参与者大多从未使用过混合现实设备,只是在完成任务前进行了短暂的学习。当参与者有足够的时间学习使用混合现实设备,或者邀请一些有混合现实体验经验的参与者进行实验时,结果可能会有所不同。另外,此研究只对“选择任务”进行研究,交互方式在导航和操作中可能呈现不同的结果,因此未来的研究将进一步关注混合现实交互操作的全过程交互体验设计。

[1] MILGRAM P, KISHINO F. A Taxonomy of Mixed Reality Visual Displays[J]. IEICE TRANSACTIONS on Information and Systems, 1994, 77(12): 1321-1329

[2] ResearchGate. User Interface Constraints for Immersive Virtual Environment Applications[EB/OL]. (2014-11- 22)[2020-04-21]. https://www.researchgate.net/publication/27521594_User_Interface_Constraints_for_Immersive_Virtual_Environment_Applications.

[3] 约瑟夫·小拉维奥拉, 恩斯特·克鲁伊夫, 瑞恩·克马汉, 等. 3D用户界面设计与评估[M]. 北京: 机械工业出版社, 2019. LAVIOLAJR J J, ERNST K, MCMAHAN P R, et al. 3D User Interfaces Theory and Practice[M]. Beijing: China Machine Press, 2019.

[4] ZHAI Shu-min, BUXTON W, MILGRAM P. The "Silk Cursor": Investigating Transparency for 3D Target Acquisition[C]. New York: Association for Computing Machinery, 1994.

[5] ResearchGate. Virtual Environment Interaction Techniques[EB/OL].(2013-06-23)[2020-03-22]. https://www. researchgate.net/publication/2812583_Virtual_Environment_Interaction_Techniques.

[6] MUTASIM A K, BATMAZ A U, STUERZLINGER W. Pinch, Click, or Dwell: Comparing Different Selection Techniques for Eye-Gaze-Based Pointing in Virtual Reality[C]. Germany: ACM Symposium on Eye Tracking Research and Applications, 2021.

[7] RYU K, LEE J J, PARK J M. GG Interaction: A Gaze–Grasp Pose Interaction for 3D Virtual Object Selection[J]. Journal on Multimodal User Interfaces, 2019, 13(4): 383-393.

[8] BLATTGERSTE J, RENNER P, PFEIFFER T. Advantages of Eye-Gaze over Head-Gaze-Based Selection in Virtual and Augmented Reality under Varying Field of Views[C]. New York: Association for Computing Machinery, 2018.

[9] CHEN D L, BALAKRISHNAN R, GROSSMAN T. Disambiguation Techniques for Freehand Object Manipulations in Virtual Reality[C]. Atlanta: IEEE, 2020.

[10] KANG H J, SHIN J H, PONTO K. A Comparative Analysis of 3D User Interaction: How to Move Virtual Objects in Mixed Reality[C]. Atlanta: IEEE, 2020: 275-284.

[11] SIBERT L E, JACOB R J K. Evaluation of Eye Gaze Interaction[C]. New York: Association for Computing Machinery, 2000.

[12] KYTÖ M, ENS B, PIUMSOMBOON T, et al. Pinpointing: Precise Head- and Eye-Based Target Selection for Augmented Reality[C]. New York: Association for Computing Machinery, 2018.

[13] WEISE M, ZENDER R, LUCKE U. How can I Grab That?: Solving Issues of Interaction in VR by Choosing Suitable Selection and Manipulation Techniques[J]. I-com, 2020, 19(2): 67-85.

[14] JORDAN W P, THOMAS B, MCCLELLAND L I, et al. Usability Evaluation In Industry[M]. Boca Raton: CRC Press, 1996.

[15] SAURO J, DUMAS J S. Comparison of Three One-Question, Post-Task Usability Questionnaires[C]. New York: Association for Computing Machinery, 2009.

[16] HART S G, STAVELAND L E. Development of NASA-TLX (Task Load Index): Results of Empirical and Theoretical Research[J]. Advances in Psychology, 1988, 52: 139-183.

[17] DAVIS F D, BAGOZZI R P, WARSHAW P R. User Acceptance of Computer Technology: A Comparison of Two Theoretical Models[J]. Management Science, 1989, 35(8): 982-1003.

Hand-Eye Collaborative Interaction Design of Virtual Object in Mixed Reality Sand Table

HU Yongab, HE Yu-zhenab, XIONG Meng-hanab, SHEN Xu-kunab

(a.School of New Media Art and Design, Beihang University b. State Key Laboratory of Virtual Reality Technology and Systems, Beihang University, Beijing 100191, China)

This paper studies the 3D interaction performance and user experience evaluation of the virtual 3D object in the mixed reality sand table, and puts forward interaction design principles and design suggestions. The interaction design is carried out for the "selection" task of virtual objects outside the touchable range of both hands in the mixed reality environment. The layout mode of virtual objects is creatively introduced as an evaluation variable. And under the three typical virtual object layouts, a comparative study on the performance and user experience of three interactive modes of hand-controlled light, head movement, eye movement and gesture coordination is carried out. Through the design of an experimental prototype system, user experience test, experimental data analysis and evaluation, we verify the principles of interactive design, and put forward interactive design suggestions. The experimental results show that the hand-eye collaborative interaction mode combined with gaze and pinch gesture has significant advantages in time, task load and user preference. The accuracy of point and pinch interaction is the best in all the three layouts. It is suggested that the design of "selection" task interaction in the mixed reality environment should pay attention to the principles of functionality, continuity and pleasure, and put forward some design suggestions to reduce the work load and fatigue of "selection" task interaction and adopt novel interaction to improve pleasure.

mixed reality; 3D interaction; interaction design; user experience design and evaluation

TB472

A

1001-3563(2022)06-0001-10

10.19554/j.cnki.1001-3563.2022.06.001

2022-02-20

国家重点研发计划资助(2019YFF0301305)

胡勇(1981—),男,博士,副教授,主要研究方向为VR/AR内容智能生成与交互设计。

沈旭昆(1965—),男,博士,教授,主要研究方向为数字媒体/虚拟现实研究与设计。