面向图像匹配的局部特征提取研究进展

2022-03-16刘向增徐雪灵刘如意宋建锋苗启广

刘向增,徐雪灵,刘如意,宋建锋,苗启广

(西安电子科技大学 计算机科学与技术学院,陕西 西安 710071)

0 引 言

随着智能系统与传感技术的发展,图像匹配技术已广泛应用于图像配准、多模式图像融合、变化监测、机器人视觉导航、目标跟踪、3D场景重建等领域。图像匹配精度易受数据获取环境(光照、天气)、平台姿态(视角、位置、运动状态)、传感器成像机理差异(红外、可见光、雷达)的影响(见图1),而实现图像精确、稳健匹配的关键与前提是效局部特征的提取与描述。所谓局部特征是图像中不同于其邻域的一种模式,该模式与图像的某种特性变化相关联,如灰度、颜色、纹理、结构等。局部特征的表征形式可为显著点、直线、边缘,亦可为局部区域块、深层处理(梯度统计、滤波、卷积)的特征向量描述,因而,图像局部特征可分为语义性特征和定位性特征两类:

图1 同一场景的多模态图像

(1)语义性特征:具备某种目标属性的局部特征,如遥感图像中的直线特征时常对应道路,边缘对应图像纹理的分界线,图像的区域块特征对应某种特定纹理植被、水域或建筑。

(2)定位性特征:不具备特定的目标属性含义,但其具备时空几何稳定性,常用于图像目标定位与特征追踪。

鉴于上述定义,语义性特征常用于目标检测与识别、图像检索、目标跟踪;定位性特征常用于图像匹配、配准与拼接、视觉导航、3D重建、SLAM等领域。图像匹配领域中数据获取的环境(天气、时间、状态)不同及传感器差异使得图像间存在较大的辐射变化及几何结构形变,导致一致性局部特征的提取与描述变得异常困难。

图像匹配应用中高效的局部特征应具有以下性质:

(1)可重复性:同一场景的两幅待匹配的图像中提取的局部特征应达到较高的重复率才能满足特征匹配的高精度对应需求。

(2)独特性与显著性:两幅待匹配图像中提取的局部特征应反映出图像中显著性的结构特征,且其位置与几何属性具备独特性以减少单幅图像中的自相关性,为提升特征的单应性匹配精度提供保障。

(3)几何与对比度不变性:局部特征应具备对比度及几何不变性,即两幅图像间发生辐射变化及获取视角变化时,不变性为局部特征的一致性提供保证。

(4)高效性:局部特征提取在具备上述性质的同时,尽量具有低复杂度运算,以保证实时任务中图像匹配的高时效性。

上述性质中可重复性与不变性是衡量高效局部特征的最重要的两个特性,是实现对比度变化与几何差异条件下稳健与精确图像匹配的根本保障。图像局部特征在匹配领域发挥了举足轻重的作用,原因在于它不但解决了前景与背景的辨识问题,而且可以对目标的任意部分进行定位与多尺度分析,同时在局部区域可将复杂的几何变化进行简化,实现快速有效的特征追踪。

局部特征的研究可以追溯至1954年Attneave提出的形状信息会集中至高曲率的控制点。该领域的研究已近70年,难以详细介绍所有的工作进展,文中主要针对常用的典型算法与模型进行归类与分析,主要从传统特征检测与描述设计、经典机器学习的特征定位与生成、现代深度局部特征学习等三个方面与读者进行分享,为相关研究人员提供比较全面的参考。

文中第一节主要介绍基于传统特征设计的局部特征提取方法与基本流程,为后续基于学习的模型设计提供基础;接着第二节展示了经典机器学习的特征定位与生成,为复杂环境下局部特征的自动检测与生成提供新思路;结合当前流行的深度学习,第三节对深度局部特征的学习模型进行的简介与分析;随后,第四节针对不同应用对当前流行的算法模型进行了概述;最后,第五节给出了结论。

1 传统局部特征

深度学习兴起之前,传统局部特征设计在图像匹配领域占据着至关重要的位置,甚至当今在某些特定环境下,传统局部特征的匹配效果依然优于深度学习方法。本节通过局部特征在图像匹配的应用,介绍传统局部特征的发展及典型成果,为理解后续基于学习方法的局部特征提取提供理论性基础。通常图像匹配的流程可分为特征检测、描述与匹配三部分,具体实现流程如图2所示,因此,本节分别从特征检测、特征描述两方面对传统局部特征设计进行回顾与总结,并对相关典型算法及其应用进行讨论。

图2 图像匹配中传统局部特征检测与描述

1.1 局部特征检测

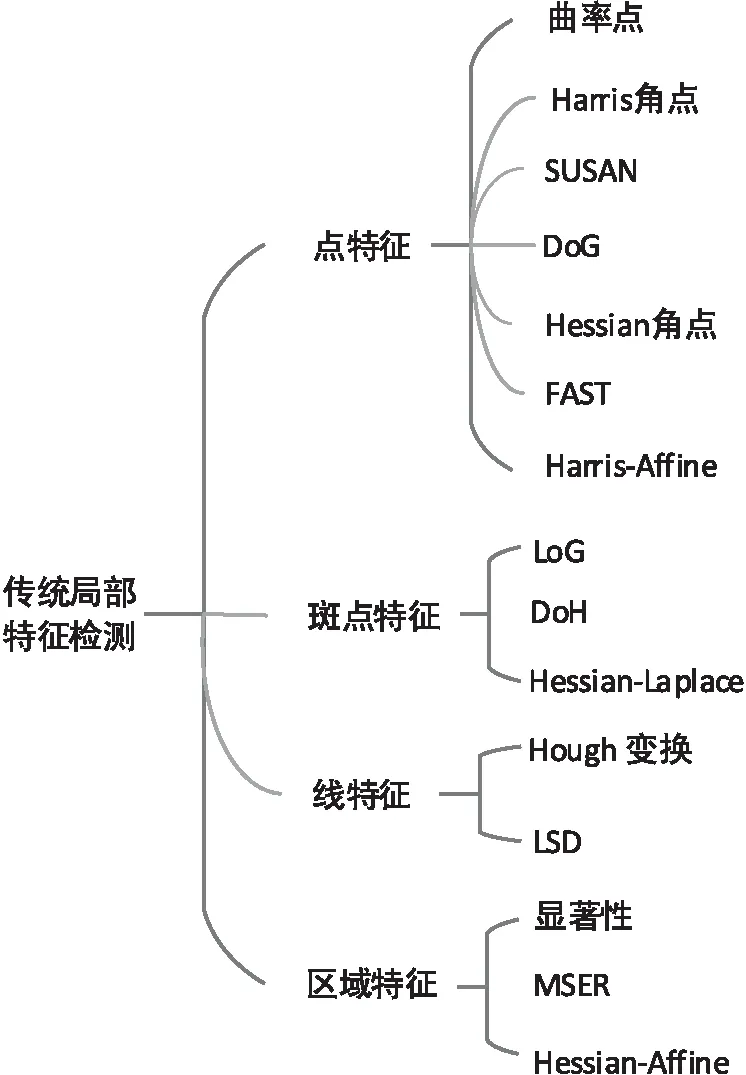

传统局部特征检测是通过手工特征检测方法设计,利用特定的计算准则直接从图像中将特征进行定位与提取的过程。此类特征主要包括点特征、块特征、区域特征、线特征,典型的代表性算法如图3所示。

图3 传统代表性局部特征检测方法

(1)作为最重要的局部特征,点特征是进行特征匹配的关键,是通过分析图像局部灰度的变化而提取的,可分为基于轮廓曲率、基于梯度变化、基于灰度分布三类。

轮廓曲率:目标轮廓的交叉点或结合点通常可反映信号的双向的变化,因此,利用轮廓曲率的极值可定位点特征。为精确定位曲率点的尺度信息,文献为应对尺度的变化提出了曲率图的尺度空间表示。Zhu等提出了非线性点特征检测方法,建立了特征点检测的一系列标准,克服了曲率近似及高斯滤波的问题。

梯度变化:为改进Moravec提出的基于块自相关的计算方法,Harris等提出了通过分析图像的局部二阶矩矩阵(自相关矩阵),构建窗口平移信息量变化函数对角点特征精确检测的经典方法,具体函数如下:

(1)

其中,I

,I

为I

(x

,y

)的偏导数。F

=det(M

)-α

·trace(M

)(2)

其中,det(M

)与trace(M

)分别为矩阵的行列式和迹,α

的取值范围为0.

04~0.

06。为减少噪声的影响,通常提前对图像进行高斯滤波。Harris算子具有旋转与对比度不变性(见图4),但缺乏尺度不变性。

图4 Harris角点检测示例

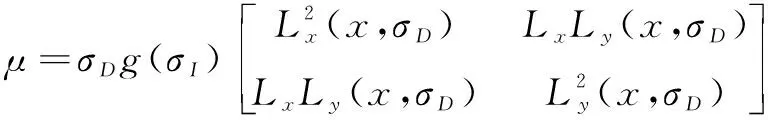

Mikolajczuk与Schmid将Harris算子融入高斯尺度空间实现特征检测的尺度不变性,二阶矩矩阵改为如下形式:

(3)

其中,L

为高斯平滑后微分图像,σ

为局部微分尺度,σ

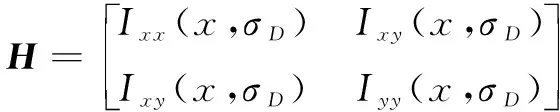

为积分尺度。文章进一步考虑了各向异性的高斯仿射尺度空间,实现了角点检测的仿射不变性。另外,Beaudet利用Hessian矩阵(式4)行列式的最大值定位点特征。

图5 DoG极值点检测

(4)

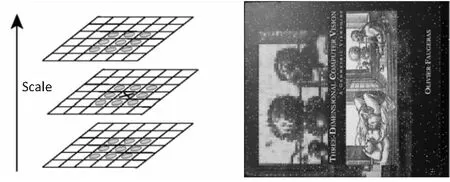

为实现点特征的多尺度检测并减轻计算复杂度,Lowe提出的SIFT算法中设计了DoG(高斯差分)算子:

D

(x

,y

,σ

)=L

(x

,y

,kσ

)-L

(x

,y

,σ

)(5)

L

(x

,y

,σ

)=G

(x

,y

,kσ

)*I

(x

,y

)(6)

通过搜寻DoG空间层与尺度层的极值点提取关键点,然后利用边界效应去除和重定位,实现点特征的亚像素定位。

灰度值分布:为满足点特征快速提取的要求,文献提出SUSAN(最小核值相似区)算子,通过计算圆域内与中心点灰度值相近的数量,若小于某一阈值,则该中心点被检测为特征点。近来,文献提出了FAST算子,通过统计固定半径圆域内灰度值大于或小于中心点的数量,若大于某一阈值,则将中心点作为特征点。

(2)作为点特征的补充,斑点特征可反映内容一致性局部区域,通常为具有边界的近似圆斑。常见方法有高斯拉普拉斯尺度极值:

(7)

Hessian矩阵(式4)行列式与迹同时极值法(DoH),为实现斑点特征的尺度不变性,文献[12]提出了Hessian-Laplace,效果如图6所示。

图6 LoG与Hessian-Laplace斑点检测

(3)可反映图像结构性信息的另一类重要特征为线特征,如Hough变换将图像中的直线检测问题转化为极坐标参数空间中通过某点最多正交曲线的问题。为提升直线检测的效率,Morel等提出了LSD,实现了图像中线特征的快速检测。

(4)区域特征是反映局部纹理或内容一致性区域的特征,较斑点特征的范围更广。常见的区域特征有显著性特征、最大稳定极值区域特征、仿射不变区域特征。Kadir等将显著性特征定义为局部复杂性或不可预见性,通过灰度概率分布信息熵的尺度空间极值确定特征的区域范围。作者进一步考虑尺度空间及椭圆区域形状参数实现了显著性区域的仿射不变性。Matas等通过比较区域边界内外的灰度值实现最大稳定极值区域特征(MSER)检测。为实现仿射不变区域特征提取,文献[12]提出了Hessian-Affine区域检测方法,将Hessian矩阵的特征值作为椭圆区域的参数进行稳定性估计,进而确定区域边界。

上述局部特征检测方法,鉴于对比度及几何变化的影响,点特征和区域特征应用比较广泛。为实现较好的匹配效果,通常将多种特征进行组合检测。

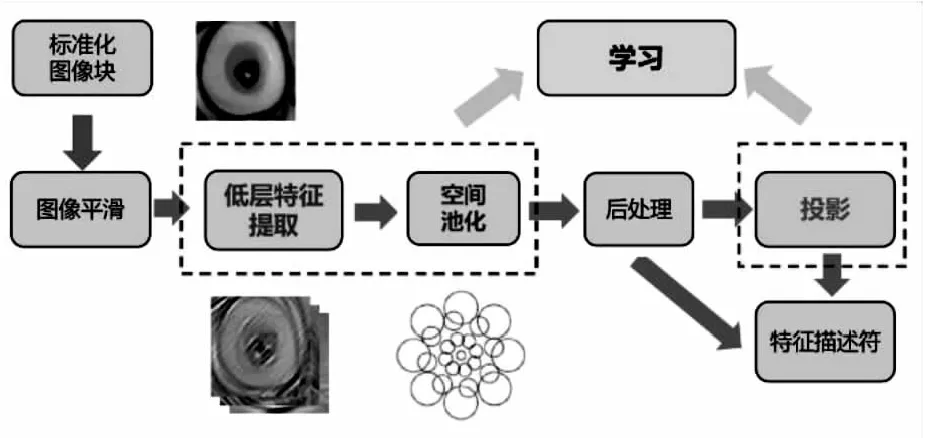

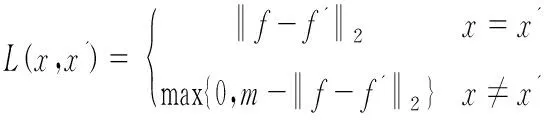

1.2 局部特征描述

局部特征提取后,实现复杂环境下特征间稳健匹配的关键是如何对局部特征进行精确描述。特征描述子是对图像局部特征的定量化数学描述,反映了其局部领域内的灰度、纹理或结构特性。理想的描述子应具备噪声、对比度、几何变化的不变性。特征描述方法主要分为梯度分布统计与局部二值化描述两类。

梯度分布统计描述:该方法通过某种规则统计特征点邻域的梯度分布,并生成描述向量。经典的方法如梯度方向直方图(HoG),对梯度的方向进行直方图统计:

图7 HoG:梯度直方图统计描述

(8)

θ

(x

,y

)=arctan(L

/L

)(9)

局部特征描述的里程碑工作采用梯度直方图统计的思想对特征点进行SIFT向量描述,实现同模态图像的稳定匹配。Bay等提出了SURF,利用Haar小波响应替代梯度并通过积分图像提升了描述子生成效率。Alcantarilla将SURF算法扩展至非线性尺度空间,提出KAZE进一步提升了描述子的匹配精度,随后将快速显式扩散嵌入到金字塔框架,实现了KAZE的加速计算。Abdel-Hakim等将颜色信息融入描述子,提出了CSIFT。Morel等通过生成不同视角的图像并提取ASIFT向量,实现了全仿射不变性匹配同时增加了算法复杂度。Arandjelovi′c等利用Hellinger核均方根替代欧氏距离,提出RootSIFT提升了特征匹配的效果。Dong等提出了DSP-SIFT,通过特征块尺寸与梯度方向的池化,提升了描述子的匹配性能。Hassner通过对特征点的多尺度SIFT子空间表示,提出SLS实现了良好的匹配效果。

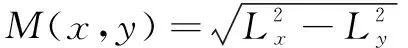

局部二值化描述:为满足移动与嵌入式设备的高效特征匹配及实时性任务(VSLAM)需求,研究人员提出了二值化特征描述(见表1),利用Hamming距离对描述子进行快速匹配。

表1 典型二值化描述子

Ojala等首次提出了局部二值模式(LBP),通过比较特征点与其邻域内像素的灰度值,若其值大则该位置为1,反之为0。为解决平坦区域描述子的不稳定问题,Heikkilä等将SIFT中的梯度信息更替为LBP,提出了CS-LBP。随后,Chen等通过改变编码的位数,提出了RLBP,并应用于纹理分类。Calonder等于2010年利用特征点邻域的随机分布构建BRIEF描述子,随后Rublee等通过FAST角点检测进行矩估计实现特征方向不变描述(ORB)。Leutenegger等设计了围绕特征点的四个同心环采样模式,提出了BRISK二值特征描述方法,通过尺度金字塔实现了尺度不变性。Alahi等模仿人眼对中央凹区具备高分辨,对周边低分辨的视觉感知的采样模式,提出了FREAK描述方法。受LIOP对灰度信息进行排序的启发,Choi等提出了灰度排序二值化特征描述(BIO),该方法有效缓解了灰度排序导致的误差。

传统局部特征描述主要对特征邻域内梯度或灰度分布进行简单统计,对同模式图像特征匹配效果良好,然而对于多模式图像及细节变化较大的图像依然效果欠佳甚至失效,因此,近来研究人员逐渐将学习的方法应用于局部特征的提取与描述。

2 经典学习型局部特征

基于经典学习方法的局部特征提取可归结为两类:一是通过对传统局部特征描述的自适应学习,将特征投影至学习出的低维空间,实现局部特征的自动检测与描述;二是通过监督学习,依据特征的可匹配性与重复性构建特征分类器实现特征自适应提取。本节从学习型特征检测与描述两方面进行介绍。

2.1 学习型局部特征检测

最初,文献[25,45-46]利用经典学习方法进行加速传统局部特征的检测。Hartmann等训练随机森林分类器对DoG检测的特征进行可匹配性预测,进而提升SFM中匹配的效率。为抵抗天气、季节、时间引起的光照变化影响,Verdie等提出了时不变学习检测器(TILDE),该方法将分段线性函数作为回归器获取的特征点在可靠性方面高于SIFT和SURF,然而该方法不具备度不变性。

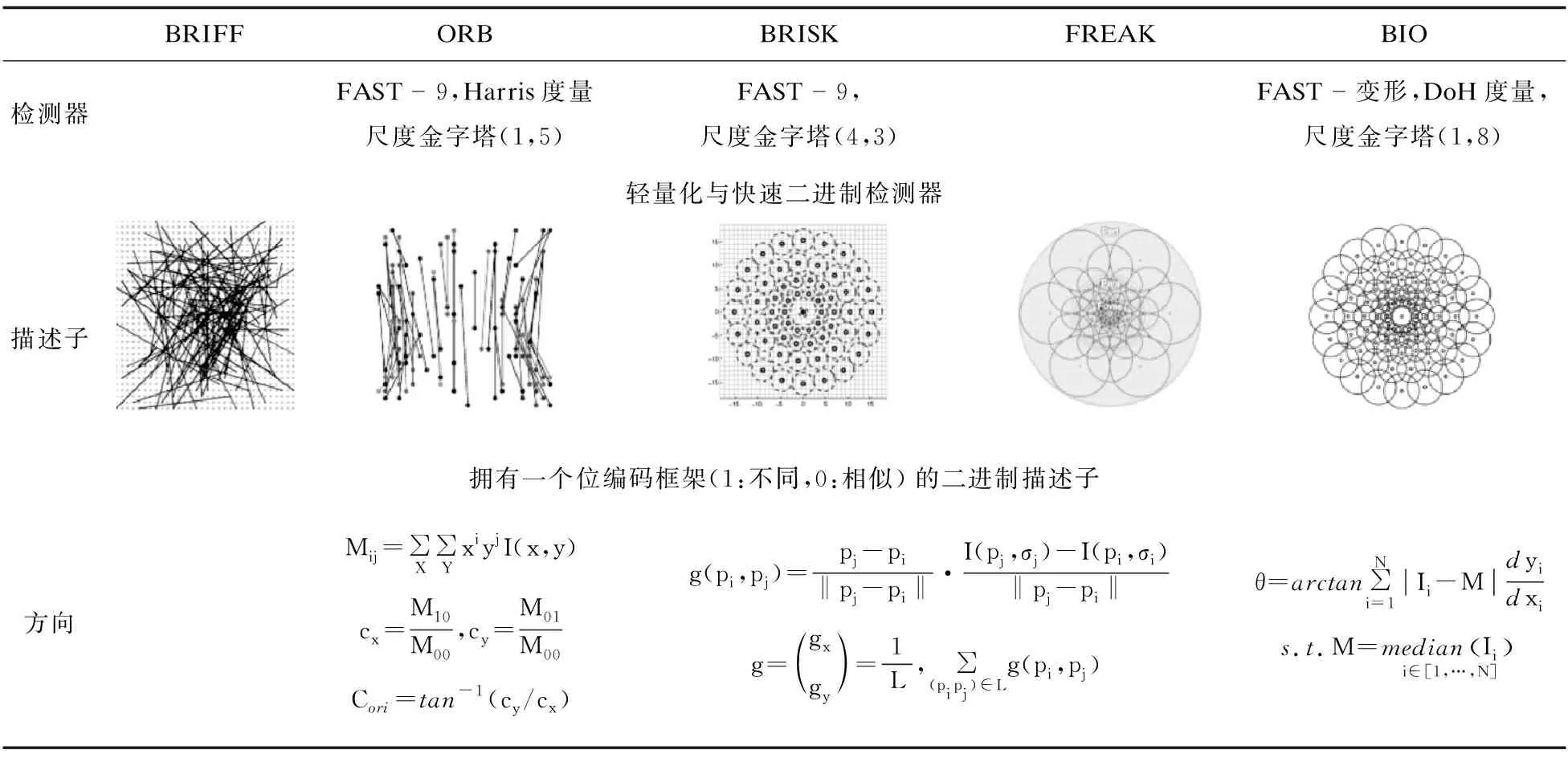

2.2 学习型局部特征描述

早期,Ke等利用主成分分析(PCA)将梯度图像投影至新的空间构建PCA-SIFT,实现了SIFT的降维处理,提升了匹配速度。随后,Lepetit等利用随机树、Babenko等通过boosting方法对匹配与非匹配特征进行表达学习。近来,Brown等利用可操纵滤波或梯度方向映射对传统局部特征进行空间池化,并通过线性或非线性变换对特征进行降维(见图8)。为应对由视角变化引起的仿射扭曲,Wang等将PCA应用于输入图像块的仿射变换集合,通过线性空间到点的映射获取特征的仿射子空间表达。对于较复杂的非刚体变换,Simo-Serra等基于扩散几何,利用热扩散原理对图像块构建非刚体扭曲与光照不变描述子DaLI,利用PCA对特征降维保证描述子的紧凑性。

图8 空间池化与特征嵌入优化的描述子学习

学习型二值化描述子的研究主要针对特定应用,如人脸识别、运动恢复结构(SFM)、3D重建,包括LDAHash,D-BRIEF,RI-LBD,BinBoost,RFD,BOLD等算法。Strecha等利用线性判别分析(LDA)最小化类内与类间距离比计算投影矩阵,然后对阈值化投影生成二值化描述子(LDAHash)。D-BRIEF则通过学习图像块与判别子空间的线性投影映射对图像块进行二值化。

图9 TcovDet特征点检测流程

近来,Duan等提出一种旋转不变二值化描述子的学习方法(RI-LBD),该方法先将图像块映射至旋转二值模式,再学习块的方向与二值化投影矩阵。受BRIFF的启发,Trzcinski等利用弱分类器对图像梯度进行池化,通过提升二值化哈希函数进行二值化描述子生成。Fan等提出了接受域描述子(RFD),依据区域的独特性或相关性进行的选取。Balntas等通过对图像块的轻微扰动自适应调节度量,进而生成二值化在线学习描述子(BOLD),其自适应性描述过程同样适用于其他二值化描述子。

基于经典学习的描述子利用学习的思想从特征匹配性、投影空间、几何扰动自适应等方面增加了传统局部特征提取与描述的灵活性,在一定程度上提升了匹配的效率。

3 深度学习型局部特征

经典机器学习型局部特征实现了传统局部特征的降维与自适应空间投影,然而其本质并非自动学习的抽象特征。深度学习的兴起使得非线性自适应局部特征学习成为可能,该方法利用多层级联非线性映射将输入图像直接进行特征提取,不依赖传统特征设计。本节从深度学习特征检测、深度学习特征描述、一体化特征检测与描述三方面进行介绍。

3.1 深度学习局部特征检测

与传统局部特征提取方法类似,Lenc等提出CovDet,通过学习图像块与变换之间的映射将特征检测转化为回归问题。利用最小化损失函数使映射函数满足协变性约束:

φ

(gx

)=gφ

(x

),x

∈X

,g

∈G

(10)

函数φ

是由卷积神经网络(CNN)学习而得,最终给出三种特征检测器,前两种具备平移不变性,第三种具备旋转不变性。作者将三种检测器应用于整幅图像将置信度超过某一阈值时作为特征点输出。作为CovDet的拓展,TcovDet(见图10)则将函数φ

作为变换预测网络进行学习,将变换推广为仿射变换,实现了良好的特征检测。Savinov等将特征检测转化为函数响应的学习问题,通过建立图像块与实数之间的映射并对其进行排序提取特征点。随后,Mishkin等首次利用深度学习模型进行仿射协变区域检测,考虑可匹配性与几何精确性的平衡设计硬负常量损失函数:

图10 Superpoint特征检测与描述自监督学习流程

(11)

(12)

该模型提取的仿射区域在图像检索方面获得了良好的匹配效果。Laguna等提出浅层多尺度架构融合传统与学习的CNN滤波,通过传统对特征进行定位、排序,利用CNN滤波实现多尺度特征检测。

3.2 深度学习局部特征描述

特征检测之后如何对其进行稳健的描述是后续特征匹配的关键。本节主要讨论基于深度学习模型的特征描述,从深度特征描述、度量学习、损失函数设计三个方面进行介绍。

深度特征描述:AlexNet在ImageNet的性能提升掀开了深度学习在视觉邻域研究的热潮,因此,早期研究人员直接将AlexNet提取的特征图作为图像描述子应用于图像匹配。Fischer等最早将AlexNet的中间响应层作为特征,以MSER区域为描述范围构建描述子学习模型PhilippNet并应用于3D特征点之间的匹配。随后,Paulin直接以AlexNet为深度特征提取模型,构建块卷积核网络(patch-CKN)进行快速的块特征描述。上述文献均以欧氏距离度量深度特征描述子的相似性,为应对图像间的复杂变化,研究人员对相似性度量进行了深入研究。

度量学习:2015年Han等将描述子与度量进行联合学习提出了MatchNet模型(见表2),该模型通过多层CNN与空间池化进行描述子计算,利用三层全卷积层进行度量学习,结合交叉熵损失将匹配问题转化为分类问题。Zagoruyko等提出了Deepcompare,设计了孪生、伪孪生、双通道、空间池化孪生、双流多分辨等多种网络,并对其进行了比较,最终给出双通道网络性能最优。

表2 基于孪生神经网络局部特征学习模型

损失函数设计:为比较图像块之间的相似性,大多文献通过计算CNN描述子之间的距离进行判断,然而CNN特征由于不同的损失函数定义存在差异。本节主要从逐段损失、三元组损失、全局损失等进行讨论。Jahrer等首次将逐段损失应用于描述子的学习,Simo-Serra等提出DeepDesc挖掘最难的正负样本提升网络的性能。Choy等针对几何对应提出了通用对应网络(UCN),利用卷积空间变换实现精确的几何对应,模型中采用的一致性对比损失如下:

(13)

其中,m

为超参数。Balntas等提出利用三元组损失训练描述子匹配模型PN-Net(见图11),其中P

,N

分别表示正负样本。Mishchu等提出HardNet,该模型通过简单的三元组损失最大化正样本与负样本之间的距离:

(15)

TGLoss等将三元组损失替换为全局损失,在保证匹配块距离与非匹配块距离分布方差之和较小的情况下最大化匹配块距离与非匹配块距离分布均值之和。L2-Net设计的全局损失考虑了三个方面:最小化匹配描述子之间的距离、最小化描述子内部的相关性、最大化描述子中间特征图的相似性。

3.3 一体化特征检测与描述

近来,端到端一体化特征检测与描述模型成为局部特征学习的研究热点。Yi等首次提出了端到端特征检测与描述模型LIFT,该模型由三部分组成:检测器、方向估计器、描述子生成器,并由两个空间变换相关联。第一个空间变换实现检测器提取图像块由大及小的剪切;第二个空间变换根据方向估计器对剪切后的图像进行旋转,其中检测器采用TILDE,描述子则采用DeepDesc进行计算。

深度局部特征(DELF)利用ResNet50提取深度特征,基于视觉注意进行特征点筛选,最后通过PCA实现描述子的降维,成功应用于大规模的图像检索。DeTone针对多视角问题提出了特征点检测与描述自监督训练模型SuperPoint,对于输入图像可由单通道同时实现特征点定位与描述(见图10)。首先利用合成数据训练特征检测器,然后通过单应性自适应生成伪特征点,进而训练SuperPoint网络,其中特征点检测采用交叉熵损失,特征点描述采用合页损失。

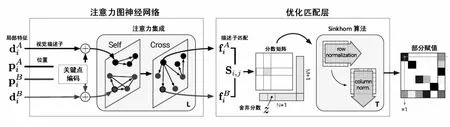

Dusmanu等用一个CNN实现特征检测与描述双重角色(D2-Net),其流程如图11所示,(i

,j

)处的描述子由多层特征图组成,特征点检测通过层内与层间软件测分值的非极大值抑制获得,网络训练的损失函数采用特征检测与描述联合的三元组损失。Luo等同时考虑视觉表征与特征之间的几何关系提出了ContextDesc,该模型通过几何上下文编码器将特征点的几何关系进行编码,利用视觉上下文编码器对局部特征及区域特征进行编码,最终构建出128维描述子。Sarlin提出了基于注意力的上下文聚合机制SuperGlue(见图12),首先通过关键点编码器将特征点位置及其描述子映射为同一个向量,然后通过自注意和交叉注意层进一步转化为更为稳健的表征,最后经过优化匹配给出分数矩阵并由Sinkhorn算法得到特征匹配关系。该模型利用SuperPoint+SuperGlue实现了室内与室外数据的良好匹配效果,其性能超越了D2-Net与ContextDesc。随后,Sun等基于SuperGlue提出了由粗到细的匹配策略,通过Transformer中的自注意与交叉注意层进行特征变换(LoFTR),再由置信矩阵得到初步对应关系;细匹配阶段再利用LoFTR进行特征变换,最后由相关系数矩阵给出匹配关系。

图11 D2-Net检测与描述流程

图12 SuperGlue实现架构图

上述基于深度学习的局部特征提取与描述方法,通过不同的模型构建、损失函数设计、匹配策略研究实现了较为灵活的特征提取与描述,部分模型的性能已经超越传统局部特征,为不同应用需求提供了诸多选择。

4 局部特征性能分析与比较

本节主要讨论传统局部特征、深度学习局部特征的性能比较,为不同应用提供思路。

4.1 传统局部特征比较

早期,Heinly等对多种传统特征检测与描述方法(Harris,MSER,FAST,BRIEF,ORB,BRISK,SURF,SIFT)在牛津数据集(模糊、光照、视角等变化)上从回忆率、重复率、正确匹配率等方面进行了分析与比较。当图像间不存在几何变化时,BRIEF的性能优于ORB,BRISK,SIFT;当图像间存在旋转变化时,ORB的性能优于BRIEF和BRISK;当图像间存在复杂的几何变化时,SIFT的表现最优。

Mishkin等提出了范围更广的宽基线立体匹配数据集,包含几何、光照、传感器、外观、多模态等变化,通过对多种检测器及描述子进行测试,实验结果表明Hessian-affine具备最优的检测性能,SIFT及其改进DAISY具有最佳的描述子表现。Sun等提出了基于图像定位评价的购物中心场景数据集,对BRIEF,SURF,SIFT,COV,RootSIFT等局部特征提取方法进行了比较,通过COV检测与RootSIFT描述获得了最佳性能。

4.2 深度学习局部特征比较

近来,随着深度学习在局部特征提取的应用,研究人员对学习方法与传统方法进行了应用性能的比较,如文献[56,81-82]。

Zhang等将传统特征检测方法与FAST、TILDE、CovDet、TCovDet在多种数据集上进行了分析比较,结果表明TCovDet在特征重复率方面优于CovDet和TILDE,这两种方法均优于SIFT,SURF,MSER,Harris Laplace,Hessian affine,FAST等检测器。在匹配性能方面,TCovDet与SIFT分别在不同的数据集上获得了最佳表现。为解决在不同的数据集上对多种检测与描述方法的不一致问题,Balntas等提出了新的基准数据集HPatches,该数据集包含大量适合描述子训练与测试的新数据,并清晰定义了在匹配、检索、分类等方面的评价协议。作者对SIFT、RSIFT (RootSIFT)、BRIEF、ORB、BBoost、Deep-Compare(DC)、DeepDesc、TFeat、L2-Net、HardNet(HNet)等进行了全面评价(见图13),结果表明L2-Net与HNet在不同任务上获得了最优的性能表现,TFeat在块证实与匹配方面优于传统局部特征检测与描述方法。此外,Lenc等基于HPatches数据集专门针对特征检测方法进行了评价,提出了改进的特征检测重复率计算方法(见图14),在5类数据集上对11种检测方法进行测试,统计结果显示TILDE有较高的特征检测重复率,然而在视角变化情况下Hessian affine的重复率达到最高,某些情况下TCovDet的特征重复率依然最优。

图13 Hpatches数据集上不同方法在证实、匹配、检索等任务的精度比较

图14 Hpatches数据集上不同特征检测方法的重复率比较

文献[88]对最新的基于深度学习的一体化特征检测与描述方法(D2Net,R2D2,DISK,Sparse-NCNet,DRCNet,LoFTR)进行了分析与比较,结果表明LoFTR在单应矩阵估计及姿态估计的性能最优。

4.3 局部特征提取方法应用建议

通过前两节的比较与分析,对比较具体的应用给出如下建议:

(1)一般情况下传统局部特征提取方法较基于学习的方法计算复杂度低,简单场景下特征检测可采用Harris、FAST、DoG等检测器,特征描述可采用SURF、BRIFF、ORB等描述子;

(2)含有较大对比度、几何变换建议采用SIFT、Hessian affine等传统局部特征提取方法,亦可采用TILDE、TCovDet、SuperPoint等特征检测方法;

(3)复杂场景下的局部特征描述与匹配建议采用RootSIFT、L2-Net、D2Net、ContextDesc、SuperGlue、LoFTR等方法。

在较复杂的情况下(不同模态、不同时相、不同视角等),也可将多种方法组合使用。

5 结束语

该文针对图像匹配的应用对局部特征的研究进展进行了总结与分析,主要从传统局部特征设计、经典机器学习局部特征提取模型构建、深度学习局部特征挖掘等三个方面对局部特征的检测与描述展开介绍与讨论,分析了典型代表算法的基本原理及优势,通过多篇文献的比较结果对具体的应用给出了相应的建议。目前,局部特征提取仍存在诸多挑战,如多模态、多时相导致的局部特征不一致;多视角造成的几何变换过大,局部特征不稳定。因此,如何利用深度学习领域最新研究成果,构建跨模态、多时相、宽动态条件下稳健的局部特征提取模型,实现图像匹配、视觉导航、SLAM等领域的更广范围的应用是今后研究的主要方向。