数据合规科技的风险规制及法理构建

2022-03-03唐林垚

内容摘要:个人信息滥用屡禁不止,引发数据安全“立法热”,但强监管令可合法使用的有效数字资源尤为稀缺。数据要素化国策下,隐私计算技术、SaaS平台等数据合规科技有望通过结果输出、模型训练、代码编写的“去中心化”实现非信任主体间数据价值的合规有序释放,但也必然导致传统人工智能风险的泛化和异化。由于数据处理模式被深度重构,散见于各层级法律的信任维系、目标纠偏、损害救济、权利保障和隐名消除等机制均不同程度失灵。为平衡各方法益,可藉由宏观政策、社群规范、技术构架、各方博弈的有机联动,打造以变应变的动态规制体系。其基本原则是,努力消除复杂数据处理局面的风险“盲维”,兼顾数据价值挖掘的效用需求,确保数据合规科技安全合规。

关键词:数据合规科技 隐私计算 低代码 个人信息保护 安全合规 人工智能

中图分类号:DF0 文献标识码:A 文章编号:1674-4039-(2022)01-0079-93

一、问题的提出

数据乃新型生产要素,已为全球共识。助推传统产业转型升级、打造新产业新业态新模式、壮大经济发展引擎,皆以充分发挥数据要素对其他要素的倍增作用为先决条件。根据《国民经济和社会发展第十四个五年规划和2035年远景目标纲要》,“统筹数据开发利用”“强化算力智能调度”“推进数据跨部门、跨层级、跨地区汇聚融合”,成为我国数字化转型格局下数据驱动生产、生活和治理方式变革的顶层设计。近几年来,数据作为企业和公共部门重要资产被深度开发利用,随之而来的是大规模数据泄露事件频频发生,隐私保护相关法律接连颁布。国家层面一体推行的民法典、电子商务法、网络安全法、数据安全法、个人信息保护法等,回应了数字产业发展和社会公共诉求,体现出全球共识和本土经验的融合。在激发要素潜能和隐私保护的双重驱动下,数据合规科技的概念炙手可热。

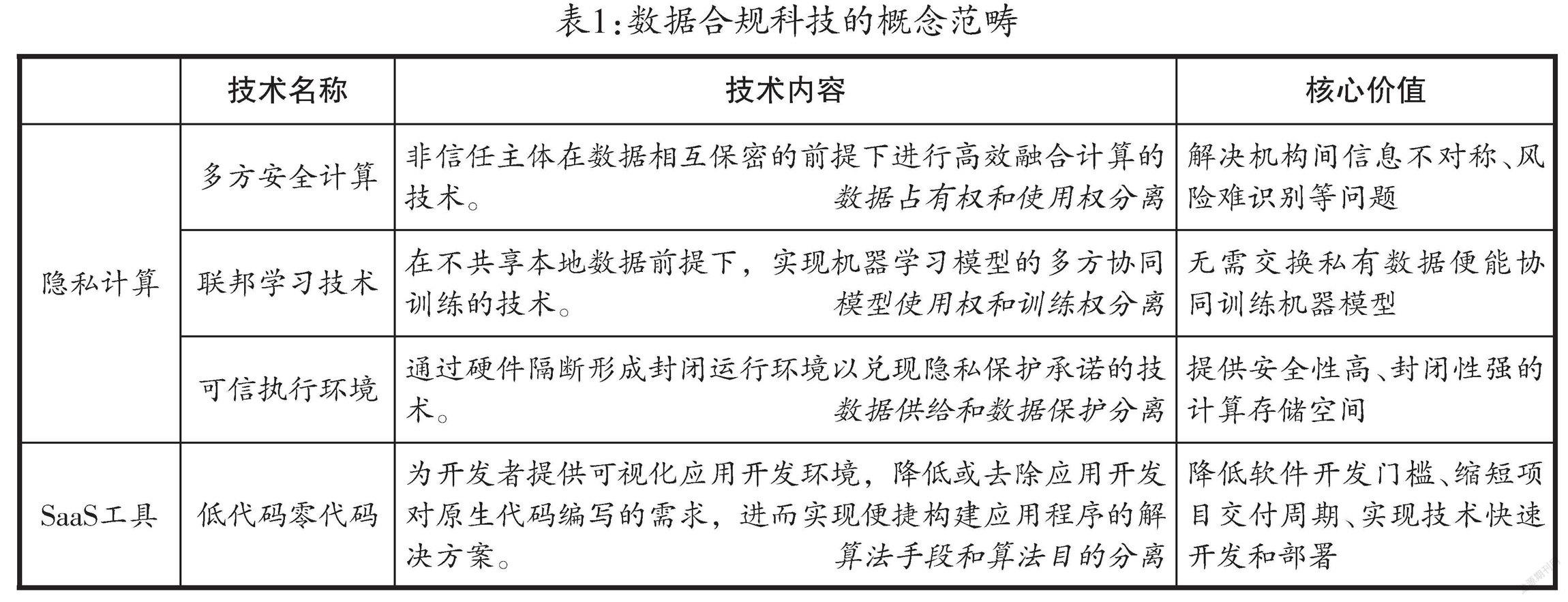

学界和实务界以数据合规科技的总称统摄一切在提供隐私保护前提下实现数据价值挖掘的应用手段,包括但不限于以多方安全计算、联邦学习、可信执行环境为代表的隐私计算技术以及以低代码、零代码为核心的“软件即服务”(SaaS)平台等。〔1 〕各项主流技术的内容和价值,如表1所示。

“新一代人工智能是靠数据和知识‘双轮驱动’的,数据越多才能越智能。” 〔2 〕作为人工智能时代具有泛在普适性的底层技术,数据合规科技在打通应用通道、破除行业壁垒、化解信息孤岛方面有得天独厚的优势,必将成为强监管趋势下数据共享基础设施的重要组成部分。例如,对于金融机构内部的黑灰名单不能明文共享的困境,多方安全计算能以名单“可用不可见”的方式输出涉及个体的联合计算结果,提高整个金融行业风险的联防联控能力。再如,鉴于医疗数据的敏感性,智慧医疗服务商很难同时掌握样本足够、特征完整、能够全面反映患者症状的数据;联邦学习为此类问题提供了解决方案,无需交换各个机构的私有数据,便能协同各方参与诊疗模型的训练。

虽有广阔应用前景,但数据合规科技同样具备颠覆性重构算法应用流程的潜力,其风险也不可小觑。就如“自反性现代化”的经典命题所揭示出的那般,用以消弭风险的技术手段有时“恰恰是风险生产的诱因”。〔3 〕持续性、大规模、跨行业的敏感数据互通,与个人信息保护之间已然产生张力;去中心化的“离散”“非均衡”式创新,使得既有法律规则难以对其有效涵盖。在資本逐利天性的诱导下,原本技术彰显法律意义上的实质合规极有可能合乎情理地演化为“将计就计的合规”“表里不一的合规”以及“以假乱真的合规”。由于披上了“合规”面纱,数据主体在数据合规科技的潜在风险面前可谓毫不设防。因此,如何用新方法、新手段回应数据合规科技带来的新问题、新挑战,无疑是当前法学界必须思考的重要命题。

二、数据合规科技的风险辨识及规制需求

数据合规科技的理念源于欧美立法者广泛推崇的“通过设计保护隐私”,即在设计之初就将数据安全的需求嵌于其中,成为技术运作的缺省规则,而不是出现问题之后,才将法律规则赋于其上。〔4 〕我国科技部“伦理先行、敏捷治理”的倡议 〔5 〕同“通过设计保护隐私”有异曲同工之妙,体现出积极预防而非被动救济、正和共赢而非零和博弈的全周期数字正义价值观。遗憾的是,当前数据合规科技的各项技术面临通信开销大、性能效率低、传输复杂度高、与主流技术体系磨合不佳等瓶颈,技术应用的前端、中端和后端均可能引致不同程度的系统性风险。厘清风险嵌入数据合规科技的技术途径,是明确规制需求的基本前提。

(一)方案构建维度的风险

方案构建是数据合规科技应用的起点,目的在于将抽象的数据处理需求,比照着监管规则的技术约束转化为程序和代码可以处理的计算问题。例如,欧盟通用数据保护条例(以下简称GDPR)对跟踪广告提出了更高的隐私保护需求,数据处理者想要在不降低广告跟踪性能的前提下安全、合法地调取用户数据,就需通过安全多方计算的技术范式对原有的数据处理过程予以重构。数据合规科技的方案由主导方提出,主导方以技术的受益权为对价换取多个参与方的数据集和算力投入,各方在意思表示一致后开始合作。在数据合规科技场景中,解决特定问题的数理过程依然经由算法实现。弱人工智能阶段,算法逻辑直接映射自然人逻辑,开发者的价值观负载和内隐性偏见将导致自动化决策系统失误。数据合规科技为算法自动化决策施加了诸多限制性条件,使得主导方在代码编写和技术开发过程中不得不心怀更多顾虑,转译过程的精确性更加无法保证。

具体而言,安全多方计算通常以降低数据清洗成本为起点,技术方有时会摒弃清洗成本较高的非结构化数据,采用生成对抗网络(GAN)产生的模拟数据。联邦学习中参与“集训”的初始模型必须具备相当程度的适应性品格,才能在多个数据源间往返流转,这种适应性品格使得初始模型通常承载着多功能乃至多目的因而丧失本应具备的专用性和专属性。可信执行环境的硬件封闭和低代码平台算法间的相互嵌套带来了衔接和协作方面的问题,让转译过程中的偏差和耗散更为严重,毕竟,“中间步骤越多,就越不能终局地定义概念”。〔6 〕数据合规科技虽向外拓展了自动化决策的维度,但随之而来的代价是,方案制定者的内心成见将被技术显化,代码意涵与真实意涵相去甚远。规制的需求,因风险的存在而存在,如何降低转译偏差,加固技术性较高的监管薄弱环节,提升底层代码表意的准确性,是数据合规科技规制需要考虑的第一层问题。

(二)数据整合维度的风险

数据是风险嵌入数据合规科技的另一条重要途径。数据匮乏将导致机器学习模型过拟合现象。借用权重衰减实现岭回归的正则化策略,虽能有效提高模型泛化性能、防止过拟合,但由于权重向量在梯度更新之前先行收缩,该举措经常会导致模型规则的修改。数据合规科技的重要价值之一,在于显著拓宽了模型的数据来源渠道,但有时数据渠道本身也是风险的根源:首先,互联网等外部渠道数据的来源合法性难以甄别;其次,共享模式下数据流转更加复杂和难以控制,数据使用边界无法限定;再次,各方数据问题可能相互传染,激发数据安全的连带风险。机器学习模型遵循算法逻辑,从大数据的具体样例中“温故而知新”出足以指导实践的普遍规则。多方安全计算利用更大的数据池形成规则集、联邦学习借用大数据增量完成自我迭代、低代码平台使用旧数据训练的模型解决新问题等过程,实质上是提取数据增量中隐藏秩序、规则和倾向,并将其用于未来发展的感知与决策的过程,不会背离过往数据所体现出的关系特征。〔7 〕

本来,大数据的“多渠道和合”有望修正数据采集的天然瑕疵。最理想的情况是,因样本分布过于离散导致代表性不足的数据暗点、因样本过于集中导致代表性过剩的数据亮斑、因遗漏误录导致样本缺失的数据盲区,都能因为不同源头数据集之间的取长补短而完全消失,抹平单一数据集的结构性差异。例如,通过联邦学习技术,仅能较好识别标准普通话的语音识别软件可能因方言数据集参与模型训练而减少识别错误;倾向于对流动人口作出高危警示的犯罪预测系统,或随全国违法数据的加权平均,矫正对外地人的偏见。但是,数据合规科技经常在相互渗透的行业间进行,各技术数据源的选择标准有时过于僵化,为合规而采取的安全保护手段也因成本限制而日渐趋同,数据合规科技的数据聚合过程可能反而会放大数据集的原本缺陷,导致暗点更暗、亮斑更亮、盲区更盲。简言之,数据合规科技虽然大幅增加了可供机器学习模型深度挖掘的大数据体量,但如果增加的大数据异质化程度较低,数据量和模型性能之间仍然不呈线性关系,在过拟合问题之外,还可能由于噪声侵入进一步降低系统效率。如何将数据资源的非均衡性考虑在内,建立科学的数据筛选和容忍机制,是数据合规科技规制需要考虑的第二层问题。

(三)技术适用维度的风险

数据合规科技固有的“白盒特性”,导致了技术适用维度的人机对抗风险。所谓“白盒特性”,是指数据合规科技中的各参与方都可以直接获取完整的技术参数,恶意攻击者同样可以利用该特性伪装成诚实参与方窃取运算结果、扭曲模型训练、破解可信环境或生成恶意低代码。数据合规科技的安全研究,大多都建立在同一个假设之上,即除了主导方、中央服务器是中立可信的,其他所有终端和参与方均不能排除尝试获取用户隐私和对抗系统的可能,即使他们严格按照协议方案执行程序。〔8 〕正因为如此,一般依据危害性从低到高将数据合规科技的参与方划分为三种类型:诚实但好奇的、暗自觊觎的、纯粹恶意的。此种划分方式表明,随着利益需求的不断变化,各参与方的角色也可能发生改变。当隐私泄露时,“没有一片雪花是无辜的”。

数据合规科技长期面临单点故障和人为攻击的安全隐患,其威胁主要来自三个方面。其一,刻意上传破坏模型。出于安全考慮,中央服务器没有访问各参与方本地数据的权限,因此,即使是诚实但好奇的参与方也可能因为上传不正确的数据或模型导致运算结果误差或全局模型损坏。在实践中,不可信服务器的恶意投毒、样本对抗和后门攻击往往更加致命,也更为常见。其二,回推手段获取信息。好事者无需采用任何非法手段,通过比较数次单独运算结果同多方计算结果的差异、分析本地模型更新与全局模型的迭代、窥视加密解密的双向过程等,就足以从中获取相当丰富的推论信息。〔9 〕其三,恶意服务器围猎用户隐私。纯粹恶意的敌方可能直接对用户数据集、训练模型参数、模型预测标签以及模型返回结果下手,通过对抗式网络攻击、成员推理攻击、属性物理攻击和模型反演攻击等方式获取用户隐私数据。

更严重的是,防御体系的升级速度,赶不上数据量的指数级增长。〔10 〕即便有所防范,训练集中只要包含3%的中毒数据,模型误差将从12%上升至23%。〔11 〕通过隐写术反汇编,恶意参与方可以将病毒和流氓软件悄无声息地传输至目标设备中,攻击成功的概率在九成以上。〔12 〕对于司空见惯的32位浮点数、权值较低的机器学习框架(例如PyTorch、TensorFlow等),恶意负载行为既不会显著影响原始模型性能,也不会对神经网络的全局判断造成影响,可以规避杀毒引擎的安全扫描。〔13 〕如何引导各参与方怀抱诚实和善意,在“你中有我,我中有你”的交互中做到“人人为我,我为人人”,是数据合规科技规制需要考虑的第三层问题。

(四)结果输出维度的风险

“个人信息不仅关涉个人利益,而且关涉他人和整个社会利益,具有公共性和社会性。” 〔14 〕模型不精确、数据瑕疵放大、用户隐私泄露等问题,可能导致普遍存在的算法歧视从个体歧视上升至群体歧视。算法歧视主要源于数据集偏差或数据缺陷,在数据合规科技场景中,不同来源数据间的强搭和错配可能对联合数据造成冲击与扰乱,使歧视规模性放大。除了数据投毒等极端手段,诚实但好奇参与方的数据输入因数据梯度同其他参与方相差过大,也可能间接导致模型被污染,输出歧视性结果。

单次歧视的即时危害虽不易被察觉,却足以在更长时间维度和更长数据链条上产生积累式影响,联邦学习全局模型的不断轮回就将导致群体歧视泛滥。例如,一线城市的银行对高净值客户的划分标准显著高于二、三线城市,若不加区分地将银行数据整合并通过联邦学习训练客户画像模型,加权得出的高净值客户划分标准定然对二、三线城市客户产生歧视。同理,当不同学校的毕业生数据被用于训练招聘筛选系统、当男性占绝对多数的IT行业数据和其他行业数据被共同用于训练升职评价系统时,同身份紧密捆绑的群体歧视将假模型共训之名,从数据向模型蔓延。如何对“因时间、空间等联结形成的特定对象的个人信息加强精准保护”, 〔15 〕减少歧视的发生,是数据合规科技规制需要考虑的第四层问题。

(五)应用市场维度的风险

机器学习模型映鉴社会运营的多元要素及其复杂互动,透过算法将连贯重叠的个体生活分割成彼此独立的静态片段。在数据合规科技大规模部署前,面对相似或相异的受众,不拘一格的智能应用被限制在各自为政的领域,彼此之间没有交流与协作,更多地是算法间的“朝上竞争”——效率高、服务好、安全稳定的智能应用将获得更高市场份额,兴风作浪、过度榨取用户剩余的智能应用将面临被淘汰或整改的命运。数据合规科技可能逐渐导致算法趋同,在技术黑箱的掩护之下,过去算法间的朝上竞争极有可能向逐底竞争转变。对数据规整性要求不高、通信成本更低、算法可解释性匮乏的智能应用,或将随着数据合规科技的跑马圈地,逆向淘汰相对保守的传统智能应用。如何避免智能应用的“逆向淘汰”,是数据合规科技规制需要考虑的第五层问题。

上述五个维度的风险并非技术变革的产物,而是前沿科技打破传统算法应用数据处理惯例的必然结果。易言之,虽然打着合规的旗号,数据合规科技所遵循的内在机理耦合了风险产生的技术规律。〔16 〕应对风险的本土化策略,是紧密结合我国实情,向前检视当前数据安全法律体系的制度余量,向后探索符合数据合规科技发展规律的规制路径。

三、应对风险的法律制度余量及规制局限

多维度的风险呼吁多层级的规制手段。数据合规科技的规则完善,已在世界范围内徐徐展开,呈现出软法硬法交织、两者相互推动的特点。梳理发现,虽然早已有“数据创新生态”“数据资源开放”等提法,但数据合规科技成为世界各国竞相追逐的技术高地,始于欧盟法院在Scherems II案中判决欧盟—美国隐私保护盾无效, 〔17 〕两大经济体数据互传曾一度陷入瘫痪。为了缓解局势,欧洲数据保护委员会将数据合规科技背书为跨国数据处理活动的合规依据,英国数据伦理与创新中心推崇隐私计算为值得信赖的数据利用方式,针对数据合规科技的法案和标准不断颁布,对核心技术的理解日益加深。不过,就规制而言,徒法不足以自行,各国立法尚停留在“政策促进”“应用指引”“技术标准”和“部门立法”层面,未能串联成应对数据合规科技的动态规范。在“摸着石头过河”初期,有必要深入检视以分块式立法样态散见于不同层级法律中既有规范的局限性;只有先行廓清现有制度和工具的“能与不能”,再行探讨如何将数据合规科技纳入体系化动态规范的法治轨道,才谓有的放矢。

(一)信任维系机制的局限

信任维系,是一切数据处理活动得以持续进行的基石。人工智能法律中最常见的信任维系机制,是算法可解释性的合规要求,被视为“对抗数据个体的主体性、自治性沦陷和丧失的内在之善”。〔18 〕数据合规科技的技术样态,如数据链条的拉长、机器模型的共建、硬件环境的闭合、代码模块的借调,必然将加剧算法可解释性难题,使信任维系机制失效。

数据合规科技的各项技术构成了一系列法益依附的黑箱,由于受商业秘密的保护,监管者难以强制技术方公开披露技术细节。例如,公共管理部门数据合规科技的使用关涉公共安全,将内部细节置于公众审视之下容易遭受舆论非难,且必然削弱系统抵御恶意攻击的能力,这显然是技术善治的不可承受之重。各项技术环环相扣的符码规则进一步加大了技术可解释性的难度:分布式学习的模型构建、抵抗恶意攻击的加密方法以及半封闭的硬件环境均以减少不透明度作为其隐私保护屏障。〔19 〕事实上,在多方安全计算中,与其说参与方对模型公允性笃定不移,毋宁说是出于对人多势众的迷信;联邦学习各参与方可能对本地数据如何教化公共模型尚且难以做到了如指掌,遑论能够准确把握其他各方对公共模型的启发和改进。在使用SaaS平台时,无代码的创建者按照自己对模块的理解去搭建能够迅速上手的功能系统,之所以选择无代码正是因为其根本不具备理解和编译底层代码的能力和知识储备。由此可见,算法可解释性的式微本就是数据合规科技保障数据安全的一种手段。因此,信任维系层面的法律制度有必要根据技术样态予以重塑。

(二)目标纠偏机制的局限

信任维系机制的局限也导致了目标纠偏机制的局限。连接信任维系机制和目标纠偏机制的法律范式是知情同意框架,数据主体因知情而同意或不同意,共同勾勒出数据处理目标的能动性边界。数据主体的“同意”,是对个人数据权益的处分,这种处分不能脱离商品或服务合同的语境单独存在。意思表示居于合同法律关系的核心,合同当事人作出有效意思表示的前提,是对订立合同时相关重要事项的知悉及表意自由。然而,在数据处理活动中,用户同意的知情前提常因各种原因被削弱。例如,用户协议可能篇幅过长,即便语言平实易懂,用户也不可能潜心阅读完毕。再如,用户选择同意与否的窗口期过于短暂,经常在几秒之内就必须点击同意以便进入实质性的主合同履行阶段。由于相当多的意外情况在日后的数据处理活动中才可能发生,数据主体在对一系列关切自身重大利益的事项进行“一揽子同意”时,通常无法准确评估合同的每一条款可能使自身面临的风险。此即约翰·密尔所称“长期契约中自由意志的局限”“个人是自身利益的最佳决策者, 但该原则的例外情形是,在即期做出远期的利益判断。” 〔20 〕就数据合规科技而论,数据主体可能无法想象,允许数据处理者与其他受托方或第三方共享用户数据,将带来巨大的数据保护空白;数据主体也无法预料,出于实现公共利益的善心,适当允许处理者扩大数据采集范围,反而将助长数据剩余权利滥用、隐私迫害等情况的滋生。

雖然表意不自由并不等同于合同法理论上的胁迫与欺诈,很多不透明也确实是因为数据合规科技中加密技术使用过度所致,但某些情况暗含胁迫或欺诈意味,立法者不能等闲视之。例如,数据主体只能通过多方安全计算才能得到优于原本算法决策的结果,技术方以“为客户提供更精确的运算结果”为名,推荐数据主体同意来自不同数据处理主体的多方处理请求;可信执行环境和低代码系统随时间推移出现处理延迟,平台方建议将企业数据从自家服务器向特定云端服务器迁移以获得云计算模块的加速。鉴于数据合规科技的技术复杂性,知情同意框架无法保障数据主体从一开始就作出不含效力瑕疵的意思表示。

综上所述,数据处理者可以就技术细节提供堪称翔实的用户协议,数据主体也对此表示同意,但不能因此完全认可此间法律关系的产生、变更或消灭的合理性,还应“进行价值层面的衡量并做出执法和司法上的正确判断”。〔21 〕数据主体既无力深究长篇累牍用户协议中可能存在的雷区,也无法从技术层面知晓自己的数据何时被调取或使用;意思表示真实性和有效性大打折扣,“同意”与“事实上知情”存在断层,现行知情同意框架实难应对数据合规科技带来的复杂挑战。

(三)损害救济机制的局限

目标纠偏机制的失守,使数据主体在实践中更倾向于通过损害救济机制向数据处理者主张责任。脱胎于传统的侵权责任法,损害救济机制通过设立较高的赔偿数额,引导当事人自行消化高交易成本。一方面,法律向受害人提供可以获得同所受侵害相匹配赔偿的公平允诺,激励受害人向法院积极主张不受侵害的权利;另一方面,实施不法行为的施害人将被克以明确的赔偿责任,确保侵害行为的预期净收益为负,进而抑制其侵害冲动。理论上,两者的合理锚定保证了潜在收益和责任负担之间的连接强度,将施害人自食其果的概率维持在合理区间。但是,从民法典的相关规定来看,自然人对其个人数据享有作为民事权益的人格权益, 〔22 〕而人格权益属性具备一经成立即附着于复杂社会关系的特殊性,“停止侵害”“返还财产”“赔偿损失”“赔礼道歉”等责任承担方式均无法在实质上消除影响、恢复名誉。

侵权行为的成立,以“侵权行为对被侵害人造成损害”“侵权行为和造成损害之间有因果关系”为构成要件。技术尚不成熟时,数据合规科技的利用是一种“射幸行为”,谁也没法保证,单个细分场景中算法给出的最优解,经过多方安全计算的跨场景加权后是否会变为次优甚至劣后的结果;在简单场景中披荆斩棘的低代码模块,由于同其他模块的叠加有无可能造成系统整体效率的走低。在技术黑箱的层层掩护之下,原告方难以证明看似中立的技术应用是导致自身权益受损的直接近因,锁定数据合规科技侵权行为的法律责任可谓难上加难。〔23 〕受制于部分技术的不可解释性,举证责任倒置的引入同样无济于事。可以想象,反复历经个人信息保护立法和司法审判的规训,技术方早已学会巧妙地把自己的真实意图进行冠冕堂皇的包装,将责任免除的说辞嵌入数据合规科技的各个环节,在被告方轻而易举“证明”损害不存在或自身对损害不负有责任后,原告方将继续深陷举证难的困境。损害救济机制的局限,需要系统性地加以克服,政策制定者可先从新型法律关系的界定和承认着手,再逐步丰富损害救济机制的手段。

(四)权利保障机制的局限

在目标纠偏和损害救济机制之间,各国立法者从数据主体的“个人信息自决”入手,赋予了数据主体一系列权利救济途径。例如, GDPR第17条规定了“被遗忘权”“数据主体有权要求数据控制者擦除关于其个人数据的权利”。实现被遗忘权的方式是“清除同个人数据相关的链接、备份或复制”,此举因实践成本极高且有悖信息自由而饱受诟病。〔24 〕美国加州消费者隐私法案(以下简称CCPA)第3章规定了“删除权”“如果服务提供商收到消费者提出的删除其个人数据的可验证请求,则应从其系统中删除消费者个人数据,并指示任何‘从服务提供商’从其系统中相应删除消费者个人数据”,较之于被遗忘权更具可操作性。〔25 〕我国信息安全技术个人信息安全规范(以下简称安全规范)第8条第3款和个人信息保护法第47条借鉴了CCPA删除权的思路,但通过适当降低删除权实质内涵的方式进一步降低了技术方的合规成本:只要个人数据在日常业务功能所涉及的系统中不能被“检索或访问”,即满足安全规范第3条第10款对“删除”的定义。

数据合规科技本为桥接不同源头的数据而生,此时,为降低企业合规成本而允许技术方采取“名义删除”的做法不再有效,解决方案是重回GDPR被遗忘权所体现出的“实质删除”进路,要求企业真正实现不可逆转的删除。此外,被遗忘权、删除权还面临“技术不能”的考验。例如,具有不可篡改特性的区块链技术在数据合规科技中的穿插应用,令不可逆转的删除难以实现;在数据集中添加噪声以降低敏感数据泄露风险的常见做法,也将加大“实质删除”的难度和数据量;联邦学习全局无损的模型构建,极大地限制了特定区块的删除,任何区块的缺失意味着秘钥的断层以及后续区块无法进行哈希链接。〔26 〕总之,数据合规科技中的数据主体需要不同于被遗忘权或删除权的信息自决手段,才能克服既有权利保障机制的局限。

(五)隐名消除机制的局限

在多重机制纷纷失效的情况下,隐名消除机制构成了数据主体的最后一道防线,数据处理者有责任采取技术手段保证任何人或组织无法以倒推的方式,知晓信息主体的真实身份。安全规范规定了去标识化和匿名化两种隐名手段。就保护层级而言,去标识化的保护效力低于匿名化:去标识化通过降低数据区分度减少数据同数据主体之间的关联性,使得数据难以对应到个人,但保留了个体颗粒度、哈希函数等技术手段替代原有信息的标识;匿名化虽然同去标识化的技术手段多有重合,但其终极目的是将个人数据完全同数据主体的身份相剥离。

问题在于,随着数据如滚雪球般积累,完全匿名化的状态将不可能保持。〔27 〕“数据最小化、匿名化等原则,在大数据反向识别和预测性挖掘等技术下失去了应有的保护作用。” 〔28 〕单独看来没有任何痕跡残余的匿名化数据,极有可能因为数据聚合而露出蛛丝马迹。诚然,数据合规科技的加密手段能有效划分权限,在很大程度上阻绝了多方大数据“实质合并”的可能,但机器学习模型在各参与方之间的多次往返流转也极有可能粘附足以识别“去标识化”数据的线索。极端情况下,掌握了足够多的单向反馈和模型变动,完全碎片化的匿名数据也有可能被复原。“个人信息具有的可识别性通常并非全有或全无,而是呈现出不同程度的识别能力,经过匿名化处理的信息仍可能残存一定的‘可识别性’。” 〔29 〕考虑到数据合规科技带来的数据交流的爆炸式增长,任何匿名化处理手段都将难以有效消弭匿名数据的剩余风险。

上述各项法律机制的局限,实际上是规制思维的局限。其一,政府主导的规则制定模式,极易因为利益关联和认知局限等,排斥技术场景中的个性化诉求。其二,过度聚焦于应用前端和中端的规则设计,难以有条不紊地化解数据合规科技带来的各项冲击。在探寻规制的新方法、新范式之前,我们必须承认一个根本性前提:数据合规科技同传统人工智能技术的风险在起因、特征、危害等方面已有显著不同,不可简单地将传统规制思维相沿成俗。由于存在不同维度的风险,数据合规科技的法律规制需要透过一种联结化的努力,在整合当前机制的基础上,突破前述局限性,形成稳定性与灵活性统一的制度框架。

四、规制数据合规科技的系统性思考

自既有的制度余量观之,数据合规科技的规制机制并不贫乏,但囿于种种局限性的存在,当前内涵繁杂、维度齐备但功能相对简单、规则过于刚性的机制统合,很难对数据合规科技不同维度的风险给予有效回应,甚至会对个别数据主体的独特性利益造成压制,无法担当治理数据合规科技的重任。信任维系、目标纠偏、损害救济、权利保障和隐名消除等机制的突破,最终需要一个系统性的规制体系加以承载。

(一)数据合规科技的规制原理

传统法律规制的各项局限并非互不相关,它们共同揭示了这样的原理:数据合规科技的“去中心化”特征,正逐步瓦解企业、部门和平台的边界,基于边界概念的安全防护体系将不复适用。说到底,数据环境越复杂,技术方就越有可能以合法形式绕开预设约束,迂回实现自身利益的最大化进而损害社会公共利益。

新兴技术通过颠覆“传统工商业态和经营模式”促进劳动生产率的提升, 〔30 〕法律若未能及时跟进、推陈出新,将产生监管套利的灰色空间。数据合规科技的大趋势下,普通人如何拒绝不合理的隐私计算请求、个人生命和财产在数据合规科技出错失误时如何获得及时保护、数据主体如何理解各项技术原理从而有机会对其权益保护作出适当的安排等,都需要通过法律规则的演进赋予其采取合法行动的有效手段或足以抗衡技术滥用的法律地位。数据合规科技的健康发展和合理利用离不开法律和技术的良性互动,因兼顾隐私保护和激发数据潜能的双重追求,良性互动的基本回路应当脱离自上而下的强监管逻辑,审慎探寻将技术规范循序嵌入法律政策的合理路径,确保“法定义务的履行和技术标准的遵守有机整合”。〔31 〕顺应数据合规科技的应用发展趋势,数据合规科技的规制应正确对待传统法律规制的短板,发展出平衡各参与方利益、促进技术增益数据价值、保护数据主体综合权益的规制体系。

(二)既有机制的补强和完善

面对数据合规科技风险,已有的各项规制手段仍然有延伸适用的空间,但应结合已知局限进行定向的修补和完善。

1.动态知情同意框架

虽然知情同意框架有着诸多缺陷,但至今仍然广泛被各国立法者前置为信息处理全周期的第一闸口,主要是因为标准化的模式对于各方而言均为最有效减少交易成本的解决方案。〔32 〕可以预计,在数据合规科技作为算法应用基础设施的全新业态中,知情同意框架仍将发挥巨大的作用,但亟需根据全新的业务特征加以调整。

数据合规科技联结了多方节点数据和算力资源,通过提升机器学习模型的泛化能力完成从个体智能到群体智能的数据处理生态转变。不同于业务模式较为固定的传统算法决策,横跨数据合规科技全周期的知情同意框架,对应的不再是“搜集—处理—决策”的简单合同,而是贯穿下游数据、中游技术到上游应用的一系列合同集束,此间任何一个环节的细微改变,都会产生合同的链式反应。“信息应用场景的动态化是大数据背景下信息技术的生命力之所在。” 〔33 〕数据合规科技的适用场景呈现高度动态化特征,数据处理者必须结合节点状态、合约策略、加密方式、环境闭合等情况临机应变,清晰、稳定、透明的数据处理方式不再具有可期待性。这种动态化的业务特征决定了知情同意框架也必须相应处于动态变化之中,数据主体只有做到与时俱进的“知晓”,才能作出真正符合其意思表示的“同意”,否则无异于缘木求鱼。因此,即使是去标识化、匿名化的个人数据参与多方安全计算、联邦学习等,数据处理主体也应当“逐次、分别、主动”请求用户授权。

2.严格的转委托原则

个人信息保护法第21条允许处理者在获得数据主体同意时将个人数据委托受托方进行处理,委托方和受托方须就数据处理的目的、方式、种类和保护措施达成合意,在委托关系解除后,受托方须返还或删除个人数据。在数据合规科技可能存在的多重合同关系中,受托方及第三方通常处于“从数据处理者”的地位,主数据处理者同意从数据处理者的共同处理行为,在性质上只是对原授权许可范围的变更,并未因此产生新的独立授权,主处理者和从处理者之间的权利义务确立应当符合以下原则。

其一,安全评估原则。例如,安全规范第9条规定了数据处理主体委托第三方时的安全评估义务,主处理者应当确保从处理者“根据有关国家标准的要求,建立适当的数据安全能力,落实必要的管理和技术措施”。其二,中心控制原则。主处理者对从处理者应当有合理手段和措施遏制从处理者的机会主义行为,例如,撤销其委托,以确保从处理者的好奇心在可控范围内,且任何时候不带恶意。其三,权限递减原则。所有从处理者的权限不得大于主数据处理者,包括但不限于处理数據的类型、数量、目的和授权期限等,主处理者对从处理者的授权应以拟实现的正当目的为限。其四,逐次授权原则。即便从处理者的权限范围小于主处理者,主处理者也必须就新从处理者的引入、拟授权处理权限的变化等额外获取数据主体的同意。其五,上下游联动原则。数据主体变更、限制、撤回对主处理者的授权时,从处理者也应当相应调整、减少、停止数据处理行为,主处理者应当确保下游处理者的行为与之联动,无需数据主体一一知会从处理者。其六,责任共担原则。对于任何超出自身权限的数据处理行为,主从处理者承担连带责任。

3.正当程序的权利保障

无论技术如何发展,自然人享有的正当程序权利,不因规则体系的数字化重建而改变。〔34 〕遵循行政法的自然正义观,英美立法者正探讨“陈情权”的可行性,为遭受不公正自动化决策的数据主体提供获得公平聆讯和请求行政复议的机会。另一个同数据合规科技息息相关的权利范式是“离线权”,该权利允许数据主体将个人数据从数据合规科技的实践中撤离出来,并自由决定其个人数据在不同数据处理者之间的流转, 〔35 〕与欧美数据保护法中的“数据可携带权”以及我国个人信息保护法中的“个人信息转移权”有异曲同工之妙。在不同的技术场景中,离线权的表现形式亦有所不同。例如,在多方安全计算中,数据主体行使离线权即意味着撤销参与未来多方安全计算的同意,数据处理主体须接续本地自动化决策方案,以保持服务提供的连续性。在联邦学习中,离线权表现为用户可以随时行使的“掉线权”。作为解决多组织协同训练问题的有效手段,现有联邦学习技术通常限制用户掉线。研究表明,通过在本地模型参数上添加差分隐私扰动、在聚合参数上添加用户噪声等方式,用户掉线将不再对模型训练构成威胁, 〔36 〕掉线权的普及具备了技术层面的可行性,异构系统间的联邦学习也成为可能。掉线权的法益体现在,虽然掉线权的制度引入给技术方带来了更高的合规成本,但有助于吸引更多离散客户端参与联邦学习,从而提升系统的准确性和鲁棒性。〔37 〕

(三)多元机制的构建和分工

1.口径统一的宏观行业标准

数字化转型阶段,金融、保险、医疗、销售、教育等行业都向数据处理行业过渡。2021年6月28日,中国支付清算协会发布《多方安全计算金融应用评估规范》,这是我国第一个有关隐私计算的金融规范,足见金融行业对数据合规科技的重视。数据标准统一、技术规范明晰,是上下游规则联动的基础。数据合规科技流派众多,数据采集和处理方式差别迥异。金融行业之外,其他行業主管部门也应当联合牵头制定跨行业共同遵守适用的“数据辞典”,打造数据交换的“通用语言”,做到数据编码、制式、口径、格式方面标准的统一,保证数据来源、内涵、处理逻辑可被“反事实校验”。建立跨行业的统一标准,还将有利于构建新兴技术适用的漏洞知识库:行业主管部门应将零散的概念、实例和规则整合成体系化的检索库,在地址、端口、服务、属性、协议五元组层面实现数据合规科技的知识图谱化。

政府部门处于数据和关键信息基础设施的要冲,是最庞大、最完整的数据拥有者。政府部门向各行各业定向、合理、有序开放“国家教育资源公共服务平台”“国家科技管理信息系统公共服务平台”“国家社会保险公共服务平台”“全国企业信用信息公示系统”等数据库,有助于赋能各个产业的数字化转型。〔38 〕目前,国家级和区域级的大数据交易所已在我国渐次成型。2021年3月31日,北京国际大数据交易所成立,系我国首家基于“数据可用不可见,用途可控可计量”新型交易范式的数据交易所。〔39 〕2021年11月25日,上海数据交易所成立,以“推动数据要素流通、释放数字红利、促进经济高质量发展”为导向,积极突破“确权难、定价难、互信难、入场难、监管难”等阻碍数据交易规模化的核心问题。〔40 〕统一行业标准之后,可以交易所为依托,选择政府数据作为数据合规科技试点,在金融普惠、智慧医疗、教育监管等领域率先打造技术沙盒,之后再以点带面逐步向全国、全行业示范推广,分步完善数据流转的确权模式,循序渐进推动数据合规科技的应用落地。

2.技术甄别的中观审查体系

低代码的板块拼接以及隐私计算中同态加密、差分隐私等手段的使用,打破了数据输入和结果输出间的线性关联,算法可解释性要求被数据合规科技架空。诚然,闭门、随机、混淆、变化的数据利用模式加大了敌手攻击的难度,为数据合规科技带来了相当程度的安全保障,但这并不足以正当化数据处理过程中一系列技术黑箱的存在。数据合规科技应同时具备结构上的稳定性和经济上的可操作性,纵使加密和防御手段令人眼花缭乱,贯穿数据合规科技前中后端的运行逻辑应当始终如一;此乃评价整体解决方案的一惯性标准,即当且仅当能够从相对于整体实践提供最佳证成的数据合规科技方案中脱颖而出,所采取的各项具有“黑箱性质”的技术手段才是可取的。从监管便利性来看,虽然各个流程环环相扣的可解释性要求既无必要也无可能,但数据合规科技的各参与方确应就整体方案的可欲性和优越性达成共识,并以共同声明的方式,在请求用户特别授权时,就以下三个方面内容作出详细且外行人也能理解的信息披露:(1)整体方案的目标愿景、运作逻辑与构建机理;(2)所选取技术手段的必要性及面临的权衡取舍;(3)可能存在的系统偏差、隐私风险、运行故障和补救方案。

同算法可解释性所面临的问题相似,信息不对等必然诱发权力滥用。技术迷雾可以有效阻碍数据主体证伪上述信息披露,技术方的解释和说理方式则完全取决于拟实现的经济或政治目标。技术迭代迅速,多环节技术叠加还有可能造成脱离造物者预设程序但短期内难以被人察觉的情况。〔41 〕因此,心怀善意的技术方至多作出“自以为正确的解释”,而错误乃至虚假的信息披露或是数据合规科技中的常态。因此,有必要引入外部审查机制、深入拷问数据合规科技的潜藏风险。数据合规科技方案的外部审核主体应当由独立的第三方机构担任,实施审核的专家委员会由具备相关技术背景、同各参与方无利益往来的专家组成。外部审核应着重关注技术方在降低算法歧视方面是否尽力而为。避免算法歧视群体化需要追问数据合规科技数据处理的社会性聚合机制, 〔42 〕尤其是作为多方安全计算、联邦学习和低代码参与方的自身禀赋、行业特点和地域限制在何种程度上影响了数据样本的生成。无论如何清洗,来源于同一主体的数据通常会被打上难以察觉的烙印,具有隐性的身份化表征,在无形之中限定了数据合规科技的应用格局。不同数据间集体身份在数据合规科技实践中相互排斥和博弈越明显,得出的运算结果、训练出的公共模型和成型的低代码模块就越有可能产生歧视。由于歧视主要根源于数据,外部审核应当确保技术方在数据清洗过程中引入了缺省数据筛选机制,主动去除冗余、不相关、不合格数据,降低通信成本、提升运算精度,避免数据合规科技参与方因为数据饥渴而来者不拒,从源头掐断算法歧视群体化的苗头。

3.开发行为的微观伦理规范

虽然宏观标准和中观审查体系有望解决既有机制难以企及的诸多难题,但促进技术向善最有效的手段始终是通过法律将标准和原则植入技术应用的底层行动逻辑,因势利导出政策制定者期望的结果,这也是“通过设计保护隐私”的应有之义。事实上,数据安全同技术效益、商业价值之间从来就不是此消彼长的冲突关系,保障数据安全并不意味着牺牲其他价值,“企业在保护用户隐私的同时,也在为自己创造竞争优势”。〔43 〕如果技术方可以将自己的偏好和价值观嵌入代码的字里行间,立法者同样可将伦理先行原则、声誉评价机制等固化进开发行为规范,为不同类型的技术应用创设差异化的社群规则。

就数据合规科技而言,各项技术应用首先需要满足伦理先行原则,不得游走于现有法律体系的灰色地带进行监管套利。通说认为,算法规制目标无他:其一,警惕本来应当是中立的智能应用,被用来掩饰未取得“多数人同意”的少数人集权;其二,建立利益相关者对话和商谈的场域,避免法律沦为技术寡头的帮凶。〔44 〕数据合规科技汇聚了海量大数据,技术方极有可能经不住诱惑,利用算法压榨个体摄取不成比例的回报。由于同算法息息相关,数据合规科技同样包含价值判断,立场抉择关涉多方利益,因此,技术方案选择不应是简单的效益至上或是性能择优。数据合规科技践行伦理先行的理念,要求各参与方的效益增长势必要同步拉动社会公共利益提升。

此外,技术方还应当主动引入声誉概念作为参与方信任度的衡量指标,净化数据合规科技的运行环境。从可采取的技术手段来看,多权重的主观逻辑模型使基于声誉的可信赖客户端之间的“朝上竞争”成为可能,配合区块链技术的不可篡改特性,分布式信誉管理不再是痴人说梦。例如,围绕深度强化学习设计激励策略,在开源分布式特殊场景中推行资源按劳分配,以达到边缘节点的最佳训练水平; 〔45 〕利用区块链技术跟踪全局模型更新,对积极参与联邦学习的用戶给予丰厚奖励,能实现局部模型的更高稳定性。〔46 〕契约理论可被用于数据合规科技各参与方算力投入和模型质量的衡量,一直以来困扰实务界的“拜占庭将军问题” 〔47 〕有望通过“联合诚实参与方而非揪出恶意方”的方法得以解决。不过,技术互嵌的解决方案有时也相互掣肘,技术方需量力而行。例如,区块链技术的公共账本特性存在通信延迟、数据吞吐量大等问题,与通信开销同样不可忽视的隐私计算相结合,必然对通信设备、服务器带宽以及主机算力等提出更高要求。域外学者提出了对通信成本和模型准确性之间进行表征的方程式,可以对特定带宽下分布式学习的速率进行有效评估,从而对两者的权衡取舍予以指导。〔48 〕

(四)整体规制方案的价值衡量

在既有机制补强和多元机制构建所共同组成的图景中,规制体系的稳定性有赖于规制者结合实情作出正确的价值考量。数据合规科技规制本质上是多层级风险防范与技术方案设计和应用之间的复杂价值平衡,即受数据合规科技影响的多种法益与合理使用技术的利益间的价值平衡。

在福利经济学领域,价值增减的衡量一直有两套标准:一套是视福利为个人需求加总的“帕雷托效率”,主张当个体境遇的变好不以牺牲他人利益作为代价时,社会福利才是增值的;另一套是将资源再分配纳入计算的“卡尔多—希克斯效率”,认为只要获益方所获得的利益足以补偿受亏损者的损失,那么社会总体福利也是增值的,至于补偿是否实际发生则无关紧要。〔49 〕前文指出,个人数据具有人格权益属性,而人格权益的侵害既不表现为经济利益的丧失,也难以通过事后救济的方式弥补。因此,在数据合规科技场景中,“卡尔多—希克斯效率”的计算方式毫无用武之地,宜将“帕累托效率”所展示出来的理想目标作为价值衡量标杆。亦即,无论被何种技术加持,技术方的经济效益在任何时候都不应凌驾于人格权益之上。即使是为了社会效益的增长,个人数据权益的克减有时不可避免,但在有多个参与方的技术场景中,如果部分参与方的利益主要体现为财产利益,其余参与方的利益主要体现为人格权益,人格权益方应当享有优先保护。

(五)机制联结互动的动态方案

数据合规科技的安全合规,以规制体系的系统性和融贯性为保障。上文建议的多项机制共同展示出了数据合规科技不可或缺的多个规制面向,而各个规制面向间的内部关系,亦可进一步完善。易言之,必须将分散零碎的规则和工具嫁嵌入多维共治的动态方案中,数据合规科技的规制体系才算完整。不同规制面向间的合理联结和差异化耦合,可以为数据合规科技的各项技术形成有针对性的规制方案,并根据不同维度的风险、结合不同的应用场景,条分缕析出符合“帕累托效率”的动态规制方案。正在征询意见的网络数据安全管理条例坚持促进数据开发利用与保障数据安全并重,主张“分地区、分部门、分行业”建立数据分类分级保护制度;以促进保障数据依法有序自由流动、依法合理有效利用为导向,数据合规科技的动态规制图式,如下图所示。

这一图式展示出了数据合规科技的动态规制体系,即以不同层面的法律规则为核心、各项规制要素同频共振的系统化规制模式。例如,对于智慧金融领域的数据合规科技,因为关涉公共产品的分配,计算结果的准确性和数据安全同等重要, 〔50 〕宏观层面的行业标准如果偏重数据安全和应用流程的一体化规范,中观层面的外部审查体系就应当着重关注计算结果的公允程度及其对数据主体的潜在影响;为了缓解规制过程中工具理性和价值理性的冲突,个体层面的权利保障是对结果数据维度风险的补救和兜底。

总之,因应技术的流变、场景的不同以及参与方禀赋的差异,针对数据合规科技的规制方案没有一成不变的“最优解”,必须基于风险产生的不同机理,考虑治理成本、技术条件、舆论环境等外在约束,形成力所能及的差异化制度安排。诚然,逐一考察数据合规科技的各项技术并提出各个技术专用的制度设计建议颇费周章,非本文在有限篇幅内能够完成的任务,但图式中不同维度和要素的交互联结,可助力不同的风险场景和规制目标形成符合国情、环环相扣的规制方案,希望能为日后各项技术规制的单独细化抛砖引玉。细分领域的不同技术间因数据处理的目的不同、应用行业不同,需要分别设计不同的社群规范和权利簇,但大体规制框架无论是在方法论层面还是在法益衡量层面均没有实质差别。

上述动态规制图式中多项机制间的连接和互动机理并非法律人的凭空臆想,而是立足于我国现有数据安全法律体系的必然选择。较之于传统的静态制度安排,动态的规则设计能够更为细致地兼顾各项机制和工具之间的整体协调和按需调整,避免小规则对大体制的掣肘和抵消。当然,随着时间推移,数据合规科技的规则之治不可能变动不居,各项机制和联动思路也必须随着技术的嬗变不断发展和完善。

结 语

“没有意识到风险,是最大的风险。” 〔51 〕在人工智能技术面前,人类更应该充分发挥自身的理智优势使潜在风险最小化。破解数据合规科技的风险迷局,必须超越传统人工智能法律规制的路径依赖,摒弃科学乌托邦主义情结,完成思维和方法论的转变:其一,从单点被动防御转向全网主动联防联控,以数据和人为核心构建覆盖“客户端—云—服务器—模型—应用—社会”的一体化纵深安全运营体系;其二,在各关键节点优化知情同意、数据处理转委托等规则,强化对各行各业数据处理行为的约束,结合技术现状有针对性发力;其三,建立跨部门的沟通和问责机制,在全天候预警监测的基础上加强跨行业数据的穿透式监管能力,自下而上构建数据合规科技的动态规制体系。唯有如此,透过数据合规科技的要素价值释放,才可谓安全无虞。

中国社会科学院法学研究所助理研究员,法学博士。

本文系国家社科基金重大项目“大数据时代个人数据保护与数据权利体系研究”(项目批准号:18ZDA145)的阶段性研究成果。

〔1〕合规科技不同于“科技合规”,后者是指技术方与监管者以数字化方式互相连通,实时向监管者传输应用数据以动态形成合规报告的信息披露实践,而前者则是将监管要求转化为科技应用的技术约束,主动降低安全隐患的技术利用模式。

〔2〕中共中央党史和文献研究院:《习近平关于网络强国论述摘编》,中央文献出版社2021年版,第121页。

〔3〕参见许可:《个人信息治理的科技之维》,载《东方法学》2021年第5期。

〔4〕I. S. Rubinsteint & N. Good, Privacy by Design: A counterfactual Analysis of Google and Facebook Privacy Incidents, 28 Berkeley Tech. L. J. 1335 (2013).

〔5〕科技部《关于加强科技伦理治理的指导意见(征求意见稿)》(2021年7月28日)。

〔6〕Koch, Hans-Joachim, and Helmut Rüßmann. Juristische Begründungslehre: eine Einführung in Grundprobleme der Rechtswissenschaft, Beck, 1982, p.67.

〔7〕参见沈伟伟:《算法透明原则的迷思》,载《环球法律评论》2019年第6期。

〔8〕参见周纯毅等:《分布式深度学习隐私与安全攻击研究进展与挑战》,载《计算机研究与发展》2021年第5期。

〔9〕B. Hemenway & W. Welser, Achieving Higher-Fidelity Conjunction Analyses Using Cryptography to Improve Information Sharing, RAND Corporation, 2014, p.6.

〔10〕参见Z. Wang, et al., Beyond Inferring Class Representatives: User-Level Privacy Leakage from Federated Learning, 1 Proceedings of IEEE Infocom Conference On Computer Communications, 2512-2520 (2019).

〔11〕J. Steinhardt, et al., Certified Defenses for Data Poisoning Attacks, in Michael I. Jordan, et al (eds.), Advances in Neural Information Processing Systems, Cambridge: MIT Press, 2017, pp.3517.

〔12〕X. Y. Chen, et al., Targeted Backdoor Attacks on Deep Learning Systems Using Data Poisoning, preprint, (5526) arXiv, 1712 (2017).

〔13〕Z. Wang, et al., EvilModel: Hiding Malware Inside of Neural Network Models, 26 IEEE Symposium on Computers and Communications, 2107 (2021).

〔14〕高富平:《个人信息保护:从个人控制到社会控制》,载《法学研究》2018年第3期。

〔15〕最高人民检察院《贯彻执行个人信息保护法推进个人信息保护公益诉讼检查工作》(2021年8月21日)。

〔16〕参见曹建峰:《人工智能治理:从科技中心主义到科技人文协作》,载《上海师范大学学报(哲学社会科学版)》2020年第5期。

〔17〕Commissioner v. Facebook Ireland Limited, Maximillian Schrems (Case C-311/1).

〔18〕张欣:《算法解释权与算法治理路径研究》,载《中外法学》2019年第6期。

〔19〕参见刘志勇、何忠江等:《大数据安全特征与运营实践》,载《电信科学》2021年第5期。

〔20〕J. S. Mill, The Principles of Political Economy, New York: Colonial Press, 1961, p.959.

〔21〕张新宝:《个人信息收集:告知同意原则适用的限制》,载《比较法研究》2019年第6期。

〔22〕参见程啸:《论我国民法典中个人信息权益的性质》,载《政治与法律》2020年第8期。

〔23〕参见唐林垚:《算法应用的公共妨害及其治理路徑》,载《北方法学》2020年第3期。

〔24〕参见刘文杰:《被遗忘权:传统元素、新语境与利益衡量》,载《法学研究》2018年第2期。

〔25〕参见丁晓东:《被遗忘权的基本原理与场景化界定》,载《清华法学》2018年第6期。

〔26〕参见黄尹旭:《区块链应用技术的金融市场基础设施之治理——以数字货币为例》,载《东方法学》2020年第5期。

〔27〕[英]維克托·舍恩伯格等:《大数据时代:生活、工作与思维的大变革》,盛杨燕等译,浙江人民出版社2013年版,第200页。

〔28〕徐明:《大数据时代的隐私危机及其侵权法应对》,载《中国法学》2017年第1期。

〔29〕齐英程:《我国个人信息匿名化规则的检视与替代选择》,载《环球法律评论》2021年第3期。

〔30〕参见马长山:《司法人工智能的重塑效应及其限度》,载《法学研究》2020年第4期。

〔31〕赵精武、周瑞珏:《隐私计算技术:数据流动与数据安全的协同保护规则构建》,载《信息通信技术与政策》2021年第7期。

〔32〕参见王利明:《数据共享与个人信息保护》,载《现代法学》2019年第1期。

〔33〕万方:《个人信息处理中的“同意”与“同意撤回”》,载《中国法学》2021年第1期。

〔34〕参见张凌寒:《算法自动化决策与行政正当程序制度的冲突与调和》,载《东方法学》2020年第6期。

〔35〕参见唐林垚:《“脱离算法自动化决策权”的虚幻承诺》,载《东方法学》2020年第6期。

〔36〕参见路宏琳、王利明:《面向用户的支持用户掉线的联邦学习数据隐私保护方法》,载《信息网络安全》2021年第3期。

〔37〕鲁棒性,指系统在其特性或参数发生摄动时仍可使品质指标保持不变的性能。

〔38〕参见许可:《从监管科技迈向治理科技》,载《探索与争鸣》2018年第10期。

〔39〕参见徐佩玉:《北京国际大数据交易所成立》,载《人民日报》(海外版)2021年4月3日。

〔40〕参见张懿:《助力“艰苦一跃”,更好释放数字经济潜能》,载《文汇报》2021年11月26日。

〔41〕参见何大安:《厂商运用大数据和人工智能的经济学分析》,载《上海师范大学学报(哲学社会科学版)》2021年第3期。

〔42〕参见李成:《人工智能歧视的法律治理》,载《中国法学》2021年第2期。

〔43〕郑志峰:《通过设计的个人信息保护》,载《华东政法大学学报》2018年第6期。

〔44〕参见[英]凯伦·杨、马丁·洛奇:《驯服算法》,林少伟等译,上海人民出版社2020年版,第353页。

〔45〕See Y. Zhan, et al., A Learning-Based Incentive Mechanism for Federated Learning, 7 IEEE Internet of Things Journal, 1221 (2020).

〔46〕See Y. J. Kim & C. S. Hong, Blockchain-Based Node-Aware Dynamic Weighting Methods for Improving Federated Learning Performance, 20 Asia-Pacific Network Operations and Management Symposium, 1-4 (2019).

〔47〕拜占庭将军问题是指在有叛徒的情况下将军们如何共谋的难题。在数据合规科技中,该问题演化为在分布式单元中的部分参与方可能给出不实数据的条件下,如何使分布式单元达到一致的难题。亦即,在缺少可信任的中央节点和数据传输通道的情况下,分散在系统中的各参与方应如何达成共识?

〔48〕See Y. Han, A. Ozgur & T. Weissman, Geometric Lower Bounds for Distributed Parameter Estimation Under Communication Constraints, 2 Proceedings of the Conference on Learning Theory, 3163-3188(2018).

〔49〕参见艾佳慧:《法律经济学的新古典范式》,载《现代法学》2020年第6期。

〔50〕参见苏宇:《数字代币监管的模式、架构与机制》,载《东方法学》2021年第3期。

Abstract: Frequent data breaches accelerated privacy protection legislation, yet the strong regulatory trend has in turn caused the scarcity of legitimately-usable data. Under the data-as-production-factor strategy, mainstream CompTech such as privacy-preserving computation and SaaS platform could help to release the data potential in an orderly and compliant manner in-between untrusted entities through the "decentralization" of outcome calculating, model training and hardware defensing, but may also give rise to the generalization and alienation of traditional problems. Due to the deep reconstruction of the data processing mode, trust maintenance scattered across every level of the law, target correction, defect remedy, rights protection and compulsory anonymization methods all malfunctioned in CompTech scenarios. In order to balance the legal interests of each subject, future legislation should aim to build a dynamic regulatory system that adapts to changes, through the collaboration between macro policies, community regulation, technology structure and the competition between actors. The bottom line of such an adaptable legal framework is to eliminate the risks from the blind spots from the complex data processing scenarios and to give full consideration to the utility needs of data productivity, so as to ensure the compliance of the CompTech itself.

Key words: CompTech; privacy-preserving computation; low code; personal information protection; security compliance; Artificial Intelligence