基于生物识别技术的全球个人信息安全治理研究

2022-02-02林梓瀚

林梓瀚 游 祎 史 渊

(1.中国电子系统技术有限公司,北京 100141;2.外交学院图书馆,北京 102206;3.北京交通大学法学院,北京 100091)

生物识别(Biometrics)是利用量化的生物(包括解剖学和生理学)特征及行为特征,以快速可靠的方式对个体进行身份自动识别和认证的手段[1]。19世纪中期,工业革命的快速城市化进程增加了社会各界对身份识别规范方法的需求。1892年,英国著名生物学家弗朗西斯·高尔顿(Francis Galton)开发了世界上首个指纹分类系统;1903年,纽约州的监狱开始使用指纹系统;1960年,基于伍德罗·W.布莱索(Woodrow W.Bledsoe)研究成果的半自动面部识别技术面世[2]。随着智能技术的发展,生物识别技术被应用到不同的场景,包括公共事业、商业等,为社会带来了极大的便利,但是生物识别技术的广泛应用也带来了相应的困境,由生物识别引起的个人信息的安全问题更加引人关注。

本文梳理了生物识别技术主要的应用场景及其带来的困境,分析了国际组织与欧美等主要经济体对生物识别技术的治理政策和治理举措,以期为中国利用生物识别技术收集个人信息的监管提供参考。

1 生物识别技术的应用场景和困境

1.1 生物识别技术的分类及应用场景

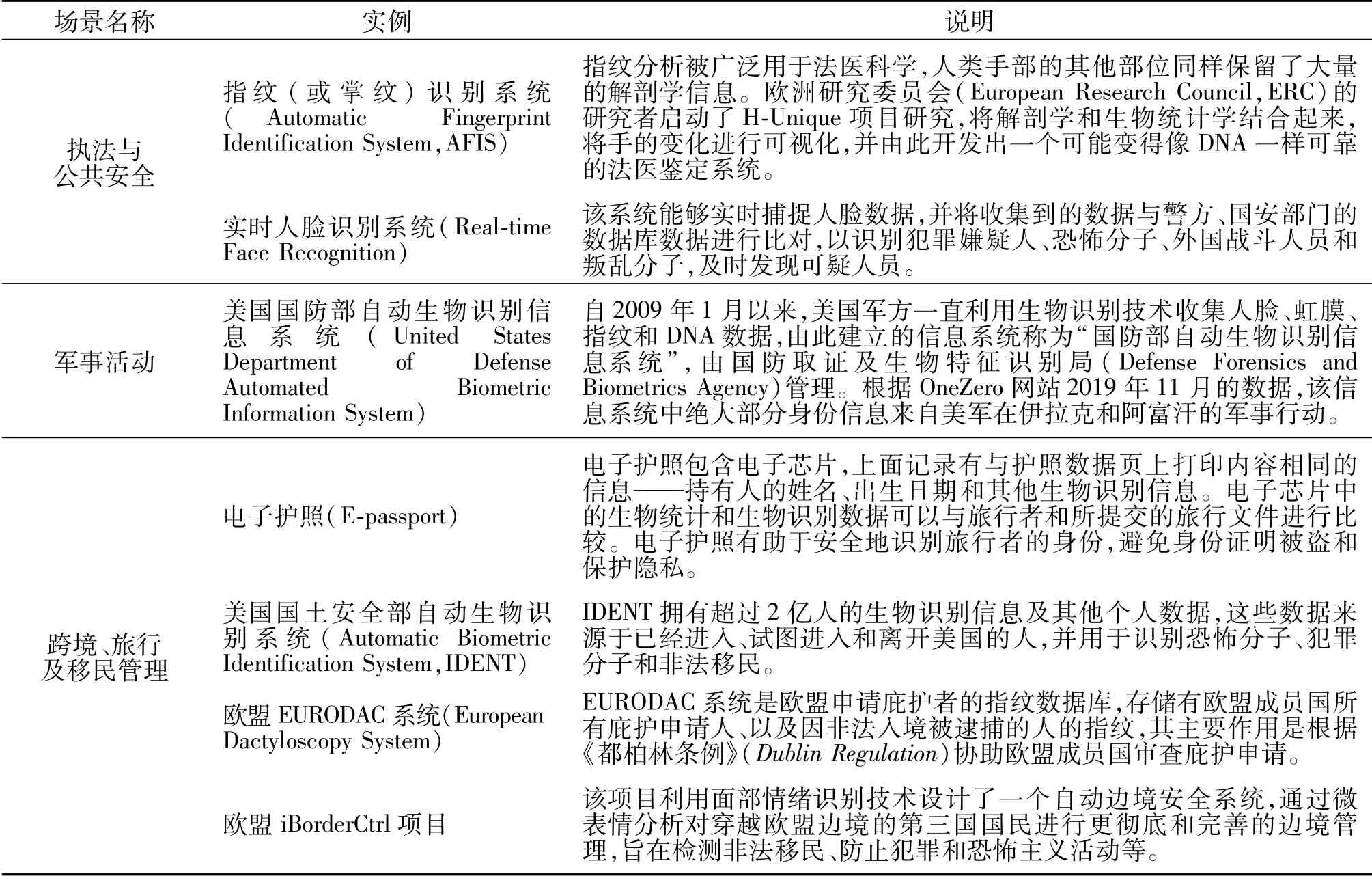

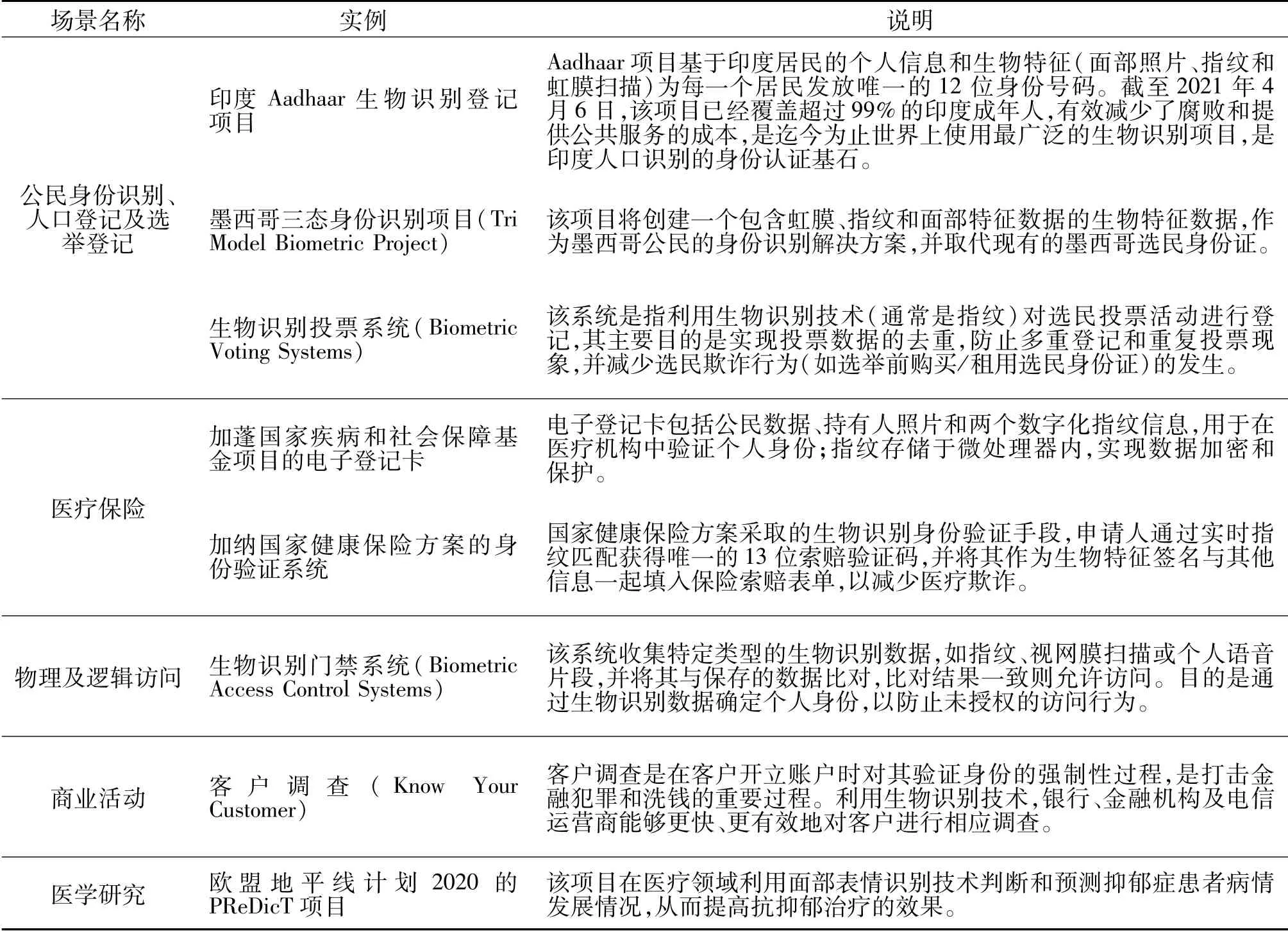

生物识别可分为人脸识别、语音识别、虹膜识别、指纹识别、静脉识别、步态识别等类别,其中最受决策者和管理者关注,且应用最为广泛的是人脸识别。概括而言,生物识别主要的应用场景如表1所示。

表1 生物识别的应用场景Tab.1 Scenarios of Biometric Technology Application

(续表1)

1.2 生物识别技术带来的困境

当前,生物识别技术正飞速发展。例如,判断用户情绪状态的情绪识别技术以生物传感器技术为基础,有助于有效监控情绪,并及时捕捉、反馈,提升决策效率,在零售行业、电子商务行业、教育、医疗和国防领域都得到广泛应用[3]。多模态混合生物识别技术也备受重视,其原理是通过融合各种行为和/或身体特征来识别一个人,或者通过融合几个单模态生物识别系统来进行识别,这一技术大大提升了生物识别技术的灵活性,有助于根据不同的场景和需求设置有效的融合方式和权重决策[4]。此外,非接触式生物识别技术逐渐兴起,其中人脸识别技术已经日臻成熟,普遍应用于考勤、门禁、银行等场景中;静脉识别技术主要应用于一些中小场景,如获取手指、手掌、手背静脉的图像等;虹膜识别因其唯一性、防伪性、便于信号处理等特征,偏重于安保和有高度保密需求的应用场景[5]。

利用生物识别技术进行用户身份识别和验证具有高效便捷的特征,随着人工智能的发展,算法也越来越精确。据美国国家标准与技术研究 院(National Institute of Standards and Technology,NIST)2020年的测试情况显示,使用最佳算法实施的面部识别失败率仅有0.08%[6]。然而,这也引起了有关各方对生物识别数据收集、管理、使用的担忧,尤其使用生物识别所导致得个人信息泄露更是引起各方对生物识别使用正当性的争论。

身份识别和认证是一个统计学过程,生物识别信息录入和获取时的条件变化会导致生物特征指标达不到100%匹配。此外,算法存在的歧视问题导致出现错误的识别结果,算法存在的“对抗样本”漏洞也使人脸识别有被破解的可能。生物特征数据的收集和存储是一个敏感问题,由于生物特征标识的唯一性和不可改变性,任何生物特征数据存储系统的漏洞都可能导致严重的后果,用户可能永远失去他们的生物特征身份。各国尚未准备好利用现有技术和工具保护迅速增长的生物识别数据,而且随着技术的发展,生物识别也面临更多的问题。

技术发展带来的问题与生物识别技术广泛使用的叠加引发了安全方面的担忧。生物识别信息作为一种数据,本身具有唯一性和不可变性,不像传统密码可以通过定期更换来减小风险[7]。以人脸识别为例,通过对人脸特征、表情等进行分析,甚至可以推测出识别对象生物信息外的内心感受,不仅关乎个人隐私,也涉及个人的尊严,一旦泄露可能造成无法挽回的后果。因此,生物识别数据的重要性与技术困境为制定专门针对生物识别数据隐私和安全的法律提出了要求。

2 主要国际组织的生物识别技术规范

国际组织一直关注智能技术发展为个人隐私带来的安全问题,囿于国际组织作用的局限性,相关的国际组织主要从原则性规范入手,在“国际软法”层面对宏观的智能技术运用进行规范。

2.1 OECD与G20人工智能规则

经济合作与发展组织(Organization for Economic Co-operation and Development,OECD)早在1980年就发布了《关于隐私保护和个人数据跨境流通的指导方针》(Guidelines on the Protection of Privacy and Transborder Flows of Personal Data),该指导方针是全球首个关于个人数据保护和流通的政策性标准文件。文件将“个人数据”定义为“与确定的或可识别的个人(数据主体)有关的任何信息”,提出:数据收集应当在合法、公平及获得数据主体知情或同意的前提下进行;应在不迟于收集数据时向数据主体说明收集目的,随后的使用也应限于这些目的或与这些目的不抵触的其他目的;保持数据完整、准确和及时更新;除数据主体同意或法律授权,个人数据不得被披露、提供或用于其他目的;个人数据应得到合理的安全保护,以防数据丢失或未经授权的访问、破坏、使用、修改或披露[8]。

2019年5月22日,OECD发布了《关于人工智能的政策建议》(Recommendation of the Council on Artificial Intelligence,简称《建议》)。该建议是各国政府在人工智能领域的首个原则性共同标准,明确了隐私、数字安全风险管理、负责任的商业行为等方面内容,旨在促进人工智能监管的科学有效,同时确保人权和民主价值观得到尊重[9]。《建议》提出关于人工智能的五条原则,即“利益相关者应积极参与对值得信赖的人工智能的负责任管理,从而推动包容性增长、可持续发展及人类福祉”“以尊重法治、人权、民主价值观和多样性的方式设计系统,并纳入适当的保障措施(如人为干预),从而确保社会公平公正”“保证人工智能系统的透明度和信息披露可靠性”“人工智能系统在其全生命周期应以稳健、安全和可靠方式运行,并对潜在风险进行评估和管理”“开发、部署或操作人工智能系统的组织和个人应根据上述原则对系统的正常运作负责”[10]。

2019年6月9日,二十国集团(G20)在贸易和数字部长会议表决通过了《关于贸易和数字经济的声明》,并在该声明的附件部分提出了相应的人工智能原则。总体上说,G20采纳了OECD《关于人工智能的政策建议》中的原则,强调:加强人工智能管理以促进包容性增长、可持续发展及人类福祉;以人为本的价值观及公平性;透明度和可解释性;稳健性、安全性和保障性,以及问责制[11]。

2.2 UNESCO人工智能规则

在OECD/G20人工智能治理框架外,联合国教科文组织(United Nations Educational,Scientific and Cultural Organization,UNESCO)于2021年11月41届大会上通过了《人工智能伦理问题建议书》(The Recommendation on The Ethics of Artificial Intelligence,简称《建议书》),旨在为各国制定人工智能相关立法、政策提供自由、人权、尊严等价值观,公平与非歧视等原则和影响评估等行动框架指导,确保相关行为者的活动都合乎道德规范,促进对人类尊严和性别平等的尊重,推动人工智能伦理方面的交流和对话,从而实现本领域的蓬勃发展和利益共享[12]。

《建议书》强调,人工智能系统设计和使用应当尊重、保护和促进人权和基本自由,有利于环境保护和生态繁荣,促进社会多样性和包容性,实现人类生活的和谐安宁。同时,人工智能应遵循安全性、公平性、永续性、可靠性、可解释性、由人类监管和控制、注重隐私、公开透明等原则。

2.3 欧洲委员会“108约+”规则

欧洲委员会(Council of Europe)2018年出台的《关于个人数据自动处理过程中的个人保护公约》(Convention for the Protection of Individuals with Regard to Automatic Processing of Personal Data,也称《第108号公约+》)是对1981年《第108号公约》的更新和升级[13]。它明确强调数据保护的目标是保障人的尊严、保护人权和基本自由,提到“个人对其数据及相关处理过程的控制”属于个人自主权。

《第108号公约+》沿用了OECD对“个人数据”的定义,并提出了保护个人数据的基本原则,涉及数据处理、数据安全、特殊数据类别、处理过程的透明度、数据主体权利等方面,其中明确提出,对于“能够确定个人身份的生物识别数据”,只有在法律规定了恰当保障措施对本公约做出补充的情况下,才允许使用,避免这类有关个人身体、生物或生理特征的敏感数据在处理过程中给数据主体的权利、利益和基本自由造成威胁。2021年1月28日,欧洲委员会《第108号公约+》咨询委员会发布了《人脸识别指南》,要求使用人脸识别技术的实体应当确保技术使用的公平性,透明性和准确性,以及遵守目的限制、数据最小化等原则[14]。

3 主要国家/地区的生物识别技术治理模式

欧盟、美国、日韩、中国等主要国家/地区基于生物识别技术提出了自己的治理方案,总体而言欧盟的方案更加严苛,美国强调实用主义,日韩等国根据各自情况制定政策,中国力图在管与用之间构建平衡。

3.1 欧盟构建严苛的治理体系

20世纪70年代以来,欧盟委员会就致力于推动数据保护标准的建立和完善。欧盟对生物识别数据的管理建立在尊重人权及其他基本权利的基础上,《通用数据保护条例》中确立了“严格必要”与“最小损害”原则,最新的《人工智能法案(草案)》则对生物识别进行更加严格的规制。

3.1.1 《欧盟基本权利宪章》确立基本原则

《欧盟基本权利宪章》(Charter of Fundamental Rights of the European Union,简称《宪章》)是对1950年《欧洲保护人权和基本自由公约》的补充完善,强调欧盟所秉承的普世价值观——人类尊严、自由、平等、团结、公民权利和正义,并将保障范围扩展至公民权利和社会权利之外,包括数据保护权利、保证生物伦理及透明政府,它对每个欧盟成员国都有法律约束力[15]。宪章第八条专门提到个人数据保护,规定人人有权保护与其有关的个人数据,包括生物识别数据在内的个人数据处理必须基于特定目的、经相关人员同意或符合法律规定。此外,任何人都有权获取和访问与其相关的数据,并有权要求对(错误)数据做出修改。

3.1.2 《通用数据保护条例》加强个人信息保护

欧盟《通用数据保护条例》(General Data Protection Regulation,GDPR)于2018年5月正式施行,GDPR对欧盟28个国家的数据保护法案进行标准化,并在控制和处理个人身份信息(Personally Identifiable Information,PII)方面采取了更加严格的新规则。此外,GDPR还通过将个人数据控制权交还欧盟民众的方式,实现了对个人数据保护及数据保护权利的拓展[16]。GDPR取代了1995年的欧盟《数据保护指令》(Data Protection Directive)成为欧盟诸国数据管理方面的新标准[17]。GDPR将敏感的个人数据纳入个人身份信息的范畴中,规定生物识别数据是指“与自然人的身体、生理或行为特征相关,由特定技术处理产生的,能够确认该自然人独特身份的数据”;并强调“生物识别数据的收集必须经过当事人预先明确同意,且当事人有权在任何时候撤回其同意,数据的收集和使用必须有清晰、合法的目的,特殊使用情况下需保证对数据主体最小程度的损害”[18]。

3.1.3 《人工智能法案(草案)》明确监管措施

2020年2月19日,欧盟发布《人工智能白皮书——追求卓越与信任的欧洲方案》(White Paper on Artificial Intelligence-A European Approach to Excellence and Trust,简 称《白 皮书》),作为应对人工智能挑战的一系列措施的核心,以新的数字战略捍卫技术主权和数字主权[19]。

《白皮书》指出了GDPR在生物识别方面的局限性,即生物识别技术并非只是为了识别个人身份,还有可能用来评估个人行为或情绪。为弥补GDPR的不足,《白皮书》将生物识别列为本质上具有高风险的应用,侵犯了个人隐私权、免受歧视权和自由,并明确要求,任何生物识别应用必须有科学证明的效果、在受控环境和严格条件下进行,禁止广泛使用人工智能驱动的生物识别技术对人类、人类行为或情绪进行监视、跟踪、评估、分类。

在《白皮书》的基础上,2021年4月欧盟委员会发布了名为《制定关于人工智能的统一规则,并修订某些欧盟立法法》(Laying Down Harmonised Rules on Artificial Intelligence(Artificial Intelligence Act)And Amending Certain Union Legislative Acts)的草案(又称《人工智能法案(草案)》),对人工智能的定义、风险类别及应用场景、被完全禁止的人工智能应用情况做出规定,旨在解决人工智能应用过程中对人类社会造成的风险问题。欧盟《人工智能法案(草案)》将人工智能系统划分为4个风险等级,分别为不可接受的风险、高风险、有限风险以及低风险。1)不可接受的风险是指该人工智能系统会实质操控个人,给个人造成不利身心伤害,该风险的人工智能系统属于禁用系列;2)高风险是指该系统用于自然人的生物识别、基础设施管理运营等,对于该人工智能系统应建立全生命周期的风险控制系统,第三方准入前需进行合规评估;3)有限风险是指使用该人工智能系统可能会导致误导后果,对于该人工智能系统需符合透明度要求;4)低风险包括了绝大多数人工智能系统,欧盟鼓励其符合人工智能合理应用原则[20]。

针对生物识别数据,该草案要求“基于此类数据监测情感或划分社会类别的系统”应符合相应的信息透明度要求。草案还将实时远程生物识别系统界定为“通过将某人的生物识别数据与参考数据库中的生物识别数据进行比较,在事先不知道目标人物是否会出现及是否能被识别的情况下,用于远距离识别自然人的人工智能系统,该系统与所使用的技术、程序或生物识别数据类型无关”,并对其在执法过程中的某些应用提出了具体的限制和保障措施;特别强调,除非有某些例外情况(如有针对性地寻找潜在受害者,防止人的生命安全受到威胁或阻止恐怖袭击,侦查、定位、识别或起诉犯罪嫌疑人等),禁止在公共场所为执法目的使用实时远程生物识别系统。

3.2 美国采取实用主义自下而上开启立法进程

在生物识别技术运用上,美国强调实用主义,因此目前美国并没有统一、全面的联邦法律监管生物识别数据。不过,越来越多的州开始关注生物识别数据涉及的隐私问题,出于对生物识别数据的收集、保存和使用等过程进行管理和控制,强调对公民隐私和自由的保护等目的,美国开启了自下而上的立法进程。

3.2.1 联邦层面进行立法尝试

联邦层面虽然暂未有统一的立法,但是国会针对人脸识别等生物识别技术已提起相关的法案,进行了立法尝试,主要包括《道德使用人脸识别法案》《商业面部识别隐私法案》《国家生物识别信息隐私法案》等几项法案。《道德使用人脸识别法案》对人脸识别技术的使用进行限制,规定在颁布人脸识别技术使用指南前,政府机构不得安装相关的设备,不得访问或使用通过该技术获得的个人信息等,同时法案也规定了救济条款,个人认为政府违反规定的,可以向地方法院提起民事诉讼。《商业面部识别隐私法案》规定在使用面部识别数据时需提前通知用户,明确了用户的知情同意权利,同时在保护用户方面,规定面部识别技术还需要通过第三方测试后才能进入市场。《国家生物识别信息隐私法案》强调用户的知情同意授权,将企业未经许可收集、购买或交易从客户那里获得生物识别信息的行为视为非法,并且在采集用户面部图像、声纹等生物识别信息前需征得用户同意。

3.2.2 各州立法推动治理探索

在州层面,伊利诺伊州、德克萨斯州、加利福尼亚州、佛罗里达州等都出台了有关生物识别的立法,其中最有代表性的是伊利诺伊州与佛罗里达州的立法。

2008年,伊利诺伊州通过了美国第一个生物识别隐私特别法案——《生物信息隐私法案》(Illinois Biometric Information Privacy Act,BIPA),该法案成为其他各州制定相关法律的基准。BIPA因涉及的行为数量和种类众多,涵盖收集、交易、使用/处理、维护、存储、破坏任何基于个人生物标识的信息(包括视网膜或虹膜扫描、指纹、声纹、手部扫描、面部图片、DNA等)等行为,成为美国最严格的生物识别隐私法案之一。根据BIPA规定,处理生物识别数据的企业在收集此类数据前必须获得用户的知情同意并限制此类数据的对外披露,同时需为此类数据提供存储保护,规范了企业处理生物识别数据的方式。BIPA为受到侵害的个人提供了一项私人诉讼权利,允许他们获赔1000美元(过失侵权)或5000美元(故意侵权),或实际损害金额(以数额较大者为准),同时可以获得律师费、诉讼成本以及禁令救济。

2019年,佛罗里达州出台了《佛罗里达州生物信息隐私法案》(Florida Biometric Information Privacy Act,FBIP),意在对私人实体在生物识别标识和生物识别信息的使用、收集和维护方面做出要求和限制。FBIP将“生物识别标识”定义为“视网膜或虹膜扫描、指纹、声纹或手、脸的几何形状扫描”,将“生物识别信息”定义为“基于生物识别标识确定个人身份的任何信息,无论其获取、转换、存储或共享方式如何”[21]。根据FBIP规定,私人实体在征询消费者同意时,需告知收集生物识别信息的原因及用途,还需要向公众提供相关信息保存和处理的政策。私人实体不得利用生物识别信息获利,也不得出售、租赁或交易此类信息。

2020年1月1日起实施的《加州消费者隐私法 案》(The California Consumer Privacy Act,CCPA)是生物识别立法迈出的重要一步,被视为未来联邦相关法律框架的潜在模型。CCPA加强了对加州居民隐私权和消费者权益的数据保护,涉及权利包括获取数据、删除数据、移植数据、要求企业不出售其个人信息、选择退出、诉讼权等。同年11月,加州通过了《加州隐私权利法案》(The California Privacy Rights Act,CPRA),CPRA对CCPA进行了补充和修正,并特别创建了一个新的个人信息类别——敏感个人信息,生物识别数据以及种族、民族、性取向、宗教信仰和地理位置或社会安全号码等,都包括在这个新类别中[22]。

此外,德克萨斯州通过了自己的《生物识别隐私法案》(Tex.Bus.&Com.Code§503.001),其中明确规定,(相关行为体)未经事先同意不得随意捕捉、获取、出售生物识别数据,必须谨慎存储、传输和保护数据,并在合理时间内妥善销毁。如果雇主出于安全目的收集雇员的生物识别信息,那么这些信息的保留时间不应超过雇佣关系终止时间。尽管该法案对每项违法行为处以25000美元的高额民事罚款,但与BIPA不同,它没有赋予私人诉讼权。

除上述各州,亚利桑那州、马里兰州、新罕布什尔州、南卡罗来纳州和西弗吉尼亚州也都曾尝试提出物识别法案,但未能成功通过。爱达荷州、南达科他州和路易斯安那州等其他一些州,提出了具体的人脸识别立法,但没有提出更加全面的生物识别立法。此外,包括罗德岛州、弗吉尼亚州和威斯康星州在内的其他州在更广泛的数据隐私法规中加入了生物识别内容,但也没有出台完善的生物识别立法。

3.3 日韩等国根据各自情况制定治理政策

3.3.1 日本明确个人信息处理者义务

日本于2003年出台了《个人信息保护法》(The Act on the Protection of Personal Information,APPI),2015年对该法案进行大幅修订(2017年5月30日生效),2020年该法案又做出实质性修订,新修正案于2022年4月1日正式生效。2020年修正案对中央及地方政府责任、个人信息保护措施、个人信息处理业务经营者义务等内容进行了明确规定,还提及“需要特别注意的个人信息”(包括个人种族、信仰、社会地位、病史、犯罪记录等),但并未对生物识别信息的监管和保护提出具体要求[23]。

APPI及其后的修正案可以被视为日本个人信息保护的顶层法律。此外,包括日本国家行政机关、独立法人在内的不同行为体制定了相应的个人保护法律,这些法律面向不同领域、适用于不同法律关系,构成了灵活而缜密的制度体系。

3.3.2 韩国构建隐私保护体系

韩国的个人数据保护法由作为一般法律的《个人信息保护法》和若干具体部门的特别法律组成,包括《促进信息和通信网络利用和信息保护法》《信用信息使用和保护法》等。

《个人信息保护法》(Personal Information Protection Act,PIPA)于2011年9月通过,2020年2月进行修订,其目的是保护数据主体的隐私权。PIPA明确了与个人信息有关的定义、处理个人信息的原则、数据主体的权利、政府责任等内容。它是世界上最严格的数据隐私法之一,对处理个人数据的整个生命周期涉及的活动都规定了非常规范和具体的要求。另外,PIPA特别对“敏感信息”(包括意识形态、信仰、加入或退出工会或政党、政治观点、健康状况等)、“个人身份信息”(即用于识别个人身份的任何信息)、“居民登记号码”的处理和保护做了规定;针对采集生物识别数据的可视数据处理装置,PIPA也对其安装和操作进行了限制。但是,法案并没有对生物识别数据进行明确界定,也没有专门针对此类数据处理和保护的条款[24]。PIPA与GDPR有着类似的执行标准,但不同的是,PIPA不要求数据主体的明确书面同意。

3.4 中国构建“管”与“用”之间的平衡

虽然目前我国尚无专门的生物识别立法,但在个人信息保护方面已经制定相关标准并形成体系,软硬法并行,强调“管”“用”平衡。我国最初采取了类似美国的做法,但随着对个人信息及生物识别数据的日益重视,我国开始在许多法律条文方面趋向于更加严格的欧盟规则[25]。

3.4.1 国家层面完成个人信息保护顶层建设

在个人信息保护方面,《民法典》第1033-1037条对个人信息的保护进行了详细的规定,强调自然人的个人信息受法律保护,收集信息需以知情同意为前提,同时明确处理个人信息的,应当遵循合法、正当、必要原则,不得过度处理。2017年6月1日施行的《中华人民共和国网络安全法》为个人信息(包括生物识别数据)安全保护提供了参考,第四章规定网络运营者应当对其收集的用户信息严格保密,并建立健全用户信息保护制度,围绕个人信息保护确立了原则与自然人的人格权益[26]。2021年6月11日,《中华人民共和国数据安全法》正式通过,并于2021年9月1日起实施[27]。《中华人民共和国数据安全法》对数据安全与发展、数据安全制度、数据安全保护义务等做出规定,其中提到开展数据活动的原则:有利于经济社会发展、增进人民福祉、符合社会公德伦理;加强风险监测和实施定期风险评估;以合法、正当方式获取数据;数据收集和使用不得超过必要限度等。此外,《中华人民共和国个人信息保护法》对处理包括人脸等个人生物特征在内的敏感个人信息作出专门规定,要求只有在具有特定目的和充分必要性的前提下,方可处理敏感个人信息,并在事前进行风险评估[28]。

除特定立法外,生物识别等标准的制定也迈上进程,《生物特征识别信息的保护要求(征求意见稿)》于2019年6月正式向社会征求意见,《信息安全技术远程人脸识别系统技术要求》也于2020年11月1日正式实施。标准的制定提供了生物识别的“软法”支撑,为构建我国基于生物识别技术的个人信息保护提供了相应的参考。

3.4.2 地方政府立法细化保护规则

在地方政府层面,关于生物识别技术的规制,最有代表性的是深圳制定的《深圳经济特区数据条例》,该条例于2021年6月29日通过,并于2022年1月1日起施行[29]。《深圳经济特区数据条例》首先明确了对生物识别数据的定义,指出生物识别数据是包括自然人的基因、指纹、声纹、掌纹、耳廓、虹膜、面部识别特征等数据。该条例除规定处理的知情同意于严格必要原则外,为了避免生物识别数据的滥用,还规定数据处理者应“提供处理其他非生物识别数据的替代方案”,从归集源头上进一步保障个人信息的安全。2021年7月14日,深圳市人大常委会发布《深圳经济特区人工智能产业促进条例(草案)》向社会公开征询意见[30]。该草案规定数据流通情况下,需对合法获得的个人数据进行匿名化或者去标识化等处理并禁止侵犯个人隐私和个人信息保护或危害国家、社会公共安全或人身安全等行为。

此外,《浙江省公共数据条例》于2022年3月1日起施行。该条例将公共数据分为无条件共享、受限共享和不共享数据三类,对个人信息采集问题进行了明确的规定,特别强调,公共管理和服务机构收集数据时,不得强制要求个人采用多种方式重复验证或特定方式验证。针对生物识别信息,条例要求“已经通过有效身份证件验明身份的,不得强制通过收集指纹、虹膜、人脸等生物识别信息重复验证”[31]。

4 启示与建议

4.1 完善我国个人信息收集授权同意机制

以人脸识别为例,由于人脸识别的技术特性,人脸识别不需要被识别对象直接接触识别设备,在利用摄像头识别人脸信息时,即使距离较远也可以实现[32]。在实际操作中,虽有例外,但大部分生物识别的应用难以实现授权同意的前提。在公共场所采取大范围的生物识别,范围内所有人便无法选择不被监测和识别这有悖自愿性,以目前的法律框架难以解决相关问题。

因此,除法定例外以外,为了进一步保障信息收集时个人的知情权,应完善授权同意机制。首先,在具体操作中视情况应规定收集者、使用者的事前信息披露义务并严格应用程序。没有收集者、使用者的信息披露义务的规定,就难以真正保障和实现个人同意权[33],在严格应用程序方面,可参考美国《商业面部识别隐私法案》,其规定面部识别技术还需要通过第三方测试后才能进入市场。其次,根据场景采用欧盟GDPR中所遵循的选择进入(opt-in)机制,确保个人的知情同意并授权,将数据处理权的初始决策交由个人来决定。

4.2 对生物识别技术分应用场景进行管制

生物识别的应用场景包括执法与公共安全、军事活动、跨境、旅行及移民管理、公民身份识别、人口登记及选举登记、医疗保险、物理及逻辑访问、商业活动。生物识别的使用主要基于两个大的目的,一是出于公共目的使用,二是出于非公共目的使用。概括起来,出于公共目的的使用包括:一是涉及国家公共安全层面的,如犯罪侦查;二是政府职能层面的,如电子政务等。出于非公共目的的使用则包括:一是社会和个人层面的,如考勤管理、门禁系统;二是商业层面的,如电子支付。

在现实生活中,公共目的与非公共目的的界限经常出现混淆,出于非公共目的生物识别技术存在滥用现象,需对不同场景的应用进行清楚定义与差异性管制。因此可参考GDPR与《人工智能法案(草案)》等做法,首先在律法上对公共目的与非公共目的的场景进行清楚界定,其次对出于公共目的使用则继续坚持严格必要与最小损害原则,对于非公共目的的使用如小区、商店的门禁系统等可参考《佛罗里达州生物信息隐私法案》进行严格规定,在必要情况下可对其进行禁用。

4.3 对生物识别技术进行分级监管

为了防止个人信息泄露,保护个人信息安全,针对不同等级的生物识别技术采取不同程度的监管措施与要求。欧盟《人工智能法案(草案)》将人工智能系统划分为4个风险等级,并根据不同等级提出相应的法律义务要求。因此对于我国的生物识别技术,可参考欧盟对于人工智能系统的风险等级划分,按照不同级别的生物识别技术造成的影响,规定不同级别的法律义务要求,进一步保护个人信息的安全。