门控融合对抗网络的水下图像增强

2022-01-22林森,刘旭

林 森,刘 旭

门控融合对抗网络的水下图像增强

林 森1,刘 旭2

(1. 沈阳理工大学自动化与电气工程学院,辽宁 沈阳 110159; 2. 辽宁工程技术大学电子与信息工程学院,辽宁 葫芦岛 125105)

针对水下成像中图像存在的色彩失真、对比度低和雾化严重等问题,提出一种门控融合对抗网络的水下图像增强方法。主要特点是使用生成网络将图像特征信息逐像素恢复,并通过门控融合形成清晰图像。首先,利用多个并行子网络对同幅图像的不同空间特征信息进行学习,提升网络对图像特征学习的多样性。然后,通过门控融合,将不同子网络学习到的图像特征相融合。利用生成网络与鉴别网络进行相互博弈,反复训练网络,获得增强的水下图像。最后,在EUVP数据集和U45测试集上进行实验对比。实验结果表明,该算法的关键点匹配与原图相比平均高19个匹配点,UCIQE平均值为0.664 7,UIQM平均值为5.723 7,与其他经典及最新算法相比具有优势,效果良好。

图像处理;水下图像;生成对抗网络;多尺度输入;门控融合

随着深海资源的开发与保护,各领域对高质量水下图像的需求逐年增加。由于自然光在海水中发生散射,致使水下图像具有色偏和细节缺失等问题[1],对海洋资源信息的传递和展示带来了困难。因此,在海洋探索与开发等领域,水下图像增强算法具有重要的研究意义。

最近几年,深度学习技术在水下图像增强方面取得进展。其中多分支的设计结构得到了广泛地应用,WANG等[2]提出双分支的网络模型,对图像分别进行颜色校正与去模糊,经融合得到增强的水下图像;LU等[3]提出了多尺度循环生成对抗网络(multi-scale cycle generative adversarial network,MCycleGAN),加入多尺度SSIM损失函数改善图像质量;GUO等[4]提出用于水下图像增强的多尺度密集生成对抗网络(underwater image enhancement using a multiscale dense generative adversarial network,UWGAN),利用密集连接模块提高网络鲁棒性,并通过频谱归一化来限制判别器的Lipschitz常数,加快网络收敛速度;LI等[5]构建了水下图像增强网络(underwater image enhancement network,Water-Net)来消除图像近景中的浓雾;LIU等[6]根据超分辨率重建(Ssuper-resolution reconstruction,SR)模型,提出基于残差网络的水下图像增强框架(deep residual framework,UResnet)以解决水下图像细节丢失及色偏问题。

上述基于单分支或多分支网络的水下图像增强算法虽致力于提升图像质量,但多数方法由于仅依靠单一尺度特征融合,仍存在特征提取不充分、缺少细节特征等问题。因此,本文提出一种门控融合对抗网络的水下图像增强算法(underwater image enhancement algorithm using gated fusion generative adversarial network,GF-GAN),主要贡献如下:

(1) 利用3条不同尺度的并行子网络,学习同一图像中的不同空间特征信息,进而适应多变的水下场景。

(2)将门控融合创新性地应用于水下图像处理,基于多尺度特征融合,改善图像的色度、清晰度和对比度。

(3) 生成网络并行子网络中,加入与卷积对称的反卷积结构,便于水下低质量图像恢复,同时加入跳跃连接加快网络的训练速度。

本算法可以良好地解决色偏现象,增强图像清晰度和细节特征。在数据集上的实验结果表明,本文算法与其他经典及新颖算法相比具有更好的视觉效果,可进一步应用于海洋资源开发等工程实践中。

1 基础理论

1.1 卷积-反卷积对称结构

随着人工智能,特别是深度学习技术的发展,卷积神经网络(convolutionalneural network,CNN)在计算机视觉领域[7-8]取得了良好成效。

在图像增强时,卷积层(convolutional layer,Conv)能提取水下图像的基本特征,但连续的卷积层会导致水下图像的细节特征丢失。因此,SUN等[9]引入连续的反卷积层(deconvolutional layer,Deconv)来恢复图像的细节特征,Conv和Deconv分别对输入的特征映射执行卷积和反卷积运算。每个卷积层的输出为

受文献[9]的启发,本文GF-GAN利用Conv- Deconv的对称结构,设计3个不同尺度的并行子网络作为生成网络,提取并恢复同一图像的不同特征。

1.2 生成对抗网络

生成对抗网络模型(generative adversarial networks,GAN)[10]通过学习样本数据的分布情况来生成具有对抗性的逼真数据。GAN由生成网络(generator,G)和鉴别网络(discriminator,D)组成。

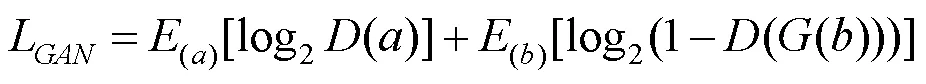

本文GF-GAN与GAN相似,通过D监督G并结合两者的相互博弈,使网络具有良好的图像增强能力,其目标函数可以表示为

其中,为分布函数期望值;为随机噪声;()为判断为真的概率;()为由随机噪声映射的生成数据;(())为()接近真实数据的概率。

2 GF-GAN水下图像增强算法

首先对本文算法的效果进行宏观展示,并给出简要的分析说明,更加直观地显示算法优势。然后,进一步详细阐述网络的具体组成和结构。

图1通过傅立叶光谱图可视化水下图像的能量分布,展示GF-GAN算法的处理结果。

在图1中,3幅原始傅里叶光谱图中布满暗点,表明其对比度和边缘清晰度较低。Water-Net算法图像中暗点数量未见明显变化,相反在GF-GAN算法处理后图像暗点减少,表明对比度和边缘清晰度较原图显著增强,视觉感受良好。

GF-GAN包括2部分:①生成网络,目的是生成水下清晰图像;②鉴别网络,用来区分生成图像和目标图像。

2.1 生成网络结构

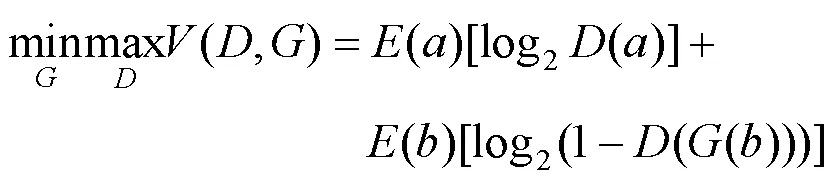

如图2所示,GF-GAN算法的生成网络由多尺度特征恢复模块(feature refine module,FRM),以及门控融合(gated fusion,GF)构成。GF-GAN生成网络结构中,FRM类似于YANG等[11]设计的特征提取模块,由3组尺度不同的并行子网络(parallel sub-network,PSn)构成。

图2 生成网络结构

PSn的编码路径和解码路径由2组连续的Conv-Deconv对称结构组成。其中,3个PSn的卷积核大小分别为7×7,5×5和3×3。GF-GAN在对称结构中间加入步长为1 (stride=1)的Conv,以稳固同一幅图像不同像素点上的空间特征信息,其余步长为2 (stride=2)的Conv与Deconv,分别完成特征提取和恢复任务。

GF-GAN在Conv与Deconv结构后加入批标准化层(BatchNorm,BN)和激活层来加快网络的收敛速度,并使用Leaky ReLU (图2中简写为LReLU)作为激活函数,增加网络的非线性。由于图像的纹理细节可能会在Deconv解码过程中丢失,GF-GAN在对称的Conv和Deconv中加入跳跃连接(skip connection),使网络具有更好的特征恢复能力。

GF-GAN通过FRM提取不同尺度的空间特征信息,有助于其后的门融合结构进行特征融合,并结合多种损失函数,获得清晰图像。

2.2 鉴别网络结构

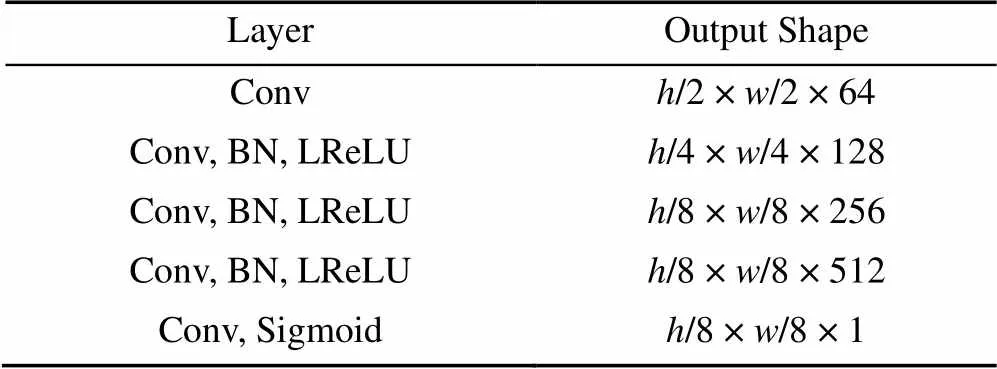

鉴别网络由5层Conv构成(表1),类似于70×70的马尔科夫鉴别器(PatchGAN)[12]。PatchGAN通过判断图像中各像素块的平均真实率来分辨图像真假,即只有当所有图像块都具有良好的细节特征且真实性较高时,才会将生成的图像视为真,因此其被广泛应用于不同任务的网络框架[13-14]中。Sigmoid函数将输出像素点的范围映射到[0,1],有利于鉴别图像在某个区域内的真假性。

表1 鉴别网络参数

2.3 门控融合

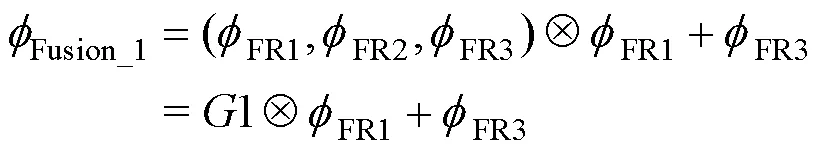

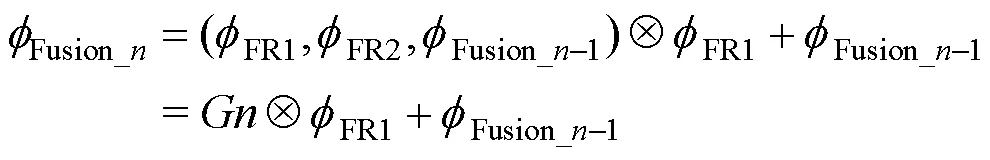

由于门模块[15](gated module,GM)在多模态融合中对重要特征提取具有显著效果,本文所采用的GF,将不同子网提取到的空间特征信息进行连接,并采用递归合并策略逐步融合特征。

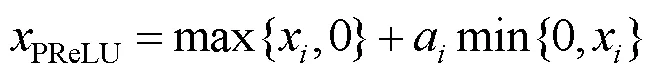

图3中门控融合模块网络由2个递归门构成,其中,每个递归门中含有一个基本门模块(basic gate block,BGB),每个BGB由一个维度连接层(concatenate layer,Concat)、2个卷积核大小为3×3的Conv、1个卷积核大小为1×1的Conv以及PReLU函数构成,PReLU函数可以表示为

其中,x为第层的正区间输入信号;a为第层负区间的权系数。当a趋于0时,PReLU在负数区间有很小的斜率,相较于ReLU在负数区间取值为0,选用PReLU可以避免ReLU梯度消失的问题。

图3 门控融合网络

Fig. 3 Gated Fusion Network

由此,本算法采用一种递归策略,利用3个独立分支的依赖性,进行多尺度特征融合。

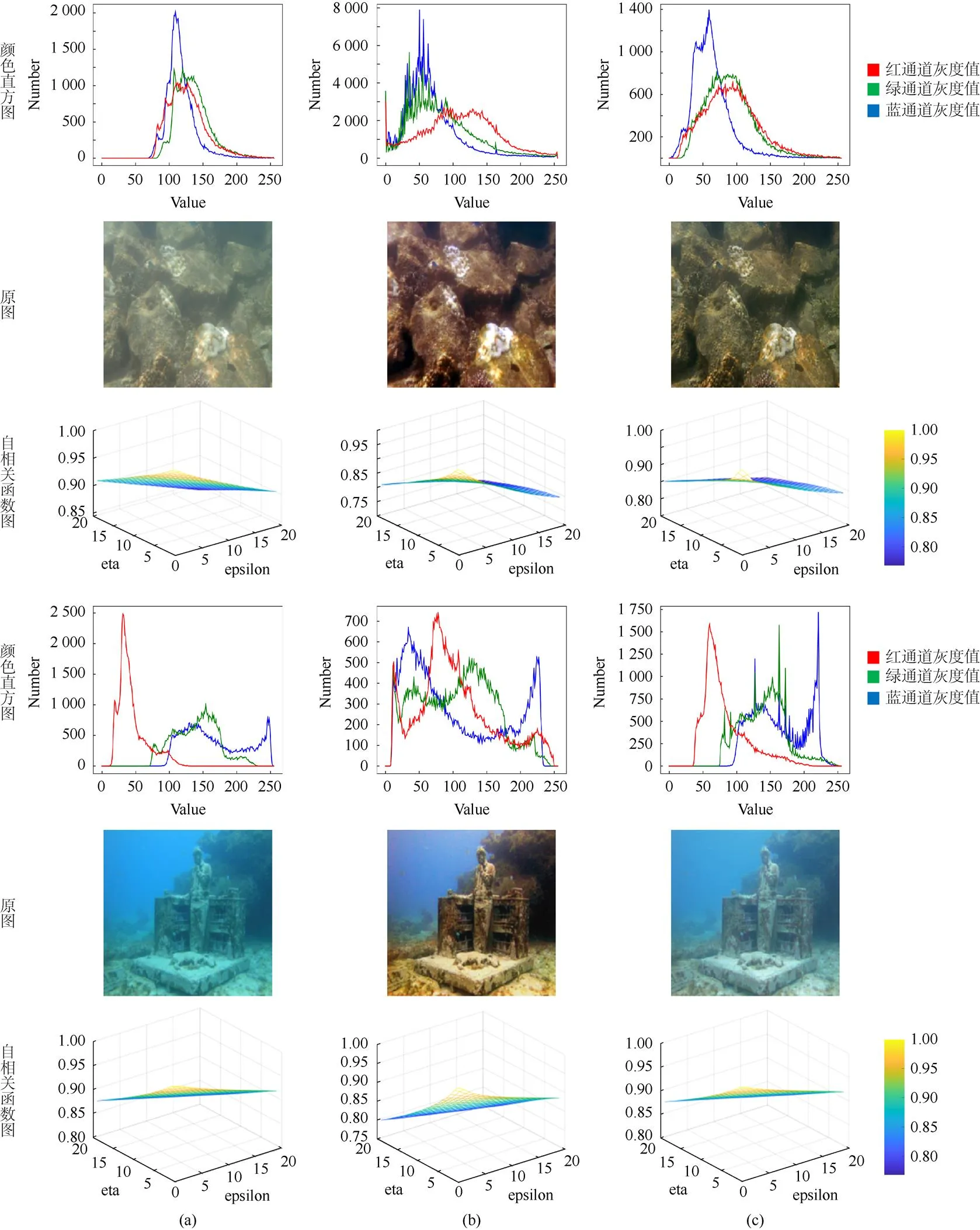

采用颜色直方图和自相关函数三维图像,对原图、GF融合方式与Concat融合方式进行对比,结果如图4所示。

在图4中,采用GF作为融合方式的图像相较于原图和Concat融合的颜色直方图灰度级有显著增强,RGB 3通道分布均匀;自相关函数三维图像空间重复周期短,纹理颗粒度较小,纹理细致且鲜明。

本文所采用的GF是一个通用的图像融合结构,优势在于不依赖任何先验知识和预处理过程,可将FRM收集到的空间特征信息进行融合,进而得到生成网络的最终图像。

2.4 损失函数

(1) 对抗损失函数。GF-GAN是基于生成对抗网络模型,对抗损失函数为

其中,为水下退化图像;为水下目标图像;为数学期望。

图4 颜色直方图和自相关函数图像对比图((a)原始图像;(b) GF融合结果;(b) Concat融合结果)

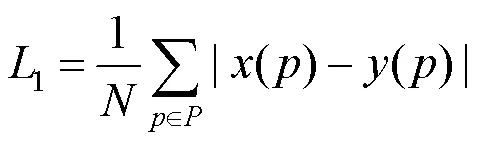

(2)1损失函数。选用1损失[12]来减少引入的伪影,即

其中,为像素;为该像素所代表的色块;()与()分别为经过处理后图像色块的像素值和真实图像色块的像素值。对抗损失函数和1联合使用可减少输出图像噪声等干扰因素。

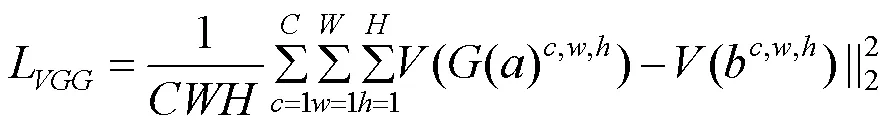

(3) 感知损失函数。利用感知损失函数[16]进行特征重建,即

其中,,,分别为图像的通道数、宽度和高度,而表示Conv4_3层(VGG-19)的非线性变换。

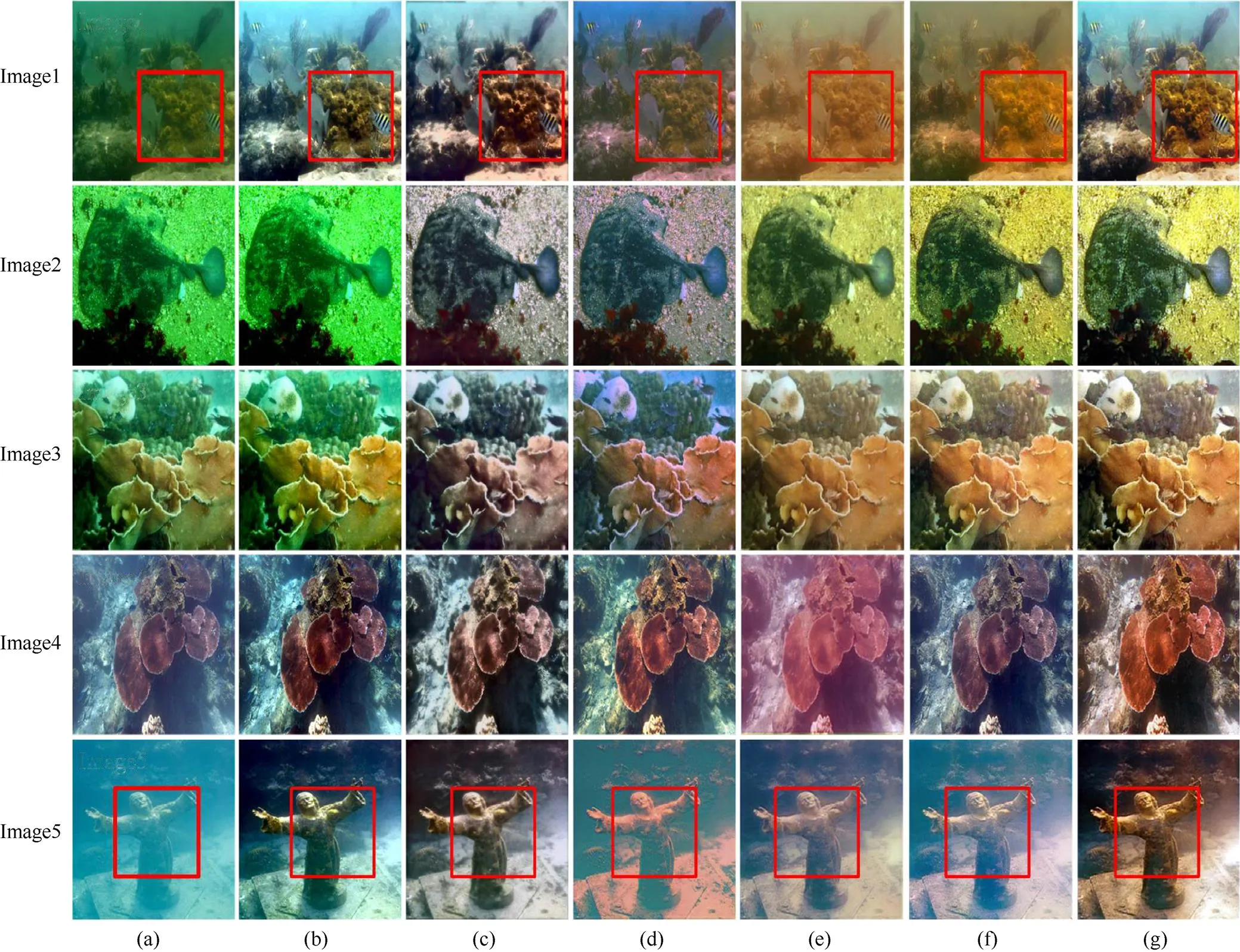

(4) 整体损失。即上述3种损失的线性组合,以加快网络参数收敛,具体为

3 实验结果与分析

为验证GF-GAN的有效性,将GF-GAN与传统算法和其他深度学习算法进行对比。借助颜色恢复实验,展示GF-GAN在消除色偏方面的作用;通过比较不同浑浊度与不同色偏程度的水下图像,体现GF-GAN在复杂环境下对图像对比度以及纹理细节增强方面的作用;利用SURF关键点匹配实验,验证GF-GAN对图像关键特征方面的增强程度。

3.1 数据集和训练方式及实验环境

使用从EUVP[17]数据集中得到的3种不同水下光照情况的underwater_dark,underwater_imagenet和underwater_scenes筛选出的5 000张配对图像,其中,80%作为GF-GAN数据集,20%作为测试集,并加入U45[18]数据集同样作为测试集,来体现本文算法的拓展性。EUVP数据集是在各种可见度条件下,在不同位置进行海洋探索和人机合作实验期间收集的具有代表性的水下数据集,包含大量已配对与不配对,且感知质量良好的水下图像。本文实验基于Ubuntu16.04系统,Tensorflow搭建的深度学习框架,硬件配置为 Intel® Core™ i7-8750H CPU @ 3.6 GHz,32.0 GB RAM,NVIDIA TITAN Xp,对比实验的硬件配置相同。

3.2 主观评价与分析

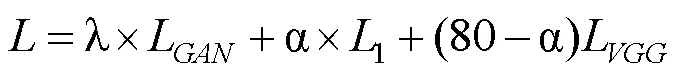

首先基于色卡恢复实验来验证GF-GAN在消除色偏与对比度提升方面的有效性。实验结果如图5所示。

在图5中,将本文算法与自适应参数的颜色直方图拉伸(relative global histogram stretching,RGHS)算法[19]、去雾网络与方向滤波器(DehazeNet & HWD)算法[20]、Water-Net算法[5]以及UResnet算法[6]和可改善视觉感知的快速水下增强(fast enhancement for improved visual perception,FunIE)算法[17]进行分析比较。

图5 色卡恢复实验((a)原始图像;(b) RGHS[19];(c) DehazeNet&HWD[20];(d) Water-Net[5];(e) UResnet[6];(f) FunIE[17];(g) GF-GAN;(h)标准色卡)

从图5中观察可得,DehazeNet&HWD算法色卡色块偏差较大,蓝色、紫色等色块对比度低,色卡整体颜色失衡。Water-Net算法色卡整体偏红,相邻色系区分度较低,尤其是红色、淡黄色和橙色等暖色块,颜色校正的整体效果较差。UResnet算法整体较为清晰,但土黄色与绿色块对比度较低,难以区分。FUnIE算法色卡颜色较为准确,但整体颜色偏暗,且图像对比度没有明显提升。本文提出的GF-GAN与传统的RGHS算法色卡图像相比颜色鲜明,且黄色与浅绿色、蓝色与紫色等同色系颜色对比度增强,结果图像颜色与真实色卡接近,但GF-GAN相比RGHS算法对于图像的对比度的提升更为明显。

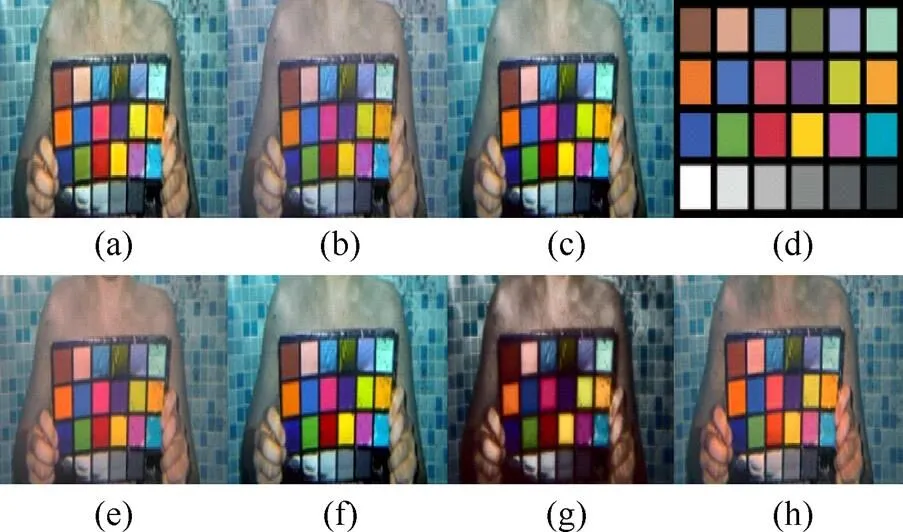

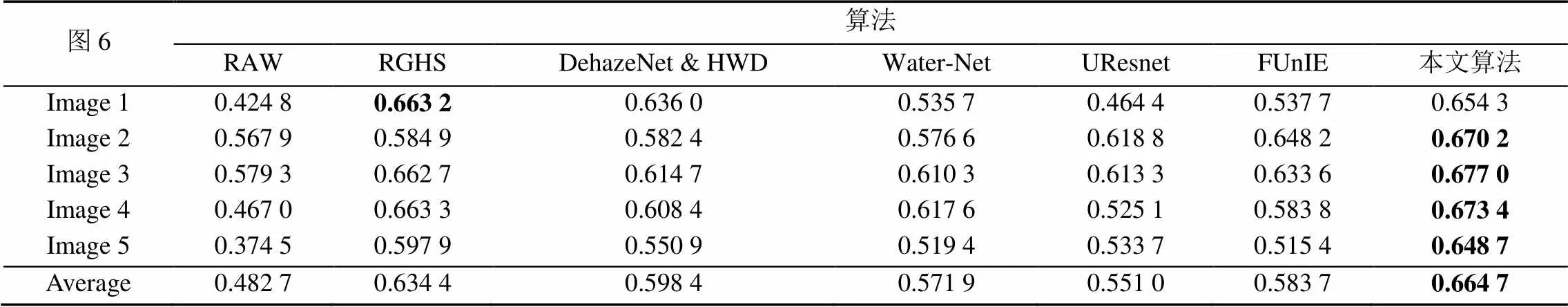

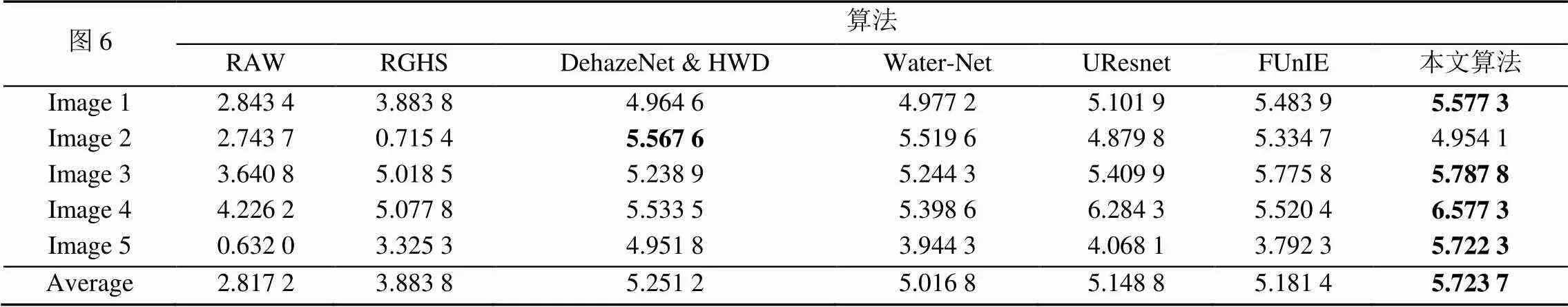

为验证GF-GAN在复杂环境下对图像的对比度以及纹理细节增强方面的作用,对5幅具有代表性的不同浑浊度与不同色偏程度的水下图像进行实验,如图6所示。

从图6可以看出,DehazeNet & HWD算法可以有效地解决色偏问题,如Image2和Image5,由于过度曝光及颜色补偿,导致处理后的水下图像普遍呈灰白色,且亮度较暗,但大部分纹理细节仍较为明显。在Image1中,UResnet算法以及FUnIE算法对于图像的雾化问题基本无效,且得到的图像有严重的色偏、色差等颜色问题,得到的图像清晰度也比较低,不利于分析观测。在Image2中,RGHS算法对绿色色偏没有任何改善,而DehazeNet & HWD算法和Water-Net算法未正确恢复沙土的颜色,且得到的图像亮度偏暗,在Image3中同样如此。在Image4中,RGHS算法和Water-Net算法有浅绿色伪影,DehazeNet & HWD和FUnIE算法有浅蓝色伪影,UResnet算法处理过的图像整体偏红。在Image5中,RGHS算法,DehazeNet & HWD算法和GF-GAN算法能恢复出红框中雕像躯体的纹理细节,并且对比度有显著拉伸。相比之下,GF-GAN算法在对于图像的色偏和色差、雾化、图像纹理细节和对比度等方面,有显著改善,且符合视觉效果。在Image1的红色边框中发现,GF-GAN算法对近景区域的图像细节以及亮度有明显增强。Image4中GF-GAN算法对于图像整体亮度有明显增强,且图像整体纹理细节,相比UResnet算法,FUnIE算法更加清晰,对比度更强。相比之下,GF-GAN算法增强后的图像更加鲜明和纹理细节特征更突出。

图6 对比实验

3.3 客观评价与分析

通过水下图像质量评价综合指标(underwater color image quality evaluation,UCIQE)[21]、水下图像质量测量指标(underwater image quality measures,UIQM)[22]和加速鲁棒特征(speeded up robust features,SURF)[23]对图像质量进行客观测评。

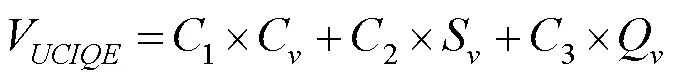

UCIQE利用CIELab空间的色度、饱和度与清晰度进行线性加权组合,来测评水下图像质量的好坏程度。UCIQE值范围为[0,1],其值越大表示水下彩色图像质量越好,即

其中,1,2,3为加权系数,分别为色调方差、饱和度方差、清晰度。取值为1=0.4680,2=0.2745,3=0.2576[21]。

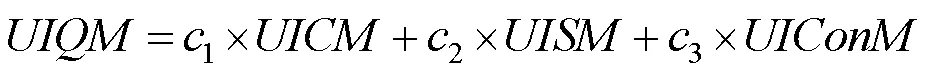

UIQM采用HVS模型,不需要参考图像,但UIQM依赖于水下图像的3种度量属性:①图像色度系数(UICM);②清晰度系数(UISM);③对比度系数(UIConM)。其表达式为

其中,1,2,3为加权系数,分别代表水下颜色校正程度、水下场景的能见度、水下图像的对比度。取值为1=0.0282,2=0.2953,3=3.5753[22]。

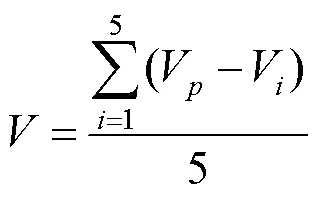

表2和表3分别为不同算法处理下,图6中5幅图像的UCIQE与UIQM值,加粗字体为最优值。通过式(12)分别计算UCIQE与UIQM测评提升均值

其中,V为GF-GAN算法测评均值;V为各个对比算法的测评均值。

由表2和表3可知,本文算法对不同水下环境皆有较高的测评值。其中,UCIQE值整体提升9.43%,UIQM值整体提升57.33%。表明GF-GAN算法能有效地消除水下图像色偏,处理后的图像色彩鲜明,视觉效果良好。

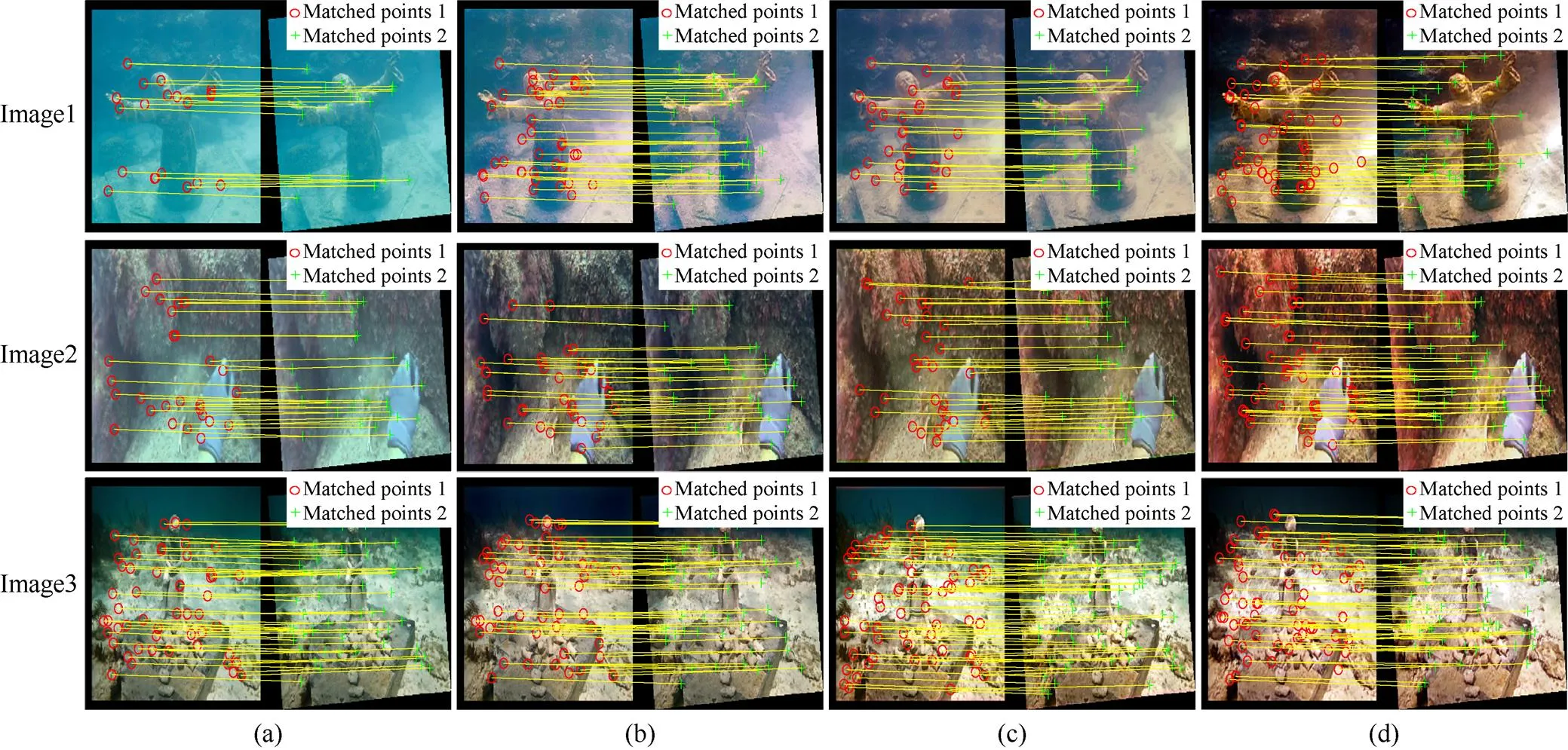

原始水下图像和增强图像的SURF关键点匹配试验图如图7所示,匹配结果见表4。

表2 UCIQE指标评测结果

表3 UIQM指标评测结果

图7 原始水下图像和增强图像SURF关键点匹配试验

表4 SURF关键点匹配结果

图像细节特征越清晰,其关键点匹配数目越多。由表4可知,经本文GF-GAN算法处理的图像,较原始图像的关键点匹配数目有显著提升,尤其在Image2中,GF-GAN较其他算法的特征匹配点数目大幅度领先。因此,证明本文算法对图像细节特征有显著改善,在后续特征匹配过程中具有明显的实用效果。

4 结 论

本文针对水下图像存在颜色失真,雾化程度高和低对比度等诸多问题,提出了多尺度门控融合生成对抗网络的水下图像增强算法。首先,通过门模块的改进模型构建了GF,自适应地学习3条子网络的不同空间特征信息。其次,利用多个不同尺度的子网络对同幅图像不同的空间特征进行学习,并将对应的输出通过GF进行融合。最后,加入感知损失函数以及1损失函数,增强图像的视觉感知效果。实验结果表明,本文GF-GAN算法的UCIQE值平均为0.664 7,UIQM值平均为5.723 7,关键点匹配比原图平均高19个匹配点,均优于其他对比算法。证明GF-GAN能恢复出更多纹理细节,具有更好的色彩表现,图像视觉信息丰富,同时能够达到良好的去浑浊效果,适用于不同类型的水下退化图像。在后续工作中,考虑将双鉴别器与此网络结构相结合,进一步提高水下退化图像增强的效率。

[1] 郭继昌, 李重仪, 郭春乐, 等. 水下图像增强和复原方法研究进展[J]. 中国图象图形学报, 2017, 22(3): 273-287.

GUO J C, LI C Y, GUO C L, et al. Research progress of underwater image enhancement and restoration methods[J]. Journal of Image and Graphics, 2017, 22(3): 273-287 (in Chinese).

[2] WANG Y, ZHANG J, CAO Y, et al. A deep CNN method for underwater image enhancement[C]//2017 IEEE International Conference on Image Processing (ICIP). New York: IEEE Press, 2017: 1382-1386.

[3] LU J Y, LI N, ZHANG S Y, et al. Multi-scale adversarial network for underwater image restoration[J]. Optics & Laser Technology, 2019, 110: 105-113.

[4] GUO Y C, LI H Y, ZHUANG P X. Underwater image enhancement using a multiscale dense generative adversarial network[J]. IEEE Journal of Oceanic Engineering, 2020, 45(3): 862-870.

[5] LI C Y, GUO C L, REN W Q, et al. An underwater image enhancement benchmark dataset and beyond[J]. IEEE Transactions on Image Processing, 2020, 29: 4376-4389.

[6] LIU P, WANG G Y, QI H, et al. Underwater image enhancement with a deep residual framework[J]. IEEE Access, 2019, 7: 94614-94629.

[7] 黎智, 徐丹. 基于卷积神经网络的蜡染染色模拟[J]. 图学学报, 2020, 41(2): 196-203.

LI Z, XU D. Batik dyeing simulation based on convolutional neural network[J]. Journal of Graphics, 2020, 41(2): 196-203 (in Chinese).

[8] 王新颖, 王亚. 权值优化集成卷积神经网络及其在三维模型识别中的应用[J]. 图学学报, 2019, 40(6): 1072-1078.

WANG X Y, WANG Y. Weighted optimization integrated convolutional neural network and its application in 3D model recognition[J]. Journal of Graphics, 2019, 40(6): 1072-1078 (in Chinese).

[9] SUN X, LIU L P, LI Q, et al. Deep pixel-to-pixel network for underwater image enhancement and restoration[J]. IET Image Processing, 2019, 13(3): 469-474.

[10] GOODFELLOW I J, POUGET-ABADIE J, MIRZA M, et al. Generative adversarial nets[C]//The 27th International Conference on Neural Information Processing Systems. New York: ACM Press, 2014: 2672-2680.

[11] YANG M, HU K, DU Y X, et al. Underwater image enhancement based on conditional generative adversarial network[J]. Signal Processing: Image Communication, 2020, 81: 115723.

[12] HUANG G, LIU Z, VAN DER MAATEN L, et al. Densely connected convolutional networks[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). New York: IEEE Press, 2017: 2261-2269.

[13] ISOLA P, ZHU J Y, ZHOU T H, et al. Image-to-image translation with conditional adversarial networks[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). New York: IEEE Press, 2017: 5967-5976.

[14] ZHU J Y, PARK T, ISOLA P, et al. Unpaired image-to-image translation using cycle-consistent adversarial networks[C]// 2017 IEEE International Conference on Computer Vision (ICCV). New York: IEEE Press, 2017: 2242-2251.

[15] REN W Q, MA L, ZHANG J W, et al. Gated fusion network for single image dehazing[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2018: 3253-3261.

[16] ZHANG H, SINDAGI V, PATEL V M. Image de-raining using a conditional generative adversarial network[J]. IEEE Transactions on Circuits and Systems for Video Technology, 2020, 30(11): 3943-3956.

[17] ISLAM M J, XIA Y Y, SATTAR J. Fast underwater image enhancement for improved visual perception[J]. IEEE Robotics and Automation Letters, 2020, 5(2): 3227-3234.

[18] ANWAR S, LI C Y. Diving deeper into underwater image enhancement: a survey[J]. Signal Processing: Image Communication, 2020, 89: 115978.

[19] HUANG D M, WANG Y, SONG W, et al. Shallow-water image enhancement using relative global histogram stretching based on adaptive parameter acquisition[C]//The 24th International Conference on MultiMedia Modeling. Heidelberg: Springer, 2018: 453-465.

[20] PAN P W, YUAN F, CHENG E. Underwater image de-scattering and enhancing using dehazenet and HWD[J]. Journal of Marine Science and Technology, 2018, 26(4): 531-540.

[21] YANG M, SOWMYA A. An underwater color image quality evaluation metric[J]. IEEE Transactions on Image Processing, 2015, 24(12): 6062-6071.

[22] PANETTA K, GAO C, AGAIAN S. Human-visual-system- inspired underwater image quality measures[J]. IEEE Journal of Oceanic Engineering, 2016, 41(3): 541-551.

[23] BAY H, TUYTELAARS T, VAN GOOI L. Surf: speeded up robust features[C]//European Conference on Computer Vision. Heidelberg: Springer, 2006: 404-417.

Underwater image enhancement algorithm using gated fusion generative adversarial network

LIN Sen1, LIU Xu2

(1. School of Automation and Electrical Engineering, Shenyang Ligong University, Shenyang Liaoning 110159, China; 2. School of Electronic and Information Engineering, Liaoning Technical University, Huludao Liaoning 125105, China)

An underwater image enhancement algorithm using gated fusion generative adversarial network was proposed for solving problems of underwater image color distortion, low contrast, and heavy fogging. The crucial element of this algorithm is that it recruited a generator to pixel-by-pixel restore image feature details and synthesized a clear image through gated fusion. First of all, to increase the variety of image feature learning by the network, several parallel sub-networks were employed to learn different kinds of spatial feature knowledge of the same image. The image features learned from different sub-networks were fused utilizing gated fusion. The generator and the discriminator were used for mutual games, and the network was repeatedly trained to obtain enhanced underwater images. Finally, using the EUVP dataset and the U45 testset, this paper performed a series of comparative experiments. The algorithm’s key point matching was 19 points higher than the raw image, according to the experimental results. The average UCIQE value was 0.664 7, while the average UIQM value was 5.723 7. It can achieve improvements over other classic and latest algorithms, demonstrating the algorithm’s extraordinary performance.

image processing; underwater image; generative adversarial network; multi-scale input; gated fusion

TP 391.4

10.11996/JG.j.2095-302X.2021060948

A

2095-302X(2021)06-0948-09

2021-01-18;

2021-04-16

国家重点研发计划项目(2018YFB1403303);辽宁省重点研发计划资助项目(2019JH2/10100014)

林 森(1980-),男,辽宁沈阳人,副教授,博士。主要研究方向为图像处理与模式识别、机器视觉。E-mail:lin_sen6@126.com

18 January,2021;

16 April,2021

National Research Key Program of China (2018YFB1403303); Liaoning Provincial Research Foundation for Key Program of China (2019JH2/10100014)

LIN Sen (1980–), male, associate professor, Ph.D. His main research interests cover image processing and pattern recognition, machine vision. E-mail:lin_sen6@126.com