数字孪生技术在光网络中的应用与问题

2022-01-18朱康奇华楠李艳和郑小平

朱康奇 华楠 李艳和 郑小平

(1.北京信息科学与技术国家研究中心,北京 100084;2.清华大学电子工程系,北京 100084)

0 引言

5G技术的成熟与落地使人们对于下一代移动通信技术有了更高的性能期许和要求。随着移动通信对带宽、时延等需求的不断提升,以及移动通信蜂窝和单基站覆盖范围的不断变小,光通信网络的重要地位在6G时代将得到更为突出的体现,其性能上限也将成为制约整个信息网络能力进一步提升的重大瓶颈。 智能化是当前光网络发展的一大趋势[1]。随着人工智能技术的发展和应用领域的增多,将机器学习和光网络的智能管控相结合无疑是一个绝佳的选择。与此同时,数字孪生技术也取得了极大的发展和进步。数字孪生技术利用采集到的大量数据,对一系列物理实体建模并模拟其行为,将实体光网络映射到数字世界,同时利用机器学习算法对数据进行分析和挖掘,进而实现对实体光网络更好的管控。

1 数字孪生技术及其应用

1.1 数字孪生技术

数字孪生是物理系统(及其相关环境和进程)的虚拟表示,通过物理系统和虚拟系统之间的信息交换进行更新[2],它的正常运作建立在对所研究的对象精准感知的基础之上。

数字孪生在不同领域中都有着广泛的应用,例如大型建筑或海上钻井平台的物理结构可以通过数字孪生进行改进[3];制造业中的产品从设计到制作再到成品,这之间的所有步骤都可以在数字孪生的辅助下进行[4];汽车具有复杂的工作系统以及协同机制,相应的设计难度非常大,而数字孪生的引入可以在汽车设计的过程中,既提高车辆性能,又提高生产效率[5];数字孪生还有助于设计和规划结构复杂、用途多样的太阳能农场[6];在城市规划领域,数字孪生可以实时显示3D空间数据[7];在医院,得益于数字孪生,患者可以获得更为优质的医疗保健服务,医生们则可以根据传感器生成的数据来追踪患者的各项健康指标,进而做出更精准的判断[8];在科研院所,科研人员可以利用数字孪生系统生成的大量数据进行更为全面和深入的研究,并据此对试验进行优化,实现更高效的方案设计。

数字孪生技术在光通信网络的研究和发展过程中也逐渐显露出巨大作用。研究人员会在不同节点装配上不同功能的感知模块,如传感器、光性能监测(Optical Performance Monitoring,OPM)模块,由这些模块生成的关于光网络性能与运行状态的数据,会被传送至数据处理系统中用于完善数字孪生所建立的模型[9],数字孪生系统也可以借助机器学习算法,基于模型进行模拟仿真、性能研究并生成可行的优化方案。这些工作的最终目标是挖掘虚拟网络模型所反映出的实体网络各研究对象之间的深层次联系,并将之应用于对实体网络的管理和控制。

1.2 数字孪生与机器学习在光网络中的应用与潜在问题

近年来针对光网络的不同分层均有相应的感知技术被提出,并与机器学习技术相结合,开启初步的应用(见图1)。例如,物理层(光链路物理损伤估计、光放大器控制、物理层安全分析等)[10]、链路层(光开关状态感知、端口状态感知等)[11]、网络层(资源利用率分析、丢包率监测、跨域路由计算等)[12]。这些技术能够在特定的场景中给光网络带来一定程度的性能提升,但是它们大多仅工作在单一的场景下,采集特定的数据,优化单个的指标,适用性和扩展性受限。然而,光网络各层级之间紧密联系,隐含很强的关联性。因此,由于很少或没有考虑到其他优化目标,这些相互独立的感知技术往往难以实现整体网络性能的优化,甚至会出现为优化一个指标而牺牲其他指标性能的情况。其根本原因在于这些独立的感知技术作用在“低维度”,或它们所依赖的感知数据本身就是“低维度”的,如同“盲人摸象”,无法获得“高维度”的数字孪生并重现完整的真实网络,自然也就难以避免“顾此失彼”的局部优化,遑论实现全局优化。

另一个值得关注的问题在于机器学习是一种“垃圾进,垃圾出”(Garbage In, Garbage Out)的技术,为了发挥其真正效力,需要有高质量的数据集对其进行支撑。但是,在实际的数据采集过程中,感知模块的性能差异以及感知数据的传送、存储和处理能力均会限制真实网络数据采样的一致性和实时性,进而破坏数字孪生的精确性。

随着数字孪生技术的应用不断增多,光网络中会有大量数据被收集并存储在数字孪生系统之中,此时上述由数据采集设备的差异性和时间同步误差带来的感知数据不准确将会显著降低网络状态参数评估的准确性,并大幅恶化网络性能。

感知数据的实时性和一致性的影响程度会随着网络规模的扩大和网络动态性的增强而变得愈发严重。未来的6G光网络规模或可达万节点甚至百万节点量级,由此带来的业务频繁拆建、故障频繁发生、高度并发等现象会使整个网络运行在一个亚毫秒甚至微秒级的“高动态”状态。在这种情况下,感知数据实时性和一致性的不足可导致“数字孪生”网络与实体网络脱节,进而使整个网络失控。

2 光网络中数据采集问题的数学模型

光网络数字孪生系统中存在两个典型的数据采集问题:失真和噪声,其产生原因主要有3个,本文将分别对这3个原因进行分析和建模。

2.1 数据采集设备自身的不足与缺陷

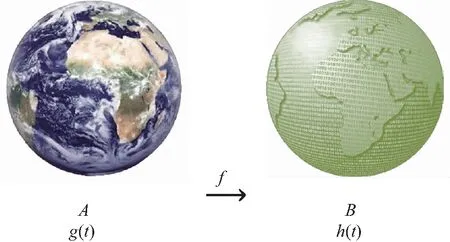

如图2所示,A表示现实世界中的光网络,设备要收集的A中的数据对应函数g(t)。将数据采集设备采集数据的过程看作是对函数g(t)的变换,对应于操作f。最终采集到的数据,即变换得到的结果,为数字世界中的光网络映射B对应的函数h(t)。

图2 数字孪生系统中的数据采集示意图

这一过程表示为:

f[g(t)]→h(t)

(1)

显然,函数f的精度直接影响采集数据的精度,并会进一步影响数字孪生模型的精度。在这种情况下,数据采集设备本身精度不足或存在其他缺陷,引入数据采集误差,是数据采集噪声的一个来源。

2.2 多设备采集场景下的不一致性

在分布式多设备数据采集场景中,随着光网络的域间协作愈发重要和频繁,不同节点或不同域间存在感知信息的海量传输。同样可以使用数学表达式对这一场景进行描述:假设采集对象为g(t),不同节点上的采集设备对应不同的操作函数,如f1,f2,…,fn,它们采集得到的数据分别为h1,h2,…,hn,不同的结果对应不同的信息格式或特征。这一过程用数学表达式可表示为:

(2)

在这种情况下,如果感知信息没有统一的标准或模型,那么不同节点之间将难以高效协同。其主要原因在于分析系统往往是针对具有某一特征的感知信息进行设计的,感知信息和分析系统之间的不匹配将极大地降低系统性能。这种不匹配可以被看作是数字孪生系统中的一种失真。为了解决数据采集不一致的失真问题,一种有效的方式是对分布式数据采集设备进行校准,使其能够高效协同工作。

2.3 动态网络中的时间误差

在动态网络中,如果采集时间存在随机抖动或整体偏差(分别对应采集数据的噪声和失真),得到的采集数据也会有相应的误差,即下式中的Δg:

g(t+Δt)→g(t)+Δg

(3)

造成时间误差的主要原因有3个,分别是传输时延的不对称、传输时延的变化以及有限的时钟分辨率。其中,传输时延不对称和传输时延变化均可以被补偿,补偿后的时间误差对于纳秒级时间同步系统的影响很小。而第3个原因——有限的时钟分辨率,在时间同步网络中引入的时间读数误差对于时间同步精度的影响在时钟周期量级(通常在10 ns量级或更高),并且难以补偿。

网络中的时间误差累积同样不可忽视。时间同步误差沿着同步路径每经过一跳都会累积,两个节点间的同步误差与邻居节点间的同步误差和这两节点间跳数的均方根成正比[13]。据此可以推断,百万节点网络的时间同步误差或比万节点网络大10倍。此外,通常人们希望地理上相邻的节点具有低时间误差,但是在实际应用的场景中,地理相邻的两个节点可能在两条不同的同步路径上,并且具有很大的时间误差积累。这一现象并不少见,且通常很难甚至无法设计出对所有节点均最优的时间同步路径树,尤其对于大型网络而言该问题尤为严重。

为了解决时间抖动与偏差引入的数据采集噪声和失真,需要实现精确的时间同步,以尽量减少时间误差带来的不确定性。

3 基于应用实例的特征影响分析及解决方案探讨

结合上述光网络数字孪生数据采集模型的特征,从两大场景出发,基于应用实例,进一步阐述数据采集的噪声与失真对光网络数字孪生系统的影响,并探讨相应的解决方案。

3.1 数据采集不一致性与时间误差对光网络数字孪生系统的影响

数据采集的噪声与失真在不同场景下造成的影响各有不同,以下将针对数据采集的不一致性与时间误差对数字孪生系统的影响进行分析。

3.1.1 数据采集不一致性的影响

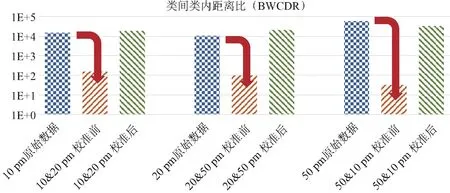

当尝试构建光通信数字孪生系统时,明确收集到的数据包含哪些信息是非常重要的。光谱作为光信号在频域的表现形式,承载着光信号和传输环境的大量信息,这些信息会受到不同激光器、调制器、调制格式、信号源、二进制码格式和信号速率等因素的影响,可用于对光通信系统的分析,以实现更好的管理和控制。为了定量描述不同因素引入的差异有多大,引入光谱类间类内距离比(Between/Within-Class Distance Ratio,BWCDR)[10]的概念。

当存在多设备光谱数据采集不一致的情况下(3种光谱采集设备,分辨率分别为10 pm、20 pm和50 pm),不同光信号采集光谱的BWCDR会大幅下降(见图3)[10]。这个问题会导致光谱分析的性能急剧恶化,在使用机器学习技术辅助分析时受到的影响尤甚。例如,在基于机器学习的光谱识别任务中,如果测试数据与训练数据的采集设备不同,其识别准确率会从100%下降到12.5%,无法应用。

图3 不同设备多种分辨率光谱混合后对BWCDR的影响

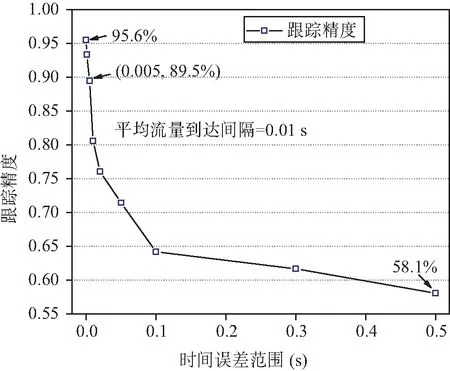

3.1.2 时间误差的影响

在一个复杂的网络中,不同节点之间的系统时间误差、信令传输时延的变化、时延抖动等都会导致数据获取或处理的时间不准确,从而产生对系统控制有害的噪声和失真。例如,在弱耦合模分复用光网络的串扰跟踪工作中[11],研究人员利用光功率计测量被监测通道的功率,同时使用开关状态探测器获取光开关的状态,并基于光通道功率和开关状态数据构建深度神经网络(Deep Neural Network,DNN)。采集到的所有数据都将被发送到串扰监控和数据分析服务器,以供DNN的训练与应用,研究结果如图4所示[11]。研究人员发现当数据采集的时间误差从0 s扩大到0.5 s时,串扰跟踪的准确度会从95.6%下降到58.1%。显然,时间误差越大,系统所受到的负面影响也越大。

图4 跟踪精度与时间误差

3.2 数据采集不一致性与时间误差的解决方案

3.2.1 数据采集不一致性的解决方案

在当今复杂的网络环境中,不一致的数据采集是不可避免的。需要建立一个统一的信息模型,找到一种实现自适应感知信息校准的方法,从而消除数据的不一致性。

在很多领域都可以发现这类问题的踪迹。例如,在化学工程相关领域,比较不同实验室、不同测量设置所产生的数据时,数据不一致性也是一个普遍存在的问题,而计量学家们则提出了以分层贝叶斯模型为代表的统计方法对数据进行处理[15],从而获得一致的数据集。另一方面,空中物联网系统由于其对机动性和观察、采集、通信能力的高要求,其需要的测量精度要远超过普通的商用传感器;而在高海拔环境中,环境因素往往会迅速变化并导致传感器读数发生极大偏差,针对此问题,有学者提出了基于神经网络的数据校准模型,以提高数据质量[16]。

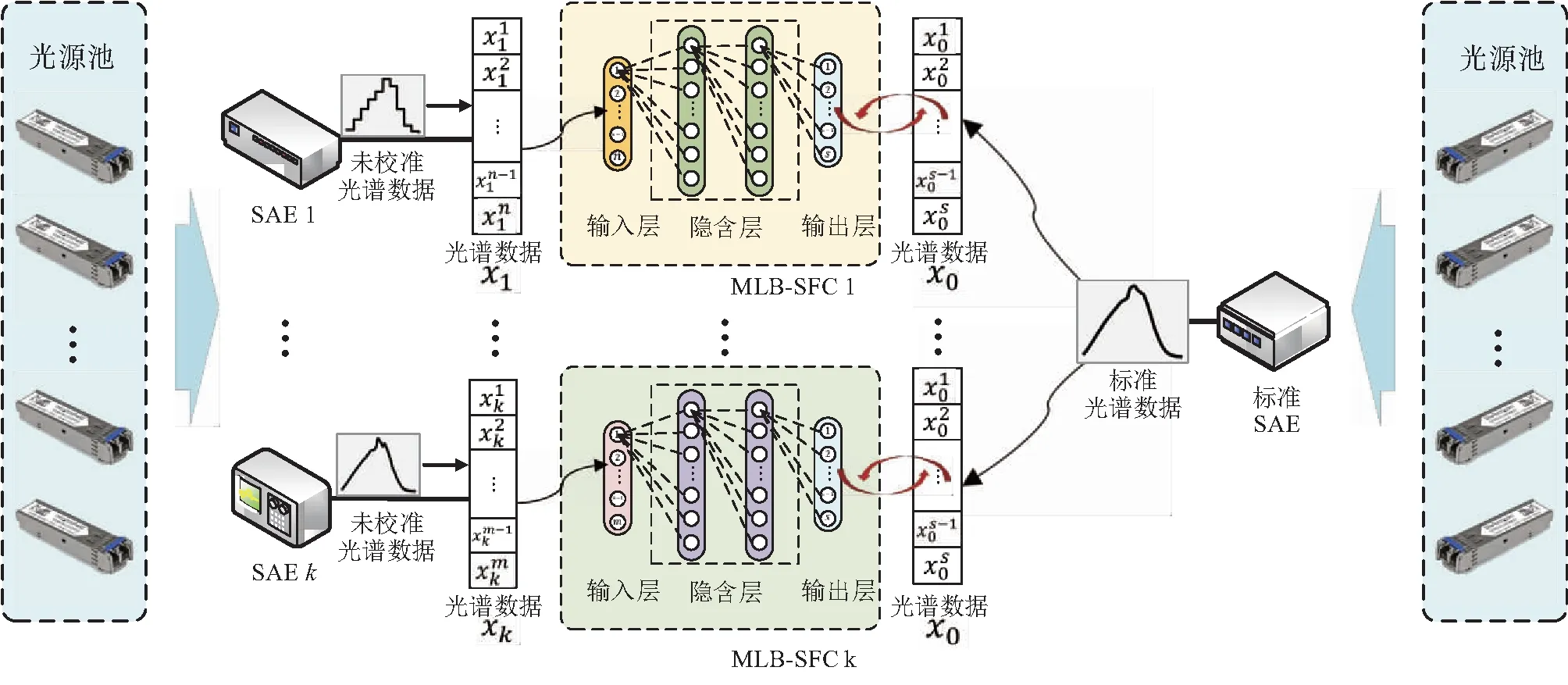

上述方法所处理的数据对象主要为单一维度的数据,如某种条件下的某个读数,其适用场景范围较小,可扩展性较差。为了寻求更高维度的感知与处理,所采集的数据需要包含更多信息以支撑更全面的分析,而针对不一致的高维数据的校准方案,也更加重要。例如,在光网络中光谱便是一个包含有大量信息的高维研究对象。在基于机器学习的光谱特征校准方案中(见图5)[14],研究者使用标准光谱采集设备(Spectrum Acquisition Equipment,SAE)来采集标准光谱,作为校准单元——全连接神经网络(Fully-Connected Neural Network,FCNN)的目标输出。同时,大量未校准的光谱数据被未校准的SAE收集,作为神经网络的输入。当数据集准备好后,训练FCNN模型使用标准光谱校准其他光谱,以消除不同的SAE引入的光谱特征差异。在经过这种高维校准处理后,光谱的识别准确率可获得大幅提升,使多设备采集的一致性提升至与单设备采集相当的水平。

图5 基于机器学习的光谱特征校准(MLB-SFC)方案

在可预期的未来,各领域针对采集数据不一致性的研究将相互借鉴,不断融合,从彼此独立的“低维度”感知技术向更高维度拓展,从而有效地解决这一普遍存在的重要问题,使不同条件、不同系统、不同场景下获得的数据都能够被有效校准和高效利用。

3.2.2 时间误差的解决方案

当前商用网络中采用的高精度时间同步协议以IEEE 1588为代表,其最新版本为IEEE 1588-2019[17]。在大规模网络中,这一协议将时钟组成多个高精度时间同步协议(Precision Time Protocol,PTP)时间域,每个时间域中的边界时钟都沿着树状主从式结构从上一级的主时钟获取时间,基于双向链路传输时间相等的假设计算时间修正量,最终实现对时间误差的补偿。此方法的主要问题在于同步过程中存在时间误差累积,在大规模网络中的同步精度提升难度大。同时,时间同步精度也严重受限于有限的时钟分辨率。提高时钟频率或使用鉴相技术[18]能够降低由时钟频率不足引入的时间误差,但是在大规模网络中这两种方法均不可避免使用大量更昂贵的器件,对成本构成挑战。

针对IEEE 1588中存在的时间误差累积问题,有学者提出分布式时间同步(DTS)方案[19]。不同于IEEE 1588中的主从结构,DTS 将时钟组织成网状对等结构,即每个节点的地位是对等的。每个同步节点与其所有邻居节点交换时间戳消息,根据与所有相邻节点的平均时间差计算自身的时间修正量。这样,可以减少时间误差累积,同时提高网络出现故障后的生存性。

为了降低由时钟频率不足引入的时间误差,进一步提高时间同步精度,低成本双频时间同步技术被提出[20]。当发送时钟和接收时钟使用相同的频率时,有限的时钟分辨率会导致时间读取错误。为了解决这个问题,笔者提出在从节点对到达的时间同步包引入周期性扰动时间,以消除多个同步接收时间戳错误的相关性。为实现这一效果,笔者提出在主、从节点分别使用不同频率的时钟。当发送和接收时钟工作在不同的频率时,时间同步包到达时刻时间戳的时间相关性会被消除,且其相位会在时钟周期内周期性均匀分布。通过计算多次测量得到的平均时间读数误差,就能够实现精准的时间同步误差补偿。

相较于数据不一致性的校准工作,时间同步相关工作的发展更为成熟和全面。但是,在面向未来B5G/6G百万节点纳秒级时间同步网络的需求时,现有时间同步网的网络体系、协议、核心技术、关键模块和组网技术等仍需要进一步的发展和提升,以应对未来网络和数字孪生系统对传输时延抖动和不对称性的精确测量和补偿、大规模时间同步网络时间误差累积的抑制、大规模时间同步网络的生存性和快速收敛等方面的更高需求。

4 结束语

机器学习在当今的众多领域中均被公认为一种强大的辅助工具,在它的帮助下,可以利用数字孪生系统实现对真实世界的准确、高效的管理和控制。在光通信领域,从全光网1.0迈向全光网2.0的进程中,数字孪生也同样有力地推动了光网络的智能化,引领我们走向下一代光网络。然而,数字孪生系统的正常工作依赖于感知数据的精确获取,由于数据采集设备的不一致性以及有限的时间同步精度,在实际应用中会产生失真与噪声两大问题。本文聚焦光通信网络分析了这两大问题的来源,并在此基础上探讨了可能的方法来减小时间误差,以及降低数据采集不一致性给光网络数字孪生带来的负面影响。