抗目标丢失的视觉机器人跟踪算法

2021-12-11张子昂马千千赵伟卓

张子昂,杨 旗,马千千,赵伟卓

(沈阳理工大学,机械工程学院,辽宁 沈阳 110159)

0 引言

随着机器人应用技术及计算机视觉技术的蓬勃发展,搭载视觉系统的机器人成为了国内外学者研究的热点。视觉机器人的应用中,往往需要机器人具备自主识别及跟踪目标的能力。

在机器人跟踪目标的过程中,目标往往会因为障碍物的遮挡或者目标运动到镜头外,导致跟踪目标消失在机器人视野内,机器人无法获得目标信息,从而无法准确跟踪,大大影响了跟踪性能。因此视觉跟踪机器人需要可以一定程度上抗目标丢失的跟踪性能。

均值漂移(Meanshift)算法[1]是目标跟踪中常用的一种基于核密度的无参概率密度估计方法,选取目标颜色作为跟踪特征时即利用物体颜色HSV值的特征,结合均值漂移(Meanshift)算法,实现对目标物体的自动识别与跟踪功能。该算法相比以往识别跟踪算法,计算速度更快,对目标物分辨率与轮廓完整程度要求小,精确度较高[2]。

但是当目标消失时,机械臂末端控制器因无法收到通过对图像处理后获得的正确的目标位置信息,导致跟踪失败,稳定性及鲁棒性很差。本算法中,当目标为未丢失状态时,利用Meanshift算法跟踪目标,控制机器人运动;若判断目标为丢失状态,则对实时保存的图像信息重检测,处理与分析,并预测机器人的运动轨迹,获得控制参数控制机器人运动找回目标,机器人重新侦测到目标位置信息,可以继续跟踪目标。

1 抗目标丢失的视觉机器人跟踪算法

1.1 算法框架

在机械臂末端对目标的跟踪过程中,目标的颜色信息一般来说不会发生很大的变化,有较强的抗形变能力,只要其颜色特征不变就能够对目标进行跟踪。本算法需要预先给出目标的颜色特征信息,根据特定的颜色信息对目标丢失前的 n帧图像(根据相机FPS以及目标深度确定n的值)进行图像阈值分割及形态学处理。该方法较为简洁,不会对视觉跟踪系统造成负担,能够有效提高跟踪效率。

该算法由三部分构成,包括基于颜色信息的图像分割、判断目标丢失类别及机器人运动轨迹规划。

(1)基于颜色特征的图像分割

根据目标颜色特征信息,通过建立HSV颜色空间得到分割阈值,对重检的每帧图像进行分割、二值化、高斯滤波及形态学处理。

(2)判断目标丢失类别

对于视觉跟踪机器人来说,目标丢失有两种状态:一是目标被障碍物完全遮挡;二是目标移动到镜头外。

(3)机器人运动轨迹规划

计算出处理后的每一帧图像的分割区域的像素中心坐标(x, y),将所有的坐标点绘制在图像坐标系下,使用一元线性回归分析方法对所有的坐标点拟合,得到一元线性回归模型,从模型中获取相关系数ρ、回归系数r。相关系数ρ表征了变量间的线性相关程度即拟合程度的高低。回归系数r表征了拟合曲线中像素坐标 x与 y的线性关系,通过手眼标定可获得像素坐标系与世界坐标系的关系,回归系数r相应的可以作为控制参数控制机器人的运动,重新获取目标位置信息进行跟踪。

1.2 基于HSV颜色空间的图像分割

如图1所示,HSV颜色空间模型是倒锥形模型:

图1 HSV颜色空间模型Fig.1 HSV color space model

该颜色空间模型是按色调、饱和度、明度来描述的。H代表色调、S代表饱和度、V代表明度。在圆锥上,角度代表色调H,饱和度S表示为点到中心竖线的距离,而明度值V用中心竖线表示[3]。

RGB颜色空间由一个3维立方体表示,RGB模型简化了计算机图形系统的设计,但它并不适合所有红、绿、蓝颜色分量高度相关的应用程序,使得执行某些图像处理算法变得较为困难。许多处理技术(例如直方图均衡化)仅适用于图像的强度分量。HSV图像更适用于特征提取和分类,有助于需要加快速度的实时应用[4]。

本研究通过将每帧RGB图像转换为HSV颜色空间[4]来进行预处理。为了获得准确的结果,本研究中的原始图像首先进行图像预处理,利用归一化来生成准确的性能,然后把读取的每帧图像从RGB颜色空间转到HSV颜色空间。

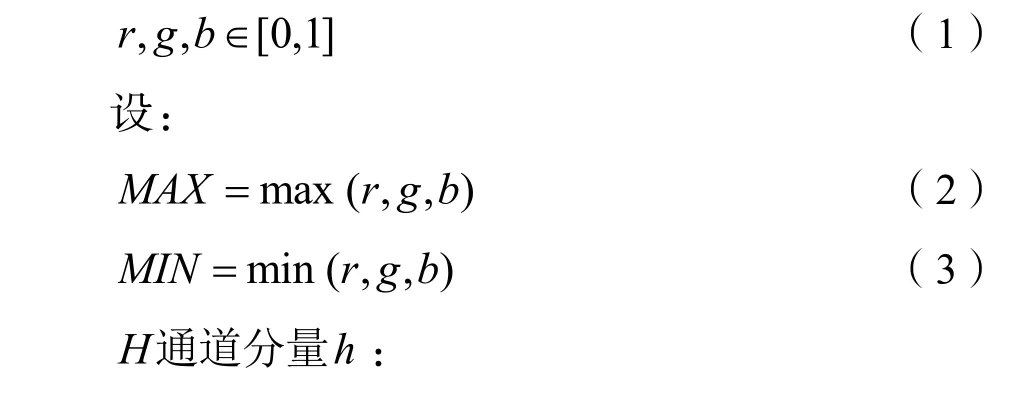

首先,将RGB颜色空间的三个分量(r, g, b)归一化:

HSV是一种直观的颜色模型。HSV在用于指定颜色分割时,通过获取当前工作环境下的该颜色的H、S、V值,将阈值区间T设置为H±15、S±15、V±15分割效果较好,区间过大容易在分割的图像中产生噪点,区间过小容易因光照,阴影,色块颜色不均等因素丢失图像信息。

对分割后的每帧图像进行二值化操作,图像的二值化有利于图像的进一步处理,使图像变得简单,而且数据量减小,能凸显出感兴趣的目标区域[6]。

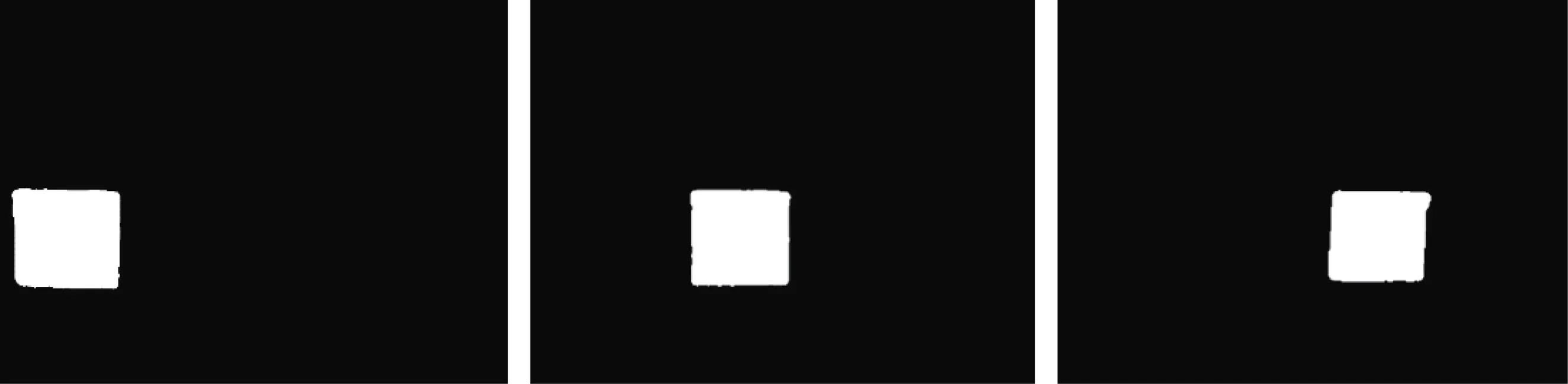

将每帧图像上的满足T的所有像素点的灰度值设置为255,其余点的灰度值设置为0,能够直观的观测到分割效果。如图2所示,截取色块运动过程中的三帧图像和分割效果。

图2 基于HSV的阈值分割Fig.2 threshold segmentation based on HSV

可以看出分割效果较为理想,每帧图像有明显的黑白区域,由于光照,背景,色块颜色不均等因素影响,会产生些许噪声影响色块的分割效果,进而影响对色块位置的检测准确度。

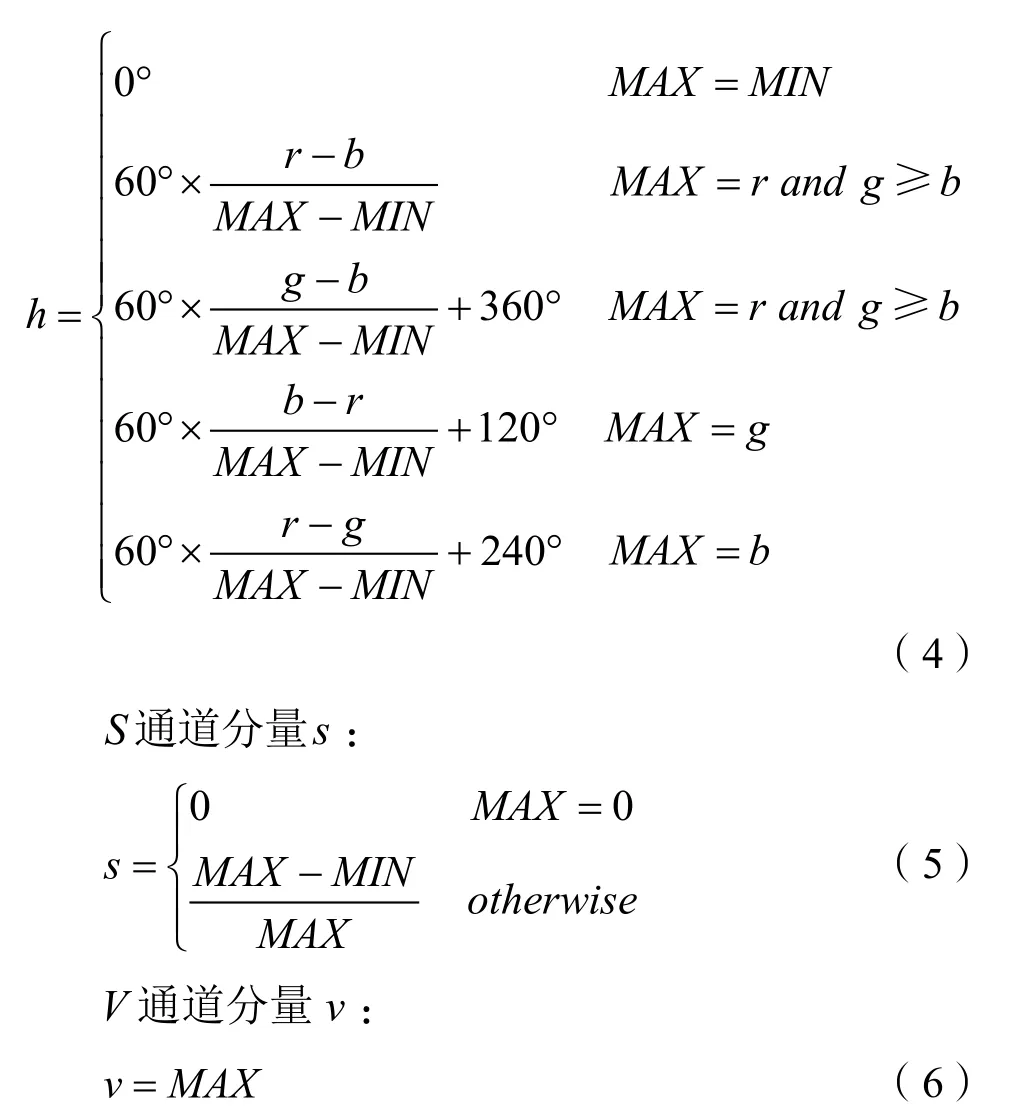

采用高斯滤波对每帧图像去噪,由于去噪过程可能会存在色块轮廓上的毛刺,所以再采用形态学操作,对图像进行开运算:能够去除孤立的小点、毛刺和小桥(即连通两块区域的小点),消除小物体、平滑较大物体的边界,同时并不明显改变其面积[7];再采用闭运算:闭运算可以填平图像中的孔洞,而图像的形状和位置能够保持不变,处理结果如图3所示。

图3 高斯滤波及形态学处理Fig.3 gaussian filtering and morphological processing

1.3 目标丢失类别判断

颜色直方图模型反映的是图像中各种颜色的分布,即各种颜色出现的概率,通过评估指定颜色特征在颜色直方图模型中的比例,确定目前跟踪器的跟踪状态即目标是否丢失。

对于视觉系统来说,目标丢失有两种状态,一是目标被障碍物完全遮挡;二是目标移动到镜头外。

遍历处理后的二值图像,获取每一帧图像的分割区域中心像素坐标,在读取的视频序列色块目标丢失时,图像中没有目标存在,此时该图像计算出的中心坐标是(0,0),为了防止影响拟合效果,将这些点舍弃。计算出所有非零点的x,y坐标平均值;最小值MIN( x),MIN( y)。

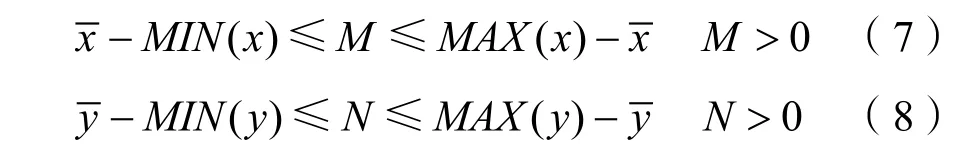

目标被障碍物完全遮挡判断条件:

式中M,N表示色块中心在像素坐标系下的像素偏移量阈值,满足此条件可认为目标被遮挡,机器人将保持位置不变,等待目标重新回到视野;不满足此条件可认为目标运动出镜头,机器人需要预测色块轨迹来跟踪目标。

1.4 线性回归分析预测目标轨迹

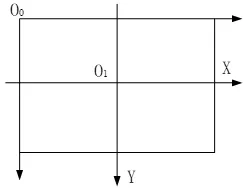

如图 4所示像素坐标系[7]下,O0代表像素坐标系下的零点,横坐标X和纵坐标Y分别是图像所在的行和列,X,Y最大值根据图像分辨率决定,图像像素宽度为X,像素高度为Y,O1为图像中任意一点的像素坐标。

图4 像素坐标系Fig. 4 pixel coordinate system

记录每帧图像处理后的像素中心坐标(x,y),将所有坐标记录在同一像素坐标系下,绘出散点图,使用一元线性回归模型对所有的散点进行拟合,一元线性回归分析的是建立因变量y与自变量x之间关系的线性回归方程,利用这个方程,来分析因变量和自变量之间的相关性以及回归系数等[9]。

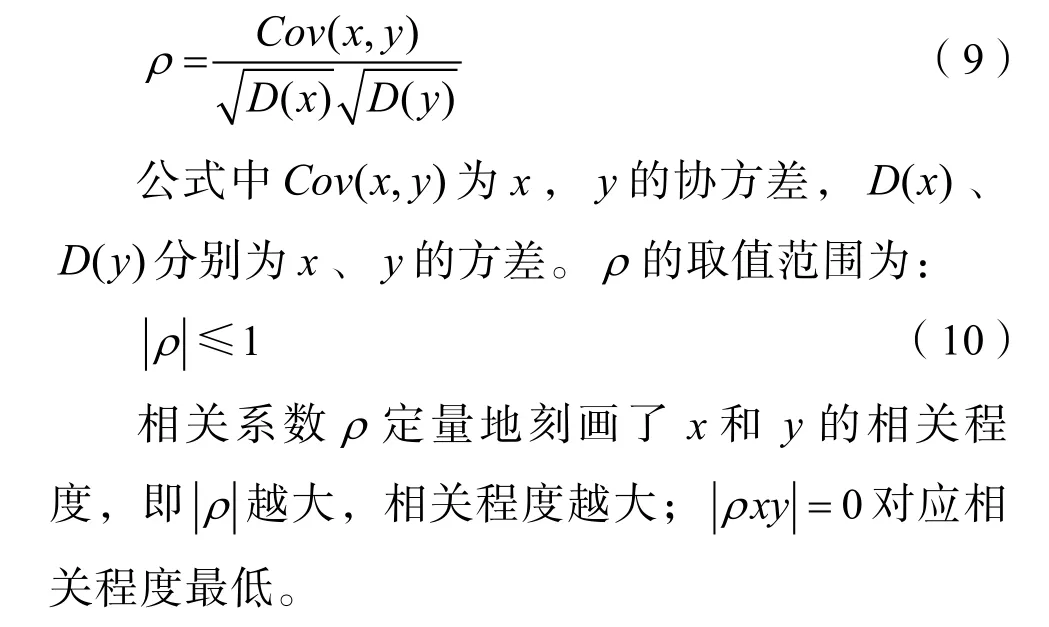

ρ是一个可以表征x和y之间线性关系紧密程度的量。计算方法为:

回归系数r 在回归方程中表示自变量x对因变量y影响大小的参数。回归系数越大表示x对y影响越大,正回归系数表示y随 x增大而增大,负回归系数表示y随x增大而减小。

机器人的运动控制使用增量运动的方式,即预先设定机器人在像素坐标系X轴方向的跟踪步长 S(mm),机器人的运动方向则通过线性模型上的x,y坐标的变化来判断。

2 实验结果与分析

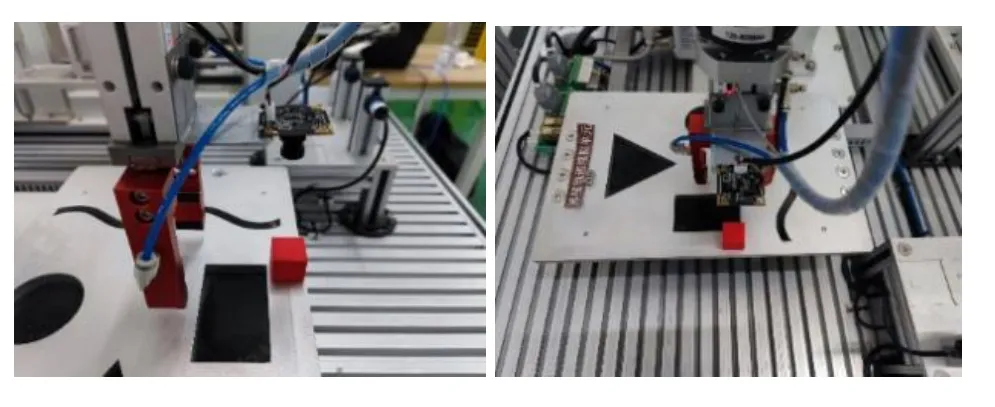

如图5所示实验环境,ABB机器人[10]末端执行器前端与单目相机组成 Eye-in-Hand(眼在手上)机器视觉系统进行目标跟踪实验。单目相机分辨率为640×480,FPS=30。

图5 实验环境Fig.5 experimental environment

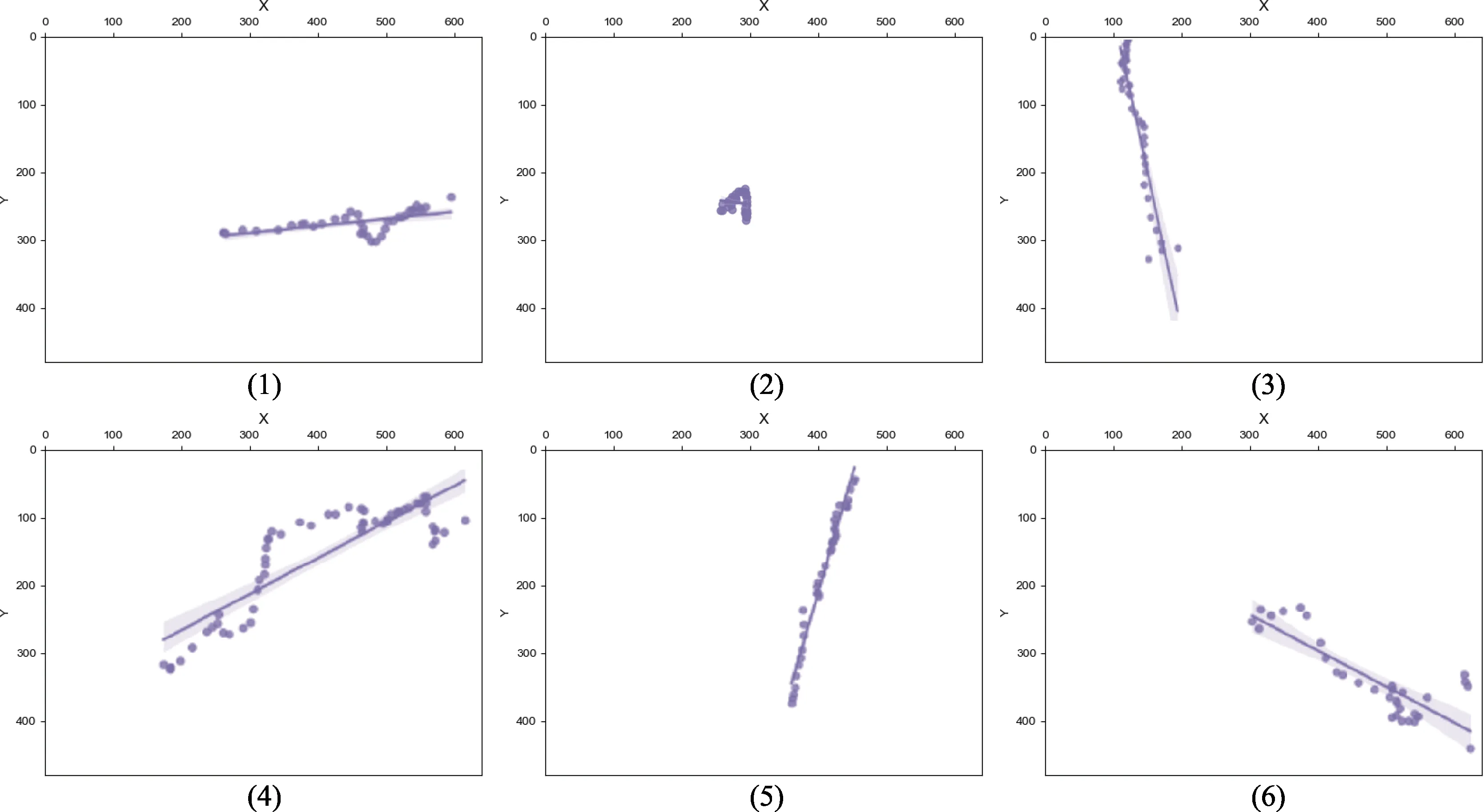

如图6所示色块在不同方向消失在相机视野时,提取丢失前实时保存的视频序列中的60帧图像中各个图像分割区域的像素中心点坐标在像素坐标系下绘制的散点图及对所有坐标点的一元线性拟合曲线,图中X轴为像素宽度(0~640),Y轴为像素高度(0~480)。图 6(1)(3)(4)(5)(6)为目标移动到镜头外时所绘曲线,图 6(2)为目标完全被障碍物遮挡时所绘曲线,可以看出能够清晰准确的获取目标出镜头前的各处位置即各个散点坐标,稳定性较好,绘制的线性回归曲线拟合程度较高,可以准确反映目标的移动轨迹。

图6 像素坐标点拟合曲线Fig.6 coordinate point fitting curve

从表1数据可以看出,跟踪系统可以有效地分辨出目标丢失类别,图 6(2)为目标被遮挡,其余为目标运动出镜头视野。相关系数的值大部分在 0.9左右,表明对各个坐标点的拟合程度较好,模型可有效反映出目标的运动轨迹,回归系数r正值表示y随x增大而增大,负值表示y随x增大而减小,符合机器人运动轨迹,可作为机器人的控制参数控制机器人的运动方向对丢失的目标进行跟踪。目标被遮挡情况下机器人成功保持位置不变,等待目标重新回到视野;目标移动出镜头时机器人均正确规划路径,按照预设步长 S成功找回目标位置信息,并可以继续跟踪。

表1 相关系数与回归系数统计Tab.1 statistics of correlation coefficient and regression coefficient

3 结论

针对传统的视觉跟踪机器人不具备目标丢失判断及跟踪能力,本文在均值漂移(Meanshift)算法的基础上,判别目标是否丢失。通过对实时保存的目标颜色信息并重检测,确定目标丢失的类别,并在目标消失在镜头视野内时规划机器人的路径,重新找回目标。本文算法在ABB机器人上搭载视觉跟踪系统进行实验验证,实验结果表明本文算法可以有效判断目标丢失状态以及丢失类别。在视觉跟踪机器人实际应用中可以更加灵活的对目标实施跟踪任务,有效解决了视觉机器人在视野内丢失目标后的跟踪失败问题,提升了跟踪性能以及跟踪器的稳定性和可靠性。