基于无人机影像自动检测冠层果的油茶快速估产方法

2021-11-26严恩萍尹显明莫登奎

严恩萍,棘 玉,尹显明,莫登奎

基于无人机影像自动检测冠层果的油茶快速估产方法

严恩萍,棘 玉,尹显明,莫登奎※

(1. 中南林业科技大学林业遥感大数据与生态安全湖南省重点实验室,长沙 410004;2. 中南林业科技大学南方森林资源经营与监测国家林业与草原局重点实验室,长沙 410004;3. 中南林业科技大学林学院,长沙 410004)

快速准确的产量估算对油茶经营管理和可持续发展具有重要意义。该研究针对油茶快速估产的应用现状,提出一种基于无人机影像自动检测冠层果的方法用于油茶快速估产。首先借助无人机航拍影像,通过随机抽样选取120株油茶树进行无人机近景摄影和人工采摘称量;然后利用Mask RCNN(Mask Region Convolutional Neural Networks)网络开展基于近景影像的油茶冠层果自动检测与计数;采用线性回归和K最邻近建立冠层果数与单株果数之间的关系,同时结合研究区典型样木株数和平均单果质量,构建基于冠层果自动检测的估产模型。结果表明:1)无人机超低空近景影像结合Mask RCNN网络能够有效检测不同光照条件油茶果,平均F1值达89.91%;2)同传统卫星遥感相比,基于无人机近景摄影的冠层果自动检测在作物产量估测方面显示出明显优势,Mask RCNN网络预测的冠层果数与油茶样木单株果数之间具有良好的一致性,拟合决定系数2达0.871;3)结合线性回归和K最邻近构建的模型估产精度均较高,拟合决定系数2和标准均方根误差NRMSE(Normalized Root Mean Square Error)分别在0.892~0.913和28.01%~31.00%之间,表明基于无人机影像自动检测冠层果的油茶快速估产是一种切实可行的方法。研究结果可为油茶快速估产和智能监测提供参考。

无人机;自动检测;油茶;快速估产;冠层果

0 引 言

油茶是中国南方特有的木本油料树种,含有丰富的不饱和脂肪酸和维生素E,在医药保健方面具有重要的应用价值[1]。作为油茶产量的重要组成部分,油茶果数量和单果质量是反映油茶产量的重要指标,因此快速获取油茶果数量和单果质量极为重要。传统的油茶果数量和单果质量获取主要采用人工采摘计数称量,消耗大量的人力物力财力。因此,开发一种高效准确的油茶果数量和单果质量监测方法具有重要意义。

国内外学者对基于图像分析技术的果实数量监测开展了相关研究[2],例如为克服外界复杂环境的影响,李昕等[3]提出基于多特征融合的油茶果识别方法;李立君等[4]提出基于改进凸壳理论的定位检测算法。早期的果实监测研究主要集中于苹果[5-6]、柑橘[7]、西红柿[8]、油茶[9]和番石榴[10]等。这些研究均采用基于像元的光谱响应作为果实检测的独特特征,然而果实图像存在颜色和形态多样、遮挡重叠严重以及背景相似等问题,给油茶果的准确识别带来挑战。

随着计算机技术的进步,深度学习理论广泛用于基于果实数量监测的作物估产。例如为提高油茶果识别的速度与精度,张习之等[11]提出基于改进卷积自编码机神经网络的油茶果图像识别方法;Koirala等[12]比较了6种现有深度学习算法在树冠图像中检测芒果果实的性能,结果表明YOLO(You Only Look Once)算法检测日间芒果图像数据集的效果较好,F1分数达0.89。深度学习理论已被成功用于芒果[13]、柑橘[14]、番茄[15]和苹果[16]等作物的产量估算。然而目前的研究均采用地面拍摄的近距离照片作为数据源,无法满足大面积估产需求。

近年来,无人机遥感的发展为基于果实数量的大面积作物估产提供了条件。虽然卫星遥感应用于作物估产具有快速、无损、尺度大的优势[17],但是由于空间分辨率的限制,无法获取精确的果实数量[18]。同卫星遥感相比,无人机遥感具有空间分辨率高、获取速度快、操作简单的优点[19-20],可选择最优作业时期获取高分辨率航拍影像,实现基于果实数量的大面积作物估产[21]。例如Apolo等[22]基于无人机捕获的柑橘园影像,采用Faster RCNN(Faster Region Convolutional Neural Networks)模型对柑橘类水果进行产量估算,模型估产精度较好,具有用于柑橘类相似作物产量估算的潜力。

鉴于此,本文拟开展基于冠层果自动检测的油茶快速估产研究,以无人机近景航拍影像为数据源,通过Mask RCNN(Mask Region Convolutional Neural Networks)网络从近景影像中自动检测油茶冠层果数量,采用2种方法拟合Mask RCNN网络预测的冠层果数与单株果数之间的关系,结合研究区油茶样木株数和平均单果质量,构建基于冠层果自动检测的估产模型,以期为大面积油茶林的快速估产提供新的研究思路。

1 材料与方法

1.1 研究区概况

试验区位于湖南省中部的新邵县陈家坊镇江村,介于邵阳盆地和新涟盆地之间,属典型的南方低矮丘陵,地处东经111°08′~111°05′,北纬27°15′~27°38′之间(图 1)。境内春暖夏凉,四季分明,属中亚热带大陆性季风湿润气候,年平均气温17.0 ℃,年均无霜期271 d,年降水量1 365.2 mm,油茶林面积300 hm2。江村油茶种植示范基地是新邵县重点油茶产业基地,造林年度为2014年,总面积为59.18 hm2。

1.2 数据获取与预处理

1.2.1 无人机影像数据

无人机影像数据包括航线规划数据和近景摄影数据,其中前者用于获取研究区油茶样木的空间分布信息;后者用于油茶果样本数据集的构建,包括训练集、验证集和测试集。两种数据均采用大疆御Mavic 2 PRO四轴无人机获取,航拍当日天气晴朗、风速0.3~1.5 m/s、光线充足。搭载的传感器为Hasselblad L1D-20C航拍相机,焦距为28 mm,光圈值为/2.8~/11。相机图像分辨率为5 472 像素×3 648像素(JPEG格式)。

无人机航线规划数据采集于2020年10月19日至21日,拍摄高度为100 m,速度5 m/s,镜头垂直于地面,航向重叠率70%,旁向重叠率分别为80%,像元大小2.75 cm×2.75 cm。具体数据处理流程包括:①剔除重叠率低、重复和模糊的照片;②通过Agisoft Metashape软件加载和匹配影像,构建密集点云,利用密集点云重建三维模型生成正射影像;③基于正射影像显示的油茶林空间分布信息,利用随机抽样选取120株典型油茶样木。

无人机近景摄影数据采集于2020年10月25日至26 日,拍摄高度距离油茶样木空间位置正上方3 m,镜头垂直于地面,连续拍摄,获取油茶样木的完整冠幅,像元大小0.082 5 cm×0.082 5 cm。共拍摄1 000张油茶冠幅影像,剔除重复、模糊等无效影像,最后保留800张近景影像。

1.2.2 地面实测数据

地面实测数据主要用于油茶冠层果标注和估产模型的精度验证。采集时间为2020年10月25日至26日,通过随机抽样选取120株典型样木进行实地调查,记录每株油茶样木的编号、空间位置(经度、纬度和海拔)、单株果数、单株产量和单果质量,空间位置信息利用手持GPS采集,单株果数通过人工采摘计数获取,单株产量采用电子秤实际称量获取,单果质量由单株产量除以单株果数获取。

2 研究方法

2.1 数据集构建

油茶果样本数据集的构建包括数据标注、数据扩增和数据划分3部分。①数据标注:为满足网络训练的要求,利用Labeme软件对油茶果的最小外接矩形进行人工标注,保证每个标注框仅含有单个油茶果目标;②数据扩增:为提高网络的泛化能力,从拍摄的照片中随机抽取400张作为标注样本,采用图像旋转、图像移动、图像缩放、图像增强、噪声注入、对比度变换等方法进行数据扩增(图2),最后保留1 200张作为样本数据集;③数据划分:将扩充数据集按8∶1∶1分为训练集、测试集和验证集。其中训练集用于训练模型参数,验证集用于训练模型的超参数调优,测试集用于评估模型的泛化能力。

注:混合变换指照片经过上下翻转,亮度/对比度变换以及像素值放大/缩小等处理。

2.2 Mask RCNN算法

本研究采用目前经典的深度学习算法Mask RCNN网络检测油茶冠层果。该方法基于原有的Faster RCNN进行扩展,完成目标检测的同时实现高质量的实例分割[23]。Mask RCNN算法包含3个任务分支:目标分类、目标框坐标和目标区域的二值掩码。本文首先通过深度残差网络ResNet提取特征图像,同时通过FPN(Feature Pyramid Networks)对特征图像进行多尺度特征融合,实现低维信息和高维特征的融合,避免高维语义信息的丢失;然后结合区域生成网络RPN(Region Proposal Network)提取潜在的目标区域ROI (Regions of Interest);利用ROI align层将ROI映射成固定维数的特征向量,其中2个分支经过全连接层进行分类和目标框回归,另1个分支经过全卷积运算得到分割区域的二值掩码[24]。具体Mask RCNN模型结构如图3所示。

本文油茶冠层果检测的训练环境均为Google提供的云服务器Colaboratory,GPU为Tesla P100-PCIE-16 GB。训练网络为基于PyTorch的Mask RCNN网络,采用Python3.6语言编程实现网络的训练和测试。训练参数为:初始学习率0.004,学习率下降系数0.1,一次训练迭代2个样本,共进行54 000次迭代训练,第20 250次迭代和第27 000次迭代时学习率下降。分别输出学习模型至文件夹,记录训练日志。

由于精度评价需要同时考虑准确率和召回率,本研究采用F1值作为油茶冠层果识别的评价指标,具体表达式如下:

其中Precision代表精确率,%;Recall代表召回率,%;TP表示实际为油茶果且被模型预测为油茶果的样本数;FP表示实际为背景但被模型预测为油茶果的样本数;FN表示实际为油茶果但没有被网络识别为油茶果的样本数。

2.3 估产模型构建

2.3.1 单株果数估计

以Mask RCNN网络预测的冠层果数为自变量,实测的单株果数为因变量,采用线性回归和K最邻近算法2种方法构建冠层果数与单株果数之间的经验模型。线性回归(Linear Regression,LR)是利用回归方程确定目标值与特征值之间线性关系的一种统计分析方法。本文采用的线性回归满足一元一次方程;K最邻近(K-Nearest Neighbor,KNN)算法是经典的模式识别方法,首先给定测试数据和训练数据之间的距离,其次选定距离最近的个训练数据完成测试数据的预测。研究采用Python3.8语言构建油茶样木单株果数预测模型,K最邻近算法共设置5个值,最大值为5,值为2(即欧氏距离)。

2.3.2 估产模型

本研究采用冠层果数拟合的单株果数,构建油茶样木产量估算模型。具体计算公式如下:

式中Yield为研究区单株油茶估测产量,kg;代表研究区油茶样木编号;代表研究区油茶样木的平均单果质量;代表研究区随机抽样选取的10%典型油茶样木株数;Q代表研究区第株油茶样木的单株果数,通过冠层果数拟合获取。

以线性回归拟合为例,则Q的计算公式如下:

式中q代表研究区第株油茶样木基于Mask RCNN网络预测的冠层果数,和分别表示线性回归的斜率和截距。

本文油茶样木的平均单果质量= 0.020 kg,样木株数=120,线性回归拟合中和取值分别为1.016和4.943。油茶样木单株产量估算公式为:

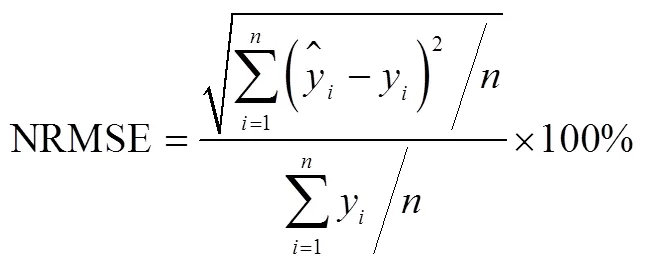

2.3.3 模型精度评价

采用决定系数(2)和标准均方根误差(Normalized Root Mean Square Error,NRMSE)对油茶产量的预测结果进行评价[25]。2反映预测产量与实测产量之间的拟合程度;NRMSE衡量预测产量与实测产量之间的标准化偏差程度,反映估测模型的可靠性,NRMSE越小,预测精度越高。计算公式如下:

3 结果与分析

3.1 样本数据集处理

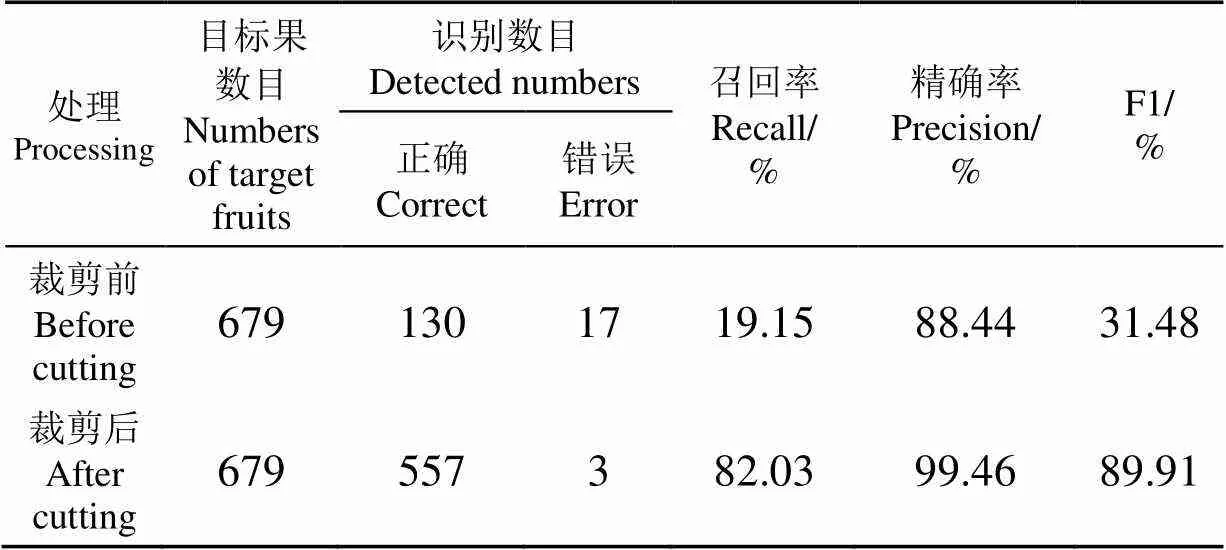

研究表明,不同大小的图像对网络的训练速度和特征提取均有一定影响。由于网络结构和硬件限制,Mask RCNN网络训练时要求输入特定尺寸的图像,而无人机近景影像往往大于这个尺寸。因此为保证油茶果特征的提取精度,本文通过缩放裁剪操作使无人机影像满足Mask RCNN网络训练的输入要求(如表1所示)。

表1 影像裁剪前后油茶果识别精度比较

由表1可知,裁剪前图像的F1值仅为31.48%,召回率仅为19.15%,说明裁剪前预测结果非常不理想,难以实现目标的准确分割。裁剪后各项指标均有提升,其中F1值达到89.91%,提高了约58个百分点;召回率从19.15%提高到82.03%,说明适当的图像裁剪操作,能够实现油茶果特征的准确提取,提高模型预测精度。

3.2 冠层果自动检测

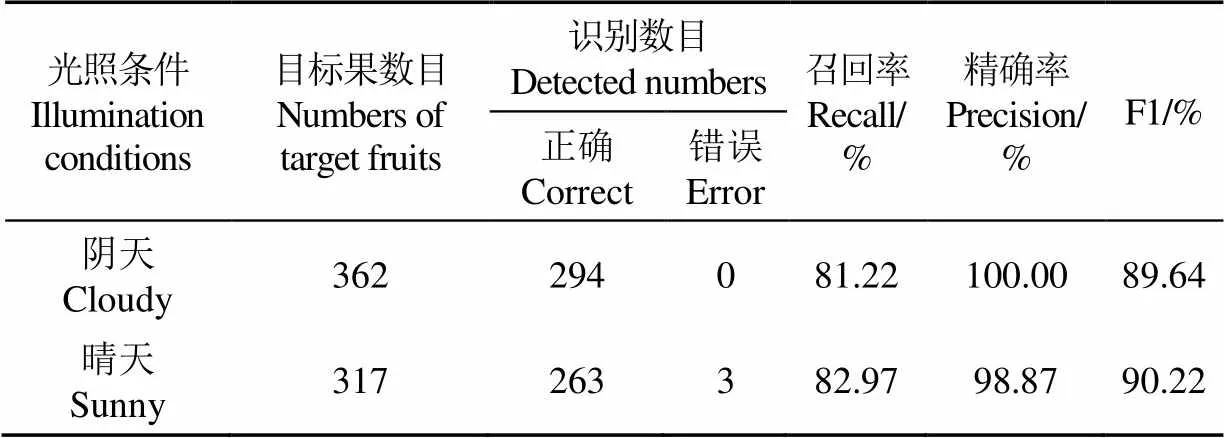

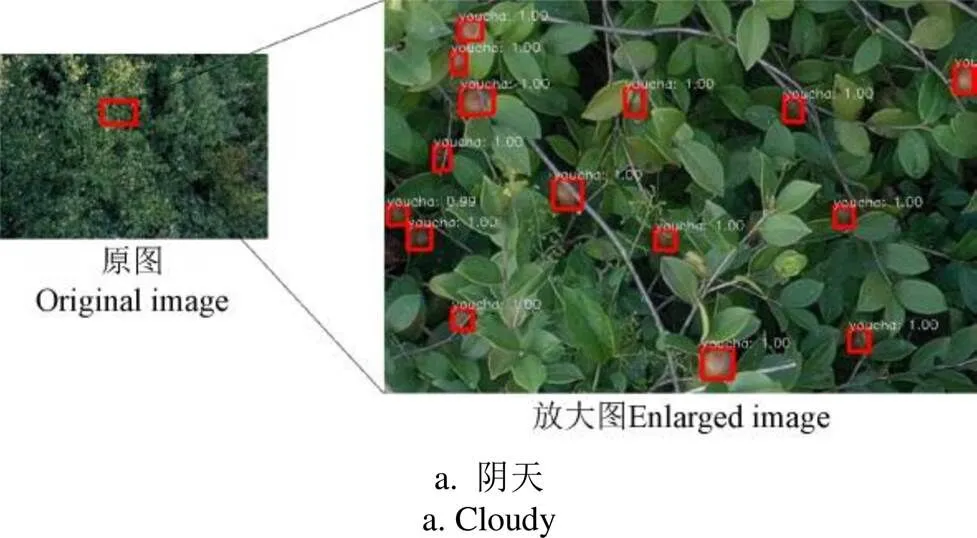

冠层果测试集为无人机近景图像通过数据增强和随机裁剪按比例随机获取,具体测试精度见表2。同时为更好地说明训练模型的泛化能力,选择不同光照条件(阴天和晴天)的油茶果照片进行检测,具体检测结果如图4所示。

表2 测试集冠层果平均检测精度

由表2可知,测试集共有679个油茶果目标,本文方法识别的油茶果数目为560个,其中557个为油茶果目标,平均召回率为82.03%,平均准确率为99.46%,平均F1值为89.91%,说明Mask RCNN网络的检测精度较高,不仅能检测目标油茶果的定位框,而且能准确识别油茶果的二值掩码。

结合图4分析可知,Mask RCNN网络不仅适用于阴天采集的光照均匀图像,同样适用于晴天采集的强光照射图像,F1值分别为89.64%和90.22%。强光照射可能导致油茶果目标表面光线极强,导致肉眼无法将油茶果目标正确识别,本文网络能有效识别图像中的油茶果目标,召回率为82.97%;该网络同样适用于阴天部分遮挡情况的油茶果识别,召回率为81.22%。另外部分青色和红色小果与检测背景相似,存在一定的漏识别现象,说明不同成熟度的果实颜色对油茶果检测精度有一定影响。总体上,Mask RCNN网络检测油茶果的精度较高,能够用于后续油茶样木的快速估产。

注:原图大小均为5 472像素×3 648像素,放大图大小为684像素×456像素;矩形框上方的数字表示目标为油茶果的概率。

Note: The size of the original image is 5 472 pixels×3 648 pixels, and the size of the enlarged image is 684 pixels×456 pixels; the number above the rectangular box represents the probability that the target is a camellia oleifera fruit.

图4 Mask RCNN网络对不同光照条件油茶果的检测效果

Fig.4 Detection effects of Mask RCNN network on camellia oleifera under different lighting conditions

3.3 样木产量数据统计

根据油茶冠层果识别结果,对研究区120株油茶样木的产量数据分别进行统计(表3)。分析可知,油茶样木冠层果数和单株果数平均值分别为38和133,在2~153和8~532之间变化;单株产量和单果质量平均值分别为2.652和0.020 kg,介于0.042~10.542和0.004~0.047 kg之间,说明研究区油茶样木产量普遍不高,具有一定的改良空间。另外,4类油茶产量数据均表现出不同程度的差异性,变化范围介于30.00%~96.42%之间,说明本文选择的油茶样木具有一定的代表性,可能受油茶结实大小年、油茶品种和种植环境等因素影响,统计的产量数据呈现出较强的变异性。

3.4 估产结果分析

3.4.1 单株果数估计

基于预测的冠层果数据,构建冠层果数与单株果数之间的经验模型,其中80株样木数据用于模型构建,预留的40株样木数据用于精度验证,具体结果如表4所示。

分析可知,2种方法的2均不低于0.871,NRMSE均低于38%;其中LR模型估算精度较高,2和NRMSE分别为0.888和36.23%;KNN模型精度略低于LR模型。说明采用Mask RCNN网络预测的冠层果数与实测的单株果数之间存在良好的线性拟合关系,证明了基于冠层果数拟合样木单株果数的有效性。

表3 研究区油茶样木产量数据统计结果

SD: Standard deviation; CV: Coefficient of variation.

表4 基于冠层果数拟合的单株果数精度检验结果

NRMSE: Normalized Root Mean Square Error.

3.4.2 估产精度评价

基于冠层果数拟合的单株果数,利用公式(4)对研究区剩余的40株油茶样木进行产量估测,估产精度验证结果如图5所示。

分析图5可知,2种方法均取得较好的估产效果,2和NRMSE分别在0.892~0.913和28.01%~31.00%之间变化。估产精度方面,LR的估产精度略高于KNN,2和NRMSE分别为0.913和28.01%,说明基于冠层果数拟合的油茶样木单株果数与单株产量之间存在良好的线性关系,本文方法具有较好的稳定性和有效性。

4 讨 论

4.1 油茶果样本集扩增

相关研究表明,数据扩增是一种常用的数据增强方法,可在增加样本数量的同时减少模型训练出现的过度拟合[26]。考虑油茶果颜色与油茶叶片的相似性,以及无人机航拍的影像数量有限和环境的不确定性,难以满足Mask RCNN网络训练的样本需求,研究采用图像缩放、亮度、对比度、噪声注入以及翻转等方法,对已标注的样本进行数据扩增,结果表明适当的数据扩增操作,能够提高模型的泛化能力,减少复杂环境对油茶果识别造成的不良影响,提高油茶果的识别精度。这与已有学者采用数据增强技术扩充样本数据集缓解过拟合的研究结论相似[27],随着研究的持续开展,后续将围绕油茶果样本数据集的标准化开展深入研究。

4.2 油茶果自动检测的影响因素

本研究采用Mask RCNN网络对不同光照条件的油茶冠层果进行识别,结果表明该网络不仅能准确提取目标油茶果的定位框,还能准确绘制目标油茶果的二值掩码,说明该网络具有良好的准确性和稳定性,检测油茶果的精度均较高[28],预测的油茶果数量能够用于后续研究;已有研究表明,遮挡重叠、分布密集、背景相似以及表面阴影是影响目标对象精准识别的主要干扰因素[29],本文通过采用全卷积神经网络FCN提取油茶果目标的准确特征,一定程度减少背景、遮挡、重叠和阴影等因素的干扰,实现油茶果目标的高效识别,这与已有学者采用全卷积神经网络检测苹果的研究结论相似[30]。随着样本数据集的积累,后续将围绕遮挡、重叠、背景(如不同成熟度的果实颜色)以及阴影等影响因素开展深入研究,以期进一步提高油茶果自动检测的精度。

4.3 估产模型精度比较

为提高作物产量的估算精度,本研究以无人机航拍影像为数据源,采用Mask RCNN网络开展基于近景影像的油茶冠层果自动检测与计数,然后利用2种方法建立预测的冠层果数与单株果数之间的关系,构建基于冠层果自动检测的估产模型,旨在为无人机遥感在大面积作物快速估产中的应用提供一种新的思路。虽然由传统卫星遥感估算的作物产量在区域和国家尺度可以接受,但是不能精确到单株样木的产量估算,主要受卫星遥感空间分辨率的限制[18, 31-32]。同传统卫星遥感相比,基于无人机近景摄影的冠层果自动检测在作物产量估测方面显示出明显的优势,因为来自无人机超低空近景拍摄的高清影像可以实现油茶样木冠层果的准确检测与计数。

研究表明,由Mask RCNN网络检测的油茶冠层果数与单株果数之间具有良好的一致性,可作为大面积油茶林产量估算的真值数据。另外受无人机超低空航拍数据的限制,本文只是利用随机抽样采集部分典型油茶样木的高清影像,通过高清影像预测的冠层果数拟合单株果数,同时结合研究区油茶样木株数和实测单果质量,探索构建基于冠层果自动检测的估产模型的可行性。利用无人机超低空近景影像和实测产量数据开展大面积油茶林的精细化估产将是下一步的研究重点。众所周知,油茶产量的估算精度受多种因素的影响,如油茶的生长年份、大小年和不同品种等。随着研究的持续推进,后续将围绕不同区域、不同年份、不同品种和不同种植密度开展试验研究,以填补油茶估产模型研究的空白。

5 结 论

随着无人机遥感的快速发展,基于冠层影像的农作物估产得到了广泛关注,然而鲜有基于冠层果自动检测的油茶快速估产报道。鉴于此,研究以无人机航拍影像为数据源,通过随机抽样方法选取120株油茶树进行无人机近景拍摄和人工采摘称量;然后利用Mask RCNN开展油茶冠层果的自动检测与计数;最后利用两种方法拟合冠层果数和单株果数之间的关系,同时结合油茶样木总株数和实测单果质量,构建基于冠层果自动检测的估产模型。结果表明:

1)借助无人机超低空近景摄影,利用Mask RCNN网络能够有效识别不同光照条件的油茶果,平均F1值达89.91%,可作为后续产量估测的真值数据;

2)同传统的卫星遥感相比,基于无人机近景摄影的冠层果自动检测在作物产量估测方面显示出明显的优势,Mask RCNN网络预测的冠层果数与单株果数之间具有良好的一致性,决定系数2不低于0.871;

3)估产结果表明,结合2种方法(线性回归和K最邻近)构建的模型估产精度均较高,拟合决定系数2和NRMSE分别在0.892~0.913和28.01%~31.00%间变化,说明基于冠层果自动检测的油茶估产方法具有较高的稳定性和适用性,是一种可推广的作物估产方法。

[1] 张东生,金青哲,薛雅琳,等. 油茶籽油的营养价值及掺伪鉴定研究进展[J]. 中国油脂,2013,38(8):47-50.

Zhang Dongsheng, Jin Qingzhe, Xue Yalin, et al. Nutritional value and adulteration identification of oil tea camellia seed oil[J]. China Oils and Fats, 2013, 38(8): 47-50. (in Chinese with English abstract)

[2] Gongal A, Amatya S, Karkee M, et al. Sensors and systems for fruit detection and localization: A review[J]. Computers and Electronics in Agriculture, 2015, 116: 8-19.

[3] 李昕,李立君,高自成,等. 基于偏好人工免疫网络多特征融合的油茶果图像识别[J]. 农业工程学报,2012,28(14):133-137.

Li Xin, Li Lijun, Gao Zicheng, et al. Image recognition of camellia fruit based on preference for aiNET multi-features integration[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2012, 28(14): 133-137. (in Chinese with English abstract)

[4] 李立君,阳涵疆. 基于改进凸壳理论的遮挡油茶果定位检测算法[J]. 农业机械学报,2016,47(12):285-292,346.

Li Lijun, Yang Hanjiang. Revised detection and localization algorithm for camellia oleifera fruits based on convex hull theory[J]. Transactions of the Chinese Society for Agricultural Machinery, 2016, 47(12): 285-292, 346. (in Chinese with English abstract)

[5] Gongal A, Karkee M, Amatya S. Apple fruit size estimation using a 3D machine vision system[J]. Information Processing in Agriculture, 2018, 5(4): 498-503.

[6] Zhou R, Damerow L, Sun Y, et al. Using colour features of cv. ‘Gala’ apple fruits in an orchard in image processing to predict yield[J]. Precision Agriculture, 2012, 13(5): 568-580.

[7] Kurtulmus F, Lee W S, Vardar A. Green citrus detection using ‘eigenfruit’, color and circular Gabor texture features under natural outdoor conditions[J]. Computers and Electronics in Agriculture, 2011, 78(2): 140-149.

[8] Yamamoto K, Guo W, Yoshioka Y, et al. On plant detection of intact tomato fruits using image analysis and machine learning methods[J]. Sensors, 2014, 14(7): 12191-12206.

[9] 李昕,李立君,高自成,等. 改进类圆随机Hough变换及其在油茶果实遮挡识别中的应用[J]. 农业工程学报,2013,29(1):164-170.

Li Xin, Li Lijun, Gao Zicheng, et al. Revised quasi-circular randomized hough transform and its application in camellia-fruit recognition[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2013, 29(1): 164-170. (in Chinese with English abstract)

[10] Lin G C, Tang Y C, Zou X J, et al. Guava detection and pose estimation using a low-cost RGB-D sensor in the field[J]. Sensors, 2019, 19(2): 428.

[11] 张习之,李立君. 基于改进卷积自编码机的油茶果图像识别研究[J]. 林业工程学报,2019,4(3):118-124.

Zhang Xizhi, Li Lijun. Research of image recognition of camellia oleifera fruit based on improved convolutional auto-encoder[J]. Journal of Forestry Engineering, 2019, 4(3): 118-124. (in Chinese with English abstract)

[12] Koirala A, Walsh K B, Wang Z, et al. Deep learning for real-time fruit detection and orchard fruit load estimation: Benchmarking of ‘MangoYOLO’[J]. Precision Agriculture, 2019, 20(6): 1107-1135.

[13] Wang Z, Walsh K, Koirala A. Mango fruit load estimation using a video based Mango YOLO-Kalman filter-hungarian algorithm method[J]. Sensors, 2019, 19(12): 2742.

[14] Zhuang J J, Luo S M, Hou C J, et al. Detection of orchard citrus fruits using a monocular machine vision-based method for automatic fruit picking applications[J]. Computers and Electronics in Agriculture, 2018, 152: 64-73.

[15] Rahnemoonfar M, Sheppard C. Deep count: Fruit counting based on deep simulated learning[J]. Sensors, 2017, 17(4): 905.

[16] Häni N, Roy P, Isler V. Apple counting using convolutional neural networks[C]//2018 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS). IEEE, 2018: 2559-2565.

[17] Wu S R, Yang P, Chen Z X, et al. Estimating winter wheat yield by assimilation of remote sensing data with a four-dimensional variation algorithm considering anisotropic background error and time window[J]. Agricultural and Forest Meteorology, 2021, 301: 108345.

[18] 徐权,郭鹏,祁佳峰,等. 基于无人机影像的SEGT棉花估产模型构建[J]. 农业工程学报,2020,36(16):44-51.

Xu Quan, Guo Peng, Qi Jiafeng, et al. Construction of SEGT cotton yield estimation model based on UAV image[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(16): 44-51. (in Chinese with English abstract)

[19] García-Martínez H, Flores-Magdaleno H, Ascencio-Hernández R, et al. Corn grain yield estimation from vegetation indices, canopy cover, plant density, and a neural network using multispectral and RGB images acquired with unmanned aerial vehicles[J]. Agriculture, 2020, 10(7): 277.

[20] 周小成,何艺,黄洪宇,等. 基于两期无人机影像的针叶林伐区蓄积量估算[J]. 林业科学,2019,55(11):117-125.

Zhou Xiaocheng, He Yi, Huang Hongyu, et al. Estimation of forest stand volume on coniferous forest cutting area based on two periods unmanned aerial vehicle images[J]. Scientia Silvae Sinicae, 2019, 55(11): 117-125. (in Chinese with English abstract)

[21] Zhou J, Zhou J F, Ye H, et al. Yield estimation of soybean breeding lines under drought stress using unmanned aerial vehicle-based imagery and convolutional neural network[J]. Biosystems Engineering, 2021, 204: 90-103.

[22] Apolo Apolo O E, Martínez-Guanter J, Egea G, et al. Deep learning techniques for estimation of the yield and size of citrus fruits using a UAV[J]. European Journal of Agronomy, 2020, 115: 126030.

[23] Khan M A, Akram T, Zhang Y D, et al. Attributes based skin lesion detection and recognition: A mask RCNN and transfer learning-based deep learning framework[J]. Pattern Recognition Letters, 2021, 143: 58-66.

[24] Lin T Y, Dollár P, Girshick R, et al. Feature Pyramid networks for object detection[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2017: 2117-2125.

[25] 严恩萍,赵运林,林辉,等. 基于地统计学和多源遥感数据的森林碳密度估算[J]. 林业科学,2017,53(7):72-84.

Yan Enping, Zhao Yunlin, Lin Hui, et al. Estimation of forest carbon density based on geostatistics and multi-r esource remote sensing data[J]. Scientia Silvae Sinicae, 2017, 53(7): 72-84. (in Chinese with English abstract)

[26] Pinheiro P O, Collobert R, Dollar P. Learning to segment object candidates[J]. NIPAS’15: Proceedings of the 28thInternational Conference on Neural Information Processing System, 2015, 2: 1990-1998.

[27] 赵立新,侯发东,吕正超,等. 基于迁移学习的棉花叶部病虫害图像识别[J]. 农业工程学报,2020,36(7):184-191.

Zhao Lixin, Hou Fadong, Lyu Zhengchao, et al. Image recognition of cotton leaf diseases and pests based on transfer learning[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(7): 184-191. (in Chinese with English abstract)

[28] Fan Z M, Xia W J, Liu X, et al. Detection and segmentation of underwater objects from forward-looking sonar based on a modified Mask RCNN[J]. Signal, Image and Video Processing, 2021, 15: 1135-1143.

[29] Jia W K, Tian Y Y, Luo R, et al. Detection and segmentation of overlapped fruits based on optimized mask R-CNN application in apple harvesting robot[J]. Computers and Electronics in Agriculture, 2020, 172: 105380.

[30] 王丹丹,何东健. 基于R-FCN深度卷积神经网络的机器人疏果前苹果目标的识别[J]. 农业工程学报,2019,35(3):156-163.

Wang Dandan, He Dongjian. Recognition of apple targets before fruits thinning by robot based on R-FCN deep convolution neural network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(3): 156-163. (in Chinese with English abstract)

[31] Yu N, Li L, Schmitz N, et al. Development of methods to improve soybean yield estimation and predict plant maturity with an unmanned aerial vehicle based platform[J]. Remote Sensing of Environment, 2016, 187: 91-101.

[32] 刘焕军,孟令华,张新乐,等. 基于时间序列Landsat 影像的棉花估产模型[J]. 农业工程学报,2015,31(17):215-220.

Liu Huanjun, Meng Linghua, Zhang Xinle, et al. Estimation model of cotton yield with time series Landsat images[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2015, 31(17): 215-220. (in Chinese with English abstract)

Rapid estimation of camellia oleifera yield based on automatic detection of canopy fruits using UAV images

Yan Enping, Ji Yu, Yin Xianming, Mo Dengkui※

(1.,,410004,; 2.,,410004,; 3.,410004,)

Rapid and accurate yield estimation is of great significance to the management and sustainable development of Camellia oleifera production. The quantity and single fruit weight of camellia fruits are crucial indicators representing the Camellia yield. Therefore, a highly efficient and accurate monitoring of the quantity and single fruit weight of Camellia fruits can contribute to saving labor, material, and financial resources, as well as timely decision-making. Unmanned aerial vehicle (UAV) remote sensing has presented a high spatial resolution, fast data acquisition, and simple operation in recent years. An optimal operation period can be selected to obtain high-resolution aerial images, and thereby to realize the crop yield estimation in a large scale using the fruit numbers. However, only a few kinds of research are focused on the estimation of Camellia yield using UAV images and fruit number identification. In this study, a rapid yield estimation of Camellia oleifera was realized via the automatic detection of canopy fruit using UAV images. Firstly, a DJI Mavic 2 PRO UAV platform and Hasselblad L1D-20C camera were utilized to obtain UAV aerial images in the study area. 120 camellia oleifera trees were selected by random sampling for close-up UAV shooting, and manual picking, and weighing. A Mask RCNN framework was then employed to automatically detect and count the canopy fruits in the sample trees using UAV close-up images. Finally, two common Linear Regression (LR) and K-Nearest Neighbor (KNN) were used to build the relationship between the predicted fruit numbers of tree canopy and the measured. A yield estimation model was thus constructed using automatic detection of canopy fruits, according to the total numbers of sample trees and the average weight of single fruit. The results showed that: (1) There was an excellent performance of crop yield estimation via the automatic detection of canopy fruits using close-range photography of UAV, compared with the traditional method. (2) UAV ultra-low-altitude close-up images combined with Mask RCNN network effectively detected the camellia oleifera fruits under different lighting conditions, with an average F1 value of 89.91%. (3) There was well consistency between the predicted fruit numbers of tree canopy identified by Mask RCNN network and the measured, with2higher than 0.871. (4) The yield estimation results showed that the combined LR/KNN models presented a higher accuracy of yield estimation with2and NRMSE ranging from 0.892 to 0.913, and 28.01% to 31.00%, respectively. Consequently, the rapid yield estimation of Camellia oleifera sample trees can be achieved using automatic detection of canopy fruits from UAV images. The finding can provide highly versatile and great potential for rapid yield estimation and intelligent monitoring of the crops or trees in large areas.

UAV; automatic detection; Camellia oleifera; rapid yield estimation; canopy fruit

严恩萍,棘玉,尹显明,等. 基于无人机影像自动检测冠层果的油茶快速估产方法[J]. 农业工程学报,2021,37(16):39-46.doi:10.11975/j.issn.1002-6819.2021.16.006 http://www.tcsae.org

Yan Enping, Ji Yu, Yin Xianming, et al. Rapid estimation of camellia oleifera yield based on automatic detection of canopy fruits using UAV images[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(16): 39-46. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2021.16.006 http://www.tcsae.org

2021-04-01

2021-07-14

国家自然科学基金项目(31901311,32071682)

严恩萍,博士,讲师,研究方向为林业遥感与地理信息系统应用。Email:Enpingyan@csuft.edu.cn

莫登奎,副教授,研究方向为林业遥感与人工智能应用。Email:dengkuimo@csuft.edu.cn

10.11975/j.issn.1002-6819.2021.16.006

S127;S757.2

A

1002-6819(2021)-16-0039-08