改进Mask R-CNN的温室环境下不同成熟度番茄果实分割方法

2021-11-24龙洁花赵春江郭文忠文朝武

龙洁花,赵春江,林 森,郭文忠,文朝武,张 宇

•农业信息与电气技术•

改进Mask R-CNN的温室环境下不同成熟度番茄果实分割方法

龙洁花1,2,赵春江1,2,林 森2※,郭文忠2,文朝武1,2,张 宇2

(1. 上海海洋大学信息学院,上海 01306;2. 北京市农林科学院智能装备技术研究中心,北京 00097)

基于深度神经网络的果实识别和分割是采摘机器人作业成功的关键步骤,但由于网络参数多、计算量大,导致训练时间长,当模型部署到采摘机器人上则存在运行速度慢,识别精度低等问题。针对这些问题,该研究提出了一种改进Mask R-CNN的温室环境下不同成熟度番茄果实分割方法,采用跨阶段局部网络(Cross Stage Partial Network,CSPNet)与Mask R-CNN网络中的残差网络(Residual Network,ResNet)进行融合,通过跨阶段拆分与级联策略,减少反向传播过程中重复的特征信息,降低网络计算量的同时提高准确率。在番茄果实测试集上进行试验,结果表明以层数为50的跨阶段局部残差网络(Cross Stage Partial ResNet50,CSP-ResNet50)为主干的改进Mask R-CNN模型对绿熟期、半熟期、成熟期番茄果实分割的平均精度均值为95.45%,F1分数为91.2%,单张图像分割时间为0.658 s。该方法相比金字塔场景解析网络(Pyramid Scene Parsing Network,PSPNet)、DeepLab v3+模型和以ResNet50为主干的Mask R-CNN模型平均精度均值分别提高了16.44、14.95和2.29个百分点,相比以ResNet50为主干的Mask R-CNN模型分割时间减少了1.98%。最后将以CSP- ResNet50为主干的改进Mask R-CNN模型部署到采摘机器人上,在大型玻璃温室中开展不同成熟度番茄果实识别试验,该模型识别正确率达到90%。该研究在温室环境下对不同成熟度番茄果实具有较好的识别性能,可为番茄采摘机器人精准作业提供依据。

图像处理;机器视觉;模型;番茄;成熟度分割;Mask R-CNN;残差网络;跨阶段局部网络

0 引 言

番茄是全球栽培最为普遍的蔬菜之一,在欧美、中国和日本等国家大多采用设施栽培方式[1]。设施农业中番茄采摘主要依靠人工作业,其劳动强度大、工作效率低[2]。番茄采摘机器人可节约劳动力、提升生产效率,对工厂化番茄种植具有重要意义。制约番茄采摘机器人执行采摘的关键是番茄果实的识别、分割和定位[3]。由于识别果实的深度神经网络参数多,计算量大,同时番茄果实所处为非结构化环境,光照复杂,果实之间存在密集分布、遮挡等因素[4],导致网络识别精度低,运行速度慢。因此,亟需研究一种温室环境下番茄果实识别与分割方法。

近年来,国内外学者对果蔬的识别和分割开展了大量的研究,其中包括传统分割方法和目前流行的基于深度学习的分割方法。传统分割方法主要包括基于阈值的分割方法、基于区域生长的分割方法和基于边缘检测的分割方法等,用于从不同颜色空间中提取果蔬的外观特征,包括颜色、纹理、形状等。王春雷等[5]以根茬顶端切口为目标,提出一种基于遗传算法和阈值滤噪的玉米根茬行分割方法,该方法分割玉米根茬行平均相对目标面积误差率为24.68%,具有较好的分割准确率,但当行间秸秆也在根茬行上时,将被视为玉米根茬切口,易导致误分割。孙建桐等[6]以串收番茄为研究对象,利用Canny边缘检测算法对图像进行分割,获得果实轮廓点,结果表明果实识别正确率为85.1%,该方法在一定程度上解决了多个果实粘连的分割问题,但是浪费了大量非果实粘连处的点。深度学习分割中语义分割和实例分割较为流行,语义分割实现像素级别的分类,而实例分割不仅要实现像素级别上的分类,还要在具体类别基础上划分出不同的实例个体。Peng等[7]采用DeepLab v3+模型对荔枝枝条进行分割,DeepLab v3+模型采用编码和解码结构减少网络参数数量,同时使用空间金字塔池化提取语义像素位置信息,试验结果表明,模型对荔枝枝条分割的平均交并比为76.5%,该模型只对类别分割,未对同一类别中不同实例进行划分。Jia等[8]提出使用Mask R-CNN模型对果园中重叠绿色苹果进行识别和分割,将残差网络与密集连接卷积网络相结合作为骨干网络提取特征,该方法对120幅图像的苹果检测结果表明,平均检测准确率为97.31%,但由于数据集太少,仍需增加样本集和丰富样本多样性以更具说服力。Afonso等[9]使用RealSense相机拍摄温室中番茄果实图像,采用Mask R-CNN模型检测成熟和未成熟番茄果实,试验结果表明,使用ResNext101为主干的Mask R-CNN模型检测成熟番茄和未成熟番茄准确率分别达到95%和94%,该方法虽准确率高,但试验仅在番茄果实没有遮挡情况下进行的,未考虑遮挡和重叠等环境因素。岳有军等[10]提出一种改进型Mask R-CNN模型对苹果进行检测研究,该方法在原始Mask R-CNN网络基础上增加边界加权损失函数,使边界检测更加准确,训练后的模型在验证集下精度为92.62%,同时在不同果实数目、不同光照和识别绿色苹果情况下,该模型具有较好的分割效果,但仍有待进一步优化提高检测精度。

综上,国内外学者针对果实分割做了大量研究,为进一步提高复杂环境下番茄果实识别率和网络运行速度,本研究提出将跨阶段局部网络(Cross Stage Partial Network,CSPNet)引入Mask R-CNN网络中对不同成熟度番茄果实进行识别和分割。将跨阶段局部网络与残差网络(Residual Network,ResNet)相融合,通过跨阶段拆分与级联策略,减少特征传播过程中重复的信息,从而降低网络计算量,提高网络运行速度。最后将改进的Mask R-CNN模型部署到番茄采摘机器人上,对温室环境下不同成熟度番茄果实进行识别试验,为番茄采摘机器人精准作业提供参考。

1 材料与方法

1.1 样本采集及预处理

1.1.1 样本采集

本研究番茄果实数据采集于全国蔬菜质量标准中心(山东寿光,中国)的智慧农业科技园,试验番茄品种为“意佰芬”,根据采摘需求将番茄果实成熟度定义为绿熟期、半熟期、成熟期[11],其中成熟期番茄为最佳采摘时期。采用三维(3D)工业相机图漾(FM850-GI-E1,上海图漾信息科技有限公司,中国)采集番茄样本,相机分辨率为1 280×960像素,像素精度为4 mm,安装在国家农业智能装备工程技术研究中心(北京,中国)自主研发的番茄采摘机器人上,通过手动操作机器人进行样本采集。为保证番茄果实样本的多样性,分别采集不同光照强度(正常光和弱光)、不同果实数量、不同遮挡程度的番茄果实样本共1 000张(图1),其中绿熟期图片175张,半熟期图片73张,成熟期图片206张,包含多种成熟度果实的图片546张。

1.1.2 样本增强

为提高网络训练模型效果和模型泛化能力,采用数据增强方法增加番茄样本数量[12],防止网络因训练样本不足导致过拟合,其次采用数据增强方法模拟温室实际环境中不同光照的样本采集效果。本研究分别从绿熟期、半熟期、成熟期和包含多种成熟度的番茄样本中选取50 张原始数据,共200 张,利用翻转、调整图像的亮度、对比度和颜色对番茄样本进行数据增强(图2)。数据增强的样本共1 000张,与原番茄样本合计共2 000 张,并按照15∶3∶2的比例将数据集划分为训练集(1 500张)、测试集(300张)、验证集(200张)。

1.2 番茄果实分割模型

1.2.1 改进的Mask R-CNN网络模型

Mask R-CNN[13]是经典的实例分割网络,在Faster R-CNN[14]基础上添加了一个以全卷积网络(Fully Convolutional Network,FCN)[15]为主的掩膜分支用于预测分割任务,与分类和回归分支并行,使Mask R-CNN不仅可以检测物体,还具有语义分割功能,实现检测与分割于一体,同时引入兴趣区域对齐层(Region of Interest Align layer,RoI Align)保证特征图与输入像素一一对应,以提高分割精度。Mask R-CNN采用残差网络(ResNet)[16]和特征金字塔网络(Feature Pyramid Network,FPN)[17]作为主干网络提取特征,残差网络在浅层网络和深层网络间以跳跃连接的方式将输入直接与输出相加,用于解决深度神经网络中的梯度消失或梯度爆炸问题[18-19],但由于其网络参数多、计算量大,导致网络训练时间长、运行速度慢。

针对上述问题,本研究设计了一种跨阶段局部残差网络(Cross Stage Partial Residual Network,CSP-ResNet),该网络将跨阶段局部网络(CSPNet)[20]与Mask R-CNN中的残差网络相融合,将基础层特征映射成2部分,通过跨阶段拆分与级联策略,有效解决了深度网络重复学习梯度信息造成计算量大的问题,在降低了计算量的同时还提高了准确率。改进的Mask R-CNN网络结构如图3所示。

主干网络由层数为50的跨阶段局部残差网络(Cross Stage Partial ResNet50,CSP-ResNet50)或层数为101的跨阶段局部残差网络(Cross Stage Partial ResNet101,CSP-ResNet101)和特征金字塔网络组成,跨阶段局部残差网络提取输入图像的特征信息,通过卷积核大小为1×1的卷积层将特征传入特征金字塔网络中,特征金字塔网络采用双金字塔结构将底层特征和高层特征融合,提取跨阶段局部残差网络中各个跨阶段局部残差模块的特征,用于解决多尺度预测问题。主干网络提取的特征传入区域生成网络(Region Proposal Network,RPN)中产生感兴趣区域(Region of Interest,RoI),RPN分别采用卷积核大小为1×1的卷积层对RoI进行分类和回归,生成候选区域,兴趣区域对齐层将候选区域像素与主干网络提取的特征图一一对应,产生相同尺寸的特征,以提高掩膜准确率。网络头部由类别、边界框和掩膜分支组成,类别分支采用全连接层和Softmax分类器对目标进行分类并输出类别概率,边界框分支采用全连接层和边界框回归对目标进行定位,掩膜分支采用全连接网络实现像素到像素上的掩膜分割,掩膜损失值采用带权交叉熵损失函数计算。改进的Mask R-CNN网络相较于Mask R-CNN在跨阶段局部残差网络和掩膜损失函数两方面做了改进,具体实现如下:

1)跨阶段局部残差网络

将跨阶段局部网络与Mask R-CNN的主干网络中层数为50和101的残差网络融合,跨阶段局部残差网络结构如图4所示。输入特征通过卷积核大小为7×7、通道数为64、步长为2的基础层,再通过卷积核大小为3×3和步长为2的最大池化层后,通道数增加至原来的4倍,进入跨阶段局部残差模块。跨阶段局部残差模块由残差块和2个卷积层组成,每个残差块由3个卷积层组成,残差块之间以跳跃连接的方式将浅层网络与深层网络特征融合用于解决梯度消失或梯度爆炸问题,2个卷积层都使用1×1卷积核对特征图进行降维,减少网络参数。跨阶段局部残差模块1中残差块步长都为1;跨阶段局部残差模块2中残差块2的第1个残差的第2个卷积步长为2,通道数增加至原来的2倍;跨阶段局部残差模块3和跨阶段局部残差模块4中残差的步长变化与跨阶段局部残差模块2相同。每个跨阶段局部残差模块使用拆分与级联策略将反向传播过程中的梯度流截断,防止不同层重复学习梯度信息,以减少网络参数。网络最后通过卷积核为1×1、通道数为1 000的卷积层将特征融合输出。

2)掩膜损失函数

Mask R-CNN网络经过特征区域筛选,网络头部对各特征图进行分类、边框和掩膜计算,网络整体损失值为分类、边框和掩膜三者损失值之和,其中掩膜损失值采用平均二值交叉熵损失函数(mask)计算如式(1)所示

式中表示样本总数;(i)表示样本的期望输出,值为0或1;(i)表示样本的实际输出,即分割结果。

掩膜分支处理感兴趣区域(RoI)产生××(为实例类别个数,=80,一般为14或28)的特征图大小,在分辨率为×像素上有个二分类掩膜,每个像素点都应用了Sigmoid激活函数,为每个类别都产生掩膜,即对于一个属于第个类别的感兴趣区域,mask仅考虑第个掩膜。在分割时,若第个类别像素数量小于背景像素数量时,平均二值交叉熵损失函数会导致样本数较少的类别分割效果较差。

本研究采集的番茄果实样本中半熟期番茄数量少于绿熟期和成熟期,整体样本存在不均衡的情况,在原交叉熵损失函数基础上添加权重因子后的交叉熵损失函数(mask+weight)的计算如式(2)所示。

1.2.2 对照组网络

对照组网络分别为Mask R-CNN网络、金字塔场景解析网络(Pyramid Scene Parsing Network,PSPNet)[21]和DeepLab v3+网络[22],本研究将改进的Mask R-CNN网络与对照组各网络分别对温室环境下不同成熟度番茄图像进行了分割。

PSPNet和DeepLab v3+是经典的语义分割网络,数据标注采用Labelme[23]工具,生成的标签文件需转换为灰度图。PSPNet通过MobileNet[24]主干网络和空洞卷积策略提取特征,特征经过金字塔池化模块(Pyramid Pooling Module)得到融合的带有全局信息的特征,将融合后的特征进行上采样,最后通过一个卷积层输出语义分割结果。DeepLab v3+以DeepLab v3为基础,通过Xception-65[25]主干网络提取特征,使用空间金字塔池化(Spatial Pyramid Pooling,SPP)[26]和编码-解码结构实现语义分割,空间金字塔池化在不同尺度特征层上进行池化操作获取丰富的上下层信息,编码-解码结构采用大小为3×3的卷积核提取上下层信息,得到物体的空间信息,最后通过上采样输出预测结果。

1.2.3 评价指标

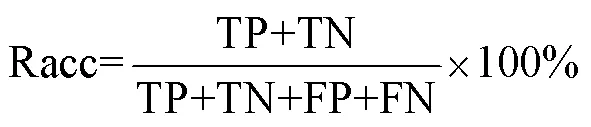

采用的性能评价指标主要包括准确率(Precision,,%)、召回率(Recall,,%)、平均精度(Average Precision,AP,%)、平均精度均值(Mean Average Precision,MAP,%)、F1分数(F1-score)、识别正确率(Recognition accuracy,Racc,%),各评价指标计算如式(3)~(8)所示

式中TP表示模型预测为正的正样本,FP表示模型预测为正的负样本,FN表示模型预测为负的正样本,TN表示模型预测为负的负样本;AP是准确率在召回率上的积分,一般AP值越高,模型性能越好;MAP为每一类别的AP的平均值,其中为类别数,本研究中=3;F1-score为准确率和召回率的调和平均值,取值范围为[0,1],1代表模型输出最好,0代表模型输出最差;Racc为本研究模型部署到机器人上的识别正确率。

模型运行速度评估指标采用模型分割单张图片所耗费的平均时间(即平均分割时间,s)表示。

1.3 试验设计

1.3.1 试验环境

本试验主机操作系统为Ubuntu16.04,中央处理器为Intel® CoreTM i7-9800X CPU @ 3.8 GHz×16,运行内存为16 GB,显卡为GeForce GTX 1080ti。神经网络在Anaconda3虚拟环境下训练,分别采用Tensorflow1.13.1和Keras2.2.4、Tensorflow1.14.0和Keras2.2.5深度学习框架以适应不同网络训练需求,配置安装Python3.7编程环境、GPU并行计算架构Cuda10.0和深度神经网络GPU加速库Cudnn7.4。

1.3.2 试验参数

1)改进的Mask R-CNN 和Mask R-CNN模型参数

改进的Mask R-CNN和Mask R-CNN模型均采用MS COCO数据集的预训练权重训练,每个批次处理1 张图片,图片最大维度设置为768,最小维度设置为384,区域生成网络(RPN)锚框大小分别为8×6、16×6、32×6、64×6和128×6,每张图片训练的RoI为100,每轮迭代次数为50,验证次数为50,网络头部训练学习率为0.001,整个网络训练初始学习率为0.001,每迭代100 次,学习率降低0.1,总迭代次数均设置为1 000,网络权重衰减系数为0.000 1,动量为0.9。

2)其他对照组模型参数

本研究中其他对照组模型为PSPNet和 DeepLab v3+网络,均采用PASCAL VOC(PASCAL Visual Object Classes)预训练模型训练。PSPNet和DeepLab v3+网络训练图片分辨率大小设置为768像素×384 像素,总迭代次数为1 000,初始学习率为0.001,每迭代100次,学习率降低0.1,其余参数设置与文献[21-22]中参数一致。

1.3.3 对比试验

1)掩膜损失函数对比试验

改进的Mask R-CNN采用带权交叉熵损失函数计算掩膜损失值,分别以CSP-ResNet50和CSP-ResNet101作为主干网络训练模型;Mask R-CNN采用平均二值交叉熵损失函数计算掩膜损失值,分别以ResNet50和ResNet101作为主干网络训练模型。通过对比训练损失函数曲线的收敛程度确定最优主干网络。

2)番茄果实分割模型对比试验

在掩膜损失函数试验的基础上,选出改进的Mask R-CNN和Mask R-CNN的最优主干网络,与基于MobileNet主干网络的PSPNet、基于Xception-65主干网络的DeepLab v3+在番茄果实测试集上进行对比试验,比较不同模型的分割性能。

2 结果与分析

2.1 掩膜损失函数结果分析

改进Mask R-CNN模型采用带权交叉熵损失函数用于计算掩膜损失值,设置权重因子=[0.15, 0.7, 0.15],分别以CSP-ResNet50和CSP-ResNet101作为主干网络训练模型;Mask R-CNN采用平均二值交叉熵损失函数计算掩膜损失值,分别以ResNet50和ResNet101作为主干网络训练模型,不同主干网络模型训练的掩膜损失函数曲线如图5所示。由图5可知,4个主干网络随着迭代次数的增加,网络掩膜损失值逐渐下降并趋于稳定,且在迭代次数为0~200范围内下降速度最快,当迭代次数为800~1 000范围时训练掩膜损失值变化不大基本趋于稳定,网络达到收敛状态。改进Mask R-CNN模型以CSP-ResNet50和CSP-ResNet101作为主干网络的掩膜损失值分别为0.05和0.088,Mask R-CNN模型以ResNet50和ResNet101作为主干网络的掩膜损失值分别为0.174和0.244,由此可知,改进的Mask R-CNN模型采用带权交叉熵损失函数训练,其掩膜损失值低于Mask R-CNN模型,泛化能力较强。

为确定最优主干网络,分别对比这4个主干网络模型在验证集上的性能(表1)。CSP-ResNet50主干网络参数量为24.28 M,模型训练时间为10 h,相比ResNet50主干网络参数量和模型训练时间分别减少5%和16.67%,CSP-ResNet50为主干的改进Mask R-CNN的平均精度均值为94.31%,性能高于其他主干网络模型。CSP-ResNet101主干网络参数量为43.99 M,模型训练时间为14 h,相比ResNet101主干网络参数量和模型训练时间分别减少1.25%和6.67%。CSP-ResNet101为主干的改进Mask R-CNN的平均精度均值为92.92%,与ResNet50为主干的Mask R-CNN模型的平均精度均值差异较小,仅差0.73个百分点,但ResNet50主干网络参数量为25.56 M,模型训练时间为12 h,考虑电脑配置和网络性能等情况,选取CSP-ResNet50和ResNet50分别作为改进模型和Mask R-CNN的最优主干网络,用于番茄果实分割试验。

2.2 番茄果实分割模型性能结果分析

在掩膜损失函数结果分析中分别确定了CSP-ResNet50为改进Mask R-CNN模型的最优主干网络和ResNet50为Mask R-CNN模型的最优主干网络,为进一步验证本研究的以CSP-ResNet50为主干网络的改进Mask R-CNN模型对温室环境下不同成熟度番茄图像分割的性能,将其与以ResNet50为主干网络的Mask R-CNN模型,以MobileNet为主干网络的PSPNet模型,以Xception-65为主干网络的DeepLab v3+模型行分割比较。

以CSP-ResNet50为主干的改进Mask R-CNN模型与其他模型在测试集上对不同成熟度番茄分割的试验结果如表2所示。以CSP-ResNet50为主干的改进Mask R-CNN模型对比以ResNet50为主干的Mask R-CNN模型平均精度均值、准确率、召回率、F1分数分别提高2.29、1.29、2.16和2.01个百分点;其次,以CSP-ResNet50为主干的改进Mask R-CNN模型分割单张图像时间为0.658 s,相比以ResNet50为主干的Mask R-CNN模型减少1.98%。试验结果表明,本研究模型在残差网络中引入跨阶段局部网络,减少特征传播过程中重复的梯度信息,相比残差网络能有效降低网络计算量,提高网络运行速度,网络分割性能在一定程度上相比Mask R-CNN模型有明显提升;以CSP-ResNet50为主干的改进Mask R-CNN模型对比PSPNet和DeepLab v3+模型对不同成熟度番茄果实分割的平均精度均值分别提高16.44和14.95个百分点,F1分数分别提高16.48和14.72个百分点,但本研究模型分割单张图像时间相比PSPNet和DeepLab v3+模型分别增加14.83%和27.52%,主要是因为主干网络CSP-ResNet50和ResNet50相比MobileNet、Xception-65网络层数较深,训练参数多且对硬件配置要求较高,导致模型运行速度相对较慢,综合权衡平均精度均值和运行速度,以CSP-ResNet50为主干的改进的Mask R-CNN模型分割不同成熟度番茄果实更具鲁棒性。

表1 不同主干网络模型在验证集中的性能结果

表2 不同分割模型在测试集中对不同成熟度番茄的分割性能

不同分割方法在测试集上对温室环境下不同成熟度番茄果实的分割效果如图6所示。由图6b和图6c可知,PSPNet和DeepLab v3+模型分割效果较差,分割目标轮廓区域均出现重叠,图6b中PSPNet模型在正常光和弱光环境下分别出现半熟期番茄误分割为成熟期番茄现象和成熟期番茄误分割为半熟期番茄现象,而图6c中DeepLab v3+模型在弱光环境下出现绿熟期番茄误分割为半熟期番茄和半熟期番茄误分割为成熟期番茄现象,可见这2种模型受光照影响较大,尤其是弱光环境下,模型难以区分番茄颜色特征,出现误分割现象。由图6d和图6e可知,以ResNet50为主干的Mask R-CNN模型和以CSP-ResNet50为主干的改进Mask R-CNN模型分割目标轮廓均清晰,但图6d中以ResNet50为主干的Mask R-CNN模型将叶子背景误分割为绿熟期番茄,因为弱光环境下绿熟期番茄颜色特征与背景相近[27],导致模型识别与分割精度下降,而图6e中,以CSP-ResNet50为主干的改进Mask R-CNN模型无误分割现象,能准确提取背景颜色和番茄果实颜色特征,且改进Mask R-CNN模型成功将遮挡严重的绿熟期番茄果实分割。综上,以CSP-ResNet50为主干的改进Mask R-CNN模型在不同光照强度和遮挡环境下对不同成熟度番茄果实具有较好的分割性能。

2.3 改进的Mask R-CNN模型验证

为验证以CSP-ResNet50为主干的改进Mask R-CNN模型的实际分割效果,将其部署到番茄采摘机器人上,对温室环境下不同成熟度番茄识别效果进行验证。机器人平台核心控制器配置为I7-7500 U、8 G运行内存、128 G固态硬盘。

采摘机器人分别从不同光照强度、果实遮挡重叠程度等情况下每隔5 s拍摄1 张番茄果实图像,模型平均每分割1张番茄图像约0.88 s,随机选取4 张样例图片对绿熟期、半熟期、成熟期番茄个数进行人工检验,分别为人工检验轻度遮挡的番茄果实数量和遮挡超过70%的番茄个数,人工检验结果和改进的Mask R-CNN模型识别结果如表3所示。由表3可知,样例3中人工检验轻度遮挡番茄数量和遮挡超过70%番茄数量总和为10个,模型识别番茄总数为9个,正确率达到90%;样例4中模型识别番茄总数为11个,人工检验轻度遮挡番茄数量和遮挡超过70%番茄数量总和为13个,模型识别总数为人工检验总数的84.62%,其中人工检验轻度遮挡的半熟期番茄仅有3个,但模型识别半熟期为4个,是因为绿熟期番茄误分割为半熟期番茄,导致模型分割正确率下降,除去误分割数量,模型识别正确番茄数量为10个,正确率为76.92%;样例1中模型对于遮挡超过70%的番茄果实未识别,识别番茄总数量与人工检验总数量有较大差距,正确率仅为66.67%,是因为番茄果实遮挡超过70%以上时像素少,特征不明显,导致模型难以提取番茄颜色、形状等特征,且遮挡严重时番茄果实表现为小目标,模型识别较为困难。其次,不同光照强度对算法分割性能也有影响,尤其是弱光环境下,会增加模型分割番茄难度,出现误分割现象,导致准确率下降。对于此类问题,后续可以采用农艺农机结合方法来提高设施环境下模型识别正确率。总体上,本研究在实际应用中具有适用性,可为温室环境下采摘机器人精准采摘成熟期番茄奠定基础。

表3 改进的Mask R-CNN模型番茄识别与人工检验对比结果

注:*表示出现误分割现象,人工检验轻度遮挡的半熟期番茄仅有3个,而模型识别半熟期番茄为4个,这是因为模型将绿熟期番茄误分割为半熟期番茄所致。

Note: * indicates that the model has mis-segmentation. There are only 3 half ripe tomatoes with lightly shaded by manual inspection, but 4 half-ripe tomatoes identified by the model. This is because the model misclassifies green ripe tomatoes into half ripe tomatoes.

3 结 论

本研究提出了一种改进Mask R-CNN模型对温室环境下不同成熟度番茄果实进行分割,并将改进的Mask R-CNN模型部署到番茄采摘机器人上进行识别验证,结论如下。

1)本研究在番茄果实测试集上的试验结果表明,以CSP-ResNet50为主干的改进Mask R-CNN模型对番茄果实分割的准确率为95.25%,召回率为87.43%,F1分数为91.2%,平均精度均值为95.45%。本研究模型的平均精度均值相比金字塔场景解析网络(Pyramid Scene Parsing Network,PSPNet)模型、DeepLab v3+模型、以ResNet50为主干的Mask R-CNN模型分别提高了16.44、14.95和2.29个百分点;本研究模型平均分割单张图像的时间为0.658 s,相比以ResNet50为主干的Mask R-CNN模型平均分割单张图像时间减少了1.98%。由于半熟期番茄是绿熟期番茄到成熟期番茄的一个过渡阶段,颜色特征与绿熟期和成熟期些许相似,识别精度低于成熟期和绿熟期,但不影响后期采摘机器人采摘成熟期番茄。

2)将以CSP-ResNet50为主干的改进Mask R-CNN模型部署到番茄采摘机器人上,在温室环境下开展不同成熟度番茄果实识别论证试验,并与人工检验进行对比。试验结果表明,当番茄果实遮挡较低且未误分割时,改进Mask R-CNN模型识别番茄数量与人工检验数量差距较小,正确率达到90%;当番茄果实遮挡严重、光照较弱时,模型识别准确率下降,针对此问题可在未来进一步研究。

[1] 霍建勇. 中国番茄产业现状及安全防范[J]. 蔬菜,2016(6):1-4.

Huo Jianyong. Current status and safety precautions of Chinese tomato industry[J]. Vegetables, 2016(6):1-4. (in Chinese with English abstract)

[2] 张振,王新龙,刘军民,等. 现代果园作业平台与试验[J]. 农业工程,2019,9(6):106-111.

Zhang Zhen, Wang Xinlong, Liu Junmin, et al. Modern orchard operating platform and experiment[J]. Agricultural Engineering, 2019, 9(6): 106-111. (in Chinese with English abstract)

[3] 樊艳英,张自敏,陈冠萍,等. 视觉传感器在采摘机器人目标果实识别系统中的应用[J]. 农机化研究,2019,41(5):210-214.

Fan Yanying, Zhang Zimin, Chen Guanping, et al. Application of vision sensor in the target fruit recognition system of picking robot[J]. Journal of Agricultural Mechanization Research, 2019, 41(5): 210-214. (in Chinese with English abstract)

[4] 刘芳,刘玉坤,林森,等. 基于改进型YOLO的复杂环境下番茄果实快速识别方法[J]. 农业机械学报,2020,51(6):229-237.

Liu Fang, Liu Yukun, Lin Sen, et al. Fast recognition method for tomatoes under complex environments based on improved YOLO[J]. Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(6): 229-237. (in Chinese with English abstract)

[5] 王春雷,卢彩云,陈婉芝,等. 基于遗传算法和阈值滤噪的玉米根茬行图像分割[J]. 农业工程学报,2019,35(16):198-205.

Wang Chunlei, Lu Caiyun, Chen Wanzhi, et al. Image segmentation of maize stubble row based on genetic algorithm and threshold filtering noise[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(16): 198-205. (in Chinese with English abstract)

[6] 孙建桐,孙意凡,赵然,等. 基于几何形态学与迭代随机圆的番茄识别方法[J]. 农业机械学报,2019,50(增刊1):22-26,61.

Sun Jiantong, Sun Yifan, Zhao Ran, et al. Tomato recognition method based on iterative random circle and geometric morphology[J]. Transactions of the Chinese Society for Agricultural Machinery, 2019, 50(Supp. 1): 22-26, 61. (in Chinese with English abstract)

[7] Peng H X, Xue C, Shao Y Y, et al. Semantic segmentation of litchi branches using DeepLab v3+ model[J]. IEEE Access, 2020, 8: 164546-164555.

[8] Jia W K, Tian Y Y, Luo R, et al. Detection and segmentation of overlapped fruits based on optimized Mask R-CNN application in apple harvesting robot[J]. Computers and Electronics in Agriculture, 2020, 172: 1-7.

[9] Afonso M, Fonteijn H, Fiorentin F S, et al. Tomato fruit detection and counting in greenhouses using deep learning[J]. Frontiers in Plant Science, 2020, 11: 571299-571310.

[10] 岳有军,田博凯,王红君,等. 基于改进Mask R-CNN的复杂环境下苹果检测研究[J]. 中国农机化学报,2019,40(10):128-134.

Yue Youjun, Tian Bokai, Wang Hongjun, et al. Research on apple detection in complex environment based on improved Mask R-CNN[J]. Journal of Chinese Agricultural Mechanization, 2019, 40(10): 128-134. (in Chinese with English abstract)

[11] 张靖祺. 基于机器视觉温室番茄成熟度检测研究[D]. 泰安:山东农业大学,2019.

Zhang Jingqi. Research on Maturity Detection of Greenhouse Tomato Based on Machine Vision[D]. Tai’an, Shandong Agricultural University, 2019. (in Chinese with English abstract)

[12] 朱逢乐,郑增威. 基于图像和卷积神经网络的蝴蝶兰种苗生长势评估[J]. 农业工程学报,2020,36(9):185-194.

Zhu Fengle, Zheng Zengwei. Image-based assessment of growth vigor forseedlings using convolutional neural network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(9): 185-194. (in Chinese with English abstract)

[13] He K M, Gkioxari G, Dollar P, et al. Mask R-CNN[C]//Proceedings of 2017 Conference on Computer Vision (ICCV), Venice: IEEE, 2017.

[14] Ren S Q, He K M, Girshick R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149.

[15] Long J, Shelhamer E, Darrell T. Fully convolutional networks for semantic segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(4): 640-651.

[16] He K M, Zhang X Y, Ren S Q, et al. Deep residual Learning for image recognition[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Las Vegas: IEEE, 2016.

[17] Lin T Y, Dollar P, Girshick P, et al. Feature pyramid networks for object detection[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Honolulu: IEEE, 2017.

[18] 王春山,周冀,吴华瑞,等. 改进Multi-scale ResNet的蔬菜叶部病害识别[J]. 农业工程学报,2020,36(20):209-217.

Wang Chunshan, Zhou Ji, Wu Huarui, et al. Identification of vegetable leaf diseases based on improved Multi-scale ResNet[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(20): 209-217. (in Chinese with English abstract)

[19] 娄甜田,杨华,胡志伟. 基于深度卷积网络的葡萄簇检测与分割[J]. 山西农业大学学报:自然科学版,2020,40(5):109-119.

Lou Tiantian, Yang Hua, Hu Zhiwei. Grape cluster detection and segmentation based on deep convolutional network[J]. Journal of Shanxi Agricultural University: Natural Science Edition, 2020, 40(5): 109-119. (in Chinese with English abstract)

[20] Wang C Y, Liao H Y M, Wu Y H, et al. CSPNet: A new backbone that can enhance learning capability of CNN[C]//2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops, Seattle: IEEE, 2020.

[21] Zhao H S, Shi J P, Qi X J, et al. Pyramid scene parsing network[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Honolulu: IEEE, 2017.

[22] Chen L C, Zhu Y K, Papandreou G, et al. Encoder-decoder with atrous separable convolution for semantic image segmentation[C]//Proceedings of the European Conference on Computer Vision, Mountain View: ECCV, 2018.

[23] Russell B C, Torralba A, Murphy K P, et al. LabelMe: A database and web-based tool for image annotation[J]. International Journal of Computer Vision, 2008, 77(1/2/3): 157-173.

[24] Howard A G, Zhu M, Chen B, et al. MobileNets: Efficient convolutional neural networks for mobile vision applications[J/OL]. Computer Vision and Pattern Recognition, 2017, [2017-04-17]. https: //arxiv. org/abs/1704. 04861.

[25] Chollet F. Xception: Deep learning with depthwise separable convolutions[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition, Honolulu: IEEE, 2017.

[26] He K M, Zhang X Y, Ren S Q, et al. Spatial pyramid pooling in deep convolutional networks for visual recognition[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2014, 37(9): 1904-1916.

[27] 廖崴,郑立华,李民赞,等. 基于随机森林算法的自然光照条件下绿色苹果识别[J]. 农业机械学报,2017,48(增刊1):86-91.

Liao Wei, Zheng Lihua, Li Minzan, et al. Green apple recognition in natural illumination based on random Forest algorithm[J]. Transactions of the Chinese Society for Agricultural Machinery, 2017, 48(Supp. 1): 86-91. (in Chinese with English abstract)

Segmentation method of the tomato fruits with different maturities under greenhouse environment based on improved Mask R-CNN

Long Jiehua1,2, Zhao Chunjiang1,2, Lin Sen2※, Guo Wenzhong2, Wen Chaowu1,2, Zhang Yu2

(1.,,201306,; 2.,,100097,)

Fruit recognition and segmentation using deep neural networks have widely been contributed to the operation of picking robots in modern agriculture. However, the most current models present a low accuracy of recognition with a low running speed, due mainly to a large number of network parameters and calculations. In this study, a high-resolution segmentation was proposed for the different ripeness of tomatoes under a greenhouse environment using improved Mask R-CNN. Firstly, a Cross Stage Partial Network (CSPNet) was used to merge with Residual Network (ResNet) in the Mask R-CNN model. Cross-stage splitting and cascading strategies were contributed to reducing the repeated features in the backpropagation process for a higher accuracy rate, while reducing the number of network calculations. Secondly, the cross-entropy loss function with weight factor was utilized to calculate the mask loss for the better segmentation effect of the model, due to the imbalance of the whole sample. An experiment was also performed on the test sets of tomato fruits with three ripeness levels. The results showed that the improved Mask R-CNN model with CSP-ResNet50 as the backbone network presented the mean average precision of 95.45%, the precision of 95.25%, the recall of 87.43%, F1-score of 0.912, and average segmentation time was 0.658 s. Furthermore, the mean average precision increased by 16.44, 14.95, and 2.29 percentage points, respectively, compared with the Pyramid Scene Parsing Network (PSPNet), DeepLab v3+, and Mask R-CNN with ResNet50 as the backbone network. Nevertheless, the average segmentation time increased by 14.83% and 27.52%, respectively, compared with PSPNet and DeepLab v3+. More importantly, the average segmentation time of improved Mask R-CNN with CSP-ResNet50 as the backbone network was reduced by 1.98%, compared with Mask R-CNN with ResNet50 as the backbone network. Additionally, the new model performed well in the segmentation of green and half-ripe tomato fruits under different light intensities, especially under low light, compared with PSPNet and DeepLab v3+. Finally, the improved Mask R-CNN model with CSP-ResNet50 as the backbone network was deployed to the picking robot, in order to verify the recognition and segmentation effect on different ripeness of tomato fruits in large glass greenhouses. In a low overlap rate of tomato fruits, the model identified the number of tomato fruits consistent with manual detection, where the accuracy was more than 90%. When the occlusion or overlap rate of tomato fruits exceeded 70%, particularly when the target was far away, the accuracy of 66.67% was achieved in the improved Mask R-CNN model, indicating a large gap with manual detection. Only a few features with the blur pixels were attributed to the difficulty to extract the shape and color features of tomato fruits. In addition, low light also posed a great challenge on recognition difficulty. Correspondingly, it was more difficult to pick tomatoes for the picking robot, particularly a relatively low success rate of picking, as the overlap was more serious. Fortunately, the picking success rate improved greatly, as the occlusions reduced. Consequently, the integrated multiple technologies (such as image acquisition equipment, the performance of the model, the execution end design of robotic arm, and automatic mechanization) can widely be expected to effectively improve the picking rate of mature tomatoes under the complex environment of a specific greenhouse. The new model also demonstrated strong robustness and applicability for the precise operation of tomato-picking robots in various complex environments.

image processing; machine vision; models; tomato; maturity segmentation; Mask R-CNN; residual network; cross stage partial network

龙洁花,赵春江,林森,等. 改进Mask R-CNN的温室环境下不同成熟度番茄果实分割方法[J]. 农业工程学报,2021,37(18):100-108.doi:10.11975/j.issn.1002-6819.2021.18.012 http://www.tcsae.org

Long Jiehua, Zhao Chunjiang, Lin Sen, et al. Segmentation method of the tomato fruits with different maturities under greenhouse environment based on improved Mask R-CNN[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(18): 100-108. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2021.18.012 http://www.tcsae.org

2020-11-15

2021-07-26

国家自然科学基金项目(31601794);北京市农林科学院青年基金(QNJJ202027);北京市重点研发计划项目(D171100007617003);宁夏回族自治区重点研发计划项目(2018BBF02024)

龙洁花,研究方向为农业机器人和机器视觉。Email:seven060422@163.com

林森,高级工程师,研究方向为农业智能装备。Email:linseng@nercita.org.cn

10.11975/j.issn.1002-6819.2021.18.012

TP391.4

A

1002-6819(2021)-18-0100-09