深度学习驱动的知识追踪研究进展综述

2021-11-12任依梦尚余虎张翼英

梁 琨,任依梦,尚余虎,张翼英,王 聪

天津科技大学 人工智能学院,天津300457

教育信息化的不断推进和“互联网+”课堂教学的迅猛发展产生了海量的教育数据,如何高效自动地提取教育数据的知识特征并建立关系,是当前教育大数据时代面临的一项重要研究。在线教育平台为学习者提供了开放的自主学习途径[1]。作为一种新型在线教育模式,其应用过程中也存在一些局限性,包括无法挖掘学生隐性认知状态、学习资源贴合度不够、缺乏较强的针对性、无法保证多元化学习资源和学习路径的有效性。研究人员试图引入数据挖掘、学习分析、人工智能等先进技术破解在线教育发展难题。具体来说,学习平台收集的学习数据反映了学生个体的真实学习轨迹,研究这些数据,可以更有效地分析学生的知识状态,为学习者提供适应性智能导学服务。

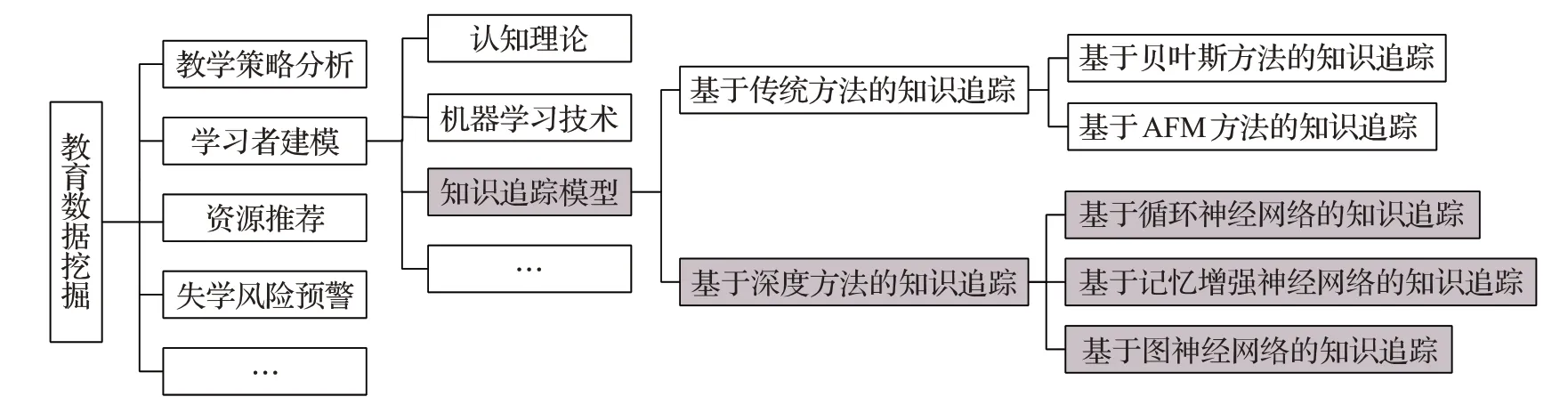

如图1所示,知识追踪(Knowledge Tracing,KT)模型为教育研究者预测学习者知识状态提供了一个便捷的途径,一直是教育数据挖掘领域的研究热点[2]。知识追踪通常被描述为一个有监督的时间序列学习任务,给定学习者的历史练习记录Xt={(q1,a1),(q2,a2),…,(qt,at)},其中qt表示题目编号,at表示相应的分数,自动追踪学生知识掌握状态随时间的变化[3],预测学习者下一次答对题目qt+1的概率。通过获取学生作答习题的显式学习表现,追踪其随时间变化的隐式知识状态,从而预测学生在未来时间的作答表现。依此,推荐系统利用该概率动态调整返回给学习者的学习资源或反馈[4],并跳过或推迟预测不符合学生当前知识水平的内容,提供针对性的辅导服务。同时,通过对学生知识状态的评估,教师能够更好地了解每个学生的真实认知情况,进而优化教学模式与策略,其主要流程如图2所示。

图1 教育数据挖掘思维导图Fig.1 Educational data mining mind map

图2 评估学习者的知识状态Fig.2 Assessing learners’knowledge status

1 相关工作

1.1 传统KT模型的特点及局限性

按照建模方法的不同,现有知识追踪模型可以分为两类:传统机器学习方法和深度学习方法。BKT[5]和AFM[6]是传统机器学习方法中具有代表性的两种模型,它们已被广泛应用于智能教学系统中评估学习者的知识水平[7-8]。

Corbett等人于1994年提出贝叶斯知识追踪[3](Bayesian Knowledge Tracing,BKT),将学习者对每个知识点的掌握情况建模为一组二元变量P(Kt)∈{0,1},每个变量代表学习者是否掌握某个知识点K,然后采用隐马尔可夫模型(Hidden Markov Model,HMM)跟踪学生知识状态的变化,预测学生掌握知识点的概率。

BKT的建模过程基于三点假设:学生的答题序列仅涉及单一知识点,不支持包含多知识点的答题序列分析;学习者在知识学习过程中不存在遗忘现象;学生的表现和知识掌握状态均为二元变量。

标准BKT方法的预测结果具有统计学意义,可解释性较好。然而BKT对于学习的四点假设具有先天的局限性,使得BKT的实际应用范围受限。随后,诸多研究者从不同角度提出对模型本身的假设改进。文献[9]基于BKT模型,结合习题与知识点中丰富的关联关系提出了BKTC模型,通过实验证明了所提出方法在数学、拼写学习和物理等五个大规模数据集中的预测精度更高。Qiu等人[10]在模型中加入知识遗忘特性,模拟学生的知识熟练程度可能随时间的推移而下降。Agarwal等人[11]为使学习水平估计的更新更平滑,用近因权重代替学习率,将二元知识状态进一步细化为21个状态。

研究人员在心理测量学理论发现了一类可以解决BKT相关问题的模型,即可加性因素模型(Additive Factor Model,AFM)[6]。AFM考虑了练习的尝试次数和学习率两个变量对学习者知识状态的影响。与BKT不同,AFM假设学习是一个渐进的变化过程而不是离散的过渡,不是估计学习者潜在的知识状态,而是直接预测学习者正确回答练习的概率。同时,诸多研究者从参数约束[12]、引入失误因子[13]、情绪态度[14]等不同角度对标准AFM进行扩展。

学习者的学习行为数据量大且复杂,收集到的海量、连续的习题通常与多个知识点相关联,传统的KT模型依赖专家标注,也不能很好地捕捉多个知识点之间的关系。深度学习具有自动学习复杂知识概念内在关系的能力,并且不需要专家对知识点进行显式标记[15]。因此,深度学习模型被引入KT领域。鉴于学习者练习数据的时序性,递归神经网络(RNN)[16]常被用于建立基于深度学习的知识追踪模型。作为RNN的流行变体,长短期记忆(LSTM)神经网络[17]和GRU[18]也广泛应用于KT任务中,取得了比传统KT模型更好的预测性能。

1.2 现有综述分析

在已有的相关综述研究中,文献[19]围绕智能辅导系统的学生模型展开,概述了KT以及PFA模型在预测学生练习表现中的最新进展。文献[2]重点从知识点、学习者和数据三个层面梳理了BKT模型在教育领域的应用现状。文献[20]详细阐述了深度学习技术在知识追踪中的应用,通过避免技术细节来定性地解释模型工作原理。文献[21]从原理、方法步骤、算法的效率和可扩展性等维度详细介绍基于BKT、IBKT、DBN、DKT方法的知识追踪模型,对研究者提出了未来的研究方向和面临的挑战。文献[22]从理论技术角度梳理基于概率图、矩阵分解以及深度学习的知识追踪模型原理、方法步骤、模型扩展等。文献[23]总结了知识追踪的相关理论,全面对比DKT、DKVMN、SAKT、RKT模型在大规模数据集上的表现差异。文献[24]从模型组成、建模技术、扩展模型、模型对比和评估五个方面对BKT、DKT、DKVMN进行了概述。文献[25]对教育大数据中知识追踪模型的回顾和分析更加系统和全面,梳理并比较了基于BKT和DKT方法的2类知识追踪模型。总体来说,这些文献涉及到深度学习技术的模型较少,侧重于机器学习方法、经典模型梳理的分析较多。

通过检索计算机领域、教育领域和认知科学领域的期刊和会议,查阅了发表时间限定于2015年1月1日至2021年6月20日深度知识追踪的相关论文,共筛选出65篇文献。本文重点对基于深度学习的知识追踪及其扩展模型进行全面与最新的讨论,按照建模方法的角度将其划分为基于循环神经网络、记忆增强神经网络、图神经网络的知识追踪模型。通过梳理和对比三类模型及其改进模型,帮助读者快速了解知识追踪领域的最新研究进展。

2 基于循环神经网络的知识追踪

标准BKT方法只能对学生在单个知识点上的学习情况进行建模,它将学生在多知识点上的学习过程视为多个离散过程。RNN是深度学习领域中一类特殊的具有自循环反馈的全连接神经网络,能够学习复杂向量之间的映射关系。HMM和RNN都是通过隐状态的演化来刻画序列之间的依赖关系,但在面对高维、连续的数据时RNN的表达能力更强。受此启发,Piech等人于2015年提出DKT(Deep Knowledge Tracing)模型[15],DKT是第一次尝试利用递归神经网络(如RNN、LSTM)对学生的练习过程进行建模以预测其表现,在不需要对训练数据集进行人工标注的情况下得到了比BKT更好的效果。

2.1 DKT模型原理

标准DKT的结构如图3所示。DKT模型输入为学生答题记录{x1,x2,…,xt},通过one-hot编码或压缩感知表示法xt被转化为向量输入模型。为了将输入映射到输出,输入向量会通过隐藏层进行特征提取,隐藏层{h0,h1,…,ht}的状态向量ht可理解为学生在第t时刻的知识状态。将学生的知识状态通过输出层计算可得到输出向量,{y1,y2,…,yt}表示在时间步1~t,学生正确回答每一道习题的概率。所涉及公式如下所示:

图3 DKT模型结构图Fig.3 DKT model structure diagram

模型的目标函数如式(3)所示,模型训练选用随机梯度下降算法作为优化器,即:

其中,δ(qt+1)表示在第t+1时间步作答习题qt+1的one-hot编码,l表示二元交叉熵。

DKT模型将RNN应用到知识追踪任务中,取得了比传统BKT方法更好的预测性能(AUC(Area Under Curve)值提高20%[26]),且能够更深层次地捕捉练习文本的时序特征和语义特征。

2.2 DKT模型改进

学生在线学习环境极为复杂,学习过程会受到多方面因素的影响。DKT输入数据为学生练习记录,而忽略了学习者的行为特征以及知识点之间的关联关系,且输入的学习特征太少也会影响模型的准确性。

传统RNN、LSTM在处理超长序列时容易丢失信息而导致模型的性能下降;同时,模型缺乏对关键特征的提取和强化。

DKT的预测性能优于传统机器学习方法,但其隐藏状态ht本质上很难被解释为知识状态。因此,DKT模型的不可解释性制约了其在实际教学的应用。

传统机器学习方法结合人的先验知识及直观感受来构造特征。RNN、LSTM等深度学习方法依赖于大规模数据集的处理,当样本数据量小时可能导致显著特征提取效果差。

学习特征少、长距离依赖、可解释性差、无法有效选取学生特征是DKT模型最显著的4个问题。本文将DKT的扩展模型分为4类:(1)结合教育数据特征改进模型;(2)引入注意力机制改进模型;(3)可解释性知识追踪;(4)融合机器学习方法的模型改进研究。表1总结了各种模型所属的改进方向类别和主要的改进方式。

表1 DKT改进模型对比Table 1 Comparison of improved DKT models

2.2.1 结合教育数据特征改进模型

(1)改进学习者建模的研究。诸多研究者考虑纳入学习者的学习行为等内隐学习特征评估学习成效。Liang等人[27]在DKT输入中添加额外的学生反应时间、练习尝试次数、第一次响应结果等学生特征评估学习者的知识水平。针对这种高维输入数据,结合自动编码器降维并输入模型,从而减少了训练所需的资源和时间。该模型预测结果取得了一定的提升,但该方法依赖于繁琐的人工特征提取及选择过程,可能会受主观影响产生误差。Cheng等人[28]受BKT模型失误和猜测参数的启发,失误和猜测概率应该随做题的过程而不断变化。在DKT中引入失误和猜测因子以更好地模拟学生的真实做题情况。VDKT等人[29]在文献[28]基础上引入了部分理解因子建模学习过程中的随机性行为。CKT[30]模型针对在线学习平台中收集的学生互动点击流数据,分析学生的学习状态,预测未来学习趋势和表现。

学习是一个循序渐进的过程,因此在追踪学生的知识状态时,需要进一步考虑时间特性对预测结果的影响。Nagatani等人[31]引入时间间隔来模拟学生的遗忘行为,将改进后的模型命名为Extended-DKT,通过比较Extended-DKT和DKT的差异,研究时间间隔对预测准确率的影响。Yang等人[32]借助决策树融合多种异构特征如作答时间、作答次数等衡量学生的遗忘情况,在拟合数据集上表现更优。Pu等人[33]提出DKT+Transformer结构,引入答题时间信息调整模型的注意力权重计算中,以更好地考虑时间特性对预测结果的影响。

(2)融合知识结构信息的研究。标准DKT模型主要利用学习者的答题记录预测其未来表现,而忽略了不同知识点之间的关联关系,即“知识结构”对知识状态的影响。Chen等人[34]考虑到课程概念之间存在先决关系,将知识点间前驱后继关系建模为有序对,用作知识追踪模型中的约束,有效缓解了知识追踪中的数据稀疏性问题。DTKS[35]设计了图嵌入算法将练习关系信息融入对学生知识状态的建模,可以同时捕获练习的顺序依赖关系和内在关系。

最近的一些研究考虑了“知识结构”的影响,但忽略了知识点之间的传播具有不同形式,如相似关系(无向,影响力可双向传播)和前驱后继关系(有向,影响力只能单向传播)。SKT[36]借助知识结构中的多重关系对概念之间的影响传播进行建模,同时考虑了学习者练习序列的时间效应和知识结构的空间效应,能够更准确地估计学习者的知识状态。

本节详细介绍了结合教育数据特征在深度知识追踪领域的改进方法,主要分为改进学习者建模和融合知识结构信息。改进学习者建模的方法最为直观,通过添加更多信息,借助深度学习的特征提取能力,提升预测的性能。融合知识结构信息的方法从练习文本组织特点出发,深入挖掘知识点之间丰富的结构和相关性。结合教育数据特征的改进方法通过添加更多信息提升模型性能,但也增加了模型训练所需的资源和时间。同时,如何更有效地将教育数据特征纳入知识追踪任务中的研究还不够深入。

2.2.2 引入注意力机制

注意力模型[37]是神经网络中的重要概念,已在语音识别[38]和图像注释[39]等不同应用领域中进行了广泛的研究。直观地说,注意力机制是一个重要性权重向量,无需通过循环而直接建立输入与输出之间的相似性度量。学习是一个持续不断的过程,KT模型引入注意力机制可以加强关键信息弱化无用信息,以增强历史上重要状态的影响来预测学生未来表现。

Su等人[40]提出在模型预测输出时使用余弦相似度计算练习题目相似性,对所有隐藏状态进行加权和聚合,有效捕获了练习序列中的长期依赖关系。此外,文献[41]也采用类似思路,使用Jaccard系数计算知识点之间的注意力权重,结合LSTM与注意力值预测学生表现。

针对学生交互序列的稀疏数据面临难以泛化问题,Pandey等人[42]提出SAKT模型,使用基于自注意力机制的transformer模型为之前回答的练习分配权重,以提取关键信息。Choi等人[43]认为SAKT模型的注意力层太浅,为了更深入挖掘习题与学生回答之间的复杂关系,Choi等人设计了叠加3个注意力模块的编码器和解码器组合,通过大量的实验,证明多头注意力的有效性。

受认知科学关于遗忘机制研究的启发,Aritra等人[44]提出了单调注意力机制AKT,引入指数衰减项来计算注意力的权重,降低久远练习对预测的重要性。

本节详细介绍了注意力机制在深度知识追踪领域的改进。引入注意力机制将较长的序列转化为包含重要信息的短序列,但是并没有从根本上解决问题。注意力权重大的特征周围也有相关信息(距离越近相关性越强),也要考虑进模型,即注意力机制忽略了注意力所在位置周围信息。未来研究可以引入“窗口”机制,把一定范围内的信息都提取出来。

2.2.3 可解释性知识追踪

基于深度学习的知识追踪模型已被证明在无需人工特征的情况下优于传统的知识追踪模型[45]。然而,深度学习模型的输出和工作机制受到不透明的决策过程和复杂内部结构的影响,非计算机背景的人难以理解其内部工作机制,这极大程度地限制了深度知识追踪模型在实际教学中的应用。

为了克服这一挑战,已经开发了许多模型,如香港科技大学的Lee等人设计了KQN知识查询网络[46]模型,使用神经网络将学生的学习活动编码为知识状态向量和知识技能向量。同时,KQN可以针对不同的技能查询学生的知识状态,然后通过可视化两类向量之间的交互以增强模型的可解释性。

事后解释(post-hoc interpretable)方法,发生在模型训练之后,利用解释方法为预测结果提供决策依据[47]。这种方法的优点是,在不降低预测性能的情况下可以事后解释不透明的模型。在知识追踪领域,主要有分层关联传播(Layer-wise Relevance Propagation,LRP)和不确定性评估方法。Lu等人[48]提出采用后自组织可解释方法来理解基于RNN的DLKT模型,利用分层关联传播方法将关联从模型的输出层反向传播到输入层来解释基于RNN的DLKT模型。文献[49]使用蒙特卡洛方法为模型的输出预测值提供一个不确定性评分,以减轻预测过程中的不透明性。

此外,也有研究者尝试使用显性知识概念来解释学生隐性知识状态的变化,这对于许多实际应用都是有益的,比如可解释性练习推荐。TC-MIRT[50]利用RNN建模复杂序列数据,结合心理测量学模型IRT参数的可解释性,使模型能够进行概念级的弱点诊断,帮助学生了解自身的薄弱知识概念。EKT[51]将每个学生的知识状态向量扩展成一个随时间更新的知识状态矩阵,其中每个向量代表学生对某个概念的掌握程度,有效解决传统DKT难以确定学生擅长或不熟悉哪些概念问题。

本节详细介绍了深度知识追踪领域对可解释问题的改进方法,主要分为知识可视化、事后解释方法和诊断薄弱知识概念。三类方法针对学生的认知状态,给出了可能的解释方法,在一定程度上提高了模型的可解释性。同时也具有共性缺点:模型训练参数较多;参数本身也不像BKT方法具有可解释性。

2.2.4 融合机器学习方法的模型改进研究

机器学习相关算法分析和预测的总体误差小,可以尝试在某些模块或功能上使用机器学习相关技术作为辅助工具,进一步提升知识追踪模型的预测性能。

学生的能力是不断发展的,标准DKT模型忽略了学习者学习能力和学习速度的差异。DKT-DSC[52]使用K-Means聚类动态地将学生分配到具有相似能力的不同组,并随时间的推移定期重新评估。

由于学生数据的稀疏问题影响着知识追踪模型的性能,文献[53]结合支持向量机和矩阵分解模型提出基于因子分解机(FM)的知识追踪模型,利用特征之间的组合特性,引入多种辅助信息如多种知识概念组成成分,题目尝试次数,知识概念掌握水平建模,通过在多个数据集中验证发现该模型能够很好地处理稀疏数据。

大多数研究都假设练习的难度是恒定的,这不符合学习的规律。学生可能会多次尝试同一练习,并逐渐掌握练习中包含的知识,因此应该根据学生目前的知识水平来调整练习的难度。Gan等人[54]设计了领域感知知识追踪机(FA-KTM),结合学生的动态学习过程(学习和遗忘)和练习难度评估学习者的知识状态水平,对DKT的性能具有促进作用。

Yang等人[55]考虑到学生知识状态主要受近期练习的影响,提出了卷积知识追踪(CKT)模型,使用3D卷积网络强化学习者近期回答的练习对知识状态的影响。大量的实验证明,关注学生的短期特征可以更好地对学生的知识状态进行建模,进而增强模型的预测能力。

爱学习教育集团AI Lab团队提出一种练习分层特征增强知识追踪模型[56],使用Bert挖掘练习文本生成嵌入向量,然后输入到3个子系统提取练习的知识分布、语义特征和难度,最后将3个特征连接并输入进LSTM作出预测。

Xu等人[57]提出DynEmb模型,使用矩阵分解将练习题目和学生嵌入到一个连续隐空间中,同时结合RNN建模学习者的学习过程。但矩阵分解无法捕获学生和练习的交互信息,从而忽略了学生和练习交互的重要性。

本节详细介绍传统机器学习方法在知识追踪任务中的应用。借助K-Means、支持向量机、矩阵分解等传统机器学习方法的优势,提升知识追踪任务的预测性能。同时,传统机器学习方法过于依赖训练参数的设置,对于学生特征的选取和扩展不够灵活;如何借助机器学习技术的优势辅助知识追踪任务评估学生认知状态有待进一步深入研究。

2.3 模型的比较研究

模型的比较研究包括BKT与DKT[58-59]、DKVMN与DKT[60]、DKT与PLM-IRT[61]的比较。相关模型的示意图分别如图4(a)~(d)所示。如图4(a),BKT使用隐马尔可夫模型将学习者的潜在知识状态建模为一组二元变量。如图4(b),DKT使用高维的隐藏向量表示学生的知识状态。如图4(c),DKVMN同时跟踪每个知识概念的掌握状态,所有掌握状态构成学生的知识状态。如图4(d),PLM-IRT利用概率表达式测量学习者知识掌握情况。

图4 模型结构图Fig.4 Model structure diagram

综上,BKT表示过程中丢失了学生数据中的时序特征,但相较于深度模型,BKT的参数可解释性较强。PLM-IRT也是传统方法中的一种,通过考虑主客观因素预测学生表现,但该方法适用于学习者能力不变的环境。DKT具有较强的特征提取能力,可以有效利用学生数据的特征和规律,然而DKT无法显示获取学生对单个知识点的掌握状态,可解释性较差。相较于BKT和DKT,DKVMN模型参数数量较少且能够自动输出学生对单个知识点的掌握程度。同时,Gervet等人[20]在多个规模不同的数据集上评估传统模型和深度模型的性能。研究工作表明,基于Logistic回归的改进算法在中小型数据集上表现得更好,而深度模型在较大的数据集或强调时序信息的数据集上表现得更好。

2.4 模型应用

DKT在预测和评估学习成绩方面非常有效。Su等人[40]结合学生个性化信息和题目语义信息,设计了基于马尔可夫特性和注意力机制的两种策略来预测学生成绩。MFA-DKT[62]利用机器学习模型来自动捕获学生的行为特征和练习特征,然后将基于递归神经网络的架构结合attention机制,在ASSISTments数据集上进行学生成绩预测,模型的准确性得到提高。Mongkhonvanit等人[63]使用DKT模型采集学习者的学习行为数据如点击资源的时间点、停留时长等信息计算学生的课程参与度,进而改善MOOC中学生流失问题。

DKT也可以用于开放式的学习环境中,如编程练习[64-65]、发现知识点间拓扑顺序[66]、生成试卷[67]、验证认知理论[68]、学习路径推荐[69、生成学习报告[70]等。文献[71]基于学习者中学时期在ASSISTments智能导学系统记录的学习轨迹,应用DKT模型预测大学毕业后的第一份工作是否属于STEM(Science、Technology、Engineering、Mathematics)领域。

DKT改进模型的应用如表2所示。

表2 DKT改进模型的应用Table 2 Application of improved DKT model

3 基于记忆增强神经网络的知识追踪

循环神经网络的变体LSTM可以通过输入门获取当前样本的信息(短期记忆),也可以通过遗忘门有选择地保留先前样本的部分信息(长期记忆)。但是LSTM将所有记忆单元存储在隐藏状态向量中,该记忆方法会受可训练参数数量的影响,在处理具有1 000量级的超长序列问题时存在一定的局限性。记忆增强神经网络(Memory Augmented Neural Network,MANN)是针对上述问题提出的一种解决方案,创新性地在标准循环神经网络基础上增加了记忆矩阵,允许网络保留多个隐藏状态向量,分别对这些向量进行读写,从而提高了网络的记忆能力,增加了读写过程来控制记忆状态更新,具有比RNN和LSTM更强的记忆能力。

3.1 DKVMN模型原理

动态键值对记忆网络(Dynamic Key-Value Memory Networks for Knowledge Tracing,DKVMN)[72],由香港中文大学的施行建于2017年提出,它借鉴了MANN使用记忆矩阵的思想,同时又结合了BKT和DKT的优点,实现了使用非线性变换学习表示和跟踪每个概念状态的能力。

在每个时间步,DKVMN输入是习题编号qt,输出是学习者正确回答下一道习题的概率p(rt|qt)。模型假设练习包含N个潜在概念{c1,c2,…,cN},这些知识概念存储在一个称为key的静态矩阵Mk中。学生对每个概念的掌握程度,即概念状态{s1,s2,…,sN}存储在称为value的动态矩阵Mv中,它通过删除向量et和添加向量at来存储和更新学生对于相应知识概念的掌握程度。

DKVMN模型的整体结构如图5所示,模型整体由3部分组成。图5蓝色部分表示权重计算过程,即计算习题与各知识点间的相关权重。紫色部分表示读过程,根据学生的知识掌握水平和当前练习的难度预测学生的表现。绿色部分表示写过程,根据学生的练习记录采用擦除加法机制更新他们的知识状态,并将结果添加至矩阵Mv中。

图5 DKVMN模型Fig.5 DKVMN model

3.2 DKVMN模型改进

标准DKVMN方法仅使用习题编号和做题结果作为模型的输入,而忽略了学生在学习平台中产生的碎片化数据,诸如学生的行为特征、练习后学生学习能力的变化和学生之间学习能力的差异等特征信息对学习结果的影响。因此,诸多研究者从输入建模、使用不同方法等角度展开创新与改进。本文将DKVMN的扩展模型分为2类:(1)结合教育数据特征改进模型;(2)结合机器学习方法扩展模型。扩展模型的对比如表3所示。

表3 DKVMN改进模型对比Table 3 Comparison of improved DKVMN models

3.2.1 结合教育数据特征改进模型

文献[73]提出DKVMN-LA模型,在DKVMN模型的基础上引入学生练习的行为特征和练习后学生能力的变化建模学生的认知状态。文献[74]针对标准DKVMN模型无法建模学生掌握知识点的速度,引入分布式记忆矩阵,实现了知识增长速度的动态建模。DKVMN-CA[75]将练习题的难度、学生的练习时间等影响判断学生知识水平的因素整合至传统DKVMN模型中,提升了模型的预测性能。受DKT-DT的启发,文献[76]提出一种融合梯度提升回归树的深度知识追踪优化模型,利用梯度提升回归树算法(GBRT)将学习者学习能力、学习行为和任务难度等特征信息融入知识追踪模型,通过收集学习者更多的特征信息,提升模型的预测精度。根据德国著名心理学家艾宾豪斯对人类遗忘过程的研究,学习的遗忘过程会受到学生当前知识状态和练习时长的影响[77]。按照这一思路,Zou等人[78]提出一种基于学习过程(LPKT)的知识追踪模型,在读过程中根据当前知识状态计算知识遗忘量,计算下一个时刻的知识状态时再参考LSTM的遗忘机制,这样就比较符合学生的学习规律。

传统DKVMN模型也存在难以捕捉长依赖关系和解释性较差等问题。Abdelrahman等人[79]提出了序列键值记忆网络知识追踪模型(SKVMN)。SKVMN在其序列建模中使用一种改进的HOP-LSTM,HOP-LSTM使用三角隶属度函数(triangular membership function)捕捉练习序列之间的顺序依赖关系,增强了模型捕捉长期依赖关系的能力。

本节从学习特征、时间因素、捕捉长期依赖关系三个改进角度展开论述。引入学习特征信息、时间因素增加了建模的维度,但是在数据中嵌入这些异构特征存在一定的难度。HOP-LSTM方法控制信息在LSTM细胞间跳跃,加快了模型的推理速度,该方法跳跃决策的制定有待进一步研究。

3.2.2 混合模型

在复杂交互学习中,在线辅导系统有效的提示行为可以填补学生对空白概念的理解。针对这种情况,Dogga等人[80]提出了一种新的知识追踪框架,设计多任务模型将请求提示预测与知识追踪进行联合训练,通过实验证明了框架的有效性。

文献[81]发现学生学习数据自然地呈现出聚类特征,提出结合群体学习特征的LMKT模型,该模型可以准确预测学生对新知识的学习过程。DSCMN[82]通过捕获学生长期学习过程中每个时间间隔的学习能力,实现动态学生分类,相当于在模型的输入中隐式地嵌入了学生能力信息。

针对DKVMN模型没有关注学习者在答题过程中的具体行为,仅仅关注学习者最终是否答对习题。DKVMN-DT[83]将用户的答题时间,用户是否请求提示,用户尝试作答题目的次数等影响用户答题的因素输入到一个决策树模型,用来预测用户的作答情况。

强化学习和深度神经网络的有机结合取得了不错的成就,研究者们提出将强化学习与知识追踪任务相结合建模学生的认知情况。文献[75]基于DKVMN-CA模型获取学生的知识状态,将系统对用户推荐的习题作为当前的动作,学生下一时刻做k道题目的平均准确率作为当时的奖励,提出了基于强化学习的习题推荐方法,实现学习资源的个性化推荐。AIDKVMN[84]设计了智能Agent挖掘学习者与学习资源间的隐性关联,跟踪学生的知识状态,进而有针对性地向学习者提供个性化学习服务。

IRT方法能体现学生之间,问题之间的差异性,结合这一特性给DKVMN方法带来了新的改进方向。Yeung等人[85]综合了IRT模型和DKVMN模型,使用DKVMN模型处理学生的学习轨迹,并估算学生随时间推移的能力水平和项目难度水平。然后使用IRT模型通过估算的学生能力和题目难度来预测学生正确回答某项练习的概率。

本节梳理了基于DKVMN的新型多混合知识追踪方法。在此过程中,结合机器学习、强化学习等研究技术与方法提升模型精度的同时也存在一些问题:(1)文献[80]依据学习者的知识掌握程度决定是否显示提示,但没有考虑提示问题的数量以及问题的顺序。(2)在线教育数据的来源和类型极其丰富,单智能体强化学习算法已无法全面分析学习者的知识状态,可以考虑将多智能体强化学习技术应用到复杂的教育场景中。(3)以上方法在训练模型优化神经网络参数时,都是不加区分地使用所有学生的学习数据,即训练模型时假设所有学生的能力相同,显然该假设不符合学生实际学习状态。

4 基于图神经网络的知识追踪

现有的方法大多将练习记录简化为知识序列,不能充分挖掘练习文本中蕴含的丰富信息。根据教育领域中的知识转移理论[86],当学习者学习一个概念时,不仅会改变现有知识概念的熟练程度,还会改变相关联知识概念的掌握程度。受图神经网络(GNN)近期成功的启发,Nakagawa等人提出一种基于GNN的知识追踪方法,即基于图的知识追踪(Graph-based Knowledge Tracing,GKT)[87]。该方法将知识结构转化为图形,从而间接将知识追踪任务重构成GNN模型中时间序列节点级分类问题。

4.1 模型原理

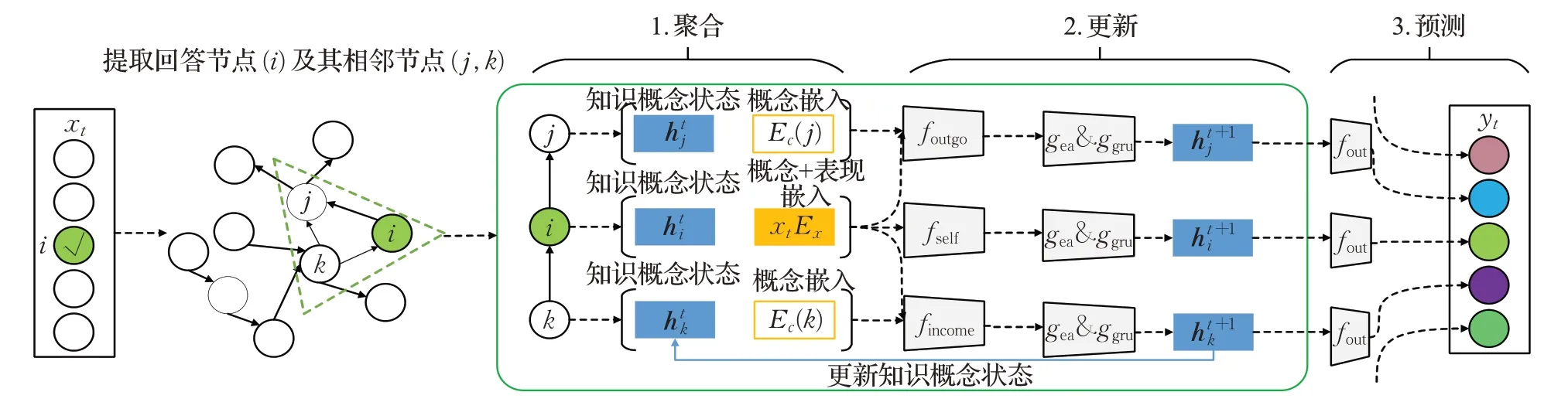

文献[87]首次将GNN应用于知识追踪任务中,形成GKT模型,图6介绍了GKT的模型结构。将一门课程知识建模为图G=(V,E),掌握课程知识的要求被分解为N个子知识点,称为节点V={v1,v2,…,vN},节点之间的关系定义为边E,其中E⊆V×V,学生在时间步t对于知识点v的掌握程度建模,掌握程度会随着时间而变化。

图6 GKT的模型结构Fig.6 GKT model

当学生回答了包含知识点vi相关的练习时,GKT首先聚合与回答的概念相关的节点特征,然后更新学生对所回答概念本身及其相关概念的掌握状态,Ni表示与vi相邻的所有节点。最后预测学生在下一个时间步正确回答每个概念的概率。具体计算过程如下所示:

(1)聚合。将已经回答的概念i及其邻近概念j∈Ni的隐藏状态和嵌入使用一个向量表示。

(2)更新。基于聚合特征和知识图结构更新隐藏状态。其中,fself是多层的感知器,gea是Zhang等人提出的擦除-加法门,ggru表示门控递归单元,fneighbor是一个基于知识图结构定义信息向相邻节点传播的函数。

(3)预测。输出每个学生在下一个时间步正确回答每个知识点的预测概率。

4.2 模型改进

基于图神经网络的知识追踪(GKT)将图神经网络与知识追踪任务相结合。它将学习者的隐藏知识状态编码为图节点的嵌入,根据嵌入特征向量和知识图结构更新隐藏状态,最后,模型输出下一时间步学生正确回答每个概念的预测概率。通过多个神经网络对概念节点间的边类型关系独立建模,提高了知识追踪的预测性能和可解释性。

针对学生的练习记录,题目中包含的知识点反映了学生在共性知识层面的掌握程度,而其文本描述则体现了学生对于该题目本身个性属性(如难度等)的理解与学习。标准GKT模型没有挖掘练习文本中蕴含的语义信息,因此面临着练习表征丢失问题。Liu等人[51]首次提出融合题目语义的知识追踪模型EKT,使用Bi-LSTM网络挖掘练习文本层面的个性信息,并将其融入到学生的知识变化建模过程中。然而EKT直接将练习文本输入至特征提取器中,没有考虑习题潜在的层次图性质,并且会因嵌入文本而带来额外的噪声。为了解决上述问题,Tong等人[88]采用层次图神经网络推断和聚合练习文本,捕获层级结构将能更加完整高效地表征习题,有效解决了习题表征丢失问题。同时结合基于attention机制的递归序列模型,在真实在线教育系统”爱学习”上进行实验,证明模型的有效性。

受CNN的启发,诸多研究者使用卷积方法处理图形结构数据[89-90]。图卷积神经网络(Graph Convolutional Network,GCN)被提出用于半监督图分类,基于自身及其邻居的信息来更新自身节点表示。因此,如果使用多个图卷积层,则更新的节点表示包含邻居节点的属性和高阶邻居的信息。Yang等人[91]按照这一思路提出了一种基于图卷积神经网络的知识追踪(GIKT)模型。利用GCNS聚合练习和知识点嵌入,然后从高阶信息中挖掘练习和知识点的特征,有效缓解了学生交互数据的稀疏性问题。

本章详细介绍了基于图神经网络的知识追踪,图神经网络的信息传播机制相较传统深度学习模型更具有可解释性[92]。基于图神经网络的知识追踪能够有效学习到课程知识概念意义丰富的隐式表示,可以提高学生知识概念状态的可解释性。但在实际教学中,课程知识概念划分粒度不一,这使得图数据具有多样的特性,会直接影响模型知识状态评估的性能。

表4 总结了基于图神经网络的扩展模型主要的改进方式和局限性。

表4 图神经网络改进模型对比Table 4 Comparison of improved GKT models

5 数据集与评估指标

5.1 数据集

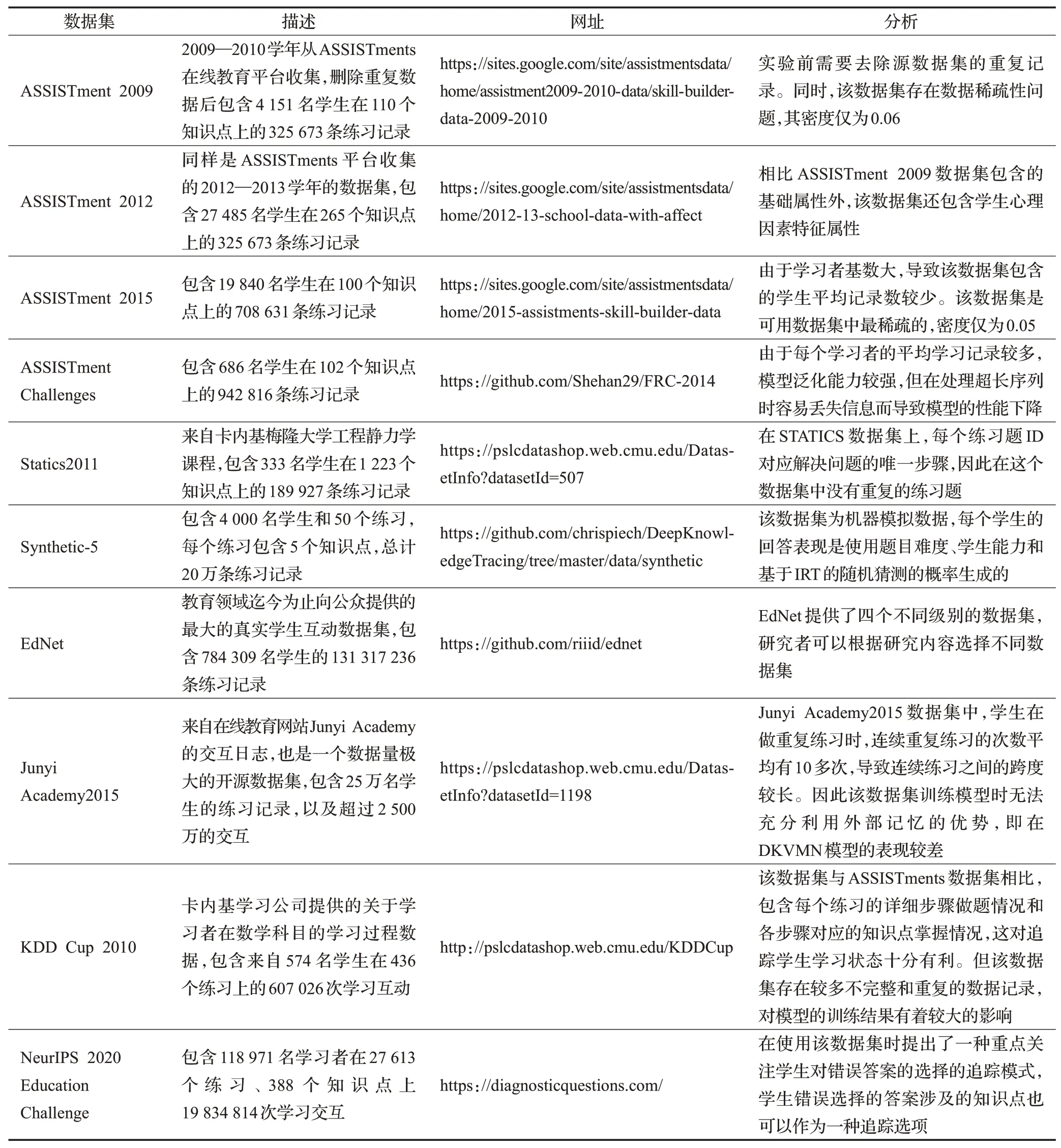

本章将介绍知识追踪任务中常用的10类大型公开数据集,其简述、下载链接和分析如表5所示。研究者可以根据研究内容选择不同的数据集。

表5 数据集Table 5 Data set

ASSISTments数据集是知识追踪任务中的基准数据集,该数据集是由ASSISTments在线辅导系统获得的小学数学课程的学生答题记录。数据集包含4类数据。

(1)ASSISTment 2009。2009—2010学年收集的ASSISTment数据,去掉重复记录之后,包含4 151个学生在110个问题上的325 673个交互。完整数据集分为两个不同的文件,即技能构建数据集和非技能构建数据集。其中,技能构建数据集的含义为:若某学生作答数据满足某个条件(如连续正确作答n次与该知识点相关的习题,其中n由老师设置,通常取值为3),则视为该学生已掌握该知识点;若学生使用辅导(“提示−+”或“将这个问题分解为步骤”),则视为该学生没有掌握该知识点。此数据集在教育数据挖掘领域多被用于预测学生表现、训练个性化学生模型、利用聚类方法改进学生模型等。数据集包含时间编号、问题编号、尝试次数、序列号、老师ID等多个属性,而应用到知识追踪任务时一般只使用习题ID、学生ID、学生表现(对/错)三个属性。作为教育数据挖掘领域的经典数据集,常常被用于做知识追踪模型的基准比较。

(2)ASSISTment 2012。ASSISTment 2012数据集是ASSISTments平台收集的2012—2013学年的数据集,数据集中除了包含时间编号、问题编号、尝试次数、序列号、老师ID等基础属性外,还包含学生心理因素特征属性(沮丧、困惑、专注、无聊),通过不同学生心理因素表现程度(该值接近“0”表示不那么沮丧,接近“1”表示更加沮丧),对学生表现进行预测。

(3)ASSISTments2015。ASSISTments2015数据集不包含练习ID字段,在删除学生表现不是1或0的练习记录后,包含由19 840名学生、100个知识点组成的708 631条交互记录。虽然此数据集中的记录数量多于ASSISTment 2009,但每个学生的平均记录数量较少。此数据集是ASSISTments数据集中继ASSISTment 2009后使用最多,模型效果最好的数据集。

(4)ASSISTment Challenges。该数据集来自ASSISTment教育数据挖掘挑战赛。就练习次数而言,ASSISTment Challenges数据集是所有可用数据集中密度最高的数据集,其密度为0.81。

(5)STATICS2011。该数据集来自卡内基梅隆大学工程静力学课程。在力学系统中,每个练习都包含多个计算步骤。由于此数据集的练习题目较少,因此在知识追踪任务中常将练习题的每个步骤作为模型的单独输入,即将练习ID和步骤ID一起充当输入。

(6)Synthetic-5。Synthetic-5数据集是由Piech等人生成利用机器生成的模拟数据,它由训练数据和测试数据组成,每个练习包含5个知识点,增加了知识点之间的结构属性、难度属性等,该数据集的结构良好,但由于数据集为模拟数据,每个练习都没有真实的知识点标签。

(7)EdNet。EdNet数据集来自多平台AI辅导服务系统Santa,在韩国拥有超过78万用户。EdNet提供了4个不同级别的数据集,每个级别分别命名为KT1、KT2、KT3和KT4。随着数据集级别的增加,与学习相关的行为集更加丰富,有助于研究人员分析学生的学习参与度。同时该数据集是教育领域迄今为止向公众提供的最大的真实学生互动数据集,包含上亿级学生交互记录。

(8)Junyi Academy2015。Junyi Academy2015数据集来自在线教育网站Junyi Academy的交互日志,也是一个数据量极大的开源数据集,包含25万名学生超过2 500万的交互记录,在使用数据集时,为了减少计算时间,一般会随机挑选一部分学生,组成由若干练习和交互组成的子样本。

(9)KDD Cup 2010。2010年KDD杯挑战赛旨在根据学生与智能辅导系统的交互日志来预测学生在数学问题上的表现,共包含由6 043名学习者组成的20 012 498条交互,每条交互包含学习者ID、知识点所属章节、回答正确或错误、知识点类型、练习开始与结束时间、正确与错误步骤的持续时间等属性。在这个数据集中,学生需要解决的练习涉及多个步骤,每个步骤都与一个或多个知识点相关联。此外,学习者在做题过程中可以请求系统提示,但只要请求提示后该题会被标记为错误回答。

(10)NeurIPS 2020 Education Challenge。数据来源于Eedi在NeurIPS会议上发起了一项预测建模挑战赛,包含2018年9月至2020年5月期间学生对多项选择题的回答记录。比赛通过分析学生选择的错误答案揭示了他们出错的原因,找出隐藏在错误答案中的有价值信息,该模式为知识追踪的建模提供了更广阔的空间。

5.2 评估指标

在KT任务中,一般从回归和分类两个角度评估模型的预测性能。从回归的角度出发,包括平均绝对误差(MAE)和均方根误差(RMSE)两个指标。此外,也可以从分类角度对模型进行评价,包括预测准确度(ACC)、ROC曲线下部分的面积(AUC)两个评估指标。MAE、RMSE、ACC计算公式分别为:

其中,n表示学生作答的习题个数,h(x()i)表示第i个习题得分的预测值,y()i表示第i个习题得分的真实值,right表示模型预测正确的个数,N表示学生作答的习题个数。

AUC为二元预测评估提供了一个健壮的度量,表示模型预测的正例排在负例前面的概率。AUC得分为0.5表示模型性能与随机分类效果相同,AUC越高表示模型性能越好。特别是在样本极端不平衡的情况下,AUC指标在评价模型性能方面效果更佳,因此大多数研究以AUC作为模型的最终评价指标。

6 模型对比与分析

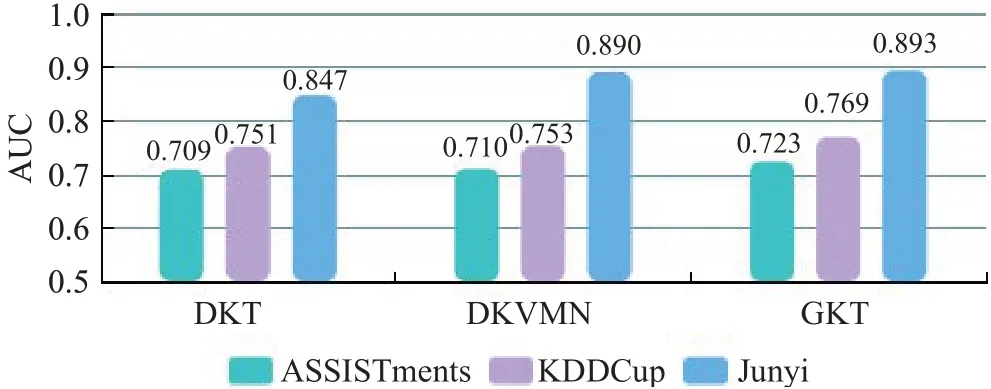

综上,DKT、DKVMN、GKT三类深度知识追踪模型都是基于学习者的历史答题情况,跟踪学习者的知识状态变化,预测他在下一个练习的表现。如表6所示,这三类模型在知识状态的定义和概念交互方面具有一定的差异。

表6 模型比较Table 6 Model comparison

(1)学生知识状态ht的定义。DKT利用递归神经网络(如RNN、LSTM)将学生的认知状态概括在一个高维、连续的隐藏向量中,因此追踪学生对某一知识概念的掌握水平比较困难。为解决上述问题,香港中文大学的施行建等人于2017年提出DKVMN模型,DKVMN可以自动学习输入练习文本和潜在概念之间的关联,引入外部记忆矩阵存储学生的知识状态,而且无需增加模型参数数量,提高了模型计算效率。受到GNN近期在其他领域成功的启发,Nakagawa等人将图神经网络引入知识追踪任务中,基于图神经网络的知识追踪方法假设学生在每个时刻对每个知识点都有独立的知识状态,将知识结构图形表示,为每个知识概念建立状态模型,其图形化描述如图7所示。

图7 DKT、DKVMN和GKT学生知识状态Fig.7 Knowledge status of DKT,DKVMN and GKT students

(2)知识状态更新过程中概念间的交互方式。在DKT中,概念之间无明显交互。在DKVMN中,使用点积注意机制计算原始输入概念和潜在概念之间的关系权重,但这不足以模拟知识概念之间复杂和多重的关系。继而,GKT利用K个神经网络对K个输入概念之间的关系权值进行建模,实现了对知识概念之间多个复杂关系的建模。三种模型更新方式的图形化描述如图8、9所示。最后,利用AUC指标评估不同模型在3个公开数据集上的表现,如图10所示(对比结果引自文献[36]、[87])。

图8 DKVMN和GKT知识状态更新过程中概念间的相互作用Fig.8 Interaction between concepts in process of knowledge state updating of DKVMN and GKT

图10 AUC比较Fig.10 AUC comparison

7 总结和展望

随着知识追踪的研究和应用的不断深入,其发展方向主要包括优化学生知识结构、关注学生内隐学习特征、主观题自动测评、驱动教学模式改革以及建模不同领域,具体内容为:

图9 描述语言Fig.9 Description language

(1)融合教育知识图谱。现有的研究大多数都是基于学习者与智能辅导系统采集的学习轨迹数据作为输入,建模的维度比较单一。教育知识图谱作为一个新兴的研究方向,是一种建立知识与学习资源关联关系的有效手段。一方面,可以利用教育知识图谱来描述学习资源之间的关系,作为知识追踪模型的辅助数据。另一方面,认知图式深刻影响着学习者的学习活动,而知识追踪可以获取学习者的认知水平。如何将学习者自身的认知结构以知识图谱的方式可视化展现出来,如何实现知识图谱与学习者水平的同步更新等,都是未来的研究方向。

(2)内隐知识显性化。学习者的认知加工过程是非常复杂的,存在诸多显性与隐性的相关因素,已有的知识追踪方法考虑学习过程中的显性认知行为,即学习者的知识掌握状态;而对于隐性的相关因素,如心理特征、学习态度、学习情绪等多模态数据,并未加以考虑。EEG-KT[93]模型使用脑电图(electroencephalogram,EEG)设备监测学生的心理状态,以改进对学生隐性知识状态的评估,提高了BKT模型的预测性能。因此,未来研究可以考虑如何通过捕捉学生的脑电、眼动、肢体动作等分析学生的专注度情况;如何建立有考量学习者学习情绪的知识追踪模型,融合人工智能、学习分析等新兴技术,为更近一步的模拟学生的真实学习情境提供数据支持。

(3)主观题自动测评。知识追踪模型自提出以来,大部分研究工作都致力于用二元结果来模拟学生的表现。但是在实际学习中,练习的对象一般分为有客观题和主观题。主观题由于是“发挥性题目”,往往带有主观性,多数没有唯一标准答案。将学生的真实文本答案转换为向量作为输入极其困难,因此大部分KT模型无法针对主观题建模。因此,未来的研究应该利用学生给出精确答案的详细描述作为KT模型的输入,结合深度学习技术实现主观习题的自动批改,提高知识追踪模型的适用范围。

(4)驱动教学策略改革。知识追踪模型比判断学习者知识掌握的传统方法提供了更丰富的动态信息。同时,结合其他学习分析技术,持续地采集更多微观的过程性数据,比如学生的学习轨迹、在每道作业题上逗留的时间等,形成学生数据的测评报告,帮助教育者分析每位学生的兴趣点、知识缺陷。因此,未来的研究可以关注如何使教学材料的呈现形式与学习者偏好的学习方式相匹配,如何根据学习者的认知水平匹配不同的教学材料,从而设计更加灵活多样、更具有针对性的教学策略。

(5)针对不同领域建模。现有的KT模型大多针对单学科建模,并且特定学科(例如,数学)模型不能直接移植于其他学科(例如,物理)。因而为每个学科构建领域模型是复杂且耗时的。Cheng等人[28]首次提出了一种自适应知识追踪(AKT)框架,实现了领域间良好的信息传递。Cheng等人的研究为解决领域适配问题奠定了初步的基础,然而,AKT对超参数比较敏感,如何更合理地建模,使其不需要手动设置超参数是一个值得研究的问题。因此,未来的研究应该根据不同学科的特点,尝试使用其他算法或引入其他模型解决教育数据挖掘中的其他预测问题,进一步提高知识追踪跨领域建模的准确率。

知识追踪模型根据学生动态的习题作答表现追踪学习者的知识状态、预测其掌握水平和未来表现,已被广泛应用于智能教学系统中。随着深度学习技术在知识追踪领域中发挥愈加关键的作用,采用知识追踪的个性化建模将会有更广泛的需求与应用。本文从建模方法的角度对现有深度知识追踪模型进行研究综述,梳理和分析了三类最新的深度知识追踪模型以及扩展模型,揭示了深度学习方法与学生交互序列建模任务之间的关系。

自2015年深度知识追踪问世,知识追踪模型的研究是计算机领域和教育领域的热点问题,应依据建模任务和数据特点选择模型。未来将持续探索深度知识追踪与教育场景的深度融合。