碎云环境下GF-4卫星对运动舰船的目标跟踪

2021-11-11林迅姚力波孙炜玮刘勇陈进简涛

林迅 姚力波 孙炜玮 刘勇 陈进 简涛

碎云环境下GF-4卫星对运动舰船的目标跟踪

林迅1姚力波1孙炜玮1刘勇2陈进3简涛1

(1 海军航空大学,烟台 264000)(2 军事科学院国防科技创新研究院,北京 100071)(3 北京遥感信息研究所,北京 100192)

针对“高分四号”(GF-4)卫星可进行连续观测和图像分辨率低的特点,文章提出了一种在碎云条件下用GF-4卫星对运动舰船目标进行检测和跟踪的算法。该算法基于区域候选的卷积神经网络(R-CNN)模型构建思路,首先利用双参数恒虚警率(CFAR)完成候选目标区域提取,以充分利用卷积神经网络(CNN)中LeNet网络在识别简单弱小目标时识别速度快的优势;然后对目标进行静态特征提取和鉴别;最后利用地理航行中的中分纬度法与全局最近邻(GNN)算法相结合进行目标关联和跟踪,形成了目标航迹并获取目标运动信息。文章选取GF-4卫星序列图像对所提算法进行试验,并通过舰船自播报(AIS)信息进行验证,结果显示:该算法能在一定碎云条件下排除碎云目标的干扰,有效地进行运动舰船目标检测与跟踪,具备较强的工程应用价值。

运动舰船目标检测 目标跟踪 碎云条件 卷积神经网络 “高分四号”卫星遥感图像

0 引言

静止轨道遥感卫星能够进行一段时间的连续观测,获取一定区域内的连续变化图像,已广泛应用于水文气象、同步监测等领域,对于各类应急突发任务,可提供快速的图像数据支持。低轨遥感卫星传感器分辨率高,能够进行目标识别,对目标信息和特征进行深度挖掘。相对于低轨遥感卫星,静止轨道遥感卫星分辨率低,但具有大幅宽、能够在广域范围内搜索和发现目标的优势,可与低轨对地监视卫星形成有效互补[1]。

目前,在视频卫星跟踪领域,大多采用相关滤波(CF)或者基于深度学习的方法进行跟踪。David S. Bolme将相关滤波理论引入目标跟踪领域,提出了误差最小平方和(MOSSE)算法。后续学者们在MOSSE算法的基础上进行了很多优化,例如:文献[3]中核相关滤波(CSK)使用密集采样并引入核函数;文 献[4]将尺度变化这一特征引入,提出DSST算法。

近年来,利用神经网络对目标进行检测和跟踪逐渐成为研究热点。由于卷积神经网络具有强大的特征提取能力,目标的深度特征被越来越多的挖掘出来。连续卷积算子视觉跟踪(C-COT)[5]和高效卷积算子(ECO)[6]等方法均采用深度特征来提升目标跟踪的速度和精度。利用公共数据集,通过区域建议网络(RPN)适应跟踪过程中目标尺度的多样性,并将目标跟踪转化为单次的局部检测任务[7-8]。

目前深度学习在视频卫星目标跟踪任务中使用频繁,但仅局限于分辨率为米级和亚米级的低轨视频卫星,低轨视频卫星图像中的舰船目标特征丰富,且网络上存在大量数据集可以用于网络的训练。但在分辨率不高的情况下,并没有比较好的数据集能够用于网络的预训练,利用单帧检测和帧间关联的方法进行目标跟踪能够取得较好的效果。例如,使用背景建模法中的ViBe算法对序列图像中的单帧图像进行检测,再利用滤波器进行帧间目标的关联与跟踪[9],能够在干净无云的场景下取得较好的目标检测与跟踪效果。然而,在可见光图像中,云层经常成为一个阻碍目标检测的重要因素,尤其是碎云[10-11]。

在“高分四号”(GF-4)卫星图像中,其较低的图像分辨率给目标检测带来了很大的挑战。作为静止轨道遥感卫星,舰船目标在图像上显得非常微小,成白色小点状,如图1(a)所示(由红色箭头标出)。这样的小点一般占据的像素只有十几甚至几个像素,没有明显的尺寸、形状等特征。图1(b)和图1(c)分别为GF-4卫星图像中的舰船目标与对应的近景外形图,该船船身长度为300m,可以看出在图像中舰船目标的细节特征很少,一些礁石、云层等目标在形状和外观上与其非常相似[12-14],因此当检测区域内出现碎云目标时,检测虚警率便会大幅度提升。根据上述特点,本文利用GF-4卫星图像序列的帧间信息差异,基于区域候选的CNN(R-CNN)网络模型思路[15],提出了一种基于改进CNN的目标检测与跟踪算法模型,用于检测和分析存在碎云时的海面舰船目标。

该方法首先对序列图像使用归一化水体指数(NDWI),从而排除大面积的云层和陆地对目标的检测干扰,再根据直方图分布进行灰度变换来增强目标;其次,通过双参数恒虚警率(CFAR)检测,提取候选目标区域;然后,利用训练好的卷积神经网络(CNN)LeNet对目标进行鉴别,区分出舰船目标和碎云目标,再通过仿射变换参数矩阵得到目标的经纬度坐标;最后,利用全局最近邻(GNN)算法结合地理航迹来关联和跟踪帧间目标。

图1 GF-4卫星部分区域图像

1 算法原理

本文提出的碎云条件下运动舰船目标检测和跟踪流程如图2所示,共分为预处理、数据集构建、预训练、候选目标区域提取、目标鉴别、坐标转换、目标关联跟踪和动态信息提取几个部分。本文所提碎云,是指在GF-4卫星遥感图像中大小和形状均与舰船目标相近的云目标。

1.1 图像预处理

舰船目标与碎云目标特征相似,先提取海洋区域作为预候选区域,剔除陆地上空的碎云目标,降低虚警率。利用GF-4卫星图像有多波段的特点,选用NDWI提取海洋和较大面积的云层区域。

图2 GF-4舰船目标检测与跟踪流程

该方法利用海洋等水体在绿光波段反射能力强,在近红外波段反射能力弱,而陆地与大面积云层的反射能力不同的差异性,来设定阈值。由于舰船目标的反射能力也与水体不同,如果直接进行剔除,容易造成大量的目标丢失。采用区域化操作,将一景GF-4卫星图像划分成相同大小的若干个区域。利用舰船航行安全等限制,使一个区域内的舰船目标所占像素点数目不高于一定比例,采用赢者通吃的原则来判定每块区域的性质,即该区域内水体像素点数占总像素点数的比例高于阈值,则判定所有像素值为1,反之为0。以二值图像的形式提取出海洋区域这一感兴趣区域(ROI)作为预候选区域。

单一波段的GF-4卫星遥感图像中目标很难用人眼去识别,海杂波、海水深度不同导致太阳光在海面的不同反射强度形成的噪声近乎淹没目标,检测时很容易出现虚假目标,导致过高的虚警率。从整个序列来看,这些杂波和反射形成的噪声在序列图像中也出现了运动和闪烁的现象,极易造成虚警和漏警。因此,在检测之前,还需要对图像进行预处理,以降低虚警和漏警。

因此,利用灰度变换,将整幅图像的灰度均匀映射到整个区间内,以增加各类物体的对比度,增强目标。图像的对比度增强,小白点状目标也更加明显,再利用先前完成的水体二值图像分割陆地和大面积云层,从而完成对图像的预处理。预处理方法剔除了陆地岛屿和大面积云层,增强了目标与背景的差异。

1.2 候选目标区域提取

对候选目标进行提取,再通过预候选区域进行筛选。本文采用的是基于双参数CFAR的候选目标区域提取方法[16-17]。单参数CFAR采用局部最大值或者最小值等参数检测目标,在具有海杂波的场景下无法达到很好的检测效果;而双参数CFAR是通过均值和方差这两个参数表征恒虚警模板边界的杂波,更加符合实际。双参数CFAR基于杂波服从正态分布的假设,主要采用滑窗的方式进行,有三个正方形窗口,分别为目标窗、保护窗和背景窗,三个窗口滑动的步长相同。目标窗内的点被判定为目标的判别准则为

检测结束后会在二值图像上将目标位置标为1,运用膨胀和腐蚀对图像进行处理,统计二值图像中所有为1的区域,即候选目标。选取候选目标的质心作为候选区域中心,将候选目标区域裁剪成相同的尺寸,提取出来。

传统的LeNet神经网络广泛用于手写数字识别,其识别速度快,准确率高[18]。但识别的目标图片样本中只有一个目标,且图片样本区域小,无法进行较大范围内的多目标检测和识别,因此将GF-4图像用双参数CFAR提取候选目标区域,对极小区域的图片样本进行规范化,作为LeNet的目标样本输入,将目标检测问题转化为目标的二分类识别问题,实现在50m级分辨率下使用深度学习模型提高目标检测水平的效果。

1.3 数据集构建

目前,遥感领域的数据集主要集中在目标检测和建筑、道路语义分割两个方向上。目标检测数据集有DIOR、DOTA、NWPU VHR-10、TAS、SSDD、OpenSARShip等,包含光学和SAR数据集。其中光学数据集分辨率在米级和亚米级,SAR数据集有部分为25m级分辨率。在50m级的空间分辨率上,目前没有较好的数据集进行网络的预训练。

利用GF-4卫星NIR波段图像制作50m级空间分辨率下的目标识别数据集。首先,对GF-4原始图像进行切片,选取海面上存在舰船和碎云目标的区域,利用目标与海面的区别快速提取舰船和碎云目标;然后,通过人工标注并结合AIS参考信息,对目标打上标签并分类,再按照一定尺寸裁剪目标周围区域作为目标样本。

数据集共包含31 780个目标样本,正样本共5 078个,负样本共26 702个。将GF-4原始图像中的大型舰船目标(即在50m级分辨率下可检测识别)提取出来,作为数据集的正样本;将大小、形状等特征与大型舰船目标相近的碎云目标提取出来,作为数据集的负样本。

1.4 候选目标静态特征提取和鉴别

候选目标的静态特征由单帧的候选目标区域通过CNN进行特征的提取,并利用提取的静态特征对目标进行鉴别,其网络结构如图3所示。该网络结构基于LeNet网络基本架构,共有3个卷积层,2个最大池化层,一个全连接层。每一层都利用了上一层局部区域产生的局部特征。

图3 CNN鉴别网络

每个候选目标区域共有5个波段,即5层,每层有28×28个像素。因此,输入层为5×28×28。然后,通过8通道且卷积核大小为3像素×3像素的卷积层提取目标特征,并设置步长为1,全0填充。在卷积层后衔接批量归一化层,利用小批量上的均值和方差,调整模型的输出,使得模型在训练时更加稳定。激活函数则选用ReLU函数,目的是为了让训练收敛速度加快。池化层采用2像素×2像素最大池化,通过该层后通道数不变,但每个通过的像素数在长和宽两个维度上都进行减半。将卷积层和最大池化层交替连接,并且通过卷积层不断加深通道数以保持卷积核不变。当特征图变成32层,每层像素尺寸为3×3后,将特征图以1个像素平铺形成隐藏层,在隐藏层后面通过全连接的方式形成输出层。根据获取的特征对候选目标区域进行鉴别。

利用LeNet在目标识别数据集上的对特征较少的目标识别速度快、识别精度高的特点,对目标样本进行识别,区分舰船和碎云目标。由于碎云目标在图像中的大小与舰船目标相近,且具有一定的速度,后续轨迹关联时无法剔除,利用CNN对小切片进行鉴别,不但速度快,还可在保证检测率的前提下降低虚警率,达到更好的检测效果。同时,降低了后续目标关联和跟踪的运算成本。

1.5 目标跟踪与动态特征提取

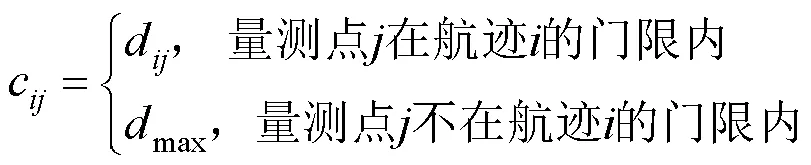

目标的动态特征主要为目标的航向、航速信息,本文利用GNN算法,对鉴别后的多帧目标进行关联,并利用关联后的目标动态特征进行二次鉴别。GNN算法是基于最近邻算法(NN)优化改进而来[19-20]。然而在杂波较大、目标较为密集的情况下,距离最近的量测并不一定是与该航迹关联的正确目标量测,因此并不能很好的进行有效的关联和跟踪。GNN算法将时刻的所有个量测和个现存航迹进行统一分配,设计关联代价函数,计算分配时的总关联代价,将总关联代价最小的量测与航迹分配作为这一时刻的航迹补充,形成航迹。

本文利用地理坐标信息,结合中分纬度航法对目标进行航迹关联和跟踪。传统的GNN关联和跟踪在利用地理坐标信息时,将经纬度坐标看做是二维平面坐标系,并没有考虑到舰船目标在地球表面航行时地球表面的曲率对坐标位置的影响。然而,卫星遥感图像序列的帧间间隔较长,目标在投影平面的位置形变较大,影响目标的跟踪效果。因此采用中分纬度航法进行状态向量的更新,提高目标跟踪的准确性。

计算关联总代价并求出最小关联代价。其中关联总代价为

且

(6)

设舰船目标的运动状态方程为

本文将中分纬度法用于1阶EKF中。经纬度的中分纬度法恒向线模型为

2 实验验证与分析

GF-4卫星成像范围极广,幅宽达400km,兼具红外、全色和多光谱等成像方式。表1为GF-4卫星的基本参数。其中,多光谱传感器(PMS)共有5个波段,分别为全色、蓝色、绿色、红色和近红外波段,其空间分辨率约为50m;红外传感器(IRS)为中红外波段,其空间分辨率约为400m。GF-4卫星拥有较短的重访周期,在同一区域下可得到一段连续时间的序列遥感图像。

表1 GF-4卫星基本参数

Tab.1 Basic parameters of GF-4 satellite

GF-4卫星与其他高分系列卫星相比,其主要特点就是广域成像的能力。比如GF-2卫星虽有着亚米级空间分辨率的成像能力,清晰的成像能力能够更好地进行目标检测,但是其成像幅宽只有45km,远小于GF-4卫星的400km;另外,GF-2卫星的重访周期为5天,与GF-4卫星相比也有很大差距。目前,GF-4卫星已经在轨运行5年多,为海洋监视、水文气象、抗震减灾和农林业等多个领域提供了大量遥感图像数据。

为了验证本文算法的有效性,本文选取了13帧GF-4卫星的NIR波段数据,成像区域位于渤海湾,成像时间自2020年10月17日10:09:59至2020年10月17日10:23:53,共834s,帧频约为64s/帧。每帧的NIR数据共有5个波段,图像大小为10 240像素×10 240像素,原图像为L1A数据(未经过正射校正),分辨率均为50m。先对GF-4卫星图像进行无控制点条件下的正射校正,有效校正了除去量测误差之外的其他误差。

2.1 舰船目标检测实验

本实验选择GF-4可见光图像的波段3(绿光)和波段5(近红外),利用NDWI提取预候选区域。场景1位于烟台和大连中间靠近大连海域,场景2为靠近山东半岛海域,覆盖范围均为50km×50km。图4(a)、(b)为两个场景利用NDWI指数计算得到的密度图,图4(c)、(d)为区域化操作之后的二值图像。从图4(a)、(b)中可以看出,利用NDWI能够有效分割陆地岛屿和较大块的云层,将区域化操作的区域大小设置为8像素×8像素,找到了舰船目标的预候选区域,见图4(c)、(d)。在后续检测完成后利用预候选区域进行陆地、岛屿和大型云层上虚警目标的剔除。

利用灰度直方图对图像进行增强,使目标更突出,提高目标检测的精度。由图5展示的是两个场景灰度直方图可以看出,图像灰度集中在100附近区域并向两侧延伸,且右侧拖尾比左侧拖尾长。选取一定区域内的灰度进行线性变换,拉伸至[0,255],结果如图6所示,其中图6(a)、(b)为变换前图像,整体呈灰白色,对比度低,目标被淹没在杂波中并不明显;图6(c)、(d)为变换后的图像,对比度明显增加,能够更好地区分背景和目标并进行检测。

图5 图像灰度直方图

图6 灰度变换对比

图7 检测出的候选目标区域

选取候选目标的质心作为候选目标区域中心坐标,将候选目标区域裁剪成大小为28像素×28像素的相同尺寸,提取出来并保存成候选目标区域切片。利用已经训练好的CNN网络,对候选目标区域进行鉴别,得到鉴别结果。可以看出,经过CNN网络的鉴别,疑似舰船目标的候选目标区域下降到38个,显著降低了虚警率。为了对比目标检测效果,本文采用传统双参数CFAR、帧差法、比值法和双参数CFAR+CNN鉴别四种算法进行比对。其中帧差法采用两帧差分法,阈值设置为20,比值法阈值为0.01,图8为两个场景单帧实验结果展示,第一行为场景1,第二行为场景2。

图8 单帧实验结果比对

从左往右,依次是传统双参数CFAR、帧差法、比值法和本文算法(双参数CFAR+CNN鉴别)四种算法的单帧目标检测实验结果,可以看出比值法对弱小目标检测的效果并不好。

本文选用一组长序列图像进行对比实验。这个序列的总成像时间约为14min,利用AIS数据作为该区域内的舰船目标参考真值,并结合人工判读,确定目标数量。计算所有帧的检测精度并取平均值,得到最终的检测精度。同时,计算出检测概率和虚警率。单帧目标检测的准确率A、检测概率d和虚警率f的计算公式如下:

其中,t表示检测为舰船目标的舰船目标数;f表示检测为舰船目标的非舰船目标数,即虚假目标数;0表示该区域内所有的舰船目标数,该数目由AIS数据加上人工判读获得,实验总目标数为序列图像中每帧存在的目标数之和。实验结果如表2所示。

表2 四种算法的表现

Tab.2 Performance of four algorithms

从表2中可以看出,传统双参数CFAR和帧差法的检测虚警率较高,且帧差法存在较大数量漏警。本文提出的算法在检测准确率和虚警率上较其他算法均有较大改善,在检测概率(为每帧检测到的舰船目标数量与真实的舰船目标数量比值的平均值)上,传统双参数CFAR与本文算法比较相近,不存在太大差异,均显著优于帧差法。由于GF-4卫星图像中舰船目标过于弱小且存在较多的碎云干扰,比值法不能很好的进行目标检测,其精度太低,故认为该算法不适合,也无法计算精度。

为使本文算法的应用场景更有针对性,表3是对本文所提算法检测出的舰船目标的长度统计。从表3可以看出,本文所提算法对较大型舰船目标(长度≥100m)的检测概率较高,长度在50m和100m之间的检测概率较低。观察实验数据发现,在该海域的中型舰船(50m≤长度<100m)长度呈两极分化状,堆积在50m和100m的上下限,且长度在50m附近的中型舰船目标占据大多数。而GF-4卫星可见光图像的成像分辨率为50m,这样的中型舰船目标,在候选目标区域提取时会被剔除,因此检测概率较低。

表3 本文算法检测出的舰船目标长度统计

Tab.3 Length statistics of detected ship targets

2.2 舰船目标跟踪实验

选择目标检测实验处理得到的目标位置,利用图像中携带的地理坐标系信息,得到仿射变换参数矩阵。将目标的质心像素坐标经过地理仿射变换映射到经纬度坐标系中,获得目标的地理坐标信息,这有利于后续进行目标关联和跟踪以及目标动态特征提取。

利用与中分纬度航法结合的GNN算法,将仿射变换后的候选目标进行多帧的关联和跟踪,得到的跟踪结果见图9。图9中,“o”表示航迹起始点,“+”表示航迹终止点,红色航迹为本文算法跟踪得到的航迹,蓝色航迹为目标参考航迹。

图9 GF-4卫星跟踪结果

可以看出,在无控条件下进行的正射校正存在一定的误差,但是总体误差比较接近参考坐标,统计得到位置误差约为2km。目标跟踪形成的总航迹数为22;跟踪舰船目标形成的航迹数为19,AIS与人工鉴别反馈的结果为21,虽航迹数目大致相等,但是存在部分航迹遗漏和不完整航迹,以及存在一部分虚警目标。其中,航迹遗漏和不完整航迹存在的主要原因均是由于海面噪声不稳定,且由于舰船在航行过程中有可能存在云层的遮挡,导致部分帧序列图像并不能完全检测出所有的舰船目标,在采用GNN关联和跟踪算法后由于航迹过短被剔除,或者是未被剔除但是形成的航迹不完整,不能覆盖所有帧图像。存在一部分虚警目标的原因是由于碎云的存在,虽然本文提出的算法能够大幅度降低碎云的影响,但是受成像分辨率的影响,部分和舰船目标极其相似的碎云目标被当做舰船目标保留了下来,未被剔除。

本文算法能够进一步提取目标的动态特征,包括舰船目标的航向、航速等信息。在跟踪的前几帧,目标航速存在较大波动,但是随着时间的推移,目标的航速信息逐渐稳定,且与AIS提供的参考航速信息相差不大。图10为舰船目标提取的动态信息与参考动态信息进行比对的结果,误差点以每个目标的动态信息估计值为纵坐标,以动态信息参考值为横坐标,若点位越接近中间的零误差线则表示其误差越小。其中图10(a)为航速信息对比结果,经统计其平均航速误差约为0.98kn(约0.5m/s);图10(b)为航向信息对比结果,经统计,其平均航向误差约为4.69°,基本满足广域舰船目标监视需要。

图10 动态信息比对

3 结束语

本文提出了一种碎云条件下运动舰船目标的跟踪方法。通过较长序列的多帧GF-4卫星图像,验证了本文所提算法的有效性,具有较高的目标检测率和航迹转化率,可以从较复杂的场景中有效检测出舰船目标,生成目标航迹,提取目标的动态特征。而且,能够满足一定时间内对较大型舰船目标的持续监视需求,同时,本文算法结合了双参数CFAR和LeNet网络结构,将目标检测转化为二分类的目标识别,既发挥了LeNet识别速度快的优势,又规避了目前日益庞大的深度学习网络算力需求高的缺点,具有较高的工程实现价值和潜力,体现出GF-4卫星在海洋广域监视方面的巨大应用潜力。本文算法可以进一步协同低轨视频小卫星、电子侦察卫星等进行更细致的目标类型识别,为后续多源卫星信息的融合打下了基础。另一方面,如何降低单帧检测时碎云目标对目标检测算法的影响需要进一步研究,如何改进轻量化CNN结构,降低目标检测的虚警率是后续研究应考虑的重点。

[1] 田瑜基. 高分四号卫星应用研究探析[J]. 科技创新导报, 2020(17): 22-23.

TIAN Yuji. Analysis on the Application of GF-4 Satellite[J]. Science and Technology Innovation Herald, 2020(17): 22-23. (in Chinese)

[2] HENRIQUES J F, CASEIRO R, MARTINS P, et al. Exploiting the Circulant Structure of Tracking-by-Detection with Kernels[C]//Proceedings of the 12th European Conference on Computer Vision - Volume Part IV. Berlin, Heidelberg: Springer, 2012.

[3] BOLME D S, BEVERIDGE J R, DRAPER B A, et al. Visual Object Tracking Using Adaptive Correlation Filters[C]//The Twenty-Third IEEE Conference on Computer Vision and Pattern Recognition, CVPR 2010, June 13-18, 2010, San Francisco, CA, USA. IEEE, 2010.

[4] DANELLJAN M, HÄGER G, KHAN F S, et al. Accurate Scale Estimation for Robust Visual Tracking[C]//British Machine Vision Conference, September 1-5, 2014, Nottingham, UK.

[5] DANELLJAN M, ROBINSON A, KHAN F S, et al. Beyond Correlation Filters: Learning Continuous Convolution Operators for Visual Tracking[EB/OL].[2021-05-30]. /https://www.researchgate.net/publication/306187161_Beyond_ Correlation_Filters_Learning_Continuous_Convolution_Operators_for_Visual_Tracking.

[6] DANELLJAN M, BHAT G, KHAN F S, et al. ECO: Efficient Convolution Operators for Tracking[C]//CVPR 2017, July 21-26, 2017, Honolulu, HI, USA.

[7] REN S, HE K, GIRSHICK R, et al. Faster R-CNN: Towards Real-time Object Detection with Region Proposal Networks[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence, 2017, 39(6): 1137-1149.

[8] ZHU K, ZHANG X, CHEN G, et al. Single Object Tracking in Satellite Videos: Deep Siamese Network Incorporating an Interframe Difference Centroid Inertia Motion Model[J]. Remote Sensing, 2021, 13(7): 1298.

[9] BARNICH O, DROOGENBROECK M V. ViBE: A Powerful Random Technique to Estimate the Background in Video Sequences[C]// 2009 IEEE International Conference on Acoustics, Speech and Signal Processing, April 19-24, 2009, Taipei, China. IEEE, 2009.

[10] WANG Z, DU J, XIA J, et al. An Effective Method for Detecting Clouds in GaoFen-4 Images of Coastal Zones[J]. Remote Sensing, 2020, 12(18): 3003.

[11] LU M, LI F, ZHAN B, et al. An Improved Cloud Detection Method for GF-4 Imagery[J]. Remote Sensing, 2020, 12(9): 1525.

[12] XIAO F, YUAN F, CHENG E. Detection and Tracking Method of Maritime Moving Targets Based on Geosynchronous Orbit Satellite Optical Images[J]. Electronics, 2020, 9(7): 1092.

[13] LIU Y, YAO L B, XIONG W, et al. Ship Target Tracking Based on a Low-resolution Optical Satellite in Geostationary Orbit[J]. International Journal of Remote Sensing, 2018, 39(9): 2991-3009.

[14] 姚力波, 刘勇. 基于高分四号卫星的舰船目标跟踪[C]//第四届高分辨率对地观测学术年会, 武汉, 2017. YAO Libo, LIU Yong. Ship Target Tracking Based on GF-4 Satellite[C]//China High Resolution Earth Observation Conference, Wuhan, 2017. (in Chinese)

[15] HOSANG J, BENENSON R, DOLLÁR P, et al. What Makes for Effective Detection Proposals?[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2016, 38(4): 814-830.

[16] 刘伊丽, 张临杰, 张晰, 等. 双参数CFAR舰船检测算法两种实现方法之分析与比较[J]. 中国海洋大学学报(自然科学版), 2017, 47(Sl): 139-145.

LIU Yili, ZHANG Linjie, ZHANG Xi, et al. Comparison between Two Implementations of Two-parameters CFAR Ship Detection Method[J]. Periodical of Ocean University of China, 2017, 47(Sl): 136-142. (in Chinese)

[17] EL-DARYMLI K, MC-GUIRE P, POWER D, et al. Target Detection in Synthetic Aperture Radar Imagery: A State-of-the-art Survey[J]. Journal of Applied Remote Sensing, 2013, 7(1): 071598-071598.

[18] 赵志宏, 杨绍普, 马增强. 基于卷积神经网络LeNet-5的车牌字符识别研究[J]. 系统仿真学报, 2010, 22(3): 638-641.

ZHAO Zhihong, YANG Shaopu, MA Zengqiang. License Plate Character Recognition Based on Convolutional Neural Network LeNet-5[J]. Journal of System Simulation, 2010, 22(3): 638-641. (in Chinese)

[19] YAO L B, XIONG W, LIU Y, et al. GF-4 Satellite and Automatic Identification System Data Fusion for Ship Tracking[J]. IEEE Geoscience and Remote Sensing Letters, 2019, 16(2): 281-285.

[20] MAZZARELLA F, VESPE M, SANTAMARIA C. SAR Ship Detection and Self-reporting Data Fusion Based on Traffic Knowledge[J]. IEEE Geoscience & Remote Sensing Letters, 2015, 12(8): 1685-1689.

A Method for Moving Ship Target Tracking of GF-4 under the Condition of Broken Cloud

LIN Xun1YAO Libo1SUN Weiwei1LIU Yong2CHEN Jin3JIAN Tao1

(1 Naval Aviation University, Yantai 264000, China)(2 National Innovation Institute of Defense Technology, Academy of Military Science, Beijing 100071, China)(3 Beijing Institute of Remote Sensing Information, Beijing 100192, China)

Based on GF-4 satellites’ features of continuous observation and low image resolution characteristics, this paper presents a moving ship target detection and tracking algorithm for GF-4 satellite under the condition of broken cloud. This algorithm refers to the construction idea of convolution neural network (R-CNN) model based on region candidate, and uses double parameter constant false alarm rate (CFAR) to complete candidate target region extraction. In order to make full use of the advantage of LeNet network in convolution neural network (CNN) to identify simple and weak targets, static feature extraction and identification are carried out. Finally, the middle latitude method in geography is combined with the global nearest neighbor (GNN) algorithm to coordinate and track the target track and obtain the target motion information. This paper selects the GF-4 sequence image and the ship self-broadcast newspaper (AIS) information to carry on the experiment verification, proves that the algorithm could eliminate the interference of the broken cloud target under certain cloud condition, and effectively carry on the moving ship target detection and tracking. It has strong engineering application value.

moving ship target detection; target tracking; broken cloud condition; convolution neural network (CNN); GF-4 satellite remote sensing image

TP75

A

1009-8518(2021)05-0127-13

10.3969/j.issn.1009-8518.2021.05.014

林迅,男,1996年生,2019年获海军航空大学学士学位,现在海军航空大学信息与通信工程专业读硕士学位。主要研究方向为目标跟踪、关联。E-mail:919363290@qq.com。

2021-05-31

国家自然科学基金(91538201,61901504,61971432)

林迅, 姚力波, 孙炜玮, 等. 碎云环境下GF-4卫星对运动舰船的目标跟踪[J]. 航天返回与遥感, 2021, 42(5): 127-139.

LIN Xun, YAO Libo, SUN Weiwei, et al. A Method for Moving Ship Target Tracking of GF-4 under the Condition of Broken Cloud[J]. Spacecraft Recovery & Remote Sensing, 2021, 42(5): 127-139. (in Chinese)

(编辑:夏淑密)