智能的边界

2021-11-05乐惠骁贾积有

乐惠骁 贾积有

【摘 要】 本文从人机合作的角度对智能教学系统中的学习者的自主度进行了探讨。通过梳理人机交互设计领域和行为决策领域的相关研究,结合教学场景中的相关实验案例,讨论了智能教学系统中学习者自主度设计的大致原则:一方面,应保证学习者适当的自主度,以满足其自主性的心理需要,同时授予其部分修正系统错误的能力,减少算法厌恶的发生;另一方面,过多或不恰当的学习者自主度也无益于学习,可能导致无法为学习者的学习提供适当的支持,以及选择过载和选择困难的发生。最后,本文提出了设计智能教学系统中学习者自主度的三条具体建议:关注学习者特征,根据学习者特征设计合适的自主度;增加系统和算法的透明度,使得用户能理解智能系统的决策逻辑,或授予用户部分修改算法的权限,以减少算法厌恶的发生;为学习者提供必要的自主学习支持,而非简单地将某些学习过程的控制权交给学习者。

【关键词】 人工智能;智能教学系统;自主度;人机合作;自我调节学习;选择与决策;算法厌恶;选择过载;在线学习;学习支持

【中图分类号】 G434 【文献标识码】 A 【文章编号】 1009-458x(2021)9-0049-10

一、引言

自其研究伊始,智能教学系统研究的一大初衷即模仿人类教师的教学(Self, 1990)。从1970年的第一个智能教学系统开始,智能教学系统已在各种教学场景中有着丰富的应用。时至今日,智能教学系统已发展出形形色色的智能形式:或对学习者内隐的思考过程进行推断,并给予即时的支持(VanLehn, et al., 2005; Anderson, et al., 1995),或用自然语言与学习者对话(Jia, 2009; Nye, et al., 2014),或可识别用户的表情并给予适当的反馈(Arroyo, et al., 2014)。Vanlehn(2011)的研究表明智能教学系统的教学效果(d=0.76)已经接近人类教师(d=0.79),从性能这一角度来说模仿者与被模仿者的差距已经很小,智能教学系统近50年来的研究已取得巨大成功。

在模仿人类教师的这一愿景的驱动下,学习者与计算机的交互正从学习者与媒体的交互渐渐转向学习者与另一智能主体间的交互。在学习的过程中,智能教学系统可以有不同的角色隐喻,如辅导者、教练、评价者等(张志祯, 等, 2019)。在不同的系统中,智能教学系统承担着不同的角色,相应地,学习者也有着不一样的角色。如果换一个视角,这些隐喻暗示了理解智能教学系统的另一种可能:智能教学系统的设计者大可不必将智能教学系统的设计与开发理解为创造出一个全知全能的教学专家,智能教学系统与学习者共同完成学习任务可以被理解为一种人机合作的问题。

在工业领域,生产场景中的人机合作问题,尤其是其中的绩效问题已得到关注。例如,在一条半自动的工业流水线上,哪些环节和工作由机器自动完成,哪些环节由人类工人负责,才能获得更高的生产效率。从绩效上说,单纯的机器工作的效率低于人机合作(张异繁, 2017)。然而在许多场景中,人机合作问题并不仅仅是一个机械地拼合人和机器的工作能力的问题。对于完成任务的人类参与者来说,其所感受到的在任务中享有的自主度的多少将影响其内部动机和合作体验。有研究发现,过多的机器操作会降低用户使用机器的动机和满意度(Kim, et al., 2011),而内部动机和合作(用户)体验的变化最终将影响整个任务的绩效。

在人机交互的研究中,自主度(Autonomy)是一个关键概念,指的是在一个团队中团队成员在工作中所体验到的自由度(freedom)、独立性(independence)和决定权(discretion)(Kim & Hinds, 2006)。舉例来说,在学习者与智能教学系统交互的过程中,一个担任着教练角色的系统比一个担任同伴角色的系统享有更大的自主度,相应地,学习者在教练系统中的自主度就更小。担任教练角色的系统,如Cognitive Tutor(Ritter, et al., 2007),需要根据学习者的情况分解复杂问题,一步步引导学习者进行下一步的学习。在此过程中,教学内容的选择、学习者当前状态的评估、教学材料的呈现方式都是由系统自行选择的,而学习者则处于“任人摆布”的状态。而一个担任同伴角色的系统,如LuCy(Goodman, Linton, & Gaimari, 2016),更多的只是鼓励学习者在学习过程中进行反思。那么,在使用智能教学系统的过程中,学习者享有的不同自主度对学习效果会有影响吗?

目前,关于智能教学系统的研究大多只关注提升系统的自动性,即增强计算机系统的自动化程度,使其在学习科学与信息技术的支持下对学习场景中的各种信息进行感知和推断,自动地做出下一步决策。然而,很少有研究关注学习过程中的主体——学习者的自主度在这一人机合作过程中所产生的影响。基于以上背景,本文旨在讨论智能教学系统中学习者拥有的自主度对学习效果的可能影响,以此明确怎样的人机合作才能更好地提升学习者使用智能教学系统的效果。

为讨论这一问题,之后将延下述逻辑展开论述。

为什么学习者在使用智能教学系统时需要一定的自主度?自我决定理论(self-determination theory)较为成熟地阐述了个体对于自主度的需求。也有一些教育学研究者从该理论出发,讨论学习者在教学场景中对于自主度的需要(Niemiec & Ryan, 2009; Black & Deci, 2000)。本文将借鉴自我决定理论,深入探讨智能教学系统中学习者和自主度之间的复杂关系。

智能教学系统给予学习者的自主度并非是毫无边界的,过多或过少的学习者自主度都会对学习产生负面影响。本文将通过论述在学习者获得过多或过少自主度造成的后果,尝试构造一个智能教学系统中学习者应享有的“适度”的自主度边界。由于自主度这一概念在智能教学系统中的研究较少,缺少直接的来自实证研究的证据,本文主要从学习效果的一个重要预测因素即学习动机入手,讨论不同的智能教学系统设计对于学习者的学习动机和用户体验的影响。另外,结合行为决策(Judgement and Decision Making)领域在关于人机交互问题上的实证研究成果,如选择过载和算法厌恶等,探讨某一计算机系统中不同的自主度设计对用户的影响,并结合教育学领域实证研究的结果来推论教学场景中这一类影响是否依然有可能发生。本文关注的智能教学系统主要以智能资源推荐、智能导学系统为主。

本文最后根据上述讨论的结果,提出优化智能教学系统设计的若干建议。

二、学习者的自主度——人与机器的合作与冲突

用机器代替人类教师是智能教学系统发展的目标。目前主流的研究方向是增强系统的智能性,使其成为一个“全知全能”的专家型教师,实现各种复杂任务的交互。但是越来越多的学者认识到,在当前人工智能的发展水平下,学习者与智能教学之间的关系更多的是一种人机合作关系。贝克(Baker, 2016)认为当前的智能教学系统的发展与其初始的愿景发生了某种割裂:现有的真正在教育一线场景中使用的智能教学系统并没有很强的智能性,与研究中展示的系统的智能性相去甚远。这种割裂表明,有的智能教学系统的发展方式可能遇到了某种瓶颈,以至于成熟的智能系统无法在实际教学中部署使用。机器善于处理复杂信息,而人则更善于思考。是否在当前这种发展模式之外,还存在着一条人工智能与教育结合的出路——人机合作的模式?

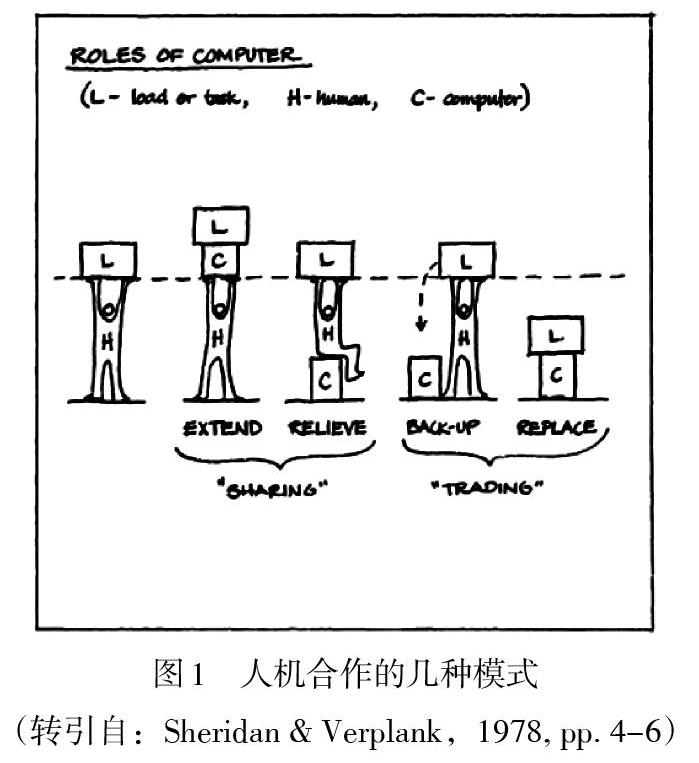

将学习者在智能教学系统中的学习理解成一种人机合作是本文的基本出发点,但有必要区分这种人机合作的形式与一般工业场景中的人机合作。施里丹等(Sheridan & Verplank, 1978)用图1表示人与电脑之间的关系。在合作处理任务时,有这样几种合作模式:①完全人工处理任务;②人在计算机的帮助下处理任务(如高強度的科学计算);③计算机承担一部分人的工作(如批处理任务);④计算机为人类工作做好备份;⑤计算机完全替代人类进行工作。

但是在智能教学系统中,学习者与系统的关系又有所不同。学习者与系统的共同目标应是学习者本人行为和行为潜能的改变,这就意味着计算机不可能代替学习者去学习,学习者也并非独自完成这一目标,所以学习者与系统的合作模式是共享对学习过程的控制权,即施里丹等总结的第二种和第三种合作模式。

自我调节学习理论认为学习者在自主学习中会使用一些策略来帮助自己学习。自我调节学习的能力对学习者来说十分重要,学习者是否能进行自我调节学习与其最终的学业表现高度相关。自我调节学习可以分为几个阶段:①评估自己的状态,激活先前知识,设定自己的学习目标并规划学习;②在学习过程中监控自己的学习行为和状态;③在学习过程中控制自己的学习行为、状态和外部环境;④学习结束后进行自我评价和反思(Pintrich, 2000)。在一个智能教学系统中,计算机时常会介入其中的某几个阶段,甚至代替学习者做出决策。例如智能教学系统会帮助学习者选择适合其能力的学习内容(阶段1),监控学习者的当前情感(阶段2),监督学习者的不良学习行为(阶段3),分析学习者的学习过程并进行归因(阶段4)。对于一些学习者,系统在某些阶段的接管对学习过程的控制权是有利的,但是对于另外一些自主学习者,可能这种控制反而会降低其使用体验——学习者和智能教学系统的合作与冲突就在这一过程中产生了。在这样的关系中,我们能否划清学习者与系统各自拥有的对学习过程的控制权限,使得二者达成更高效的合作?

(一)学习者对自主度的需求

1. 自我决定理论与学习动机

人有着追求自由的天性。自我决定理论(self-determination theory,SDT)是Deci和Ryan(2000)提出的关于人类行为的动机理论,其核心思想是将人类的动机归结为内在倾向与外部环境有机结合、共同作用的结果。自我决定理论提出了人的几个基本心理需要,即胜任(competence)、自主(autonomy)与关系(relatedness),大部分个体都为了满足这三大需要而努力(张剑等, 2010)。自我决定理论认为外部环境与个体内在共同作用,通过满足三大心理需求促进内部动机和外部动机的内化,从而影响个体的行为和心理健康。

在三大心理需要中,自主需要指的是个体有先天的、倾向于自己做选择的需要。在环境中,物质奖励、监督、评价、时间期限等规定常常使得个体感到自己的行为受到其他主体或环境的控制,自主需要无法得到满足,从而导致内部动机的下降。而一个支持个体自主决策的环境则有助于提升个体对于任务的内部动机(Deci, et al., 1994)。人机交互的实证研究证实:机器过多介入人类的操作过程将降低其对操作过程的满意程度(Kim, et al., 2011)。

贾利维蒂等(Jolivette, et al., 2002)的一项课堂观察研究发现,学习者确实会在课堂中自发地寻求一些做选择的机会。许多研究也确认了在传统课堂教学中给予学习者更多的选择机会有利于提升其学习动机。例如,麦勒(Myrow, 1979)的研究发现给予学习者选择学习主题的机会有助于提升其学习动机:一组学生可以在6个学习主题中进行选择,另一组学生只能选择被随机分配的学习主题进行学习。研究发现拥有选择学习主题自主度的学生对于学习内容有更高的热情,并更愿意继续就这一主题进行学习。此外,科恩等(Kern, Bambara, & Fogt, 2002)的研究也发现在教学过程中给学习者提供选择能提升其30%的参与度。

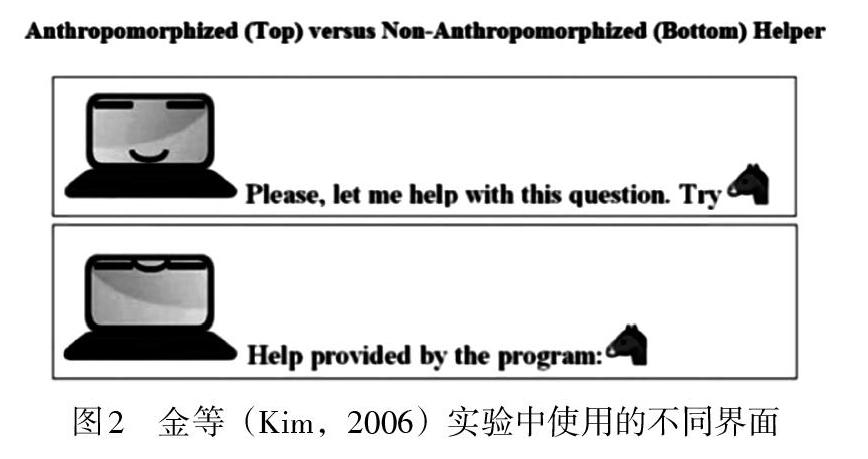

在智能教学系统的相关研究中,对于教学代理(pedagogical agents)的系统综述研究也揭示了这样一种矛盾的现象:相对于没有教学代理(与学习者互动的屏幕上的虚拟形象)的系统来说,有教学代理的系统能催生更好的学习效果,但是学习者的动机却降低了(Schroeder & Adesope, 2014)。虽然施罗德等(Schroeder, et al., 2014)将动机降低的这一效应解释为一部分学习者并不喜欢这一类系统,但是近期的一些研究为我们理解这一问题提供了新的视角:金等(Kim, Chen, & Zhang, 2016)的研究发现,即使是给电脑界面画上一个笑脸更改其拟人程度(图2),用户的使用体验也会有显著的降低。其原因在于用户感知到当前环境中有另一个主体在与自己争夺系统的控制权,其自主度受到了威胁,从而导致用户体验下降。教学代理对学习者动机的副作用也许可以通过这一路径得到解释。

2. 算法厌恶

除了能否自己做选择外,学习者是否认同系统做出的选择也是值得考量的因素。许多智能教学系统往往扮演辅导者的角色,为学习者的学习提供建议(张志祯, 等, 2019)。从性能上来看,基于统计学的预测系统的预测能力远远超越人类专家,其工作效率也远超人类(贾积有, 2018a; 贾积有, 2018b)。然而,行为决策领域的相关研究发现,即使个体认识到了智能决策系统提供的建议的准确度超过人类决策者,但是其更倾向于选择人类决策者来帮助自己进行决策,这一现象被称为“算法厌恶”(algorithm aversion)(Eastwood, Snook, & Luther, 2012)。

迪特沃斯特等(Dietvorst, Simmons, & Massey, 2015)的研究用一系列实验来探究决策者在何种情况下会自主做出决策,在何种情况下会选择采纳算法的决策结果。其研究发现,在预测任务中,个体更倾向于相信自己的判断而非辅助的预测算法的输出结果。甚至即使有时被试已经意识到算法预测精度高于自己,但仍会选择自己的预测结果作为最终答案。

后续更多的研究表明这一现象广泛存在于许多决策场景中。例如,在医疗场景中,相较于医用人工智能,病人更喜欢人类医生开出的处方(Longoni, et al., 2019);在一个以应用统计学考试为场景的实验中,考生在面临预测股市走向的任务时更愿意用人类专家而非统计模型给出的结果来修正自己的结果,在综合多种决策结果时,他们也对人类专家给出的结果赋予更高的权重(?nkal, et al., 2009)。

虽然在智能教学系统的应用场景中,仍未有充分的实证研究探讨算法厌恶在这一类系统中是否存在。但可以预见的是,至少对于部分能进行自我调节学习(self-regulated learning)的学习者来说,学习也是一个需要学习者进行选择与决策的场景(Zimmerman, 1989),当智能教学系统的判断与学习者自己的判断相左,系统却依然“我行我素”地执行程序逻辑时,学习者的内部动机就会下降。

3. 系统的错误决策

必须承认,在某些方面,如今智能教学系统的一些预测结果依然存在着相当的误差。例如,目前声音识别算法的识别准确率最高也只能到60%左右(Latif, et al., 2019),在許多时候,或许学习者会比系统更了解自己的状态。这样的“绝对”误差带来的后果更为严重。一方面,系统做出了错误的决策,给出了错误的干预;另一方面,学习者感知到了系统的错误,会产生更严重的算法厌恶(Dietvorst, et al., 2015),进一步降低学习动机。所以,给予学习者更多的自主度也是给予他们手动纠正系统错误的机会。

(二)过多/不恰当的自主度

前文讨论了智能教学系统中学习者对于自主度的要求。一方面,从自我决定理论出发,学习者天然地追求在学习过程中进行选择和决策的权力,在教学过程中赋予学习者一定的选择空间有利于提升其学习动机;另一方面,算法厌恶的相关研究表明,如果将学习者看作是自己学习计划的决策者,相比于智能教学系统的建议,他可能更相信自己的判断,而机器与人的两种判断的不一致也会导致学习动机的下降。从以上讨论中可以发现,保证智能教学系统中学习者适度的自主度有助于提升学习者的学习动机。

但是,事物总有其两面性。接下来,我们将论证给予学习者过多的自主度或错误地给学习者提供选择的机会,也将妨碍其学习动机和学习效果。

1. 缺少学习支持

在传统课堂中,即使有一些自学者对学习内容很感兴趣,但其最终的学习效果很难与接受课堂中教师系统教学的学习者相比,原因在于后者的学习过程经过了科学、系统的教学设计。一般的学习者不是教学法的专家,他们在学习过程中做出的决策以及使用的策略很难与智能教学系统相媲美,因为后者是科学的教学设计的产物。所以这样就引出了一个问题:在智能教学系统中,赋予学习者更多的自主度往往意味着系统提供了更少的学习支持,许多关于自身学习的决策需要学习者自己做出。

如上文所述,一些研究者在传统课堂中研究了赋予学习者更多选择机会对其学习动机和效果的影响,但是也有许多研究同时揭示了这一类场景中学习动机与学习效果之间的割裂:虽然给予学习者更多的选择有利于提升其学习动机,但是其最终的学习效果并没有显著的变化。例如,麦勒(Myrow, 1979)的研究发现,虽然有选择学习主题权力的那一组的学习者的学习动机增强了,但是其在学习效果上与对照组并无显著差别。纳卡穆拉等(Nakamura, Phung, & Reinders, 2020)的研究发现,在课堂中给予外语学习者更多的选择机会虽然能有效提升学习者在学习过程中的体验,但是在学习者投入的大多数维度上,有更多选择机会的学习者与选择机会更少的学习者之间并无显著差异。

虽然麦勒(Myrow, 1979)将这一情况归咎于提供的选择自由度不够“彻底”,即其只提供了6种学习材料以供选择(这一点将之后展开讨论),但是学习者缺少自主学习能力也是一个可能的原因。需要注意的是,如果将学习动机看作是学习效果的自变量,从主效应上来说,内部动机的强度与学习效果之间有一定程度的正相关,但是内部动机的增强并不一定导致学习效果的提升,绩效是内部动机和外部动机共同作用的结果(Cerasoli, et al., 2014)。许多时候,更多的学习者自主度往往意味着更少的学习引导和支持。本研究认为,学习者缺少与其自主度相匹配的自我学习能力是一个可能的原因。

在软件的交互设计中,为“新手型”用户设计交互与为“专家型”用户设计交互的思路往往是不同的(Cooper, et al., 2014)。同样,对一个“专家型”学习者来说,更多的自主度意味着内部动机的提升,且其可以使用自己熟悉的学习策略来规划自己的学习,而一个“新手型”学习者虽然自主度的需求得到满足,但可能因为缺少教学者的引导而不知所措。

从整个学习者群体来看,并不是所有学习者都有自我调节学习的能力。一部分学习者可以自主完成自我学习策略的几个阶段,但是另一部分学习者则可能需要计算機介入其中的几个学习阶段并引导或代替其做出决策,才能取得更好的学习效果。

这一点或许可以通过对比麦勒(Myrow, 1979)与赫斯卡等(Huéscar, et al., 2019)的两个实验得到一定程度上的印证。后者实验中实验组的干预方式并不是简单地给予学习者更多的选择,而是采用支持学习者自主度的方式(autonomy supportive)进行的,即教师鼓励实验组中的学习者参与活动、参与小组讨论,直到学习者发展出能自己组织学习的能力。相较于另一组简单按照教师的想法执行教学的对照组,在前后测中实验组的学习效果有显著的变化,感知到的自主度有很大的提升,而对照组则无显著的变化。该实验与麦勒(Myrow, 1979)研究的不同之处在于其中设计了对学习者自主学习的支持机制,使得学习者在获得更多的自主度的同时并不会因为缺少必要的学习支持而阻碍学习效果的提升。

2. 选择过载

正如麦勒(Myrow, 1979)将提供选择机会后未能提升学习效果解释为提供的选择机会不够“彻底”、选择集不够庞大一样,2000年前的行为心理学理论一直认为给主体的选择空间应当是多多益善的,越是多样的选择越能满足主体对于自主度的追求,从而获得更正面的行为与动机。

然而,近年来的行为心理学研究逐渐推翻了这一论断。伊恩格等(Iyenger & Lepper, 2000)发现,正如麦勒(Myrow, 1979)的实验中对于选择数量的设计一样,以往的心理学关于选择的实验中呈现的选择集的大小大多在2~6个选择。考虑到人的短时工作记忆容量是7左右(Lisman & Idiart, 1995),包含2~6个选择的选择集并不足以对短时工作记忆造成很大的负荷,故个体在这一量级的选择集中进行选择是一件相对更愉悦的事。但是,一旦个体面临的选择数量远远超过短时工作记忆可以处理的容量时,增加选择集的数量只会降低个体的内部动机。这一现象被称为“选择过载”(Choice Overload)。

在伊恩格等(Iyenger & Lepper, 2000)的研究中,有一个相似的教育场景下的实验设计:在一堂社会心理学课程上,193位大学生被随机分成两组,完成同一项课程的附加作业。一组学生可以在6个作业主题中选择一个主题,另一组学生则可以在30个作业主题中选择一个主题。结果显示在作业的质量和完成率上前者均高于后者。由于学习者需要在太多的可选择项之间进行取舍(trade-off),太多的选择对其工作记忆造成过大的认知负荷,反而降低了其完成任务的动机。同样,在教学场景下布鲁克斯等(Brooks & Young, 2011)的实验中也有类似发现,即在实体课堂中给予学习者提供更多选择的机会未必提升学习者的动机。相反,在一定的边界条件下过多的选择反而会有副作用。

伊恩格等(Iyenger & Lepper, 2000)认为,选择过载之所以发生,是因为个体在进行决策时需要对不同选择的结果进行考量,如需要考量做出错误选择的后果,需要了解和评估每个备选项的优劣,等等,这一切都对其认知造成了一定的负荷。同样,在教学场景中,这样的情况也有可能发生。举一个典型的例子:学习者在选择接下来的学习内容时,需要综合评估自身的状况与学习内容的属性,还需要考量情境中的各种因素以对各选择的好坏进行评估。可见,在这种场景中提供太多的备择项也会造成认知负荷的上升,导致学习动机的下降。

3. 两难选择削弱学习动机

同样在决策与选择领域,博迪(Botti, 2004)的研究揭示了这样一种矛盾的现象:虽然个体都更倾向于自己做出决策,但是并非所有拥有选择机会的个体的满意度都会高于没有选择机会的个体。如果选择集中的各备选项都符合选择者的喜好,那么相对于没有选择机会的个体来说,选择者体验到的满意度会高于没有选择机会的个体。但是,如果备选项并不能很好地符合选择者的喜好,那么他们体验到的满意度甚至比那些没有选择机会的个体低。换句话说,虽然从主效应看选择者能体验到更多选择的自主度,有更强的动机,但是当其面临一个两难选择时,其对于选择过程的满意度甚至不如没有选择机会的个体。

相似的情况可能同样会发生在教学场景中。扎克等(Zach & Yanovich, 2015)的研究也得到了一种与自我决定理论相悖的结果:在体育课上,一组学生可以在5~8种运动中选择自己想参与的运动,而另一组学生没有选择的机会。最后的结果显示,没有选择机会的学生在选择满意度上反而高于有选择机会的学生。由于场地的限制,许多学生最喜欢的体育课程都无法开展,而有选择机会的学生之所以选择了某样课程可能“并不是因为喜欢这种运动,而只是更不喜欢其他运动”。所以,当选择者面临两难选择后,他们对于选择过程和结果的满意度就会下降。有理由相信在智能教学系统中相似的情况也会发生。当学习者必须在多种与自己的偏好不一致的备选项中做出选择时,其学习动机就有可能会下降。

三、学习者自主度的边界

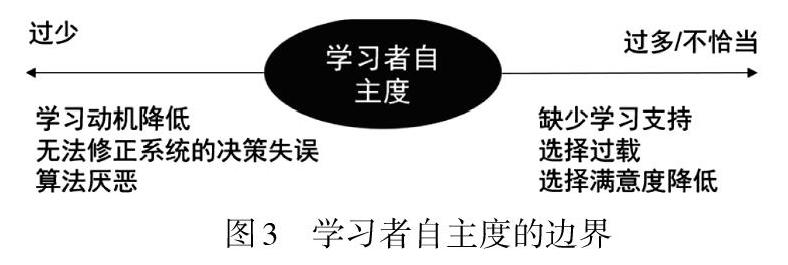

从以上的讨论中,我们大致从学习者选择的角度勾勒出了智能教学系统中学习者自主度的一个轮廓,如图3。

一方面,从自我决定理论出发,学习者需要有一定的自主度。此外,算法厌恶的相关研究显示个体在许多时候并不信赖机器的决策结果。如果系统处处僭越学习者的选择和决策,学习者的动机水平就会下降。另一方面,如果给予学习者过多的或者不恰当的自主度,学习者的学习动机也有可能降低,妨碍学习效果的提升。更多的学习者自主度往往意味着更少的学习支持,如果仅仅通过更多的自由度提高学习者的动机水平而没有相应支持其自主学习,并不一定能提高其最终的学习效果。此外,过于复杂的选择可能使学习者选择过载,降低其学习动机水平;呈现给学习者与其偏好不一致的可选择项也有可能降低其对学习内容选择过程和结果的满意度。

由此可以发现,在智能教学系统中恰当设计学习者自主度的关键,在于在学习者的自主度和人工智能系统的自主度之间寻求某种平衡。然而,由于缺少本领域相关实证证据的支持,这个平衡点难以确切界定。基于此,在接下来的讨论中,本文将尝试援引自主调节学习和用户交互、行为决策领域的相关研究成果,为智能教学系统的设计提出若干建议。

1. 关注不同学习者对自主度的不同需要

如同教学设计的模型一样,学习者特征的前端分析也应是智能教学系统设计中的一项重要工作(Dick, 1996)。总体来说,在设计智能教学系统时,由学习者确定学习者需要多大的自主度可以从两方面来考虑:①学习者是否对自己的学习有明确的目标与规划;②学习者对于学习内容的熟悉程度。

从学习目标与规划来说,自我调节学习理论给出了一个对学习者进行分类的视角:如果说所有学习者都有学习目标的话,一部分学习者可以自主、有效地对自己的学习过程进行规划,而另一部分学习者则可能在自我调节学习的某几个阶段需要系统帮助甚至替代其进行决策。对于前者而言,赋予其更多的自主度有利于提升其学习动机,同时可以更少地牺牲学习效果,因为这部分学习者相对来说需要更少的学习支持,如果在此时对其学习过程加以过多的约束和外在规划,其学习动机水平反而会下降。对于后者来说,赋予其更多的自主度却往往意味着让无法有效掌控自己学习的学习者来冒险进行决策。选择过载发生的内部心理机制在于评估过于复杂的备选项和选择集需要占用大量的认知资源,引起个体对选择活动本身的厌烦和内部动机水平的下降。切讷夫等(Chernev, B?ckenholt, & Goodman, 2015)在元分析中提出了引发选择过载的四个因素:两个外部因素为选择集复杂、选择任务过难;两个内部因素为不明确自身选择偏好、不明确选择的目的。从这一角度来说,自我调节学习更强的学习者更明确为何选择,也更擅长评估当前的学习环境(Pintrich, 2000; Shah & Oppenheimer, 2008),这也使得他们更不易选择过载。

所以学习者的自我调节学习能力可以是判断学习者需要多大程度自主度的一个理想指标。同时,丰富的已有研究和量表等工具使得这一指标的使用在工程上也易于实现。举例来说,用户刚进入系统时用自我调节学习量表对其自我学习能力进行一个简单的分类,之后针对性地赋予不同程度的自主度,也可能有效促进其学习(Zimmerman & Pons, 1986; Zimmerman, et al., 1992)。

同时,学习者对于学习内容的熟悉程度也是一个重要的决定因素。对于熟悉学习内容的学习者来说,选择集和选择任务的困难度会有一定程度的下降,此外他们对于自身的选择偏好也更清晰。切讷夫(Chernev, 2003)的研究认为,在面临选择任务时,在任务开始之前心中已有理想选择项的决策者更不易发生选择困难。而在智能教学系统中,学习者构造出这样一个希望学习的“理想型”需要一定的过往经验的支持,需要对学习内容有更多的了解。

所以,能否有效地鉴别“新手型”和“专家型”学习者,能否鉴别有明确学习目的的学习者是智能教学系统自主度设计的一个关键问题。应根据不同的学习者特征决定在何种程度上干预或指导学习者学习。在工程上,动态自主度(Dynamic Autonomy)是人机交互领域提高人机合作效率的一种解决方案,即由当前系统评估人类操作者的操作是否能完成任务目标,并决定是否等待人类的操作指令或是自主做出响应(Schermerhorn & Scheutz, 2009; Hardian, et al., 2006)。对于一个学习者背景多元的智能教学系统来说,也可以按照相似的思路进行设计,感知当前学习者的行为和状态,并决定是否给予适当的干预、如何提供个性化的交互和学习支持。

2. 采纳更透明的算法和系统

迪特沃斯特等(Dietvorst, et al., 2015)的研究指出,決策者出现算法厌恶的一个先决条件是发现算法犯错。考虑到目前智能教学系统的发展水平,在学习者使用系统的过程中很难避免系统犯错(如推荐不恰当的资源、对话中文不对题等),那么增加算法系统的透明度就成了为数不多的解决方案之一,即让学习者看到算法内部更多的信息,包括该算法如何运行、可以调节哪些参数来调整结果等。

迪特沃斯特等(Dietvorst, Simmons, & Massey, 2018)的研究发现了克服算法厌恶的一种方案:相比那些自己无法控制、无法理解其内部逻辑的算法,人们更喜欢使用那些自己可以调整的“不完美”的算法。即使在预测精度上有所偏差,但是只要有一点修改算法的权限,也可以极大地提升其使用动机水平。所以,如果在智能教学系统中开放系统的一小部分权限,能使学习者通过调节一些简单参数“定制”自己的系统,或许也将有显著的积极效果。例如,在一个电脑担任辅助者的系统中,学习者设置解题提示出现的逻辑和方式;原先系统判定学习者的当前能力未达到某一阈值就弹出提示,学习者可以小幅度修改这一阈值以配合自己的学习规划。

伯格等(Berger, et al., 2020)也提出了克服算法厌恶的一种新思路:向用户展示系统所使用的算法正在错误中“吸取教训”,随着用户的使用精度变高,能有效降低算法厌恶程度。所以,在智能教学系统中向学习者展示算法正在错误中进步,也能有效提升学习者的内部动机水平以及使用系统的意愿。

此外,增加系统决策的透明度,在用户能理解的程度上向其解释为何这样决策,能帮助用户理解系统决策的逻辑,还可以给手动修正系统的错误决策提供可能。更透明的算法能帮助学习者判断机器是否做出了正确的决策。如果学习者有相应的自主度和控制权,他们可以手动修正系统的决策结果,从而获得更优的学习效果和体验。此外,在系统并不确定对当前学习者的状态评估是否准确时,可以征求学习者的输入,辅助其进行判断,以减少错误决策。

3. 增加學习者自主学习的支持

虽然在许多情况下更高的学习者的自主度往往意味着更少的学习支持,但是值得注意的是,系统能提供的学习支持与学习者的自主度之间并不是零和的,通过适当的设计可以在提升学习者自主度的同时依然提供必要的学习支持。

正如赫斯卡等(Huéscar, et al., 2019)在传统课堂中取得成功的方式一样,在智能教学系统中添加支持学习者自主学习的设计是一个可行的方案(Wong, et al., 2019)。例如,可以在学习者选择学习内容之前呈现一些提示,刻意引导其使用自我调节学习的策略评估自己当前的状态,或基于系统的判断给出一些建议,之后再做出决策(Bannert & Reimann, 2012)。这种设计既满足了学习者对于学习自主性的要求,又给“新手型”的学习者提供了必要的支持。与系统动态自主度的设计策略不同,这种策略的一大特点在于并非通过改变系统的设计去迎合不同类型的学习者的需要,而是通过塑造学习者的自我调节学习能力等方式在使用的过程中改变其对于自主度的需要,使得学习者适应系统的自主度设计。

4. 以适当的方式组织和呈现信息

如果能够通过一些策略提供关于每个选择的必要信息(如备选项的难度、复杂度),或以适当形式来呈现选择项的信息(如以知识图谱的方式呈现学习内容),也有助于学习者进行选择,防止选择过载的发生(Chernev, 2006)。这其中的核心在于降低学习者在决策过程中的认知负荷。

四、结论

本文从人机合作的角度对智能教学系统中的学习者的自主度进行了探讨,通过梳理人机交互设计领域以及行为决策领域的相关研究,结合教学场景中的相关实验案例,讨论了在智能教学系统中学习者自主度设计的大致原则:一方面,应保证学习者适当的自主度,以满足其自主性的心理需要,授予其部分修正系统错误的能力,减少算法厌恶的发生;另一方面,过多的或不恰当的学习者自主度也无益于学习,可能导致无法为学习者的学习提供适当的支持,以及选择过载和选择困难的发生。最后,本文提出了设计智能教学系统中学习者自主度的三条具体建议:①关注学习者特征,根据学习者特征设计合适的自主度;②增加系统和算法的透明度,使得学习者能理解智能系统的决策逻辑,或授予学习者部分修改算法的权限,以减少算法厌恶的发生;③为学习者提供必要的自主学习支持,而非简单地将某些学习过程的控制权交给学习者。

由于智能教学系统相关领域的学习者选择和自主度研究较少,本文在论证过程中引用了行为决策领域和人机交互领域的一些研究结果,为了保证这些结论适用于智能教学系统的场景,另结合实体课堂中学习者选择机会与学习动机、学习效果的相关研究进行推论。但是这些结论仍然需相关实证研究做进一步的验证。此外,本文未能给出一个明确的学习者自主度的定义,对自主度的探讨大多从学习者在学习过程中的选择与决策进行,未来研究可以从更多角度展开讨论。在许多场景下,智能教学系统使用中的人机交互并不只限于单个学习者与系统之间的交互,还有可能包含其他利益相关者,如教师在智能教学系统的帮助下确定学习者的学习内容,未来的研究可以针对这些更多主体的更复杂的智能教学系统中的主体自主度进行探讨。

最后,一些批判的声音应该是有益的(Baker, 2016; 李芒, 张华阳, 2020)。智能教学系统研究的目的是“育人”而非“造人”,应是提升学习者的智能而非本末倒置地去创造一个全知全能的机器教师。相比那个看似宏大的用机器代替人类教师的愿景,如何促进教学才应是智能教学系统研究的初心。在这个意义上,一种全新的以学习者为中心的智能教学系统的发展范式可能正逐渐浮现在我们面前,其中的人机合作、自主度等概念都值得进一步研究。

[参考文献]

贾积有. 2018a 人工智能与教育的辩证关系[J]. 上海师范大学学报(哲学社会科学版),047(3):25-33.

贾积有. 2018b. 人工智能赋能教育与学习[J]. 远程教育杂志,36(1):39-47.

李芒,张华阳. 2020. 对人工智能在教育中应用的批判与主张[J]. 电化教育研究,41(3):29-39.

张剑,张建兵,李跃,Edward L. Deci. 2010. 促进工作动机的有效路径:自我决定理论的观点[J]. 心理科学进展,18(5):752-759.

张异繁. 2017. 人机合作决策中效率与信任问题的研究[D]. 武汉:华中科技大学.

张志祯,张玲玲,徐雪迎,刘佳林. 2019. 人工智能的教学角色隐喻分析——以人工智能教育应用领域高影响力项目为例[J]. 中国远程教育,(11):24-37,57,93.

Arroyo, I., Woolf, B. P., Burelson, W., Muldner, K., Rai, D., & Tai, M. (2014). A multimedia adaptive tutoring system for mathematics that addresses cognition, metacognition and affect. International Journal of Artificial Intelligence in Education, 24(4), 387-426.

Baker, R. S. (2016). Stupid tutoring systems, intelligent humans. International Journal of Artificial Intelligence in Education, 26(2), 600-614.

Berger, B., Adam, M., Rühr, A., & Benlian, A. (2020). Watch Me Improve—Algorithm Aversion and Demonstrating the Ability to Learn. Business & Information Systems Engineering, 1-14.

Black, A. E., & Deci, E. L. (2000). The effects of instructors autonomy support and students autonomous motivation on learning organic chemistry: A self-determination theory perspective. Science education, 84(6), 740-756.

Botti, S. (2004). The psychological pleasure and pain of choosing: when people prefer choosing at the cost of subsequent outcome satisfaction. Journal of personality and social psychology, 87(3), 312.

Brooks, C. F., & Young, S. L. (2011). Are Choice-Making Opportunities Needed in the Classroom? Using Self-Determination Theory to Consider Student Motivation and Learner Empowerment. International Journal of Teaching and Learning in Higher Education, 23(1), 48-59.

Cerasoli, C. P., Nicklin, J. M., & Ford, M. T. (2014). Intrinsic motivation and extrinsic incentives jointly predict performance: A 40-year meta-analysis. Psychological bulletin, 140(4), 980.

Chernev, A. (2003). When more is less and less is more: The role of ideal point availability and assortment in consumer choice. Journal of consumer Research, 30(2), 170-183.

Chernev, A. (2006). Decision focus and consumer choice among assortments. Journal of Consumer Research, 33(1), 50-59.

Chernev, A., B?ckenholt, U., & Goodman, J. (2015). Choice overload: A conceptual review and meta-analysis. Journal of Consumer Psychology, 25(2), 333-358.

Choi, S., & Clark, R. E. (2006). Cognitive and affective benefits of an animated pedagogical agent for learning English as a second language. Journal of educational computing research, 34(4), 441-466.

Cooper, A., Reimann, R., Cronin, D., & Noessel, C. (2014). About face: the essentials of interaction design. John Wiley & Sons.

Deci, E. L., Eghrari, H., Patrick, B. C., & Leone, D. R. (1994). Facilitating internalization: The self-determination theory perspective. Journal of Personality, 62, 119-142.

Deci, E. L., & Ryan, R. M. (2000). The “what” and “why” of goal pursuits: Human needs and the self-determination of behavior. Psychological Inquiry, 11, 227-268.

Dick, W. (1996). The Dick and Carey model: Will it survive the decade? Educational technology research and development, 44(3), 55-63.

Dietvorst, B. J., Simmons, J. P., & Massey, C. (2015). Algorithm aversion: People erroneously avoid algorithms after seeing them err. Journal of Experimental Psychology: General, 144(1), 114.

Dietvorst, B. J., Simmons, J. P., & Massey, C. (2018). Overcoming algorithm aversion: People will use imperfect algorithms if they can (even slightly) modify them. Management Science, 64(3), 1155-1170.

Eastwood, J., Snook, B., & Luther, K. (2012). What people want from their professionals: Attitudes toward decision-making strategies. Journal of Behavioral Decision Making, 25(5), 458-468.

Goodman, B., Linton, F., & Gaimari, R. (2016). Encouraging student reflection and articulation using a learning companion: a commentary. International Journal of Artificial Intelligence in Education, 26(1), 474-488.

Hardian, B., Indulska, J., & Henricksen, K. (2006, March). Balancing autonomy and user control in context-aware systems-a survey. In Fourth Annual IEEE International Conference on Pervasive Computing and Communications Workshops (PERCOMW'06) (pp. 6-pp). IEEE.

Huéscar, E., Moreno-Murcia, J. A., Domenech, J. F., & Nú?ez, J. L. (2019). Effects of an Autonomy-Supportive Physical Activity Program for Compensatory Care Students During Recess Time. Frontiers in Psychology, 10.

Iyengar, S. S., & Lepper, M. R. (2000). When choice is demotivating: Can one desire too much of a good thing? Journal of personality and social psychology, 79(6), 995.

Jia, J. (2009). An AI framework to teach English as a foreign language: CSIEC. AI Magazine, 30(2), 59-71.

Jolivette, K., Stichter, J. P., Sibilsky, S., Scott, T. M., & Ridgley, R. (2002). Naturally occurring opportunities for preschool children with or without disabilities to make choices. Education and Treatment of Children, 396-414.

Kern, L., Bambara, L., & Fogt, J. (2002). Class-wide curricular modification to improve the behavior of students with emotional behavioral disorders. Behavioral Disorders, 27, 317-326.

Kim, D. J., Hazlett-Knudsen, R., Culver-Godfrey, H., Rucks, G., Cunningham, T., Portee, D., ... & Behal, A. (2011). How autonomy impacts performance and satisfaction: Results from a study with spinal cord injured subjects using an assistive robot. IEEE Transactions on Systems, Man, and Cybernetics-Part A: Systems and Humans, 42(1), 2-14.

Kim, S., Chen, R. P., & Zhang, K. (2016). Anthropomorphized helpers undermine autonomy and enjoyment in computer games. Journal of Consumer Research, 43(2), 282-302.

Kim, T., & Hinds, P. (2006, September). Who should I blame? Effects of autonomy and transparency on attributions in human-robot interaction. In ROMAN 2006-The 15th IEEE International Symposium on Robot and Human Interactive Communication (pp. 80-85). IEEE.

Latif, S., Rana, R., Khalifa, S., Jurdak, R., Epps, J., & Schuller, B. W. (2019). Multi-Task Semi-Supervised Adversarial Autoencoding for Speech Emotion Recognition. arXiv preprint arXiv:1907.06078.

Lisman, J. E., & Idiart, M. A. (1995). Storage of 7+/-2 short-term memories in oscillatory subcycles. Science, 267(5203), 1512-1515.

Longoni, C., Bonezzi, A., & Morewedge, C. K. (2019). Resistance to medical artificial intelligence. Journal of Consumer Research, 46(4), 629-650.

Myrow, D. L. (1979). Learner choice and task engagement. The Journal of Experimental Education, 47(3), 200-207.

Nakamura, S., Phung, L., & Reinders, H. (2020). The effect of learner choice on L2 task engagement. Studies in Second Language Acquisition, 1-14.

Niemiec, C. P., & Ryan, R. M. (2009). Autonomy, competence, and relatedness in the classroom: Applying self-determination theory to educational practice. Theory and research in Education, 7(2), 133-144.

Nye, B. D., Graesser, A. C., & Hu, X. (2014). AutoTutor and family: A review of 17 years of natural language tutoring. International Journal of Artificial Intelligence in Education, 24(4), 427-469.

?nkal, D., Goodwin, P., Thomson, M., G?nül, S., & Pollock, A. (2009). The relative influence of advice from human experts and statistical methods on forecast adjustments. Journal of Behavioral Decision Making, 22(4), 390-409.

Pintrich, P. R. (2000). The role of goal orientation in self-regulated learning. In Handbook of self-regulation (pp. 451-502). Academic Press.

Ritter, S., Anderson, J. R., Koedinger, K. R., & Corbett, A. (2007). Cognitive Tutor: Applied research in mathematics education. Psychonomic bulletin & review, 14(2), 249-255.

Schermerhorn, P., & Scheutz, M. (2009). Dynamic robot autonomy: Investigating the effects of robot decision-making in a human-robot team task. In Proceedings of the 2009 international conference on multimodal interfaces (pp. 63-70).

Schroeder, N. L., & Adesope, O. O. (2014). A systematic review of pedagogical agents persona, motivation, and cognitive load implications for learners. Journal of Research on Technology in Education, 46(3), 229-251.

Self, J. A. (1990). Theoretical foundations of intelligent tutoring systems. Journal of Artificial Intelligence in Education, 1(4), 3-14.

Shah, A. K., & Oppenheimer, D. M. (2008). Heuristics made easy: An effort-reduction framework. Psychological bulletin, 134(2), 207.

Sheridan, T. B., & Verplank, W. L. (1978). Human and computer control of undersea teleoperators. Massachusetts Inst of Tech Cambridge Man-Machine Systems Lab.

VanLehn, (2011). The relative effectiveness of human tutoring, intelligent tutoring systems, and other tutoring systems. Educational Psychologist, 46(4), 197-221.

VanLehn, K., Lynch, C., Schulze, K., Shapiro, J. A., Shelby, R., Taylor, L., Treacy, D., Weinstein, A., &Wintersgill, M. (2005). The. Andes physics tutoring system: Lessons learned, International Journal of Artificial Intelligence in Education, 15(3), 1-47.

Wong, J., Baars, M., Davis, D., Van Der Zee, T., Houben, G. J., & Paas, F. (2019). Supporting self-regulated learning in online learning environments and MOOCs: A systematic review. International Journal of Human-Computer Interaction, 35(4-5), 356-373.

Zach, S., & Yanovich, E. (2015). Autonomy, Choice, and Pupils Motivation—Are They Really Related?. Advances in Physical Education, 5(02), 84.

Zimmerman, B. J. (1989). Models of self-regulated learning and academic achievement. In Self-regulated learning and academic achievement (pp. 1-25). New York: Springer.

Zimmerman, B. J., Bandura, A., & Martinez-Pons, M. (1992). Self-motivation for academic attainment: The role of self-efficacy beliefs and personal goal setting. American educational research journal, 29(3), 663-676.

Zimmerman, B. J., & Pons, M. M. (1986). Development of a structured interview for assessing student use of self-regulated learning strategies. American educational research journal, 23(4), 614-628.

收稿日期:2020-11-06

定稿日期:2020-12-10

作者簡介:乐惠骁,博士研究生;贾积有,博士,教授,博士生导师。北京大学教育学院教育技术系(100871)。

责任编辑 郝 丹