夜间复杂场景下红外图像行人检测算法研究

2021-07-06陈树越王巧月

赵 双,陈树越,王巧月

夜间复杂场景下红外图像行人检测算法研究

赵 双,陈树越,王巧月

(常州大学 信息科学与工程学院,江苏 常州 213164)

针对夜间红外图像中行人与背景灰度差异小且存在遮挡等问题,提出了一种夜间复杂场景下的红外行人检测算法。首先利用行人语义融合方法生成对目标全覆盖的显著图,与原图融合得到感兴趣区域,然后构造基于改进的方向梯度直方图特征的两分支分类器,同时提出一种遮挡判别算法,根据分类器模糊分数判断是否遮挡,设计一种头部模板实现最终的行人检测。在LSI远红外行人数据集和自主采集的冬、夏季节夜间行人数据上进行实验,结果表明:在不同环境下,所提出的方法均可快速鲁棒地检测出行人,可较显著地降低漏检率,检测率可达到94.20%。

红外图像;行人检测;显著性;复杂情况;方向梯度直方图特征

0 引言

行人检测是计算机视觉领域极具挑战性的问题,广泛应用在公共安全、智能监控、自动驾驶等领域中[1-2]。与传统的基于可见光的行人检测任务相比,远红外图像不受光照的影响,可以检测物体的热分布,从而在夜间对物体进行空间显示。热成像受温度值影响大,环境温度升高会带来灰度值反转问题,当行人与环境相接时,轮廓边缘无法保持完整,导致感兴趣区域提取失败进而无法检出行人、路灯、车辆向阳面等灰度值高的目标易产生误检[3]。与此同时,还要应对行人个体和姿态、视角及尺度的差异问题,复杂的背景使行人极易出现遮挡情况导致误判,现阶段的研究多关注完整体态的行人检测,而忽略了遮挡的情况。

传统的行人检测常采用分割及连通域分析,模板匹配等方法,Dalal[4]在2005年提出梯度方向直方图特征(histogram of gradient,HOG),率先使用梯度描述行人,利用滑动窗口遍历图像,得到了很高的检测率,但计算资源消耗大。随后描述纹理的局部二值模式(local binary patterns, LBP)特征、描述线状、形状、边缘的Haar-like特征,Shapelet特征和Edgelet特征等接连被提出并应用到行人检测中。很多学者对HOG特征做出了改进,比如将金字塔思想应用于尺度缩放的PHOG特征[5],结合边缘信息的HEOG特征[6],或者以HOG特征为基础进行特征融合,如HOG-LBP[7],HOGI特征[8]等。

常见的感兴趣区域(region of interest, ROI)提取方法是通过阈值分割,这种方法受图像对比度影响大,效果较差,基于视觉显著性进行ROI提取可以最大程度模拟司机的人眼注视,将有限的计算资源分配给容易引起观察者注意的区域,达到辅助驾驶的目的。显著性检测分为两类:自下而上基于数据驱动的显著性区域凸显,和自上而下任务驱动的目标凸显。

Koch[9]引入了显著图(saliency map)的概念来表示复杂场景的突出位置,他使用“赢者全取”(winner-take-all)的神经网络来选择图像中最显著的位置,在此基础上,许多由视觉注意机制启发的显著性模型被提出,如应用广泛的FT模型[10],SR模型[11]等。

与相关研究相比,本文更关注在黑暗复杂环境下探测行人,考虑了遮挡、尺度不一等情况,利用行人先验语义进行ROI提取,构造改进的HOG二分支分类器进行行人检测,同时利用遮挡判别算法,设计头部检测算子对被遮挡行人进行二次识别,实验证明本文方法检测效果良好,克服了行人的多变性,背景的复杂性。

1 红外行人候选区域提取

1.1 系统检测框架

文中提出的检测方法由3个模块组成,包括ROI提取、基于HOG特征的二分支分类和遮挡特征重识别,整体流程图如图1所示。

1.2 光谱残差(SR, spectrum residual)模型

ROI是图像中最吸引视觉的显著关键信息,提取ROI代替原始图像,可以减少大量无用的背景和噪声点的影响。本文在光谱残差模型的基础上融入红外行人的高层语义特征,得到更准确的感兴趣区域。Hou等人[11]认为不同的图像数据在对数尺度上有相似的分布趋势,因此在不同的log谱中只需要关注差异性部分就可以得到显著性区域。首先对输入图像()进行二维离散傅里叶变换,将其从空间域转化到频率域,光谱残差()定义为:

式中:A(f)为实部;hn(f)为局部平均滤波器。

利用式(2)对谱残差()和相位()进行二维离散傅里叶逆变换得到全局特征显著图(),所得的显著性图与人眼感知具有一致性。

1.3 行人高层语义特征融合

在利用SR分析得到显著性图的基础上,本文提出了针对性的红外行人的高层语义特征作为先验知识融合,相当于在进行显著性检测时增加了对图像的认知功能,提高分析准确度。行人的高层语义特征是指在待检测的图片中,一个区域或者一个像素点被行人目标包含的可能性的大小,求解这个可能性作为依托来求图像的目标性,可以获得图像中所有行人目标的大概分布情况,对图像的显著性检测有语义上的指导。

首先对输入的图像进行块分割,本文选择Alexe[12]的方法对原始图像进行分割,然后对每个分割得到的窗口进行评分,量化每个窗口包含行人目标的可能性。在红外图像中,行人的亮度普遍高于周边环境,头部区域亮度最高,低频信号强,边缘纹理比内部纹理明显,所以本文以亮度对比度和边缘信息作为先验语义,融入显著性检测中。

1)行人亮度对比度(brightness contrast, BC)。亮度特征是红外图像最重要的特征之一,如果一个包围框完整包含行人部分,则得到较高的分数,如果窗口只包含部分目标时分数降低。如图2(a)所示,实线框代表目标窗口,在计算的亮度对比度时,先将沿4个方向延伸一定尺度得到一个矩形外环,如图2中虚线框所示,用外环框减去目标框,得到所对应的背景区域,此时有:

计算窗口和背景的亮度直方图的卡方距离来定义窗口的亮度对比度:

式中:BC(,)表示亮度对比度特征值;2(·)表示卡方距离;(·)表示窗口的亮度直方图。

2)边缘线密度(edge density, ED)。相比可见光图像,红外图像(如图2(b)所示)考虑的是物体的温度信息,对杂乱的背景抑制效果良好,当温度差距较大时,行人边缘线明显,当温差小时,效果不显著。行人边缘线密度指的是窗口边界附近的边缘密度,通常情况下目标边界边缘的数量随着目标边界周长增大而增大,如图2(c)所示。首先将得到的目标窗口沿4个方向向内收缩个尺度,得到:

式中:(,)是的矩形内环。则ED计算公式如下:

实验发现Canny算子的边缘线检测效果最佳,IED()Î{0,1}是利用Canny算子进行边线检测后得到的二值化图像,Len(·)表示矩形内环的周长。

对图像的每一个窗口都从这两个角度进行打分,按式(7)计算图像中每个像素点的目标性:

在实验过程中,窗口划分总个数W的选值决定了“行人”区域的标定时间和准确性,如果W值太小,得到的目标性区域结果存在较大偏差,如果W值太大,则显著性检测的计算时间过长。

2 快速行人特征提取与分类

2.1 基于改进的HOG特征的二分支构造

HOG特征可以很好地表征图像梯度的方向分布,具体计算步骤如下:

1)输入大小为64×128的检测窗口,每64个像素作为一个细胞单元,每4个细胞单元作为一个区块,步长设置为8个像素,水平方向得到7个扫描窗口,垂直方向得到15个扫描窗口,如图3(a)所示。定义每个细胞的组距为2p/9,统计落在9个不同方向区间内的梯度大小,如图3(b)所示。利用式(8)、(9)计算每个像素的梯度幅值(,)和方向(,):

式中:(,)是图像在点(,)处的像素值,Dalal[4]验证了利用最简单的一阶梯度算子[1, 0, -1]进行水平和垂直方向的梯度计算效果最佳。

图2 目标性计算示意图

图3 HOG特征计算过程

2)利用SVM分类器构建超平面进行分类,对于给定的{x,y},=1,…,,yÎ{1,-1},分类器通过寻找最优的超平面T+=0实现行人的分类识别。

传统的HOG特征提取所需的计算量非常大,分辨率为64×128的检测窗口需要计算105个块的梯度直方图特征,得到3780维特征向量,同时多尺度缩放会导致相邻检测窗口间存在大量的重复计算区域,针对此种情况,本文提出了一种改进的HOG特征并构造了基于ROI高度的二分支分类结构(TBHOG, two-branches HOG),具体步骤如下:

①将得到的感兴趣区域扩充至扫描步长的整数倍,用邻域像素的灰度平均值作为扩充像素的灰度值;

②根据ROI的高度进行分类,定义为最小外接矩形垂直方向上的像素数,统计所有得到的ROI区域,平均高度为69.1pixel,所以本文选择69像素作为分水岭,高度小于69像素作为近景目标,高度大于69像素作为远景目标,分别训练SVM分类器,具体参数如表1所示。

③将得到的感兴趣区域分别缩放至不同的窗口大小,输入离线训练的SVM分类器进行判别。

表1 两分支的SVM分类器训练参数

2.2 遮挡处理

上述行人检测方法的出发点是将行人作为一个完整的整体设计,在LSI远红外(FIR)数据集的实验发现,对比传统的HOG方法,该方法的准确率有所提升,但是对本文自行拍摄的数据集来说,效果不够理想,因为拍摄的视频包含更多的遮挡情况,例如行人被树木等背景遮挡或行人互相遮挡。

研究发现,如果行人发生遮挡,块的HOG特征通过SVM分类器得到负的内积,每个窗口的线性SVM得分是HOG特征与向量的内积,向量是学习到的所有支持向量的加权和[13]。本文选择利用整体分类器对得到的特征向量进行评价,如果整体分类器得到的置信度属于一个模糊范围,则判断是否发生遮挡情况[14],如果确定发生遮挡,则利用设计的头部模板进行行人头部的检测,对是否包含行人进行确认。具体步骤如下:

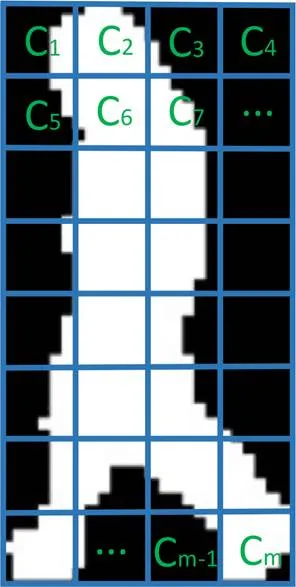

1)将待测窗口按图4分块,C是每个块得到的特征值,维数为36,HOG特征计算过程中得到55个块,定义窗口特征描述子=(1,2,…,55)T,通过训练好的Linear SVM分类器,根据式(10)计算返回值():

()=+T·(10)

图4 检测窗口分块

理论上()值越高,说明窗口中有行人的可能性越高,反之亦然,如果分类器的响应接近于0,就认为分类是模糊的。本文定义模糊区间为(-1.5, 0.5),认为可能存在遮挡。

2)对于每个C,Î{1,2,…,55},定义一个局部分类器()=+T·C,其中是支持向量展开后所对应的向量,均为36维,为每个块的检测误差。

3)通过对局部响应()进行阈值化得到离散的标签t,t=1表示是C行人的一部分,t=-1表示C是被遮挡或是背景的一部分,得到一个二值映射(1,2,…,55)。

5)无论行人是否遮挡或出现不同的朝向、姿势,行人的头部轮廓变化基本可以保持不变,头肩部呈现出类似于“W”的形状[15],如图5所示,我们设计了16×16的头部模板进行分类识别,使用离线SVM分类器训练。

图5 头部检测模型

3 系统设计与结果评估

3.1 数据集选择

实验运行环境为Intel(R) Core(TM) i3-4170 CPU,平台为MATLAB R2018b和Python OpenCV库,实验使用3个数据集:LSI远红外行人数据集(https://e-archivo.uc3m.es/handle/10016/17370)和利用FLIR E40热像仪采集的冬季(Test-W)、夏季(Test-S)道路/行人(Test-L)视频,基本信息如表2所示。

表2 测试数据的基本信息

LSI数据集来自在室外城市场景中驾驶的车辆,包含用于训练的53598张红外图像和用于测试的27994张图像。自主数据采集速率为31帧/s,分辨率为320×240像素。数据采集的时间均为晚上22:00左右,涵盖了温度变化、遮挡、尺度变化等一系列夜间行人检测常见的问题,示例如图6。每隔3帧标注一次,保证了实验的真实有效性。

3.2 评价标准

红外图像中行人的检测本质上是一个二分类问题,检测率(accuracy,ACC)是最常见的指标,即:

其中参数混淆矩阵如表3所示。

定义正确的检测需符合条件:

即预测的边界框BBROI和真实边界框BBGT之间的重叠率a0必须超过60%,否则就认为是错误的检测结果(虚警)。

表3 参数混淆矩阵

其中,TP(true positive)表示指检测器正确预测的行人窗口,FP(false positive)指将非行人预测为行人窗口的数目,TN(true negative)指检测器正确分类的非行人窗口,FN(false negative)指行人窗口发生漏检的数目。

考虑行人检测问题的实时性,本文将每张图片的平均检测时间也作为评价标准,即:

式中:是检测耗费时间;是图片张数。

3.3 参数选择

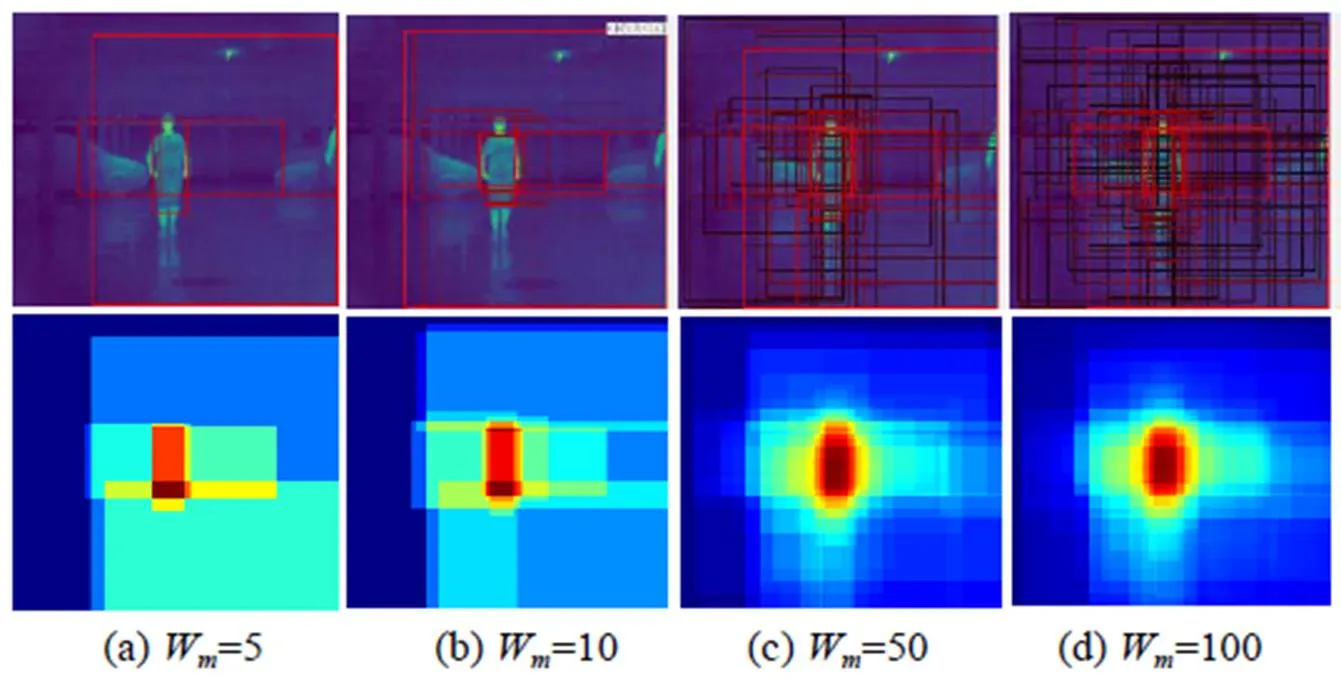

随机选取500幅LSI远红外数据集的测试图片,手动标记行人区域,统计不同目标性检测窗口数W下的行人区域数,目标性检测示意图如图7所示。

随着W的增大,检测结果如表4所示。

图7 目标性检测

表4 Wm标记结果

从表4可以看出,随着W的增大,显著性检测框与真实标注框的重合度也在上升,W=150时标记率可以达到97%,随后增速放缓但检测时间持续增加,所以本文选择目标性窗口数为150。

3.3.1 与基本算法的检测效果对比

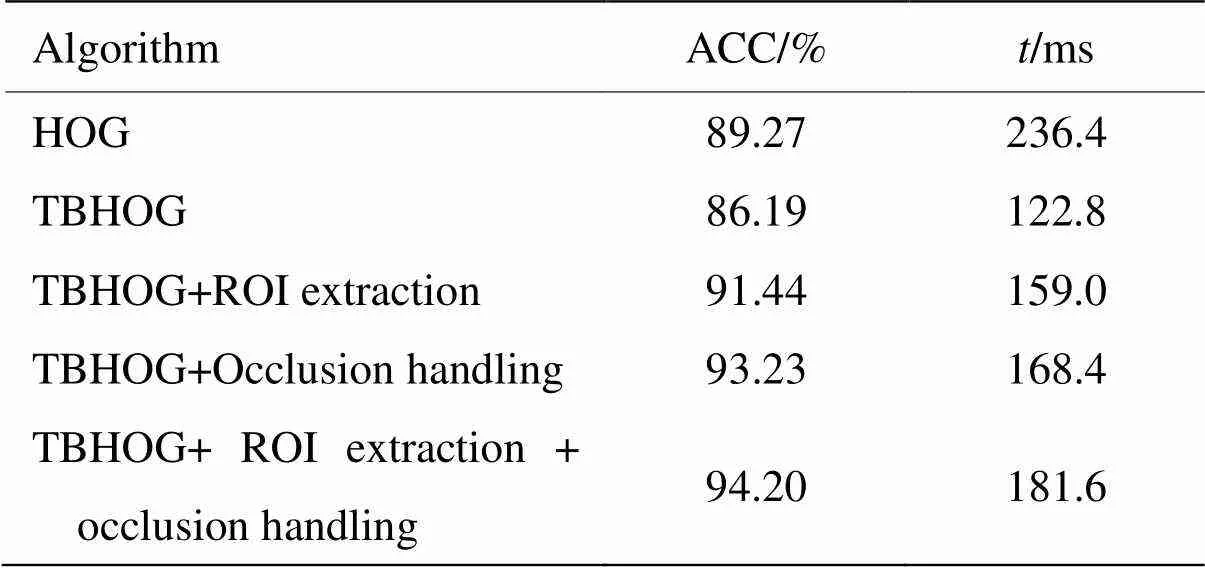

为了验证本文算法的有效性,本文在LSI远红外数据集上进行了如下对比实验,以经典的HOG特征作为基准,分别测试了二分支分类结构(TBHOG)、是否提取感兴趣区域、是否采用遮挡处理算法,检测结果如表5所示。

检测结果表明与HOG特征相比,本文方法准确率提高了5.5%,检测时间缩短了23.3%,可见本文方法对夜间行人识别有更好的实用性。准确率的提高主要来自于ROI提取和遮挡检测算法,而二分支分类结构显著降低了检测时间。

3.3.2 与其他算法的检测效果对比

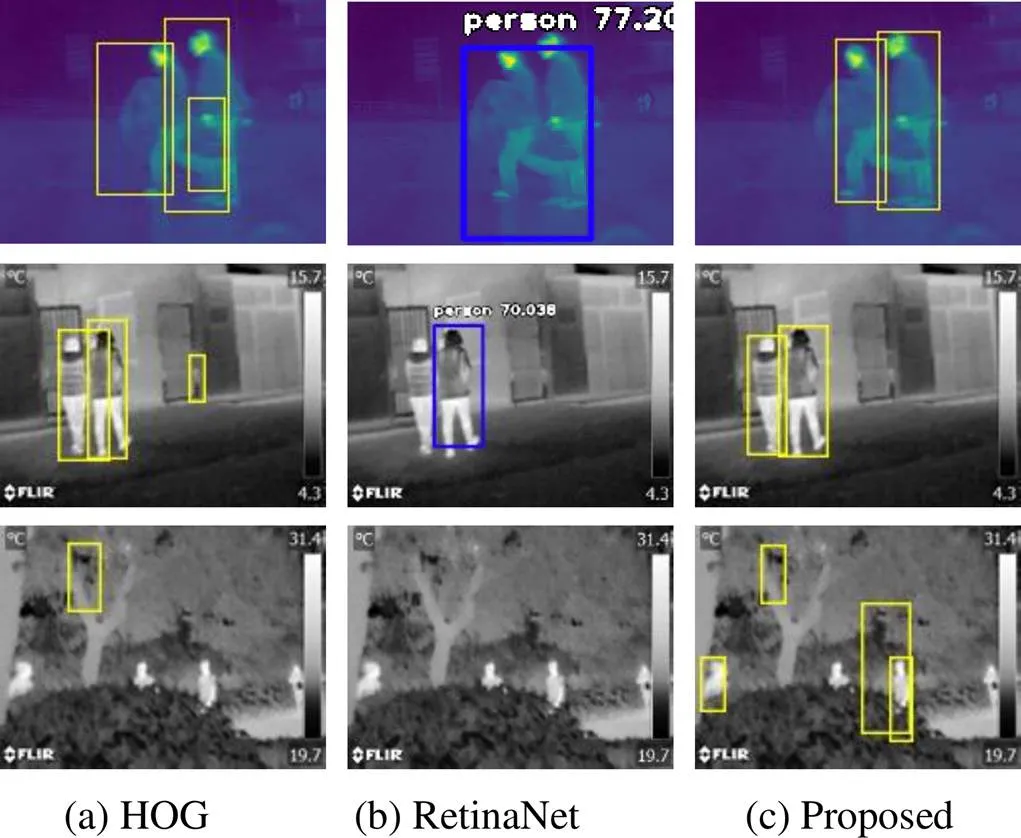

在所有数据集上将本文的检测方法与当前主流的红外行人检测方法对比:HOG+SVM方法,LBP+SVM方法及融合方法,聚合通道(aggregate channel features,ACF)方法[16],基于深度学习的RetinaNet算法[17],该算法由Python的image AI库集成,是一个开源的目标检测项目。对比示意如图8所示,检测结果如表6所示。

表5 与基本算法检测结果对比

传统的特征提取采用滑动窗口法并利用尺度缩放策略进行检测,计算量大且准确率取决于特征设计的合理性[18],由表6可以得到以下结论:

1)采用本文提出的算法,平均检测率比使用单一HOG特征提高了11.1%,比使用融合特征如HOG-LBP和ACF均有所提高,说明了方法的有效性与针对性。

2)本文所提算法平均检测速度相对于基于HOG的行人检测算法提升了27.6%,说明了采用ROI提取及两分支分类器结构的方法,相较于传统尺度缩放策略能够极大地加快检测速度,虽然仍不能满足实时性的要求,但相比检测率较高的ACF和深度方法,检测时间大幅缩短。

图8 不同算法检测效果对比

3)本文方法在LSI远红外数据集上检测率比次好的算法提高了0.15个百分点,在Test-W数据集上比次好的算法提高了3.6个百分点,在Test-S数据集上提高了5.4个百分点,可能是因为实际道路背景复杂,对行人检测不是很友好,行人的位置和姿态与开源数据库差异大,本文提出的遮挡检测算法在复杂情况下有效地降低了漏检。

表6 与其他算法检测效果对比

4 结论

针对夜间行人检测背景复杂,遮挡严重的情况,本文在SR模型的基础上改进了ROI提取方法,对得到的ROI构建基于改进的HOG特征的二分支分类器结构,并提出一种遮挡处理算法,性能评价表明,与标准方法相比,本方法在检测精度和速度上均得到很大提升,为夜间复杂情况下的行人检测提供了一种新的可能性。但算法仍无法满足实时检测的要求,且在行人较多的时候效果有限,下一步计划采用特征性更强的描述子,并结合深度学习理论,尝试解决行人的尺度不一、粘连等问题,进一步提高复杂情况下行人的检测率。

[1] XU Z, ZHUANG J, LIU Q, et al. Nighttime FIR pedestrian detection benchmark dataset for ADAS[C]//, 2018: 323-333.

[2] TAO Y, FU D, SHU P. Pedestrian tracking for infrared image sequence based on trajectory manifold of spatio-temporal slice[J]., 2017, 76: 11021-11035.

[3] 刘洋. 基于LS-DYNA的汽车正面碰撞计算机模拟仿真[D]. 西安: 西华大学, 2011.

LIU Yang. Simulation on the Front Impact of Vehicle Based on LS-DYNA[D]. Xi’an: Xihua University, 2011.

[4] Dalal N, Triggs B. Histograms of Oriented Gradients for Human Detection[C]// 2005(CVPR'05), 2005, 1(1): 886-893.

[5] Bosch A, Zisserman A, Munoz X. Representing shape with a spatial pyramid kernel[C]//, 2007: 401-408(doi: https://doi.org/10.1145/1282280.1282340).

[6] Sangeetha D, Deepa P. A low-cost and high-performance architecture for robust human detection using histogram of edge oriented gradients[J]., 2017, 53: 106-119.

[7] ZHENG C H, PEI W J, YAN Q, et al. Pedestrian detection based on gradient and texture feature integration[J]., 2017, 228: 71-78.

[8] 朱聪聪, 项志宇. 基于梯度方向和强度直方图的红外行人检测[J]. 计算机工程, 2014, 40(12): 195-198, 204.

ZHU Congcong, XIANG Zhiyu. Infrared pedestrian detection based on histograms of oriented gradients and intensity[J]., 2014, 40(12): 195-198, 204.

[9] Itti L, Koch E. A model of saliency-based visual attention for rapid scene analysis[J].., 1998, 20(11): 1254-1259

[10] Radhakrishna A, Sheila H, Francisco E, et al. Frequency-tuned salient region detection[C]//2009, 2009: (doi: 10.1109/CVPR.2009.5206596).

[11] HOU X D, ZHANG L Q. Saliency detection: aspectral residual approach[C]//2007, 2007:(doi:10.1109/CVPR.2007.383267).

[12] Alexe B, Deselaers T, Ferrari V. Measuring the objectness of image windows[J]., 2012, 34(11):2189-2202.

[13] WANG X, HAN T X, YAN S. An HOG-LBP human detector with partial occlusion handling[C]//12, 2010:(doi: 10.1109/ICCV.2009.5459207).

[14] Javier M N, Vazquez D, Lopez A M, et al. Occlusion handling via random subspace classifiers for human detection[J].Cybernetics, 2013,44(3): V342-354.

[15] Broggi A, Bertozzi M, Fascioli A, et al. Shape-based pedestrian detection[C]//, 2000: (doi: 10.1109/IVS.2000.898344).

[16] Brehar R,Vancea C, Nedevschi S. Pedestrian detection in infrared images using aggregated channel features[C]//, 2014: (doi: 10.1109/ICCP.2014.p6936964).

[17] LIN T Y, Goyal P, Girshick R, et al. Focal loss for dense object detection[J]., 2017, 99:2999-3007.

[18] 车凯, 向郑涛, 陈宇峰, 等. 基于改进Fast R-CNN的红外图像行人检测研究[J]. 红外技术, 2018, 40(6): 578-584.

CHE Kai, XIANG Zhengtao, CHEN Yufeng, et al. Research on infrared image pedestrian detection based on improved fast R-CNN[J]., 2018, 40(6): 578-584.

Infrared Pedestrian Detection in Complex Night Scenes

ZHAO Shuang,CHENShuyue,WANGQiaoyue

(,,213164,)

An infrared pedestrian detection algorithm is proposed to solve the problem of small differencesbetween pedestrians and backgroundsin gray scale images and the occurrence of occlusion in infrared images at night.First, a significant graph with the full coverage of the target is generated by the pedestrian semantic fusion method, and the region of interest is obtained by combining it with the original graph. Then,a two-branch classifier based on the improved histogram of the gradient feature is constructed. The fuzzy score of the classifier is used to determine the occurrence of occlusion and call the head template for the final detection. Experiments based on the LSI far infrared pedestrian dataset and independent datasets of pedestrians captured at night in winter and summer prove that the proposed method is robust and quick in detecting pedestrians under different environments. It can significantly reduce the rate of missed detection and realize adetection rate of94.20%.

infrared image, pedestrian detection, saliency, complex censes, HOG feature

TP391

A

1001-8891(2021)06-0575-08

2019-07-02;

2019-11-25.

赵双(1995-),女,硕士,主要研究方向:模式识别(行人检测)。E-mail:zhsss1030@163.com。

陈树越(1963-),男,教授,主要研究方向:计算机视觉、图像处理。E-mail:csyue2000@163.com。

江苏省研究生科研创新基金项目(KYCX19_1770)。