果园环境中成熟杨梅自动检测方法研究*

2021-07-01雷欢吴亮生焦泽昱陈再励马敬奇钟震宇

雷欢 吴亮生,2 焦泽昱 陈再励 马敬奇 钟震宇

特约论文

果园环境中成熟杨梅自动检测方法研究*

雷欢1吴亮生1,2焦泽昱1陈再励1马敬奇1钟震宇1

(1.广东省科学院智能制造研究所 广东省现代控制技术重点实验室,广东 广州 510070 2.仲恺农业工程学院,广东 广州 510070)

针对果园环境中自动摘果机视觉系统受光照、遮挡等影响,导致成熟杨梅检测准确率低的问题,提出一种基于机器视觉的成熟杨梅自动检测方法。首先,利用RGB摄像头采集果园环境中的杨梅图像,并采用基于YUV颜色空间Y分量的限制对比度自适应直方图均衡化算法对采集图像进行处理,以补偿光照对成像质量的影响;然后,采用“G-R”,“2R-G-B”色差法分别提取背景和前景区域,并通过形态学、区域生长等操作,建立基于OneCut算法的前景、背景区域标记控制点集,从而自动分割成熟杨梅区域;最后,针对重叠杨梅区域采用标记控制的分水岭变换方法与凸壳理论进行果实分离,实现每颗果实区域的准确定位。通过试验验证:该方法能准确检测果园环境中成熟的杨梅果实,平均准确率为93.5%,平均召回率为90.6%,具有一定的实用价值。

果园环境;成熟杨梅检测;限制对比度自适应直方图均衡化算法;OneCut;分水岭变换

0 引言

杨梅成熟期较短,且果实成熟后极易腐烂与落果,及时采摘是降低落果损失、提升果品的必然手段。随着计算机和自动控制技术的快速发展,采用自动机械采摘方式可有效节约成本、提高采摘效率与果实品质、提升果农收入。而对成熟杨梅进行准确检测,是实现杨梅自动采摘的前提。

目前,基于机器视觉的自动摘果机已逐步应用于农业生产[1],然而因果园环境中光照强度变化、果实成簇、枝叶遮挡等因素影响,自动摘果机视觉系统存在果实检测准确率低的问题,制约了其在杨梅果园的实际应用。自动摘果机的研究主要是针对果实的颜色、形状、纹理等单个或多个生物特征的组合[2-4]。从图像处理的角度分析,果实的生物特征会因自然光照的变化引起光斑和阴影,导致果实、叶子和背景颜色发生变化,从而增加果实检测的错误率。针对自然光照的影响,WANG C等提出一种改进的小波变换和基于Retinex的图像增强算法,突出在各种光照条件下的图像,并使用K-均值聚类分割果实区域[3];XU L等利用全局同态滤波对光照分布不均匀的图像进行图像增强,取得一定的识别效果[4];赵德安等提出一种改进的夜间R-G色差分割方法,分割潜在的苹果目标区域,准确率达83.7%[5];Si Y等利用色差和色差比的方法识别苹果目标区域,再结合随机圆环法和匹配算法定位苹果[6];WANG Q等在晚上使用人造光源建立图像采集系统,从而在均匀光线下,精准识别红色苹果。近几年基于深度学习的果实检测方法也逐渐流行,如XIONG J等提出一种基于深度学习的树上青芒果检测方法,可较准确检测自然环境下的芒果果实[8]。虽然基于深度学习的方法能获得较好性能,但其训练所需的各种条件环境下的样本量较大,而实际应用中难以采集,且算法的训练和推理很大程度依赖于高配置硬件设备。

近十年,专家学者对如何准确识别水果进行了大量研究,然而针对自然光照条件下果园环境中成熟杨梅果实分割与检测的研究少之又少。本文针对成熟杨梅的检测,提出一种基于机器视觉的果园环境中成熟杨梅的自动检测方法。在自然光照条件下,首先,对杨梅图像进行局部自适应图像增强;然后,采用色差法提取前景和背景区域,并利用形态学、区域生长等操作生成用于分割的标记控制点;最后,结合OneCut算法和分水岭变换方法,提取每颗成熟杨梅果实区域,实现果园环境中成熟杨梅的准确检测。

1 成熟杨梅检测流程

果园环境中成熟杨梅的检测流程如图1所示。

图1 成熟杨梅检测方法流程图

果园环境中成熟杨梅的检测流程主要包括4部分:1)局部自适应图像增强,基于YUV颜色空间Y分量,采用限制对比度自适应直方图均衡化(contrast limited adaptive histogram equalization, CLAHE)算法对杨梅图像进行局部自适应图像增强,以补偿自然场景下光照影响;2)成熟杨梅区域估计,通过RGB颜色空间通道色差法提取图像前景和背景区域,实现成熟杨梅区域初步提取;3)成熟杨梅区域分割,利用形态学和区域生长法对前景和背景区域进行标记,采用标记控制的OneCut算法对杨梅图像进行处理,实现成熟杨梅区域分割;4)单颗杨梅果实分离,采用分水岭变换方法对重叠果实进行分离,并利用凸壳运算对果实缺失区域进行估计,实现杨梅检测。

2 杨梅图像光照补偿

在果园环境中采集数据时,杨梅图像质量会受光照不均、拍摄角度等条件影响。在处理光照分布不均匀的图像时,传统直方图均衡化算法可能使图像部分区域“过度曝光”,而CLAHE算法在补偿光照影响的同时改善局部过度曝光问题。该算法将图像分割为大小相同的多个子块,对每个子块进行直方图均衡化,即设置裁剪像素,并将超出设定像素范围的灰度值均匀分配到各像素点,从而改善图像灰度值分配不均的情况,提高图像清晰度。本文为了不改变图像色彩信息而改善图像亮度,仅提取YUV颜色空间的Y分量用于图像增强,具体算法过程如下:

1)将采集的RGB图像转换为YUV颜色空间图像,提取YUV图像中代表亮度的Y通道;

2)将Y通道图像划分为大小相同的若干子块,并对分割好的每个子块进行直方图裁剪,计算该子块的像素平均值,如式(1)所示;

3)对比度受限值计算公式为

5)利用式(4)找出裁剪过后超出设定像素范围的像素值,并重新分配;

6)将子块进行直方图均衡化,并利用线性差值算法解决子块间产生的影响;

3 成熟杨梅分割与定位

果园中采集的杨梅图像一般包含几种遮挡的自然场景,如树叶、树枝、树干、草地、天空等。虽然可利用单个颜色分量或各个颜色分量的特征关系进行图像分割而得到不同目标,但杨梅果实面积偏小且生长位置众多,导致图像背景中也存在形态各异的杨梅,采用简单的颜色分割无法在不改变前景区域杨梅形态的同时去除背景的“杨梅噪点”。TANG M提出的OneCut算法基于图论分割方法[9],具有反映全局图像属性的能力[10],通过使用一次图切割即可获得硬分割结果。OneCut算法采用快速全局最优二元分割技术,明确最小化目标和背景颜色分布之间的表观重叠。提供一个包围感兴趣目标的矩形包围盒,矩形包围盒外面的像素使用硬性约束分配为背景。采用一次图切割最小化公式(式(5))表达的能量函数,实现目标分割。

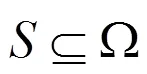

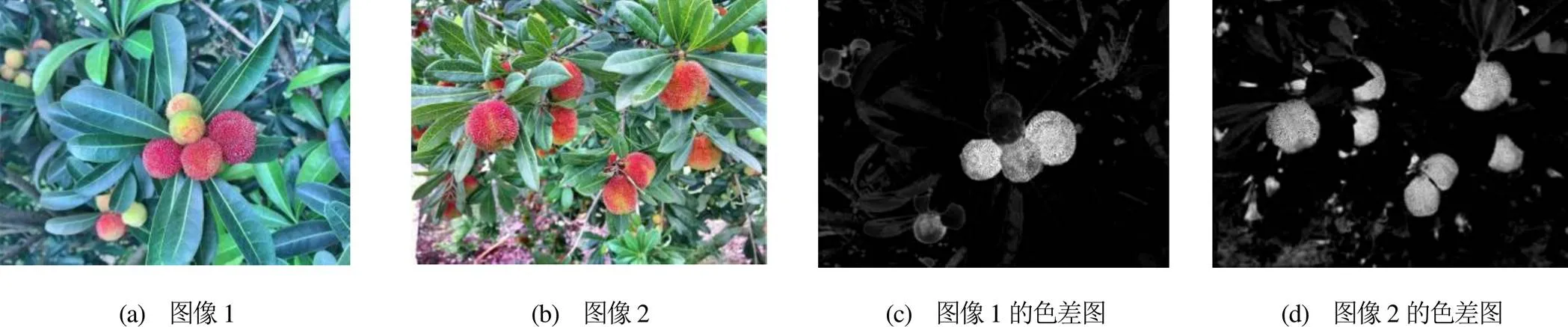

图2 杨梅果实的色差分割图

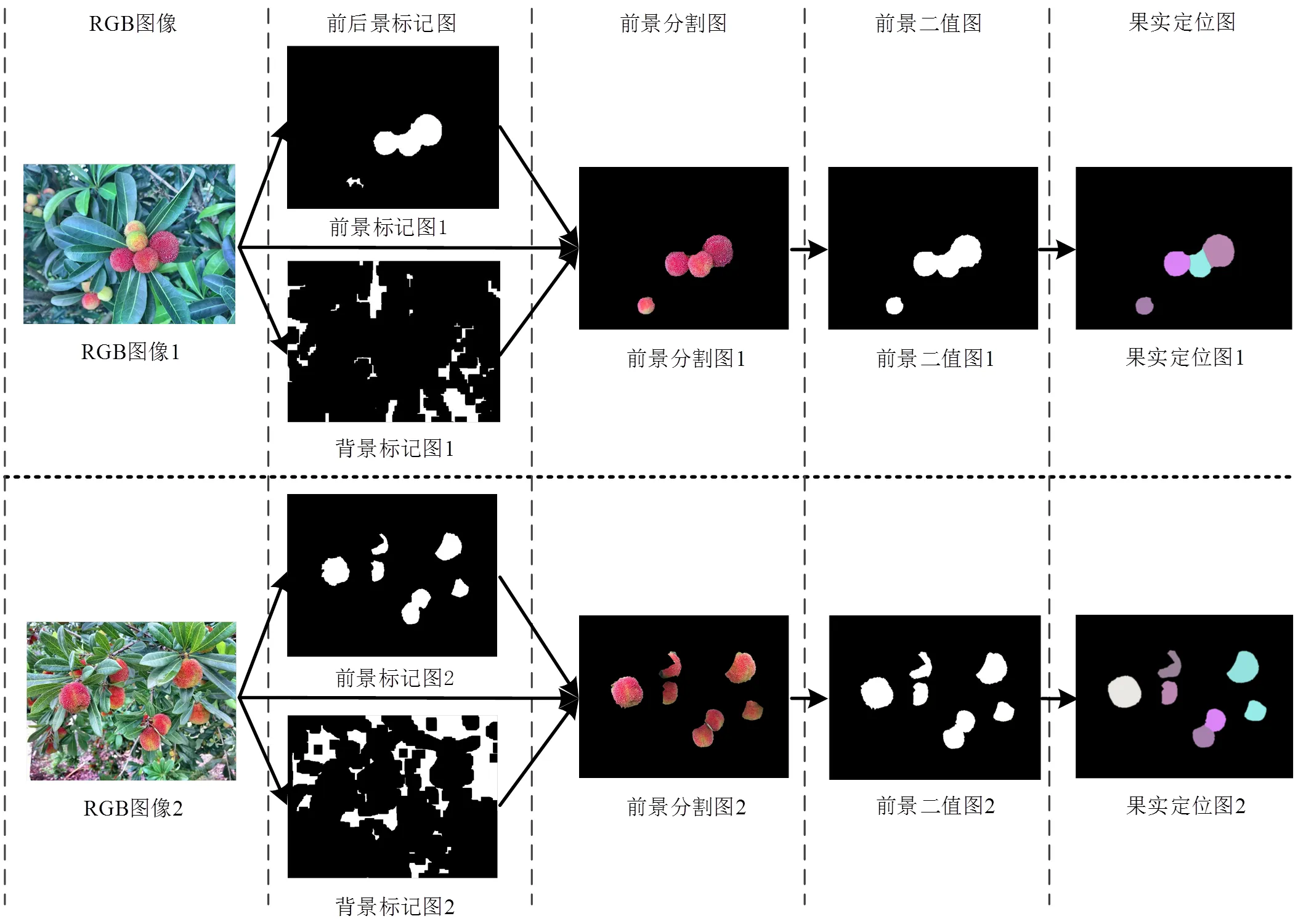

图3 杨梅前景区域分割与定位示意图

杨梅因聚集生长,导致图像中的杨梅有重叠或遮挡情况发生。分水岭变换是基于拓扑理论的数学形态学的分割方法,对微弱边缘具有良好的响应。但传统分水岭算法对图像中的噪声、物体表面细微的灰度变化,会产生过度分割现象。本文采用标记控制的分水岭变换[11]进行单颗杨梅果实分割,其中前景目标的标记控制点是从前景区域找到局部极大值而得。针对因遮挡不全的果实采用凸壳理论进行处理,最终实现每颗成熟杨梅位置的精准检测。

4 实验及结果分析

在2018年5月杨梅成熟期,用手机拍摄广州从化某天然杨梅果园图像作为实验图像。果园中杨梅树均为规则种植,在不同天气时距离杨梅果实15 cm ~ 35 cm处采集图像,图像分辨率为3264×2448,包括遮挡和光照不均等情况的成熟及非成熟杨梅图像。实验在Windows10操作系统 Visual Studio Code环境下,基于python-opencv 和numpy开源库,采用python语言编程完成。实验平台硬件配置:Intel(R) Core(TM) i7-9750H;16.0 GB内存;Nvidia Geforce GTX 1660 Ti。

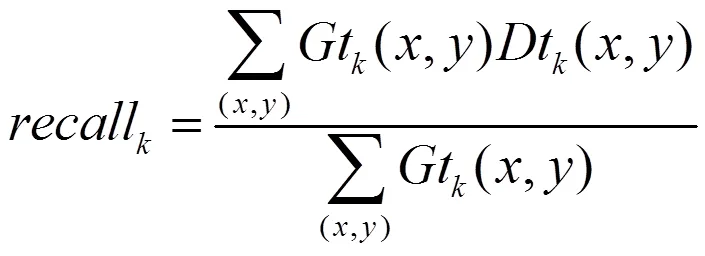

为验证本文方法的有效性,对成熟杨梅果实检测质量进行定量客观评价,采用准确率(precision)和召回率(recall)和F-measure作为衡量算法优劣的评价指标[12],其计算公式为

由于人工标记的成熟杨梅真值图像是根据杨梅在图中的实际呈现所标记,不会对遮挡成熟杨梅区域进行估计标记,因此本文方法的性能测试是以分水岭操作后、凸壳运算前的二值图像与人工标记的真值图像进行计算,以客观反映算法分割效果。为评估与对比成熟杨梅检测性能,将本文方法分别与基于直方图均衡化与色差图的OneCut分割方法(简称HCO)、基于CLAHE与色差图的分水岭分割方法(简称CCW)进行对比,其性能测试结果如表1所示。其中,果实序号分别为图2(a)、图2(b)中图像横坐标方向上成熟杨梅的排序号。

表1 实验方法的性能测试结果

由表1可以看出:相比于HCO,本文方法的平均准确率、平均召回率分别高出4.4%,2.8%,可知利用CLAHE进行光照补偿后,改善了杨梅果实区域图像质量,有利于后续成熟杨梅分割;相比于CCW,本文方法的平均准确率提升了约2%,且平均召回率高出15.3%,明显优于CCW;结合图3所示,可知利用基于标记控制点的OneCut算法进行自动分割处理后,能明显改善果实边界较模糊的成熟杨梅尤其是略带黄绿色的成熟杨梅区域的分割效果,提升成熟杨梅检测方法的适用性。

5 结语

为了自动水果采摘系统能够准确识别成熟杨梅,本文设计一种果园环境中基于机器视觉的成熟杨梅自动检测方法。首先,利用基于YUV颜色空间Y分量的CLAHE,增强原始图像对比度,减弱光照噪声对成熟杨梅图像质量的影响;其次,利用色差法分别得到前景和背景标记图,结合基于标记控制点的OneCut算法自动提取更精准的前景区域,有效避免背景中未成熟杨梅果实、枝叶遮挡等干扰;最后,通过试验验证该方法的有效性,可在果园环境中有效检测并分割出成熟杨梅,平均准确率达93.5%,平均召回率达90.6%,具有较强的鲁棒性和适用性,可用于成熟杨梅自动采摘检测,且对于其他果实分割与检测具有一定的借鉴意义。

[1] LINKER R, COHEN O, NAOR A. Determination of the number of green apples in RGB images recorded in orchards[J]. Computers and Electronics in Agriculture, 2011, 81: 45-57.

[2] WEI X, JIA K, LAN J, et al. Automatic method of fruit object extraction under complex agricultural background for vision system of fruit picking robot[J]. Optik-International Journal for Light and Electron Optics, 2014,125(19):5684-5689.

[3] WANG C, TANG Y, ZOU X, et al. A robust fruit image segmentation algorithm against varying illumination for vision system of fruit harvesting robot[J]. Optik-International Journal for Light and Electron Optics, 2017, 131: 626-631.

[4] XU L, LV J. Recognition method for apple fruit based on SUSAN and PCNN[J]. Multimedia Tools and Applications, 2018, 77(6):7205-7219.

[5] 赵德安,刘晓洋,陈玉,等.果树采摘机器人夜间识别方法[J].农业机械学报,2015,46(3):15-22.

[6] SI Y, LIU G, FENG J. Location of apples in trees using stereoscopic vision[J]. Computers and Electronics in Agriculture, 2015, 112:68-74.

[7] WANG Q, NUSKE S, BERGERMAN M, et al. Automated crop yield estimation for apple orchards[C]//Proceedings of International Symposium of Experimental Robotics. Springer International Publishing, 2013,88: 745-758.

[8] 熊俊涛,刘振,林睿,等.自然环境下树上绿色芒果的无人机视觉检测技术[J].农业机械学报,2018,4:45-52.

[9] TANG M, GORELICK L, VEKSLER O, et al. GrabCut in One Cut[C]//International Conference on Computer Vision, Sydney: IEEE, 2013:1769-1776.

[10] CAMILUS K S, GOVINDAN V K. A review on graph based segmentation[J]. International Journal of Image Graphics & Signal Processing, 2012, 4(5):1-13.

[11] JUNG C, KIM C. Segmenting clustered nuclei using h-minima transform-based marker extraction and contour parameterization[J]. IEEE Transactions on Biomedical Engineering, 2010, 57(10), 2600-2604.

[12] CHANG H H, ZHUANG A H, VALENTINO D J, et al. Performance measure characterization for evaluating neuroimage segmentation algorithms[J]. Neuroimage, 2009, 47(1):122-135.

Study on Automatic Detection Method of Mature Bayberry in Orchard Environment

Lei Huan1Wu Liangsheng1,2Jiao Zeyu1Chen Zaili1Ma Jingqi1Zhong Zhenyu1

(1.Guangdong Key Laboratory of Modern Control Technology, Institute of Intelligent Manufacturing, Guangdong Academy of Science, Guangzhou 510070, China 2.Zhongkai University of Agriculture and Engineering, Guangzhou 510225, China)

In view of the problem that the vision system of the automatic fruit picker in the natural environment of the orchard is affected by the light, occlusion and other factors, which leads to the low detection accuracy of mature bayberry, An automatic detection method of mature bayberry based on machine vision is proposed. First of all, RGB camera is used to collect bayberry image in orchard environment. The input image is processed by contrast limited adaptive histogram equalization (CLAHE) based on Y component of YUV color space to compensate the influence of light on image quality. Then, the "G-R" and "2R-G-B" color difference methods are used to extract the background region and foreground region respectively. Based on the operations of morphology and region growth, the set of control points of foreground and background regions is established, and the region of mature bayberry fruit in natural environment is segmented automatically by OneCut segmentation algorithm. Finally, the watershed transform method and convex hull theory are used to segment the overlapped fruit, so that each arbutus fruit area can be located accurately. The experiment results show that the method can accurately detect the mature bayberry fruit in orchard environment, with an average precision of 93.5% and an average recall rate of 90.6%, which has a certain practical value.

orchard natural environment; mature bayberry detection; CLAHE; OneCut; watershed transformation

广州市科技计划项目(202002020063);广东省级乡村振兴战略专项资金项目(2019KJ138)。

雷欢,男,1987年生,硕士,工程师,主要研究方向:机器视觉、人工智能。

吴亮生,男,1987年生,在读硕士,工程师,主要研究方向:机器视觉、人工智能。

焦泽昱,男,1991年生,博士,助理研究员,主要研究方向:机器视觉、人工智能。

陈再励,男,1989年生,博士,工程师,主要研究方向:安全工程、人工智能

马敬奇(通信作者),男,1988年生,硕士,工程师,主要研究方向:机器视觉、人工智能。E-mail: majingqiauto123@126.com

钟震宇,男,1971年生,博士,研究员,主要研究方向:运动控制与机器视觉。

S225

A

1674-2605(2021)03-0002-07

10.3969/j.issn.1674-2605.2021.03.002