基于改进Faster R-CNN的田间植株幼苗检测方法

2021-05-06陈旭君王承祥孙福张顺朱德泉廖娟

陈旭君 王承祥 孙福 张顺 朱德泉 廖娟

摘要:为了准确检测田间植株幼苗,以实现植株幼苗的精准喷药施肥,提出了一种基于改进FasterR-CNN的植株幼苗检测方法。以FasterR-CNN结构为基础设计植株幼苗检测网络,将ResNet50网络作为共享卷积层,并将Dropout层引入到FastR-CNN网络的全连接层之间,用月季苗图像对网络进行训练生成模型。结果表明,改进的FasterR-CNN模型对月季苗的检测准确度可达96.5%,召回率达到95.35%,而且对其他种类植株幼苗如玫瑰和番茄幼苗也具有良好的检测能力。改进的网络模型的泛化能力强,收敛速度快,有助于自动化植保机械的研发。

关键词:精准农业;植株幼苗检测;卷积神经网络;FasterR-CNN;过拟合

中图分类号:S126文献标志码:A

文章编号:1002-1302(2021)04-0159-05

作者简介:陈旭君(1999—),男,湖北大冶人,主要从事深度学习与自动化研究。E-mail:chenxujun173@163.com。

通信作者:廖娟(1986—),安徽安庆人,博士,讲师,主要从事图像分析和视觉导航研究。E-mail:liaojuan308@163.com。

随着精准农业的发展以及人们对于食品安全和环境污染问题越来越重视,精准农业成为植保领域的一个重要研究方向[1-2],自然环境下快速准确的植株幼苗识别对实现农药精准喷施具有重要意义。然而复杂的背景环境如光照变化[3]、天气[4]、杂草[5]等影响着植株幼苗的准确识别。

近年来,计算机视觉技术在自然环境下幼苗识别方面的研究和应用得到广泛开展[6]。García-Santillán等在分割植物与土壤背景后,利用Otsu自动阈值分割法区分麦苗和杂草[7]。Liao等基于秧苗颜色与背景颜色的差异性,构建光照不变超绿特征因子,采用自适应阈值分割出绿色秧苗[8]。但这些方式都是通过提取目标特定图像特征或结合传统分类算法来区分绿色作物和杂草,其特浅层征如颜色、纹理等通常是由人工选取标定,易受人为因素干扰,在性能提升和表征作物的特定信息方面具有局限性,从而对识别准确性产生不利影响。

相比传统方法,深度卷积网络能从大量数据中自动学习并提取特征,对图像具有极强的表征能力,广泛应用于农业领域[9-10]。张善文等构建了一种深度卷积网络模型,从彩色病害叶片图像中提取高层次的抽象特征,并在输出层进行黄瓜病害识别,正确识别率高于90.32%[11]。Dias等提出了一种基于深度卷积神经网络的苹果花识别方法,其召回率和精确率都在90%以上[12]。王振等采用卷积神经网络对黄瓜叶部病斑图像进行预训练得到网络模型训练的初步参数,然后将预训练结果输入到全卷积神经网络中进行模型二阶训练,经SVM分类器进行实现分割,平均像素分割准确率为80.46%[13]。Abdullahi等将深度卷积神经网络用于对玉米图像的检测和分类,其检测平均精度达到了99.58%[14]。

为了实现田间植株幼苗的准确检测,本研究以FasterR-CNN[15]为基础,提出一种改进FasterR-CNN的田间植株幼苗检测方法,利用卷积神经网络在目标检测方面的自学习能力和泛化能力,使网络可以精准检测月季幼苗,同时使网络对多种植株幼苗的检测具有普适性。

1材料与方法

1.1图像采集

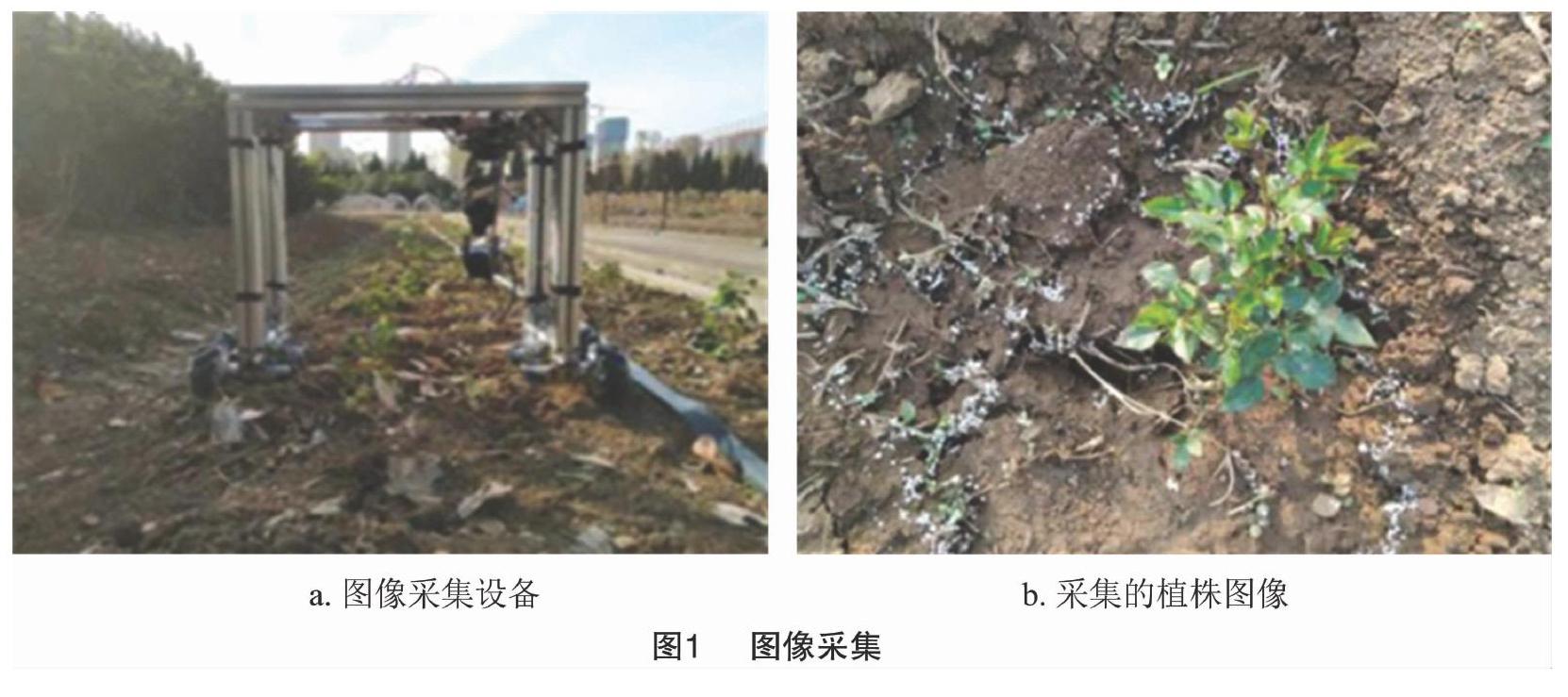

植株幼苗图像均采集于安徽农业大学农萃园内试验田,采集时间为2019年10月6—20日08:00—11:00、13:00—17:00,采集设备为图1-a所示的跨垄式智能小车,小车安装树莓派USB免驱摄像头,距离水平地面高度为30cm,由RaspberryPi3B+开发板进行控制,采集的图像如图1-b所示,图像分辨率为640×480像素,格式为JPEG。

1.2数据集构建

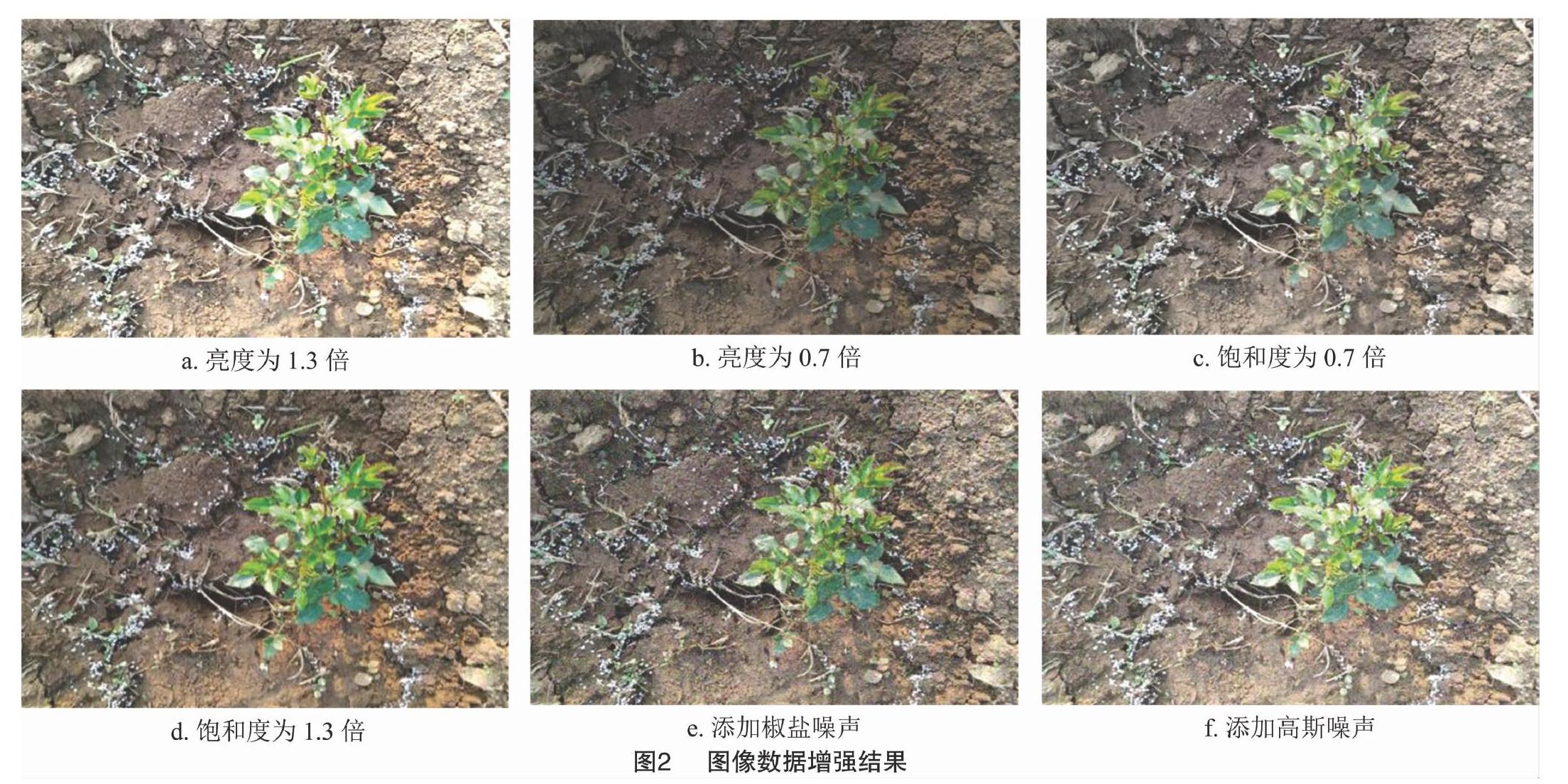

对不同的试验田采集月季苗图像共650张,测试集250张,训练集400张。由于户外场景的复杂性,须对数据集进行数据增强处理,以增加样本的多样性。以图1-b月季苗图像为例,进行6种数据增强操作如图2-a~f所示。其中,图像亮度和饱和度分别增强为原来的1.3倍和减弱为原来的0.7倍,添加噪声为0.05的椒盐噪声和均值为0.1、方差为0.01的高斯噪声,训练集图像经增强后共为2800张。

为加快神经网络收敛速度,首先将图像缩小为448×448像素,然后对训练集的月季苗目标进行人工标注。另外分别采用250株玫瑰苗、番茄苗、枸杞幼苗和凤仙花苗图像测试网络模型的泛化能力。

1.3FasterR-CNN的网络结构

1.3.1共享卷积层共享卷积层对输入的特征图进行初步的特征提取,将提取出的特征图用于RPN网络和FastR-CNN网络共享。FasterR-CNN网络常采用VGG16网络[16]作为共享卷积网络,将输入的原始特征图映射为一个512维的特征图,减少网络反向传播的训练参数。

1.3.2RPN网络RPN网络结构如图3所示,其输入为卷积特征图,以大小为w×h的低维特征图中每个像素为中心,生成k个3×3的锚框,则每张特征图共生成w×h×k个锚框,由后面连接的回归层和分类层对生成的锚框进行回归分析和分类处理。回归层选出可能包含目标的目标建议区域,分类层对每个目标建议区域进行得分判断,最后将生成的结果进行参数化设置,将得分高的目标建议区域输入到FastR-CNN的感兴趣区域池化层。

RPN網络采用端到端的训练方式,训练中网络通过反向传播计算每一层的损失函数值,根据损失函数值的大小不断更新网络权值。损失函数值越小,模型的鲁棒性越好,损失函数如式(1)所示。

1.3.3FastR-CNN模型RPN将生成的建议区域输入到FastR-CNN的ROI池化层,降低特征图分辨率,减少训练参数,加快神经网络的收敛速度。然后将参数输入2个全连接层,最后使用回归分析选定目标框,并使用Softmax分类器进行分类,输出预测目标框和目标框中可能是正确目标的概率。

1.4FasterR-CNN的改进

增加共享卷积层的深度可以提高网络的检测精度,但同时会造成信号在网络中的传播时间变长,信息的损耗和误差也会更多,因此,本研究采用ResNet网络[17]作为共享卷积网络。ResNet模型在浅层网络上添加恒等映射,由x经恒等变换传输到输出层,只用训练输入与输出的残差,避免了网络深度的增加造成退化问题。三层的残差学习单元结构如图4所示,x是残差输入,H(x)是输出,网络学习的残差函数为F(x)=H(x)-x,1×1和3×3的小卷积核比传统大卷积核减少了训练参数。

[FK(W12][TPCXJ4.tif;S+2mm][FK)]

常用的三层残差单元有ResNet50、ResNet101和ResNet152,为了选取合适共享卷积层,采用月季苗训练集训练上述3个网络模型,以网络的精确度、检测时间和训练时长作为评价指标,比较结果如表1所示。由表1可知,网络深度的增加能提高识别精度,但也会增加训练参数,降低收敛速度和检测速度。为增加网络深度,提高特征提取准确度,同时保证网络收敛速度,选择ResNet50网络作为RPN和FastR-CNN的共享卷积层。

训练深度卷积神经网络时,经常会出现过拟合现象,为了提高网络的泛化能力,在FasterR-CNN的全连接层中引入Dropout层,隐藏部分神经元。Dropout设置为0.5,同时将网络权值乘以0.5以保持输入数据和输出数据的稳定。改进的FasterR-CNN如图5所示。

2结果与分析

试验设备为台式计算机,CPU为Corei7-8700k,GPU为NvidiaRTX2070,内存32G,存储为500GB固态硬盘和1TB机械硬盘,设备操作系统为windows10(64位),编程软件为Matlab2019a。训练过程分为4步:先训练RPN网络,根据RPN输出的目标建议区域对FastR-CNN网络进行训练,再根据FastR-CNN的参数训练RPN网络,FastR-CNN根据参数更新后的RPN网络再次进行训练,最后将RPN网络和FastR-CNN网络进行统一。在每一步的训练过程中,设置学习回合数为15,并采用随机梯度下降算法优化网络,其中训练的第1步和第2步设置初始学习率为1×10-5,第3步和第4步的初始学习率设置为1×10-6。

为了验证本文FasterR-CNN对田间植株幼苗检测效果,以准确率(precision,P)和召回率(recall,R)作为模型性能评价指标,用来度量模型的优劣,P值和R值计算如下:

P=检测正确[]检测正确+检测误以为正确×100%;

R=检测正确[]检测正确+检测误以为错误×100%。

试验中采用基于VGG16和ResNet50作为共享卷积层的FasterR-CNN模型分别对月季花进行目标检测,表2所示为2种不同特征提取网络的FasterR-CNN检测结果的准确率和召回率。由表可知,基于ResNet50作为共享卷积层的FasterR-CNN模型在准确率和召回率2项指标上表现出优良性能,其对月季苗检测准确率达到96.50%,召回率达到95.35%,明显优于VGG16网络。另外,在相同的设备和参数设置下,以VGG16为基础网络的FasterR-CNN网络训练时间长达22h,而改进的FasterR-CNN模型训练时间缩短了4h。在检测速度上,基于VGG16网络的FasterR-CNN平均检测时间为0.312s/f,而残差结构不会增加训练参数,还能激发深层网络的收敛性能,其平均检测时间为0.281s/f,比VGG16网络检测速度快了0.031s/f。

另外使用改进的网络模型对与月季花具有较高相似度的植株幼苗包括玫瑰幼苗、番茄幼苗、枸杞幼苗和凤仙花苗进行检测,以验证网络的泛化能力,检测结果如图6所示。从图6可见,以月季苗为样本训练好的模型对其他植株幼苗也具有良好的检测效果。

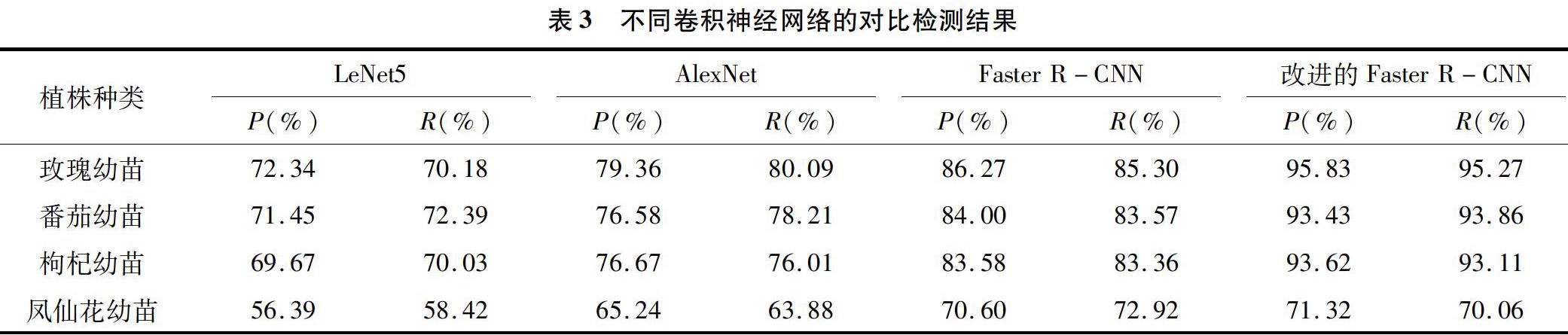

对于量化网络的泛化能力,表3给出了改进前后FasterR-CNN以及LeNet5和AlexNet网络对玫瑰幼苗、番茄幼苗、枸杞幼苗和凤仙花苗的检測准确率和召回率。可见,网络深度的增加会增强网络的泛化能力,提高对多种植株幼苗的识别精度,而增加了候选框的FasterR-CNN在检测精度上相比LeNet5和AlexNet网络有了很大的提升,改进的FasterR-CNN使用了更深度的ResNet50网络并引入了Dropout层,使网络的检测精度和泛化能力有更进一步的提升。网络对玫瑰幼苗、番茄幼苗、枸杞幼苗的检测精度随着网络深度的增加均有较大提高,而凤仙花苗的检测精度却提高较少,主要是因为训练集的月季花苗叶片较小,而凤仙花整体叶片较大,当网络深度增加时,训练网络模型对非小叶片植株的检测敏感度不足,导致检测精度没有较大提升。由表2和表3的数据可以证明,网络的改进提高了网络模型的泛化能力,加快了网络的收敛速度,对多种植株的检测具有普适性。

3结论

本研究提出了一种基于改进FasterR-CNN的植株幼苗检测方法,通过采用ResNet50网络作为共享卷积层提取特征,在FasterR-CNN模型中增加Dropout层,加快了网络的收敛速度,同时也增强了网络的泛化能力。经验证,改进的FasterR-CNN在针对月季苗、玫瑰苗、番茄幼苗和枸杞幼苗的识别上具有较高的识别精度,可以初步应用于植株幼苗的精准检测定位。本研究有助于推动自动化施肥机或者洒药机的研发,降低农药和化肥在农业生产中的使用量,保护环境和农产品安全。

本研究将可以进一步进行建模,设计算法寻找网络模型与网络泛化能力的关系,并不断改进网络结构,提高网络的泛化能力和收敛速度,通过较少数据集的训练,使网络模型对于一般的植株幼苗检测具有普适性。

参考文献:

[1]邓向武,齐龙,马旭,等.基于多特征融合和深度置信网络的稻田苗期杂草识别[J].农业工程学报,2018,34(14):165-172.

[2]赵常,耿爱军,张姬,等.水肥药精准管理技术研究现状与发展趋势[J].中国农机化学报,2018,39(11):28-33.

[3]孙俊,何小飞,谭文军,等.空洞卷积结合全局池化的卷积神经网络识别作物幼苗与杂草[J].农业工程学报,2018,34(11):159-165.

[4]BonadiesS,GadsdenSA.Anoverviewofautonomouscroprownavigationstrategiesforunmannedgroundvehicles[J].EngineeringinAgriculture,EnvironmentandFood,2019,12(1):24-31.

[5]张乐,金秀,傅雷扬,等.基于FasterR-CNN深度网络的油菜田间杂草识别方法[J].激光与光电子学进展,2020,57(2):297-305.

[6]杨斯,黄铝文,张馨.机器视觉在设施育苗作物生长监测中的研究与应用[J].江苏农业科学,2019,47(6):179-187.

[7]García-SantillánID,MontalvoM,GuerreroJM,etal.Automaticdetectionofcurvedandstraightcroprowsfromimagesinmaizefields[J].BiosystemsEngineering,2017,156:61-79.

[8]LiaoJ,WangY,YinJN,etal.SegmentationofriceseedlingsusingtheYCrCbcolorspaceandanimprovedOtsumethod[J].Agronomy,2018,8(11):1-16.

[9]KamilarisA,Prenafeta-BoldúFX.Deeplearninginagriculture:asurvey[J].ComputersandElectronicsinAgriculture,2018,147:70-90.

[10]甘騏榕,苏芳,练坤玉,等.改进LeNet-5模型在大米分选算法上的应用[J].安徽农业大学学报,2019,46(3):549-553.

[11]张善文,谢泽奇,张晴晴.卷积神经网络在黄瓜叶部病害识别中的应用[J].江苏农业学报,2018,34(1):56-61.

[12]DiasPA,TabbA,MedeirosH.Appleflowerdetectionusingdeepconvolutionalnetworks[J].ComputersinIndustry,2018,99:17-28.

[13]王振,张善文,王献锋.基于改进全卷积神经网络的黄瓜叶部病斑分割方法[J].江苏农业学报,2019,35(5):1054-1060.

[14]AbdullahiHS,SheriffRE,MahieddineF.Convolutionneuralnetworkinprecisionagricultureforplantimagerecognitionandclassification[C]//2017SeventhInternationalConferenceonInnovativeComputingTechnology(INTECH),2017:1-3.

[15]RenSQ,HeKM,GirshickR,etal.FasterR-CNN:towardsreal-timeobjectdetectionwithregionproposalnetworks[J].IEEETransactionsonPatternAnalysisandMachineIntelligence,2017,39(6):1137-1149.

[16]HammadI,El-SankaryK.ImpactofapproximatemultipliersonVGGdeeplearningnetwork[J].IEEEAccess,2018,6:60438-60444.

[17]HeKM,ZhangXY,RenSQ,etal.Deepresiduallearningforimagerecognition[C]//2016IEEEConferenceonComputerVisionandPatternRecognition(CVPR),2016:770-778.