基于机器人视觉的面部表情识别技术分析

2021-02-28刘业辉宋玉娥朱贺新

刘业辉 宋玉娥 朱贺新

摘 要:在信息技术应用逐渐成熟的背景条件下,机器人视觉方案开始走入各行各业。为使机器人视觉面部表情识别达到理想的识别效果,研究了采用机器人视觉方式进行处理,对人类面部表情进行精准识别,进而为相关功能实现提供支撑,如学校课堂管理、安防工作等。该文主要针对基于机器人视觉的面部表情识别技术进行深入研究,以供参考。

关键词:机器人视觉;面部表情;识别技术

中图分类号:TP391.4 文献标识码:A文章编号:2096-4706(2021)16-0102-03

Analysis of Facial Expression Recognition Technology Based on Robot Vision

LIU Yehui, SONG Yu’e, ZHU Hexin

(Beijing Polytechnic College, Beijing 100042, China)

Abstract: Under the background of the gradual maturity of information technology application, robot vision scheme begin to enter all walks of life. In order to achieve the ideal recognition effect of robot visual facial expression recognition, the robot visual processing method is studied to accurately recognize human facial expression, so as to provide the supports for the realization of relevant functions,, such as school classroom management, security work, etc. This paper mainly studies the facial expression recognition technology based on robot vision for reference.

Keywords: robot vision; facial expression; identification technology

0 引 言

智能化解决方案正在广泛应用,对面部表情进行识别的技术需求日益增多。为达到理想识别效果,需要合理采用机器人视觉面部表情识别技术,通过相关技术手段对人类表情进行深入分析,最终以高识别效率输出高质量结果。通过研究相关技术细节,可以为后续应用机器人视觉方案打下坚实基础,具有正面影响意义。

1 表情识别方法分类

在机器人视觉方案应用阶段,面部表情自动化识别属于常用类型之一,其主要针对人类面部状态进行采集,并对比数据库内部表情数据,获得特征加以分析。通过此类方式,可有效识别目标情绪倾向,有利于相关内容的联想、整合与分析,快速识别特征面部表情。常规情况下,完整识别系统需要包含人脸检测、定位跟踪、特征提取、表情识别四个模块[1]。

在针对人脸进行检测的过程中,需要首先通过图像采集模块获取数据信息,随后利用序列处理方法,检测目标人脸位置,并开展定位与跟踪活动如图1所示。

针对人脸进行检测与定位的措施主要分为两种,即知识措施与特征措施。知识措施需要对人脸存在的基础条件进行规则化处理,使后续能够利用知识数据库完成粗检测、精检测流程,实现定位目标人脸位置的目标。粗检测与精检测的主要区别与分辨率、帧率存在关联,因此需要根据环境条件与硬件条件的差异进行针对化处理。目前,主流应用方案采用灰度图像积分投影曲线处理方式进行操作,其能够根据局部区域极值数据,判断人脸器官所处位置,整体鲁棒性较高[2]。除此之外,基于特征的检测方法也具有理想应用价值,其在处理阶段需要借助人脸所具备的相关特征进行操作,如肤色情况、纹理状态、边缘位置等。但是,相对于知识检测方法,特征检测可能会受到其他条件干扰,因此应当避免在精细化要求较高的场合应用。为达到理想识别效果,应当针对面部表情信息进行分类处理。通常情况下,分类工作主要利用设计机制展开预先定义的类别处理。常用分类措施主要分为两种,即模板匹配、神经网络[3]。

2 人脸图形获取与预处理

对针对人脸图形进行获取并完成预处理操作时,需要首先补偿光照条件,避免信息出现亮度过低、模糊等影响识别的问题。通常情况下,人类面部肤色容易受到光源颜色、采集设备色差等问题影响,出现偏离实质色彩的情况。因此,需要利用参考白算法完成图像补偿措施,使光照条件产生的负面影响能够得到有效控制。

光照条件补偿纠正结束后,应当对图像信息进行中值滤波平滑处理。中值滤波属于非线性滤波类型,其能够有效排除噪声像素,为后续进一步识别提供重要基础。在实践阶段,应当对图像内部像素周边灰度差距较大的位置进行纠正,使其能够与周边像素实现平均化表现状态。

3 面部表情识别系统的实现与实验结果

3.1 面部表情识别系统设计

面部表情识别系統设计基本结构如图2所示。

在设计面部表情识别系统的过程中,需要首先准备系统应用设备并合理规划界面布局。本次应用实验平台为台式计算机设备,并结合USB摄像头装置完成视频图像采集。台式计算机配置为AMD RYZEN 5600X处理器,内存配置为16 GB,能够有效承载面部识别计算压力与数据存储需求。表情识别系统采用C++编写,并基于开源视觉库OPEN GL完成处理模块设计[4]。在界面规划阶段,中央显示窗口应当与摄像头连接,显示视频信息内容。窗口内采用红色矩形标记目标人脸位置,为调试跟踪模块提供基础条件。表情识别信息需要显示于红色矩形标记下方,并在界面右侧控制区域输出帧数状态与识别结果保存位置。面部表情识别处理如图3所示。

首先利用检测定位方式对视频图像帧进行检查、处理,随后将人脸区域从摄像头信息中分离(割)。若在单帧内成功检测到目标人脸,则启动人脸跟踪处理模块。

3.2 人脸检测定位及跟踪实验

人脸检测与定位属于机器人视觉识别方案的核心模块,通过从人类基本表情视频流内抽取相关图像进行对比,并采用双眼定位与视觉瞳孔拾取方法进行处理,能够有效明确定位方案应用效果。实验过程中,主要针对X与Y方向的双眼瞳孔定位进行分析,并明确误差情况。结果显示,瞳孔定位误差极限数据不超过4像素,具有应用可靠性。同时,对虹膜半径识别误差极限不超过5像素,单帧定位耗时仅523毫秒,实时性良好。

在跟踪实验开展阶段,主要应用中值滤波、开启闭合等像素操作方案,整体时间消耗较长。通过采用1 000帧人脸识别图像数据进行粗定位实时检测,对结果进行分析能够发现,针对单帧图像的定位耗时极限达到了72毫秒,实用性较低。为解决此类问题,应当采用粒子滤波跟踪应用算法,使人脸检测与识别装置能够得到有效补充,进一步强化实时性特征,跟踪计算时采用式(1)进行处理[5]。

yt=2yt-1-yt-2 (1)

本式中,y代表二维向量{r,c},r,c分别代表此粒子在目标图像内的行列坐标状态。yt代表第t次粒子滤波初始阶段所处位置,yt-1代表第t-l次确定的跟踪目标位置,yt-2代表第t-2次确定的跟踪目标位置。完成改造后再次进行相关识别测试发现,跟踪算法耗时仅为人脸粗定位算法耗时的二分之一。人脸区域检测定位与跟踪主要算法流程如图4所示。

3.3 面部表情识别实验

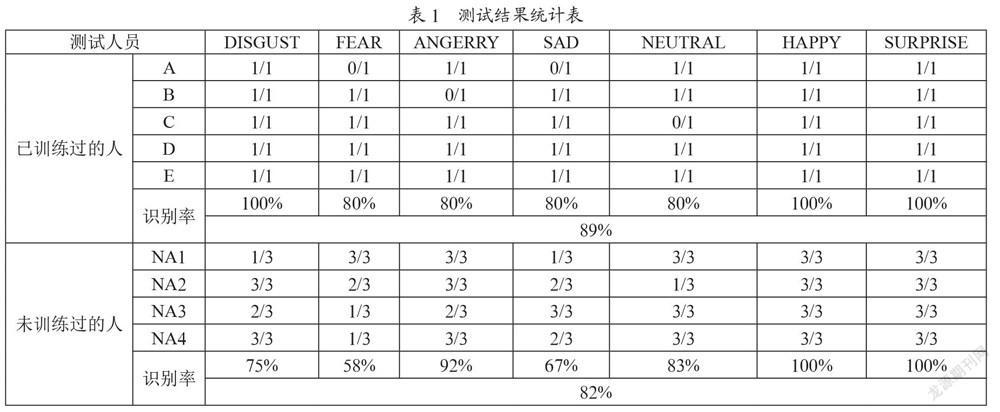

在针对面部表情进行识别时,为明确系统应用效果,需要展开相关测试实验。实验工作主要依靠训练分类表情数据进行处理,相关数据内容来源于5名随机人员在稳定环境条件下展现面部表情。通过对比相关实验数据能够发现,本次构建的表情识别系统能够对特定目标面部情况实现高效识别,与人工鉴定表情类型结果具有趋同性,可判定为准确度较高。同时,针对实验结果进行分析能够发现,本次应用系统对相关特征表情的识别率超过85%,平均可识别效果相对接近,均处于85%以上。针对特定表情进行识别时,由于面部特征明显,因此识别率会产生上升趋势,如开心、惊讶、愤怒等,识别率能够达到95%以上。此类面部表情特征与其他常见表情存在显著差异,在面部器官位置出现改变时,识别敏感区域相对位置与状态变化显著,如面部眉毛、眼睛、嘴部等。因此,针对相关表情的识别效果较为良好,能够在特定要求下进行应用。除此之外,针对厌烦、害怕、悲伤三种表情的识别效果相对较差,容易出现判断错误或结果混淆等情况。导致此类问题出现的主要原因与三种表情敏感区域变化不显著有关,同时此类负面表情共同特征较多,容易导致人脸识别系统出现误判断问题。因此,需要重视对负面表情识别的优化工作,确保不同类型面部特征能够得到有效区分,避免影响整体识别准确率与稳定性。

除常规识别实验外,还应当展开非特定人类表情识别实验工作。通过此类实验方式,能够明确本次设立的表情识别系统能否使用多种差异人群类型识别需求场景。通过选择四名非特定人选开展识别工作,并利用与常规面部识别系统完全一致的分类装置进行处理,能够在排除特定图像信息的情况下展开客观识别活动。四名非特定测试人员需要在稳定环境条件下展现多种面部表情,如厌烦、害怕、开心、悲伤等[6]。在表情分类装置内部不存在对应样本的情况下,整体工作稳定性大幅降低,但是整体分析表情识别效果与人工识别仍然存在显著趋同性,平均识别率达到了80%,可以认为非特定人类表情识别效果仍然较为理想,能够明确整体识别效果具有较为稳定的趋势。因此,本次识别系统具有显著实用性,能够在多种情况条件下进行应用。用训练过和为训练过的人分别做测试,初步结果如表1所示。

4 结 论

综上所述,在针对人类面部表情进行识别的过程中,机器人视觉解决方案具有良好应用效果。在落实系统处理架构时,需要重视相关技术应用细节,确保面部表情能够得到稳定识别,尽可能提高应用质量与效率,为后续多种场景应用打下坚实基础,进一步拓展计算机识别应用功能推广范围。

参考文献:

[1] 潘光良.机器人人脸表情识别技术研究 [J].智能机器人,2019(1):50-52.

[2] 李萧玮.基于智能服务机器人表情识别技术研究 [J].中国新通信,2018,20(23):76.

[3] 王锴.挑战条件下的人脸表情识别 [D].中国科学院大学(中国科学院深圳先进技术研究院),2020.

[4] 何志超,赵龙章,陈闯.用于人脸表情识别的多分辨率特征融合卷积神经网络 [J].激光与光电子学进展,2018,55(7):370-375.

[5] 姚丽莎,徐国明,赵凤.基于卷积神经网络局部特征融合的人脸表情识别 [J].激光与光电子學进展,2020,57(4):338-345.

[6] 崔凤焦.表情识别算法研究进展与性能比较 [J].计算机技术与发展,2018,28(2):145-149.

作者简介:刘业辉(1969.12—),男,汉族,四川省开县人,教授,硕士研究生,主要研究方向:电子通信、移动互联应用、人工智能应用;宋玉娥(1981.02—),女,汉族,山东省曹县人,副教授,信号处理学博士,主要研究方向:移动通信工程、信息安全与对抗、人工智能应用;朱贺新(1983.06—),女,汉族,河南省南阳人,副教授,通信与信息系统硕士,主要研究方向:移动通信工程、移动互联应用、人工智能应用。