区域自适应多尺度强光融合的红外图像增强

2020-12-14陈念年廖小华

巫 玲,陈念年,廖小华

区域自适应多尺度强光融合的红外图像增强

巫 玲,陈念年,廖小华

(西南科技大学 计算机科学与技术学院,四川 绵阳 621010)

图像增强可以分为全局增强和局部增强两种技术,当前基于局部的图像增强技术无法准确地对目标和背景进行分割且难以自适应地对分割区域进行增强。本文提出了一种区域自适应多尺度强光融合算法用于红外图像的增强处理。该算法首先使用语义分割技术完成目标区域和背景区域的划分,然后使用改进后的多尺度强光融合算法分别对各区域进行自适应增强。实验结果表明,所提算法的增强效果均优于当前主流算法,图像增强的视觉效果更真实。

红外图像;图像增强;强光融合;多尺度

0 引言

红外成像技术具备穿透性强、隐蔽性好、辨识性高等优点,红外图像在军事、监控、工业等领域取得广泛应用。与可见光成像技术相比,红外成像容易受到大气环境和成像设备的影响,这导致红外图像存在对比度低、细节大量丢失的问题,需要进行增强处理。

图像增强不仅是图像边缘检测与特征提取等技术的基础,还是提高图像视觉效果的主要手段。

目前,图像增强可以分为全局增强和局部增强两种技术。前者指的是不考虑像素在图像空间中的分布情况,对所有像素使用相同的映射关系进行灰度变换,主要有线性变换、非线性变换、直方图均衡化、Retinex理论、多曝光融合以及深度学习等方法。线性变换与非线性变换理论简单,变换函数的选取决定了图像增强的效果;直方图均衡化在增强图像的同时会减少图像的灰度级并带来新的噪声。Retinex理论认为原始图像等于光照图像和反射图像的乘积,从原始图像中剥离光照图像,剩下的反射图像就是图像增强的结果。单尺度Retinex[1]算法难以对光照图像进行准确的估计,多尺度Retinex算法[2]综合多种光照信息以提高图像的增强效果。文献[3]首先将观测图像分解成光照图像与反射图像,然后对光照图像进行拉普拉斯金字塔变换并进一步得到新的光照图像,最终通过融合光照图像和反射图像达到图像增强的目的。文献[4]利用深度学习技术设计了一种卷积神经网络用于图像增强,该网络可以自适应地将原始图像分解为光照图像和反射图像,通过采用大量成对的高、低质量图像作为训练样本而获得一个能够完成图像增强的映射模型,最终实现图像的增强处理。多曝光融合技术要求获取同一场景下不同曝光程度的多幅图像,根据图像的曝光程度和像素信息计算相机响应函数从而达到图像增强的目的。多曝光融合技术要求获取同一场景下不同曝光程度的多幅图像,文献[5-6]根据计算得到相机响应函数从而达到图像增强的目的。文献[7]首先利用一幅原始图像生成多幅不同曝光程度的图像,然后根据设计好的权值矩阵对原始图像和生成的曝光图像进行最终的合成。

为了避免全局增强方法容易导致局部过增强、颜色失真的现象,局部增强方法得到了重视与发展。文献[8]提出了深度双边网络用于图像的增强研究,虽然获得的网络模型是一个全局映射关系,但由于该网络充分考虑了原始图像的局部信息和全局信息,所以增强后的图像具有较好的细节表现。文献[9]将红外图像分割成目标区、过渡区和背景区3种区域,对各区域进行不同的灰度变换而完成了红外图像的增强处理。文献[10]利用视觉显著性区域检测将原始图像分解成目标分量和背景分量,通过分别对目标分量和背景分量进行处理而实现了图像增强。

综上,目前基于局部的图像增强方法研究较少,且无法准确地分割原始图像。强光融合[11]技术以平均灰度级为阈值将原始图像分解成明暗两个分量,并利用全局高频分量对明暗分量进行增强处理而得到增强后的图像。

强光融合技术采用平均灰度级分割图像且全局高频分量存在尺度性,本文在强光融合的基础上提出了一种区域自适应多尺度强光融合算法。所提算法首先准确地对目标和背景进行区域分割,然后从各区域中获取多种尺度的高频分量并利用各区域的平均像素对目标区域和背景区域进行明暗分解,最后通过加权融合目标区域和背景区域从而得到增强图像。

1 本文算法

全文算法模型如图1所示,首先利用语义分割技术将给定的红外图像分割成目标和背景两类图像,再对目标图像和背景图像分别进行自适应多尺度强光融合,最后将目标图像与背景图像融合而实现图像增强。

1.1 强光融合

强光融合是一种利用图像的高频成分进行图像增强的技术,在增强图像的同时能有效避免过增强现象的出现。强光融合算法主要分为3步:

Step 1:计算图像增强所需的模板:

=<0.5 (1)

Step 2:获取输入图像的高反差分量:

=-*+0.5 (2)

Step 3:对输入图像进行增强处理:

=1·+2·(1-) (3)

式中:为归一化至[0, 1]之间的单通道原始图像;表示增强后的图像;表示高斯算子,“*”表示卷积运算;为一个0-1矩阵;“·”表示点乘运算。1和2根据式(4)、式(5)计算:

1=2··(4)

2=1-2·(1-)·(1-) (5)

图1 区域自适应多尺度强光融合算法流程图

1.2 多尺度强光融合

虽然红外图像普遍存在对比度低、细节损失的问题,但拍摄场景、拍摄技术以及拍摄设备本身等差异性仍将决定红外图像质量各异。强光融合技术的关键在于从图像中提取合适的高频分量,若待增强的红外图像中只含有少量高频成分,则必须将式(2)使用的高斯滤波器的值设置较大才能确保得到足够有效的细节信息。本小节提出了多尺度强光融合算法以更有效地实现红外图像增强,算法分为4步:

Step 1:利用式(1)计算图像增强所需的模板;

Step 2:设计多个高斯滤波器(不同),获取给定红外图像的多级高频分量:

h=-*W+0.5 (6)

Step 3:针对各级高频分量对原始图像进行强光融合:

y=1(k)·+2(k)·(1-) (7)

Step4:将不同尺度的增强图像进行加权融合:

式中:表示尺度个数;W表示第个高斯算子;h和y分别表示W滤波得到的高频分量和对应的增强图像,1(k)和2(k)分别将和h代入式(4)、式(5)计算得到。

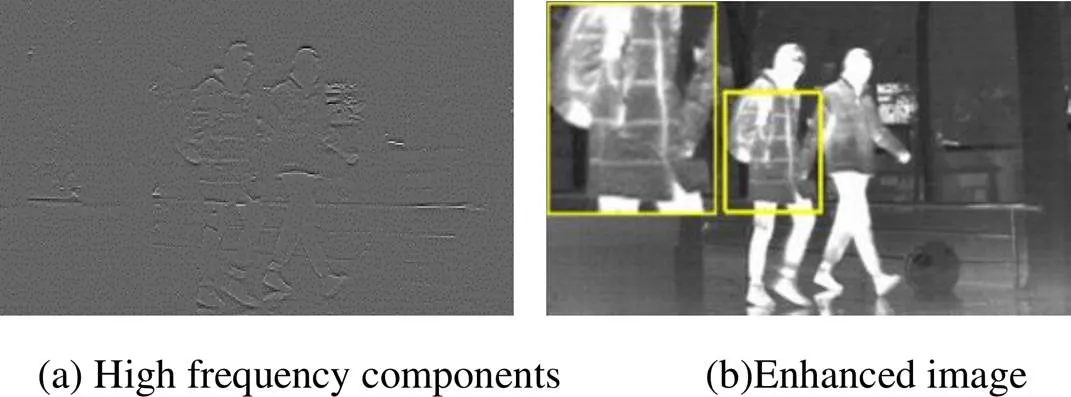

图2、图3展示了不同尺度下的高频分量及对应的增强图像。

图2 s=1对应的高频分量及增强图像

图3 s=5对应的高频分量及增强图像

1.3 区域自适应多尺度强光融合

被动式红外成像是一种根据物体自身辐射热量而成像的技术。在夜晚或室内等场景中,由于人体、机器等与环境温差较大,红外相机拍摄到的图像通常表现为目标明亮和背景暗淡的现象。强光融合算法在计算模板(式(2))时没有考虑到目标和背景的差异性,本小节提出区域自适应多尺度强光融合算法,该算法的核心部分在于根据目标区域和背景区域自适应地计算阈值。因此的计算方法如式(9)所示:

=<vg(9)

式中:表示目标区域或背景区域;vg是中像素的均值。

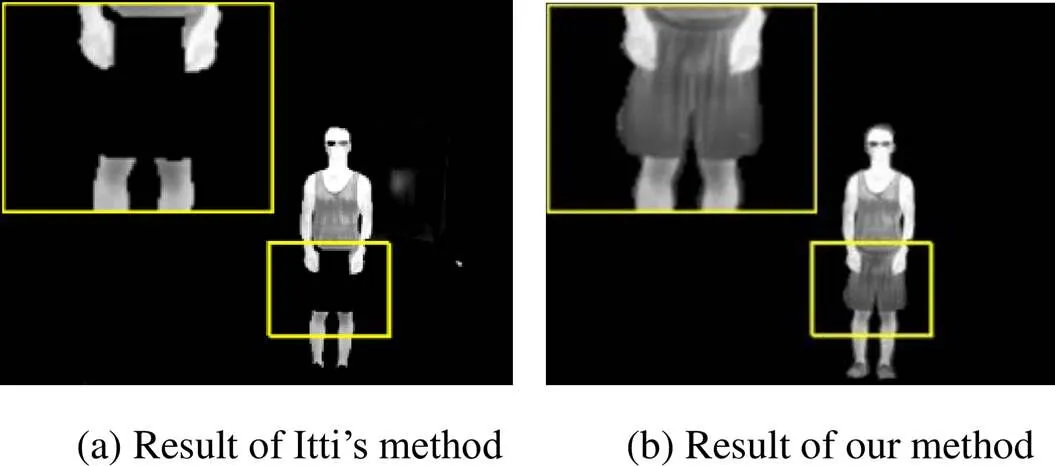

自适应融合的关键在于目标/背景分割的完整性,本文重新训练了语义分割网络(Unet[12])以对原始图像实现区域分割。图4对比展示了两种图像分割方法的分割效果,其中,(a)表示图像显著性检测(Itti[13])的结果,(b)表示图像语义分割的结果。

图4 两种不同图像分割方法的分割结果

2 实验与分析

本文实验中,Unet网络训练用到的软件硬件平台为:Linux操作系统Ubuntu16.04,Intel Xeon E5-1630 v3@3.7GHz四核处理器,16GB内存,Nvidia GTX 1080Ti 11GB显卡,实验程序在keras2.2.5框架下使用Python 2.7.15语言编写。部分对比实验的软硬件平台为:Windows 7旗舰版64位操作系统,Intel(R) Core(TM) i5-6500 CPU @ 3.20GHz,8GB内存,编程环境为Matlab 2015a.

2.1 实验数据及评价指标

文中主要使用实验室自主拍摄的红外图像展开研究,部分红外图像如图5所示。

为了全面地评价图像增强的效果,选择Brenner函数[14]和图像熵(Entropy)作为图像的客观评价指标。Brenner函数是一种梯度评价函数,定义如式(10)所示:

式中:(,)表示图像第(,)处的像素值;、分别表示图像的高和宽;值越大说明图像清晰度越好,质量越高。

图像信息熵反映图像信息的丰富程度,定义如式(11)所示:

式中:L表示图像的灰度级;pi表示第i个灰度级出现的概率;E值越大说明图像质量越高。

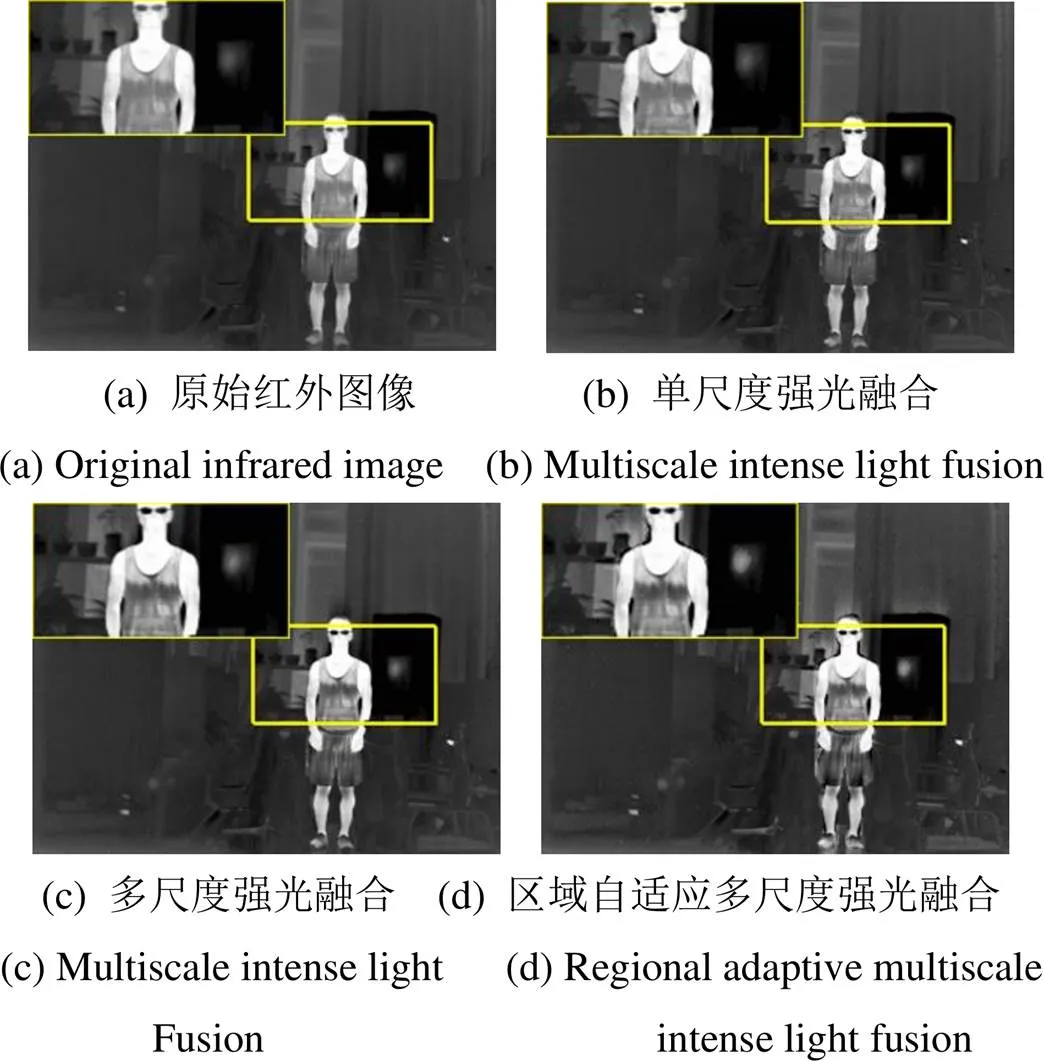

2.2 算法有效性验证

为了验证所提算法的多尺度和区域自适应阈值计算的有效性,对单尺度强光融合增强、多尺度强光融合增强以及区域自适应多尺度强光融合增强进行了对比实验,代表性结果如图6所示。单尺度时高斯滤波器=3,多尺度时=2、3、5、7、9、11、13。对比图6和表1,本文提出的算法能有效增强图像的目标区域与背景区域,其增强效果更真实,指标得分更高。

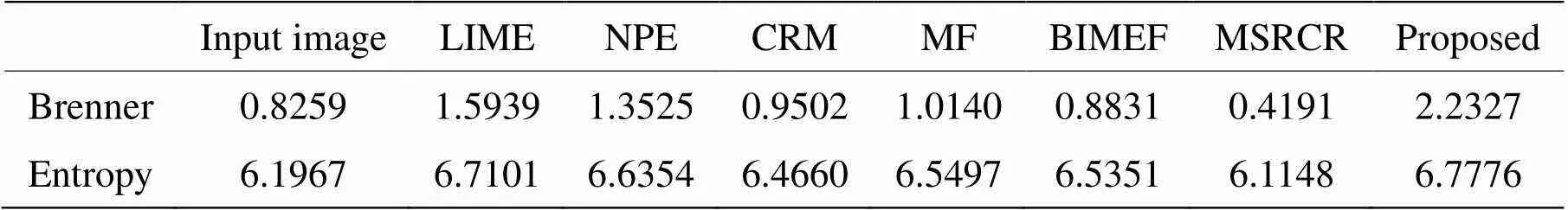

2.3 不同算法的实验对比

将文中所提算法与基于光照图估计的微光图像增强(Low-light image enhancement via Illumination Map Estimation,LIME)[15]、保持自然增强(Naturalness Preserved Enhancement,NPE)[16]、相机响应模型(Camera Response Model,CRM)[6]、多偏差融合(Multi-deviation Fusion method,MF)[3]、仿生多曝光融合(Bio-Inspired Multi-Exposure Fusion,BIMEF)[7]、带色彩恢复的多尺度Retinex算法(Multi-Scale Retinex with Color Restoration,MSRCR)[17]等主流算法进行比较,图7给出了不同算法的增强结果的对比,表2给出了对比指标数据。

由图7(g)和(h)可知,本文所提多尺度算法比MSRCR增强的图像直观感觉更真实、清晰度更高;BIMEF是一种多曝光融合算法,MF是将原始图像分解成光照分量和反射分量并对光照分量进行多尺度增强融合的算法,对比图7(e)和(f),BIMEF算法增强的图像更有层次感;对比图7(c)~(f),NPE、CRM和MF算法增强效果相近,NPE相对更佳;图7(a)显示,LIME算法出现全局过增强现象。

图6 算法有效性验证效果展示

表1 算法有效性验证的评价指标对比

从表2中可以看出,无论是Brenner评价函数还是信息熵,本文算法均最优。排名第2的LIME算法,直观看来具有全局过增强的不足。Brenner评价函数和信息熵对各算法的评价时,只有对CRM算法和BIMEF算法交换了顺序,其他算法排名均保持了一致。

图7 不同算法增强效果对比

表2 不同算法增强后的评价指标对比

3 结论

本文在现有强光融合算法的基础上提出一种区域自适应多尺度强光融合算法用于红外图像的增强研究,该算法充分考虑了原始图像的区域信息和多种尺度的高频特征。

本文方法与目前主流图像增强算法进行比较,结果表明,所提算法主观、客观上均能更真实地增强图像。

[1] Land E H, Mccann J J. Lightness and retinex theory[J]., 1971, 61(1):1-11.

[2] Jobson D J, Rahman Z, Woodell G A. A multiscale retinex for bridging the gap between color images and the human observation of scenes[J]., 1997, 6(7): 965-976.

[3] FU X, ZENG D, HUANG Y, et al. A Fusion-based Enhancing Method for Weakly Illuminated Images[J]., 2016, 12(129):82-96.

[4] CHEN W, WANG W, YANG W, et al. Deep Retinex Decomposition for Low-Light Enhancement[C]//(),2018: 61772043.

[5] Debevec P E, Malik J. Recovering high dynamic range radiance maps from photographs[C]//97, 1997: 369-378.

[6] YING Z, LI G, REN Y, et al. A New Low-Light Image Enhancement Algorithm using Camera Response Model[C]//()., 2017: 3015-3022.

[7] YING Z, LI G, GAO W. A Bio-Inspired Multi-Exposure Fusion Framework for Low-light Image Enhancement[J]., 2015, 14(8): 1-10.

[8] Gharbi M, Chen J, Barron J T, et al. Deep Bilateral Learning for Real-Time Image Enhancement[J]., 2017, 36(4): 118.

[9] 徐军, 梁昌洪, 张建奇. 一种红外图像增强的新方法[J]. 西安电子科技大学学报: 自然科学版, 2000, 27(5): 14-17.

XU J, LIANG C H, ZHANG J Q. A New Approach to IR Image Enhancement[J], 2000, 27(5): 14-17.

[10] 汪忱, 张宝辉, 王虹, 等. 基于视觉显著区域的红外图像增强算法研究[J]. 红外技术, 2017(9): 835-840.

WANG C, ZHANG B H, WANG H, etc. Research on Infrared Image Enhancement Algorithm based on Visual Saliency[J]., 2017(9): 835-840.

[11] 关文涛. 选择的艺术:Photoshop CS图层通道深度剖析[M]. 北京:人民邮电出版社, 2006: 459.

GUAN W T.[M]. BeiJing: People's Posts and Telecommunications Press, 2006: 459.

[12] Ronneberger O, Fischer P, Brox T. U-Net: Convolutional Networks for Biomedical Image Segmentation[C]//, 2015: 234-241.

[13] Itti L. A model of saliency-based visual attention for rapid scene analysis[J]., 1998, 20(11): 1254-1259.

[14] 王竑舒, 徐熙平. 广角相机图像的调焦评价函数研究[J].长春理工大学学报: 自然科学版, 2019(3): 38-41, 50.

WANG H S, XU X P. Study on Focusing Evaluation Function of Wide-angle Camera Image[J].: Natural Science Edition , 2019(3): 38-41, 50.

[15] GUO X, LI Y, LING H. LIME: Low-Light Image Enhancement via Illumination Map Estimation[J]., 2017, 26(2): 982-993.

[16] WANG S, ZHENG J, HU H M, et al. Naturalness Preserved Enhancement Algorithm for Non-Uniform Illumination Images[J]., 2013, 22(9): 3538-3548.

[17] Petro A B, Sbert C, Morel J M. Multiscale Retinex[J]., 2014(4): 71-88.

Infrared Image Enhancement Based on Regional Adaptive Multiscale Intense Light Fusion

WU Ling,CHEN Niannian,LIAO Xiaohua

(,621010,)

Image enhancement can be divided into two kinds: global enhancement and local enhancement. Current image enhancement techniques based on local enhancement cannot accurately segment the target area and background, and it is difficult to enhance the segmentation region adaptively. In this paper, a region-adaptive multi-scale strong light fusion algorithm is proposed for infrared image enhancement. Firstly, semantic segmentation technology is used to divide the target area and background area. Then, the improved multi-scale strong light fusion algorithm is used to enhance each area adaptively. The experimental results show that the enhancement effect of the proposed algorithm is better than that of the current conventional algorithms, and the visual effect of image enhancement is more realistic.

infrared images, image enhancement, intense light fusion, multi scale

TP39

A

1001-8891(2020)11-1072-06

2019-12-30;

2020-11-03.

巫玲(1982-)女,四川遂宁人,讲师,硕士,主要研究方向为光学测量、视觉检测。Email:wuling751@126. com。