基于数据降维的复杂属性大数据分类方法研究

2020-10-21胡淑新宋志蕙

胡淑新 宋志蕙

摘 要:针对数据的多维度、非线性、不稳定性等特有的复杂属性,在传统数据分类方法的基础上,本研究将高维大数据进行降维处理,结合SVM分类方法和多元SVM-REF分类方法,提出一种基于数据降维的复杂属性大数据分类方法。试验证明,与传统数据分类方法相比,本设计方法能够有效地提升复杂属性大数据的分类效率,也为后续对高维数据分类和数据复杂波动规律分析的深入研究提供依据。

关键词:数据降维;复杂属性;大数据;分类

中图分类号:TP391文献标识码:A文章编号:1003-5168(2020)02-0018-03

Abstract: Aiming at the unique complex attributes of data such as multi-dimensionality, non-linearity, and instability, based on the traditional data classification method, this research reduced the dimension of high-dimensional big dat, combined SVM classification method and multivariate SVM-REF classification method, and proposed a method for complex attribute big data classification based on data dimensionality reduction. Experiments show that compared with traditional data classification methods, this design method can effectively improve the classification efficiency of big data with complex attributes, and also provide a basis for subsequent in-depth research on high-dimensional data classification and analysis of data complex fluctuation rules.

Keywords:data reduction;complex attributes;big data;classification

近年来,信息技术和互联网不断发展,大数据分析技术逐渐成熟,而复杂属性的大数据分类充满机遇和挑战[1]。当前,科学研究水平不断进步,信息技术与互联网技术也在不同的领域中逐渐成熟,新兴技术的发展在带动行业本身进步的同时也扩大了软件和硬件技术的市场需求。因此,新的市场和模式不断要求数据挖掘迈向更高的水平。从数据的体量、类型及维度等方面来分析,研究的对象也变得越来越复杂[2]。随着互联网的不断普及,企业要从设计、制定、运营等不同环节为用户提供全方位的解决办法,而这些环节都或多或少地涉及数据的采集、整理与分析,企业为了保证自身优势,需要从多个角度兼顾信息处理的时效性、准确性及经济性。因此,人们对复杂属性的大数据分类研究提出了更加严格的要求。

1 高维大数据的降维处理

传统的特征抽取技术包括主成分分析和线性鉴别分析。但这些传统的特征抽取技术都存在着局限性。目前,一种新型的基于核的分析方法出现,并已经在模式识别领域和机器学习领域展现了其优秀的分类能力[3]。这种分析方法利用非线性转换技术,对数据间不同类别的可分离性进行增强,以获取更好的分类效果。与传统方法不同的是,该方法能够利用核技术将输入进来的样本映射到高维度的特征空间中,其间不需要对该样本的非线性映射函数有具体的掌握,因此减轻了传统的非线性映射方法的负担。但该方法的弊端在于,无法对大型数据进行分类处理。在对大数据进行分类时,时间和空间的复杂程度都明显提高,并且特征抽取的效率取决于训练样本的个数,个数越多,取样的效率会越低,因此该方法对于大数据分类的效率更低[4]。基于此,可以将一个大型数据集划分为多个不同的小数据集,将一个大分类问题分解成为多个小分类问题,从而解决原有的大分类问题。通常情况下,高维大数据的降维可以分为特征选择和特征提取,如图1所示。

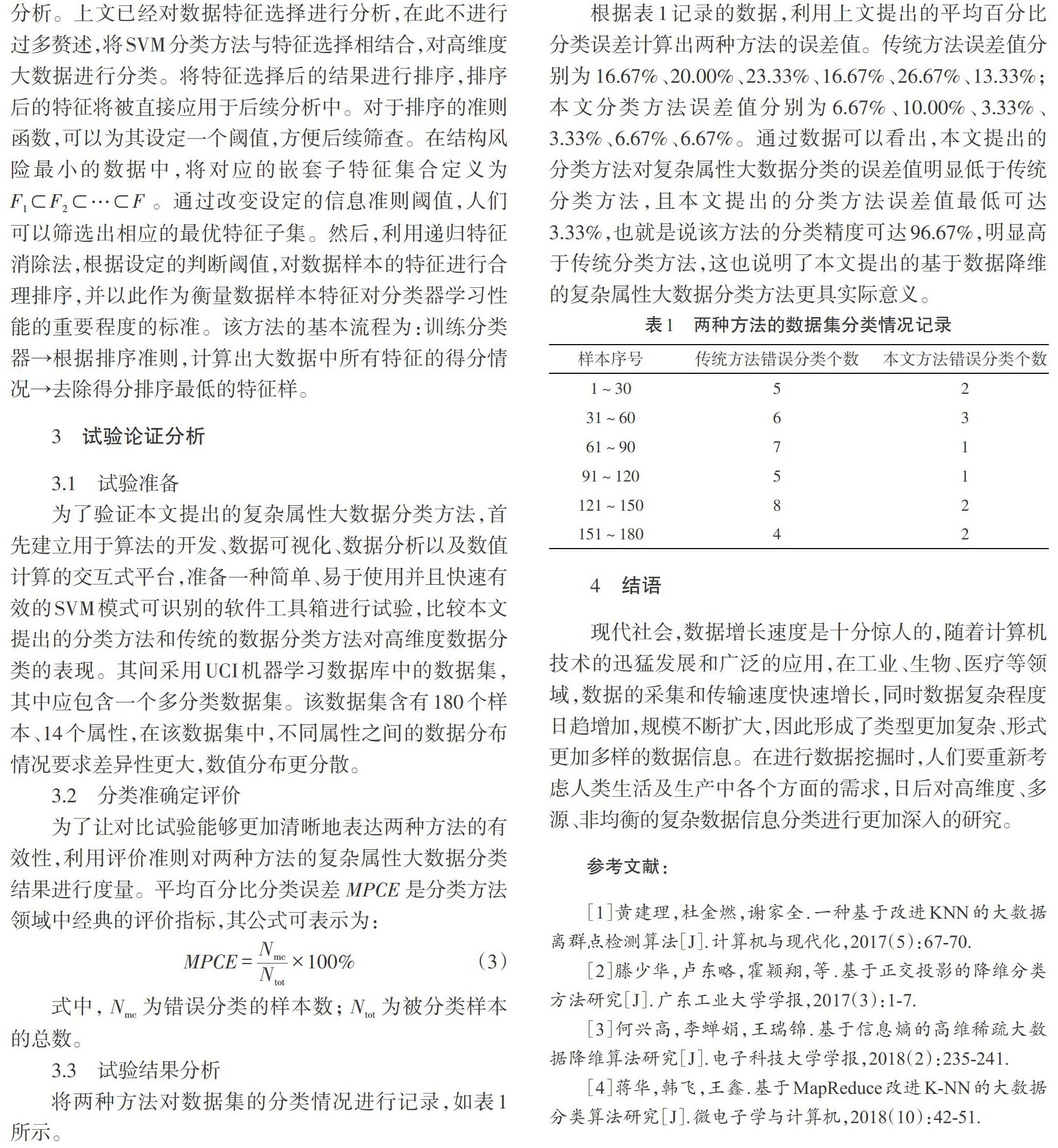

特征提取是指在原始的大数据特征中选取一个满足条件的最优特征子集进行建模,因此这种方法也称为选维。假设大数据为[X],大数据中包含[N]个特征信息,表示为[X=(x1,x2,...,xN)],通过特征选择选出[M]个最具有代表性的特征构成新的特征矢量[Y],表示为[Y=(xi1,xi2,...,xiM)],且[M 特征提取是利用映射函数将特征从原始的大数据空间映射到新的特征子空间中。特征提取的特征矢量可表示为[X=(x1,x2,...,xN)],其变换函数表示为[y=f(x)],[X]经[y]变换降维后得到[M]为新的特征矢量,可表示为[Y=(y1,y2,...,yM)],且[M 在对复杂属性大数据进行降维处理时,要根据大数据的特征选用适当的方法,若大数据中的特征是相互独立的个体,则选用特征选择的方法更加方便快捷;若大数据中的特征之间具有关联性、不独立,则应选用特征提取方法对大数据进行降维处理,执行特征的函数变换可以消除特征之间的相关性。在进行数据降维时也可将两者综合利用,首先进行特征选择,将选出的一部分具有代表性的特征施加数学映射变换,将原始大数据空间映射到新的子空间中,达到双重降維的目的。 2 復杂属性大数据分类方法 关于利用特征选择和特征提取降维处理后的大数据,根据其不同特点,采用SVM分类方法或多元SVM-REF分类方法对复杂属性大数据进行分类,下面对两种分类方法进行了详细的说明。 2.1 SVM分类方法 传统的数据分类方法包括两种,一种是有监督的分类方法,如决策树、神经网络模型等;一种是无监督的分类方法,如聚类分析、主成分分析等。在众多有监督的分类方法中,SVM(支持向量机)分类方法在非线性问题处理、数据特征识别、小样本数据分析等方面具有独特的优势,是一种经典机器学习方法,以统计分析为理论基础。SVM分类方法的核心建模思想是结构风险最小化原则。 假设一个未知映射为[p],对于给定的输入样本空间[a]和与其对应的输出域[b],任何机器学习的目的都是为了让输出域[b]更加贴近事实。具体说明,假设损失函数为[E],记期望风险(映射值与实际值之间的误差被称为风险)为[R],用公式可表示为: 式(2)给出的是在不同情况下,映射函数[p(a)]所对应的概率。对于大数据分类问题来说,二分类器中的一对一和一对多方法能够更容易地拓展到多分类问题中。实际上,[a]和[b]的联合概率密度函数[p(a,b)]为未知的函数,因此,式(1)中的期望风险[R(p)]无法通过直接计算得出。人们,需要根据大数据样本的经验分布推断[R(p)],并以经验风险逼近期望风险。当数据样本的容量趋近于无限大时,经验风险将无限趋近于期望风险。但在实际应用中,由于采集到的数据样本十分有限,因此在有限的数据样本情况下,经验风险最小并不一定是期望风险最小的时候。基于经验风险最小的分类器的识别能力较差,在分类过程中很难达到更高的分类精度,针对这一问题,在有限数据样本的条件下将结构风险降低到最小。 2.2 多元SVM-REF分类方法 当采集到的数据特征样本的维度过大而训练样本的模式较少时,采用降低高维度数据空间的维数用以避免过拟合风险。在进行过拟合过程中,样本的训练分类器通常是分类精度非常高的,但缺点在于泛化性能差。利用正则化方法能够在某种程度上解决过拟合问题的同时不对数据进行降维处理,而SVM分类方法正是针对这一问题建立的。SVM分类方法在处理非线性问题时具有良好的表现效果,并且计算过程的复杂度相对较低,但SVM分类方法只能用于对小样本数据进行识别,而对于高维度的大数据样本进行分析时要结合特征选择的方法进行分析。上文已经对数据特征选择进行分析,在此不进行过多赘述,将SVM分类方法与特征选择相结合,对高维度大数据进行分类。将特征选择后的结果进行排序,排序后的特征将被直接应用于后续分析中。对于排序的准则函数,可以为其设定一个阈值,方便后续筛查。在结构风险最小的数据中,将对应的嵌套子特征集合定义为[F1?F2?…?F]。通过改变设定的信息准则阈值,人们可以筛选出相应的最优特征子集。然后,利用递归特征消除法,根据设定的判断阈值,对数据样本的特征进行合理排序,并以此作为衡量数据样本特征对分类器学习性能的重要程度的标准。该方法的基本流程为:训练分类器→根据排序准则,计算出大数据中所有特征的得分情况→去除得分排序最低的特征样。 3 试验论证分析 3.1 试验准备 为了验证本文提出的复杂属性大数据分类方法,首先建立用于算法的开发、数据可视化、数据分析以及数值计算的交互式平台,准备一种简单、易于使用并且快速有效的SVM模式可识别的软件工具箱进行试验,比较本文提出的分类方法和传统的数据分类方法对高维度数据分类的表现。其间采用UCI机器学习数据库中的数据集,其中应包含一个多分类数据集。该数据集含有180个样本、14个属性,在该数据集中,不同属性之间的数据分布情况要求差异性更大,数值分布更分散。 3.2 分类准确定评价 为了让对比试验能够更加清晰地表达两种方法的有效性,利用评价准则对两种方法的复杂属性大数据分类结果进行度量。平均百分比分类误差[MPCE]是分类方法领域中经典的评价指标,其公式可表示为: 3.3 试验结果分析 将两种方法对数据集的分类情况进行记录,如表1所示。 根据表1记录的数据,利用上文提出的平均百分比分类误差计算出两种方法的误差值。传统方法误差值分别为16.67%、20.00%、23.33%、16.67%、26.67%、13.33%;本文分类方法误差值分别为6.67%、10.00%、3.33%、3.33%、6.67%、6.67%。通过数据可以看出,本文提出的分类方法对复杂属性大数据分类的误差值明显低于传统分类方法,且本文提出的分类方法误差值最低可达3.33%,也就是说该方法的分类精度可达96.67%,明显高于传统分类方法,这也说明了本文提出的基于数据降维的复杂属性大数据分类方法更具实际意义。 4 结语 现代社会,数据增长速度是十分惊人的,随着计算机技术的迅猛发展和广泛的应用,在工业、生物、医疗等领域,数据的采集和传输速度快速增长,同时数据复杂程度日趋增加,规模不断扩大,因此形成了类型更加复杂、形式更加多样的数据信息。在进行数据挖掘时,人们要重新考虑人类生活及生产中各个方面的需求,日后对高维度、多源、非均衡的复杂数据信息分类进行更加深入的研究。 参考文献: [1]黄建理,杜金燃,谢家全.一种基于改进KNN的大数据离群点检测算法[J].计算机与现代化,2017(5):67-70. [2]滕少华,卢东略,霍颖翔,等.基于正交投影的降维分类方法研究[J].广东工业大学学报,2017(3):1-7. [3]何兴高,李蝉娟,王瑞锦.基于信息熵的高维稀疏大数据降维算法研究[J].电子科技大学学报,2018(2):235-241. [4]蒋华,韩飞,王鑫.基于MapReduce改进K-NN的大数据分类算法研究[J].微电子学与计算机,2018(10):42-51.