基于K空间数据的深度核磁共振图像重建*

2020-07-20黄敏管智慧周到陈军波

黄敏,管智慧,周到,陈军波

(中南民族大学生物医学工程学院,武汉 430074 )

1 引 言

扫描时间较长,是核磁共振(MRI)当前存在的一个主要问题。基于压缩感知的MRI扫描有效地缓解了这一问题。但随后的重建过程是基于迭代算法实现的,在保证重建图像质量的前提下,重建时间变长,不利于临床实时成像。

传统MRI图像重建方法没有统一框架,与脉冲序列、K空间采样轨迹等密切相关,研究者必须对成像原理,脉冲序列等非常熟悉。在各种医学成像技术中,MRI的重建算法相对是最复杂的。

近年来,深度学习[1-3]也逐步应用于MRI重建领域。Jin等[4]提出使用U-net模型重建MRI,模型通过对补零后FFT的伪影图像与金标准图像之间进行学习,重建出不含伪影的MRI图像。后来,他们又在U-net模型的基础上加入残差模块,解决了反向传播过程中梯度消失的问题。随后出现的级联卷积神经网络[5],将多个CNN网络模块级联起来,进行输入为带伪影图像的端到端训练。2016年,Sun等[6]提出ADMM-net网络,该模型将交替方向乘子算法(ADMM)与CNN联合起来作为一种MRI重建方法。

上述各种CNN模型输入的是空间域图像,与MRI扫描的频域数据相比,前者丢失了部分MRI信息。若直接对K空间频域数据进行学习[7],则更符合重建的思路和工程要求。

2018年,Souza等[8]提出了W-net模型,该模型由频域U-net和空域U-net组成,两个子模型中间由傅里叶变换相连接。其中频域U-net的输入为双通道,分别载入复数数据的实部和虚部,作为整个网络的输入。但当我们用新数据送入该模型,得到的重建结果较差。

为了优化W-net模型的性能,我们对原白模型采用基于新实例数据的迁移学习方法,并对损失函数和学习率进行调整,提升了模型的泛化能力。然后对优化后的模型加入数据更新模块,进一步改善了模型的重建效果,并分析不同采样率下的模型性能,与传统压缩感知算法(BM3D-MRI)[9]作比较。

2 数据与方法

2.1 数据准备

W-net原数据集包含45个体数据,为T1加权、矢状位全采样的K空间数据,每个体数据包含170层二维数据,训练集/验证集/测试集分别为4 250/1 700/1 700。由于数据量较少,模型对新数据的重建效果较差。

为了提高模型的泛化能力,我们采用扩展数据进行迁移学习。数据来源于IXI数据集(https://brain-development.org/ixi-dataset/),选取其中240个T1加权的矢状位的正常脑部体数据。每个体数据包含150张2D磁共振图像,训练集/验证集/测试集分别为24 000/6 000/6 000。由于W-net模型的输入端为K空间数据,需要对图像进行FFT得到频域数据,经采样率20%的高斯随机掩模欠采样后,再送入网络学习。将经过迁移学习后的W-net模型称为W-net1,见图1。

图1 扩展数据集预处理Fig.1 Preprocess forextended data set

为了增加训练集的数量,在实际训练中还加入了数据增强。对训练数据进行在角度(0,40)内的随机翻转(模拟MRI斜面扫描),以及参数为0.075的左平移和右平移、参数为0.25的裁剪和缩放,并通过最近邻的插值方式处理超出的边界点。最终实现小批次的在线增强,直至达到设定的Epoch次数为止。

图2 W-net模型框架Fig.2 W-net model framework

2.2 网络训练

图2中的W-net网络,由结构对称的a和c两个U-net部分,和一个中间IFFT连接部分b构成。共包含44个卷积层。

其中,a为带残差的频域U-net,输入和输出均是频域数据。共22个卷积层,前21个卷积层后面均伴随激活函数ReLU,最后一个卷积层后面跟随线性激活函数。前半部分(下采样)经过三次池化操作对输入数据降采,减小特征图大小和增大视野。后半部分(上采样)经过三次反卷积,以增大特征图大小和输入数据尺寸保持一致。由于下采样会丢失一部分信息,故将上采样和下采样中对应的特征图进行组合,再卷积。并将最后一层卷积输出与a输入相加得到a部分的输出。

经过中间b部分的IFFT,将数据由频域转换到图像域。c与a结构相似,但为空域U-net,其输入与输出均为图像域。a部分对输入为K空间欠采样的数据进行学习,预测出完整的K空间数据。c部分则是进一步提取图像的高阶特征,滤除图像伪影。

模型输入为K空间欠采数据补零后的256×256数据,输出为256×256的重建MRI图像。损失函数为a部分输出的全采K空间数据的均方根误差和最终输出图像的均方根误差的加权,公式为:

(1)

其中,ki和Ii分别为训练集第i个样本的全采样K空间数据和重建图像,n为训练集样本的数量。损失函数的第一项作为恢复原始数据的误差项,第二项作为重建结果的误差项。

调整q1与q2的比例q1+q2=1,训练得到不同模型,用扩展数据的测试集对其分别测试。以测试结果的平均峰值信噪比(PSNR)和平均均方根误差(NRMSE)作为评价指标。通过分析,折中选取q1为0.3,则q2为0.7,见图3。

采用Adam函数对网络进行反向优化,原模型的初始学习速率为10-3,β1=0.9,β2=0.999。迁移学习过程以原模型参数作为初始参数,用扩展数据集中的训练集对原模型进一步训练。并将初始学习率调为10-4,每批次输入4个训练样本,实验共迭代6×105次,训练时长约35 h。

图3 q1与q2对模型性能的影响Fig.3 Effects of q1 and q2 on model performance

本研究是基于深度学习Keras框架在配置有8块16 GB的NVIDIA Tesla V100 GPU工作站上实现的,采用了开发语言Python3.6和MatlabR2018b用于数据分析。

2.3 数据更新

考虑到重建图像的K空间数据与原始数据的一致性,有必要在模型中加入数据更新层。

首先,对输出图像进行傅里叶变换得到当前全K空间数据,将欠采样输入数据中补零的部分进行替换。然后,对更新后K空间数据进行IFFT,得到模型的最终输出。整个模型的重建过程见图4。

3 结果与分析

3.1 模型预测结果

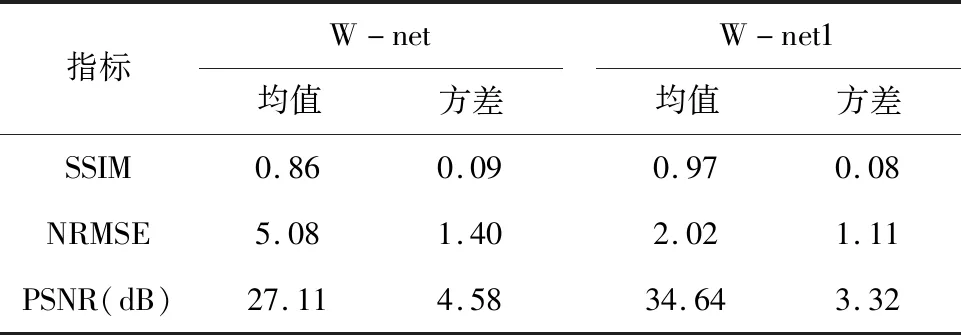

将原始和扩展数据集的两个测试集合并为新的测试集,样本量为7 700。分别对W-net和W-net1两个模型进行测试,并对每个指标计算其均值和方差,指标结果见表1。分析可知,相比原模型,经过迁移学习后的模型W-net1其结构相似度SSIM从0.86上升到0.97,PSNR平均提高了约7.5 dB,NRMSE从5.08下降到2.02,说明模型的性能整体有较大的提升。

图4 模型重建过程Fig.4 Model reconstruction process

表1 模型重建指标对比Table 1 Model reconstructionindexcomparison

为了测试模型的泛化能力,本研究随机地在网上寻找不同部位及不同方位的MRI图像,图5(a)-(d)为金标准参考图像。a为与训练数据同一批的头部矢状位图像,b为大脑轴位图像,c为大脑轴位含病灶图像,d为膝盖图像。对以上MRI图像进行FFT,模拟得到k空间全采样数据,并加入随机噪声,然后加掩模,得到欠采的测试数据。分别输入到W-net和W-net1模型中,输出结果分别为图中的第二排与第三排。

从结果可知,原模型W-net对正常人的头部测试数据,能够预测得到较好的结果,见图5(e)-(f)。但对含病灶的大脑和膝盖,预测效果很差,见图5(g)-(h)。肿瘤和周围组织的对比度较差,且缺失了轮廓(黄色箭头位置);膝盖对比度更差。

由表2可知,对含病灶的头部核磁共振数据,W-net重建图像的NRMSE较高,PSNR较低,未达到临床上医学图像的诊断标准。

图5 W-net与W-net1的测试结果Fig.5 Test results ofW-net and W-net1 model

然而,迁移学习后的模型W-net1,对含肿瘤的头部欠采核磁共振数据有很好的预测效果。由表2可知,相比原模型,W-net1重建图像的PSNR提高了近10 dB,NRMSE降低了8.7。同时观察图5(h)和图5(l)的膝盖图像,重建效果在对比度上明显改善。

表2 含病灶数据的重建指标对比Table 2 Reconstruction indicators for lesion data

可见,W-net1模型不仅对头部矢状位和大脑轴位数据有很好的预测效果,而且对含肿瘤的头部和结构相对简单的膝盖等部位数据,同样具有很好的预测重建能力。因此,W-net1与原模型W-net相比,大大提升了模型的泛化能力。

图6 数据更新效果对比Fig.6 Comparison of data update effect

最后,为进一步提升模型性能,在W-net1模型中添加数据更新层,改进后的模型对小脑部分的纹理细节恢复有更好的表现,见图6。

3.2 深度MRI重建与传统算法比较

为了比较深度MRI重建与传统重建算法的优劣,分别采用10%、20%和30%的降采样率数据进行重建。采用高斯随机掩模,对全采K空间数据进行降采样,并比较三种采样率的重建结果。传统重建算法选用CS-MRI重建中重建效果较好的BM3D-MRI,见图7。第二行至第四行分别对应不同采样率的重建结果及误差图,第二列和第四列分别代表三种采样率的深度重建和CS重建结果,第三列和第五列分别代表三种采样率的深度重建误差图和CS重建误差图。

观察可知,当采样率为10%时,CS重建图像较模糊,而深度重建结果虽在肿瘤边缘不是很清晰,但肿瘤的位置和形状能够较准确地呈现出来。当采样率为20%时,相比CS重建,深度重建能够更好地恢复肿瘤的边缘轮廓和内部形态(黄色箭头所示)。对于深度MRI重建,当采样率提高到30%时,肿瘤大小及对比度与金标准相比,几乎准确复原,明显优于CS重建效果,且重建速度也远远高于传统算法,可在扫描后马上看到重建图像,这对于临床实时应用具有极大的意义。

图7 深度重建与CS重建结果对比Fig.7 Comparision between the results of deep reconstruction and CS reconstruction

4 结论

我们研究了深度MRI重建方法,对W-net模型进行迁移学习,对损失函数和学习率等超参数进行了调整,改进后的模型的泛化能力大大提升。在重建质量与速度上,深度MRI均优于压缩感知法。为进一步改善W-net1模型的重建效果,在模型中加入了数据更新模块,改进后的模型能够学习到更多的纹理细节特征。后期可研究深度并行MRI成像技术[10],以更接近临床应用。

深度MRI成像基于对大量数据进行学习,训练好的模型能够对新数据进行预测得到理想的重建结果。相比于传统MRI成像技术,深度MRI成像是更加智能化的“黑盒子”,其快速准确的预测能力,将显著改善以往MRI成像领域扫描加速后带来的重建算法复杂,重建效率和效果均较差的情况。深度MRI成像将开辟MRI“快速扫描+快速重建”的新未来,改变传统的重建思维和实现模式。

感谢“认知科学国家民委重点实验室”的资助(中央高校基金CZY19040)。