基于动态增强磁共振成像的影像组学和不同CNN的深度学习对乳腺良恶性病变的诊断价值

2020-06-23周洁洁张洋苏敏莹何遐遐徐妮娜叶舒欣李建策王瓯晨王美豪

周洁洁,张洋,苏敏莹,何遐遐,徐妮娜,叶舒欣,李建策,王瓯晨,王美豪

(1.温州医科大学附属第一医院 放射科,浙江 温州 325015;2.美国加州大学欧文分校 功能肿瘤影像中心,加利福尼亚州 欧文 96214;3.温州医科大学附属第一医院 甲乳外科,浙江 温州 325015)

乳腺动态增强磁共振成像(dynamic contrastenhanced magnetic resonance imaging,DCE-MRI)具有很高的灵敏度[1-2],可以检测到许多良性病变。随着越来越多的筛查和术前MRI检查的开展,更好地描述MRI检测到的增强病变性质对于提高诊断的准确性至关重要。利用计算机软件从影像学图像中高通量地提取海量的临床医师肉眼无法获取的定量信息,再利用大数据分析方法获得有价值的特征用于临床分析和诊断[3]。近年来,人工智能算法,特别是深度学习在医学图像分析方面取得了显著进展,使医学图像分析领域迅速向前发展[4]。卷积神经元网络(convolutional neural network,CNN)是一种常用的深度学习方法,应用于分析摄影、病理和影像学图像,并报道其在分割、异常检测、疾病分类和诊断等各种临床任务中具有巨大的潜力[5]。 本研究探讨和比较影像组学和5种不同的CNN方法在DCE-MRI上对乳腺良恶性病变的诊断准确性。

1 资料和方法

1.1 一般资料 选取2017年1月至2018年6月经温州医科大学附属第一医院手术或穿刺病理证实的乳腺病变患者152例,所有患者均为女性,术前均行GE 3.0T机器进行MRI平扫及增强检查,所有结果均经病理检查证实。其中恶性肿瘤患者93例,平均年龄(52±11)岁,恶性病变103个;良性病变患者59例,年龄(45±9)岁,良性病变73个。纳入标准:①MRI检查前未行任何放化疗者;②MRI检查前未行穿刺或手术治疗者。排除标准:①MRI检查禁忌证者;②无法行钆喷替酸葡胺(Gd-DTPA)增强检查者;③MRI图像模糊影响分析者。所有患者均签署知情同意书,本研究经医院伦理委员会审查通过。

1.2 磁共振扫描方法 采用GE SIGNA HDx 3.0T MR扫描仪,使用GE 8通道乳腺专用相控阵表面线圈。患者俯卧位,双乳自然悬垂于线圈洞穴内。常规扫描序列包括:轴位STIR序列、轴位FSE T1WI序列、矢状位FS T2WI序列、轴位DWI序列以及动态增强磁共振扫描。DCE-MRI在DWI序列之后进行,采用轴位乳腺优化容积成像三维梯度回波(volume imaging for breast assessment,VIBRANT)序列,具体参数:TR 5 ms,TE 2 ms,FA 10°,层间距1.2 mm,层厚1.2 mm;扫描野34 cm×34 cm,矩阵416×416。每期扫描时间90 s,共扫描6期(1期增强前蒙片、5期增强)。对比剂为Gd-DTPA,按 0.1 mmol/kg,以2.5 mL/s高压注射器静脉注射。

1.3 图像处理方法

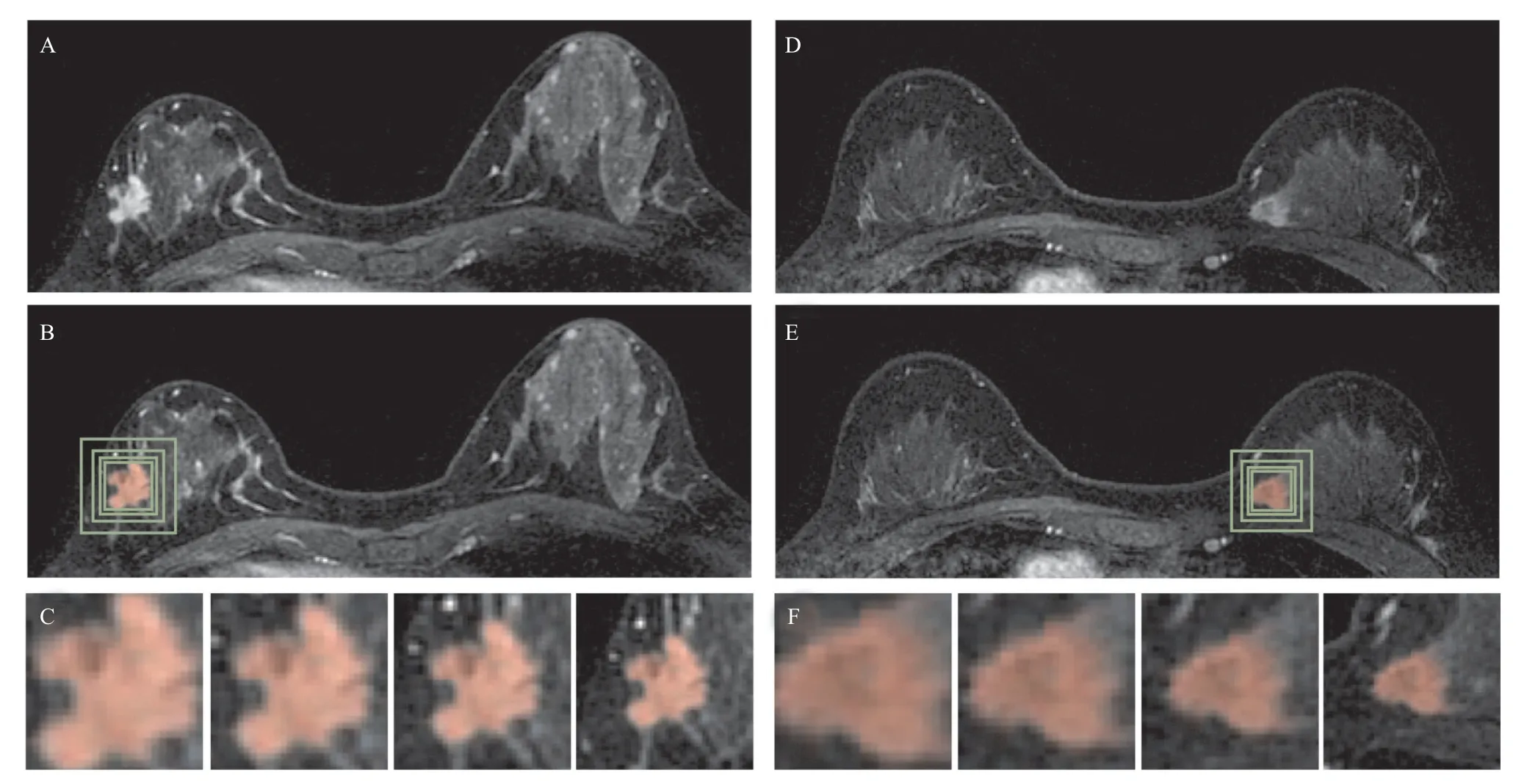

1.3.1 影像组学分析:增强扫描共6期,1期增强前蒙片(F1),5期增强(F2-F6)。利用计算机算法自动分割强化病灶。对于肿块型病灶,采用模糊C均值(fuzzy-C-means,FCM)聚类算法[6]。对于非肿块型病变,FCM不能很好地分割病灶,采用区域生长法(region growth)获得肿瘤边界。DCE参数图根据以下公式获得:早期流入信号增强图(signal enhancement ratio,SE ratio)=[(F2-F1)/F1];最大信号增强图=[(F3-F1)/F1];流出斜率图=[(F6-F3)/F3][7]。恶性病灶和良性病灶的DCE参数,浸润性导管癌见图1,纤维腺瘤见图2。进行影像组学分析前,对每幅参数图上的分割病灶进行分析,获得12个直方图参数和20个GLCM纹理特征参数[8-9]。为了区分良恶性病变,采用随机森林算法选择具有最高意义的特征[10],再利用这些特征训练逻辑模型作为分类器。以上计算采用Matlab 2013b(MathWorks,Natick,MA)编写程序进行。

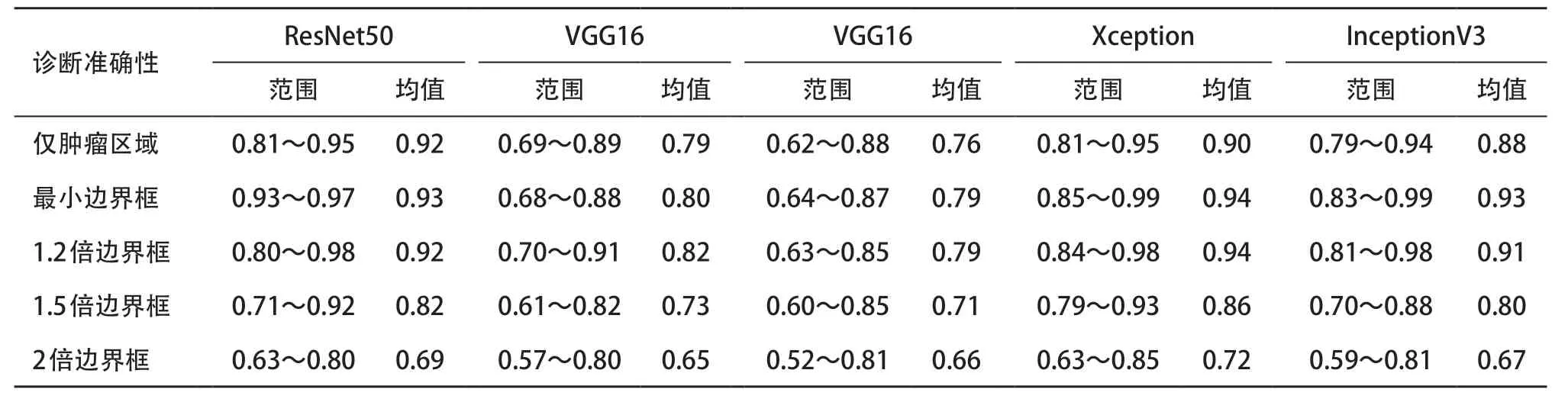

1.3.2 深度学习分析:采用5种不同的CNN进行深度学习,包括ResNet50[11]、VGG16[12]、VGG19[12]、Xception[13]和InceptionV3[14]。基于三个DCE参数图进行分析。对于每个病灶,都会生成包含整个肿瘤的最小方形边界框。为了增加例数,所有层面都被用作独立的输入,数据集被随机仿射变换进一步扩充。损失函数为交叉熵,优化器为Adam,学习率为0.001[15]。ImageNet作为这些模型中参数的初始值工作[16]。使用10倍交叉验证评估准确性。为了评估肿瘤周围组织的作用,采用5种不同输入框的方法进行分析:①仅包含肿瘤;②包含少量肿瘤组织的最小边界框;③放大1.2倍边界框;④放大1.5倍边界框;⑤放大2 倍边界框。边界框被调整到64×64作为深度学习输入。见图3。

1.4 统计学处理方法 采用SSPS22.0统计学软件进行统计分析。计量资料用 ±s 形式表示,2组比较用独立样本t 检验;计数资料用百分数表示。利用每个病灶层面的恶性概率预测进行ROC分析,以≥0.5为恶性概率阈值计算诊断准确率;ResNet50分析中,不同尺寸边界框分析的结果采用DeLong检验进行比较分析;5种不同CNN的深度学习在交叉检验中获得AUC,ResNet50与其他4种网络的结果分别进行独立样本t 检验。P <0.05 为差异有统计学意义。

图1 56岁右乳浸润性导管癌患者MRI成像及相应参数图

图2 66岁右乳纤维腺瘤患者MRI成像及相应参数图

2 结果

2.1 良恶性病灶情况 恶性病灶103 个,其中导管原位癌12个(占11.6%),浸润性导管癌84个(占81.6%),其他类型浸润性癌7个(占6.8%);良性病灶73个,其中腺病38个(占52.1%),纤维腺瘤17个(占23.3%),导管内乳头状瘤12个(占16.4%),其他良性病变6个(占8.2%)。恶性组病灶体积为(3.77± 3.08)cm3,良性组病变体积(1.18±1.66)cm3,2组差异有统计学意义(P<0.001)。

2.2 影像组学和不同CNN深度学习分析结果 影像组学分析的诊断准确度为80%。对于深度学习,5个不同大小输入边界框的5种CNN模型的诊断效能见表1。对于ResNet50模型,包含肿瘤的最小边界框效果效能最好,随着边界框越来越大,诊断效能逐渐下降。含少量肿瘤周围组织的最小边界框诊断效能高于仅包含肿瘤边界框、1.2 倍、1.5 倍和2.0倍边界框分析,差异有统计学意义(Z=1.37、1.15、2.74、3.25,均P<0.05);针对含少量肿瘤周围组织的最小边界框分析中,ResNet50(93%)与Xception(94%)和InceptionV3(93%)的诊断准确性差异无统计学意义(t=-0.48、-0.09,均P>0.05);且ResNet50高于VGG16(80%)和VGG19(79%),差异有统计学意义(t=5.2、4.7,均P<0.01)。

3 讨论

DCE-MRI被认为是乳腺病变最精准的影像学检查,能准确、直观地显示病灶,并能很好地显示病灶的形态特征、内部动态强化特征以及病灶与周围组织的关系[1-2]。但影像医师肉眼阅片获得的信息具有一定的主观性,并且对医师的技术水平、专业知识以及临床经验都有极高的要求,因此诊断的准确性差异较大。随着计算机辅助诊断,包括纹理分析及影像组学等一系列影像分析及机器学习技术的发展,实现了影像大数据的自动化高通量特征提取、分析,获得更客观的诊断结果,提高诊断的敏感性和特异性[17]。

图3 2例乳腺恶性病变MRI和不同尺寸边界框分析图

表1 5种不同深度学习算法分析的诊断准确度

自2012 年影像组学概念提出以来[3],大量研究证实基于DCE-MRI的影像组学分析能够有效判断肿瘤良恶性,预测乳腺癌组织病理分级、淋巴结情况、分子亚型以及新辅助化疗疗效评估等[8,18]。随着人工智能技术的进一步发展,深度学习已被应用于乳腺X光摄影的乳腺癌检测和诊断,其对于肿块病变的检测表现与放射科医师具有相近的诊断准确 度[19]。乳腺MRI获取多组具有不同组织对比度图像以及增强后不同时间的不同信号强度图像,这使得深度学习算法的实现更具挑战性。TRUHN等[20]利用影像组学和深度学习技术对MRI良恶性病变的诊断性能进行了研究,多参数MRI分析结果显示,CNN对于强化病灶的良恶性鉴别优于影像组学。但临床上由于乳腺MRI价格高、需要使用造影剂、检查时间长等原因,其使用仍有一定限制。

因此,在本研究中我们选择5种较常见的CNN模型,结合影像组学,比较并初步探讨不同分析技术在乳腺MRI增强良恶性病变诊断中的价值。结果显示,尽管使用的病例数量相对较多,但基于直方图和纹理特征的影像组学的诊断准确度仅为80%,与TRUHN等[20]的研究结果相似。当使用深度学习分析时,诊断准确度不同程度提高,但所使用的模型算法不同,其结果变化很大。Xception和InceptionV3模型分析的准确度略高于ResNet50,显著优于VGG16和VGG19。笔者认为,原因可能是相对于其他类型的网络结构,Xception与InceptionV3并行使用了多种不同的卷积核,可以提取各种不同类型的图像特征。同时,Xception与InceptionV3将通道内特征与通道间特征独立处理,既能够从同一张特征图中提取足够多的图像特征,又能比较不同特征图的动态特征。并且Xception和InceptionV3的网络深度远大于Resnet50和VGG,内部所包含的大量可训练参数提高了网络性能。此推测需要在后续研究中通过增加病例数及优化模型进一步验证。

以往研究表明肿瘤周围环境包含与肿瘤侵袭性相关的重要信息,能反映血管淋巴侵袭和血管生长,以及脂质和水肿成分或腺体组织的癌变信息,有助于疾病的诊断和预后判断[21]。因此在本研究中,我们使用不同大小的边界框作为深度学习的输入来评估肿瘤周围组织的作用。结果表明,与仅包含肿瘤相比,包含少量周围组织的最小边界框分析具有更高的诊断准确率,这提示肿瘤邻近的周围组织可为诊断提供有用的信息。但随着边界框尺寸的增大,诊断效能逐渐下降,笔者认为原因可能是包含太多正常组织导致神经网络输入图像分辨率降低,并且肿瘤信息被稀释而影响诊断效能。

综上所述,在乳腺增强良恶性病变的诊断中,深度学习比影像组学具有更高的诊断准确性,且Xception、ResNet50和InceptionV3优于VGG16、VGG19模型。在深度学习中,包含适量肿瘤周围组织可能有助于提高良恶性病灶鉴别的准确性,但过多的周围组织可稀释肿瘤信息而降低诊断效能。