双判别生成对抗网络的红外图像超分辨重建

2020-05-12邢志勇肖儿良简献忠

邢志勇,肖儿良,简献忠

1(上海理工大学 光电信息与计算机工程学院,上海 200093)

2(上海市现代光学系统重点实验室,上海 200093)

E-mail:passix@163.com

1 引 言

红外图像是通过红外设备“测量”物体向外辐射的热量而获得的,能够在恶劣环境下获取图像信息.但由于硬件条件限制,红外图像分辨率差、对比度低、视觉效果模糊等.因此利用图像处理的方法获取高分辨率红外图像在遥感、监控、目标检测、军事等领域有重要的现实意义.

图像超分辨重建技术[1]SR(Super Resolution)借助相关网络模型,可以有效地提高图像的质量.其主要分为三个方向:基于插值的方法、基于重建的方法、基于学习的方法.基于插值的方法是通过将低分辨率图像的像素点映射到高分辨率图像上,对缺失的像素点用已知的像素点来估计,经典的方法有局部边缘自适应法[2,3]、双三插值法[4].基于重建的方法是通过挖掘低分辨率图像中高频信息,结合图像的先验信息,求解低分辨率成像的逆过程,从而恢复图像中的高频信息.如相似性冗余先验[5,6]、梯度轮廓先验[7]算法等.基于学习的方法是通过学习大量的样本集,从而构建出含有先验信息的低分辨率图像到高分辨图像之间的映射关系,实现图像超分辨重建.后随着深度学习的发展,该方法在图像超分辨领域中占据着主导地位.2014年,Chao Dong 等人提出的SRCNN[8]算法用三层卷积网络对图像进行超分辨重建,首次实现了深度学习在图像超分辨重建上的应用.2016年Kim在SRCNN模型上进行改进,提出VSDR[9]、DRCN[10]算法,通过加深网络模型深度来重建出质量更好的高分辨率图像.2017年Ledig等人提出基于GAN网络的SRGAN[11]算法,采用判别对抗的训练模式,使超分辨重建出的图像在视觉感知上更进一步.2018年,Zhang等人提出的RDN算法,利用密集连接的思想充分提取底层模型的低分辨率图像特征.RDN中的局部特征融合能自适应地学习来自先前和当前局部特征的有效信息,实现连续记忆(CM)机制,从而降低数据维度,增强模型的泛化能力,使训练更加稳定.

特别地,2018年邵保泰等人将SRGAN算法[12]应用在红外图像领域,取得了较好的效果.但该算法在生成器上采用常规的SRCNN网络结构,相对来说模型较为简单,特征提取不够充分,使得生成的红外图像在高频细节上存在丢失问题.

为更好的提高红外图像超分辨重建的质量,充分提取图像的高频细节特征,本文在SRGAN网络模型基础上进行改进,利用RDN网络残差密集连接的特性,提出一种双判别生成对抗网络红外图像超分辨重建算法(DD-SRGAN).在生成网络中,引入无BN层的RIRB,内部残差块密集连接,外部残差块采用远、近跳跃连接,实现红外图像信息在这种跳跃连接中传递到深层网络.去掉BN层可提高模型的泛化能力,减弱重构图像的伪影.在判别网络中,引入双判别器,图像判别器ID(Image Discriminator)和特征判别器FD(Feature Discriminator).ID:在像素域上对输入的红外图像进行判别;FD:通过对特征图结构信息进行编码,并利用高频分量和结构分量来区分超分辨SR红外图像和真实高分辨HR(High-resolution)红外图像.同时,本文利用感知损失和双判别损失函数优化训练,并根据红外图像特征性质减少数据通道参数,简化训练过程.实验结果表明,在4倍超分辨重建红外图像的情况下,也能达到更好的视觉效果.

2 理论基础

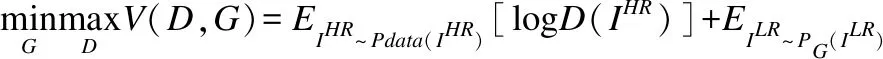

2014年,Goodfellow等人提出的生成对抗网络GAN[14]模型在图像超分辨领域引起了科学界的高度关注,和常规基于深度学习的图像超分辨重建算法相比,该算法生成的图像质量明显得到改善.GAN网络模型包括一个生成器G和一个判别器D,生成器G用给定的噪声z(一般服从均匀分布或正态分布)生成一个类似真实样本的数据G(z);而判别器D是一个二分类器,对生成器G生成的数据和真实数据进行判别分类.GAN网络的训练过程就是训练D最大化判别正确率,同时训练G最小化log(1-D(G(z)))的过程.即G和D的训练就是关于函数值极大极小的博弈问题.目的是能够实现生成器生出判别器无法对真实数据和生成数据进行判别的结果,达到欺骗的目的.函数式如公式(1)所示:

(1)

依据GAN网络的思想,结合超分辨图像的特性,本文将其运用在红外图像超分辨领域.对生成器来说,输入为低分辨率图像ILR,输出则为高分辨率图像ISR,判别器的输入为生成的高分辨率图像ISR和原始高分辨率图像IHR,输出则是对图像的来源进行判定.函数式如公式(2)所示:

(2)

在训练过程中,生成器G尽可能生成能欺骗判别器D的高分辨率红外图像ISR,而判别器D则对生成的高分辨红外图像ISR和真实的高分辨率IHR红外图像进行判别,通过这种反复优化训练促使生成器能够重建出接近于真实红外图像IHR的高分辨率红外图像ISR,达到红外图像超分辨重建的目的.

3 重建算法

3.1 网络结构

本文引用上述GAN网络的思想,通过引入额外的特征判别器FD,协同原有的图像判别器ID,和生成器G进行对抗,实现红外图像的超分辨重建.

整个生成网络架构包括16个外部残差块、4个内部残差块、两个亚像素卷积层和多个跳跃连接.子像素卷积层使用64个滤波器,其他卷积层均采用128个滤波器.残差块中去掉BN层,只保留卷积和池化层.生成网络及内部残差块结构如图1所示.

图1 生成网络模型

生成网络的具体实现过程如下:

1)首先对输入的低分辨率红外图像ILR进行一层9×9的卷积,提取低频红外图像特征.

2)利用密集连接的RIRB加深网络深度,学习更多非线性和更大感受野的高频红外图像特征.

3)通过对每个外部残差块的输出进行一次1×1的卷积,聚合不同残差块红外图像的特征.

4)将RIRB中获得的特征通过两个亚像素卷积层,实现对低分辨红外图像ILR4倍的上采样.

5)最后通过3×3卷积,完成红外图像的超分辨重建.

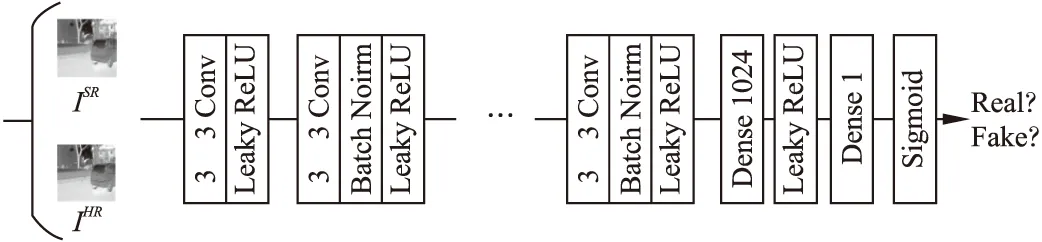

判别网络模型结构如图2所示[15],该网络以生成的超分辨红外图像ISR和原始高分辨红外图像IHR为输入,通过8个卷积层提取图像的512维特征,作为两个全连接层、sigmoid激活函数的输入,再计算样本分类概率,判定红外图像来源.

3.2 损失函数

在图像的超分辨重建领域,主要用损失函数评判网络性能.传统方法中应用最广泛的损失函数是最小均方误差(Mean-Square Error,MSE),MSE越小,超分辨出的图像和原图像相似度就越高.其对应的损失函数定义如公式(3)所示:

(3)

基于MSE损失函数能带来较高的峰值信噪比(Peak Signal to Noise Ratio,PSNR)[16],但结果会因缺乏高频细节而图像过于平滑.为了提高红外图像的质量,获取更多高频细节特征,本文采用两个损失分量:感知损失分量[17]和双判别网络损失分量.该损失函数分别定义如公式(4)、公式(5)所示:

(4)

(5)

(6)

(7)

和LMSE不同,感知相似性损失LP是在特征域中测两个图像之间的差异.函数定义如公式(8)所示:

(8)

图2 判别网络模型图

4 实 验

4.1 数据

本文中,红外图像超分辨重图像主要来源CVC-09/14:(FIR Sequence Pedestrian Dataset)数据库[19],主要场景涉及行人、车辆、建筑、街道等.数据采集首先对CVC-09/14数据库红外图像(640×480)进行剪切、翻转得到9000张(296×296)红外图像IHR作为训练集,再对IHR进行4倍降采样,得到像素大小为74×74的ILR作为本文模型的输入.

4.2 实验细节

首先,对输入的ILR和IHR红外图像进行归一化处理,使灰度取值范围线性映射到[0,1]区间,设置方程(5)中平衡项λ值为10-3.采用VGG19网络模型的前五层,在激活函数之前获取红外图像特征图φm.为平衡不同的损失项,在计算损失项前采用比例因子r为1/12.75对特征图进行缩放[20].

其次,为防止DD-SRGAN模型在训练过程中出现局部最优的情况,先对生成网络进行预训练处理.随机选取自建数据库中64张对应的IHR和ILR红外图像进行训练,采用Adam算法[21]进行优化,优化参数β设为0.9,迭代次数为96000,初始预训练模型的学习速率为10-4,下降速率为0.1.

最后,在对抗训练阶段,利用预训练好的初始化生成模型,对DD-SRGAN网络进行对抗优化训练,优化过程同样使用β为0.9的Adam算法,迭代次数为90000,初始学习速率设为10-4.训练过程的损失函数指标变化曲线如图3(a)、图3(b)所示,图3(a)为判别网络损失函数变化曲线,图3(b)为生成网络损失函数变化曲线.整个实验过程在matlab2016、python3.0计算机(windows10,Intel core i7-8700,内存12GB)上进行的.

图3 DD-SRGAN损失函数曲线

4.3 质量评定标准

评判超分辨率红外图像质量的好坏主要取决于两个方面,一是主观评价,通过视觉感知来判别红外图像的亮度、清晰度、框架和细节信息等;二是客观评价,通过算法模型计算各类指标参数,依据量化指标评定,客观评价主要参考两项指标:图像的峰值信噪比PSNR和结构相似性SSIM(Structural Similarity)[22].

(9)

(10)

式中M、N为红外图像的尺寸,μIHR和σIHR分别为IHR的平均灰度值和方差,μISR和σISR分别为ISR的平均灰度值和方差,σIHRISR为IHR和ISR的协方差,C1、C2为常数.

4.4 实验结果分析

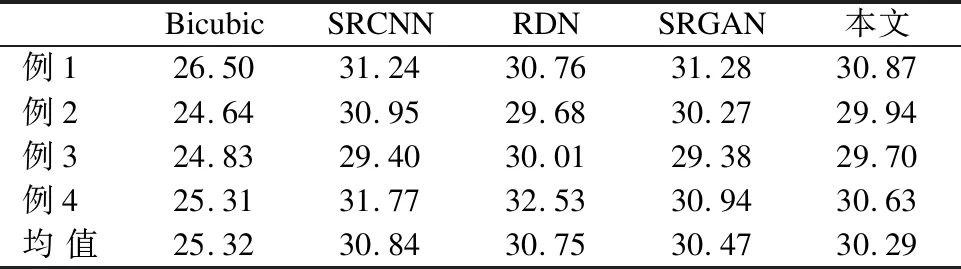

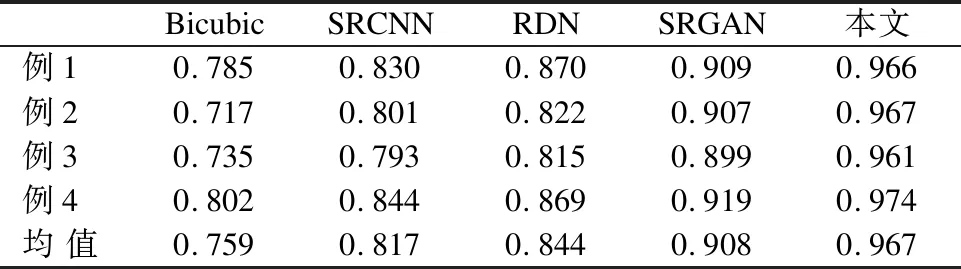

利用4.3节超分辨率质量评定方法,在CVC-09测试集中随机抽取四张红外图片进行测试,将结果与Bicubic、SRCNN、RDN、SRGAN四种经典的超分辨算法进行量化对比,得到表1、表2所示数据.从数据中可知,本文算法所重建出的红外图像在亮度、对比度、清晰度上要优于前四种算法.特别地,和RDN以及SRGAN算法相比,本文算法证明了在生成网络中采用密集残差连接的方式,以及引入双判别网络的思想有利于重建图像质量的进一步提高.在视觉效果上,本文算法生成的高分辨率红外图像ISR在边缘轮廓以及细节纹理等高频特征上也更加清晰、丰富.如例1中头部细节纹理信息更加突出,例2中车牌标志相比较RDN、SRCNN算法,本文算法避免了突出高频特征导致图像过于平滑的问题,例3、例4在细节上也能体现出本文算法所带来的更好的视觉感受.五种算法的重建结果图如图4所示.

表1 5 种算法的 4倍SR 重建 PSNR /dB结果

Table 1 ×4 SR of 5 algorithms PSNR /dB results

BicubicSRCNNRDNSRGAN本文例126.50 31.2430.7631.2830.87例224.64 30.9529.6830.2729.94例324.83 29.4030.0129.3829.70例425.31 31.7732.5330.9430.63均 值25.32 30.8430.7530.4730.29

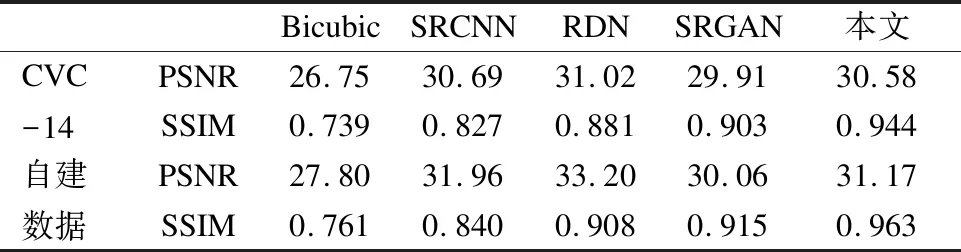

本文对CVC-14中测试集以及自建红外数据集中随机抽取20张红外图像进行验证,结果如表3所示.在SSIM指标上,本文算法比SRGAN综合提高0.045,在PSNR上提高0.89dB.但相比于SRCNN、RDN,本文算法在PSNR上不具备优势,主要原因是传统卷积网络采用MSE损失函数,而本文算法采用对抗损失和感知损失函数.

表2 5 种算法的4倍 SR 重建 SSIM 结果

Table 2 ×4 SR of 5 algorithms SSIM results

BicubicSRCNNRDNSRGAN本文例10.785 0.8300.870 0.9090.966例20.717 0.8010.822 0.9070.967例30.735 0.7930.815 0.8990.961例40.802 0.8440.869 0.9190.974均 值0.759 0.8170.844 0.9080.967

图4 五种算法的重建结果

由傅里叶频谱图特性可知,频谱图中亮点数越多,图像的高频细节特征就越充分[23].为证明本文算法在获取高频特征上的优越性,分别对例1、例2进行二维傅里叶离散变换,再进行灰度处理.结果如图5所示,(a)、(b)分别表示SRGAN算法重建图像的频谱图和本文算法重建图像的频谱图.由图可知,本文算法的频谱图对应的亮点数较为密集,证明了本文算法在提取红外图像高频特征上相比于SRGAN算法具有更大的优势.

此外,为进一步验证本文算法在处理图像细节伪影上的优势,采用Laplace算子[24],分别对SRGAN和本文算法所得到的红外图像进行边缘纹理特征分析.以例1为例,得到如图6所示的结果,(a)、(b)分别表示为上述两种算法重建图像的Laplace算子纹理特征图.由细节部分图像的纹理特性可知,本文算法能做到,噪声影响较少,边缘伪影现象不明显.

表3 两种数据集下的测试结果

Table 3 Test results under two datasets

BicubicSRCNNRDNSRGAN本文CVC-14PSNR26.7530.6931.0229.9130.58SSIM0.7390.8270.8810.9030.944自建数据PSNR27.8031.9633.2030.0631.17SSIM0.7610.8400.9080.9150.963

图5 傅里叶频谱图

图6 Laplace算子纹理特征图

5 结束语

本文在SRGAN图像超分辨算法的基础上对模型进行改进,提出了基于DD-SRGAN的单帧红外图像超分辨重建算法,有效地提高了红外图像的质量,弱化了图像细节伪影问题,使得图像的边缘和纹理特征更加明显.本文算法核心是运用两个判别器与生成器对抗训练.对于生成网络,引入无BN层的残差中的残差块(RIRB),内部残差块密集连接,外部残差块远、近跳跃连接,实现高频信息能有效的提取并传递到深层网络.实验结果表明,该算法在客观评价和主观视觉上较SRGAN算法都有较好提升,为后续实现红外图像检测与识别提供保障.但红外图像本身边缘信息平滑,图像数据信息较少,制约了超分辨网络性能的进一步提高.因此相比于可见光图像,红外图像超分辨重建在图像特征信息提取上还有很多有待解决的问题.