基于深度学习的地面苹果识别与计数

2020-05-11荆伟斌胡海棠程成李存军竞霞郭治军

荆伟斌 胡海棠 程成 李存军 竞霞 郭治军

摘要: 在农业保险中,苹果园受灾理赔需要通过快速准确的落果计数进行定损,然而自然场景的复杂性、落果的分布状态、采集员的身高、拍照习惯等环境因素和人为因素影响了基于影像的落果识别与计数的准确性和可靠性。通过获取不同落果背景、光照度、落果分布密集度、拍摄高度和拍摄距离等条件下地面的苹果影像,采用基于深度学习的更快速的区域卷积神经网络(faster region convolutional neural networks,Faster-RCNN)模型进行地面苹果检测的方法,与传统方法Hough变换和分水岭算法进行对比。结果表明,Faster-RCNN模型的平均识别精度达到95.53%,明显优于传统的地面苹果提取方法;在弱光、落果分布密集、拍摄距离较远等不理想的条件下,识别精度也达到90%以上,有较好的稳定性。基于深度学习的地面苹果识别与计数方法,有望为提高农业果品保险定损的精度与效率提供重要的技术参考。

关键词: 深度学习;苹果;识别;地面苹果数量;农业保险

中图分类号:TP391.41 文献标志码: A

文章编号:1002-1302(2020)05-0210-09

我国苹果的总产量在2017年已经达到4 139万t,并且目前我国是世界上苹果种植面积最大、产量最高的国家[1-2]。以室外种植为主的苹果易受大风、冰雹、大雨等各种不可抗拒的天气影响而受灾,且灾害存在区域性,同一地区、同一时间、同一灾种会造成多个果园受灾的现象,其受灾的严重度直接关系到苹果的产量和农民的收入。苹果损失承保是农业保险的重要内容之一,如果受损后果农报案,保险公司保险员须在2~3 d内对多家受灾果园进行受灾状况分析。保险人员在保险理赔时需要及时、快速、准确地监测苹果损失并对落果进行计数,由于时间紧、工作量大、工作强度高,通常没有足够的时间对果园的受灾状况作出详细统计,导致果农的预期与保险公司估算后的定损理赔意见不统一。目前,通常只能通过谈判进行定损,往往存在损失虚高的问题。用相机、手机拍摄落果影像结合落果自动计数技术,有望提高保险人员的调查速度,并提供评判与核实损失的依据。在用影像进行果实识别与数量统计的过程中,颜色、纹理、轮廓等特征被用以区别果实、树叶、土壤背景等。李莎等使用了单个或多个特征进行果实的自动提取[3-13],尽可能利用颜色、纹理、形状等特征及支持向量机等高级分类方法,但是由于背景环境的复杂性和多样性、果实的成熟状态不同、拍摄的时间、拍摄位置及高度等多种因素的影响,使得用模型学习的果实特征应用条件严格,在新的场景中应用的扩展性和识别精度不高,从而造成人工地面采集影像的落果检测成为重要难题。

近年来,随着人工智能的发展,深度学习在各个领域的深入应用成为重要的发展趋势[14-26]。卷积神经网络具有高级的语义表达能力,能自学习颜色、纹理、形状等浅层特征和深层特征,图像的特征表达能力强,并且具有良好的鲁棒性和泛化性。在深度学习研究中,目标检测的应用较为广泛,以快速的区域卷积神经网络(faster region convolutional neural networks,简称Faster-RCNN)[14]和YOLO(you only look once)[15]为主。研究发现,Faster-RCNN更适用于中小目标物的检测。Ren等在 Fast-RCNN的基础上加以改进,研究出更优的目标检测模型Faster-RCNN[16]。熊俊涛等基于 Faster-RCNN 对树上的绿色柑橘进行检测,在测试数据集上的平均检测精度达到了85.5%[20]。Bargoti等利用地面车辆对苹果树进行侧面影像采集,并采用卷积神经网络对苹果树进行检测,检测精度达到了86.1%[24]。国内外研究者基于深度学习在果实检测中的应用[20-26],以及Faster-RCNN在目标检测任务中快速高效的特点和小目标检测中的优势[14-16],为地面苹果的识别与计数提供了理论依据和技术支撑。然而,目前由于不同光照、背景等环境的影响与拍摄高度、拍摄距离等人为因素的影响,对基于深度学习的地面苹果识别的精度和稳定性带来挑战。

本研究面向苹果农业保险中地面苹果理赔的快速识別和计数的需求,针对不同光照度、多种土壤背景、果实表面颜色分布不均匀、影像果实相对尺寸较小等问题,获取复杂自然场景下的地面苹果影像,引入深度学习的方法学习不同地面苹果的特征,提取图片中目标物的一些隐藏像元信息进行果实识别,旨在提出1种基于Faster-RCNN对原始影像中的地面苹果进行提取计数的方法,并与传统的果实识别方法进行对比分析。

1 材料与方法

1.1 试验设计与地面苹果影像的获取

在本试验中,为了确保所获得的影像数据信息丰富,涵盖人为因素及环境因素等影响因素,主要针对以下5种因素进行地面苹果影像的收集:地面果实背景、光照度、地面苹果分布密集程度、拍摄高度、拍摄距离。设置这些因素的原因是农业保险公司在苹果园受灾并接到报案后需要勘察和定损理赔,通常会安排保险员在果园进行实地拍照。拍摄地面苹果会受到地面苹果环境的多样性、地面苹果的分布密集程度差异、不同保险员的身高、多个保险员的拍照习惯差异以及拍照时的光照度变化等影响,这些都对落果影像的自动计数提出了挑战。本研究通过模拟试验获取如下多种复杂场景下的苹果落果图片:

(1)地面果实背景。在地面苹果的分布环境中,由于不同地区的施肥环境、除草剂喷洒强度及灌溉条件等多种因素的影响,果园内会出现青草、枯草及杂草比较茂密的情况,导致果实与背景之间的对比度存在多样性特征。

(2)光照度。在保险员拍照时,由于树木阴影等因素的影响,果实的受光环境会有所不同,光照因素的影响会导致果实表面颜色分布不均匀,造成照片中果实的色调、饱和度和对比度不同。

(3)落果分布的密集程度。在果园受灾后,由于不同区域果树的受灾程度不同,会出现不同程度的落果现象,地面会出现多个果实聚集成簇的现象,果实呈现点状、面状等多种分布方式,导致果实轮廓边缘出现粘连及遮挡等现象。

(4)拍摄高度。由于保险员之间的身高有一定的差异,且拍照习惯有所不同,会导致所拍摄影像的角度多样化,影像中果实之间存在不同程度的遮挡,轮廓信息会出现不同程度的缺失。

(5)拍摄距离。在地面苹果影像中,由于保险员的拍摄距离不同,不同的影像景深導致果实在影像中的比例不同,景深严重的区域会出现果实轮廓虚化和果实颜色不丰富等现象。

在模拟果园落果环境的试验中,本研究针对上述5种场景,采用智能手机拍摄的方式进行试验数据的采集(图1)。图1-a为在不同光照环境下,影像采集员在同一天的不同时间段内(13:00—14:00为强光照,16:00—17:00为弱光照)采集的不同光照条件下的地面苹果影像。图1-b中,影像采集员选取枯草、青草、茂密的杂草作为落果背景环境。图1-c在模拟果园受灾后不同程度的落果现象试验中,影像采集员对不同密集程度的地面苹果进行拍照(当出现3个以上果实聚集为多个簇时,将其定义为落果密集;当出现3个或者3个以下果实聚集为单个簇时,将其定义为落果稀疏)。图1-d中,在模拟不同拍摄高度的影响时,影像采集员选取不同的拍摄角度进行拍摄,主要选取站立拍摄、蹲伏拍摄2种拍摄手段。图1-e表示在多种环境下,拍摄者采用不同的拍摄距离采集得到的影像。

1.2 地面苹果影像的提取方法

本研究主要采用分水岭算法、Hough变换圆检测和深度学习模型3种方法对地面苹果影像进行提取,并进行对比研究,具体流程如图2所示。

1.2.1 Faster-RCNN深度学习网络模型 深度学习训练样本库主要参考VOC 2007数据集建立,将单张影像大小固定为500×375像素,图片格式为JPG。数据集分为训练数据集和测试数据集,共有 1 140 张影像。其中,训练数据集影像共计920张,包括多种环境因素影响下的果实数据。在制作标签的过程中,用LabelImg软件对地面果实进行人工标注。

本研究采用Faster-RCNN对地面苹果进行提取。Faster-RCNN是基于RCNN和Fast-RCNN模型改进的1种目标检测模型,舍弃了Selective Search(选择性搜索)方法的提取建议框,采用共享卷积网络生成建议区域(region proposalnetwork,简称RPN)。Faster-RCNN模型共有5个部分构成,分别是特征提取层、RPN建议层、Proposal层、Roi Pooling层、Softmax分类层(图3)。其中,RPN网络是在卷积神经网络提取的feature maps(特征图层)上进行操作的,通过获取目标物特征图片中的地面位置,并在每张图片上生成300个建议框,映射到卷积神经网络最后1层输出的feature maps上,其生成的建议框质量高、数量少,并且借助于GPU(图形处理器)强大的图片计算能力,极大地提高了目标检测的速度。

在深度学习模型训练中,笔者将采集的地面苹果训练数据集输入到Faster-RCNN模型中,先经过卷积网络进行特征图片的提取,再由RPN网络产生建议区域,用于果实特征的学习,然后由Roi Pooling层根据多个果实大小固定所需的建议框尺寸,最后由Faster-RCNN有选择性地对建议区域进行学习并完成目标分类检测工作。

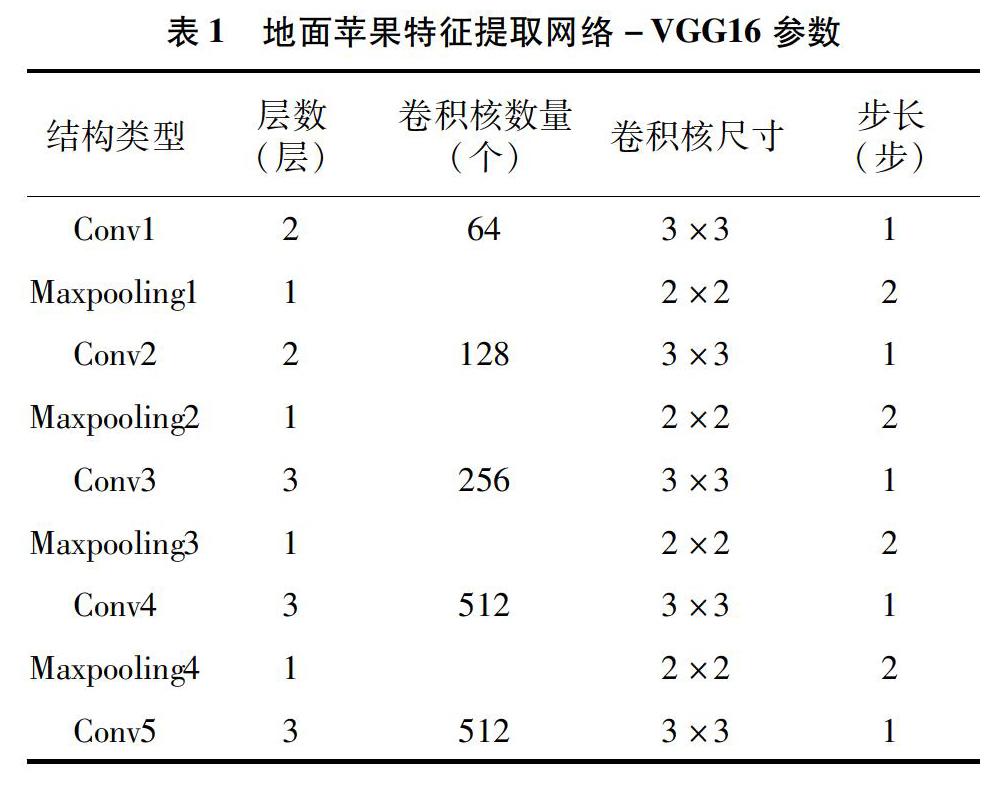

在本试验中,电脑硬件配置Intel酷睿i7处理器,搭载NVIDIA GeForce GTX1080ti显卡,内存为12 Gb,并在Ubuntu 14.04系统环境下,搭建Caffe框架。在模型训练过程中,选用大型的VGG16作为特征图片提取网络,VGG16相比于ZFNet和VGG_1024具有更深的网络,提取目标的显著特征更具有优势[27]。VGG16是由13层卷积层、13层Relu激活函数和4层池化层组成的深度网络,网络的深度决定了它能够学习图片中的多种深层次信息。本试验中的部分网络结构参数见表1。

1.2.2 分水岭算法和Hough(霍夫)变换方法 传统的果实检测方法主要是基于颜色空间和轮廓信息进行果实提取[2-6]。颜色空间是人的视觉系统直观判断目标物类型的基础,轮廓信息是我们对颜色空间筛选出的目标物大小、种类的更加准确的判断,两者相辅相成。

基于颜色空间的检测,果实颜色和纹理与背景环境具有较大差异,而分水岭算法[28]在分割目标物与背景中具有一定优势,因此本研究基于颜色空间,选用分水岭算法对地面果实进行分割提取。由于果实主要以近圆形形态为主,明显区别于地面的其他物体,而Hough变换在几何特征突出的物体检测中具有一定优势[29],所以本研究采用基于轮廓信息的Hough变换圆提取的方法进行地面果实的提取。

1.3 地面苹果识别精度的评价

本试验共选取220个测试数据集,分为5大类,共计11组数据,涵盖多种落果背景信息、不同光照度、果实分布密集与否、拍摄高度和拍摄距离等信息。其中单个测试数据中的苹果数量分别为10、12、20、35个,落果数量共计5 065个。

在地面苹果提取试验中,为了评估深度学习对原始影像中地面苹果检测的优势和有效性,统一采用原始影像进行地面果实的提取,并通过目视解译的方式判断影像中果实的实际数量,以识别精度(P)、实际识别精度(Pτ)、均方误差(MSE)作为评判依据,计算公式如下:

P=∑Ni=1 Di Ti ; (1)

Pt= 1 N ∑Ni=1 Di-FDi Ti ; (2)

MSE= 1 N ∑Ni=1 FDi+LDi Ti 。 (3)

式中:N为图片数量;FDi(falsedetection)为第i张图片中将其他目标错误识别为苹果的数量,个;LDi(leak detection)为第i张图片中未检测到的落果数量(个);Di(detection)为第i张图片中模型识别的落果数(个);Ti为第i张图片中实际的落果数量(个)。

2 结果与分析

2.1 3种方法对落果的识别结果

在本试验中,针对落果背景、光照度、落果分布密集与否、拍摄高度和拍摄距离等5种因素,采用Faster-RCNN法、分水岭法、Hough变换法等3种方法对地面苹果的落果进行提取。结合表2、图4的数据,对3种方法的识别结果进行对比可知,在多种复杂环境因素和人为因素影响下,深度学习Faster-RCNN模型在地面苹果数量提取中的识别精度达到95%,识别精度明显高于分水岭算法和Hough变换圆提取法;在单张影像的识别时间上,深度学习所需时间约为0.95 s,而用传统方法识别则需要 2~3 s,识别效率得到明显提升。

由表2、图4还可以看出,Faster-RCNN模型具有较大的优势,并且识别误差较小。其中,在用分水岭算法和Hough变换方法识别果实的过程中,原始影像未经过预处理(如去除果实表面阴影[30]、削减果实粘连[31]等),提取结果精度较低,而Faster-RCNN模型的图像同样没有经过预处理,但精度较高。已有研究表明,在经过预处理后的影像中,分水岭算法对桃的识别精度可达88.3%[8];Hough变换方法对番茄的识别精度可达77.6%[32]。

可以看出,传统的地面苹果检测结果与深度学习的识别结果差异较大。当拍摄高度较高、近景拍摄、果实分布稀疏且果实颜色信息突出时,传统方法能够准确地分割果实与背景,并进行果实标注,识别速度快、精度高,與深度学习的识别结果相当。但在多个果实聚集、光照分布不均匀、处于树木阴影区及远景拍摄的情况下,传统的果实识别方法存在部分果实无法识别、精度较低的现象,然而深度学习法在这些情况下都能够准确地识别各个果实,并进行果实标注,单个果实的识别率均高于80%,稳定性高。试验结果表明,在未经预处理的原始图像中,在背景因素、人为因素等多种因素的影响下,深度学习的识别结果均明显优于传统的识别结果(图5)。

在多个果实聚集区域,由于果实之间出现粘连,果实之间的颜色信息出现混合,分水岭算法难以对多个果实进行分割,导致出现漏判的现象;在影像中落果分布较远的区域以及多个果实密集分布的区域,由于果实轮廓虚化、果实轮廓信息交错及背景因素的影响,导致Hough变换圆检测方法的识别结果较差。在光照分布不均匀的区域和树木阴影区域,果实表面的颜色亮度出现变化,部分果实的轮廓出现虚化现象,并且传统的影像处理方法难以有效去除光照、阴影等因素的影响,导致果实的识别精度较低。

2.2 Faster-RCNN复杂场景下地面苹果的计数

本研究通过调整参数,选出最合适的参数对模型进行训练,并用训练后的模型对测试数据集进行检验。图6包括强光照射条件下、杂草背景下、裸土背景下及不同拍摄高度和距离条件下果实的检测结果。Faster -RCNN可以精准地提取出图片中每个苹果的影像,并且每张图片被判断为苹果的概率均在95%以上,具有较高的识别率。

由表3可以看出, 不同条件下深度学习模型对地面苹果识别精度的排序如下:青草>茂密杂草>枯草;强光照>弱光照;落果分散>落果集中;拍摄高度低<拍摄高度高;拍摄距离近>拍摄距离远。其中,青草背景下强光照、近距离拍摄、拍摄高度较高的落果较为分散时的识别和计数精度最高。

具体分析得出:(1)在青草背景环境中,由于果实与背景的颜色、纹理差异比较明显,所以苹果的识别精度明显高于枯草背景、茂密杂草背景,并且漏判数也最低。(2)在强光照条件下,由于光照度的影响,果实颜色、表面纹理信息与背景相比具有明显的差异,果实信息突出,所以识别率高于弱光条件下的识别率,并且识别误差也低于弱光条件下的识别误差。(3)落果分布密集会造成果实之间的距离近,并且具有不同程度的遮挡,从而增加了落果的识别难度,所以分布稀疏的落果识别精度比分布密集的识别精度高3.4%。(4)拍摄高度较低导致地面苹果之间产生不同程度的遮挡,由于拍摄高度高时,苹果之间的遮挡小,并且多数落果具有完整的轮廓信息,所以识别精度比蹲伏拍摄的识别精度高4.1%;当拍摄距离较低时,果实的漏判率相对较高,达到7.7%。(5)由于拍摄距离的影响,苹果在影像中的大小也发生明显变化,当拍摄距离较近时,果实的颜色、纹理、轮廓等信息比较完整,并且果实影像占像元的比例相对较高;当拍摄距离较远时,果实影像占像元的比例较低,并且由于背景信息和图片本身像素信息等因素的影响,增加了地面苹果的识别难度,易发生漏判、误判的情况,当拍摄距离较远时,漏判、误判的数量最多,总占比达到9.6%。

3 讨论

通过对比3种方法在复杂场景下对苹果影像的提取过程与结果发现,在复杂背景环境中,传统的方法识别精度低,主要原因一方面是未对原始影像进行预处理,另一方面可能是场景较复杂,难以满足地面苹果识别任务的需求,并且在识别过程中需要不断调整参数,影像处理过程比较繁琐。由于环境的复杂性和多样性影响,在批量识别测试样本中的落果时,传统方法难以满足各个影像所需的处理需求(去光、去噪等),导致识别困难、精度低。而传统的识别检测方法对原始图像处理较多,可能引起影像中的像素信息丢失,对落果识别也有一定程度的影响。深度学习Faster-RCNN模型,在人工建立的训练样本基础上进行背景与果实特征学习,能够得到不同姿态下的果实信息及不同的背景信息。利用卷积核滑动的方式处理单张影像,能够得到果实与背景之间的关联信息及果实与背景之间像元信息的差异,具有良好的泛化能力,检测结果的平均精度达到95%,单张影像对地面苹果的检测速度达到0.95 s/张,能够满足及时反馈处理结果的需求。通过对比Faster-RCNN在不同背景环境下的识别结果可以发现,果实轮廓信息的完整性和颜色的丰富性是使识别结果发生浮动的重要原因。在拍摄高度低、拍摄距离远及落果分布密集的条件下,由于枝叶遮挡、果实间互相遮挡、目标物相对较小等因素的影响,导致果实轮廓信息不完整,因此果实的识别精度较低;在弱光背景和拍摄距离远的环境下,由于果实的颜色信息不突出,使得识别结果的精度低于平均识别精度。

綜上所述,深度学习的检测精度优于传统方法的检测精度,适用于地面苹果的单果检测、多果检测及数量统计,但是深度学习模型的检测精度也受到多种环境因素和人为因素的影响。深度学习模型的精度受限于人为拍摄单张影像的质量及样本库的数量,由于训练样本集以单一类别的样本库为主,地物类别信息匮乏,导致模型训练所得先验知识不足,因此在部分环境下存在漏判、误判的现象。在今后的研究工作中,影像采集员应在拍摄环境光照充足、拍摄角度高等条件下采集影像,并将人工补光及拍摄支架作为重要的辅助手段,确保样本库影像的质量;在建立数据库样本时,应丰富果园地物类别信息,建立地物类别多样性、环境多样性、果实姿态多样性样本库;将完善的样本库应用于深度学习网络模型中,并将网络模型训练所得结果应用于真实果园的落果检测中,有望为提高农业果品定损、地面落果数量统计提供一定的技术参考,增强农业果品定损的公正性和科学性。

4 结论

在苹果灾损评估工作中,地面苹果是否得到准确识别与统计是确保保险理赔是否合理的重要依据。本研究对比了深度学习Faster-RCNN模型和传统方法对地面苹果进行检测计数的效果,得出以下结论:(1)在多种落果环境中,在多种复杂场景下地面苹果检测任务中,Faster-RCNN对地面苹果的平均识别精度达到95%以上,精度高于传统方法,更适合复杂场景地面苹果的提取;(2)在大样本数据处理中,深度学习批量处理影像的能力优于传统方法,具有较强的鲁棒性和泛化性,多个场景下的识别精度均高于90%,深度学习模型对单张影像的处理速度优于传统的地面苹果提取方法,从而为农业果品保险中地面苹果的数量统计提供了一定的技术参考。

参考文献:

[1]国家统计局.中国统计年鉴[M]. 北京:中国统计出版社,2017.

[2]李云国,蔡兆翔,马 静,等. 昭通高原苹果产业发展现状及可持续发展对策研究[J]. 云南农业大学学报(社会科学版),2015,9(5):69-73.

[3]李 莎,钱建平,赵春江,等. 不同颜色模型识别成熟苹果图像的比较分析[J]. 计算机工程与设计,2015,36(6):1545-1550.

[4]Guo A X,Zou X J,Zhu M S,et al. Color feature analysis and recognition for litchi fruits and their main fruit bearing branch based on exploratory analysis[J]. Transactions of the Chinese Society of Agricultural Engineering,2013,29(4):191-198.

[5]马正华,吕小俊,徐黎明,等. 近色背景果实识别的多源图像配准[J]. 计算机工程与设计,2018,39 (11):3494-3499.

[6]许 凯. 基于图像识别的苹果果实检测技术[J]. 实验室研究与探索,2016,35(10):36-39.

[7]陈礼鹏,穆龙涛,刘浩洲,等. 基于猕猴桃果萼图像的多目标果实识别方法[J]. 计算机工程与设计,2018,39(6):1738-1744.

[8]黄小玉,李光林,马 驰,等. 基于改进判别区域特征融合算法的近色背景绿色桃子识别[J]. 农业工程学报,2018,34(23):142-148.

[9]Jun L,Suk L W,Hao G,et al. Immature citrus fruit detection based on local binary pattern feature and hierarchical contour analysis[J]. Biosystems Engineering,2018,171:78-90.

[10]Thendral R,Suhasini A,Senthil N. A comparative analysis of edge and color based segmentation for orange fruit recognition[C]//IEEE. International Conference on Communications & Signal Processing,2014:463-466.

[11]Zawbaa H M,Abbass M,Hazman M,et al. Automatic fruit image recognition system based on shape and color features[C]// International Conference on Advanced Machine Learning Technologies and Applications. Springer,Cham,2014:278-290.

[12]García-Lamont F,Cervantes J,Ruiz S,et al. Color characterization comparison for machine vision-based fruit recognition[C]//International Conference on Intelligent Computing. Springer,Cham,2015:258-270.

[13]Jana S,Basak S,Parekh R. Automatic fruit recognition from natural images using color and texture features[C]// IEEE. 2017 Devices for Integrated Circuit,2017:620-624.