基于深度学习的农业区土地利用无人机监测分类

2019-10-09田琳静宋文龙卢奕竹李焕新

田琳静,宋文龙,卢奕竹,吕 娟,李焕新,陈 静

(1.首都师范大学 资源环境与旅游学院,北京 100048;2.中国水利水电科学研究院 水利部防洪抗旱减灾工程技术研究中心,北京 100038;3.渭南市东雷二期抽黄工程管理局,陕西 渭南 714000)

1 研究背景

农业干旱较为复杂,同时涉及地上气象-水文通量(如降水、灌溉、蒸散发等)和地下水文通量(如土壤水),并且农业干旱情势与影响因作物类型及其生长发育阶段等而异[1-6]。农业区土地利用快速监测与分类对农业旱情与旱灾监测评估具有重要意义,有助于制定合理的抗旱减灾应对措施,并为政府部门制定规划、土地资源管理、生态环境保护规划与决策提供了重要的基础数据[7-8]。

近些年无人机(Unmanned Aerial Vehicle,简称UAV)低空遥感技术快速发展,具有云下作业、机动灵活、数据分辨率高等优势,能够弥补卫星遥感影像获取能力的不足,在高分辨率遥感影像快速获取与应急方面优势日益突出[9-10]。基于卫星遥感的土地利用分类研究较为成熟[11-16],传统的分类方法主要包括监督分类、非监督分类、面向对象分类等。非监督分类操作简单,人为干预少,但分类精度较低。监督分类需要对分类地区有一定的先验知识,利用样本区干预分类类别及结果,通过提高样本区的质量来提高分类精度。这两种分类方法都是基于像元进行分类,存在“椒盐”现象[17]。而面向对象分类方法能够有效的减少基于像元分类出现的“椒盐”噪声现象,但其对图像的特征提取不够全面[18-20]。近年来,源于人工神经网络的深度学习方法,作为机器学习的一个研究新领域受到社会广泛关注,具有利用多层非线性的网络结构从大量数据中学习数据本质特征的能力[21-25]。其中,卷积神经网络深度学习方法具有较强的分层学习特征能力,在语音识别、视觉识别以及图像分类等方面表现出独特优势[26-29]。杜敬[30]利用深度学习方法,结合无人机影像进行水体提取;王术波等[31]对杂草进行分类;金永涛等[32]利用深度学习结合面向对象方法对典型地物进行提取,其提取精度较理想。

本文面向无人机技术在高分辨率下垫面信息快速获取方面的优势,利用卷积神经网络深度学习方法开展农业区土地利用分类研究,主要通过建立样本库、利用样本库训练卷积神经网络模型以及图像分类等步骤实施,并与最大似然法比较,利用随机选取的样本点对二者进行精度评价,并结合视觉评估验证该方法的可行性。

2 研究区与数据源

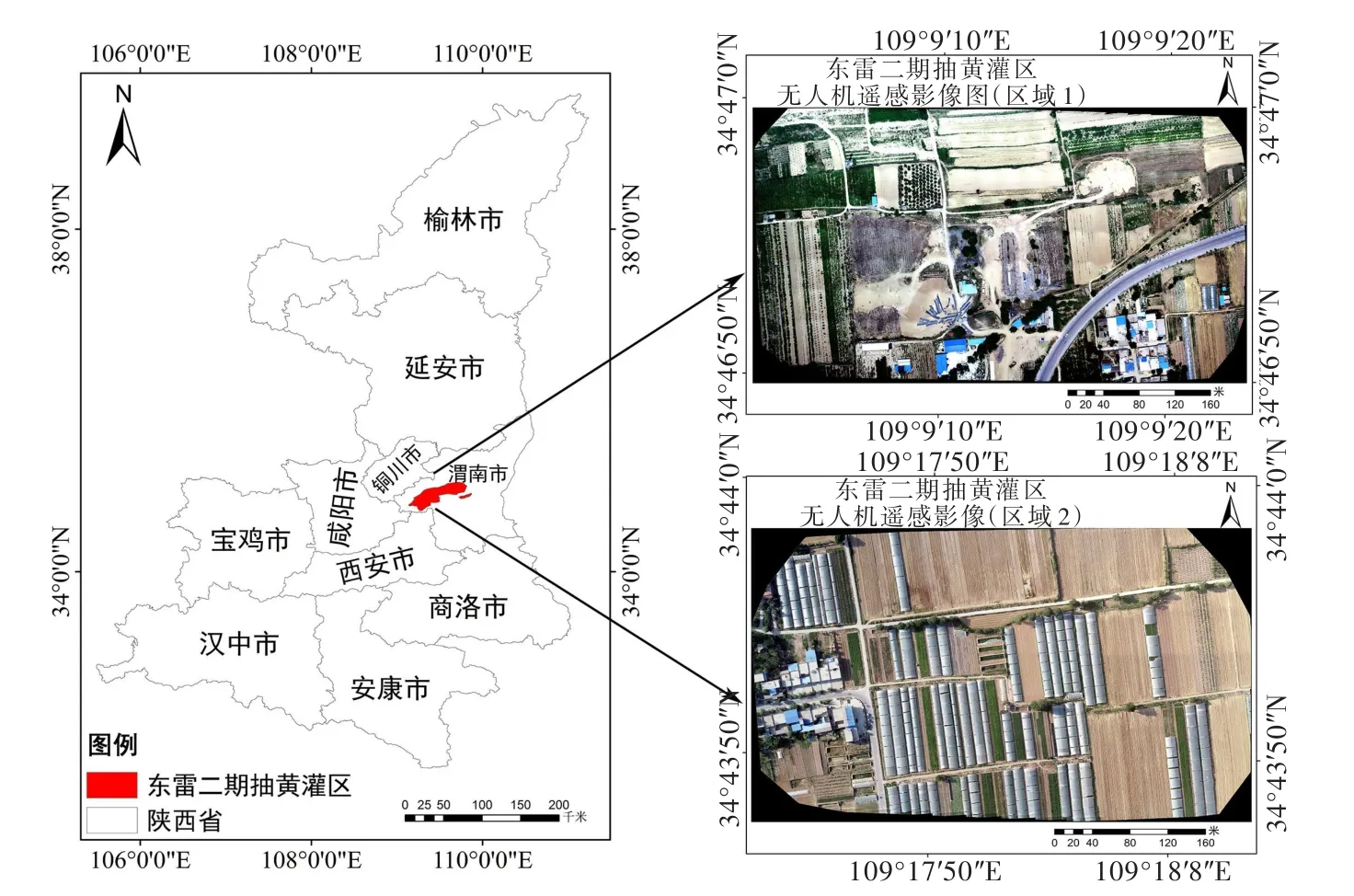

2.1 研究区选取东雷二期抽黄灌区中具有代表性下垫面的两个典型区域作为研究区(见图1),区域1、区域2总面积分别为1 333 099.33m2、168 698.41m2。东雷二期灌区地处陕西省关中东部旱塬地区,位于东经109°10′~110°10′、北纬34°41′~35°00′之间,地势由西北向东南倾斜,海拔385 ~ 600 m,总面积1469.81 km2。该地区干湿季分明,年平均降水量519~552 mm,年蒸发量1700~2000 mm。主要农作物为冬小麦、夏玉米,经济作物为水果、蔬菜等。其中,冬小麦生长周期为10月至次年6月中旬,夏玉米生长周期为6月下旬至10月,蔬菜主要采用大棚种植。

图1 东雷二期抽黄灌区典型区域航飞图(区域1和区域2)

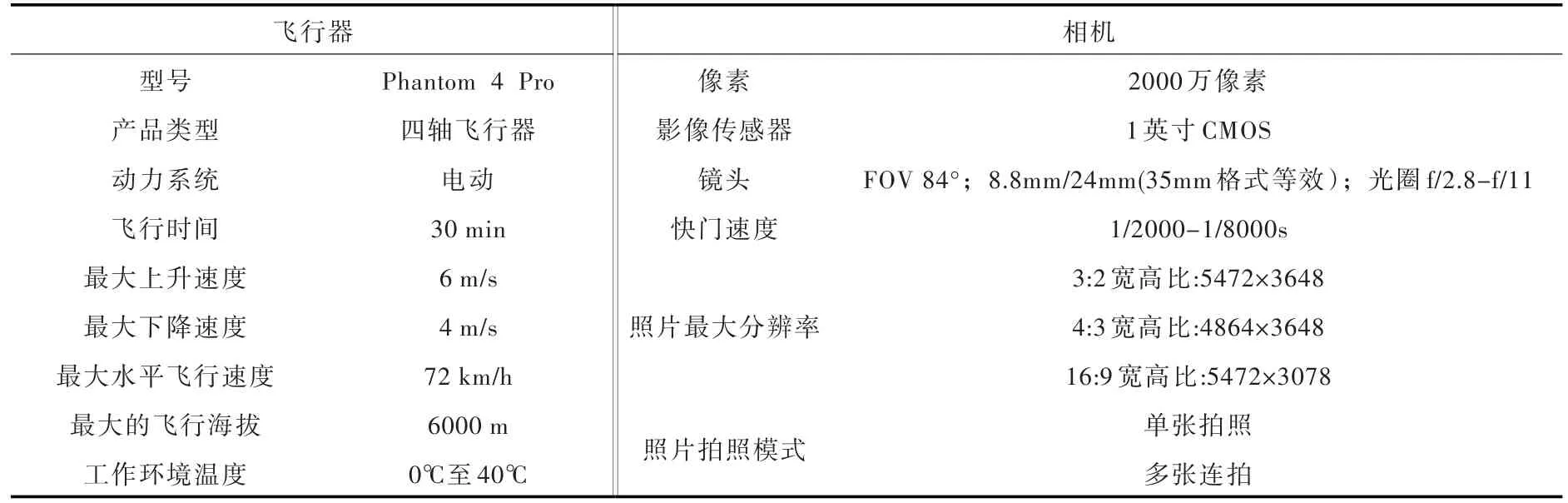

2.2 数据源研究区无人机航片利用大疆精灵phantom 4 Pro无人机搭载全色相机航拍获得,无人机和相机主要参数参见表1。以2018年6月15日东雷二期抽黄灌区区域1和区域2两个区域的无人机全色航片为数据源,其飞行高度为200 m,每张航片尺寸为5472×3648像素,空间分辨率5.45 cm,采用由中国水利水电科学研究院与北京易测天地科技有限公司联合研发、具有独立知识产权的无人机航片智能处理软件(YC-mapper)系统,对无人机航片进行校正、拼接等预处理,该软件无需人工干预,可快速完成空三解算、DEM生成、正射影像拼接等一系列任务。

表1 大疆精灵phantom 4 Pro无人机及其相机主要参数

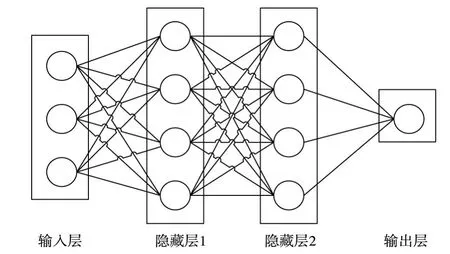

3 基于深度学习的土地利用分类方法

3.1 深度学习原理深度学习是机器学习领域一个新的研究方向,其主要利用多层非线性结构,由低到高逐层提取数据特征,并利用其特征训练模型,从对数据信息进行预测及识别。如图2所示,深度学习模型是由输入层、隐藏层(一层或多层)和输出层等多层感知器组成。典型的深度学习模型有层叠自动去燥编码机(Stacked Deoising Autoencoder,SDA)、深度置信网络(Deep Belief Network,DBN)和卷积神经网络(Convolutional Neural Network,CNN)等[30,33]。

图2 深度学习网络模型

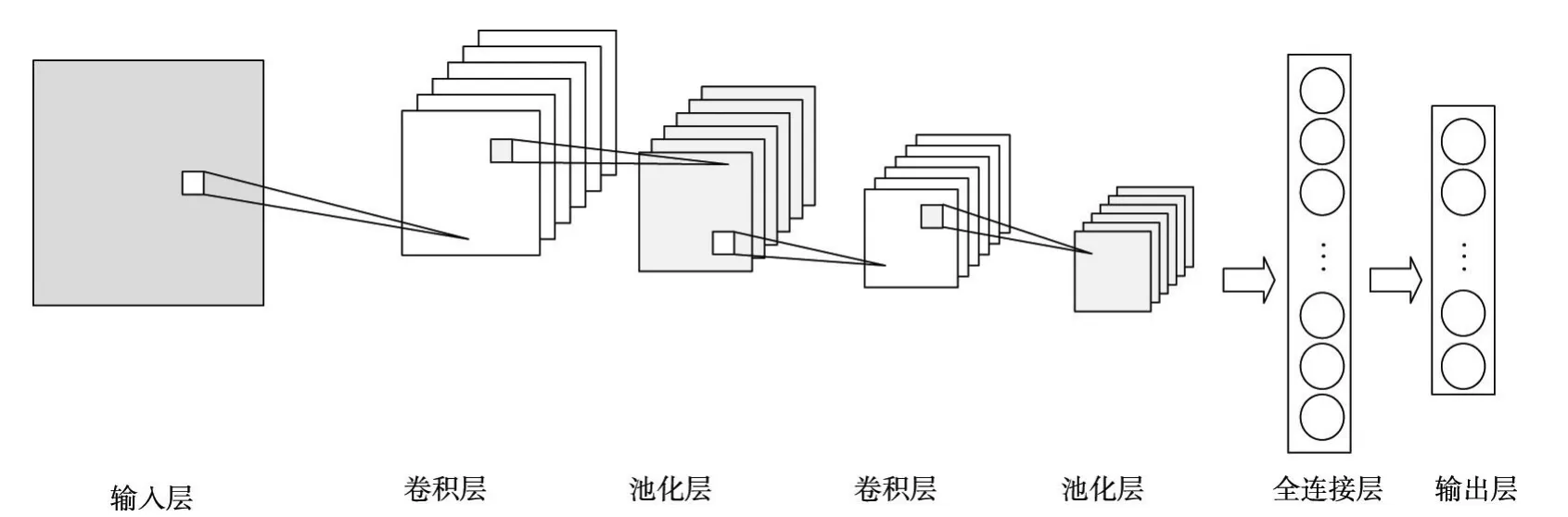

其中,CNN在语音识别、视觉识别以及图像分类等方面应用广泛,并表现出独特的优势[34]。CNN是一种前馈式多层神经网络,其具有局部连接的结构,权重共享的特点,并有较强的分层学习特征能力。CNN的基本结构主要包括输入层、卷积层、池化层(子采样层)、全连接层以及输出层五个部分(见图3)。一个CNN结构中至少存在一个卷积层,并且卷积层与池化层是成对出现的,即一个卷积层后面紧跟一个池化层,共同构成特征提取器[35]。

图3 卷积神经网络结构

卷积层是CNN网络结构的核心部分,主要作用是从样本数据中提取样本数据特征,并利用这些特征作为滤波器,对整幅影像进行卷积运算,最终获得整幅影像每个位置不同特征的激活值[31]。其计算公式为

式中:为卷积层n的第j个特征图;f为激活函数;Mi为选择输入特征图;为卷积层n-1的第i个特征图;*为卷积操作;kij为上一卷积层第i个特征图与本卷积层第j个特征图之间的卷积核;为卷积层n的偏置值。

池化层是对图像局部区域不同位置的特征进行聚类统计运算,以减少训练分类器的计算量,避免过拟合现象的发生。其计算公式为:

式中,f为激活函数;为子采样系数;down()为子采样函数;为子采样层n-1的第j个特征图;为子采样层n的偏置值。

卷积层与池化层组成的提取器所提取的是局部特征,全连接层的作用在于将提取的局部特征进行优化,通过权值矩阵获得全局特征,以减少特征数量提高计算速度。其计算公式为

式中,f为激活函数;wn为全连接网络的权重系数;xn-1为上一层的特征图;bn为全连接层n的偏置值。

CNN本质是构建输入与输出的一种映射关系,根据输入层的数据由低到高逐层提取特征,从而构建一个从低级到高级特征的映射。在这个过程中,不需要具体的数学公式计算,只需要用已知的样本数据对CNN进行训练,从而构建出具有输入输出能力的网络[23]。本研究采用CNN深度学习方法对目标地物进行提取。

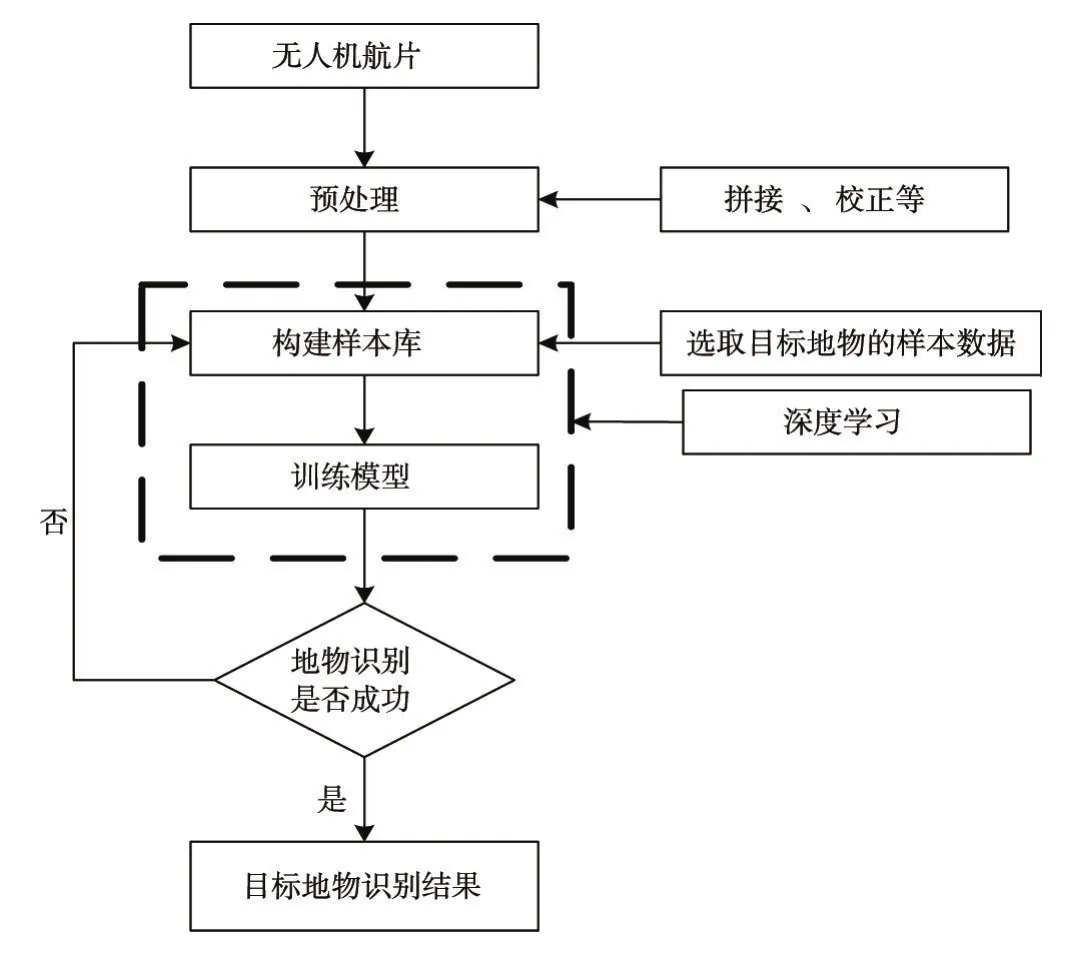

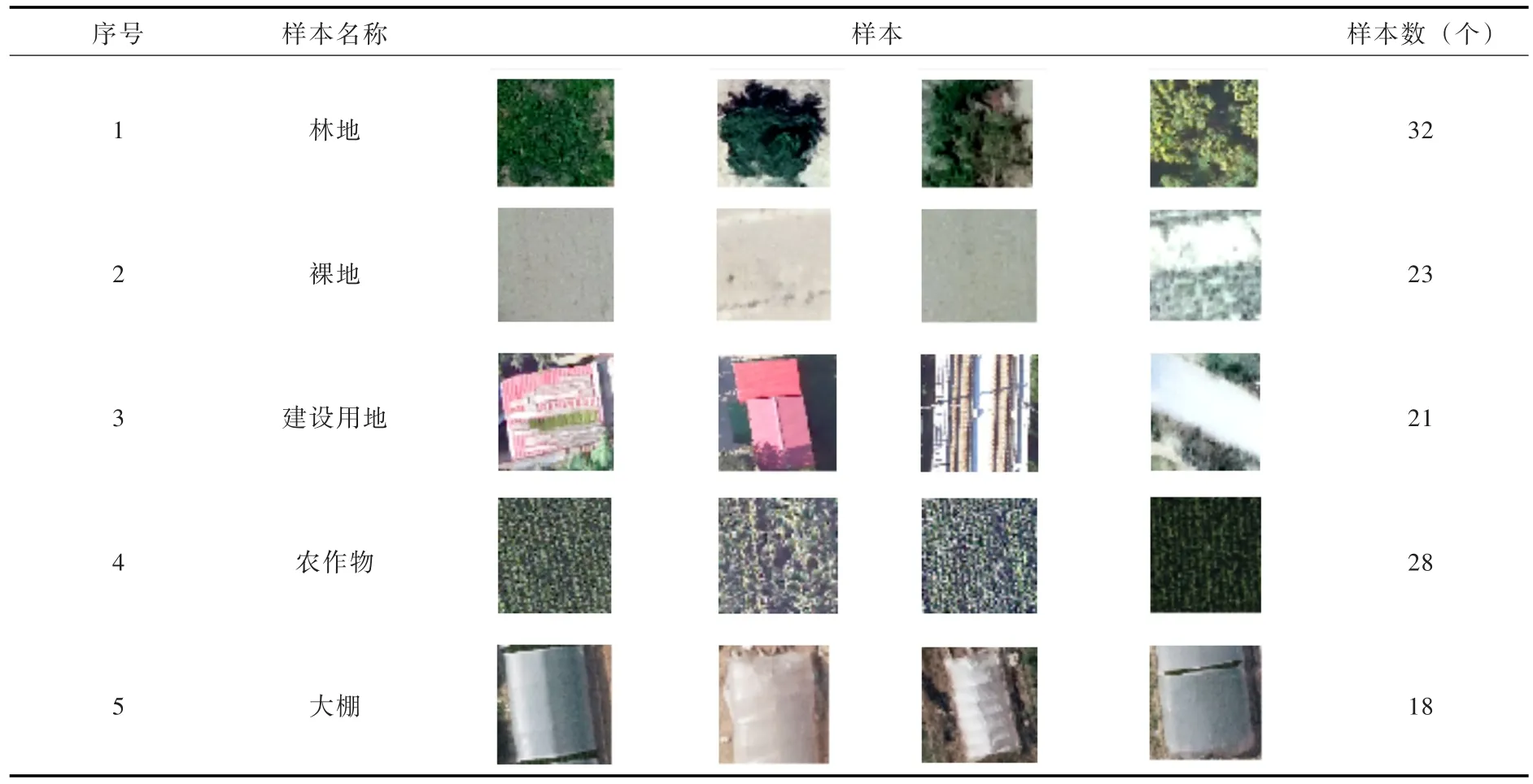

3.2 深度学习基本流程采用CNN深度学习方法,基于高空间分辨率的无人机遥感影像,对农业区土地利用进行分类,基本流程如图4所示。在通过深度学习方法对特定的目标地物进行识别时,首先需要建立目标地物的样本库,样本库构建的质量直接影响利用深度学习识别目标地物的精度。因此,在建立样本库时,每类地物的样本库应该选取包含该类地物各种形态的面状样本数据,并且尽量保证每类样本库都是“较纯”样本库,即每类样本库内只存在本类样本,不掺杂其他类型的样本,以防止给模型的构建以及训练带来干扰,影响分类结果。研究区土地利用分类的样本库构建如表2所示,样本类型主要包括林地、裸地、建设用地、农作物以及大棚等,其中建设用地包括建筑物和道路等,裸地包括收割后未种植的耕地。然后利用构建的样本库训练模型,进而利用训练好的模型对研究区域进行土地利用分类,最终对分类结果进行精度评价。

图4 基于深度学习和无人机遥感影像识别目标地物的流程图

4 结果分析

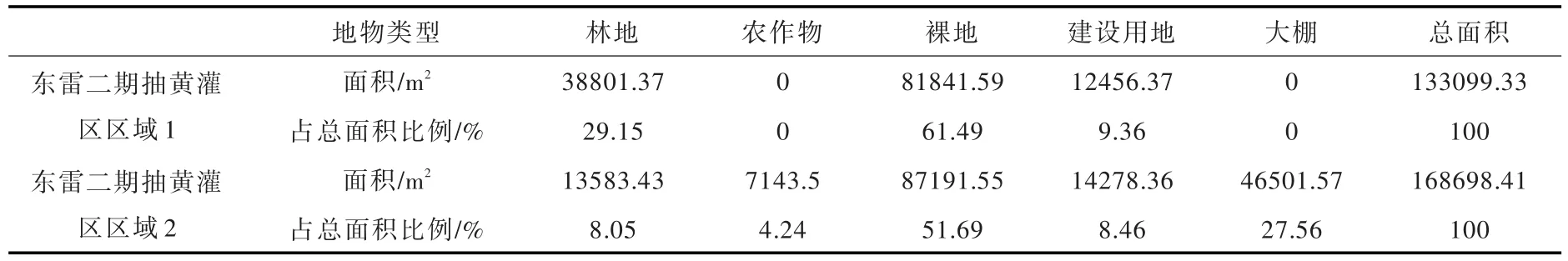

4.1 土地利用分类结果根据研究区下垫面类型特征,东雷二期抽黄灌区研究区域1面积为133 099.33 m2,土地利用分类主要包括林地、裸地、建设用地三类,研究区域2面积为168 698.41 m2,土地利用分类主要包括林地、农作物、裸地、大棚、建设用地五类,分类结果如图5和表3所示。因试验区为农作物种植区,主要土地利用类型以农用地为主,包括裸地(收割后未种植耕地)、大棚、生长中的农作物等,建设用地、林地占比较少。两个实验区内,裸地(收割后未种植耕地)所占比例最大,分别占试验区总面积的61.49%和51.69%,主要原因是无人机航拍时间为6月15日,冬小麦刚收割,大部分耕地未种植或已种植作物但并未长出。区域1中林地占比较大,约为29.15%;区域2中大棚占比较大,约为27.56%。

表2 目标地物样本库

图5 基于深度学习的土地利用分类结果

表3 土地利用各类型所占面积及比例

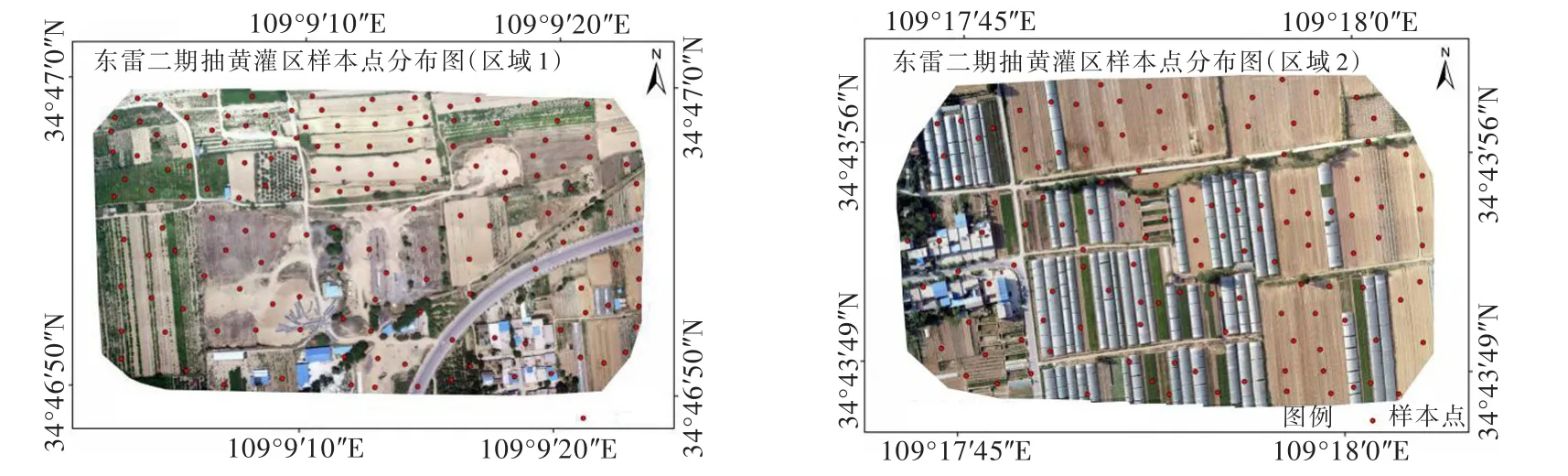

4.2 精度验证与分析利用基于最大似然法的监督分类方法与本方法进行对比。基于最大似然法的分类结果如图6所示,并采用随机抽样方法,分别在每个研究区域影像上以均匀分布的原则选择158个样本点,用于评价两种方法的分类精度,样本点分布情况如图7所示。精度结果显示,基于深度学习的土地利用分类,区域1总体精度为93.04%,Kappa系数为0.90;区域2总体精度为93.04%,Kap-pa系数为0.91。基于最大似然法的监督分类,区域1总体精度81.65%,Kappa系数为0.73;区域2总体精度为70.26%,Kappa系数为0.62。

图7 东雷二期抽黄灌区(区域1、区域2)样本点分布图

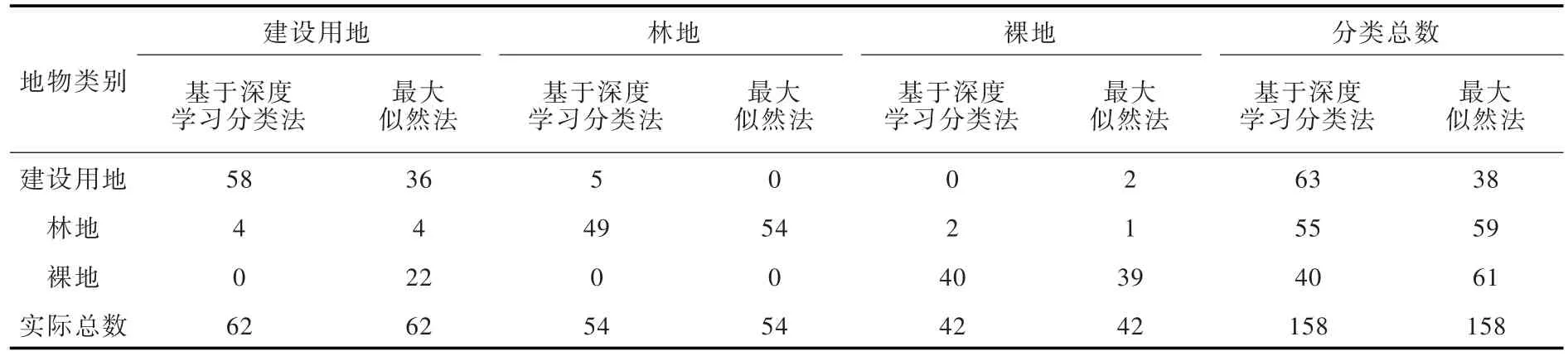

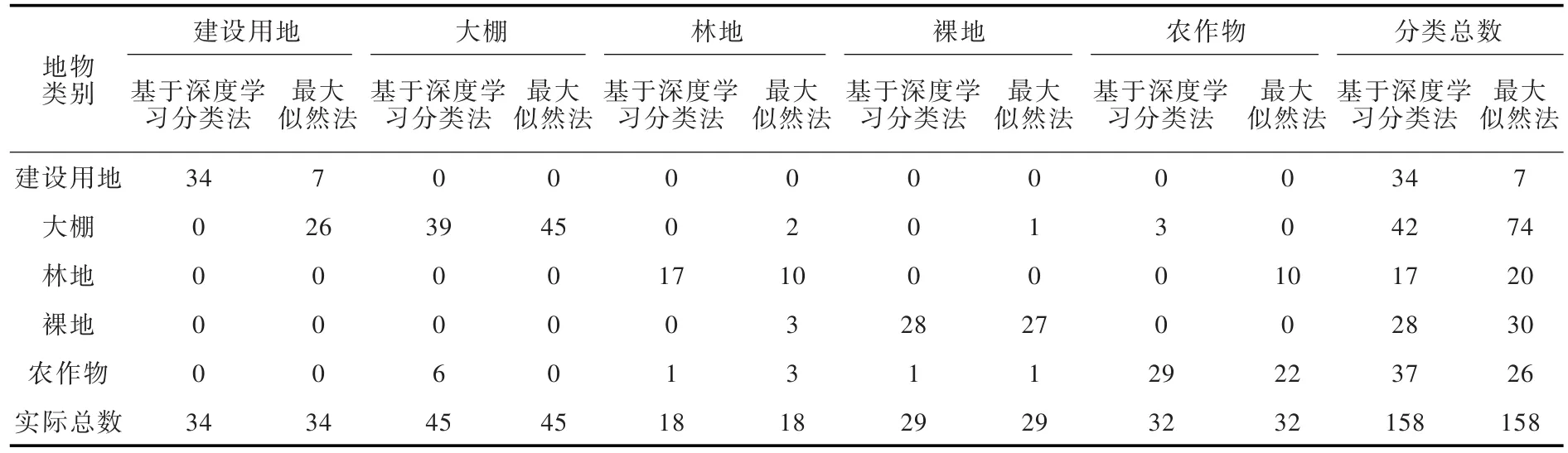

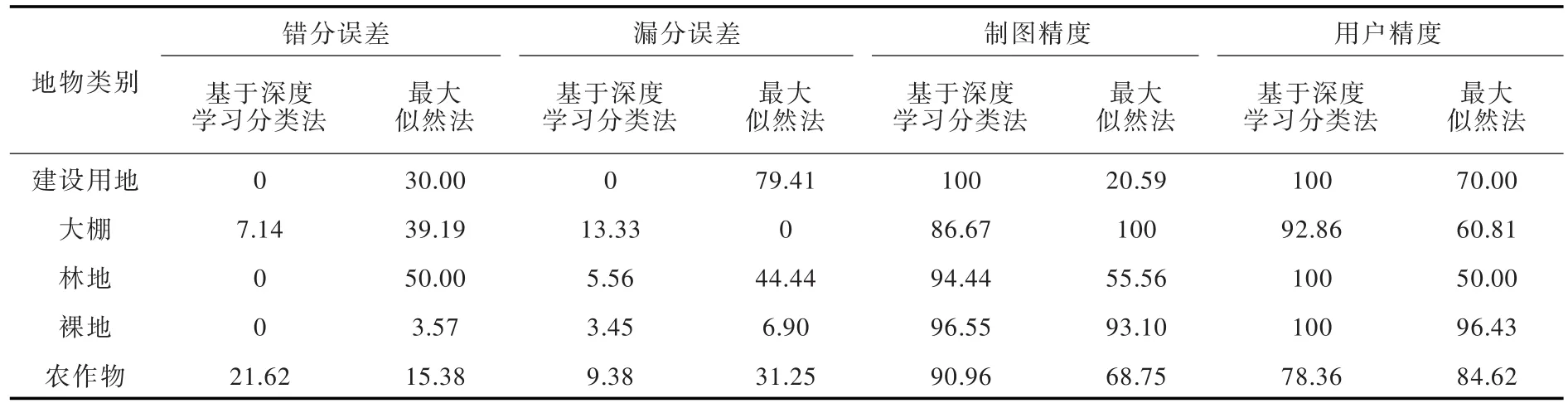

如表4—表7所示,在土地利用分类的混淆矩阵中可以看出,影像中林地、农作物这两类在颜色、纹理等特征上存在极大的相似性,难以完全有效区分开。建筑物附近存在大量的树木,且建筑物类型复杂,增大了分类难度,与林地间也存在部分混分现象。基于深度学习的土地利用分类效果较为理想,少数样本点存在错分漏分现象。区域1中,错分误差低至10.91%,漏分误差低至9.26%,制图精度达到90.74%,用户精度达到89.09%。区域2中,错分误差低至21.62%,漏分误差低至13.33%,制图精度为86.67%,用户精度为78.36%。由于区域2比区域1中分类类别多,其分类精度略低于区域1的分类精度。而基于最大似然法的土地利用分类结果错分漏分现象较为严重,其中,建设用地错分为裸地、大棚的比例较高,林地与农作物两类混分现象较严重。区域1中,错分误差高达36.07%,漏分误差高达41.94%,制图精度低至58.06%,用户精度达到63.93%。区域2中,错分误差高达50.00%,漏分误差高达79.41%,制图精度为20.59%,用户精度为50.00%。基于深度学习的土地利用分类结果优于最大似然法的土地利用分类方法,尤其在分类类别较多的情况下优势更加明显。

表4 东雷二期抽黄灌区区域1土地利用分类混淆矩阵(个)

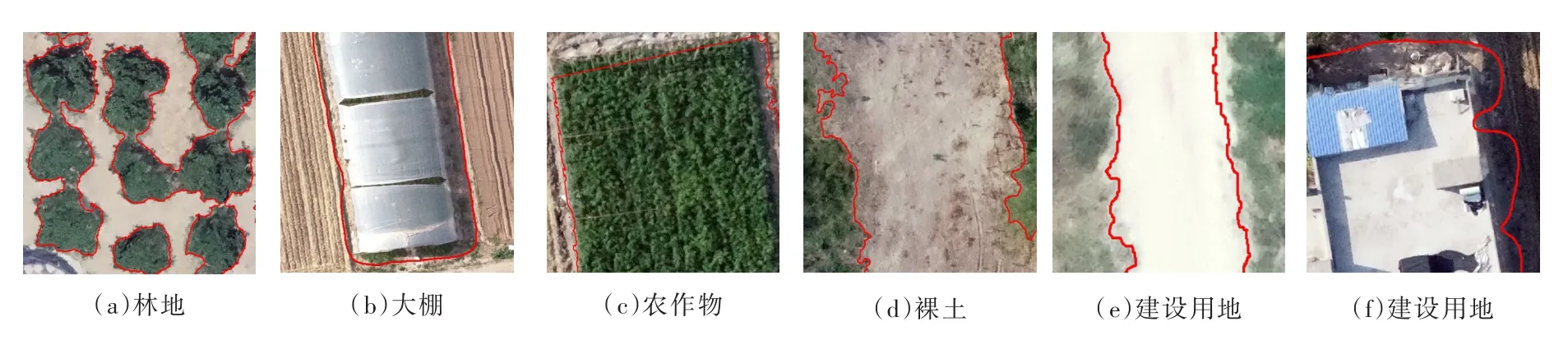

基于较高空间分辨率无人机航片与深度学习方法的农业区土地利用分类,在地物边界识别方面具有明显优势,如图8所示,林地、农作物、裸地的边界能够被清晰地识别并提取出来。但由于受阴影的影响,大棚和建设用地的边界提取存在一定的误差。

表5 东雷二期抽黄灌区区域1土地利用错分误差、漏分误差、制图精度与用户精度(%)

表6 东雷二期抽黄灌区区域2土地利用分类混淆矩阵(个)

表7 东雷二期抽黄灌区区域2土地利用错分误差、漏分误差、制图精度与用户精度(%)

图8 边界识别提取

5 结论

本文以东雷二期抽黄灌区具有下垫面代表性的小区域为研究区,利用深度学习方法,针对较高空间分辨率的无人机航片影像,开展了农业区土地利用监测分类研究,并利用基于最大似然法的监督分类方法进行对比,探究该方法对于农业区土地利用监测分类的适用性。主要结论如下:

(1)研究区的土地利用分类总体精度达到93%以上,Kappa系数为0.9以上,错分误差低至21.62%,漏分误差低至13.33%,制图精度达到86.67%以上,用户精度达到78.36%以上。错分误差较大和用户精度较低的类型为农作物,漏分误差较高和制图精度较差的类型为大棚。并该方法的分类精度明显优于最大似然法,尤其在分类类别较多的情况下优势更加明显。

(2)利用CNN深度学习方法对较高空间分辨率的无人机航片影像进行土地利用分类,能够更清晰地识别提取出地物边界,如林地、农作物以及裸地,但由于受阴影的影响,大棚和建设用地的边界提取存在一定的误差;林地与农作物间,林地与建设用地间,由于颜色、纹理等特征相似性,存在混分现象;进一步提高分类精度是未来该领域的研究方向之一。