基于时空上下文的多目标跟踪算法

2019-08-10位宝燕杨绍清刘松涛

位宝燕 杨绍清 刘松涛

摘要:在多目标跟踪中,目标尺度变化和姿态变化容易导致目标丢失,本文将时空上下文视觉(STC)单目标跟踪算法应用于多目标跟踪,该算法通过构造各目标和其上下文区域的时空关系模型,计算置信图得到下一帧图像的目标位置,并且对窗口大小进行自适应变换,当目标发生旋转等姿态变化或者尺度变化时,窗口可以根据目标变化而变化。实验结果表明,该算法能够准确跟踪多个运动目标,并在目标姿态或者尺度变化时能够自适应的检测出目标变化,并稳定跟踪目标。

关键词:多目标图像跟踪;时空上下文;自适应窗口;尺度变化

中图分类号 TP391.4 文献标识码 A

文章编号:1009-3044(2019)17-0207-04

开放科学(资源服务)标识码(OSID):

目标跟踪是计算机视觉的重要研究领域之一,目标跟踪的本质是将非平稳的、随时间变化的目标和背景图像流进行处理,提取出图像流中目标的信息[1]。在视频序列中如何实现对目标进行稳健、实时跟踪,是计算机视觉领域的热点问题[2]。其中,多目标跟踪无论在军事还是民用方面尤其重视。如军事弹道导弹防御、空中预警、空中多目标攻击,海洋预警(水面舰艇或潜艇),民用方面的交通监控或者空中飞机管制,医疗诊断等。

目前,经过近年来的深入研究与发展,多目标跟踪技术取得了很大的进步,但是由于监控设备距离目标较远、多目标在运动过程发生姿态变化或者尺度变化,监控场景太过复杂等都导致无法稳定跟踪多个目标,上述难题一直无法被克服。

多目标跟踪即确定图像序列中的各个目标的位置坐标,大致可以分为两类方法:基于目标表示的方法和基于目标定位的方法。Jepson等人提出了基于纹理特征的自适应表观模型[3],然而当目标发生尺度变化或者被遮挡时,无法精确地跟踪目标;Avidan结合光流法与支持向量机算法用于跟踪车辆[4],使用Boosting分类器跟踪运动目标,但是随着分类器训练中误差积累使分类器易发生漂移。在基于目标定位的算法中,基于Meanshift的跟踪算法较为典型,然而Meanshift算法[5]适用于目标外观不变的场景;也可以将目标跟踪问题转化为贝叶斯滤波理论框架下的预测目标状态概率问题,一般使用Kalman滤波对目标在下一帧的位置进行预测,当噪声为非高斯分布时,可以使用粒子滤波[6]预测目标在下一时刻的位置,但是当目标发生姿态变化时仍不能获得很好的跟踪效果。近几年研究发现跟踪时目标的上下文信息(周围环境)与目标之间存着密切的相关性,所以很多研究者开始研究如何运用这种相关性对目标进行跟踪。文献[7-9]中利用上下文信息对目标进行跟踪,跟踪效果好。Yang和Wu等人[10]充分利用目标上下文区域的空间关系有效地解决了目标的遮挡问题。张开华等人[11]融合了贝叶斯框架和相关滤波将时空上下文算法改进地更完善,但是该算法对目标尺度和姿态变化时性能欠佳。

综上所述,本文将时空上下文视觉(STC)单目标跟踪算法[12]应用于多目标跟踪,构建了各目标及其上下文区域的时空关系模型,计算置信图得到下一帧图像的目标位置,运算速度快,并且对窗口大小能够进行自适应变换,当目标发生旋转等姿态变化或者尺度变化时,窗口可以根据目标变化而变化。实验结果表明,本文算法可以有效地解决多目标跟踪时姿态变化或者尺度变化等复杂问题,能够实时、准确、鲁棒地跟踪多个目标。

1 自适应窗口调整的时空上下文

时空上下文(STC)是一种基于贝叶斯框架下的快速跟踪算法,利用目标周围区域的时间信息和空间信息确定目标位置[13]。时间信息指的是连续帧间目标本身所能够提供的位置、速度、尺度姿态等信息的传递,空间信息指的是目标和上下文区域内的背景之间的某种相关性,当目标变化时,空间信息可以区分目标和干扰背景。

1.1 STC算法公式化表示

贝叶斯框架下的目标跟踪关键是得到后验概率函数,也就是计算一个估计目标位置的似然函数置信图。

式中,[X=R2]是目标的位置区域,[o]是目标在场景中出现的情况,[X*∈X]是目标区域的中心点,[XC=I(Z),Z|Z∈ΩCX*]为上下文区域的特征表示,[IZ]表示位置Z点的像素灰度值,[ΩCX*]是中心位置[X*]的空间上下文区域。如图1所示。

1.2 目标模型的建立

1.2.1空间上下文模型

式(1)中,条件概率[Px|c(z),o]表示的是目标中心位置和上下文区域的空间信息,具体定义为:

式中,[hscx-z]是對目标中心位置[X*]和上下文区域内任意点Z间的相对距离和方向的统计,该函数是非径向对称函数,即[hscx-z≠hscx-z],因此可分辨出周围相似物体,不易混淆。

1.2.2上下文先验模型

式(1)中,[P(c(z)|o)]表示的是先验概率,具体定义为:

式中,[Iz]是点Z的灰度值,用以描述目标上下文区域Z的特征。[ω]是一个加权函数,[a]是归一化参数,取值为[0,1],[σ]是一个尺度参数,[σ2]为高斯函数方差,[ωσz-X*]是区域中心的加权高斯函数。

1.2.3置信图

该算法中本质是求出目标的置信图,但是我们需要对目标进行初始化。在给定目标的位置[X*]的基础上,我们通过下列公式来计算得到上下文区域任何一点X的似然得到的。目标位置的置信图模型由式(5)表示。

1.2.4快速学习空间上下文模型

基于置信图函数式(5)和上下文先验概率模型(3),快速学习得到空间上下文模型[Px|c(z),o],式(1)可表示为:

在离散状态下,时域内求积分的过程可以卷积转化为频域下的点积操作,并结合着快速傅立叶变换算法,可以提高计算速度,节省运算时间。因此式(6)经过快速傅立叶变换(FFT)算法加速后,得:

1.2.5位置的确定

目标跟踪其实是一个检索的过程。手动标记第一帧图像中各目标,则在第t帧通过式(7)可以学习得到第t+1帧的各目标空间上下文模型[htsc(x)]。该模型我们可以用来检测第t+1帧的目标位置,得到时空上下文模型后,我们就可以在新的一帧图像中计算目标的置信图[cx]:

则新一帧各目标的位置[X*]即为置信图中的最大概率点相对应的位置。

1.3 目标模型的更新

目标在跟踪过程中外观、尺度、光照等都在发生着变化,如果当前的模型只含有初始的目标样本信息,当目标变化较大时,容易导致目标丢失。因此需要更新目标模板以适应目标的变化。但是,若更新目标模型过快,误差积累较快,容易产生漂移现象。在本算法中的模型更新策略是对时空上下文模型进行更新:

1.4 自适应窗口调整

在应用场景中,場景和目标都存在着动态性,随着距离的变化,目标的尺度也时刻在发生着变化,或随着目标姿态的变化,尺度也会发生变化,所以跟踪窗口的大小在跟踪过程中非常重要,如果跟踪窗口太小或太大真实目标会消失。为解决此问题,本文利用相似度反馈对目标尺度进行更新。

首先计算新一帧图像目标位置与目标模板之间的归一化距离[ρ]:

如果[ρ]大于预定义的阈值[e],则以不同的比例(即相机缩放或目标进场/离开)搜索目标。在这种情况下,通过增加或减少目标模板大小来对目标尺寸进行更新。通过这种方式,将以目标模板的每个像素为中心的不同缩放矩形作为候选区域。通过将前一帧的目标模板的尺寸乘以比例系数[κ]来确定不同缩放长方形的尺寸。跟踪器包含两个收缩和两个增长比例系数。通过这种方式,使用四种不同的尺度在[Ω]内搜索目标,考虑目标尺寸在正方向和负方向上的变化。这种方法基于蒙特卡罗的目标更新策略[14]。将当前导致最大概率点的候选区域选择为下一帧的目标区域。

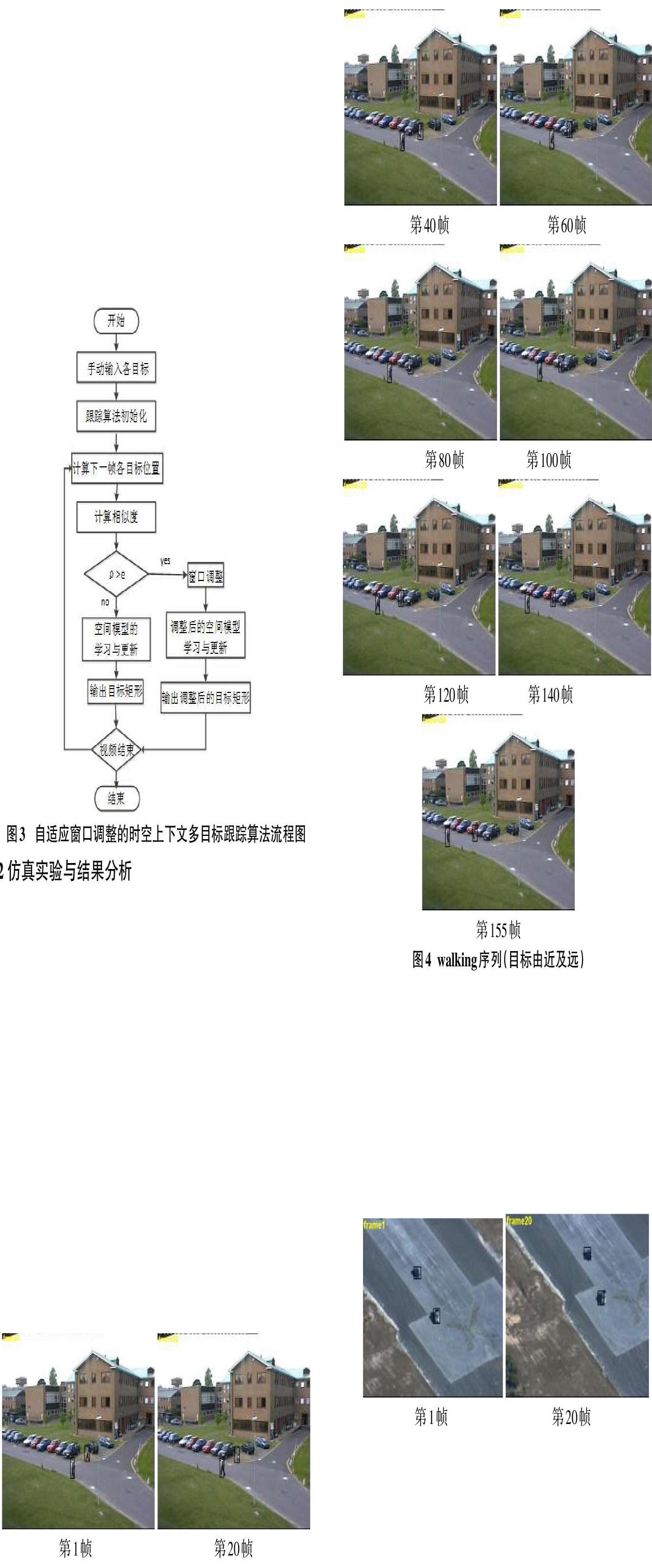

综上,可以得出自适应窗口调整的时空上下文多目标跟踪算法的整体流程图如图3所示。

2 仿真实验与结果分析

本文算法可实现手动框选多目标的实时跟踪,仿真环境为Matlab语言,分别对两个、三个等多目标进行跟踪,利用VIVID视频集[15]的两个视频序列进行性能测试。参数设置部分,在基于时空上下文信息的位置计算中,目标上下文区域的大小设置为初始帧目标大小的两倍。学习置信图的过程中模型参数[α=2.25,β=1]。其中置信图中的参数[σ]因为目标尺度的改变需要进行更新,则初始值设定为[a+b2](a和b分别是初始目标模板的宽和高)。在尺度更新部分,相似度阈值[e=1]。比例系数[κ=0.8,0.9,1.1,1.2]。基于上述参数的设定,在所有的图片序列中的参数值都是一样的,具有广范围的应用场景。下面列出了本文算法的跟踪结果。

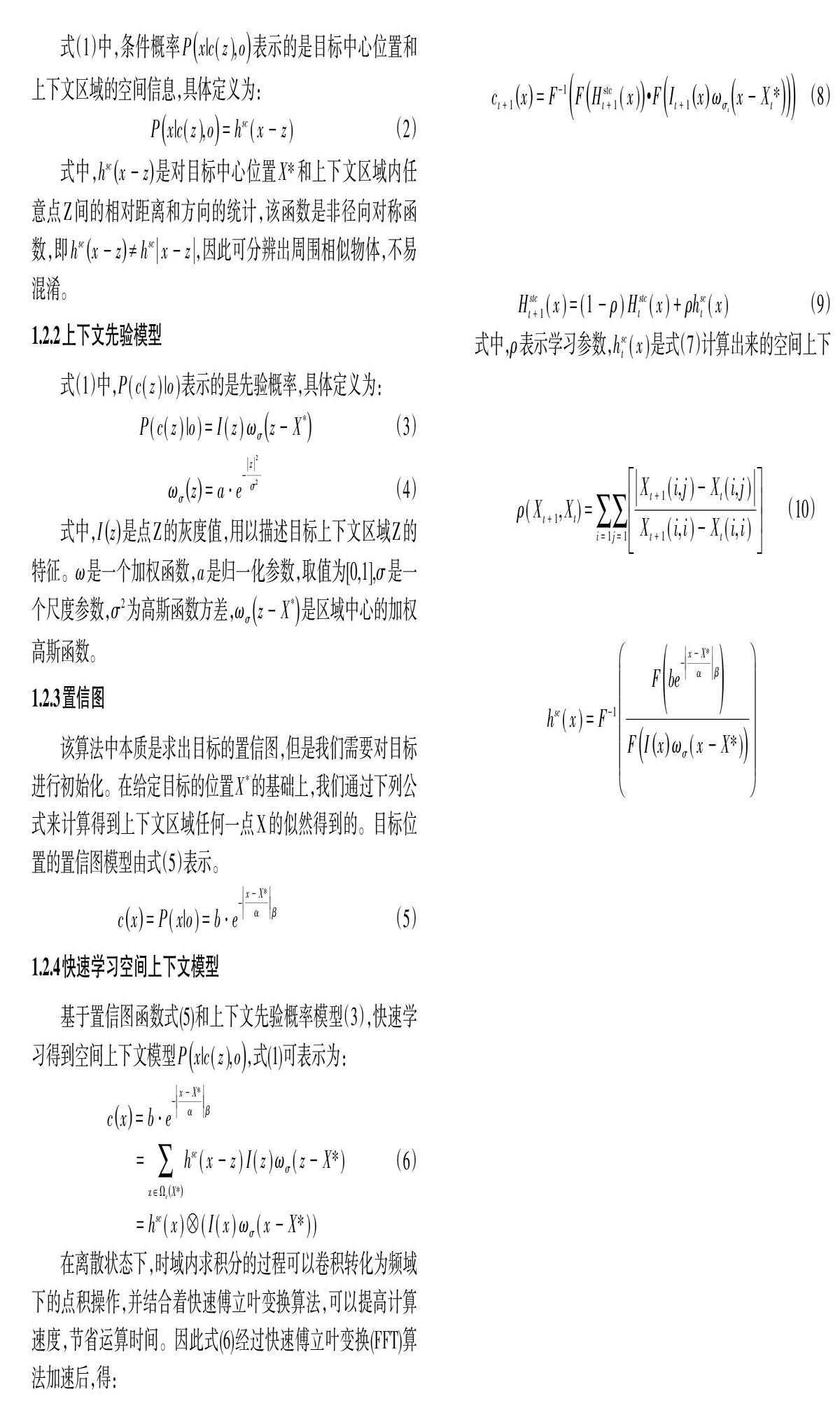

图4 Walking序列中,对路上的行人进行跟踪,行人由近至远运动,且其中一个行人目标环境背景较为复杂,实验结果表明,当两个目标由近至远变化时,本文算法跟踪目标稳定。

图5EgTest01序列中,目标逐渐由两个变为三个,最后增至六个,且目标在运动过程中,会发生大幅度的旋转等表观变化,从实验结果中可以看出前180帧时,可以准确地对目标进行跟踪,180帧后对于左下方的目标旋转时,模板没有更新,这是由于模板初始化时,对目标的前部进行匹配跟踪,所以当车旋转后,模板仍然只跟踪目标前部,导致尺寸无法学习更新。综上,本文算法可以较精准地跟踪多个目标,且当目标发生较大形变时,仍具有较高的准确率和鲁棒性。

由图4图5的实验结果可以得出结论:在对移动视频序列的多目标跟踪中,本文设计的基于上下文时空的跟踪算法是有效的,并且当目标环境背景较复杂、目标发生旋转等姿态变化或者尺度变化时,仍然可以准确地跟踪目标。

3 结语

本文针对多目标运动中姿态变化和尺度变化跟踪效果不理想问题,提出了一种基于时空上下文的多目标跟踪算法,通过每个目标的上下文时空信息对目标进行匹配跟踪,同时设置了相似度反馈机制用以更新跟踪窗口的尺度大小,提高了目标的跟踪精度。本文选取了两组有目标尺度变化和姿态变化的视频序列进行实验验证,实验表明,当不同目标发生不同的尺度或者姿态变化时,本文算法都能准确地跟踪目标,有效地解决了目标尺度姿态变化时造成的目标丢失问题,具有良好的鲁棒性。

参考文献:

[1] 李静宇,王延杰.基于子空间的目标跟踪算法研究[J].液晶与显示,2014,29(4):617-622.

[2] 郭敬明,何盺,魏仲慧.基于在线支持向量机的Mean Shift彩色图像跟踪[J].液晶与显示,2014,29(1):120-128

[3] Li X,Hu W,Shen C.A Survey of Appearance Models in Visual Object Tracking[J].Acm Transactions on Intelligent Systems & Technology,2013,4(4):1-48.

[4] 许佳佳.基于MeanShift算法的航空影像联合分割[J].液晶与显示,2014,29(4):586-591.

[5] Baydoun M,Dawi M,Ghaziri H. Enhanced Parallel Implementation of the K-Means Clustering Algorithm[C].International Conference on Advances in Computational TOOLS for Engineering Applications.IEEE,2016:7-11.

[6] Wang C,Shen Y,Wang Y,et al.Gesture tracking and recognition based on spatio-temporal context[J].Computer Engineering & Applications,2016,52(9):202-207.

[7] Yang M,Wu Y,Lao S.Intelligent Collaborative Tracking by Mining Auxiliary Objects[C].Computer Vision and Pattern Recognition,2006 IEEE Computer Society Conference on.IEEE,2006:697-704.

[8] Zhang K,Zhang L,Yang M H,et al.Fast Tracking via Spatio-temporal Context Learning[J].Computer Science,2013, 41(11):88-92.

[9] 赵洲,黄攀峰,陈路.一种融合卡尔曼滤波的改进时空上下文跟踪算法[J].航空学报,2017,38(2):269-279.

[10] 武亚宁.基于时空上下文的目标跟踪算法研究[D].燕山大学,2017.

[11] 冯新喜,魏帅,王泉,等.鲁棒标签多伯努利机动目标跟踪算法[J].华中科技大学学报(自然科学版),2018(2).

[12] Walha A,Wali A,Alimi A M.Video Stabilization with Moving Object Detecting and Tracking for Aerial Video Surveillance[J].Multimedia Tools & Applications,2015,74(17):6745-6767.

【通联编辑:朱宝贵】