网络多媒体分析系统的分析与设计

2019-07-16吴锦晶

吴锦晶

摘要:本系统针对网络上大量的多媒体数据中敏感图像、音视频广泛传播的现状,融合计算机视觉,机器学习和深度学习等技术对多媒体数据内容进行分析,旨在研发面向网络空间的多媒体检测分析技术,对互联网中图像、音视频等多媒体内容进行侦查和检测,为网络有害内容的发现与监管提供关键技术支撑。系统重点是研究敏感图像、音视频检测与检索的关键技术,并基于上述关键技术来研究敏感信息监管方法,通过多种技术手段对网络上传播的有害内容进行识别和分析,为维护国家安全和稳定提供技术保障。

关键词:敏感;多媒体;计算机视觉;机器学习

中图分类号:TP311 文献标识码:A

文章编号:1009-3044(2019)14-0189-02

1 背景

随着多媒体和网络技术的不断发展,人们越来越多依靠网络来获取和发布信息,互联网中存储和传播的信息对于大众舆论的形成和传播有巨大的影响,其中也隐藏着巨大的安全威胁。许多不法分子利用网络自由交互的特点,在网络上散布各种有损社会和谐的言论,即所谓的敏感信息,这些信息一旦扩散开来,往往会造成极其恶劣的影响,进而带来巨大的舆论压力,并造成相当的经济损失 [1]。因此,如何净化网络环境,及时、准确对网络敏感信息进行识别成为相关部门急需解决的问题。本文提出一种网络多媒体分析系统,重点研究敏感图像、音视频检测与检索的关键技术,研发面向网络空间的多媒体检测分析技术,为网络有害内容的发现与监管提供关键技术支撑。

2网络多媒体分析系统

网络多媒体分析系统主要包括:语种识别、音频比对、声纹识别、特定标识检测。

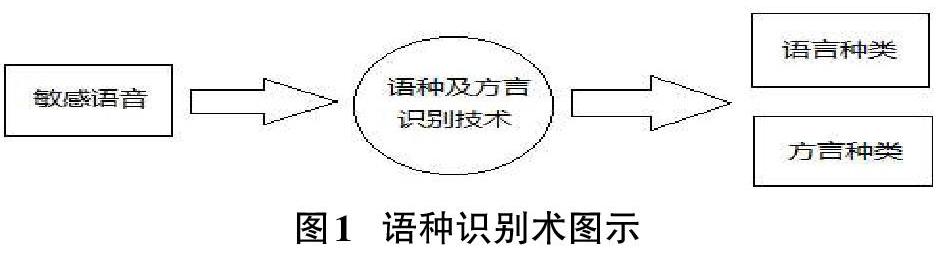

(1)语种识别:针对互联网场景类型,定制研发语种识别系统,对互联网音视频资料中的语音数据进行分析处理,识别判断其所属语种,并支持按照业务需求拓展语种识别范围。

(2) 音频比对:针对海量网络数据传播损耗和转换等特点,采用快速、高比对容错特性的音频比对算法,在音视频集合中,将与样本内容片段相同的部分提取出来。

(3) 声纹识别:在海量语音中,提取不同说话人语音形成固有声纹特征,最终识别分析出说话人的身份信息。

(4)特定标识检测:基于深度学习的特定标识检测模型,实现包含特定目标的敏感图像检测。

3系统的分析与设计

3.1语种识别

语种识别主要是利用计算机对语音数据进行分析处理,并自动识别判断其所属语种类型的过程。近年来随着全球化的趋势不断增长,语种识别的重要性也逐渐显现出来。语种识别可以用于跨语种语音识别系统、语音翻译机、呼叫中心、语音文档检索等系统中[2]。

本系统针对实际应用中的互联网场景类型,主要实现对于语音中中文普通话语种的识别,并支持按照业务需求拓展语种识别范围。由于系统中语种识别技术作为语音分类和连续语音识别、关键词识别的前端模块,并面临海量复杂环境下的数据识别处理需求,该任务的准确率和处理速度是本系统重点关注内容。

(1)传统GMM技术路线的语种识别性能已基本满足常规语种识别任务,而本系统针对网络中音视频数据的信道和背景环境复杂的情况,采用一种基于噪声鲁棒性的PNCC特征的语种识别系统;并采用MMI准则对各语种的GMM模型进行区分性训练,同时采用SVM建模,避免经典学习方法中过学习、维数灾难、局部极小等传统分类问题,有效提升语种识别模型的噪声鲁棒性和模型区分能力。

(2)在保证系统模型识别效果的同时,为确保系统效率满足海量数据处理的应用要求,本系统主要采用高斯聚类策略,在不降低声学模型维度的基础上,有效降低待运算的高斯数,从而降低运算;并采用灵活的跳帧策略,在充分保证数据量以及效果的前提下,減少有效帧的使用,从而有效提高系统的效率。

3.2音频比对

音频比对技术是指从一段连续的音频信息中搜索出是否存在指定的音频序列、指定的音频序列在该段连续的音频序列中的起始位置和结束位置,以及指定音频序列在该段连续音频序列中的完整性的技术[3]。

本系统针对网络中海量的音视频文件,通过音频比对技术,在不同的音视频文件中,将与样本内容片段相同的部分提取出来。由于互联网中音视频数据量巨大的情况以及语音传播过程中存在有传播损耗和转换等特点,音频样本比对需要具有较高的比对容错特性从而支撑网络音视频等多媒体的特性。

本系统采用快速特征提取方式来对音视频内容进行采样和标记,一方面保证音视频特征的代表性,另一方面保证在海量数据情况下的特征抽取速度;同时采用多级索引的方式来对音频(含视频抽取音频)进行检索和比对,以保证音频样本比对查找以及相似音频聚类的快速响应。

3.3 声纹识别

声纹识别,也称为说话人识别,分为两大类:声纹鉴定(说话人辨认)和声纹确认(说话人确认),前者是从若干讲话人当中分辨出特定语音资料的从属者(一对多辨析),后者确定特定的语音资料是否从属于指定的说话对象(一对一辨析)[4]。

本系统针对互联网实际应用场景,主要实现对于一对多辨析的声纹鉴定。在海量语音中,通过语音信号提取代表不同说话人身份的相关固有声纹特征,最终识别分析出特定敏感说话人的身份信息。

针对互联网中音视频数据量巨大以及来源丰富的情况,本系统采用声纹识别技术中最先进的联合因子分析方法,在因子分析理论中,说话人的信息可以认为是由一种所谓的“说话人因子”构成,而信道信息又是由一种“信道因子”构成,信道因素是影响系统性能最重要的因素,去除信道信息的影响可以大大提高识别率。本系统通过统计的方法估计出“说话人因子”和“信道因子”所在的空间,将每段具体信道情况下的“信道因子”去除,从而只保留“说话人因子”,有效提高系统识别率。

3.4 特定标志检测

特定标志检测技术主要分为离线模型训练和在线检测识别两个阶段。模型训练阶段主要利用标注的正样本和负样本训练特定标志的判别模型,用于判断检测识别阶段的滑动窗口中是否包含特定标志;检测识别阶段则采用滑动窗的方法扫描图像区域,通过训练好的模型识别其中是否包含该特定标志。

(1)模型训练。采用Adaboost学习算法建立特定标志模型并训练一个强级联分类器。Adaboost是一种迭代算法,其核心思想是针对同一个训练集训练不同的分类器(弱分类器),然后把这些弱分类器集合起来,构成一个更强的最终分类器(强分类器)。其算法本身是通过改变数据分布来实现,它根据每一轮训练中每个训练样本的分类结果正确与否,以及上一轮的总体分类准确率来确定每个样本的权值。再将修改过权值的新训练数据送给下一轮分类器进行训练,最后将每次训练得到的分类器通过级联的方式组合起来,作为最终的决策分类器。

(2)检测识别阶段。利用上一步训练好的强级联分类器,基于多个Adaboost弱分类器对不同的特征进行依次分类来完成特定标志的识别,即把多个Adaboost弱分类器串联起来,然后提取每个滑动窗中的不同特征,把这些特征依次输入不同的Adaboost弱分类器中进行判断,只有当所有的弱分类器都判断为正,则表示该滑动窗内包含该特定标志。这样一是可以针对要识别的特定标志选择出对其最有效的特征表示方法;二是减少计算量,例如当一个滑动窗中的第一个特征没有通过第一个分类器判断为负,即结束计算,直接判断当前滑动窗中不含有该特定标志,转而处理下一个滑动窗,这样就能快速抛弃没有该特定标志的滑动窗,达到快速识别的目的。

此外,对于待识别图像,进一步利用频域图像的相关性匹配减少滑动窗口的扫描范围。首先计算待识别图像的频域图像,并利用特定标志的模板在待识别图像上进行相关性匹配,根据得到的响应获取特定标志在待识别图像中的大致位置区域,将滑动窗口的扫描范围缩小到一个较小范围内。另外根据相关性匹配得到的区域大小,进一步将滑动窗的大小变化限制到一定范围内,进一步减小原始的搜索空間。相比于原始的滑动窗算法在全图和全尺寸的扫描,本系统大大减少了检测的计算量,实现对特定标识的实时检测。

4 结束语

本系统针对网络敏感信息的数据量巨大、来源丰富的特点,主要实现了包括语种识别、音频比对、声纹识别、特定标识检测四类关键技术的研究和设计,并在准确率和处理效率上都提出了可靠有效地实现方法,更好地适应网络敏感信息识别的需求,为网络有害内容的发现与监管提供了技术支撑。

参考文献:

[1]王浩.基于半监督学习的网络敏感信息识别[D]. 天津大学, 2012.

[2]张卫强, 刘加. 基于听感知特征的语种识别[J]. 清华大学学报(自然科学版), 2009(1):78-81.

[3] 郭兴吉, 范秉琪. 基于特征的音频比对技术[J]. 河南师范大学学报(自然版), 2006, 34(2):35-38.

[4] 石燕. 声纹识别技术研究[D]. 南京航空航天大学, 2004.

【通联编辑:王力】