基于轮廓图像空频域特征的舞蹈翻腾姿态识别模型

2019-04-28耿君

摘要:文中旨在研究基于轮廓图像空频域特征的舞蹈翻腾姿态识别模型。该模型先将待识别舞蹈视频图像实施腐蚀、膨胀、中心归一化等预处理,利用处理后图像提取舞蹈翻腾姿态能量图,通过离散余弦变换提取舞蹈翻腾姿态能量图频域特征,利用C ontourlet变换提取舞蹈翻腾姿态能量图空域轮廓特征,采用特征级融合方法融合以上特征获取舞蹈轮廓图像的空频域特征向量集,再将待识别舞蹈视频序列候选姿态利用Baum-Welch算法训练为隐马尔可夫模型,利用舞蹈轮廓图像的空频域特征向量集将隐马尔可夫模型量化至观察序列,通过前向后向算法获取观察序列姿态概率,观察序列概率值最大的隐马尔可夫模型对应姿态即为所需识别舞蹈翻腾姿态。实验结果表明,该模型可较好地提取具有空频域特征的舞蹈轮廓图像,有效识别舞蹈视频中舞蹈翻腾姿态,且识别100帧有阴影舞蹈视频图像中舞蹈翻腾姿态识别准确率高于96%。

关键词:舞蹈翻腾姿态;姿态识别;轮廓图像;空频域特征;模型训练;对比验证

中图分类号:TN911.73-34;TP391

文献标识码:A

文章编号:1004-373X( 2019) 24-0146-04

随着社会不断进步,舞蹈艺术逐渐进入普通人的生活,人们鉴赏水平以及艺术关注度逐渐提高,如何提升舞蹈艺术水平成为近年来急需解决的问题。利用姿态识别分析人体运动行为已成为近年来相关专家学者的重要研究方向[1]。舞蹈翻腾技巧是评价舞蹈演员基本功以及综合能力的重要指标,识别舞蹈翻腾姿态对于艺术教学以及研究具有重要意义。目前,人体姿态识别已取得较大成效。文献[2]方法先通过人体姿态时空特征建立人体结构信息高层描述模型,再采用图像特征识别方法识别人体姿态。该方法需要通过完整度较高的人体轮廓识别姿态,而视频中图像多数无法提取完整度较高的人体轮廓,因此识别准确率较低。文献[3]方法先提取人体行为特征,利用人体行为特征建立时空与或图模型,再采用视频序列运动目标检测与识别方法识别时空与或图模型中人体姿态。该方法仅可识别二维图像中人体姿态,未考虑视频图像变化情形,导致识别稳定性较差。文献[4]方法利用面向情感语音识别方法识别人体姿态特征,该方法选取单一特征识别人体姿态,导致无法准确区分目标区域以及背景区域,识别结果准确性较差。为了解决以上问题,本文提出基于轮廓图像空频域特征的舞蹈翻腾姿态识别模型,先提取轮廓图像的频域特征以及空域轮廓特征,再通过隐马尔可夫模型识别舞蹈翻腾姿态特征,具有较强的识别性能,便于人们识别视频中舞蹈翻腾姿态。

1 舞蹈翻腾姿态识别模型

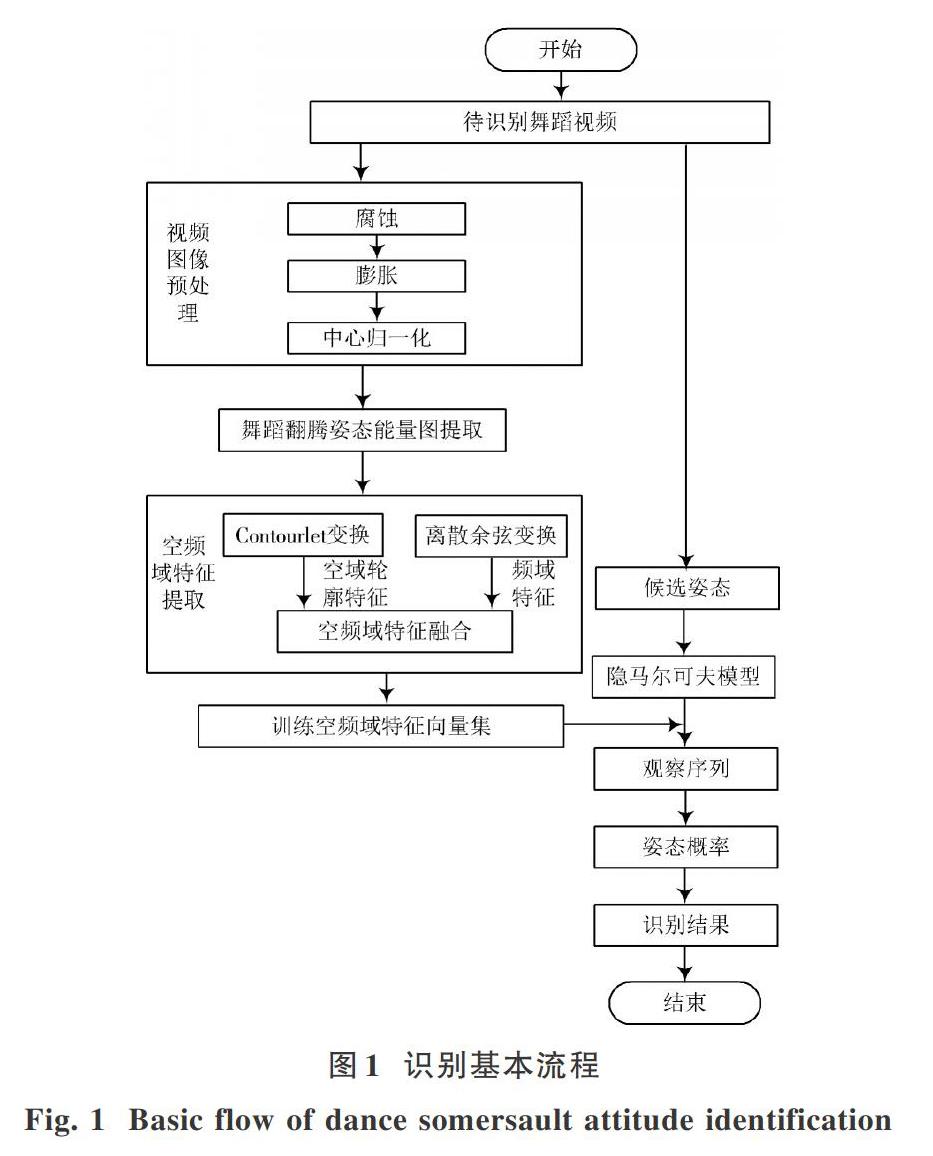

基于轮廓图像空频域特征的舞蹈翻腾姿态识别模型的识别基本流程如图1所示。

将待识别舞蹈视频图像通过腐蚀、膨胀、中心归一化等预处理后,提取舞蹈翻腾姿态能量图。利用离散余弦变换以及C onto urlet变换方法提取舞蹈翻腾姿态能量图中频域特征以及多方向多分辨率空域轮廓特征[5];利用提取特征区分人体在舞蹈翻腾姿态时高低频分量并捕捉舞蹈翻腾特征细节信息;采用特征级融合方法融合以上特征获取轮廓图像的空频域特征向量集等进行处理。

1.1 提取舞蹈翻腾姿态能量图

通过舞蹈翻腾姿态能量图体现人体舞蹈翻腾姿态速度以及形态等详细信息,提取舞蹈翻腾姿态能量图可过滤随机噪声,具有较高的鲁棒性。

计算待识别视频各图像中包含像素点数量,获取目标像素数量极小时帧号,将相邻三个具有极小值帧号的图像帧设置为完整姿态周期,获取周期内姿态图像帧数。设一个舞蹈翻腾姿态周期具有n帧图像,经中心归一化方法预处理后可得第t帧舞蹈翻腾姿态图像为Bi(x,y),第t帧舞蹈翻腾图像所对应舞蹈翻腾姿态能量图公式如下:式中,G(x,y)为灰度图像,图像中各像素点灰度值为该点舞蹈翻腾姿态周期内能量,即舞蹈翻腾过程中像素点出现于此处的频次。灰度值大小体现该像素点出现于此处的频次高低[6]。

1.2 提取轮廓图像空频域特征

通过离散余弦变换方法提取舞蹈翻腾姿态能量图中频域特征,利用频域信息划分舞蹈翻腾姿态中高低频分量;通过C ontourlet变换方法提取舞蹈翻腾姿态能量图中空域轮廓特征[7]。

1.2.1 提取频域特征

采用局部二值法等局部特征描述方法无法描述完整舞蹈翻腾姿态。而离散余弦变换方法可区分舞蹈翻腾姿态中高频与低频成分,将舞蹈翻腾姿态中动作较小的头和肩等低频部分与高频的四肢摆动动作区分,有效提取舞蹈翻腾姿态频域特征。利用离散余弦变换方法可准确区分人体舞蹈翻腾姿态时各种频率,且计算简单,轻松提取舞蹈翻腾姿态频域特征[8]。式中f(x,y)表示舞蹈翻腾姿态能量图中像素点坐标为(x,y)的灰度值;u表示像素点(x,y)水平方向变换率即水平空间频率;v表示像素点(x,y)垂直方向变换率即垂直空间频率;F(u,v)表示离散余弦变换后频率系数,其中,F(O,0)表示图像频域特征直流部分。

通过离散余弦变换方法计算舞蹈翻腾姿态能量图C(x,y)后,获取与原图像尺寸相同的变换系数矩阵,该变换系数矩阵体现舞蹈翻腾姿态能量图像队形的频域特征一,。舞蹈翻腾姿态能量图中低频分量处于频率幅度谱左上角,表示图中像素值较大区域,即变换较慢区域,该区域为舞蹈翻腾姿态能量图主体部分;舞蹈翻腾姿态能量图中高频分量处于频率幅度谱右下角,表示图中像素值较小区域,该区域体现舞蹈翻腾姿态能量图细节以及边缘部分。

1.2.2 提取空域轮廓特征

1.3 舞蹈翻腾姿态识别

为增加识别准确性,将待识别视频序列候选姿态训练为隐马尔可夫模型[10],需要寻找最优模型参数(A,B,π),使基于該模型生成观察序列o的概率P(OIA)存在最大值。通过隐马尔可夫模型中前向后向算法构造辅助变量寻找最优参数识别舞蹈翻腾姿态。前向变量局部概率公式如下:

將待识别视频序列候选姿态利用Baum-Welch算法训练为隐马尔可夫模型,利用轮廓图像的空频域特征向量集将隐马尔可夫模型量化至观察序列,通过前向后向算法以隐马尔可夫模型为条件获取观察序列的姿态概率P(Ot|λt),即计算所有候选姿态隐马尔可夫模型生成的观察序列概率P(Ot|λt),其中f表示候选姿态类别编号。

2 实验分析

选取CPU为Intel i7 8700,内存为8 GB的PC作为实验平台,利用Matlab 7.0数据分析软件分析实验结果。从互联网中选取5段具有翻腾姿态的舞蹈视频作为实验对象。

2.1 舞蹈翻腾姿态识别结果

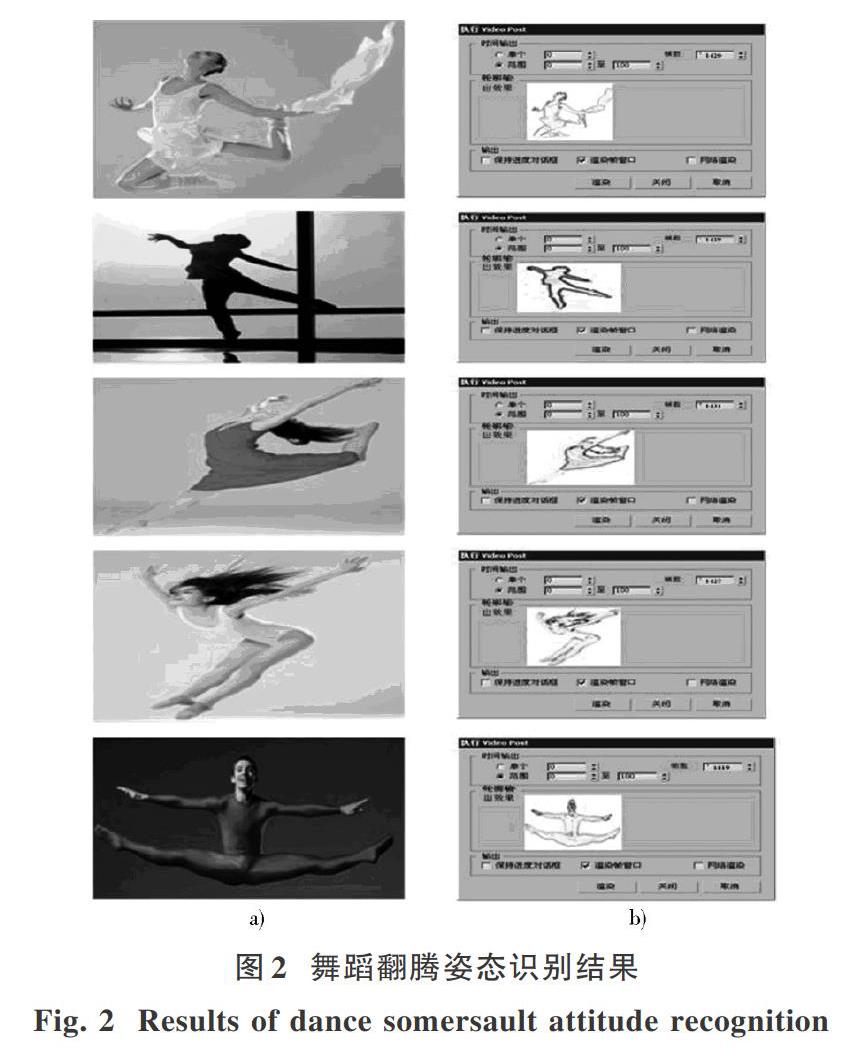

从5段视频中各截取舞蹈翻腾姿态视频1 min,其中1 min视频包括图像1 440帧。采用本文模型识别5段1 min视频中的舞蹈翻腾姿态,截取舞蹈视频中识别的舞蹈翻腾姿态图像如图2a)所示,采用本文模型获取具有空频域特征的轮廓图像和5段视频舞蹈翻腾姿态识别结果如图2b)所示。

通过图2识别结果可以看出,采用本文模型可较好地提取具有空频域特征的舞蹈轮廓图像。在5段具有1 440帧图像的舞蹈翻腾视频中,本文模型识别结果分别为1 429帧、1 429帧、1 431帧、1 427帧、1 419帧。通过以上实验结果表明,采用本文模型可有效识别舞蹈视频中舞蹈翻腾姿态。

2.2 舞蹈翻腾姿态识别准确率

以上实验结果表明,本文模型可有效识别舞蹈翻腾姿态。为进一步检测本文模型识别性能,将本文模型与分层次模型以及动态路径模型对比。视频图像中存在的阴影严重干扰识别舞蹈翻腾姿态准确率,从5段实验视频中选取有阴影以及无阴影图像样本各100帧,统计三种模型识别情况,对比结果如表1所示。

通过表1实验结果可以看出,采用本文模型在有阴影的5段100帧视频图像中识别舞蹈翻腾姿态准确率均在96%以上;在无阴影的5段100帧视频图像中识别舞蹈翻腾姿态准确率均在98%以上。而采用分层次模型在有阴影的5段100帧视频图像中识别舞蹈翻腾姿态准确率均在88%以上;在无阴影的5段100帧视频图像中识别舞蹈翻腾姿态准确率均在85%以上。采用动态路径模型在有阴影的5段100帧视频图像中识别舞蹈翻腾姿态准确率均在77%以上;在无阴影的5段100帧视频图像中识别舞蹈翻腾姿态准确率均在78%以上。

分析实验结果可知,本文模型在阴影干扰下识别舞蹈翻腾姿态准确率有所降低,但识别结果均高于96%,而分层次模型以及动态路径模型虽受阴影干扰影响不大,但识别准确率明显低于本文模型,验证了本文模型识别舞蹈翻腾姿态的准确性。采用三种模型重复识别5段实验视频10次,取10次识别结果平均值,统计三种模型的误识别率,检测三种模型识别鲁棒性。采用三种模型重复识别舞蹈翻腾姿态误识别率结果如图3所示。

通过图3实验结果可以看出,采用本文模型重复识别5段视频中舞蹈翻腾姿态误识别率均在4%以下,明显低于采用分层次模型以及动态路径模型识别舞蹈翻腾姿态误识别率结果,再次验证了采用本文模型识别视频中舞蹈翻腾姿态的准确性。

3 结论

本文研究一种基于轮廓图像空频域特征的舞蹈翻腾姿态识别模型,通过离散余弦变换提取舞蹈翻腾姿态能量图频域特征,采用Contourlet变换提取舞蹈翻腾姿态能量图空域轮廓特征,有效提高了利用隐马尔可夫模型识别舞蹈翻腾姿态精准度。并通过实验验证本文模型在有无阴影情况下均可有效识别视频中舞蹈翻腾姿态,且识别准确率高。

参考文献

[1]王曲,赵炜琪,罗海勇,等,人群行为分析研究综述[Jl计算机辅助设计与图形学学报,2018. 30(12):163-175.

WANG Qu, ZHAO Weiqi, LUO Haiyong, et al.Research oncrowd behavior analysis:a review [J]. Journal of computer-aid-ed design&computer graphics, 2018, 30( 12): 163-175.

[2]郑潇,彭晓东,王嘉璇.基于姿态时空特征的人体行为识别方法[J]计算机辅助设计与图形学学报,2018,30(9):1615-1624.

ZHENG Xiao. PENG Xiaodong, WANG Jiaxuan. Human ac-tion recognition based on pose spatio-temporal features [J]. Jour-nal of computer-aided design&computer graphics. 2018. 30(9):1615-1624.

[3]易唐唐.基于时空与或图模型的视频人体动作识别方法[Jl.控制工程,2017 .24(9):1792-1797.

YI Tangtang. Video human action recognition based on spatialtemporal and-or graph model[J]. Control engineering of China,2017. 24(9):1792-1797.

[4]宋春晓,孙颖.面向情感语音识别的非线性几何特征提取算法[J]计算机工程与应用,2017,53( 20):128-133.

SONG Chunxiao, SUN Ying. Nonlinear geometric feature ex-traction algorithm for emotional speech recognition [J]. Comput-er engineering and applications, 2017. 53(20): 128-133.

[5]周涛,范影乐,朱亚萍,等.基于主视通路层级响应模型的轮廓检测方法[J],航天医学与医学T程,2018.31(3):75-83.

ZHOU Tao, FAN Yingle, ZHU Yaping, et al.Fast contour de-tection method based on hierarchical response model of prima-ry visual pathway [J]. Space medicine&medical engineering,2018, 31(3):75-83.

[6]陈家益,黄楠,熊刚强,等.基于灰度最值和方向纹理的概率滤波算法[J]计算机工程与应用,2017 .53(8):186-192.

CHEN Jiayi, HUANG Nan. XIONG Gangqiang, et al.Proba-bility filtering algorithm based on maximum and mini - mumgray and directional texture [J]. Computer engineering and ap-plications, 2017. 53(8): 186-192.

[7]范哲意,蔣姣,曾亚军,等.基于空一频域特征和线性判别分析的视频步态识别[J]光学技术,2017.43(4):374-380.FAN Zheyi. JIANG Jiao, ZENG Yajun, et al.Video humangait recognition based on space-frequency domain features andlinear discriminant analysis [J]. Optical technique, 2017, 43(4):374-380.

[8]倪晓航,肖明波,基于改进边缘活动轮廓模型的超声图像分割[J]计算机工程与设计,2018,39(6):183-186.

NI Xiaohang, XIAO Mingbo. Ultrasound image segmentationbased on improved edge active contour model [J]. Computer en-gineering and design, 2018. 39(6): 183-186.

[9]苏富林,钱素娟,魏霖静,等,频域内基于邻域特征学习的单幅图像超分辨重建[J]计算机工程.2017 .43 (5):255-260.

SU Fulin, QIAN Sujuan, WEI Linjing, et al.Single-image su- per- resolution reconstruction in frequency domain based onneighborhood feature learning [J]. Computer engineering,2017. 43(5):255-260.

[10]康乃馨,何明浩,韩俊,等.时频域综合分析的雷达信号识别方法[J]现代防御技术,2017.45(5):162-169.

KANG Naixin, HE Minghao, HAN Jun. et al_Radar signalrecognition method via synthetic analysis in time-frequency do-main [J]. Modern defense technology, 2017, 45(5): 162-169.

作者简介:耿君(1982-),女,山东济南人,博士,讲师,研究方向为计算机应用。