基于图像颜色特征的高粱胚芽鞘识别及定位方法

2019-03-03闫建伟苏小东赵源刘进平

闫建伟 苏小东 赵源 刘进平

摘要:利用图像颜色特征,分割高粱胚芽鞘种子图像,确定高粱种子轮廓矩,根据其轮廓矩确定高粱种子质心坐标,然后根据高粱胚芽鞘图像颜色特征对图像进行颜色分割,获取高粱胚芽鞘图像,计算高粱胚芽鞘轮廓极点坐标,再选取距离质心最远的2个坐标作为高粱胚芽鞘轮廓近似直线端点,连接2个端点作为胚芽鞘近似直线。最后根据高粱种子轮廓质心坐标、胚芽鞘近似直线和切割距离(给定)确定胚芽鞘的姿态和高粱胚芽鞘的切割点位置。该方法能获得高粱胚芽鞘和种子较为完整的图像,并能准确得出胚芽鞘的切割位置及姿态等相关信息。该研究方法为高粱胚芽鞘的识别与分析提供了准确、快捷、可视的技术手段,为构建胚芽鞘智能识别、定位的视觉系统及自动化切割装置提供了技术支撑。

关键词:高粱;胚芽鞘;颜色特征;识别;切割位置

中图分类号: TP391.4 文献标志码: A 文章编号:1002-1302(2019)23-0252-05

胚芽鞘是单子叶植物所特有的,是一种鞘状结构。胚芽鞘具有保护胚芽中幼小的叶和生长锥的作用,同时含有叶绿体,出土后既能进行光合作用,又对幼苗的独立生活起着重要的作用[1]。在胚芽鞘培养及胚芽鞘相关研究领域,胚芽鞘的快速准确识别是一项十分重要的工作。传统的胚芽鞘识别及切割位置的判断主要依靠工作人员的经验,判断的准确度和速度主要依赖于判断者的主观意识,其合理性和科学性有明显缺点,且人工识别切割胚芽鞘具有效率低、精度低等缺点。

机器视觉经过60多年的快速发展,逐渐成为一种较为成熟的先进技术,也是近几年来受到国内外研究者较多关注的研究热点,研究人员利用图像的颜色特征和形态学等知识探讨和分析了彩色图像的分割[2-10]、分类[11-20]与定位[21-30]。湖南工业大学的石伟在基于机器视觉的纸张计数方法研究及其应用中提出1种基于K均值聚类的纸张精确计数方法,可以很好地进行纸张的准确计数,计数准确率达99%[31]。华南理工大学的李春在基于机器视觉的焊接工件识别与焊接轨迹校正方法研究中研究了图像预处理技术,包括灰度转换、滤波去噪、阈值处理、形态学运算及边缘检测等。通过对图像进行预处理,可以滤去噪声,增强目标信息,使其具有一定的鲁棒性[32]。国外研究者利用机器视觉做了相关研究,将机器视觉应用到各个领域,并取得了不错的效果。2016年印度农作物处理技术研究所(IICPT)的Vithu等在利用机器视觉的粮食检测研究中发现,视觉系统可以快速准确地检测粮食的质量[33]。加拿大萨斯克切温省大学工程学院化学与生物研究所的Shrestha等利用机器视觉技术预测小麦淀粉酶的活跃性,取得了较好的预测效果[34]。

数字图像处理技术在高粱胚芽鞘方面目前暂无相关研究,因此,研究高粱胚芽鞘图像识别技术和切割位置判断是一项非常重要的研究课题。本研究以高粱胚芽鞘的颜色特征为依据,结合高粱胚芽鞘生长特点及形态学特征对高粱胚芽鞘进行快速识别及切割位置的判断。

1 材料与方法

1.1 图像采集

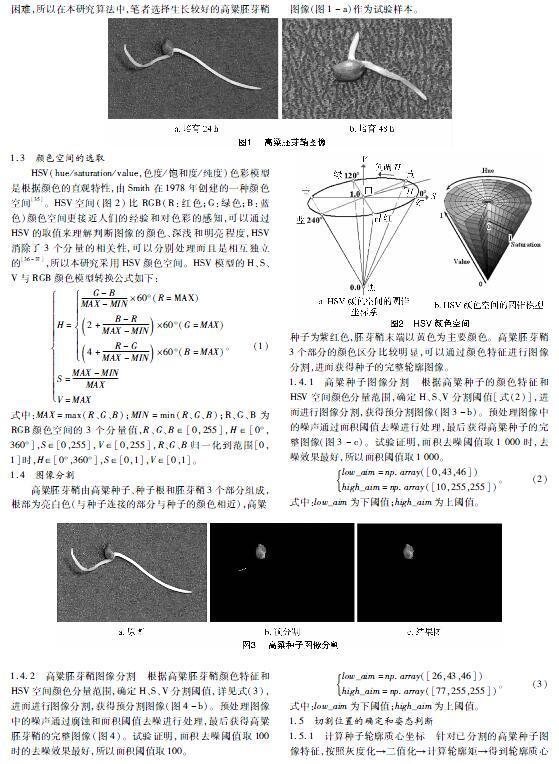

高粱种子的培育地点为贵州大学西校区农学院种子种苗培育实验室,培养设备为光照培养箱,培养条件为水培、无光照、温度25.6~28.6 ℃。培养时间选在2018年1月8日上午。图像采集于2018年1月10日、1月12日在实验室内进行。利用尼康(Nikon)D750相机获得小麦图像共15幅(高粱样本从培养皿中随机选取15个),图片格式为JPG,分辨率为1 024×683PPI(像素数)。图1-a于2018年1月12日 09:00 拍摄获得,图1-b在2018年1月10日09:00拍摄获得。在PC(个人计算机)上完成高粱胚芽鞘的识别算法开发,PC机配置为Inter CoreTM i5-6200U、CPU2.3 GHz、内存4 GB,基于Windows 7操作系统,编程工具为Python3.6+Opencv3.3.1,开发環境为PyCharm 2017.3。

1.2 样本分析

不同培养时间的胚芽鞘,在形状、颜色和大小等方面有着较大区别。图1-a为培养时间为94 h的高粱胚芽鞘图像,其胚芽鞘、须根生长得较好,胚芽鞘末端为黄色,比较容易通过颜色特征进行图像分割;图1-b为培养时间为48 h的高粱胚芽鞘图像,整个胚芽鞘比较小,并且胚芽鞘和须根区分不明显,整体尺寸小,后续进行切割位置和姿态判断也相对较为困难,所以在本研究算法中,笔者选择生长较好的高粱胚芽鞘图像(图1-a)作为试验样本。

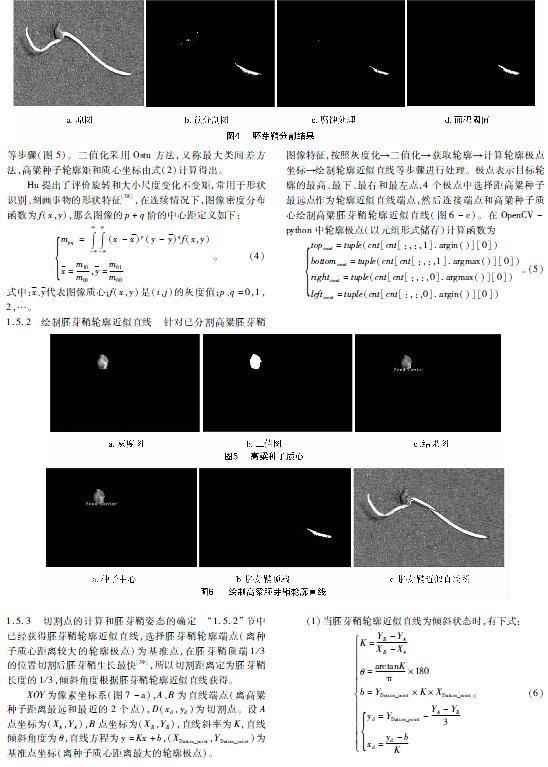

1.3 颜色空间的选取

HSV(hue/saturation/value,色度/饱和度/纯度)色彩模型是根据颜色的直观特性,由Smith在1978年创建的一种颜色空间[35]。HSV空间(图2)比RGB(R:红色;G:绿色;B:蓝色)颜色空间更接近人们的经验和对色彩的感知,可以通过HSV的取值来理解判断图像的颜色、深浅和明亮程度,HSV消除了3个分量的相关性,可以分别处理而且是相互独立的[36-37],所以本研究采用HSV颜色空间。HSV模型的H、S、V与RGB颜色模型转换公式如下:

H=G-BMAX-MIN×60°(R=MAX)

2+B-RMAX-MIN×60°(G=MAX)

4+R-GMAX-MIN×60°(B=MAX)

S=MAX-MINMAX

V=MAX。

(1)

式中:MAX=max(R、G、B);MIN=min(R、G、B);R、G、B为RGB颜色空间的3个分量值,R、G、B∈[0,255],H∈[0°,360°],S∈[0,255],V∈[0,255],R、G、B归一化到范围[0,1]时,H∈[0°,360°],S∈[0,1],V∈[0,1]。

1.4 图像分割

高粱胚芽鞘由高粱种子、种子根和胚芽鞘3个部分组成,根部为亮白色(与种子连接的部分与种子的颜色相近),高粱

种子为紫红色,胚芽鞘末端以黄色为主要颜色。高粱胚芽鞘3个部分的颜色区分比较明显,可以通过颜色特征进行图像分割,进而获得种子的完整轮廓图像。

1.4.1 高粱种子图像分割 根据高粱种子的颜色特征和HSV空间颜色分量范围,确定H、S、V分割阈值[式(2)],进而进行图像分割,获得预分割图像(图3-b)。预处理图像中的噪声通过面积阈值去噪进行处理,最后获得高粱种子的完整图像(图3-c)。试验证明,面积去噪阈值取1 000时,去噪效果最好,所以面积阈值取1 000。

low_aim=np.array([0,43,46])

high_aim=np.array([10,255,255])。

(2)

式中:low_aim为下阈值;high_aim为上阈值。

1.4.2 高粱胚芽鞘图像分割 根据高粱胚芽鞘颜色特征和HSV空间颜色分量范围,确定H、S、V分割阈值,详见式(3),进而进行图像分割,获得预分割图像(图4-b)。预处理图像中的噪声通过腐蚀和面积阈值去噪进行处理,最后获得高粱胚芽鞘的完整图像(图4)。试验证明,面积去噪阈值取100时的去噪效果最好,所以面积阈值取100。

low_aim=np.array([26,43,46])

high_aim=np.array([77,255,255])。

(3)

式中:low_aim为下阈值;high_aim为上阈值。

1.5 切割位置的确定和姿态判断

1.5.1 计算种子轮廓质心坐标 针对已分割的高粱种子图像特征,按照灰度化→二值化→計算轮廓矩→得到轮廓质心

等步骤(图5)。二值化采用Ostu方法,又称最大类间差方法,高粱种子轮廓矩和质心坐标由式(2)计算得出。

Hu提出了评价旋转和大小尺度变化不变矩,常用于形状识别、刻画事物的形状特征[38],在连续情况下,图像密度分布函数为f(x,y),那么图像的p+q阶的中心距定义如下:

mpq=∫∞-∞∫∞-∞(x-x)p(y-y)qf(x,y)

x=m10m00,y=m01m00。

(4)

式中:x、y代表图像质心;f(x,y)是(i,j)的灰度值;p、q=0,1,2,…。

1.5.2 绘制胚芽鞘轮廓近似直线 针对已分割高粱胚芽鞘图像特征,按照灰度化→二值化→获取轮廓→计算轮廓极点坐标→绘制轮廓近似直线等步骤进行处理。极点表示目标轮廓的最高、最下、最右和最左点,4个极点中选择距高粱种子最远点作为轮廓近似直线端点,然后连接端点和高粱种子质心绘制高粱胚芽鞘轮廓近似直线(图6-c)。在OpenCV-python中轮廓极点(以元组形式储存)计算函数为

topmost=tuple(cnt[cnt[:,:,1].argin()][0])

bottommost=tuple(cnt[cnt[:,:,1].argmax()][0])

rightmost=tuple(cnt[cnt[:,:,0].argmax()][0])

leftmost=tuple(cnt[cnt[:,:,0].argin()][0])。

(5)

1.5.3 切割点的计算和胚芽鞘姿态的确定 “1.5.2”节中已经获得胚芽鞘轮廓近似直线,选择胚芽鞘轮廓端点(离种子质心距离较大的轮廓极点)为基准点,在胚芽鞘顶端1/3的位置切割后胚芽鞘生长最快[39],所以切割距离定为胚芽鞘长度的1/3,倾斜角度根据胚芽鞘轮廓近似直线获得。

XOY为像素坐标系(图7-a),A、B为直线端点(离高粱种子距离最远和最近的2个点),D(xd,yd)为切割点。设A点坐标为(XA,YA),B点坐标为(XB,YB),直线斜率为K,直线倾斜角度为θ,直线方程为y=Kx+b,(XDatum_point,YDatum_point)为基准点坐标(离种子质心距离最大的轮廓极点)。

(1)当胚芽鞘轮廓近似直线为倾斜状态时,有下式:

K=YB-YAXB-XA

θ=arctanKπ×180

b=YDotum_point×K×XDatum_point

yd=YDatum_point-YA-YB3

xd=yd-bK。

(6)

式中:YB-YA≠0,XB-XA≠0;d为切割点。

(2)当胚芽鞘轮廓近似直线为水平状态时,有下式:

YB-YA=0

θ=0

yd=YB=YA

xd=XDatum_point±|AB|3。

(7)

式中:|AB|为高粱胚芽鞘轮廓近似直线长度,当高粱种子质心坐标在基准点左侧时,即x (3)胚芽鞘轮廓近似直线为竖直状态时,有下式:

XB-XA=0

θ=90

yd=YDatum_point±|AB|3

xd=XDatum_point。

(8)

式中:当高粱种子质心坐标在基准点下方时,即y 2 结果与分析

本研究在培养盘中随机选取在光照培养箱水培后的15个高粱种子图像作为试验样本,培养时间为94 h(2018年1月8日11:00至2018年1月12日09:00),胚芽鞘平均长度为5 cm,图像大小为1 024×683,背景色为黑色。用本研究方法对实际拍摄的真彩色高粱胚芽鞘图像进行分割和姿态确定。如表1所示,试验成功率为100%,图像处理平均耗时 0.055 s,能够满足今后胚芽鞘切割设备视觉系统的速度要求。

3 讨论与结论

本研究在HSV颜色空间下通过高粱胚芽鞘的颜色特征分别对高粱种子和胚芽鞘进行图像分割,获得种子和胚芽鞘的完整分割图像,并根据高粱胚芽鞘形态特征,提出1种胚芽鞘切割位置和姿态的确定方法。试验结果表明,本研究方法可以简单有效地对高粱胚芽鞘、种子进行图像分割,胚芽鞘的识别成功率和切割位置计算准确率均达到100%,能够满足胚芽鞘切割装置视觉系统的要求。

本试验从胚芽鞘培养盘中的大量胚芽鞘中随机选取15个进行试验具有代表性,图像分割算法和胚芽鞘姿态的判断方法具有客观性和可重复性,利用本研究图像分割算法只需改变图像分割H、S、V分量阈值,就可以应用于济麦、玉米和小麦等不同品种或者种类的胚芽鞘的图像分割,高粱胚芽鞘姿态判断方法可以为其他单子叶植物(具有胚芽鞘)胚芽鞘姿态判断提供理论参考和依据。

对不同培养时间的高粱胚芽鞘进行图像分割效果对比可知,培养94 h左右的胚芽鞘生长较好,图像分割效果好,可以很好地进行切割位置判断,在后续胚芽鞘图像识别分割和胚芽鞘切割设备试验时可以选择此时期的高粱胚芽鞘样本作为试验样本。

4 结语

本研究方法具有较好的适应性,因此基于颜色特征在不同种类胚芽鞘图像分割中是值得研究的。本研究提出的胚芽鞘分割算法及胚芽鞘切割位置和姿态的判断方法具有一定的研究意义和实用价值,补充了图像处理技术在胚芽鞘方面的应用,并为后续胚芽鞘自动切割装置搭建机器视觉系统提供了技术支撑。

参考文献:

[1]陈爱国,陈进红. 胚芽鞘的伸长机理和生理生态响应[J]. 山东农业大学学报(自然科学版),2002,33(4):438-441.

[2]吴 鑫,王桂英,丛 杨. 基于颜色和深度信息融合的目标识别方法[J]. 農业工程学报,2013,29(增刊1):96-100.

[3]翟瑞芳,方益杭,林承达,等. 基于高斯HI颜色算法的大田油菜图像分割[J]. 农业工程学报,2016,32(8):142-147.

[4]杨蜀秦,宁纪锋,何东健. 一种基于主动轮廓模型的连接米粒图像分割算法[J]. 农业工程学报,2010,26(2):207-211.

[5]任守纲,马 超,谢 忠,等. 基于分水岭和梯度的蝴蝶兰图像分割方法[J]. 农业工程学报,2012,28(9):125-129.

[6]Ren D Y,Jia Z H,Yang J,et al. A practical GrabCut color image segmentation based on bayes classification and simple linear iterative clustering[J]. IEEE Access,2017,5:18480-18487.

[7]Chen M,Ludwig S A. Color image segmentation using fuzzy C-regression model[J]. Advances in Fuzzy Systems,2017(2):1-15.

[8]Ananth C,Senthilkani A S,Gomathy S K,et al. Color image segmentation using IMOWT with 2D histogram grouping[J]. International Journal of Computer Science and Mobile Computing,2014,3(5):1-7.

[9]Jaffar M A,NaveedN,Ahmed B,et al. Fuzzy c-means clustering with spatial information for color image segmentation[C]// IEEE. International Conference on Electrical Engineering.Lahore,Pakistan,2009:9.

[10]Shi J,Malik J. Normalized cuts and image segmentation[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence,2000,22(8):888-905.

[11]闫小梅,刘双喜,张春庆,等. 基于颜色特征的玉米种子纯度识别[J]. 农业工程学报,2010,26(增刊1):46-50.

[12]陶华伟,赵 力,奚 吉,等. 基于颜色及纹理特征的果蔬种类识别方法[J]. 农业工程学报,2014,30(16):305-311.

[13]周云成,许童羽,郑 伟,等. 基于深度卷积神经网络的番茄主要器官分类识别方法[J]. 农业工程学报,2017,33(15):219-226.

[14]司永胜,乔 军,刘 刚,等. 苹果采摘机器人果实识别与定位方法[J]. 农业机械学报,2010,41(9):148-153.

[15]宋 健,王 凯,张晓琛. 茄子采摘机器人目标识别与测距方法[J]. 实验室研究与探索,2015,34(9):54-57.

[16]Jeon Y,Kim J. Active convolution:learning the shape of convolution for image classification[J]. Computer Vision and Pattern Recognition. IEEE,2017.

[17]Wang K Z,Zhang D,Li Y,et al. Cost-effective active learning for deep image classification[J]. IEEE Transactions on Circuits & Systems for Video Technology,2017,27(12):2591-2600.

[18]Zhao Z Q,Jiao L C,Zhao J Q,et al. Discriminant deep belief network for high-resolution SAR image classification[J]. Pattern Recognition,2017,61:686-701.

[19]Huang G,Chen D,Li T,et al. Multi-scale dense networks for resource efficient image classification[C]//IEEE. Computer Vision and Pattern Recognition,2017.

[20]Wang F,Jiang M Q,Qian C,et al. Residual attention network for image classification[C]//IEEE. Computer Vision and Pattern Recognition. Honolulu,HI,USA,2017:6450-6458.

[21]房爱青,李长勇,黄艳华,等. 草莓采摘机器人的草莓定位算法研究[J]. 现代制造技术与装备,2016(10):90-92.

[22]王粮局,张立博,段运红,等. 基于视觉伺服的草莓采摘机器人果实定位方法[J]. 农业工程学报,2015,31(22):25-31.

[23]张 浩,陈 勇,汪 巍,等. 基于主动计算机视觉的茶叶采摘定位技术[J]. 农业机械学报,2014,45(9):61-65.

[24]司永勝,乔 军,刘 刚,等. 苹果采摘机器人果实识别与定位方法[J]. 农业机械学报,2010,41(9):148-153.

[25]项 荣,应义斌,蒋焕煜. 田间环境下果蔬采摘快速识别与定位方法研究进展[J]. 农业机械学报,2013,44(11):208-223.

[26]张铁中,陈利兵,宋 健. 草莓采摘机器人的研究:Ⅱ.基于图像的草莓重心位置和采摘点的确定[J]. 中国农业大学学报,2005,10(1):48-51.

[27]Qian X,Zhao Y,Han J. Image location estimation by salient region matching[J]. IEEE Transactions on Image Processing A Publication of the IEEE Signal Processing Society,2015,24(11):4348-4358.

[28]吕继东,赵德安,姬 伟,等. 苹果采摘机器人对振荡果实的快速定位采摘方法[J]. 农业工程学报,2012,28(13):48-53.

[29]王 政,张微微,张 宾,等. 基于聚类算法对象提取的快速定位采摘机器人设计[J]. 农机化研究,2016,38(7):45-49.

[30]周海峰,朱云霞. 改进主动形状模型彩色图像目标定位研究[J]. 计算机仿真,2012,29(9):308-311.

[31]石 伟. 基于机器视觉的纸张计数方法研究及其应用[D]. 株洲:湖南工业大学,2016.

[32]李 春. 基于机器视觉的焊接工件识别与焊接轨迹校正方法研究[D]. 广州:华南理工大学,2015.

[33]Vithu P,Moses J A. Machine vision system for food grain quality evaluation:a review[J]. Trends in Food Science & Technology,2016,56:13-20.

[34]Shrestha B L,Kang Y M,Baik O D. A two-camera machine vision in predicting alpha-amylase activity in wheat[J]. Journal of Cereal Science,2016,71:28-36.

[35]兰 红,胡 涵. 结合HSV空间的改进二维Otsu免疫组化图像分割[J]. 计算机应用与软件,2016,33(5):200-203.

[36]蔡式东,杨 芳. 一种基于HSV空间和粗糙集的彩色图像分割方法[J]. 光电子技术,2011,31(1):5-9.

[37]张 铮,徐 超,任淑霞,等. 数字图像处理与机器视觉:Visual C+ + 与Matlab实现[M]. 北京:人民邮电出版社,2014:282-283.

[38]Hu M K. Visual pattern recognition by moment invariants[J]. IRE Transactions on Information Theory,1962,8(2):179-187.

[39]李秀军,梁 爽. 以玉米胚芽鞘为材料的“生长素的发现”系列实验[J]. 生物学通报,2016,51(9):52-54.

收稿日期:2018-09-13

基金项目:中央引导地方科技发展专项资金(编号:黔科中引地[2017]4005);贵州省科技计划(编号:黔科合成果[2016]4008号);贵州大学培育项目(编号:黔科合平台人才[2017]5788-43)。

作者简介:闫建伟(1980—),男,河南鹿邑人,博士,副教授,主要从事特色自动化装备、机器视觉、智能装备研究。E-mail:jwyan@gzu.edu.cn。