基于多尺度边缘融合及SURF特征匹配的车辆检测及跟踪方法*

2019-01-21穆柯楠王会峰景首才

穆柯楠 王会峰 杨 澜 景首才

(1.长安大学电子与控制工程学院 西安 710064;2.长安大学信息工程学院 西安 710064)

0 引 言

对交通流信息进行实时检测,并根据其变化迅速做出交通诱导控制,是智能交通系统(ITS)的一项重要内容。道路交通参数的实时采集与处理方法,已日益成为智能交通研究领域的一项研究热点。基于视频的交通参数提取系统通常在路侧/上方安装工业摄像机,通过对摄像机视野内车道上的车辆进行检测、跟踪,从而获取车流量、车型、车速等重要交通参数[1-3]。

目前车辆检测的常用方法主要有帧差分法、背景差分法、光流法、模型法、特征检测法等。张英等[4]提出一种改进的三帧差分法,通过对帧差分图像和背景差分图像进行融合和形态学处理,实现车辆检测。李搏轩等[5]混合使用混合高斯模型与帧差法区分背景暴露区域与运动车辆区域,以解决传统混合高斯模型存在的运动目标区域检测完整度低、易将背景暴露区错检为运动车辆的问题。CAO[6]用特征光流法将运动物体的边缘信息与光流运动的信息进行多特征融合,对视频图像中运动目标进行准确检测和实时跟踪。WANG[7-9]采用基于模型的方法,将检测到的候选车辆区域与计算机数据库中预先建立的车辆模型进行匹配从而车辆检测与跟踪。基于特征的方法通过检测车辆的局部特征,如对称部件(车轮、头灯、尾灯等)[10-11]、阴影[12]、边缘[13]等特征来定位车辆,而这些特征的提取通常需要通过边缘检测来实现。因此基于边缘特征的车辆检测方法与前者相比,方法简单,耗时短,适合交通参数统计等实时应用。但由于噪声或背景边缘(如车道线、栏杆、树木等)的存在导致该方法的检测结果不准确,因此如何最大限度地检测出车辆边缘同时抑制干扰边缘,成为提高该方法检测准确率的关键问题[14-15]。

目前车辆跟踪的常用方法主要有基于统计学的方法(如粒子滤波法、Kalman滤波法等)和基于特征匹配的方法。然而目前前者类型跟踪方法的主要挑战和攻克难点在于如何抑制跟踪目标漂移现象,以及提高多目标跟踪性能[16-17]。基于特征匹配的跟踪方法,其性能很大程度上取决于所选特征的独特性、稳定性、复杂度和数量几个方面,“少而优”的特征点能够大大提升该类型算法的性能[18]。其中“少”要求特征点的数量能够在降低算法计算成本的同时保证跟踪准确度;“优”则要求特征点能够鲜明且唯一的表征车辆目标,同时具有表征复杂度低和稳定性高的特点。

综合上述问题和研究背景,论文提出了一种基于多尺度边缘融合及SURF特征匹配的车辆检测与跟踪方法。在车辆检测部分,利用图像多尺度分解和多尺度边缘融合,在最大限度地检测出车辆边缘的同时抑制了交通图像背景干扰边缘,再采用适当形态学处理操作确定目标车辆区域;车辆跟踪部分是利用SURF特征匹配方法实现检测车辆的实时跟踪,提取交通图像的SURF特征在保证特征点选取“优”原则的同时兼顾特征低复杂度,根据车辆检测结果建立跟踪样本集合以保证特征点选取的“少”原则,另外提出了车辆跟踪样本更新策略,进一步提高车辆跟踪的实时性和准确性。

1 基于多尺度边缘融合的车辆检测

1.1 多尺度边缘融合

针对传统基于边缘的车辆检测方法易受噪声或背景边缘影响导致检测结果不准确的问题,本节将图像的多尺度信息应用于车辆边缘检测。作者在文献[19]中已经提出一种多尺度融合边缘检测方法,具体思路是:只在原始图像大小的基础上进行1层m阶高斯金字塔分解和1层m-1阶高斯差分金字塔分解,然后对多尺度图像分别进行边缘检测,最后对多尺度边缘进行融合。对经过DoG边缘检测得到的4幅多尺度边缘图像采用多尺度边缘融合策略进行融合,融合得到边缘定位准确、车辆边缘轮廓凸显、细节边缘减少、抗噪能力较高的边缘图像。详细步骤见文献[1-3]。

1.2 车辆检测

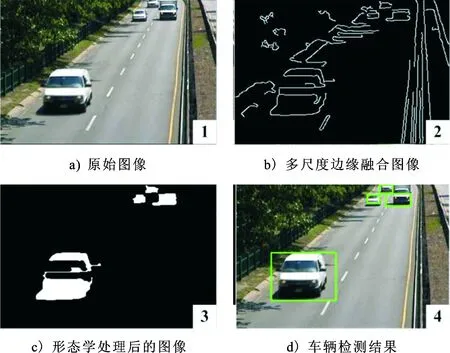

由于环境复杂背景、光照、阴影干扰,多尺度融合边缘图像中除了车辆轮廓边缘以外,还包含部分背景边缘和不连续边缘,需要对其进行适当的形态学处理和连通性分析。为了进一步剔除背景干扰,得到图像中车辆的准确定位,论文结合车辆的几何形状特点建立如下连通域几何约束:对图像所有连通域面积按大小排序,定义面积阈值T=1/2med{Ai|i=1,2,…,t},其中Ai表示各连通域面积,t为连通域数量。若某连通域面积小于该阈值,则视为噪声或背景区域而被剔除,否则为车辆区域。如图1所示为采用论文方法得到的车辆检测结果。

图1 视频序列中单帧图像基于多尺度边缘融合的车辆检测结果。Fig.1 Vehicle detection results of one frame in a video sequence based on multi-scale edge fusion.

2 基于SURF特征匹配的车辆跟踪

在车辆跟踪阶段,首先建立车辆跟踪样本集合(其中跟踪样本为车辆检测阶段获取的运动车辆区域),然后将每个跟踪样本与后续固定帧间隔的交通图像中运动车辆区域进行SURF特征匹配。定义匹配度阈值并制定跟踪样本更新策略,保证车辆跟踪的连续性、准确性,解决驶入、驶离、间歇运动车辆的跟踪问题。

2.1 跟踪样本集定义

(1)

每一个跟踪样本包含了样本序号(l)和其所处的视频帧序号(k),a为样本集中样本总数,b为参与检测与跟踪的视频帧数。

2.2 车辆SURF特征匹配

SURF(speeded up robust features, 加速稳健特征)是图像的尺度不变特征,其特征提取速度大大高于SIFT特征提取。为了在保证特征“优”原则的同时兼顾特征低复杂度,本节采用车辆的SURF特征实现车辆跟踪。

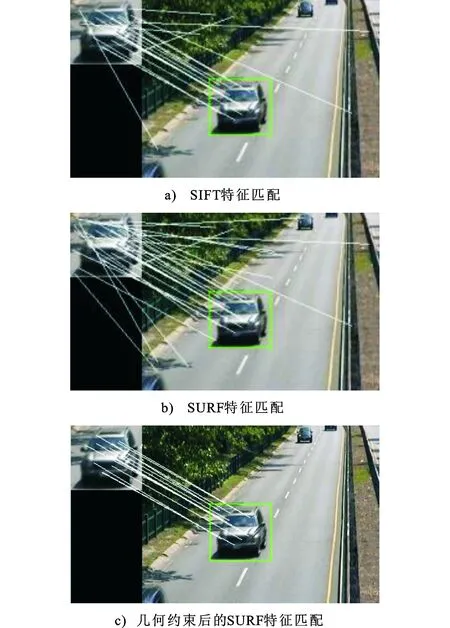

然而,SURF特征提取的高速率是以降低特征提取的准确度为代价的。与SIFT特征匹配结果相比,SURF特征匹配存在的误匹配特征对更多,如图2(a)和(b)所示。本节通过分析跟踪样本集中样本与待跟踪帧中车辆SURF特征匹配的结果,发现跟踪样本在与其所处帧序号相隔的10帧内外观(主要指大小)变化较小,因此“各正确特征匹配点对的匹配连线应互相平行”的特点。据此,定义特征匹配几何约束条件如下。

(2)

则特征匹配几何约束条件定义为

|ki-Ak|≤Δk

(3)

式中:Ak表示所有匹配点对连线的斜率均值。通过多次实验确定当Δk=0.25时去除误匹配点对的效果最佳。图2(c)所示为经过几何约束后的SURF特征匹配结果。

图2 跟踪样本与当前检测车辆的特征匹配结果Fig.2 Feature matching result of tracking sample and current detected vehicle

2.3 跟踪样本集更新策略

在车辆跟踪过程中,车辆运动造成的车辆外观大小改变、车辆驶入、驶离相机视野,车辆间歇性运动,背景缓慢变化(树木晃动)造成的车辆区域误检测都会对跟踪造成困难。若不针对这些情况对跟踪样本集进行实时有效的更新,则当前的跟踪样本集会很快发生退化,从而导致跟踪失败。为此,论文针对以上4类导致跟踪样本集退化的因素,制定如下跟踪样本集更新策略。

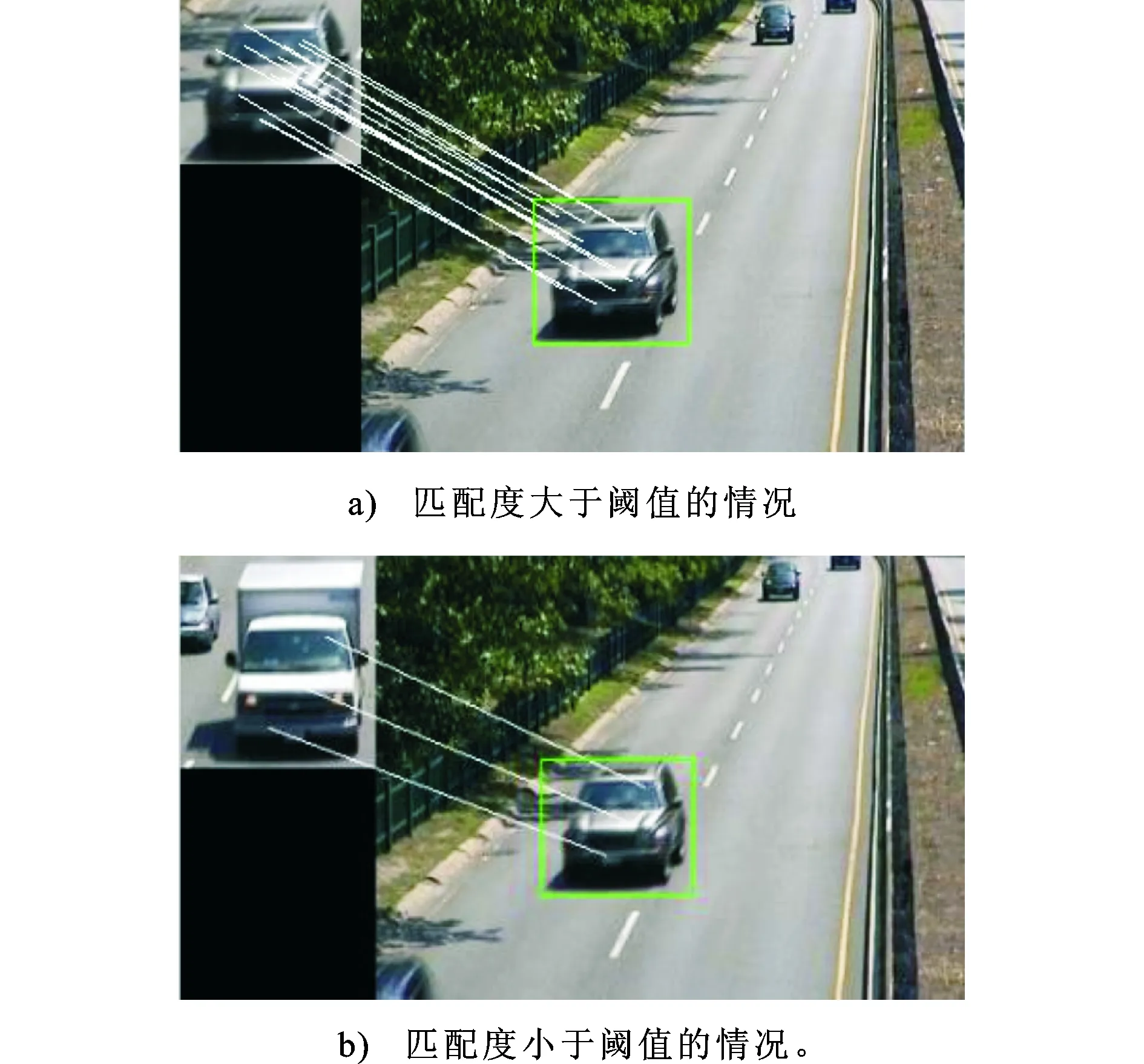

1)若新的图像帧中检测到的运动车辆区域与样本集中某一样本成功匹配(匹配度大于预设阈值),则用新检测到的运动车辆更新对应样本。该操作能够避免由于车辆在一段时间后形态(行驶姿态、靠近或远离相机而导致的大小变化)的明显变化而导致原始样本集退化。

2)若新的图像帧中检测到的运动车辆区域在跟踪样本集中不存在与之匹配的样本时(匹配度小于预设阈值),则视该车辆为新的驶入车辆,将其作为新样本加入跟踪样本集。

3)若跟踪样本集中的某车辆样本在后续的连续两帧中均未匹配成功,则视该车辆为驶离车辆或间歇性运动车辆,将其从样本集中剔除。

4)若跟踪样本集中的某车辆样本在后续的连续两帧中的位置不变(位移小于预设阈值),则视该车辆为间歇性运动车辆或背景干扰(如随风晃动的树木),将其从样本集中剔除。

上述更新策略中的匹配度以及位置偏移定义在2.4节中详细介绍。

2.4 跟踪样本集更新策略中的变量定义

2.4.1 匹配度

(4)

计算出某跟踪样本和运动车辆区域的SURF特征匹配度后,通过设定匹配度阈值,就可以判断两者是否匹配成功。如图3(a)所示为匹配成功的情况,图3(b)为匹配失败的情况。论文采用试验法得到:当TR=85%时平均跟踪性能参数最优。

图3 跟踪样本与当前检测车辆的特征匹配度对比Fig.3 Feature points matching result comparison of tracking sample and current detected vehicle

2.4.2 位置偏移

论文中跟踪样本集更新策略的另一个重要参数是连续帧中对应运动车辆区域的几何中心位置偏移,论文将其用几何中心偏移位移si表示并按如下方式定义:假设某运动车辆区域的像素坐标(左上顶点和右下顶点坐标)为(x1,y1),(x2,y2),其几何中心为

(5)

则连续帧中对应运动车辆区域的几何中心位置偏移计算见式(6)。

(6)

位置偏移阈值TS计算见式(7)。

(7)

图4 车辆检测窗口的几何中心在图像中的运动轨迹Fig.4 Moving trajectory of vehicle detection window′s center in image

其中X×Y为视频帧分辨率,320×240为标准分辨率,二者的比率α为当前视频序列的像素尺寸归一化参数。如图4所示为某一运动车辆区域的几何中心在检测窗口的运动轨迹。假设帧频为F,从车辆驶入相机视野到驶出视野共采集M帧,所需时间为t2,则v表示运动车辆检测窗口几何中心在图像中的平均移动速率,以像素为单位。δ为实验中2个待检测帧的帧间隔数,t1为对应的间隔时间。偏移阈值确定之后,根据条件ΔS≤TS判别静止车辆或干扰区域并将其从样本集中剔除。

3 实验结果及算法性能分析

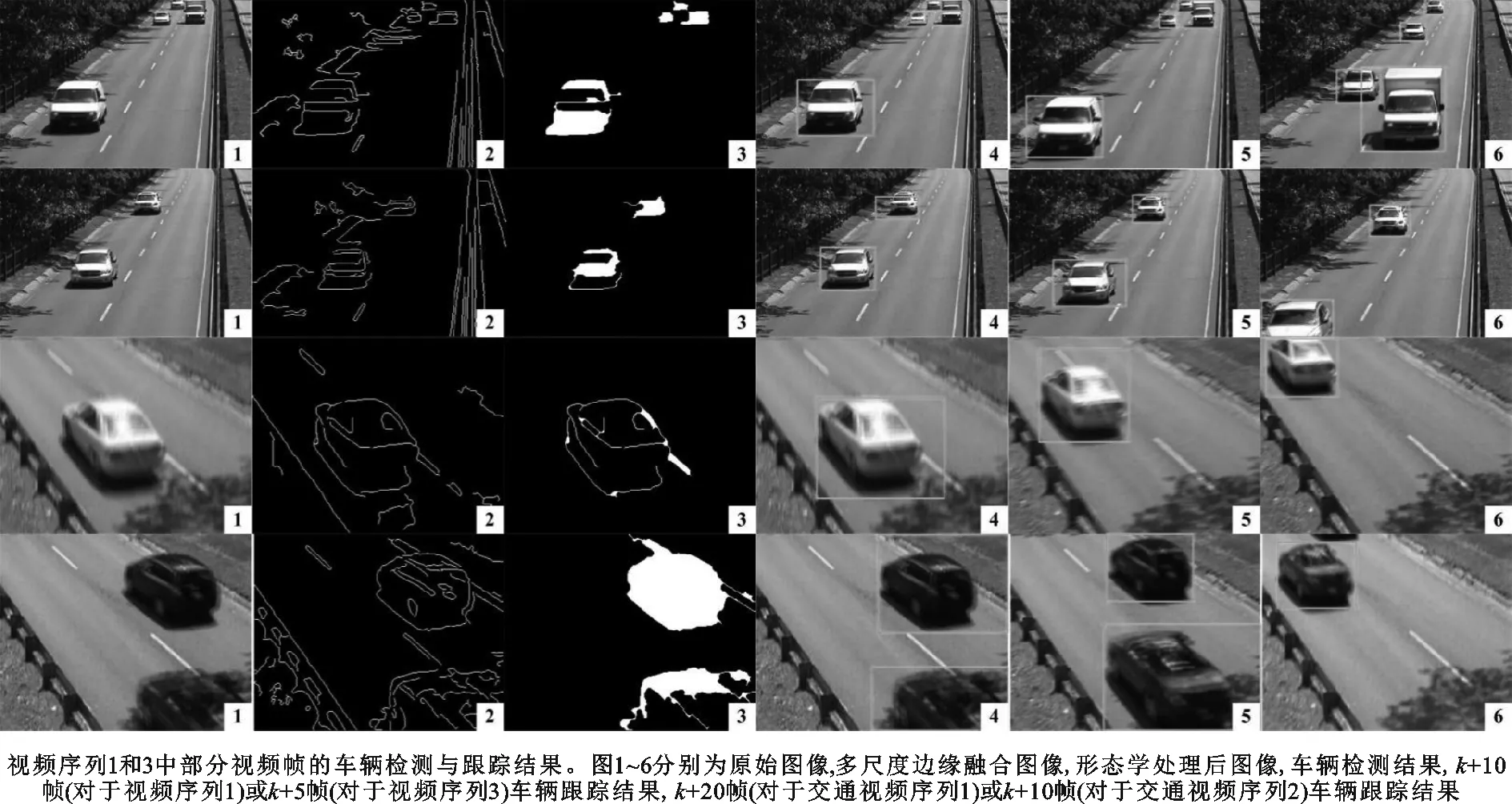

论文在Win10系统下采用Matlab 2012a仿真软件和VC++软件实现算法编程,对5个不同交通场景视频(视频来源:ChangeDetection检测视频集dataset 2012,网址:http://changedetection.net/,包含基准交通视频highway.zip、相机抖动交通视频traffic.zip、路侧交通视频boulevard.zip、背景变化交通视频fall.zip、车辆间歇运动交通视频streetlight.zip 5类)中的运动车辆进行检测和跟踪,以测试论文算法的性能。图5所示为部分交通视频序列中的车辆检测和跟踪结果。

论文算法的车辆检测模块的性能通过检测率和检测准确度2个参数来度量。检测率为t时刻正确检测车辆数pt和pt漏检车辆数lt之和的比值,反映算法的漏检率;检测准确度为正确检测车辆数pt与其和误检车辆数ft之和的比值,反映算法的误检率[20]。2个参数的值越大,表明算法的检测性能越好,计算分别见式(8)~(9)。

(8)

(9)

实验首先对交通视频中的车辆进行人工标定,作为标准参考车辆数,再根据检测结果以及式(8)~(9)计算论文算法的检测率和检测精度2个参数。

图5 视频序列1和3中部分视频帧的车辆检测与跟踪结果。Fig.5 Vehicle detection and tracking results of some frames in video sequence 1 and 3

论文算法的车辆跟踪模块的性能通过跟踪精确度和跟踪准确度2个参数来度量。跟踪精确度表明跟踪算法精确估计车辆位置的能力;跟踪准确度表明跟踪结果与实际车辆保持一致性的能力,反映算法的目标丢失率、误检率、误匹配率[21-23]。2个参数的值越大,表明算法的跟踪性能越好。2个参数的计算见式(10)~(11)。

(10)

式中:di,t为t时刻车辆跟踪位置与实际位置的误差;pt为t时刻正确跟踪车辆的数量。

(11)

式中:mt,nt,ct分别表示t时刻跟踪丢失的车辆数,检测错误的车辆数(即未找到匹配目标车辆的跟踪样本数),错误匹配的车辆数。

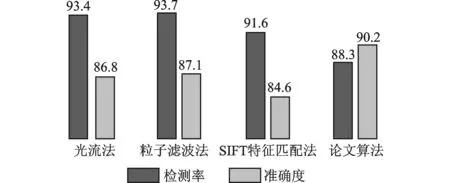

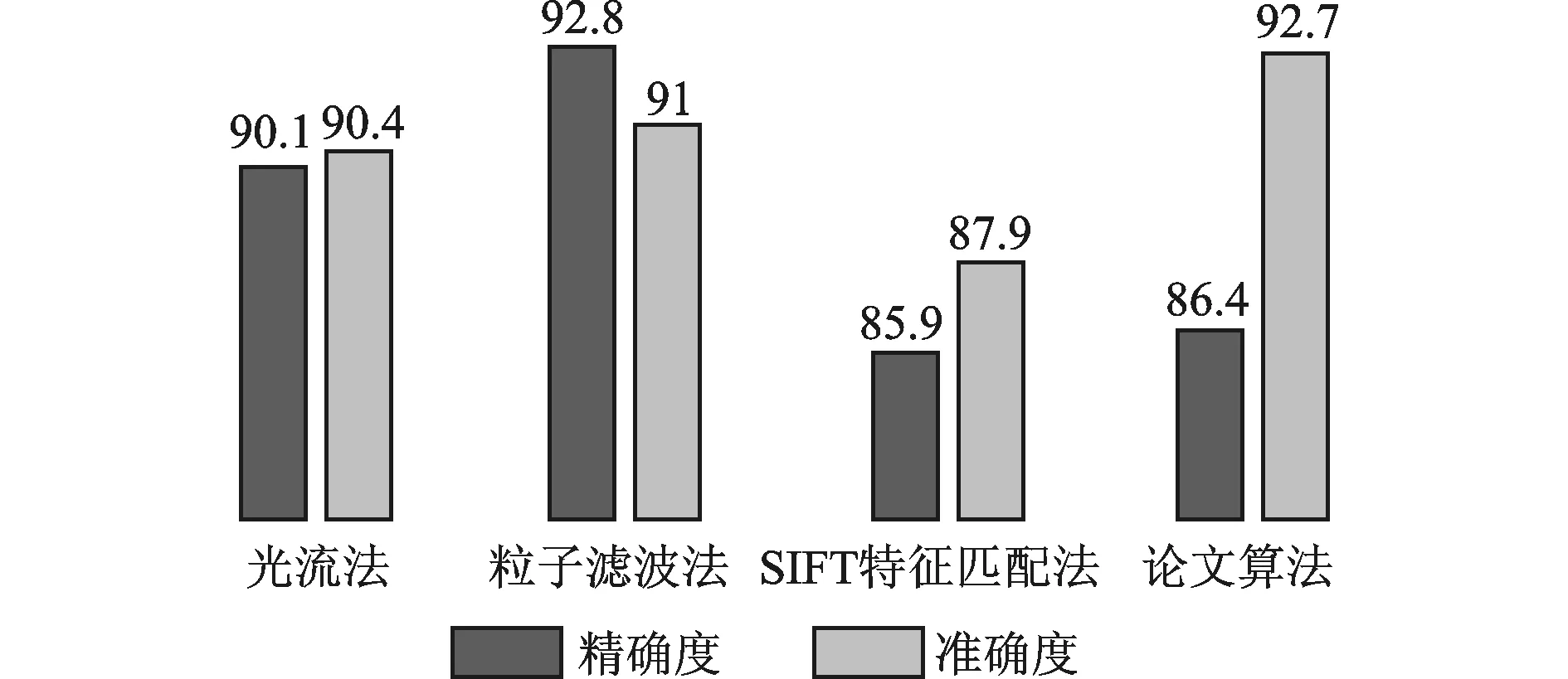

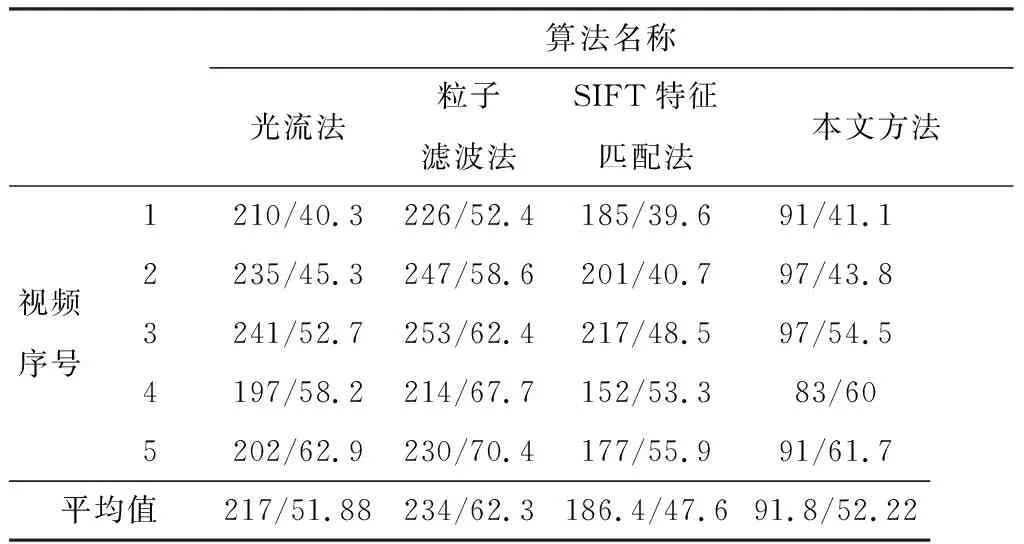

为验证论文算法的检测/跟踪性能和实时性,实验对传统基于光流法的车辆检测与跟踪方法、基于粒子滤波的车辆检测与跟踪方法、基于SIFT特征匹配的车辆检测与跟踪方法,以及本文算法在同一仿真软件平台上进行实现,对各算法检测、跟踪视频序列1~5中100辆车的检测、跟踪结果数据以及耗时数据进行统计平均和对比分析。

1)在论文算法检测和跟踪性能验证阶段,实验首先对交通视频中的车辆进行人工标定,作为标准参考车辆数和标准参考车辆位置,再根据检测、跟踪结果以及式(8)~(11)计算论文算法和其他3种对比算法的检测率、检测准确度、跟踪精确度和跟踪准确度平均值,如图6~7所示。从柱形图可以看出:论文算法的检测率为88.3%,检测准确度为90.2%,检测率低于光流法、粒子滤波法以及SIFT特征匹配法,但具有最高的检测准确度;论文算法的跟踪精确度为86.4%,跟踪准确度为92.7%,跟踪精确度低于光流法和粒子滤波法而高于SIFT特征匹配法,但具有最高的跟踪准确度。分析论文算法检测率和跟踪精确度较低的原因是论文在车辆检测阶段采用的车辆特征是单一的多尺度边缘特征,与其他算法所用的特征相比更易受背景物体干扰,导致漏检测以及检测到的车辆区域几何中心与实际车辆位置差距较大;而算法检测准确度和跟踪准确度较高的原因是论文提出了基于SURF特征匹配的跟踪样本更新策略,能够有效识别检测和跟踪过程中间歇运动的背景干扰和车辆,降低误检测和误跟踪数量。

图6 4种算法检测性能对比(%)Fig.6 Comparison result of vehicle detection performance between the four different methods

图7 4种算法跟踪性能对比(%)Fig.7 Comparison result of vehicle tracking performance between the four different methods

2)在论文算法的实时性验证阶段,实验对各算法处理相同视频序列的耗时进行统计平均,实验结果见表1。从表中结果可以看出论文算法的检测时间成本与跟踪速率分别为91.8 ms和52.2 fps,实时性较其他3种算法更好。论文采用的车辆特征和算法复杂度较低,有效降低了算法的时间成本,更适合交通参数提取的实时性应用。

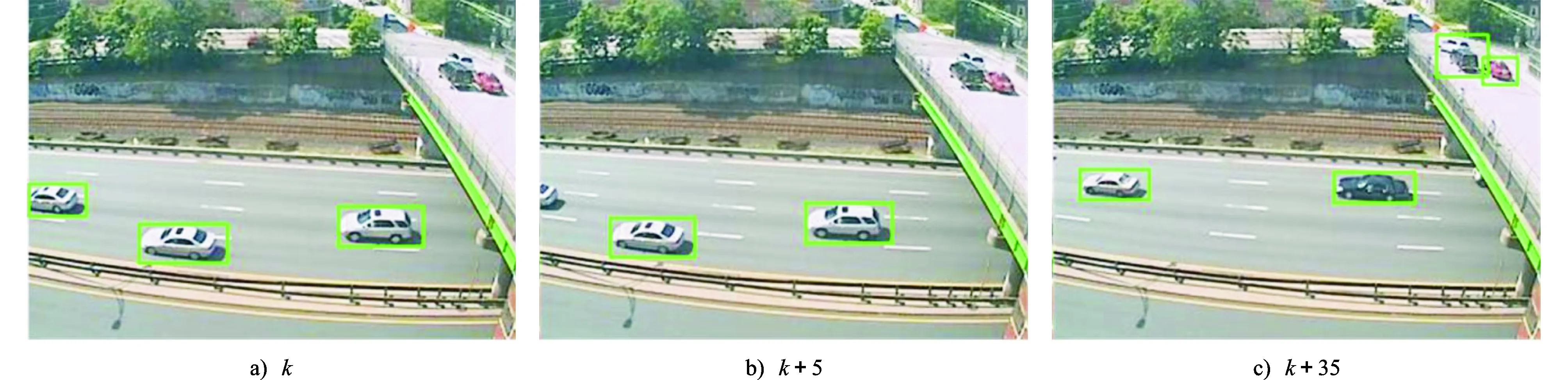

实验进一步对论文所提跟踪样本集更新策略对车辆检测和跟踪性能的影响进行验证。如图8所示视频序列4,背景中存在树木摆动干扰,导致第k帧中将摆动的树干误检测为运动车辆。由于该区域面积较大,因此不能利用面积阈值将其剔除。根据2.3节跟踪样本集更新策略方法,对于第k帧检测到的面积较大的背景区域,在第k+5帧中计算其对应区域检测窗口的几何中心偏移位移。由于相邻帧之间的同一背景区域几何中心偏移很小,因此通过设置偏移阈值可以将该背景区域从跟踪样本集合中剔除,第k+15帧中将不会出现该背景区域。如图9所示的视频序列5包含间歇性运动车辆。第k+35帧中检测到图像右上角车辆并对其进行跟踪,这是由于在第k,k+5帧中该车辆处于静止状态,直到第k+35帧才开始运动,因此检测并跟踪该车辆,同时将其加入跟踪样本集合中。

表1不同算法的车辆检测时间成本(单位:ms)与跟踪速率(单位:fps)Tab. 1Comparison in vehicle detection consumption (unit: ms) and vehicle tracking rate (unit: fps) of different methods

图8 采用论文算法去除视频序列4中背景干扰Fig.8 Result of remove background interference in video sequence 4 using the proposed method

图9 采用论文算法判断视频序列5中间歇性运动车辆Fig.9 Judgement of intermittent moving vehicles in video sequence 4 using the proposed method

4 结束语

笔者研究了基于多尺度边缘融合和SURF特征匹配的车辆检测与跟踪方法。通过采用多尺度边缘融合的车辆检测方法,以解决传统基于边缘特征的车辆检测方法易受噪声、交通背景干扰,导致检测结果不准确的问题。根据车辆检测结果建立跟踪样本集合,通过建立SURF特征匹配几何约束消除误匹配,从而提高特征匹配准确度。针对车辆驶入/驶出相机视野、车辆间歇性运动、背景缓慢变化4种情况,制定跟踪样本更新策略并定义相关变量和阈值,利用SURF特征匹配方法对检测车辆进行实时跟踪。最后,在Matlab2012a仿真平台上采用论文算法对5种不同交通场景的视频序列进行车辆检测和跟踪,并与其他3种典型算法的性能参数进行对比分析。实验结果表明论文算法在车辆检测准确度、跟踪准确度以及时间成本方面的性能有明显的提高。然而论文算法的检测率和跟踪精确度却有待提高。后续工作拟在多尺度边缘特征的基础上融合其他特征,形成一种低复杂度、多维度的车辆特征,以提高车辆的检测率,同时增加车辆基本尺寸信息作为车辆跟踪约束条件,以提高车辆的跟踪精确度,以期在交通参数提取、车辆环境感知等领域中得到广泛应用。