面向视频侦查应用的跨摄像头车辆比对方法

2018-12-28牛宇豪田正方刘满良单大国王新宇

孙 鹏 牛宇豪 田正方 刘满良 单大国 王新宇

(1 中国刑事警察学院声像资料检验技术系 辽宁 沈阳 110035;2 现场物证溯源技术国家工程实验室 北京 100038;3 天津市滨海新区公安局溏沽分局 天津 300450;4 江西省经济犯罪侦查与防控技术协同创新中心 江西 南昌 330103;5 东莞市公安局刑警支队 广东 东莞 523008)

1 引 言

当前的公安执法与办案实践中,以城市视频监控系统为代表的天网工程发挥了越来越重要的作用。依托现有的网络视频监控体系,数以百万计的视频监控摄像头能够实时的向指挥中心传输清晰的视频。在案件侦办过程中,通过监控视频寻找嫌疑车辆获取案件线索,最终锁定抓捕犯罪嫌疑人已经成为当前公安机关的常用手段之一。从海量的视频监控资料当中找出嫌疑车辆则是视频侦查的重点工作。目前,在视频监控中查找嫌疑车辆完全是通过人工的方式进行,从案发调取相关视频资料到找到案件相关线索的时间跨度大,容易出现误判或者漏判,导致犯罪嫌疑车辆具有充分的时间逃逸。根据嫌疑车辆特征进行自动快速的比对查找则是一种高效的方法。通过将包含有嫌疑车辆的视频关键帧与样本车辆的视频截图提取特征点后进行比对,通过相似度的高低来认定该帧所记录的车辆是否为所要查找的嫌疑车辆,从而实现锁定与跟踪犯罪嫌疑车辆的目的。在上述过程中,图像特征的选择在车辆自动比对中至关重要。目前,几何特征、彩色特征、纹理特征等在目标(运动)识别、感兴趣区域匹配方面都得到了广泛的应用。上海大学的徐伟团队[1]通过Harris算法对运动车辆的特征点进行提取从而测得车速。此方法建立在特征点选择恰当的基础上,但在视频信号中并不总是能够准确选取稳定且有效的特征点。国防科学技术大学的唐永鹤团队[2]提出的Laplacian算子对图像的LoG变换响应所描述的局部特征的算法。该方法对图像的角度、亮度、模糊程度的变化不敏感。长沙理工大学的傅明团队提出了一种根据图像主色相似度的差分统计直方图均值的特征提取算法。

上述团队使用各种复杂算法对图像进行处理,然后根据运算结果提取特征,普遍存在着计算量大的问题。Lowe等[3]提出的SIFT算法对于光线、噪声、轻微视角改变不敏感,同时将金字塔结构引入尺度空间从而减少了计算量。该算法计算简单效果显著,特别适用于公安领域的视频侦查、图像特征提取与比对等工作。为更好适应公安工作对实时性的高要求,本文通过将提取视频关键帧,并进行二值化与腐蚀膨胀等预处理得到主体轮廓图像,并与SIFT算法相结合,提出了一种面向视频侦查应用的跨摄像头车辆比对方法。该方法极大的缩短了计算时间,同时能够完成车辆特征识别与比对的预期要求。

2 本文方法

本文在进行SIFT特征提取之前,首先使用帧差法提取视频关键帧,然后利用二值化与腐蚀膨胀等预处理方法降低数据冗余,得到包含犯罪嫌疑车辆形态特征的主体轮廓图像,从而有效地避免了其他方法计算复杂、实时性差的问题。特征提取阶段,通过构建图像金字塔与图像差分金字塔,将二维图像中的每一个点变换至三维空间当中,使其与三维空间中附近邻域的其他点进行图像域与尺度域的比较,如果一个点在运算过程中相对领域取得了极值。那么该点就是极值点,也即SIFT特征点。下一步的工作就是对SIFT特征点的位置、所处尺度与方向这3个数据进行计算与确定。

每个点的方向都是由其邻域的128维方向综合估计得出。邻域中数目最多的方向确定为主方向,邻域中数目比较多的方向确定为辅助方向,最终的特征点方向则是由这些方向综合得出的。如果一个特征点的相邻邻域方向与另一视频关键帧中的某个特征点的相邻邻域方向完全相同,则说明这两个特征点相匹配。如图1所示为本文提出的跨摄像头车辆比对流程示意图。

图1 车辆比对流程示意图

2.1 预处理过程

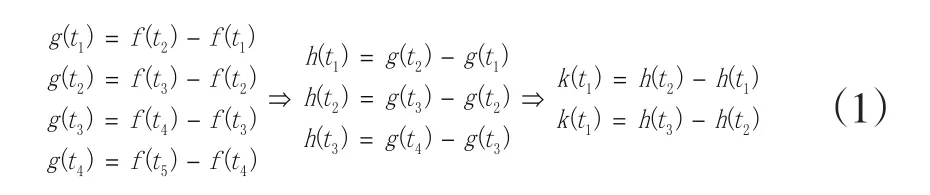

进行预处理的第一步是从海量的监控视频中提取视频关键帧[4-5]如图2,以及关键帧在时间轴向前向后紧邻的4幅帧图像共计5幅图像,将其在RGB色彩空间转换为灰度图像,之后利用帧差法计算:

得到两幅显示车辆轮廓的灰度图像,将噪点少的图像选出,并使用最大类间方差算法测量二值化阈值θ:

根据视频设备与视频设备所处环境的现实情况,对θ值进行人工调整后得到视频关键帧的二值化图像如图3。再用中值滤波器进行滤波去除噪点,通过使用膨胀与腐蚀算法进行计算,使二值图像中汽车的位置值为1而其他位置值为0。设此二值图像为如图4, 在R、G、B三个维度分别为叠加得到仅显示运动车辆的帧如图5。

图2 视频中的待检测帧

图3 灰度图像做帧差法运算

图4 膨胀与腐蚀后得到连通域

图5 将区域显示原RGB图

需要说明的是,上述帧差法运算中使用了视频关键帧与相邻的多幅虚拟帧,从而达到了进一步突出运动物体的效果。帧差法运算之后利用中值滤波器进行去噪处理。之后又进行了多次膨胀操作与腐蚀操作,从而得到最终的车辆主体轮廓图像。图6为未经预处理的图像的SIFT特征点,图7为经过预处理之后得到的主体轮廓图像中的SIFT特征点。

图6 未经预处理的图像中的SIFT特征点(两张图的特征点数量分别是15238与14078)

图7 经预处理的图像中的SIFT特征点(两张图的特征点数量分别是853与748)

2.2 SIFT特征提取与比对

首先构建包含有犯罪嫌疑车辆关键帧的尺度空间[6~7],令I(x,y)表示截取的视频关键帧图像,其所对应的尺度空间L(x,y,σ)定义为:

其中G(x,y,σ)是尺度可变高斯函数:

早期康复护理的具体内容是在患者发病后的24小时内便进行护理干预,不仅加强患者的基础护理,同时,在各个阶段中,根据患者的具体情况指导其进行针对性功能锻炼,引导患者完成强度不同的功能锻炼与康复指导,一方面能够显著改善患者大脑功能的重建效果,促进非损伤区的神经功能,改善机体的肢体功能,一方面也有利于预防患者发生肌肉萎缩[3]。

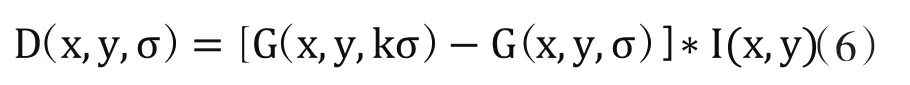

即一个变化尺度的高斯函数G(x,y,σ)与视频关键帧图像I(x,y)的卷积。同时,利用不同的高斯差分核与I(x,y)卷积:

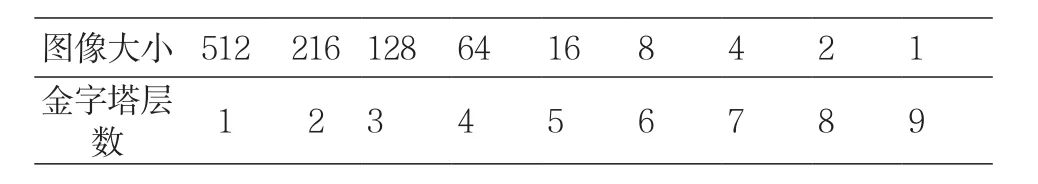

视频关键帧图像I(x,y)在尺度空间的实现则可以用高斯金字塔来表示,高斯金字塔的构建分为模糊和降采样两个步骤。首先使用含有车辆主体轮廓的图像作为金字塔的底层,隔点采样得出的图像则为上一层,通过此方法不断重复的使车辆主体轮廓图像叠加。表1为金字塔层数与图像大小之间的关系,可以看到图像越大,金字塔的层数越小。

表1 金字塔层数与图像大小之间的关系

为了使得关键帧图像尺度拥有连续性,对构成高斯金字塔的主体轮廓图像进行高斯滤波,调整高斯参数得到各层含有不同尺度、同一层含有同尺度不同模糊程度主体轮廓图像的高斯金字塔。如图8为高斯多层金字塔建立的过程。

图8 高斯多层金字塔建立的过程

在实际计算时,依据(6)使用高斯金字塔每组中相邻上下两层图像进行相减:

得到高斯差分空间D(x,y,σ),在此空间中寻找极值点,若某点像素在与相邻像素(空间中与之相邻的26个像素)比较之后是最大或最小值时,就认为该点是该尺度下的一个特征点。同时利用梯度公式计算出(x,y)处梯度的模值与方向:

其中L所用的尺度为每个点各自所在的尺度。图9为车辆特征点相邻邻域的方向向量。为了得出特征点的方向,每个特征点的邻域被划分为4个子区域如图10。邻域域内的像素均进行方向计算并进行权重处理,距离中心越远,权重越小,从而得出特征点的模值与方向。Sift算法利用图像特征点的位置、尺度与方向的对比确定两幅图像(局部)的相似程度。为了确定特征点在4×4×8=128维方向上的参数,图像的特征点的各个邻域方向进行统计,距离远的权重小,最终通过一个柱状统计图如图11来确定方向。若特征点在检材与样本两幅视频关键帧中128维方向向量互相匹配,则判定这两个特征点之间具有一致性[8~10]。

图9 车辆特征点相邻邻域的方向向量

图10 特征点的邻域向量图

图11 方向向量统计图

3 实验

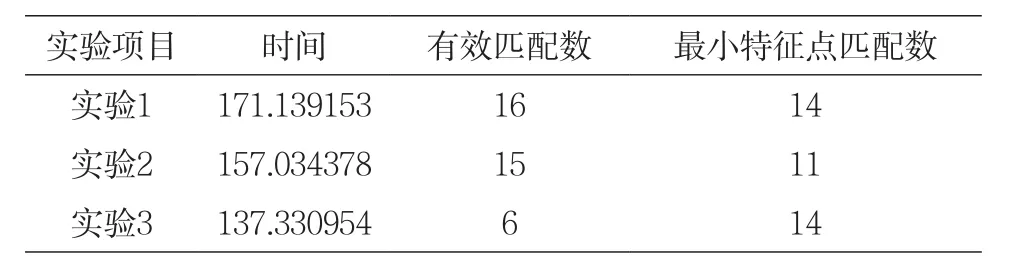

选取若干段视频,分别进行了3组包含目标车辆的视频进行处理与比对实验:第1个实验是同车同角度视频片段进行特征比对,第2个实验是同车不同角度视频片段进行特征比对,第3个实验是不同车视频片段进行特征比对。3个实验分别对包含有车辆的监控视频关键帧进行SIFT特征点比对与连线。

此外,由于摄像头拍摄环境、角度、亮度等问题均会影响不同车辆的特征点匹配,所以在对车辆进行检测前,首先通过若干组实验确定实验所需最小特征点匹配数。在本次实验条件下:①同车同角度进行比对时,匹配特征点至少达到14个。②同车不同角度进行比对时,匹配特征点至少达到11个。

3.1 实验环境

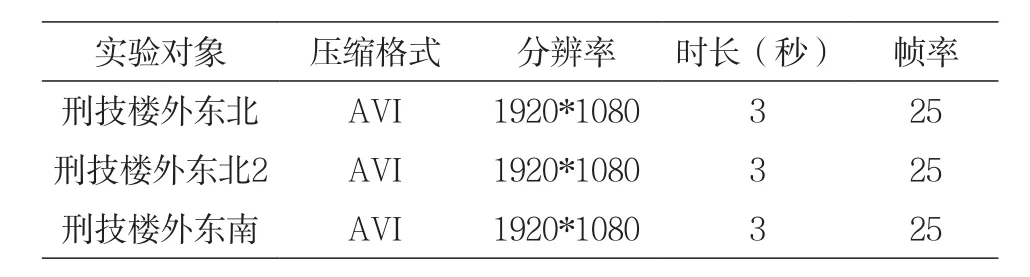

实验环境:PC:MSI GT72 6QD-839;操作系统:Windows 10企业版;软件:MATLAB R2016b。表2为实验中所使用的实验视频的基本属性。

表2 实验对象基本属性

3.2 视频内容

视频内容可以简单描述如下:加装前后保险杠与左右踏板的丰田汉兰达汽车,从北向南沿窄路缓慢进入“刑技楼外东北处卡口”拍摄范围,路两侧均为草地与树木等静物如图12。第2次经过时,车辆与摄像头之间的角度与第1次有所不同如图13。大众速腾汽车与日产尼桑天籁汽车,从北向南沿同一条窄路缓慢进入“刑技楼外东北处卡口”拍摄范围如图14。

图12 同车同角度的视频帧

图13 同车不同角度的视频帧

图14 不同车不同角度的视频帧

3.3 实验及结果

根据实验对象特点,对预处理中二值化参数进行适当调整后,即可以实现跨摄像头的车辆特征比对。图15~17分别对应了3个不同的实验的结果。

实验1中,SIFT检测算法对于同一辆车以相同角度通过同一位置会计算16个有效匹配特征点如图15所示。实验2中,SIFT算法即使对于角度与尺度变化的车辆计算出15个有效匹配特征点如图16。实验3中,SIFT算法对不同车辆进行检测会计算出6个匹配特征点如图17。表3为对上述3个不同的特征点比对实验中时间消耗、特征点有效匹配数、最小特征点匹配数的统计。

通过以上实验可以得出,视频片段中的SIFT特征比对是否能够得出两辆车系同一辆的车的认定结果,源自于每个实验的两张视频关键帧中特征点匹配数量的多少。

图15 实验1的比对结果

图16 实验2的比对结果

图17 实验3的比对结果

表3 实验结果分析

4 结论

通过实验证实,使用本文的比对算法对图像特征点进行查找比对,能够实现对嫌疑车辆进行自动比对的目的,在视频中车辆加装了个性化配饰前提下,仍然准确识别出对象车辆,基本满足预定目标,并为下一步进行视频监控实时比对提供了思路与数据。但是通过多次实验仍然发现该方法有一定的局限性,如车辆通过监控时,摄像头拍摄车辆的角度不易相差过大,否则系统无法自动识别并匹配样本与检材。同时,由于使用的笔记本计算机运算速度的局限性,本算法仍然达不到实时查找与比对自动识别视频中重点内容的方法,将作为公共安全领域中的一个重要方向继续发展,更精确的算法、更快捷的程序均能提高自动识别算法的运算效率。