基于卷积神经网络的玉米根茎精确识别与定位研究

2018-10-20张亚兰陈黎卿黄莉莉

杨 洋 张亚兰 苗 伟 张 铁 陈黎卿 黄莉莉

(1.安徽农业大学工学院, 合肥 230036; 2.安徽省智能农机装备工程实验室, 合肥 230036; 3.中国农业机械化科学研究院, 北京 100083)

0 引言

我国玉米中后期病虫害防治现今仍以人工喷洒农药为主,对施药人员身体健康危害较大,实现自动喷雾作业,推进玉米中后期田间机械化管理是研究的方向。农业机械路径的自动获取是实现自动喷洒农药的关键,路径的获取方式从早期的预埋电缆导航发展到北斗导航、机器视觉导航和激光导航[1],其中视觉导航具有成本低和信息采集丰富的特点,已成为广大学者研究的热点。刁智华等[2]以早期玉米图像为研究对象,采用过绿特征算法识别作物中心线,实现玉米的精准施药。宋宇等[3]以玉米中后期图像为研究对象,提出大田环境下快速、精确提取玉米根茎导航基准线方法,为农业AGV在中后期玉米大田中的自主行走提供了导航方法。还有学者采用机器视觉的方法获取果园、秧苗和棉花等的作业导航线[4-5]。

相比常规方法,近年兴起的卷积神经网络(CNN)方法直接由数据本身特征自我学习,对图像具有极强的数据表征能力,具有适应性好、抗干扰能力强的特点,已在医学[6]、军事[7-8]、人脸识别[9-10]和行为识别[11-12]等领域广泛应用,获得了较好的效果。在农业领域,学者们也开展了CNN在病虫害检测和作物分类识别方面的研究。对于作物病害检测研究,刘德营等[13]提出卷积神经网络模型的白背飞虱识别,孙俊等[14]采用改进卷积神经网络识别植物叶片病害,谭文学等[15]设计了深度学习神经网络实时预警果蔬病害。对于作物分类识别研究,傅隆生等[16]基于卷积神经网络开展猕猴桃图像识别,高震宇等[17]基于卷积神经网络设计了鲜茶叶智能分选系统。

通过对国内外文献的分析可以看出,已有大量学者将CNN应用于农作物分类和病虫害检测,但是对于作物根茎精确识别以及路径规划方面,尚缺乏研究。本文针对农业中玉米行间环境目标检测图像的特点,提出一种以Faster R-CNN为基础,在VGG-16网络上进行迁移学习的目标检测方法。

1 履带自走式热雾机机器视觉系统

1.1 履带自走式热雾机设计

针对玉米作物中后期的病虫害防治,设计了履带自走式热雾机,主要由履带驱动系统、热雾机、电子控制元器件、整机机架等部分组成,如图1所示,集成了图像采集、喷雾作业和田间自走功能。

图1 履带自走式热雾机Fig.1 Crawler self-propelled hot fogging machine1.热雾机 2.控制器 3.机架 4.履带张紧轮 5.锂电池 6.拖轮 7.网桥 8.高清相机 9.驱动系统

履带热雾机自走底盘控制系统采用基于STM32控制核心的电动驱动器,利用双电动机差速控制转向,根据机器视觉规划出的路径,基于滑模轨迹跟踪控制算法[18]实现路径跟踪。

1.2 图像采集系统设计

如图1所示,图像采集设备采用CMOS机器视觉摄像头,图像分辨率为1 024像素×768像素,摄像头安装在履带自走式底盘前方,并利用相机成像原理对相机进行标定。履带自走式底盘设计了减振系统,有效降低图像采集平台振动加速度,提高了图像质量。

履带自走式底盘行走速度设定为1 m/s,视频/图像信号和控制指令通过Alvarion网桥搭建数据链路进行传输,玉米行间有效传输距离大于500 m。图像传输和指令返回时间小于20 ms,图像处理平均时间180 ms,该采集系统能够实现动采集动处理功能。图像处理硬件采用Thinkpad P50移动工作站,Inter Core i7处理器,主频2.6 GHz,内存容量32 GB,Nvidia Quadro M2000M型显卡,显存4 GB。

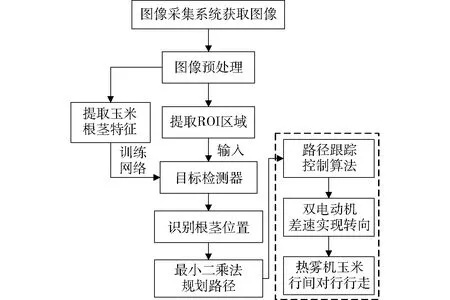

1.3 玉米根茎精确识别与路径跟踪流程

本文旨在通过图像信息识别出玉米田间行驶路径,实现履带自走热雾机的对行行走。首先需要对图像进行预处理,去除噪声并增强图像中的有用信息,提取出单株玉米根茎的特征图像并导入迁移网络进行训练,获得玉米根茎目标检测器。然后基于履带自走热雾机图像采集模块采集图像,并对所采集的图像提取感兴趣区域(ROI),利用已训练好的目标检测器精确识别玉米根茎位置,最后采用最小二乘法识别路径,履带热雾机底盘根据已识别出的路径,采用双电动机差速控制方式实现热雾机自主对行行走,具体流程如图2所示。

图2 玉米田间路径识别流程图Fig.2 Path recognition flowchart of maize field

2 基于卷积神经网络的玉米根茎精确识别模型构建

2.1 基于Faster R-CNN的目标检测方法

随着计算机视觉原理的发展应用,针对图像的目标检测成为近年来计算机视觉领域的研究热点。传统目标检测通过滑动窗口进行区域选择,容易造成窗口冗余,而手工设计的特征对于多样性变化缺乏很好的鲁棒性,对于复杂场景下的目标检测效果不好。

2012年,卷积神经网络(CNN)在图像识别基础上取得了先进的性能,引起科学界的广泛关注。2014年,UIJLINGS等[19]提出区域卷积神经网络(R-CNN),利用selective search算法在图像中提取候选区域并输入到卷积神经网络(CNN),提取卷积特征,通过SVM分类器对候选区域提取的特征进行分类,最后对SVM分类建议区域做边界框回归。

但是,由于该方法对每一个候选区域均做了一次卷积,存在大量的重复运算,随后又提出了Fast R-CNN检测方法[20],该方法将建议区域的特征提取转移到最后一层的卷积特征图上进行,并在之后加了一个针对目标区域的池化层,此外利用Softmax Loss和Smoorh L1 Loss对分类和边界回归联合训练,有效提高了目标检测的精度和效率。

针对建议区域提取低效的问题,文献[21]在Fast R-CNN的基础上,提出了Faster R-CNN检测方法,引入了区域建议网络(RPN),检测网络共享图像卷积特征。至此,目标检测的基本步骤被统一到一个深度网络框架内,不存在重复运算,运算速度得到了显著的提升。

2.1.1区域建议网络

图像识别中的目标检测算法是比较复杂的问题,需要网格结构具有一定的复杂度,如果从零开始建立网络则难以确定合适准确的网络,需在预训练好的模型上进行迁移学习[22],本文基于VGG-16深度网络[23]开展迁移学习,采用Faster R-CNN算法进行训练,卷积核设置为3×3,最小检测对象为32×32。如图3所示,整体结构由两部分组成,一个是区域建议网络(RPN)生成检测框信息,另一个是使用Faster R-CNN检测建议框并识别目标。

图3 基于VGG-16的Faster R-CNN网络框架Fig.3 Faster R-CNN network framework based on VGG-16

输入的图像经过由卷积层、池化层、以及Relu激活函数层组成的特征提取网络后生成特征图层并输入到区域建议网络,区域建议网络也是一种全卷积网络,与Faster R-CNN目标检测网络共享计算,旨在有效地预测各种尺度和高宽比的区域建议。以一个任意大小的图像作为输入,输出一组矩形的对象提议,每个对象提供一个对象评分。

为了生成区域提议,使用一个小网络在由特征提取网络得到的特征图层上滑动扫描。这个网络将输入特征图层的3×3卷积核作为输入,然后映射到一个低维度的特征上。为了解决目标的多尺度问题,需要引入不同尺度、不同长宽比的基准窗。卷积核中心点对应原图上的位置称之为锚(anchor)的中心点,通过设置8、16、32共3种倍数以及1∶2、1∶1、2∶1共3种长宽比,即可得到9种尺度的锚,这样在遍历特征图层的过程中,会生成上万个锚作为初始检测框。

通过图3可以看到,区域建议网络实际分为2条线,上面一条通过分类层(cls)判断这些初始检测框是目标还是背景,下面一条通过回归层(reg)预测检测框的中心坐标(x,y)、宽度w和高度h,进而获得精确的建议区域。而最后的Proposal层则负责综合考量分类和回归的问题,同时剔除过小以及超出边界的区域。

2.1.2损失函数

为了训练区域建议网络,需要为每个锚分配一个二进制类标签用于判断建议区域是目标还是背景。针对建议区域与期望区域重叠部分的占比I,一般设定I大于0.7的区域为目标,分配正标签;I小于0.3的区域为背景,分配负标签。对于I在0.3和0.7之间的a锚,以及跨越图像边界的锚则需要舍弃。重叠部分占比I定义为

(1)

式中A——建议区域面积

B——期望区域面积

一个建议区域可以包含多个锚,因此一个建议区域可以包含多个正标签。其中,I阈值的设定对于训练结果也会造成很大的影响,这个参数的最佳值通过下文的评价指标得到。

将Faster R-CNN中的多任务丢失后的目标函数最小化,图像的损失函数定义为

(2)

式中i——一个锚的索引

Ncls、Nreg——分类层数和回归层数

pi——目标锚的预测概率

ti——预测边界框的4个参数化坐标参数

Lcls——目标与背景两个类的对数损失

Lreg——目标与背景的回归损失

λ——权重

分类层(cls)和回归层(reg)的输出分别由pi和ti组成,这两项由Ncls和Nreg归一化,并由平衡参数λ加权(默认λ=0,因为平均精确率在很宽范围内对λ不敏感)。因此分类层和回归层项的权重大致相等,对于边界框回归,采用文献[24]中的4个坐标参数,分别为

(3)

式中x、y、w、h——预测区域框横坐标、纵坐标、宽度、高度

xa、ya、wa、ha——建议区域框横坐标、纵坐标、宽度、高度

x*、y*、w*、h*——期望区域框横坐标、纵坐标、宽度、高度

tx、ty、tw、th——建议区域框横坐标、纵坐标、宽度、高度的损失量

2.2 玉米根茎精确识别模型

针对玉米作物行间环境,建立专门的目标训练数据集,基于Faster R-CNN目标检测方法对数据集进行训练和测试,所有的测试评估均在核心配置为E5-2620 CPU 与NVIDIA Quadro K5000 GPU的图形工作站上进行。整个目标检测网络在 Matlab 2017a 上构建完成。

2.2.1训练样本库建立

基于图像采集系统采集玉米作物行间图像,针对玉米根茎目标构建专用目标样本库。如图4所示,共采集了1 000幅相似图像,可以看出,图像中包含多株玉米作物、杂草,以及存在玉米茎叶干扰遮挡的现象,虽然绿色特征较为明显,但是根茎携带部分泥土特征,并且不同光照条件下绿色特征也不同,采用传统的图像处理方法难以准确地区分,体现了玉米作物行间环境的复杂性。排除掉较远较小的根茎,每幅样本图像约可以提取10个单株根茎样本。

图4 田间玉米图像Fig.4 Corn picture in field

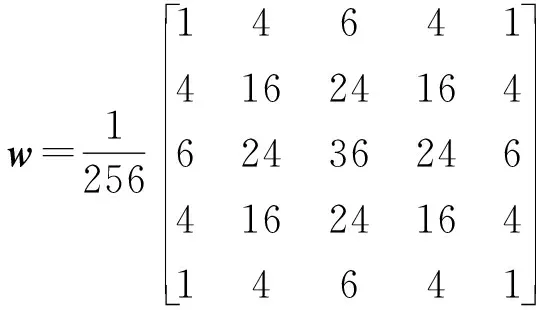

为了缩短训练时间,对每幅图像提取只包含单株玉米根茎的样本图像,并将样本图像的尺寸统一化,本文首先基于高斯核构建图像的DOG金字塔模型。高斯核是被证明的唯一可以产生多尺度空间的核[25],通过对同一幅输入图像进行不同尺度的高斯卷积,可以使图像平滑,高斯金字塔表达式为

(4)

(5)

式中N——高斯金字塔层数

x、y——图像像素点横坐标、纵坐标

Gk(x,y)——第k层图像

Rk、Ck——第k层图像的行数和列数

w(i,j)——二维可分离的5×5窗口函数

i、j——卷积层图像的行数和列数

通过式(4)完成下采样及平滑处理。

在高斯金字塔的基础上,利用高斯差分对图像进行上采样,即可构成图像的DOG金字塔模型。根据此模型将单株玉米根茎图像分辨率统一缩减至同一尺度,将裁剪得出的图像组成目标训练数据集,采用Matlab中的Training Image Labeler工具箱对样本图像具有根茎特征的目标进行标定,如图5所示。

图5 玉米根茎人工标定图Fig.5 Corn root artificial calibration diagrams

2.2.2单株玉米根茎识别

将数据集按照9∶1分为训练集和测试集两部分,对单株玉米根茎进行训练,图像输入层对输入的图像提取建议目标区域,会存在大量的重复和冗余的部分,这些多余的部分会拖慢检测效率,因此将最大建议区域设置为2 000像素,初始学习速率为1×10-5。设定完成后对网络进行训练,步骤如下:

(1)单独训练RPN网络,得到建议区域。

(2)将步骤(1)得到的建议区域作为输入,单独训练Faster R-CNN检测网络,此时两个网络仍是分开训练,还没有共享卷积层。

(3)利用Faster R-CNN检测网络训练RPN,此时固定网络公共的卷积层,只微调RPN独有的参数。

(4)固定网络公共的卷积层,利用RPN网络微调Faster R-CNN检测网络,只更新Faster R-CNN独有的参数。

通过以上步骤创建了一个用于检测的统一网络,训练完成后对测试集进行目标检测。

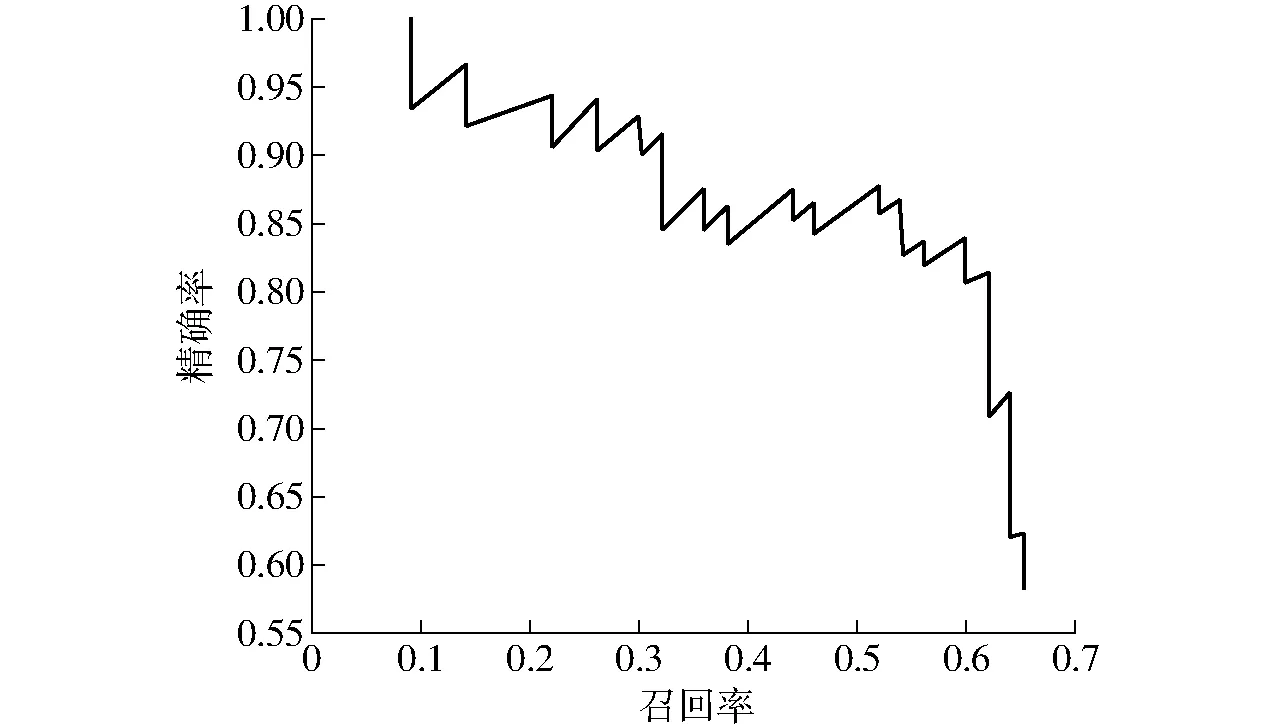

为了评估目标检测器的训练效果,还需确定相应的评价指标。召回率和精确率是最常用的两个评估标准,召回率为目标图像被成功检测出来的比例,而精确率是检测到目标的图像中真正包含目标的比例。理想状态下两者都越高越好,但召回率和精确率具有负相关性,一般情况下难以保证两者均达到较好的数值,所以需要针对情况综合考虑,在玉米作物行间环境中要实现路径识别的功能,最重要的是能成功检测出目标区域,可以容许存在一定的检测误差,但是如果出现没检测到的根茎目标时,就会对后期的路径识别带来较大的影响,所以召回率的作用更为重要。图6为对测试集进行目标检测后目标检测器的召回率和精确率的关系曲线,可以看出,当召回率大于0.6时,检测的精确率会有较大幅度的下降,平均精确率为0.62。

图6 召回率与精确率耦合关系Fig.6 Relationship of recall rate and precision coupling

图7为对单株玉米根茎识别的部分测试结果,从图中可以看出,训练的目标检测器对目标根茎识别的效果比较理想,回归检测得出的目标框可以很好地包含根茎的特征,即使存在光照、阴影以及部分根茎被玉米茎叶遮挡的现象,通过训练模型也可以准确地识别。

图7 单株玉米根茎识别图Fig.7 Precise identification diagrams of single corn plant roots

2.2.3玉米行间环境下的玉米根茎识别

在以单株玉米根茎为目标训练得出的深度学习网络模型的基础上,本节对玉米行间环境下的多株玉米根茎进行检测。从图4可以看出,路径两侧的玉米根茎作为识别的主体部分,但玉米叶片部分的图像意义不大,会对结果造成干扰,所以在识别前对玉米作物行间图像进行预处理,提取感兴趣区域(ROI),不仅能消除干扰,还能够提高检测器的运算速度,增加识别效率。

通过对玉米行间图像进行对比分析,定义感兴趣区域为图像下半部的以路径为主体的多边形对称区域,如图8a所示,利用设定的感兴趣区域对图像进行掩模处理,得到的图像如图8b所示。

图8 感兴趣区域提取结果Fig.8 Region of interest extraction result

对预处理后的图像进行路径检测,如图9所示,在感兴趣区域中,不仅特征明显的目标根茎能够被准确地识别,即使有的根茎被茎叶遮挡,依然能被检测器识别,并且达到了较理想的检测精度。不过仔细观察图中路径尽头能够发现,存在部分极小的目标根茎没有被检测到的现象,这是因为目标根茎所占区域过小时,由于特征缺失导致检测器误判,所以在训练过程中通过对回归边界框设定最小尺寸来最大限度地规避这种可能。

图9 整幅图像玉米根茎精确识别结果Fig.9 Accurate recognition results of corn roots

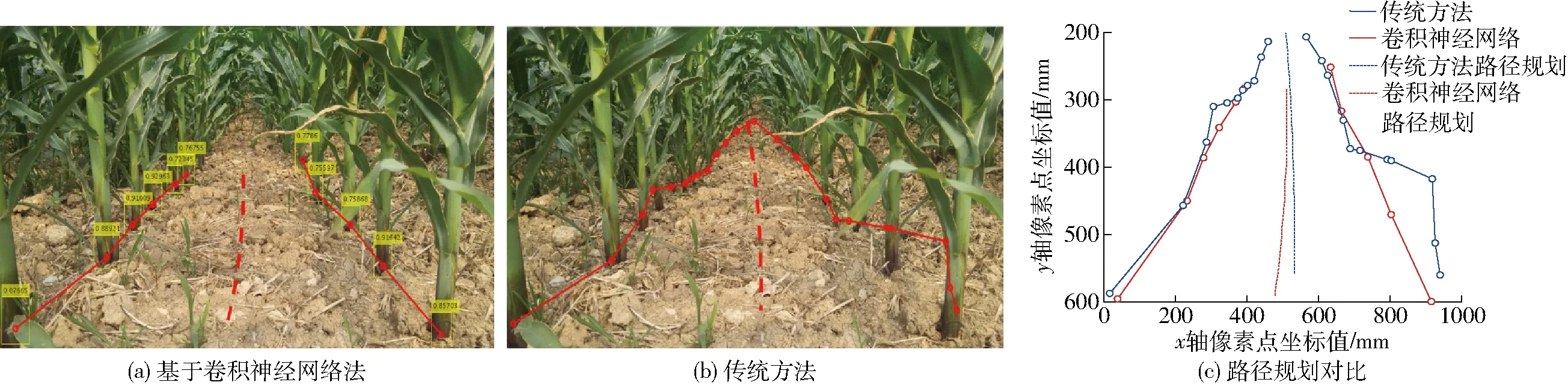

图11 理想环境下卷积神经网络与传统方法对比Fig.11 Comparison of Faster R-CNN with traditional methods in an ideal environment

3 试验与结果分析

试验地点为安徽省宿州市埇桥区灰古镇安徽农业大学皖北实验站,玉米植株行距60 cm,玉米田农艺行距为80 cm,图像采集平台为履带自走式热雾机,试验现场如图10所示。

图10 田间试验现场Fig.10 Test scene in filed

采用本文提出的方法对玉米根茎进行识别与定位,两种不同场景下的识别结果如图11a和图12a所示,根据检测器识别出的目标根茎,提取出回归边界框内的定点,构成路径的基准点。对获取的基准点采用三次样条插值的方法来获得两侧的根茎行线,之后对两侧根茎行线沿图像行方向提取的中点采用最小二乘法进行拟合,最终得到行驶路径,如图11、12中虚线所示。

为了说明本文所提出方法的优越性,采用传统图像处理方法对相同图像进行处理,并与本文方法进行对比。传统图像处理的详细过程在此不再赘述,其大致方法[3]如下:由于玉米秸秆图像包含典型的超绿特征,采用2G-R-B算法提取颜色特征因子,对采集的图像进行Otsu自适应二值分割,以及膨胀、腐蚀、去除小面积等形态学操作,将玉米作物从土壤背景中提取出来。对于分割后的二值图像,沿列方向进行垂直投影变换,可以获得玉米根茎的下部轮廓,通过对图像进行分析可以得出,根茎部位的投影值表现了局部极大的特征,所以对轮廓求极大值即可得到根茎的特征点。但得出的一系列点还包含许多无关以及重复的特征,会对路径的识别造成干扰。根据相机“近大远小”的成像原理,可以对这一系列定位点进行二次判断,从路径尽头的点沿行方向向两边搜索,距离镜头近但投影值较小的点被判断为伪特征点,需要舍去,基于该方法得到的结果如图11b、12b所示。

图12 非理想环境下卷积神经网络与传统方法对比Fig.12 Comparison of Faster R-CNN and traditional methods in non-ideal environments

图11a、11b为理想状态下的两种方法识别结果,图11c中蓝线和红线分别为采用传统图像处理和深度学习方法得出的根茎行线以及行驶路径线,深度学习能够精确识别玉米根茎,而传统图像处理方法虽然能获得两侧的根茎行线,但由于部分根茎缺乏典型的绿色特征,无法准确地识别根茎位置,从图11b能够得到,传统方法对于单个根茎难以做到准确定位,有的根茎被识别出多个特征点,而且在两株玉米秸秆之间的杂草也容易被误识别成根茎的特征点,图11c表明两种方法得出的行驶路径线具有差别,传统方法无法准确实现玉米根茎精确定位。

图12为视线被玉米茎叶遮挡下的两种方法结果对比。由于深度学习的方法是通过识别目标根茎来获得行驶路径,从图12a可以看出,在此场景下根茎以及路径信息依旧被清晰地识别出来,而传统图像处理的方法只是根据颜色特征分割玉米和土壤获取玉米根茎位置,难以精准识别每一个根茎,从图12b可以看出,有的根茎没有被识别,而且由于玉米茎叶的遮挡,导致了错误识别,最终规划出错误的路径。从图12c可以看出,两种方法得到的路径具有明显区别,传统方法得到的路径无法满足热雾机行间对行行走。

表1为两种方法检测结果的统计,本文方法相对于传统图像处理方法的精确率有了很大提高,虽然检测速度稍微慢了一些,但是不影响导航的准确性。

表1 统计结果Tab.1 Statistical results

由于本文选取的训练样本为玉米抽雄期根茎照片,基于卷积神经网络训练的识别模型无法适用于玉米其他生育时期根茎的精确识别,图13为采用本文训练的模型识别玉米拔节期玉米根茎的失败案例。因此在后续研究中需训练不同时期的玉米根茎识别模型,以提高识别模型的适用性。

图13 根茎识别失败案例Fig.13 Rhizome identification failure case

4 结束语

针对履带自走式热雾机玉米行间对行自主行走的需求,研究了玉米根茎精确识别与定位方法,在预训练网络模型VGG-16的基础上进行迁移学习,建立了玉米根茎检测网络,模拟人眼识别的功能自动从复杂田间环境中准确识别和定位玉米根茎。利用履带自走式底盘作为图像采集平台,获取玉米作物田间图像,采用模型DOG金字塔算法提取图像中的目标根茎,构成样本训练数据库。试验结果表明,本文提出玉米的根茎识别与定位方法与传统的图像处理方法相比,具有更好的定位精度,能够实现对玉米作物田间路径的准确识别,实现履带自走式热雾机玉米行间对行行走。