基于模型融合和特征关联的视频目标跟踪算法

2018-06-20岳文静

季 露,陈 志,岳文静

(1.南京邮电大学 计算机学院,江苏 南京 210023;2.南京邮电大学 通信与信息工程学院,江苏 南京 210003)

0 引 言

视频目标跟踪要求确定运动目标在视频连续序列图像中的位置[1]。这个过程通常用到模型匹配、均值漂移等方法[2-4]。上述方法在低噪声条件下对运动目标跟踪效果较好,但是在高噪声条件下会严重地降低跟踪性能,并且在运动目标数量增长和目标间相互遮挡的情况下,跟踪失效的可能性将大大增加。Liu等在均值漂移算法的基础上结合边缘与中心加权法计算巴氏系数,以此判断目标变化以增减核窗宽,该方法准确率较高,但在高噪声条件下目标丢失严重[5]。Meshgi等利用颜色直方图对目标建模,通过迭代得到与目标模型相似度最高的区域,该方法实时性高,但容易受到目标尺度变化和遮挡的影响[6]。Dong等针对跟踪过程中出现的遮挡问题提出了基于NMI的运动搜索跟踪算法,该方法提高了目标跟踪的鲁棒性和抗噪声性,但是计算复杂度较高[7]。

可见,普遍存在的背景噪声和大规模视频目标跟踪的应用需求使得视频多目标跟踪算法设计需要解决以下问题:

(1)背景噪声干扰。视频中场景通常呈现动态特征,如随风摇摆的树枝、光照变化等,这些噪声将影响目标提取的准确性。

(2)遮挡问题。目标运动过程中通常伴随着目标间相互遮挡和场景中其他静物遮挡等问题。在目标被遮挡的情况下,跟踪算法将无法继续准确跟踪。

(3)稳定跟踪问题。目标跟踪实际上是特征匹配的过程,在多目标的特征匹配中容易出现混乱,造成跟踪不稳定或失效。

良好的视频多目标跟踪算法需要有较强的抗噪性和鲁棒性,能够克服目标区域检测不完整问题,同时解决目标间相互遮挡导致的跟踪失效。为此,结合对称帧间差分法[8]、滑动平均背景法[9]、金字塔光流法[10]和卡尔曼滤波法[11],设计一种视频多目标跟踪算法,解决上述问题,提高在噪声环境中目标区域检测的完整性和多目标跟踪的准确率。

1 基于改进对称帧间差分和滑动平均背景差分的目标轮廓提取

视频目标检测是指从序列图像中将运动目标从背景图像中提取出来,获得准确的检测结果是目标跟踪的关键[12]。为准确提取运动目标轮廓,现改进对称帧间差分法,对相邻的四帧图像进行两两差分,得到的差分图像再两两进行逻辑“或”运算,接着结合改进后的对称帧间差分和滑动平均背景差分提取出运动目标轮廓。算法具体描述如下:

1.采用改进的对称帧间差分法提取出运动目标轮廓,具体如下:

(1)判断是否已读取四帧图像,如果不足四帧,则将当前帧进行灰度化处理[13]后继续读取。

(2)对连续四帧图像两两进行差分并利用Otsu阈值分割算法[14]得到最优阈值T,以对差分图像进行二值化处理。为了避免运动目标边缘空洞,消除图像中的孤立噪声,对二值图像进行了形态学膨胀和腐蚀运算。

(3)对二值图像两两进行“或”运算后对结果再次进行“或”运算,提取出运动目标轮廓D1。

2.采用滑动平均背景差分法提取出运动目标轮廓,具体如下:

(1)判断当前帧是否是第一帧,如果是则将第一帧图像当作初始背景。

(2)对当前帧图像与背景图像进行差分并设置阈值T'对差分图像进行二值化处理,提取出运动目标轮廓D2。

(3)对背景图像进行更新,在当前帧中,对于已经判断为运动目标的像素点,仍保持原来的灰度值;对于已经判断为背景图像的像素点,则按照式1进行更新。

(1)

3.将两次提取出的运动目标轮廓D1和D2进行“与”运算,对结果进行区域连通性分析后准确提取出运动目标完整轮廓D。为了简化运算,规定将运动目标轮廓的中心点作为运动目标的质心。

2 基于金字塔光流法的质心跟踪

为使跟踪算法能快速运行,保证实时处理时不丢帧,下面将视频图像按高斯金字塔[15]分解向下采样,对采样后的图像利用光流法进行质心跟踪。具体算法描述如下:

(1)判断当前帧是否是第一帧,如果是则将第一帧中检测到的运动目标轮廓作为角点的初始值并存入向量P[0]。

(2)构建高斯金字塔进行光流计算,预测出角点在下一帧中的位置并存入向量P[1]。

(3)去除不好的特征点,对跟踪成功角点的数目和坐标分别进行累加。

(4)交换向量P[0]和P[1],同时利用跟踪成功的角点坐标计算中心坐标,估计出运动目标的质心位置,将角点跟踪转换成质心跟踪。

3 基于卡尔曼滤波的多目标跟踪和特征关联

为解决目标遮挡导致的跟踪失效,提高多目标跟踪的准确率,下面引入卡尔曼滤波模型和匈牙利算法。卡尔曼滤波根据当前帧运动目标质心坐标预测出运动目标在下一时刻的质心坐标,接着利用匈牙利算法[16]计算最优匹配进行特征关联,最后修正卡尔曼滤波参数,实现对运动目标的精确定位和跟踪。具体算法描述如下:

1.对卡尔曼滤波器参数进行初始化,获取运动目标的质心坐标等参数。

2.设k时刻运动目标的质心检测集合是Dk={d1,d2,…,dn},利用卡尔曼滤波对Dk中的每个运动目标质心di进行预测,得到质心坐标预测值pi,即质心坐标预测集合为Pk={p1,p2,…,pn}。设k+1时刻运动目标的质心检测集合是Dk+1={d1,d2,…,dm},将质心预测坐标和下一时刻检测坐标的欧氏距离作为效益矩阵,利用匈牙利算法计算最优匹配进行特征关联,对质心坐标预测值Pk和下一时刻检测值Dk+1进行指派,其中欧氏距离计算见式2。

(2)

其中,(x1,y1)表示质心预测坐标;(x2,y2)表示下一时刻质心检测坐标;d表示欧氏距离。

3.在实际跟踪过程中,需要考虑跟踪失效和跟踪遗漏的情况,去除跟踪器中不满足要求的部分,同时为未指派的检测建立跟踪单元,具体原则如下:

(1)去除跟踪器中不满足要求的部分:匹配成功的质心坐标预测值和检测值之间的间隔帧数为f,欧氏距离为d,如果f和d满足式3,则认为跟踪丢失,要对此检测值重新跟踪。

f>fmax或d>dmax

(3)

其中,fmax为最大消失帧数;dmax为最大距离阈值。

(2)为未指派的检测在跟踪器中建立跟踪单元:设k时刻预测值的数量为n,k+1时刻检测值的数目为m,n 4.为了确保跟踪过程的准确性,需要不断修正卡尔曼滤波器参数,具体原则如下: (1)如果金字塔光流法跟踪成功并且当前的运动目标质心坐标预测值和下一时刻检测值匹配成功,则将检测值和金字塔光流法预测值进行加权平均作为最终观测值,更新卡尔曼滤波参数。 (2)如果金字塔光流法跟踪成功并且当前的运动目标质心坐标预测值和下一时刻检测值匹配失败,则将卡尔曼滤波的预测值作为最终观测值更新卡尔曼滤波参数。 (3)如果金字塔光流法跟踪失败并且当前的运动目标质心坐标预测值和下一时刻检测值匹配成功,则将检测值作为最终观测值更新卡尔曼滤波参数。 5.根据跟踪过程中运动目标的质心坐标变化绘制出目标的跟踪轨迹,完成多目标跟踪过程。 在下面的实验中,实验样本数据为不同分辨率的交通视频,场景为城市道路或者高速公路,视频均为AVI格式,其中视频1分辨率为1 280×720,帧率为23 F/s,视频2分辨率为1 280×720,帧率为29 F/s,视频3分辨率为320×240,帧率为25 F/s,视频4分辨率为352×240,帧率为29 F/s。算法均采用VS2013和OpenCV2.4.11开发,运行于Intel 2.3 GHz,内存4 G的Windows 7平台。 为验证基于改进对称帧间差分和滑动平均背景差分的视频目标检测算法(简称ISMA算法)的有效性,下面在视频2上进行测试,并将实验结果与对称帧间差分法、滑动平均背景差分法、VIBE算法和帧间差分法进行比较,各算法检测对比结果如图1所示。 图1 各算法检测效果对比 由图1可见,对称帧间差分法获得了完整的连通域和运动目标轮廓,但是却造成了运动目标拉长、轮廓模糊问题;滑动平均背景差分法和VIBE算法对光线变化比较敏感,同时检测过程中会出现“鬼影”,影响检测结果的准确性;帧间差分法检测的运动目标轮廓内部和边缘存在空洞;ISMA算法填补了运动目标轮廓的空洞,避免了目标的拉长,使得轮廓清晰并且受环境噪声干扰较小,准确地提取出运动目标轮廓,具有较好的鲁棒性。 为验证基于模型融合和特征关联的多目标跟踪算法(简称MFFA算法)的有效性,下面在视频1~4上进行测试,将实验结果与匹配跟踪算法进行比较。各算法在目标是否存在相互遮挡情况下的跟踪效果对比如图2和图3所示。 从图2可以看出,当运动目标不存在遮挡并且目标之间互不干扰的情况下,匹配跟踪算法和MFFA算法均可以实现稳定跟踪。但是当目标出现遮挡或者目 图3 各算法在目标存在相互遮挡 标之间相互干扰时,观察图3可知,匹配跟踪算法会出现跟踪混乱,导致多目标跟踪失败,而MFFA算法依然可以实现稳定跟踪,正确绘制出跟踪轨迹。 为证明MFFA算法的准确性,规定从目标出现到目标消失过程中,若跟踪算法在期间的每一帧都能准确地跟踪到目标车辆,则认为跟踪成功,否则认为跟踪失败。表1给出了匹配跟踪算法和MFFA算法的准确性比较。 表1 匹配跟踪算法和MFFA算法的准确性比较 根据表1,MFFA算法的准确率在视频1~3上分别比匹配跟踪算法高出8.3%,13.8%和6.2%,显著地提高了多目标跟踪的准确率。 下面比较匹配跟踪算法和MFFA算法的跟踪误差,采用视频4作为实验数据,图4给出了两种算法的跟踪误差对比结果。 图4 匹配跟踪算法和MFFA算法的跟踪误差对比 从图4可以看出,在跟踪前期MFFA算法和匹配跟踪算法的跟踪误差相差不大,随着跟踪过程的持续,匹配跟踪算法的跟踪误差远远超过了MFFA算法的跟踪误差。可见,MFFA算法进行多目标跟踪效果好于匹配跟踪算法。 为解决存在背景噪声的大规模视频多目标跟踪问题,提出了基于模型融合和特征关联的多目标跟踪算法。该算法结合改进后的对称帧间差分法和滑动平均背景差分法准确提取出运动目标轮廓,然后融合金字塔光流法和卡尔曼滤波进行目标跟踪,并利用匈牙利算法进行数据关联,最后绘制出运动目标的跟踪轨迹实现多目标跟踪。实验结果表明,该算法可以准确地提取出运动目标轮廓,在目标间相互遮挡的情况下保持稳定跟踪,提高了多目标跟踪的准确率和抗噪性。 在后续研究中,可以考虑将单帧的图像信息和帧与帧之间的变化信息进行融合,从时空关系上对视频进行深度分析,寻找合适的深度学习架构来实现视频多目标跟踪也是值得探索的方向。 参考文献: [1] 黄 奇,项 俊,侯建华,等.联合特征融合和判别性外观模型的多目标跟踪[J].中国图象图形学报,2015,20(9):1188-1198. [2] 刘大千,刘万军,费博雯.前景判别的局部模型匹配目标跟踪[J].中国图象图形学报,2016,21(5):616-627. [3] 邸 男,朱 明,韩广良.似然相似度函数在目标跟踪中的 鲁棒机理研究[J].软件学报,2015,26(1):52-61. [4] 齐美彬,岳周龙,疏 坤,等.基于广义关联聚类图的分层关联多目标跟踪[J].自动化学报,2017,43(1):152-160. [5] LIU Zongang,DU Xiaoxue,PAN Diansheng.A new tracking algorithm based on mean shift and particle filter[C]//Proceedings of the 2016 IEEE/RSJ international conference on intelligent robots and systems.Washington,DC:USA:IEEE Computer Society,2016:38-42. [6] MESHGI K,ISHII S.Expanding histogram of colors with gridding to improve tracking accuracy[C]//Proceedings of the fourteenth IAPR international conference on machine vision applications.[s.l.]:[s.n.],2015:475-479. [7] DONG Jiwen,ZHAO Lei,ZHANG Liang.The face tracking research based on cam-shift and improved NMI[C]//Proceedings of the 2013 international conference on computational and information sciences.Washington,DC:USA:IEEE Computer Society,2013:148-151. [8] 郭文俊,常桂然.基于三帧间的移动障碍物背景目标提取算法[J].软件,2016,37(2):58-62. [9] 熊 波,尹周平.滑动平均和改进权重函数的快速非局部平均图像去噪算法[J].中国图象图形学报,2012,17(5):628-634. [10] PLYER A,BESNERAIS G,CHAMPAGNAT F.Massively parallel Lucas Kanade optical flow for real-time video processing applications[J].Journal of Real-Time Image Processing,2016,11(4):713-730. [11] LIGORIO G,SABATINI A M.A novel Kalman filter for human motion tracking with an inertial-based dynamic inclinometer[J].IEEE Transactions on Biomedical Engineering,2015,62(8):2033-2043. [12] 石祥滨,张 健,代 钦,等.采用显著性分割与目标检测的形变目标跟踪方法[J].计算机辅助设计与图形学学报,2016,28(4):645-653. [13] LI Chenglong,WANG Xiao,ZHANG Lei,et al.Weighted low-rank decomposition for robust grayscale-thermal foreground detection[J].IEEE Transactions on Circuits & Systems for Video Technology,2017,27(4):725-738. [14] 高跃明,伊腾增,韦孟宇,等.二维Otsu和改进区域生长法的荧光免疫层析试条浓度的定量检测[J].传感技术学报,2016,29(9):1356-1360. [15] 赵毅力,周 屹,徐 丹.微距摄影的多聚焦图像拍摄和融合[J].中国图象图形学报,2015,20(4):544-550. [16] YADAIAH V,HARAGOPAL V V.Multi-objective optimization of time-cost-quality using Hungarian algorithm[J].American Journal of Operations Research,2016,6(1):31-35.4 实验与结果分析

4.1 视频目标检测仿真实验

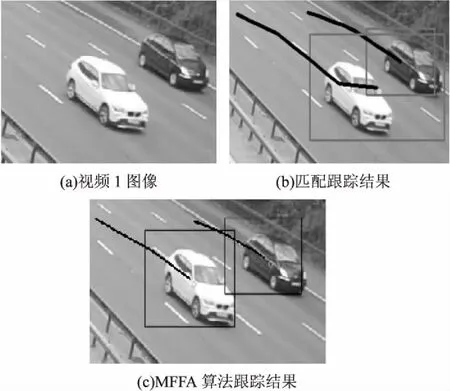

4.2 视频多目标跟踪仿真实验

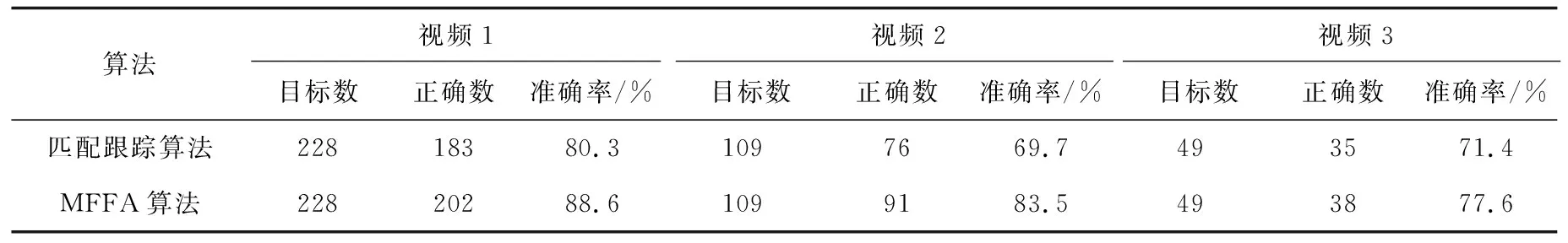

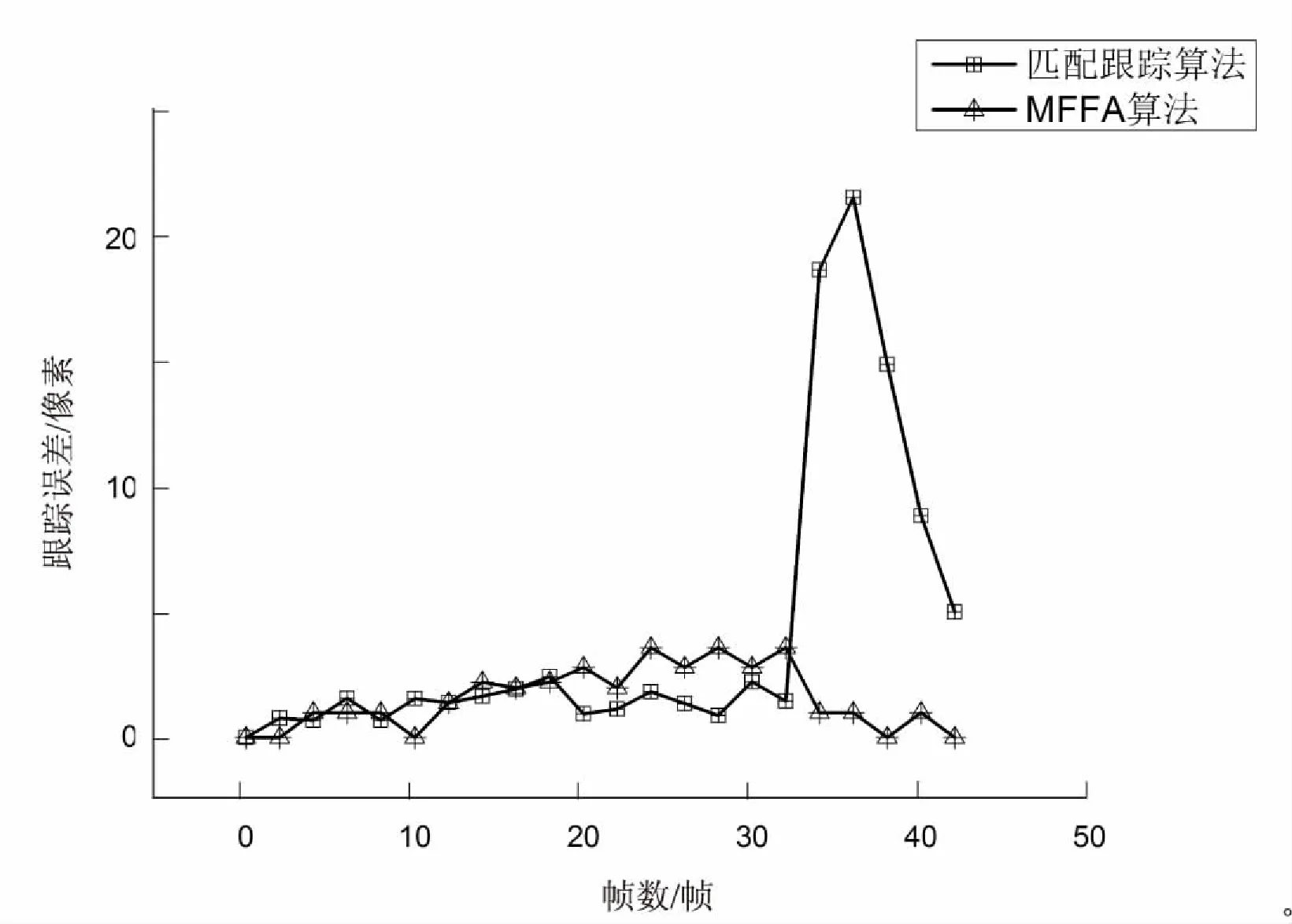

5 结束语