改进的卷积神经网络在行人检测中的应用*

2018-05-09谢林江季桂树罗恩韬

谢林江,季桂树,彭 清,罗恩韬

中南大学 信息科学与工程学院,长沙 410083

1 引言

行人检测指的是判断待处理图像或者视频帧中是否含有行人,如果有行人,给出标注。它是机动车辅助驾驶[1-3]、智能视频监控[4]、智能机器人以及人体行为分析[5-6]等应用中的关键技术,近些年来成功地应用于直升机等飞行器拍摄的图片中[7]以及在地质灾害中的受困人员搜寻与营救[8-9]等新兴领域。但在实际应用中行人图像容易受到光照、穿着、姿态、遮挡以及拍摄角度的多样性等影响,使得行人检测成为计算机视觉领域的研究难点与热点。目前,行人检测的方法主要有传统的检测方法和基于神经网络的检测方法。

传统的检测方法主要是通过图像相邻像素之间的关系来得到其特征表达。文献[10]提出的梯度方向直方图(histogram of oriented gradient,HOG)通过计算像素梯度方向直方图来构成特征。但是HOG特征的维度高,计算量大,难以满足实时性的要求。文献[11]利用积分图技术来提高HOG特征的计算速度,但还是未能解决特征维度高的缺点。文献[12]提出了局部二值模式(local binary pattern,LBP)算子,其根据每个像素点与周围像素值大小比较进行编码,得到LBP特征图谱,具有旋转不变性和灰度不变性等显著优点。文献[13]将LBP特征作为行人的特征描述子,同样取得了较好的检测效果。文献[14]提出了模板匹配的方法,该方法虽然在检测速度和检测率上有所提高,但其需要人工标注模板且存在泛化能力不强的缺点。

为了克服传统方法中需要人工标注模板以及特征维度高的缺点,文献[15]将卷积神经网络(convolutional neural network,CNN)应用到行人检测中,利用CNN具有从原始像素中学习辨别特征的能力,显著减少了计算量。文献[16]把区域提案网络(region proposal network,PRN)和级联分类器相结合,运用到行人检测中,提高了检测的准确率。文献[17]提出了多尺度CNN模型(multi-scale CNN,MS-CNN),在不同层生成一个目标检测子网,提高了CNN对小物体的检测能力。文献[18]通过对行人属性分析和语义任务来优化行人检测,降低了误检率。

本文结合了复杂的行人姿态、背景属性以及人眼视觉行为的分析,在网络的卷积层前加入选择性注意层,以减少复杂背景的干扰,同时突出了行人特征,以达到更高的检测结果。为了验证本文方法的优越性,分别在INRIA、NICTA和Daimler行人数据集上进行实验,与传统的CNN模型检测效果进行对比,实验结果表明,改进的CNN模型具有更高的准确率。

本文主要贡献有:(1)提出一种改进的CNN模型,即在传统CNN的基础上增加了一个选择性注意层,用来模拟人眼的选择性注意功能;(2)在选择性注意层,分析了两种选择性处理方法,并与传统CNN模型进行实验对比,分析不同处理对检测结果的影响,找到最佳的处理方式;(3)将改进的CNN模型在INRIA、NICTA和Daimler行人数据集上进行实验,取得了比传统模型更好的效果。

2 相关理论

2.1 选择性注意原理

为了对目标的存在性做出判断,传统CNN在卷积过程中会对整幅图片进行无差别特征提取,但实际上人们所关注的内容通常仅仅是图像中很少的一部分。这种特征提取方式不仅加重了分析难度,又造成了计算的浪费。文献[19-20]在对猫和猴的视觉皮层研究时,发现了一些对外界某种具有一定方向或朝向的刺激有强烈反应的视神经细胞,被称为方向选择性细胞。文献[21]研究发现人眼在面对复杂场景时能够迅速地将注意力集中并优先处理一些显著的目标上,这里存在一个视觉选择性注意机制,这种机制使得视觉皮层在有限的神经元下很好地处理视觉信息。

文献[22]通过对视觉注意研究,提出了一个称为特征整合理论的视觉注意假设,把注意力选择分为并行特征提取和串行特征融合两个阶段。文献[23]提出了一个视觉选择性注意模型,将选择性注意应用到目标检测上,在计算结构上模拟人脑的视觉选择性神经机制,最终计算得到应用场景的视觉显著图。文献[24-25]通过对原图像提取候选检测区域来模拟人眼的选择性注意功能,加快了检测速度。

以上方法都是采取候选框策略来模拟选择性注意功能,更小的候选框意味着更快的计算速度。然而在实验中发现,当目标在原图像中占比过大或者很小时,候选框可能未能完全覆盖目标或者还有很大一部分背景区域,这样就会给检测任务带来困难。并且人眼在观察物体的时候并不是简单地框出一个候选区,还会感知整个区域的结构或边缘信息,之后再进行细节上的处理[26-27]。

在行人检测中,行人背景变化多样,姿态也存在一定变化,但是行人的整体结构却相对固定。因此本文尝试在整个区域应用选择性注意原理,对输入图像进行纹理或者梯度操作,突出行人结构。实验证明,在行人检测中,与不进行预处理相比,改进的CNN模型能有效提高行人识别率。

2.2 图像预处理

在行人图像中,通常存在着光照强度变化、视角变化、行人姿态变化以及行人背景多样性等干扰。为了减少这些干扰对CNN的影响,对行人图像进行选择性处理,突出行人结构特征,是一种可行的方式。根据方向选择性细胞对图像的纹理与边缘表现出较强的选择性,本文将分析在选择性注意层分别采用纹理预处理和梯度预处理对实验结果的影响。

2.2.1 纹理特征预处理

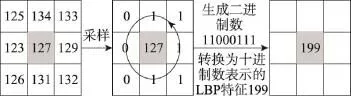

图像纹理特征描述了图像或者图像区域所对应的物体的表面性质,其本质是研究图像相邻像素点灰度的空间分布情况。LBP纹理特征是一种局部纹理描述算子[28],其在图像纹理上具有较好的表达能力。LBP纹理特征具有旋转不变性和灰度不变性且对光照变化不敏感。文献[29]将LBP纹理特征作为行人特征的描述子,在实际应用中取得了较好的效果。LBP的基本思想是:以窗口中心点(x,y)的灰度值为阈值,用相邻的8个灰度值与其进行比较,若相邻像素的灰度值大于中心点的值,则该像素标记为1,否则标记为0,从像素点(x-1,y+1)逆时针排列得到二进制编码,最后转换为十进制数即为像素点(x,y)的特征值。本文采用的窗口大小为3×3,则LBP特征的计算公式为:

其中,(xc,yc)为3×3邻域的中心元素,它的像素值为ic;ip代表邻域内其他点的像素值;s(x)为符号函数,定义如下:

其LBP特征生成图如图1所示。

Fig.1 Schematic diagram of calculation of3×3LBP operator图1 3×3LBP算子计算示意图

对图像每个像素依次进行LBP特征计算,可得到该图像的LBP纹理特征图。

2.2.2 梯度预处理

图像在计算机中以数字图像的形式存储,即图像是离散的数字信号,因此可以把图像看成一个二维离散函数,函数的求导即为图像梯度。

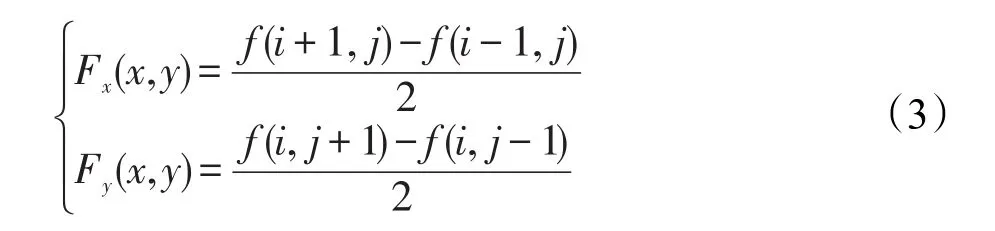

定义1(梯度图像)设f(x,y)表示一幅图像,Fy为图像水平方向的梯度,Fx为图像垂直方向的梯度,则有:

其中,f(i,j)为图像(i,j)点的像素值。然后计算梯度图像Grad(x,y):

梯度图像能够更好地适应图像的变化趋势,通过计算梯度,可以去除图像上的局部极小值和噪声,而且可以去掉与边界无关的信息,突出行人边缘轮廓。

3 本文CNN模型

卷积神经网络作为一种前馈神经网络,是近年发展起来,并引起学者广泛重视的一种高效识别方法。其通过局域感受野、权值共享和池化实现识别位移、缩放和扭曲不变性。局域感受野指的是网络层的神经元与前一层的某个区域内的神经单元连接,通过局域感受野,每个神经元可以提取初级的视觉特征;权值共享使得卷积神经网络只需要较少的参数就能完成对数据的训练;池化通过降低特征的分辨率减少计算量,防止过拟合。在行人检测中,为了减少复杂背景对检测效果的干扰,本文提出一种改进的CNN模型,即在第一个卷积层前加入一个选择性注意层。模型结构如图2所示。

Fig.2 Preprocessing CNN model图2 预处理CNN模型

3.1 选择性注意层

传统CNN在卷积过程中直接对原图像进行特征抽取。通过研究发现,在行人检测中,行人图像通常以房屋、道路、车辆为背景,且行人的非刚性特点,致使CNN在特征提取过程中时常会学习到其他错误的特征,干扰最终检测效果。

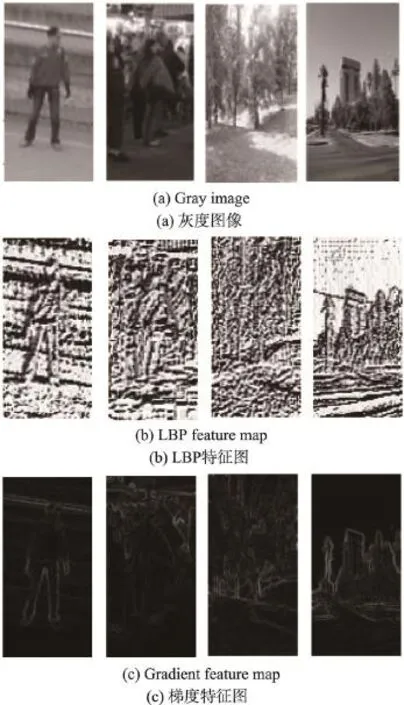

在传统CNN的输入层后加入选择性注意层,模拟人眼的选择性注意功能。选取LBP纹理预处理和梯度预处理为该层运算。图3是部分样本不同预处理效果对比。从图3(a)与图3(b)的对比可以得出,图3(b)把图3(a)的行人的背景差异全部转为纹理的差异,并突出了行人轮廓。再对比图3(c),梯度图像过滤掉了绝大部分噪声,仅仅保留了图像的边界信息。实验表明,当把LBP纹理预处理作为该层运算操作时,比传统CNN具有更高的识别率。

Fig.3 Effect contrast on different pretreatments of some samples图3 部分样本不同预处理效果对比

3.2 卷积层

卷积是卷积神经网络的特征提取操作,其过程如图4所示。

在卷积层,特征图的每一个神经元与前一层的局部感受野相连接,与一个卷积核进行卷积,经过卷积操作提取图像的局部特征。卷积层的计算公式为:

Fig.4 Convolution operation diagram图4 卷积操作示意图

其中,表示第l层的第j个特征图;为网络权重(卷积核);f(x)为激活函数;为偏置;Xil-1为网络的输入。CNN的输入为初始图像或者卷积层和下采样层生成的特征图。卷积核内部的参数和偏置通过反向传播算法进行训练,卷积核的初始值为随机生成,偏置b的初始值为0。卷积核的大小确定了运算区域的大小,卷积核中权值的大小对应了其节点的贡献能力,权值越大贡献越大,反之越小。

3.3 下采样层

在下采样层中,为了减少网络参数,并提高对图像平移、伸缩不变性,在计算图像局部特征时,需要对图像局部进行统计和分析,得到该局部的特征表达,这个统计和分析过程在CNN中被称作为池化。池化的基本原理是根据图像相对不变性的属性,对图像相邻区域的特征信息进行聚合统计。具体操作为:

其中,down(x)为池化函数;表示第l层第j个特征图对应的权重系数;b为偏置。对于一幅图像I,尺寸为M×N,采样窗口为s×s,则得到特征图的大小为(M/s)×(N/s),本文CNN的采样窗口为2×2。最常见的两种池化方法为平均值池化和最大值池化。平均值池化是对池化域内所有值求和并取其平均值作为下采样特征图的特征值;最大值池化则是取池化域中的最大值作为下采样特征图的特征值。本文采用的是平均池化,将池化的结果加上偏置b进行计算,遍历原特征图的池化域后,得到下采样特征图。

4 实验与分析

为了验证本文算法的性能,在INRIA[30]、NICTA[31]和Daimler[32]3个公开的行人数据集上进行测试。对于每个数据集,先将两个数据集中的所有图像大小缩放为128×64像素,然后在相同条件下重复10次实验,每次实验迭代(epoch)200次,每次批序列(batch size)大小为32张图像,取10次结果的平均值为实验的最终结果。采用均方误差和正确率对模型进行评价。实验使用英特尔i7-4510U处理器,8 GB内存,GeForce840M显卡,在Matlab2016环境下进行。

4.1 INRIA数据集测试结果

INRIA行人数据集是当前使用最广泛的静态行人检测数据库,拍摄条件多样化,背景复杂,存在人体遮挡、光线强度变化等情形,检测难度较大。该库分为训练集和测试集,训练集中有2 416张正样本和912张不含行人的负样本,测试集中有1 126张正样本和300张负样本。

在INRIA数据集上,对本文CNN模型采用LBP纹理和梯度两种不同预处理方式进行对比实验。图5是两种不同处理方式的均方误差及正确率随迭代次数变化曲线图。

从图5(a)可以看出,梯度预处理的均方误差曲线在训练初期波动较大,继续增加训练次数,二者都得到了收敛,但LBP纹理预处理方式比梯度预处理方式收敛得更快更好。从图5(b)可以看出,LBP纹理处理方式的正确率始终高于梯度预处理方式的正确率。由上可知,采用LBP纹理预处理方式优于梯度预处理方式。结合图3可以发现,采用梯度处理后的图像仅仅留下图中行人及其他背景物体的轮廓,其他大部分都是黑色,致使CNN无法学习更加详尽的特征,最终使得检测率不高。因此本文将采用LBP纹理预处理作为选择性注意层运算方式。

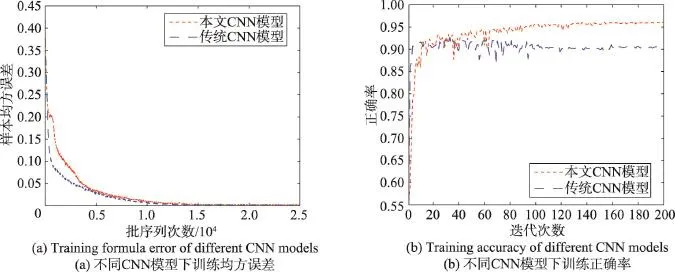

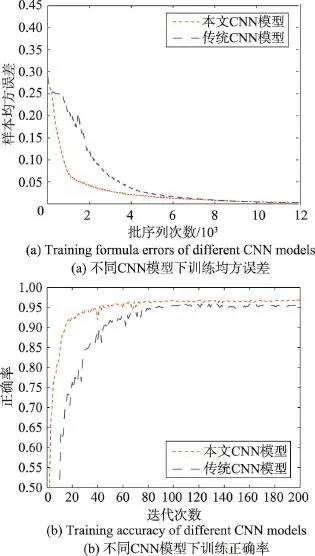

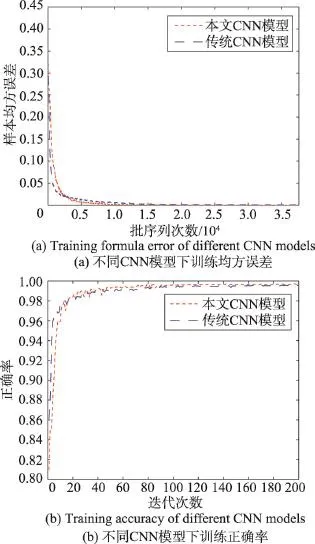

然后继续分析本文改进的CNN模型和传统CNN模型实验效果的对比,如图6所示。

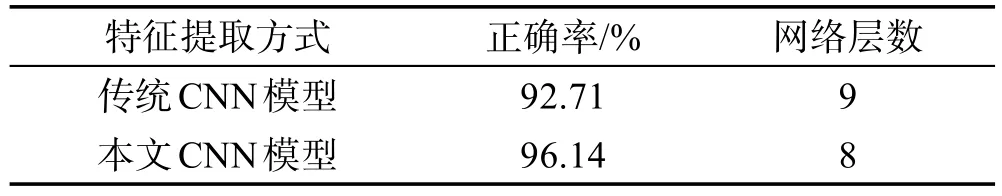

由图6(a)可知,两种模型的均方误差曲线收敛都比较快,而从图6(b)中可以发现,在训练初期,传统CNN模型与本文CNN模型的正确率曲线波动都比较大且二者的差别不大,但随着迭代次数的增加,二者的正确率曲线逐渐稳定,且本文CNN模型的正确率曲线在传统CNN模型之上。再结合表1可以看出,相对于传统CNN模型而言,本文CNN模型的正确率提高了3.33%,达到了96.14%。

Fig.5 Result comparison of different pretreatments图5 不同预处理结果对比

Fig.6 Result comparison of different CNN models图6 不同CNN模型结果对比

Table 1 Correct rate comparison of different pretreatments表1 不同预处理正确率对比

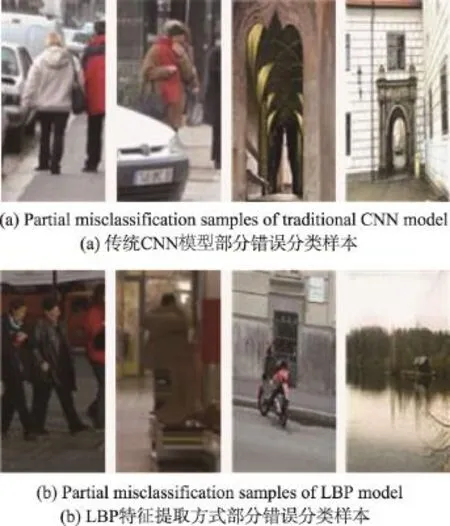

图7是不同CNN模型部分错误分类样本。从图7(a)中可以看出,即使是很明显的行人也不能正确分类,却把形状轮廓与行人相似的负样本误认为是行人,而图7(b)中的行人衣着与背景十分相似,对于某些图片,即使是人眼也可能误判。

由此可以说明,传统CNN模型在行人检测中更加容易被复杂背景影响,本文改进的CNN模型在选择性注意层采用LBP纹理预处理能够有效地去除图像复杂背景对CNN网络的影响,突出行人特征,提高行人检测率。

为了验证本文CNN模型的鲁棒性和泛化能力,本文用NICTA和Daimler行人数据库对改进的CNN模型进行了实验。

Fig.7 Partial misclassification samples of different CNN models图7 不同CNN模型部分错误分类样本

4.2 NICTA数据集测试结果

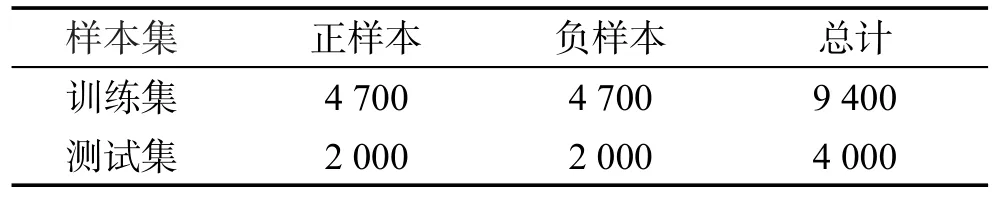

NICTA是一个规模较大的静态行人数据库,包含25 551张行人图像和5 207张非行人图像,并且对部分样本进行了平移、旋转、缩放等变换,增加了检测难度。本文从以上样本集中随机选取了一部分作为实验样本集,样本集组成如表2所示。

Table 2 NICTAintegrated sample composition表2 NICTA样本集成分组成

将学习效率(alpha)设为1,批训练样本数量(batchsize)设为50,实验中对网络模型训练200次,得到其均方误差及正确率变化曲线,如图8所示。从图中可以看出,传统CNN模型的检测效果低于本文改进的CNN模型。NICTA样本集中存在着平移、旋转、缩放等变换,而CNN中的卷积操作能很好地适应这种变换。

Fig.8 Result comparison of different CNN models on NICTAdata set图8NICTA数据集不同CNN模型测试结果对比

4.3 Daimler数据集测试结果

Daimler行人数据集是采用车载摄像机获取的,它分为检测和分类两个数据集,每个数据集包含训练和测试两部分,而每个训练和测试又分为正样本和负样本。检测数据集的训练样本集有正样本15 560张,负样本6 744张。该训练集是车载视角拍摄,相比于前两个数据集而言,更加贴近真实情况。

本文从以上样本集中随机选取了9 400张图片(4 700个正样本和4 700个负样本)作为训练集和4 000张图片(2 000个正样本和2 000个负样本)作为测试集。样本集组成如表3所示。

同样将学习效率(alpha)设为1,批训练样本数量(batchsize)设为50,实验中对网络模型训练200次,得到其均方误差及正确率变化曲线,如图9所示。

从图9中同样可以看出,本文CNN模型的正确率高于传统CNN模型的正确率。通过在Daimler数据集上的对比再一次说明了本文CNN模型要优于传统CNN模型。但对比前两个数据集的表现,这种优势不太明显,可能是因为车载视角拍摄的图像背景复杂度较低,使得两种CNN模型差别并不是十分明显。

Table 3 Daimler Integrated sample composition表3 Daimler样本集成分组成

Fig.9 Result comparison of different CNN models on Daimler data set图9 Daimler数据集不同CNN模型测试结果对比

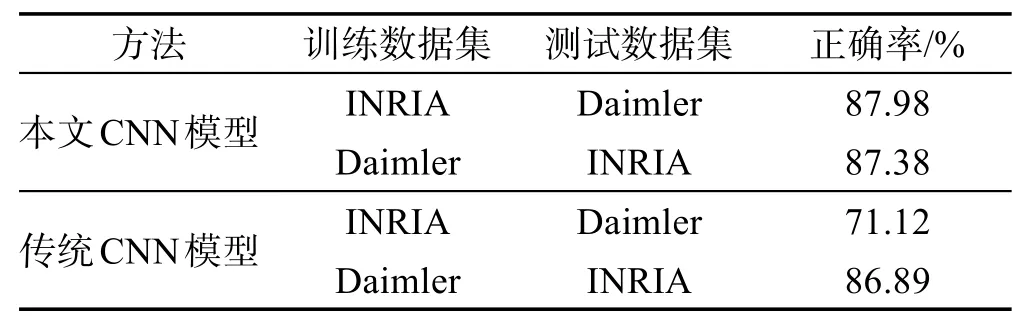

之后根据前面的实验结果,在INRIA和Daimler两个数据集进行交叉验证。具体步骤如下:首先采用INRIA数据集训练本文CNN模型,再用Daimler数据集进行测试,然后再把训练集和测试集相互对调进行实验,结果如表4所示。从表4中可以看出,在不同的数据集进行交叉验证的实验中,本文CNN模型的正确率都优于传统CNN模型,本文CNN模型具有更好的泛化能力。

Table 4 Comparison of cross test results for different CNN models表4 不同CNN模型的交叉测试结果对比

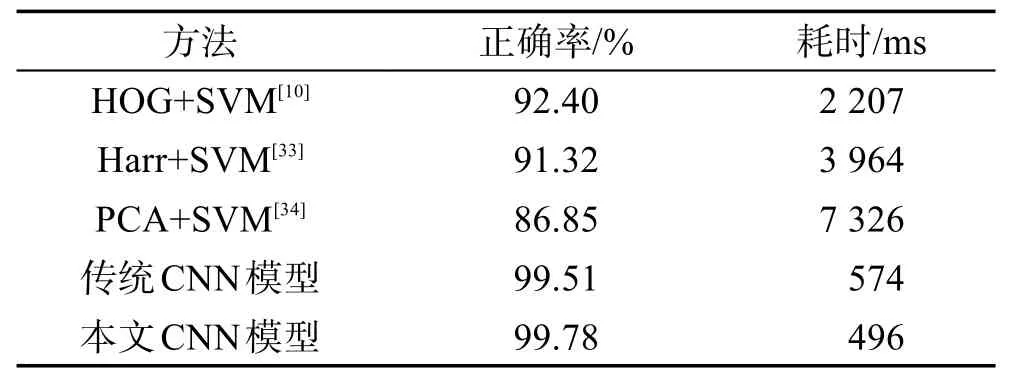

Table 5 Comparison of recognition rate for different characteristics on Daimler data set表5 不同算法在Daimler数据集的识别率对比

从正确率来看,传统CNN模型高于其他检测方法,而本文改进的CNN模型比传统CNN模型的正确率更高,达到了99.78%;从耗时来看,本文CNN模型的检测速度明显优于其他算法。结合表1可以发现,不管是从正确率还是从耗时来考虑,本文CNN模型都具有很大优势。经过不断调节网络参数最终发现传统CNN模型在网络层数为9时达到了最高准确率,而本文改进的CNN模型在网络层数为8时准确率已经高于传统CNN模型。由此可以得出,图像在经过选择性注意层处理后,CNN能够更加快速地提取到行人特征。

5 结束语

本文针对现有的行人检测方法难以处理背景复杂的行人样本的问题,提出根据人眼的选择性注意功能,对传统CNN进行改进,加入选择性注意层,对复杂的行人图像进行预处理。在3个公开的行人数据集上,对本文CNN模型进行交叉验证以及与传统方法进行对比,实验表明,本文CNN模型能更好地提取行人特征,其在Daimler数据集上的识别准确率达到了99.78%。结果显示本文CNN模型优于传统的行人检测方法,具有一定的可行性和使用价值。

本文分析了不同预处理方式对检测效果的影响,发现选用预处理的方式要适当,过度的预处理会使得图像留下的特征太少,致使CNN无法学习到足够多的特征,影响检测率。并且研究发现,LBP纹理预处理方式能够有效地过滤图像背景噪声,突出行人特征,最终提高CNN的检测率。

同时,在深度学习中,利用合理的先验知识对数据进行适当的预处理,能够去除一定的噪声,突出数据特征,使其在解决实际问题时更加有效,为今后的研究指明了方向。

[1]Liu Xiao,Tao Dacheng,Song Mingli,et al.Learning to track multiple targets[J].IEEE Transactions on Neural Networks&Learning Systems,2015,26(5):1060-1073.

[2]Li Xiaofei,Li Lingxi,Flohr F,et al.A unified framework for concurrent pedestrian and cyclist detection[J].IEEE Transactions on Intelligent Transportation Systems,2017,18(2):269-281.

[3]Biswas S K,Milanfar P.Linear support tensor machine with LSK channels:pedestrian detection in thermal infrared images[J].IEEE Transactions on Image Processing,2017,26(9):4229-4242.

[4]Huang Shiyao,Ying Xianghua,Rong Jiangpeng,et al.Camera calibration from periodic motion of a pedestrian[C]//Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition,Las Vegas,Jun 27-30,2016.Washington:IEEE Computer Society,2016:3025-3033.

[5]Bera A,Kim S,Manocha D.Realtime anomaly detection using trajectory-level crowd behavior learning[C]//Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition Workshops,Las Vegas,Jun 26-Jul 1,2016.Washington:IEEE Computer Society,2016:1289-1296.

[6]Pan Lei.Real-time detection method of abnormal event in crowds based on image entropy[J].Journal of Frontiers of Computer Science and Technology,2016,10(7):1044-1050.

[7]Smedt F D,Hulens D,Goedeme T.On-board real-time tracking of pedestrians on a UAV[C]//Proceedings of the 2015 IEEE Conference on Computer Vision and Pattern Recognition Workshops,Boston,Jun 7-12,2015.Washington:IEEE Computer Society,2015:1-8.

[8]Minaeian S,Liu Jian,Son Y J.Vision-based target detection and localization via a team of cooperative UAV and UGVs[J].IEEE Transactions on Systems Man and Cybernetics Systems,2016,46(7):1005-1016.

[9]Bertuccelli L F,Cummings M L.Operator choice modeling for collaborative UAV visual search tasks[J].IEEE Transactions on Systems Man and Cybernetics:Part A Systems and Humans,2012,42(5):1088-1099.

[10]Dalal N,Triggs B.Histograms of oriented gradients for human detection[C]//Proceedings of the 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition,San Diego,Jun 20-26,2005.Washington:IEEE Computer Society,2005:886-893.

[11]Kim S,Cho K.Trade-off between accuracy and speed for pedestrian detection using HOG feature[C]//Proceedings of the IEEE 3rd International Conference on Consumer Electronics,Berlin,Sep 9-11,2013.Piscataway,IEEE,2014:207-209.

[12]Ojala T,Harwood I.A comparative study of texture measures with classification based on feature distributions[J].Pattern Recognition,1996,29(1):51-59.

[13]Mu Yadong,Yan Shuicheng,Liu Yi,et al.Discriminative local binary patterns for human detection in personal album[C]//Proceedings of the 2008 IEEE Conference on Computer Vision and Pattern Recognition,Anchorage,Jun 23-28,2008.Washington:IEEE Computer Society,2008:1-8.

[14]Gavrila D M.A Bayesian,exemplar-based approach to hier-archical shape matching[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2007,29(8):1408-1421.

[15]Szarvas M,YoshizawaA,Yamamoto M,et al.Pedestrian detection with convolutional neural networks[C]//Proceedings of the 2005 Intelligent Vehicles Symposium,Las Vegas,Jun 6-8,2005.Piscataway:IEEE,2005:224-229.

[16]Zhang Liliang,Lin Liang,Liang Xiaodan,et al.Is faster RCNN doing well for pedestrian detection?[C]//LNCS 9906:Proceedings of the 14th European Conference on Computer Vision,Amsterdam,Oct 11-14,2016.Berlin,Heidelberg:Springer,2016:443-457.

[17]Cai Zhaowei,Fan Quanfu,Feris R S,et al.A unified multiscale deep convolutional neural network for fast object detection[C]//LNCS 9908:Proceedings of the 14th European Conference on Computer Vision,Amsterdam,Oct 11-14,2016.Berlin,Heidelberg:Springer,2016:354-370.

[18]Tian Yonglong,Luo Ping,Wang Xiaogang,et al.Pedestrian detection aided by deep learning semantic tasks[C]//Proceedings of the 2015 IEEE Conference on Computer Vision and Pattern Recognition,Boston,Jun 7-12,2015.Washington:IEEE Computer Society,2015:5079-5087.

[19]Hubel D H,Wiesel T N.Receptive fields of single neurones in the cat's striate cortex[J].Journal of Physiology,1959,148(3):574-591.

[20]Hubel D H,Wiesel T N.Receptive fields of optic nerve fibres in the spider monkey[J].Journal of Physiology,1960,154(3):572-580.

[21]Itti L,Koch C,Niebur E.A model of saliency-based visual attention for rapid scene analysis[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,1998,20(11):1254-1259.

[22]Treisman A M,Gelade G.A feature integration theory of attention[J].Cognitive Psychology,1980,12(1):97-136.

[23]Koch C,Ullman S.Shifts in selective visual attention:towards the underlying neural circuitry[J].Human Neurobiology,1985,4(4):219-227.

[24]Guo Mingwei,Zhao Yuzhou,Zhang Chenbin,et al.Fast object detection based on selective visual attention[J].Neurocomputing,2014,144(20):184-197.

[25]Salah AA,Alpaydin E,Akarun L.A selective attention-based method for visual pattern recognition with application to handwritten digit recognition and face recognition[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2002,24(3):420-425.

[26]Deubel H,Schneider W X.Saccade target selection and object recognition:evidence for a common attentional mechanism[J].Vision Research,1996,36(12):1827-1837.

[27]Johansson R S,Westling G,Bäckström A,et al.Eye-hand coordination in object manipulation[J].Journal of Neuroscience,2001,21(17):6917-6932.

[28]Chu Miao,Tian Shaohui.An extraction method for digital camouflage texture based on human visual perception and isoperimetric theory[C]//Proceedings of the 2nd International Conference on Image,Vision and Computing,Chengdu,Jun 2-4,2017.Piscataway:IEEE,2017:158-162.

[29]Li Baopu,Yang Can,Zhang Qi,et al.Condensation-based multi-person detection and tracking with HOG and LBP[C]//Proceedings of the 2014 IEEE International Conference on Information and Automation,Hailar,Jul 28-30,2014.Piscataway:IEEE,2014:267-272.

[30]INRIA person dataset[DB/OL].[2017-09-25].http://pascal.inrialpes.fr/data/human/.

[31]Daimler.Daimler pedestrian detection benchmark dataset[DB/OL].[2017-09-25].http://www.gavrila.net/Research/Pedestrian_Detection/Daimler_Pedestrian_Benchmark_D/Daimler_Mono_Ped_Detection_Be/daimler_mono_ped_detection_be.html.

[32]NICTA.Data61 predestrian dataset[DB/OL].[2017-09-25].https://data.csiro.au/dap/landingpage?pid=csiro:23454&v=1&d=true.

[33]Ikemura S,Fujiyoshi H.Human detection by Haar-like filtering using depth information[C]//Proceedings of the 21st International Conference on Pattern Recognition,Tsukuba,Nov 11-15,2012.Washington:IEEE Computer Society,2012:813-816.

[34]Abd-Almageed W,Davis L S.Human detection using iterative feature selection and logistic principal component analysis[C]//Proceedings of the IEEE International Conference on Robotics and Automation,Pasadena,May 19-23,2008.Piscataway:IEEE,2008:1691-1697.

附中文参考文献:

[6]潘磊.基于图像熵的密集人群异常事件实时检测方法[J].计算机科学与探索,2016,10(7):1044-1050.