移动机器人级联超像素行人目标分割算法

2018-02-05杨大伟黄俊达

杨大伟,张 静,黄俊达

(大连民族大学 机电工程学院,辽宁 大连 116605)

在移动机器人视觉应用中,复杂的室内外环境常常影响行人目标检测与跟踪算法的精度与效果。室内的家具与装饰、室外的建筑与景观都有可能造成遮挡,利用超像素与显著性结合的方法在复杂环境中找寻行人目标分割[1],为后续目标的检测与跟踪、自主驾驶与轨迹规划等机器人应用提供支撑[2]。

近些年来,学术界提出多种相关研究算法来分割提取复杂背景中的显著目标。文献[3]结合自动分割的行人形状进行检测,在检测过程中通过实现自动分割,对行人目标剪影和骨架进行分层匹配来实现检测,该算法可以有效减少运算时间,提高检测效率,但剪影和骨架特征相对隐蔽,检测精度会有所降低。文献[4]提出了一种基于内核分割的方法,此种分割方法基于AdaBoost训练检测器对所有行人进行检测,将分水岭算法与核密度分析相结合,选择最优分割区域,但由于该算法采用多级流水,复杂度高,实时性相对较差。文献[5]提出一种通过二维和三维两种空间维度对头部特征进行提取的算法,该算法行人头部特征与非行人区别明显,能够达到检测精准的目的,但计算量过大,很难达到实时跟踪的效果。文献[6]提出一种基于形状的行人分割模型,该方法对行人检测器结果进行边界能量最大化处理,实现对图像中行人目标的分割。文献[7]提出一种蛇形分割的目标提取方法,在AdaBoost算法的基础上添加梯形特征,使得检测更加准确,但梯形特征计算步骤复杂,运算复杂度较高。文献[8]采用SLIC超像素结合局部二值模式算法对图像前景和背景进行有效区分,辨识能力较强,具有良好的主客观分类精度。文献[9]结合超像素与边界-中心先验信息方法,提出利用空间、颜色来区分前景和背景的显著目标检测算法,但在缺少先验信息的情况下,算法效率会变差。文献[10]则基于全局K-means算法实现了一种超像素分割方法,在VOC2007数据集测试中获得良好的性能。

本文以移动机器人应用平台为对象,针对室内外行人目标清晰轮廓提取问题,提出一种基于超像素的级联式行人目标分割算法(CAscaded Superpixel pedestrian object Segmentation algorithm,CASS)。该算法连续两次利用超像素计算颜色与空间距离特征,实现对行人目标轮廓的准确提取。在仿真分析中可以看到,本文所提CASS算法在复杂的室内外背景环境下,可以获得较为优异的分割提取性能,可用于移动机器人视觉检测与跟踪算法等领域。

1 级联超像素行人分割算法

复杂的室内外背景条件下,行人目标难以被准确提取,原因多为行人与背景颜色相似或背景过于杂乱,无法对行人轮廓进行准确划分。级联超像素行人分割算法有效地利用超像素本身对边缘轮廓的吸附性特点,以超像素为最小计算单元,结合显著光流快速检测算法(Saliency Optical-Flow detection Algorithm,SOFA)对行人显著区域进行划分[11],对比行人区域内外超像素区块的颜色均值与中心空间位置距离相似程度,从而准确分割出行人轮廓,算法逻辑框图如图1。该算法中的级联逻辑,从形式上相当于两次应用超像素的颜色与空间关系,两次的不同在于:第一次以像素为单位,从点特征获取超像素区块(模块A○);第二次以超像素区块为单位,以显著性行人区域为分界,从超像素区块获取目标轮廓(模块B○)。

图1 级联超像素行人分割算法逻辑框图

1.1 第一级超像素

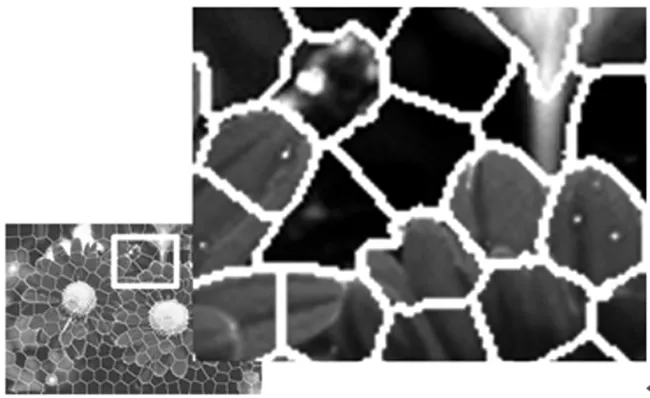

超像素具有极强的目标轮廓吸附性,经过处理后的目标和背景景物均能获得良好的划分效果,如图2。在图片中花瓣的边缘轮廓被超像素清晰地分隔开,为第二级超像素提供必要的前提条件。

图2 超像素边缘轮廓吸附特性示意图

超像素算法是基于颜色和距离的相似程度对超像素进行分割,将图像分割成为一定数量的子区域,可产生大小均匀、形状规则的超像素区块。超像素区块与像素点之间存在着一定的区别,像素点仅仅能够单一地表达固定点的色彩,而超像素区块区域能够对像素点的特征进行提取,是具有相似特征的一组像素点集合。超像素分割处理步骤如下:

(2)像素聚类。以当前像素点为中心,在给定半径s的情况下,计算圆内每个像素点与聚类中心的距离。与聚类中心距离最近的像素点设为新的聚类中心。分别计算聚类中心与像素点的颜色距离和空间位置距离,通过加权计算来确定两点之间的最终像素距离。

(1)

(2)

(3)

式中:D1lab为像素点的颜色空间距离;D1xy为像素点的位置空间距离;D1k为像素距离;s为聚类中心。m为颜色空间距离与位置空间距离的加权,当m值较大时,说明位置空间距离对于像素距离的影响较大,当m值较小时,说明颜色空间距离对于像素距离更重要。

(3)聚类迭代。像素聚类后,将每个像素分配到对应聚类中心。根据类别内平均像素位置,更新聚类中心位置。每个像素都有一个所属的聚类中心,根据所属关系,将每个像素点调整到聚类中心所在区域的平均位置,返回像素聚类进行迭代,直到所有的聚类中心不再变化,便可获得图像的超像素区块分类结果。

1.2 第二级超像素

第一级超像素计算结束后,全部聚类结果即为超像素。如何依据现有超像素特性来区分目标主体与非目标背景,实现目标的准确分割是第二级超像素计算的主要任务。在第二级超像素行人目标分割之前,需通过SOFA算法提取行人显著区域,减少行人轮廓分割干扰信息。同时,提取超像素区块相关特征,以行人区域内外超像素区块的平均颜色空间距离与超像素区块中心点的位置空间距离为特征度量依据,计算内外超像素区块的区域相关程度,确定行人目标轮廓。

第二次超像素区块中行人轮廓区域示意图如图3。设全部超像素区块为I,定义行人长方形显著区域R,行人目标真实轮廓区域为R*,且R*⊆R,非行人区域为R′,且R′=I-R。

图3 第二次超像素区块中行人轮廓区域示意图

第二级超像素的算法步骤如下:

(2)通过SOFA算法提取行人显著区域,获取区域R所在位置。

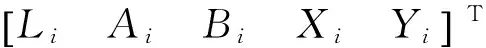

(3)获取超像素区块的平均颜色与中心点位置。计算行人区域R与非行人区域R′的颜色空间距离特征和位置空间距离特征,即以行人显著区域R内的超像素区块计算。

(4)

(5)

(6)

式中:D2lab为超像素区块平均颜色空间距离;D2xy为超像素区块的位置空间距离;D2K为超像素区块距离;δ为距离权值系数,且δ∈[0,1]。

(4)计算像素块之间的相关度,获取最终行人区域R*。

(7)

式中:ε为相关度阈值系数;ε∈[0,1],OTSU为最大类间差阈值计算函数。

2 实验结果

2.1 不同分割算法比较

为了验证本文提出CASS算法的有效性,以MSRA显著目标数据集中的图片为仿真测试源,对比目前应用广泛的四种常见显著目标分割算法EQCUT[12]、HDCT[13]、MBS[14]和PCA[15],准确率召回率直方图如图4。五种算法的二值化分割结果如图5。全部5种算法中,仅本文CASS算法与EQCUT算法的F值为0.98,指标上高于其他三种算法。

图4 准确率召回率直方图

(a)原图;(b)EQCUT;(c)HDCT;(d)MBS;(e)PCA;(f)CASS;(g)ground truth

图5二值化分割结果

与MSRA数据集提供的标准分割(ground truth)结果相比较,本文所提CASS算法性能与EQCUT算法性能相当,明显优于其他三种方法。在分割细节上,CASS算法更能够有效地接近标准真实值。如图5中第4组图片的鸭梨蒂、第5组图片的警察左前臂,均能够被准确地分割。

2.2 行人目标分割测试

为了验证CASS算法对行人目标的分割性能,

对比室内外不同环境场景视频图像帧的行人目标分割结果如图6。CASS算法在实际场景中的应用效果十分突出,CASS算法错误分割较少,分割结果中无冗余混淆背景等杂乱内容,能够将复杂背景中的行人目标准确地与背景分离开来,轮廓清晰明显,可以有效地应用于室内和室外复杂背景环境。

3 结 语

在移动机器人视觉应用中,复杂背景环境干扰的情况下能够准确地分割行人目标轮廓,不仅可以获得该目标的纹理参数,更可为检测跟踪与行人目标定位定向提供必要的预处理信息。本文以超像素对边缘轮廓的吸附性特点为基础,利用超像素计算过程中像素颜色与空间距离的相关特性,提出一种级联式超像素行人目标轮廓分割算法。该算法经两次超像素划分,先由像素点的颜色与空间距离特性获取超像素区块,再由超像素区块的颜色与空间距离特性获取行人目标轮廓。算法简单有效,计算复杂度低,能够有效地应用在移动机器人目标检测与跟踪算法中。不仅可以用来完成跟踪中对色彩直方图等的统计计算,而且可以解决机器视觉目标测向与距离估计需求,为移动机器人视觉应用提供必要基础。

图6 行人目标分割结果

[1] DAI Q. An infrared pedestrians image segmentation algorithm[C]// International Conference on Intelligent Networks and Intelligent Systems. Shenyang:IEEE, 2013:111-114.

[2] GULSHAN V, LEMPITSKY V, ZISSERMAN A. Humanising GrabCut: Learning to segment humans using the Kinect[C]// IEEE International Conference on Computer Vision Workshops. Barcelona:DBLP, 2011:1127-1133.

[3] LI Y, ZHOU Z, WU W. Combining shape and appearance for automatic pedestrian segmentation[C]// IEEE International Conference on TOOLS with Artificial Intelligence. Boca Raton: IEEE, 2011:369-376.

[4] HSIEH J, CHEN S Y, CHUANG C H, et al. Pedestrian segmentation using deformable triangulation and kernel density estimation[C]// International Conference on Machine Learning and Cybernetics. Baoding:IEEE, 2009:3270-3274.

[5] XIA L, CHEN C C, AGGARWAL J K. Human detection using depth information by Kinect[C] // CVPR 2011 WORKSHOPS. Colorado Springs: 2011: IEEE, 15-22.

[6] JUNIOR J C , MUSSE S R. Shape-based pedestrian segmentation in still images[C]// IEEE International Symposium on Multimedia. Miami: IEEE, 2015:1-6.

[7] 陈超, 宣士斌, 徐俊格. 复杂背景下的行人检测与分割[J]. 计算机工程与应用, 2012(30): 177-181.

[8] 薛萍. 基于超像素特征表示的图像前景背景分割算法[J]. 西安科技大学学报, 2017, 37(5): 731-735.

[9] 李继德,李晓强,沙彩霞. 基于超像素分类的显著目标检测[J]. 计算机应用与软件, 2017, 34(1): 180-186.

[10] 吉长东,李相泽,敖国政. 基于全局K-means算法的超像素分割方法[J]. 沈阳大学学报(自然科学版), 2017, 29(3): 212-216.

[11] 杨大伟, 姬梦婷, 张汝波,等. 移动机器人行人目标活动区域快速检测算法[J]. 大连民族大学学报, 2016, 18(3): 221-223.

[12] AYTEKIN C, KIRANYAZ S, GABBOUJ M. Automatic object segmentation by Quantum cuts[C]// International Conference on Pattern Recognition. Stockholm: IEEE, 2014:112-117.

[13] KIM J, HAN D, TAI Y W, et al. Salient region detection via High-dimensional color transform[C]// Computer Vision and Pattern Recognition. IEEE, 2014:883-890.

[14] ZHANG J, SCLAROFF S, LIN Z, et al. Minimum barrier salient object detection at 80 FPS[C]// IEEE International Conference on Computer Vision. Santiago :IEEE, 2015:1404-1412.

[15] RAN M, TAL A, ZELNIKMANOR L. What makes a patch distinct[C]// IEEE Conference on Computer Vision and Pattern Recognition. Portland: IEEE Computer Society, 2013:1139-1146.