多光电跟踪仪视频拼接算法设计与实现

2017-11-01河南中光学集团有限公司秦建峰侯米娜

河南中光学集团有限公司 秦建峰 侯米娜 刘 洋

多光电跟踪仪视频拼接算法设计与实现

河南中光学集团有限公司 秦建峰 侯米娜 刘 洋

视频图像拼接是一种低成本获取宽视角场景的方法,在军事和民用领域都具有很强的应用价值。以要地防御监控为背景,设计和实现了一种基于图像特征的多光电跟踪仪视频拼接算法。该算法对同步获取的多路视频图像用SIFT算法提取特征点,并采用RANSAC算法进行特征点匹配;然后计算仿射变换矩阵进行图像融合;最后由并行处理得到的多幅融合图像再次融合得到拼接结果。实验结果表明,视频拼接速率可达20fps,具有一定的实时性和鲁棒性。

视频拼接;SIFT特征;RANSAC;图像融合

1.引言

视频图像拼接是一种低成本获取宽视角场景的方法,是视频图像处理领域的研究热点之一,在军事和民用领域都具有很强的应用价值。

目前视频拼接是基于图像拼接实现的,图像拼接包括图像配准和图像融合两个部分:

(1)图像配准:常用的图像配准算法有基于特征的图像配准算法和基于灰度的图像配准算法。基于特征的配准算法包括Harris算法、SIFT算法和SURF算法[1]等。该类算法具有计算量小,对图像的灰度和噪声的影响不敏感,鲁棒性和稳健性高的特点。基于灰度的图像算法有归一化互相关法、相位相关法、以及互信息法[2]等,该类算法计算量大、复杂度高,对目标场景要求高;

(2)图像融合:常用的图像融合算法有加权平均法和中值滤波法[3]。加权平均算法简单易实现,中值滤波法计算量大。

本文设计和实现了一种多光电跟踪仪视频图像拼接的方法。该方法采用SIFT算法和RANSAC算法进行特征提取和匹配,完成图像配准过程;用加权平均法完成图像融合过程,进而实现视频拼接。为加快拼接速度,本文采用一次配准(特征提取、特征匹配和仿射变换矩阵计算等配准过程只计算一次)、多次图像融合的方法,达到了较好的加速效果。

2.拼接原理与关键算法

要地防御系统中目标多样且位置不定,如何在全局场景中包含人、车、物是目前的一个研究热点和难点。全景拼接无疑是一种很好的实现路径,本文探讨了一种全景拼接的方法,在保障实时性的前提下,实现快速的全景拼接,并取得较好的拼接效果。

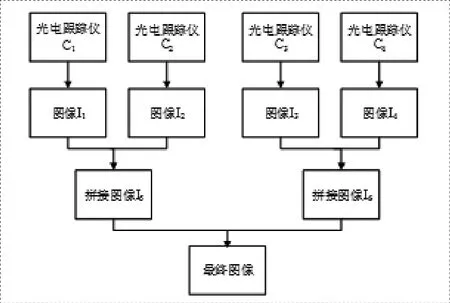

多光电跟踪仪视频拼接基本步骤:1)获取多光电跟踪仪的视频图像,并进行特征点提取及匹配,根据匹配的特征点计算仿射变换矩阵;2)利用上一步计算的矩阵进行图像拼接处理,实时显示拼接图像。本文假定四个光电跟踪仪C1~ C4依次排开,同步获取四帧图像I1~I4。为保证图像拼接的实时性,实现图像快速拼接,本文将多台光电跟踪仪分成若干小组,先进行组内拼接再进行组间拼接,并结合多线程技术加快处理速度,图1给出了多光电跟踪仪视频图像拼接方案。其中对两幅图像进行两幅图像拼接流程如图2所示,包括特征提取、特征匹配和仿射变换矩阵计算、图像融合等步骤。

图1 多光电跟踪仪图像拼接方案

图2 两幅图像拼接流程

2.1 特征提取

特征提取是进行图像拼接的前提和基础。如何提取到合适的特征点以保证图像能够拼接且拼接正确,是本步骤需要解决的问题。本文对四个光电跟踪仪同步采集的图像I1~ I4采用SIFT算法提取特征点集P1~P4。SIFT算法是由David G.Lowe于1999年提出[4],由于该算法在特征提取时,在特征点细节上进行了特殊处理,使得的提出来的特征点具有鲁棒性高,稳定性强的特性。SIFT算法的主要步骤包括:

1)尺度空间极值检测;

2)特征点定位;

3)特征点方向确定;

4)特征点描述。最终生成的特征点包含特征的坐标、尺度和方向信息[5]。

2.2 特征匹配

对需要拼接的两幅图像I1和I2,对其SIFT特征点集P1和P2进行匹配的过程如下:

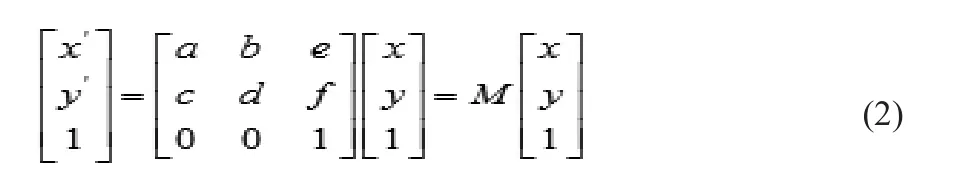

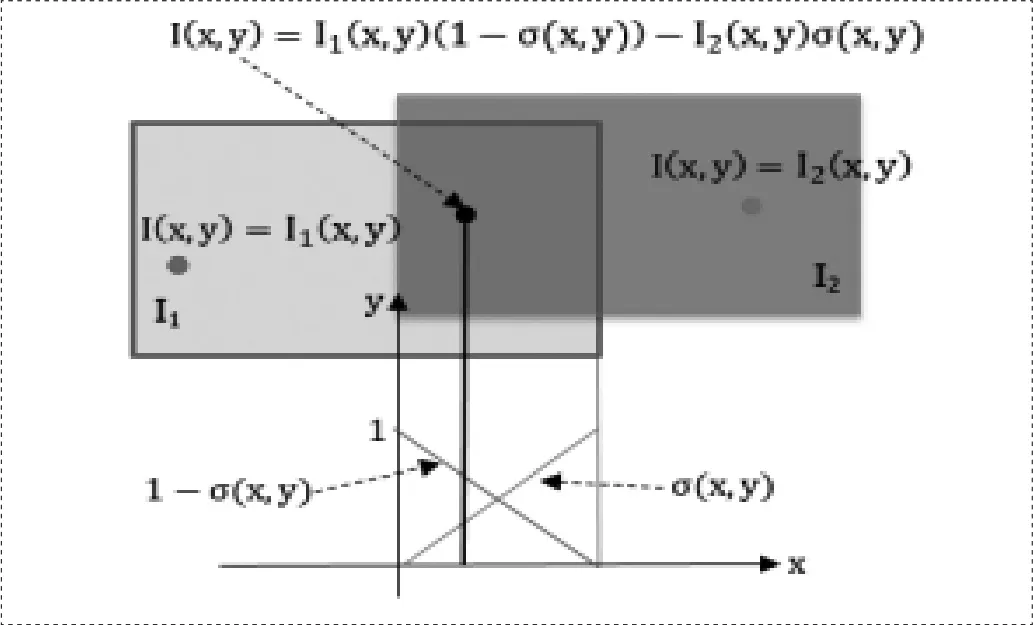

1)粗匹配:对P1中的的每个特征点a,在P2中查找a对应的最近邻特征点b1以及次近邻特征点b2,如果dist(a,b1)/dist(a,b2) 2)精匹配:经粗匹配得到的特征点对集合S1中包含虚假匹配,为解决该问题使用RANSAC方法[7]。根据对极几何约束关系,任意匹配点对(a,b)满足aTFb=0,其中F为基本矩阵,F是一个3×3的秩2奇异方阵,具有7个自由度。求解基础矩阵可采用的是改进的8点法[8]。本文采用RANSAC方法来精确估计两幅图像之间的基本矩阵F[9],同时剔除S1中的虚假匹配得到两幅图像的匹配点对S。 由RANSAC算法得到两幅图像I1和I2的匹配点对集合S后,通过S可以计算图像I1和I2的仿射变换[10],公式如下: 其矩阵表示为: 其中a,b,c,d表示旋转、缩放系数。e,f表示平移系数。(x,y)和(x´,y´)表示S中的一对匹配点。仿射变换矩阵M包含了6个参数,因此至少需要不共线的3对匹配点才能确定一个仿射变换M,因此|S|≥3(|S|表示S中点对的数目)。当|S|>3时,可以用最小二乘法来求仿射变换M。 图3 图像融合示意图 得到两幅图像之间的仿射变换后,本文采用加权平均法进行图像融合[11]。其公式如下: 其中:I1(x,y)、I2(x,y)分别表示经过上步骤仿射变换的第I1幅图像和第I2幅图像;I(x,y)表示融合后的图像;R3=I1∩I2,R1=I1-R2,R2=I2-R3。是加权系数,为重叠区域宽度的倒数。图像融合示意图如3所示。 为了验证本文提出的算法的有效性,使用Visual Studio开发平台,结合Opencv开源库,用C++语言实现。在白天自然光照下,使用四台光电跟踪仪同步录制视频流捕获四帧图像I1~I4。如图4所示。 图4 光电跟踪仪同步获取的4幅视频帧图像 图5 特征提取和特征匹配结果 图6 多光电跟踪仪视频拼接结果 图5给出了经SIFT算法提取的特征点和RANSAC方法匹配结果,其中图(a)表示图像I1和I2的特征点提取及匹配,图(b)表示图像I2和I3的特征点及匹配结果,图(c)表示图像I3和I4的特征点提取及匹配。图像I1~I4拼接结果如图6所示。 本文以要地防御监控系统场景全景拼接为背景,设计并实现了多光电跟踪仪的视频拼接算法。该算法包括特征提取、特征匹配、仿射变换、图像融合等部分。特征点提取使用SIFT方法,特征匹配采用RANSAC参数估计方法,图像融合采用加权平均法。实验结果表明,视频拼接速率可达20fps。为了进一步提高拼接的实时性,可以通过NIVIDA公司提供的GPU加速技术来进行算法优化。 [1]邱建国,张建国,李凯.基于Harris与Sift算法的图像匹配方法[J].测试技术学报,2009,23(03):271-274. [2]魏晓敏.图像配准算法研究与系统设计实现[D].南京航空航天大学,2010. [3]牛凌宇.多源遥感图像数据融合技术综述[J].空间电子技术,2005,(01):1-5+10. [4]P.Schwind,S.Suri,P.R.A.Siebert.Applicability of the SIFT operator to geometric SAR image registration[J].International Journal of Remote Sensing,2010,31(8):1959-1980. [5]D.G.Lowe.Distinctive image feature from scaleinvariant keypoints[J].International Journal of Computer Vision,2004,60(2):91-110. [6]刘相滨,邹北骥,孙家广.基于边界跟踪的快速欧氏距离变换算法[J].计算机学报,2006,(02):317-323. [7]苗学健.全景图像拼接技术关键技术研究[J].通讯世界,2016,(21):227-228. [8]Richard I.Hartley.In defense of the8-point Algorithm. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1997,19(6):580-593. [9]崔久林.视频图像目标提取技术的研究[D].长春:长春理工大学,2006. [10]R.Lin,H.B.Huang,R.C.Sun,L.N.Sun.An invariant interest point detector under image affine transformation[J].Journal of Central South University,2015,22(03):914-921. [11]Y.Q.Zhao,Q.Pan,H.C.Zhang.Adaptive polarization image fusion based on regional energy dynamic weighted average[J].Optoelectronics Letters,2005,03:70-73. 秦建峰(1980-),男,大学本科,现供职于河南中光学集团有限公司,研究领域为视频监控、图像处理、安防系统集成。2.3 仿射变换

2.4 图像融合

3.实验结果与分析

4.结束语