基于轻量级卷积神经网络的人脸美丽预测

2017-09-26甘俊英黄聿翟懿奎姜开永

甘俊英,黄聿,翟懿奎,姜开永

基于轻量级卷积神经网络的人脸美丽预测

甘俊英,黄聿,翟懿奎,姜开永

(五邑大学 信息工程学院,广东 江门 529020)

针对目前人脸美丽预测算法难于同时满足实时性、鲁棒性、准确性的现状,本文提出一种轻量级的卷积神经网络(Convolutional Neural Network,CNN). 首先,利用图像预处理来提高模型的鲁棒性. 其次,通过减少网络层数和减小输入图像尺寸来提高模型的实时性,并通过优化网络结构和增加卷积核数来增强模型的学习能力. 最后,提出大规模数据微调训练方法来进一步提高模型的预测准确性. 实验结果表明,本文方法在SCUT-FBP数据库中获得的相关度,对单张的输入图像预测时间为.

人脸美丽预测;卷积神经网络(CNN);轻量级;微调

人脸美丽预测作为人工智能的一部分有着广泛的应用领域,如在娱乐、美容、图像检索、虚拟现实等行业均具有潜在的应用价值. 然而,人脸美丽预测是一个具备较大挑战性的研究课题. 人脸的姿态、表情、光照等变化都会直接影响着人脸的美丽值. 为了让机器能跟人一样分辨出人脸的美丽度,有大量学者在这方面进行了深入的研究. 人脸美丽预测最早见于2001年发表的文献[1],至今已经历十多年的研究探索,提出了多种特征提取、分类及回归方法. 其特征提取方法可归纳为早期研究的几何特征和纹理特征,以及近年研究的浅层和深层特征[2]. 然而,现有人脸美丽预测算法在兼顾准确性、鲁棒性、实时性等性能方面依然存在诸多不足,在算法提升方面还有很大发展空间.

目前,人脸美丽在传统机器学习方法上取得了较多成果. Eisenthal等[3]2006年采用特征脸作为人脸美丽特征,再用SVM、KNN(K-Nearest Neighbor)等机器学习方法来分类,实验证明机器学习方法可应用于人脸美丽预测. Mao等[4]最初通过手工标注关建点方式,提出人脸几何特征提取方法,实验对比表明SVM在人脸美丽分类方面具有较好的效果. 文献[5]利用计算机建立大量理想的人脸模型,并总结出对人脸美丽影响最大的4种主要几何特征. 而文献[6]则提出基于3D人脸的几何特征,并结合模糊神经网络的优点,进一步提高人脸美丽的测试性能. Zhang等[7]利用关键点对人脸图像进行几何变换,研究发现特征脸保留的几何不变特征更有利于人脸美丽预测. Whitehill 等[8]采用Gabor 特征、特征脸、梯度方向直方图相结合的方式,通过SVM 回归获得最高相关度. 以上研究成果为人脸美丽预测奠定了较好基础,但传统机器学习方法在图像识别领域,尤其在特征提取、预测准确性、算法鲁棒性等方面均与深度学习方法存在较大差距.

基于深度学习的人脸美丽预测方法最近也取得了一些突破. 其中,在卷积神经网络(Convolutional Neural Network,CNN)方面取得的成果尤为突出. Gray等[9]提出一种无监督的CNN模型训练方法,并提出不依赖标签的人脸美丽预测模型评价方法. Gan等[10]采用图像掩模方法对图像进行预处理,然后提取图像LBP(Local Binary Patterns)特征训练浅层网络CRBM(Convolutional Restricted Boltzmann Machine),经过两轮特征提取后,在SVM分类和回归中取得了较好结果. 此外,Gan等[11]还提出MSK(Multi-scale K-means)特征提取方法,通过K-means聚类得到众多卷积核来初始化一个浅层网络,用于提取人脸图像特征,最后组合多个尺度特征进行SVM分类. Xie等[12]开发了一个女性人脸美丽数据库(SCUT-FBP),包含500张图像,并设计一个多层CNN模型,实验证明了CNN方法学习效果大幅超过传统学习方法. Xu等[13]设计了多个深度不等的多层网络,基于SCUT-FBP人脸美丽数据库的实验结果说明,深层网络比浅层网络的预测效果更好. 然而,基于深度学习的方法目前只取得了初步的成果,国内外相关的研究比较少,且所取得的成果还不足以满足实践应用的需求. CNN具有强大的图像特征学习能力,对图像光照、背景等干扰不敏感,且拥有丰富的层间组合等优点,因而在图像识别领域具备较大优势. 为进一步提高人脸美丽预测的综合性能,本文对CNN展开深入的研究,使其更适用于人脸美丽预测.

1 预测方法

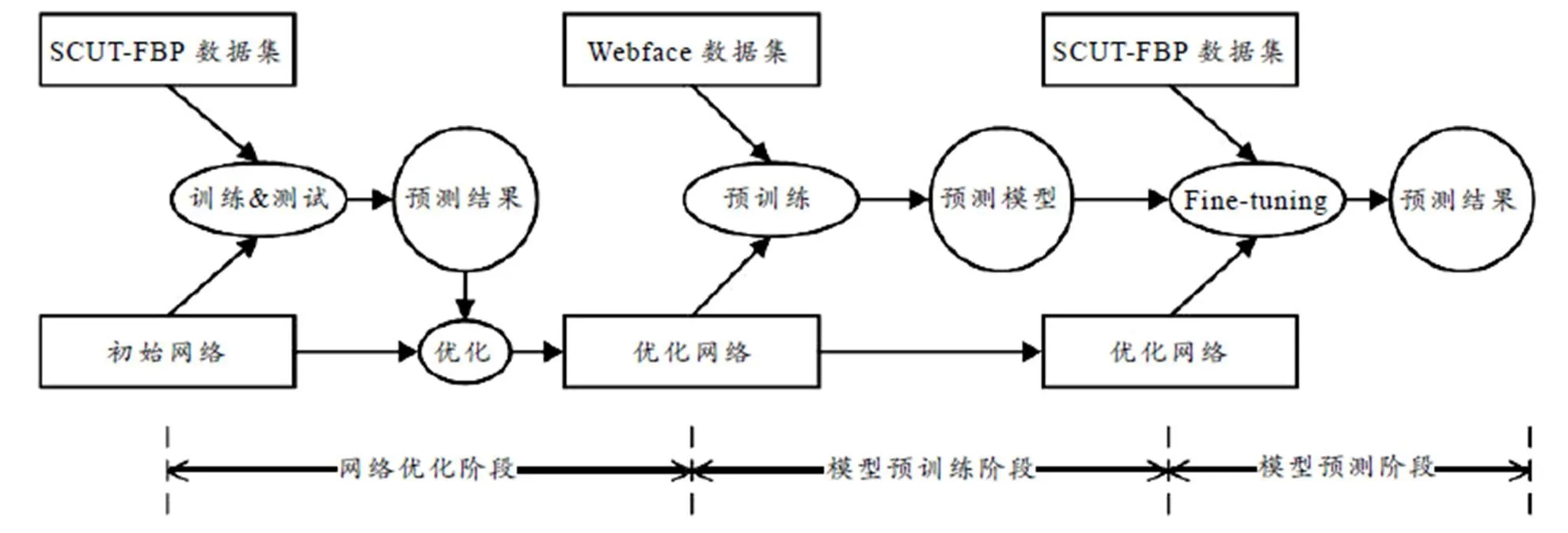

本文所提的人脸美丽预测方法分3个阶段来实现:网络优化、模型预训练和模型预测,如图1所示. 实验中,除了采用人脸美丽数据库SCUT-FBP做性能测试与分析外,还将采用大规模人脸识别数据库CASIA-WebFace预训练CNN模型. 图1中,网络优化阶段主要对所设计的初始网络进行优化,即根据SCUT-FBP上的预测性能来对网络结果进行相应的结构调整,为后续测试提供更适于人脸美丽预测的网络模型;模型预训练阶段是为了提高人脸美丽特征的提取能力,并降低对人脸美丽训练集的依赖. 大规模人脸数据能够充分训练模型对人脸的认知能力,有利于下一阶段的人脸美丽特征学习. 模型预测阶段是在前两个阶段基础上采用微调(Fine-tuning)训练方法对模型进行再训练,并分析SCUT-FBP数据库的测试结果.

图1 人脸美丽预测的流程

1.1 数据库图像的预处理

数据库里的原始图像一般处理得比较粗糙,容易对预测结果产生不良影响,因此,需要对图像进行预处理. 图像预处理包括人脸检测、关键点检测、人脸校正和归一化4个步骤,如图2所示. 其中,人脸检测和关键点检测采用文献[14]的方法来实现;再利用人脸关键点来估算人脸姿态,以便旋转校正人脸;最后将图像裁剪成大小一致且对齐的图像. 考虑到人脸图像的分布特点以及模型的性能需求,本文所设计的网络输入图像大小为144×144. 对于CNN模型,输入过大的图像不仅增加训练的耗时,过多的人脸图像冗余信息也会使模型难于收敛;输入过小的图像则会因为损失过多的图像细节而导致模型的预测效果不佳.

人脸检测 关键点检测 人脸校正 归一化

1.2 网络模型的设计

本文设计了一个具有5个卷积层和2个全连接层的轻量级CNN网络,其层次细节与文献[12-13]所提网络的区别如表1所示,其中,各参数的作用可参考深度学习框架Caffe. 另外,各层的参数设置是在多次实验验证的基础上优化的配置方式.

表1 网络模型结构对比

文献[12]提出了一个网络结构较简单的CNN模型,包含6个卷积层和2个全连接层;文献[13]是在文献[12]的基础上对模型进行改进,并且提出Cascaded Fine-tuning的训练方法来提高预测性能. 文献[12-13]的实验结果是基于SCUT-FBP数据库的测试,故本文的实验结果与之相比具有较好的说服力. 本模型与文献[12-13]的网络有一些共同点,如所有池化层的池化核大小均为2×2,所有的激活层均采用ReLU函数,以及采用Dropout层来抑制训练过拟合的问题. 然而,从表1可得出许多不同点:本模型在卷积核和可调参数数量上都明显多于前者,而更多的卷积核和可调参数能够给模型带来更强的学习能力;此外,Single Net和CNN-3 Net的输入图像大小为256×256,在Input层随机裁剪成227×227的灰度图像,卷积层共6层;而本模型输入图像大小为144×144,在Input层随机裁剪成128×128的灰度图像,卷积层共5层. 所以,本模型在输入图像大小和总层数上要小于前者,而更少的层数有利于模型的全局收敛,更小的输入图像则减少了模型的计算量,既加快了训练速度,也提高了系统的性能. 因此,从网络结构上可判断本模型在系统集成和应用方面更具优势.

1.3 模型的训练方法

SCUT-FBP数据库仅有500张图像,而小数据难以训练出性能强大的CNN模型. 为了提高测试的准确率,在人脸美丽预测训练前将引入CASIA-WebFace数据库进行预训练. CASIA-WebFace包含1万多类共40多万张图像,经过预处理后图像大小为144×144. 文献[15-17]的实验结果证明了经过大规模数据预训练的CNN模型具有较好的收敛结果. 因此,经过预训练后,再将学习目标迁移到人脸美丽预测中将获得更好的预测结果. 其训练方法如下:

1)准备训练集和测试集,测试集由CASIA-WebFace的每一类随机选取1张图像组成,剩下的为训练集.

2)将本模型的Loss层改为Softmax-Loss,固定学习率为0.001,随机初始化本模型各层的可调参数,并开始对所有层训练.

3)在训练过程中,当测试识别率不再增加时,调小学习率继续训练,直到测试识别率不再增加为止.

4)选取其中测试识别率最高的model用于初始化本模型,并将卷积层1~3的层内学习率设置为0,以充分利用网络底层在CASIA-WebFace上的学习结果. 同时,把训练集和测试集改为SCUT-FBP数据,学习率固定为,采用Fine-tuning方法训练.

5)将模型训练到测试集的Pearson系数不再增加为止,并选出Pearson系数最高的model作为实验结果.

2 实验结果与分析

实验主要采用SCUT-FBP数据库,其样本及美丽值如图3所示,样本的分布如图4所示. 从SCUT-FBP数据库中随机选取100张图像作为测试集,剩下的400张图像作为训练集. 从图4可看出,所有样本的美丽值介于1至5之间,且样本分布近似于高斯分布,说明样本分布是不均匀的,这将为预测模型带来一定的挑战. 为了更真实地反映预测模型的性能,所有实验采用五折交叉法测试. 即在500张图像中,轮流选择100张作为测试集,每种实验方法均测试5次并取其均值作为最终的实验结果. 下面将给出多种人脸美丽预测方法的回归预测结果并作对比分析.

图3 SCUT-FBP样本以及其美丽值示例

2.1 基于SVM的实验结果与分析

实验中,分别采用LPQ、LBP、K-means和MSK等4种方法进行特征提取,并采用SVM对人脸美丽特征进行回归预测,结果如表2所示. 其中,K-means和MSK算法的实现来自文献[11],MSK在文献[11]发表时取得了最优的成绩,在深度学习的浅层特征提取方法中,MSK的实验结果具有较高的代表性. 实验图像大小归一化为120×120的灰度图像,实验结果的评价采用MSE(Mean Squared Error)和Pearson系数.

图4 SCUT-FBP样本的分布图

表2 基于SVM的预测结果

从表2可知,MSK特征在SVM回归预测中取得了最佳成绩. 但其提取的特征维数相对较大,这种以增加特征维度为代价的方法将给算法的实时性和鲁棒性带来较大考验. 这也表明人脸美丽预测还有较大提升空间,为此,下面将对本文所提方法进行实验测试.

2.2 基于CNN的实验结果与分析

CNN模型具有end-to-end的学习能力,即模型经过训练后,直接输入图像便可得到预测结果. 因此,本次实验中,将直接采用SCUT-FBP数据库对Single Net、CNN-3 Net和本模型进行训练和测试,测试结果如表3和表4所示. 表3给出各模型的特性,其中,单张测试时间是在CPU上运行测试100张图像取均值得到的结果. 表4给出5次交叉测试结果,并采用Pearson系数表示. 由于测试数据较少,对于不同的交叉训练数据,本模型每次得到的预测结果差距较大,模型收敛所需要训练的次数也不一致. 训练时,本模型的batch_size设置为48,学习率固定为,表4的结果大约迭代10万次时便可获得.

表3 CNN模型的特性

表4 基于CNN的预测结果

从以上结果可知,本模型在实时性与准确性上均优于另两个网络. 尽管在3个模型中,本模型占用存储空间最大(所包含的权重参数最多),但本模型的层数少、测试图像的尺寸较小,都降低了计算量,使得其在实时性方面表现得更加突出. 另外,由于本模型针对人脸美丽图像的特点优化了网络结构,并拥有更多的可训练参数,从而具备更强大的学习能力,在预测准确性方面也取得了更好的结果. 目前,本模型的预测准确性已经超过多种基于SVM的人脸美丽预测方法,但仍然低于MSK,因而,下面将对本模型做进一步的性能提升测试.

2.3 引入Fine-tuning方法的实验结果与分析

实验先对模型进行预训练再进行Fine-tuning训练,最终实验结果如表5所示. 为了更全面地探讨经预训练后的模型性能,分别采用不同规模的CASIA-Webface数据集来训练. 其中,预训练数据集规模从0到40万张分5个层次进行实验,0表示不需要预训练. 此外,为了说明本模型的优势,引入文献[13]采用Cascaded Fine-tuning方法的实验结果作对比. 预训练时,对于不同的数据集,模型的收敛速度也不一致,一般数据集越大,收敛速度越慢. 在预训练过程中,对于40万张的预训练集,把batch_size大小设置为48,大约迭代训练75万次时,本模型能获得较好的收敛结果.

表5 采用Fine-tuning方法的回归预测结果

从表5可知,采用Fine-tuning方法训练出来的模型其预测性能均获得了较大的提升. 其中,在预训练数据集为20万张时,本模型取得了的最高相关度,优于文献[13]改进后的CNN方法以及采用MSK特征的SVM方法. 另外,从不同规模的预训练实验结果可看出,当数据量达到一定程度时,预测结果相关度将不再增加,反而出现下降的趋势. 这说明预训练的数据量并不是越多越好,过多的数据量会使本模型底层的泛化学习能力趋向于饱和. 这是由于数据量增加,类数也随着增加,从而使模型收敛的难度加大,网络底层难以学习到更有效的泛化人脸特征. 本次实验结果说明,采用Fine-tuning方法训练模型时,需要选择合适的预训练数据规模,以获得更好的预测结果.

3 结论

本文在现有人脸美丽预测方法的基础上研究了轻量级的CNN模型,通过对输入图像进行预处理和采用Fine-tuning训练方法来改善模型的实时预测性能. 实验结果说明,采用预训练的方法能够缓解CNN模型训练时因人脸美丽数据库规模不足而导致的过拟合问题,对人脸美丽的预测性能有较大的提升. 另外,CNN模型具备end-to-end的学习能力以及在大规模数据的训练下,将拥有更加强大的学习能力. 因而,面对预测难度较大的人脸美丽特征时,CNN模型比传统SVM模型更有优势. 与其他CNN模型相比,本文所设计的轻量级模型在实时性和准确性方面都取得了更理想的成果,能为人脸美丽预测系统提供更佳的性能.

[1] AARABI P, HUGHES D, MOHAJER K, et al. The automatic measurement of facial beauty [C]//IEEE International Conference on Systems, Man and Cybernetics. Tuson: IEEE, 2001: 2644-2647.

[2] ZHANG D, CHEN Fangmei, XU Yong. Computer models for facial beauty analysis [M]. Switzerland: Springer International Publishing, 2016: 3-16.

[3] EISENTHAL Y, DROR G, RUPPIN E. Facial attractiveness: beauty and the machine [J]. Neural Computation, 2006, 18(1): 119-42.

[4] MAO Huiyun, JIN Lianwen, DU Minghui. Automatic classification of Chinese female facial beauty using Support Vector Machine [C]//Proc IEEE SMC. San Antonio, IEEE, 2009: 4842-4846.

[5] FAN Jintu, CHAU K P, WAN Xianfu, et al. Prediction of facial attractiveness from facial proportions [J]. Pattern Recognition, 2012, 45(6): 2326-2334.

[6] CHIANG W C, LIN H H, HUANG C S, et al. The cluster assessment of facial attractiveness using fuzzy neural network classifier based on 3D Moire features [J]. Pattern Recognition, 2014, 47(3): 1249-1260.

[7] ZHANG D, ZHAO Qijun, CHEN Fangmei. Quantitative analysis of human facial beauty using geometric features [J]. Pattern Recognition, 2011, 44(4): 940-950.

[8] WHITEHILL J, MOVELLAN J R. Personalize facial attractiveness prediction [C]//Proceedings of FG’ 08. IEEE, 2008: 1-7.

[9] GRAY D, YU Kai, XU Wei, et al. Predicting facial beauty without landmarks [M]. LNCS: 6316. Berlin: Springer-Verlag, 2010: 434-447.

[10] GAN Junying, LI Lichen, ZHAI Yikui, et al. Deep self-taught learning for facial beauty prediction [J]. Neurocomputing, 2014, 144(1): 295-303.

[11] GAN Junying, ZHAI Yikui, WANG Bing. Unconstrained facial beauty prediction based on multi-scale k-means [J]. Chinese Journal of Electronics, 2016, 25(1): 1-9.

[12] XIE Duorui, LIANG Lingyu, JIN Lianwen, et al. SCUT-FBP: a benchmark dataset for facial beauty perception [C]// IEEE International Conference on SMC. Kowloon: IEEE, 2015: 1821-1826.

[13] XU Jie, JIN Lianwen, LIANG Lingyu, et al. A new humanlike facial attractiveness predictor with cascaded fine-tuning deep learning model [J]. Computer Science, 2015, 70(1) :45-79.

[14] DANTONE M, GALL J, FANELLI G, et al. Real-time facial feature detection using conditional regression forests [J]. IEEE Biometrics Compendium, 2012, 157(10): 2578-2585.

[15] PARKHI O M, VEDALDI A, ZISSERMAN A. Deep face recognition [C]// 26th British Machine Vision Conference. Swansea: BMVA Press, 2015: 1-12.

[16] LEVI G, HASSNER T. Emotion recognition in the wild via convolutional neural networks and mapped binary patterns [C]// ICMI 2015. Seattle: ACM Press: 2015: 1-8.

[17] LIU Xin, LI Shaoxin, KAN Meina, et al. Agenet: deeply learned regressor and classifier for robust apparent age estimation [C]// ICCV 2015. Santiago, Chile: IEEE, 2015: 258-266.

[责任编辑:熊玉涛]

Facial Beauty Prediction Based on the Lightened Convolutional Neural Network

GANJun-ying, HUANGYu, ZHAIYi-kui, JIANGKai-yong

(School of Information Engineering, Wuyi University, Jiangmen 529020, China)

In this paper, a lightened Convolutional Neural Network (CNN) was proposed to meet the requirements of the face prediction algorithm in aspects of real-time, robustness and accuracy. Firstly, face image preprocessing is used to enhance the robustness of the model. Secondly, the methods of reducing the number of network layers and downsizing the input images are adopted to improve the real-time performance of the model, and its learning ability is strengthened by optimizing the network structure and increasing the number of convolutional kernels. Finally, a large-scale data pre-training method is proposed to further improve the accuracy of the model. The experimental results show that a correlation degree ofbased on database of SCUT-FBP was obtained for the proposed method, in which the test time of oneimage is.

facial beauty prediction; convolutional neural network (CNN); lightening; fine-tuning

1006-7302(2017)03-0042-07

TP391.4

A

2017-02-17

国家自然科学基金资助项目(61372193);广东省高等学校优秀青年项目(SYQ2014001);广东省特色创新项目(2015KTSCX143,2015KTSCX145).

甘俊英(1964—),女,江西樟树人,教授,博士,研究方向为生物特征识别.