基于特征融合与改进神经网络的行人再识别*

2017-08-08蒋桧慧李小宝郭立君

蒋桧慧, 张 荣, 李小宝, 郭立君

(宁波大学 信息科学与工程学院,浙江 宁波 315211)

基于特征融合与改进神经网络的行人再识别*

蒋桧慧, 张 荣, 李小宝, 郭立君

(宁波大学 信息科学与工程学院,浙江 宁波 315211)

行人再识别中,为了获得基于突出性颜色名称的颜色描述(SCNCD)特征对于光照变化较好的鲁棒性,提出了融合SCNCD特征和对于视角变化鲁棒性高的局部最大出现概率(LOMO)表观特征;为了获得图像的结构信息,将图像划分为多个重叠块,并提取块特征;针对神经网络容易陷入局部极小值,且收敛速度慢的问题,引入动量项。经过公用VIPeR数据库和PRID450s数据测试后,实验结果表明:融合后的特征的识别能力明显高于原特征的识别能力,且改进后的神经网络收敛速度明显提高。

行人再识别; 局部最大出现频次(LOMO)特征; SCNCD特征; 块特征; 神经网络

0 引 言

行人再识别[1~4]即判断一个摄像头下出现的行人是否与另一个摄像头下出现的行人为同一行人。由于行人图像分辨率低,很难捕捉到人脸或其他生物特征,所以,行人再识别主要依据行人表观特征,如衣服的颜色、纹理等。由于受到光照、视角、遮挡、姿势等因素的影响,同一行人的外观差异很大,而不同行人也可能有很相似的外观,给行人再识别带来很大的挑战。

目前,行人再识别的研究主要集中在特征提取和度量学习方面。特征提取的主要任务是提取对于光照、视角、姿势等变化具有较高鲁棒性的有效特征。Farenzena M等人[2]根据对称和反对称性解决视角变化问题,将人体按照人体的结构划分为不同区域,对每个区域分布提取HSV直方图特征和纹理特征。Yang Y等人[5]提出了基于突出性颜色名称的颜色描述(salient color name based color descriptor,SCNCD)特征,确保与颜色越接近的颜色名称分配的概率越大。Liao S等人[6]提出了局部最大概率(local maximal occurrence,LOMO)特征,该特征按块提取HSV颜色直方图特征和尺度不变三值模式(SILTP)纹理特征,计算同一水平位置上所有块的局部特征的发生率,对于视角变化具有很好的鲁棒性。Zhao R等人[7]根据无监督学习获得每个块的突出性权值,在目标匹配时,融合图像块的突出性,突出性权值大的块在匹配中所占比重大。

度量学习[8]的主要任务是学习一个合适的度量,使得同一行人距离更近,不同行人距离更远。Kostinger K Q等人[9]提出了保持简单直接(keep it simple and straight,KISS)的度量学习算法,依据两个高斯分布的对数似然比检验学习度量。Zhang Y等人[10]在学习度量的过程中考虑了图像自身的差异性,学习得到的度量对于每个图像都有较高的适应性。Carr P等人[11]提出了使用弹性模型进行块匹配,有利于解决不同相机间的姿势和视角的变化。Wang J等人[12]在AUC损失函数基础上提出了top-heavy损失函数,对不同位置的错误排序进行不同程度的惩罚,位于序列前端位置的错误排序给予较大惩罚。

文献[5]提出的SCNCD特征对于光照变化有很好的鲁棒性,但是该特征对于视角变化的鲁棒性不高,而LOMO特征对于视角变化具有很好的鲁棒性。因此,本文提出在SCNCD特征的基础上,引入文献[6]提出的LOMO特征。考虑到基于局部块提取特征能够有效地获得图像的结构信息,本文提出了基于局部块结构融合LOMO特征和SCNCD特征的方法。

在度量学习方面,由于线性映射容易丢失行人图像的非线性流形结构,所以,本文采用非线性的反向传输(back propagation,BP)神经网络,将原始特征映射到目标空间,在目标空间中,进行相似性度量。神经网络的结构需要通过样本的特征训练得到,在训练的过程中,由于神经网络存在收敛速度慢等不足,所以,提出在更新权值时,引入动量项来增加网络的收敛速度。

1 所提方法

1.1 突出性颜色名称特征提取

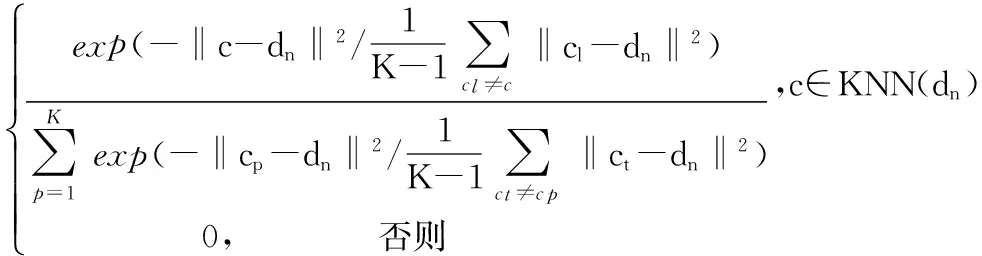

SCNCD特征[5]建立像素颜色与16种颜色名称之间的对应关系。对于RGB值相近的颜色,通常用同一个颜色名称表示。当光照变化时,在一定RGB值范围内的颜色,对应的颜色名称仍然不变,所以,颜色名称对于光照变化有很好的鲁棒性。此外,考虑到某种颜色映射到每个颜色名称的概率不相等,与颜色越相近的颜色名称映射到该颜色名称的概率越大,所以只建立像素颜色和与它最邻近的几个颜色名称的对应关系。映射关系如下

(1)

式中

且

式中 c={c1,c2,…,c16}为16种颜色名称;d={d1,d2,…,d512}为512种RGB相近的颜色;KNN(dn)为颜色dn的k近邻,k在实验中设置为5;cl,ct,cp均为dn的k近邻颜色名称;μ为dn的均值。该方法明显提高了特征对于光照变化的鲁棒性。

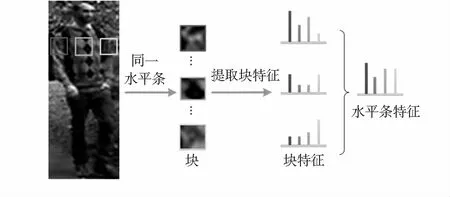

1.2 特征提取

图1为本文的特征提取过程,将128像素×48像素的图像划分为10像素×10像素,步长为5像素的重叠块,对同一水平条的所有块提取HSV颜色特征、SILTP纹理特征以及SCNCD特征。同一水平条的所有块提取特征后,最大化所有块特征相同二进制(bin)下的值,作为该水平条特征对应bin下的值。

图1 特征提取

水平条特征的提取过程:x为某水平条的特征,xp为某水平条所有块的特征。选择某水平条所有块{x1(i),…,xp(i),…,xp(i)}的第i维值的最大值x(i)=max{x1(i),…,xp(i),…,xp(i)}作为x(i)的值,i为特征向量的第i维。当行人在不同相机下视角发生变化时,某水平条的特征x在一定范围内具有稳定性,该方法很好地解决了相机的视角变化问题;同时对块提取SCNCD特征,保证了图像块对于光照变化具有一定的鲁棒性。

1.3 相似性度量学习

本文选用BP神经网络作为映射函数,在目标空间中,使用图像对特征的内积作为相似性度量

s(xA,xB)=〈f(xA),f(xB)〉

(2)

式中 xA,xB∈Rd1为待查询图像和目标图像的特征;W∈Rd1×d2为映射矩阵,用于对图像特征进行映射,通过相似性学习获得;b∈Rd2为偏差向量;d1,d2分别为原始特征空间和目标特征空间的维数。

(3)

1.4 增加动量项的梯度下降法

使用梯度下降法求解式(3)的最优解,损失L对W求偏导

(4)

(5)

当权值W接近于极值时,每次迭代变化很小,减缓了迭代速度,且可能在局部极值附近振荡,导致不能收敛,因此,考虑在更新参数的过程中加入动量项,权值的更新公式变为

(6)

式中η为学习率;α为动量项,表示W在第t+1步的变化与第t步的变化之间的关联。利用式(6)更新参数W,直至收敛,得到最优参数。参数b的求解与W相同。

2 实验结果与分析

使用VIPeR数据库[14]和PRID 450S数据库[15]进行评估,并与当前已有方法的实验效果进行比较。VIPeR和PRID 450S数据库通常用于单幅图像的行人再识别,但PRID 450S数据库比VIPeR数据库更加真实。实验结果通过累计匹配特征曲线(CMC)描述,CMC曲线表示在排名前n个人中正确匹配的人数。

2.1 参数设置

实验中,将数据库中的行人图像随机分为2部分,分别用于训练和测试。在测试阶段,选取其中一个摄像头下的图像作为待查询图像,另一个摄像头下的图像作为目标图像。实验结果通过对测试样本进行10次随机分配,并对分配后的测试样本进行评估后取得平均值。提取图像特征后使用PCA降维,VIPeR,PRID450S数据库分别降维至600,449维,并使用神经网络进行训练,学习率为10-2。

2.2 基于VIPeR数据库的实验

VIPeR数据库是从户外环境的2个摄像头中获取的,包含632个行人,每个行人有2张不同角度的图像。获取图像时,考虑了光照、视角、姿势、背景等变化,能够真实反映现实中的行人再识别问题。实验中,所有图像均归一化为128像素×48像素。

2.2.1 特征提取方法比较

为了评估本文提出的特征提取方法对于行人再识别效率的影响,在度量方法固定的条件下对比了本文方法与SCNCD,LOMO特征方法的实验效果。表1给出了使用本文的度量方法进行3种特征识别的实验效果。其中,r为目标人排名,下同。从表1的实验数据分析可知:本文的特征提取方法优于其他2种特征提取方法,尤其是排名第一(r=1)的正确匹配率(Rank1)。从表中可以发现本文方法的Rank1识别率比SCNCD方法Rank1的识别率高4.56 %,比LOMO方法Rank1识别率高1.52 %。

表1 VIPeR库不同特征的匹配率

2.2.2 度量方法比较

为了评估不同度量方法对于本文提出的特征提取方法的影响,在特征提取方法固定(本文特征方法)的条件下对比本文度量方法与传统的度量方法(PCCA[16],Svmml[17],MFA[17],kLFDA[18],KISSME[9])。图2、表2给出了对比实验效果,从图2的 CMC曲线及表2不难看出:本文方法与其他度量方法相比,排名第一的正确匹配率(Rank1)的值均高于其他度量方法Rank1。本文的度量方法使用非线性的神经网络进行度量学习而其他方法使用了线性的度量方法进行学习,因此,使用非线性的神经网络进行度量学习,识别率更高。

表2 VIPeR库不同度量方法的匹配率

图2 在VIPeR数据库上不同度量方式比较

2.2.3 BP网络改进性的验证

为了验证使用动量项改进BP神经网络对网络收敛速度的影响,在网络结构、权值、学习样本均相同的条件下,分别利用BP网络和改进的BP网络计算Rank1的识别率随迭代次数的变化情况。图3给出了BP网络和改进的BP网络下,Rank1的识别率随着迭代次数增加的变化情况,不难看出:对神经网络的参数进行更新时,使用动量项改进的神经网络收敛速度有了明显提高。

图3 Rank1跟随迭代次数的变动曲线

2.3 基于PRID 450S数据库的实验

PRID 450S数据库比VIPeR数据库更加真实。该数据库包含来自2个不重叠摄像机的450个行人,每个行人具有2张图像。由于视角变化,背景,遮挡等因素的影响,使得该数据库也有一定的挑战性。实验中,所有图像均归一化为160像素×60像素。

2.3.1 特征提取方法比较

为了评估本文提出的特征提取方法在PRID 450S数据库上的识别效果,固定度量方法对比SCNCD,LOMO特征提取方法与本文方法的识别效果。表3给出了识别效果对比,不难看出:本文的特征提取方法优于其它2种特征提取方法。本文方法较SCNCD方法的Rank1识别率高18.18 %,较LOMO方法Rank1识别率高3.29 %。

表3 PRID 450S库不同特征的匹配率

2.3.2 与现有方法的比较

为了评估本文的方法在PRID 450S数据库上的识别效果,将本文方法与现有的行人再识别方法进行比较。表4列出了常用的行人再识别方法在PRID 450S数据库上的识别效果,数据来源于相关论文或代码。将本文方法与KISSML,ELF,ECM,SCNCD,Semantic,LOMO,SLTRL等方法进行比较,从表中不难发现,本文的方法比其他方法的实验效果好,尤其是Rank1的值。

表4 PRID 450S库各算法部分匹配率比较

3 结束语

本文基于融合的思想,提出了结合LOMO特征和SCNCD特征的方法,通过将图像划分块,提取块的特征及多尺度下特征提取,增加了特征对于光照、视角及尺度变化的鲁棒性,提高了行人再识别的识别率。使用基于序列排序模型对神经网络进行训练,充分利用了样本的识别信息。通过增加动量项的方式,增加了网络的收敛速度,同时减小了网络陷入局部极小值的概率。通过对VIPeR数据库和PRID 450S数据库的测试表明:该方法取得了较好的识别效果。后期工作将重点在度量学习方面,研究如何学习出一种更高效的度量学习方法。

[1] 黄凯奇,陈晓棠,康运峰,等.职能视频监控技术综述[J].计算机学报,2015(6):1093-1118.

[2] Farenzena M,Bazzani L,Perina A,et al.Person re-identification by symmetry-driven accumulation of local features[C]∥Computer Vision and Pattern Recognition(CVPR),San Francisco,New Jersey:IEEE,2010,2360-2367.

[3] Gray D,Tao H.Viewpoint invariant pedestrian recognition with an ensemble of localized features[C]∥European Conference on Computer Vision,2008,New Jersey:IEEE,2008:262-275.

[4] Ma B,Su Y,Jurie F.Covariance descriptor based on bio-inspired features for person re-identification and face verification [J].Image and Vision Computing,2014,32(6):379-390.

[5] Yang Y,Yang J,Yan J,et al.Salient color names for person re-identification[C]∥European Conference on Computer Vision,Zurich,Switzerland,Springer,2014:536-551.

[6] Liao S,Hu Y,Zhu X,et al.Person re-identification by local maximal occurrence representation and metric learning[C]∥CVPR,Boston,MA,USA,New Jersey:IEEE, 2015:2197-2206.

[7] Zhao R,Ouyang W,Wang X.Unsupervised salience learning for person re-identification[C]∥Computer Vision and Pattern Recognition(CVPR),2013,Portland,Oregon,New Jersey:IEEE,2013:3586-3593.

[8] 俞 婧,仇春春,王 恬,等.基于距离匹配的行人再识别技术综述[J].微处理机,2016(3):77-80.

[9] Kostinger M,Hirzer M,Wohlhart P,et al.Large scale metric learning from equivalence constraints[C]∥Computer Vision and Pattern Recognition (CVPR), 2012,Providence,RI,USA,New Jersey:IEEE,2012:2288-2295.

[10] Zhang Y,Li B,Lu H,et al.Sample-specific SVM learning for person re-identification[C]∥Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition,2016:1278-1287.

[11] Carr P.Person re-identification using deformable patch metric learning[C]∥2016,IEEE Winter Conference on Applications of Computer Vision,IEEE,Lake Placid,NY,USA,2016:1278-1287.

[12] Wang J,Sang N,Wang Z,et al.Similarity learning with top-heavy ranking loss for person re-identification [J] IEEE Signal Processing Letters,2016,23(1):84-88.

[13] Zhao R,Ouyang W,Wang X.Person re-identification by salience matching[C]∥Proceedings of the IEEE International Conference on Computer Vision,2013:2528-2535.

[14] Gray D,Brennan S,Tao H.Evaluating appearance models for recognition,reacquisition,and tracking[C]∥Proc of IEEE International Workshop on Performance Evaluation for Tracking and Surveillance (PETS),2007.

[15] Roth P M,Hirzer M,et al.Person re-identificaiton[M].London:Springer,2014:247-267.

[16] Mignon A,Jurie F.Pcca:A new approach for distance learning from sparse pairwise constraints[C]∥CVPR,2012,Providence,New Jersey:IEEE,2012:2666-2672.

[17] Yan S,Xu D,Zhang B,et al.Graph embedding and extensions:A general framework for dimensionality reduction[J].IEEE Tran-sactions on Pattern Analysis and Machine Intelligence,2007,29(1):40-51.

[18] Xiong F,Gou M,Camps O,et al.Person re-identification using kernel-based metric learning methods[C]∥ECCV,Zurich,Switzerland,Springer,2014:1-16.

[19] Liu X,Wang H,Wu Y,et al.An ensemble color model for human re-identification[C]∥WACV,2015,Hawaii,USA,2015:868-875.

[20] Shi Z,Hospedales T M,Xiang T.Transferring a semantic representation for person re-identification and search[C]∥Computer Vision and Pattern Recognition.Boston,New Jersey:IEEE,2015:4184-4193.

Pedestrian re-identification based on feature fusion and improved neural network*

JIANG Hui-hui, ZHANG Rong, LI Xiao-bao, GUO Li-jun

(College of Information Science and Engineering,Ningbo University,Ningbo 315211,China)

In person re-identification,aiming at salient color named based color descriptor(SCNCD) features based on salient color names are robust to illumination changes,propose to fuse the SCNCD features and the LOMO features which are robust to viewpoint changes.In order to get structure information of images,the images are divided into overlapping patches and the patch features are extracted.In order to solve the problems that neural network is easy to fall into local minimum and its convergence speed is slow,momentum term is introduced.The proposed method has been tested in the most challenging public VIPeR database and PRID450s database,and experimental results prove that recognition abilities of the fused features are obviously higher than that of the original features,and convergence speed of the improved neural network is increased obviously.

pedestrian re-identification; local maximal occurrence(LOMO) features; salient color name based color descriptor(SCNCD) features;patch features; neural network

10.13873/J.1000—9787(2017)08—0121—05

2017—06—02

国家自然科学基金资助项目(61175026);浙江省自然科学基金资助项目(LY17F030002);“信息与通信工程”浙江省重中之重学科开放基金资助项目(XKXL1516, XKXL1521)

TP 391

A

1000—9787(2017)08—0121—05

蒋桧慧(1993-),女,通讯作者,硕士研究生,主要研究方向为计算机视觉与模式识别,E—mail:393607151@qq.com。

郭立君(1970-),男,博士,教授,主要从事计算机视觉与模式识别、移动互联网及其应用研究方向。