基于视觉信息的四轴飞行器位姿估计研究

2017-07-12范大东林林熊芝

范大东+林林+熊芝

摘要:提出一种基于已知特征点的单目视觉位姿估计方法。根据摄像机透视投影成像关系,建立四轴飞行器视觉位姿估计模型,设计一种着陆目标图案,提出着陆目标图案特征点提取及标记方法。实验结果表明,该位姿估计算法是有效的。

关键词:机器视觉;四轴飞行器;位姿估计

DOIDOI:10.11907/rjdk.171358

中图分类号:TP319

文献标识码:A 文章编号:1672-7800(2017)006-0120-04

0 引言

视觉导航技术具有设备简单、信息量大、抗电子对抗和无源性强等特点,其作为自主飞行器的辅助导航技术已经受到业界人士的高度重视,是目前无人飞行器导航技术领域中的研究热点。机载摄像机是飞行器的“眼睛”,通过它,飞行器可以实现避障、位姿估计以及目标识别等。因此,将计算机视觉运用于飞行器辅助导航具有明显优势[1-2]。

基于特征点的视觉导航方法,是近年来视觉导航领域研究较为活跃的内容之一。其基本原理为:将摄像机装载在飞行器上,并在参考目标上预先设置已知的特征点,通过提取已知特征点对应的图像坐标,根据摄像机透视投影模型,实时估计出摄像机相对于参考目标的位置姿态。

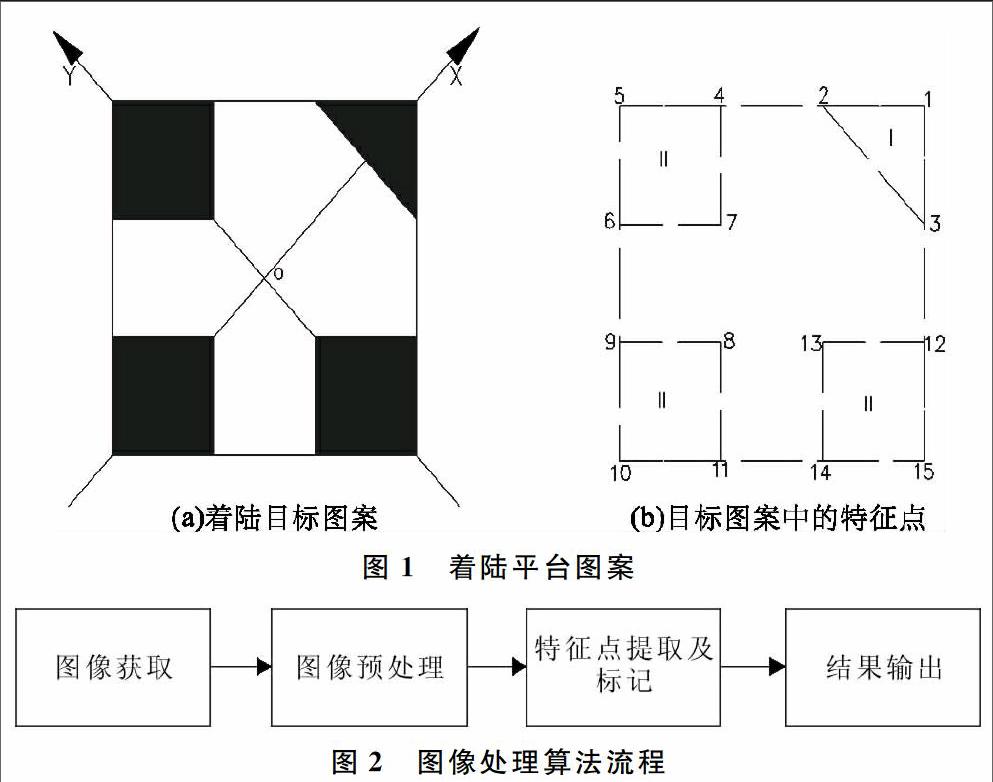

本文设计了由3个黑色正方形和1个黑色三角形组成的平面着陆目标图案,以正方形和三角形顶点为图像特征点,提出了一种基于平面单应性变换的图形特征点实时提取标记方法,利用提取的特征点图像坐标及对应的世界坐标,实时估计摄像机的位置参数,将其作为飞行器视觉导航信号。

1 着陆标志物及特征点标记

本文设计的着陆图案如图1(a)所示。着陆图案的边长为60mm,其中小正方形的边长为20mm,等腰直角三角形的直角边长为20mm。在着陆图案中,黑白相间的角点即为设计的特征标记点集。着陆图案可以分成4个部分,形状包括两种类型:I型和II型。如图1(b)所示,定义着陆目标图案的中心为世界坐标系原点,类型I的区域中心处于世界坐标系的X轴正半轴,类型II的区域中心依次分布在其余轴线上,采用右手法则来确定Z轴,可以看到各特征点在世界坐标系中的坐标是明确的。

针对所设计的着陆目标图案,图像处理的目的是确定标志点的位置,然后提取和标识出这些特征点。本文中的图像处理算法流程如图2所示,这里首先使用摄像机获取图像,然后对图像进行预处理,主要包括图像滤波、阈值分割等,最后检测与提取特征点,使用标记算法对其进行标记。

主要算法如下:

(1)阈值分割。阈值分割是指根据像素的灰度、颜色、纹理等特性按照一定的原则将一副图像或景物分割成若干个特定的、具有独特性质的部分或者子集,并提取出感兴趣目标的技术和过程。阈值分割后图像如图3(b)所示。

(2)边缘检测。边缘是不同区域的分界线,是图像局部强度变化最显著的那些像素的集合。本文边缘检测的目的是提取图像中3个四边形的边缘和1个三角形的边缘。边缘提取后图像如图3(c)所示。

(3)角点检测。图像中的角点是指图像中具有高曲率的点,本文使用的是Harris角点检测算法[3]。角点检测后图像如图3(d)所示。

(4)分割标志图案上的三角形。首先筛选出连通区域轮廓,对提取的轮廓进行直线简化,然后计算4个区域轮廓的周长为:Ci(i=1~4)。搜索4个周长中的最小值min(Ci),则min(Ci)所对应的区域I即为三角形区域。

3 实验

得到特征点的像素坐标系的坐标(u,v)及世界坐标系的坐标(xw,yw,zw)后,根据两步法标定原理,利用Matlab/GUI工具 [9],得到位姿估计模型GUI界面如图6所示。

本文采用如下方案来验证所建立的位姿估计模型的正确性[10],在着陆目标平板上绘制两个相同的特征图案,如图7所示,设定它们的距离分别为100mm、150mm、200mm、250cm和300mm。

将摄像机(摄像机为Prosilica GT2750 CCD工业相机、16mm镜头,图像大小为像素)固定在着陆目标图案的上方对该着陆目标图案进行拍照,然后利用上述位姿估计模型解算出相对位置估计测量值,得到表1的测量结果。由表1可知,位置估计误差在11mm以内,本文建立的位姿估计模型基本满足位置估计要求。

4 结语

本文以飞行器自主着陆阶段为研究对象,根据摄像机透视投影成像关系,建立了飞行器视觉位姿估计模型,设计了一种着陆目标图案,并对其进行图像处理、角点提取和特征点标记,利用两步法摄像机标定原理对摄像机位姿进行了解算,使用Matlab/GUI工具对该算法加以实现,最后利用实验室现有的条件对其进行了验证。结果证明,本文提出的图像处理及相关位姿估计算法具有一定的导航精度。但是由于需要进行大量的图像处理,耗时较多,还很难满足飞行器自主着陆阶段实时性的要求,因此缩短图像处理时间将是后续研究的重点。

参考文献:

[1]SRIKANTH SARIPALLI,JAMES F MONTGOMERY,et al.Vision-based autonomous landing of an unmanned aerial vehicle[C].Proceedings of the 2002 IEEE International Conference on Robotics & Automation,2002: 2799-2804.

[2]COURTNEY S SHARP,OMID SHAKENIA,S SHANKAR SASTRY.A vision system for landing an unmanned aerial vehicle[C].Proceedings of the 2001 IEEE International Conference on Robotics & Automation,2001:1720-1727.

[3]赵文斌,张艳宁.角点检测技术综述[J].计算机应用研究,2006,10(1):17-20.

[4]邱力为,宋子善,沈为群.用于无人直升机着舰控制的计算机视觉技术研究[J].航空学报,2003,24(4):351-354.

[5]TSAI R Y.An efficient and accurate camera calibration technique for 3D machine vision[C].In Proc.CVPR,1986:364-374.

[6]趙明.基于图像的物体尺寸测量算法研究[J].软件导刊,2016,15(11):48-52.

[7]樊冬雪.四轴飞行器视觉导航系统的设计[J].计算机技术与用,2014,40(8):140.

[8]阮利锋.小型无人直升机自主着陆视觉导航系统设计及仿真[D].上海:上海交通大学,2009.

[9]周平.MATLAB图像处理与图形用户界面设计[M].北京:清华大学出版社,2013.

[10]王山山,王丹.Matlab下视频处理系统设计与实现[J].软件导刊,2016,15(12):71-73.

(责任编辑:孙 娟)