运动区域提取和闪频分析并行的火焰检测算法*

2017-04-27陈垂雄严云洋刘以安高尚兵周静波

陈垂雄 严云洋 刘以安 高尚兵 周静波

(1.江南大学物联网工程学院,无锡,214122;2.淮阴工学院计算机工程学院,淮安,223003)

运动区域提取和闪频分析并行的火焰检测算法*

陈垂雄1,2严云洋1,2刘以安1高尚兵2周静波2

(1.江南大学物联网工程学院,无锡,214122;2.淮阴工学院计算机工程学院,淮安,223003)

在火焰检测中对火焰运动区域提取和闪烁特征分析大都分开进行,本文在提取运动区域的同时分析该区域的闪频特性,即将火焰的运动特征和闪烁特征同时提取。首先基于Ohta颜色空间找出图像中具有火焰颜色的疑似区域,其次根据视频图像某个位置在一段时间内变化的程度和次数是否都达到一定程度提取具有闪烁特性的运动区域,最后根据具有火焰颜色的连通区域是否包含这种运动区域,且颜色区域与运动区域的面积比例是否达到一定比值,来判断该连通区域是否为火焰。实验结果表明该方法在提取运动区域的同时能排除不具火焰闪烁特征的前景,且能在运动区域提取不完整的情况下保持较高的火焰检测率和较低的误检率。

运动区域;闪频分析;火焰检测;区域面积;不完整运动区域

引 言

传统的火灾警报系统是基于红外监控器、光学监控器或者离子监控器,依靠烟雾、热和辐射等火灾特性来判断是否有火灾发生。然而,这些传统的火灾报警系统要等到如热量、烟雾粒子等报警信号[1]实际到达监控器才触发警报,并且它们通常不能提供火灾的位置和火灾的发展程度等信息。而基于计算机视觉的火灾检测方法因为适用于大空间,反应快速而得到广泛的关注。严云洋等[2]提取火焰的颜色区域后,用逻辑回归对火焰的闪频特征进行分析。Chen等[3]通过改进高斯混合模型提取运动区域,用颜色特征提取疑似火焰区域,然后对具有火焰颜色的运动物体进行火焰的闪烁特征分析,从而达到最后的判断。谢迪等[4]在分析火焰运动和颜色特征的基础上,通过傅里叶变换提取火焰的闪烁特征,并将其和圆形度、角点等空域特征输入神经网络进行训练与判别。Wang等[5]提取运动区域与颜色区域后,用隐马尔可夫模型模拟火焰的闪烁特征,并用亮度图达到最后的判断。可见,许多火焰检测方法都对火焰的运动和闪频这两个重要特征进行了分析。然而,由于这两个步骤是串行进行的,因此对于火焰检测的实时性将有一定影响。上述方法在将颜色与运动区域相与的时候,对运动区域的提取提出了比较苛刻的要求,当运动区域提取不完整时,与颜色区域相与后得到的区域可能不再是火焰的真实外形,这对于进一步的闪烁特征分析或其他特征参数提取将产生较大的影响。更有甚者,在提取运动区域时,如果帧间间隔没把握好,可能因帧间变化太小而提取不到运动区域。

本文根据火焰闪烁时本身所具有的运动特性,将两个特征的提取同步进行,即在进行运动区域提取的同时,也判断该运动区域是否具有火焰的闪烁特性。即使提取的火焰运动区域不完整,但通过对运动区域与颜色区域的重叠情况,可以判断出该颜色区域是否同时具备运动和闪烁特性,从而达到火焰识别的目的。这样在缩短识别过程的同时,可以最大限度地保留真实火焰的全貌,从而提高火焰的检测准确率。

1 火焰颜色区域提取

一般可燃物燃烧的颜色在各个颜色空间中都有特定的分布模型,火焰外形呈现由内到外由白变黄再到红的环形嵌套结构,并且对于每个火焰颜色像素,红色分量都占较大比重。Yan等[6]对红绿蓝(Red,Green,Blue,RGB)分量进行线性变换,在Ohta颜色空间建立了应用于火焰检测的一种色彩模型。由于火焰图像在Ohta颜色空间次佳特征的直方图都变为单峰或双峰特性,比较适合分割提取,所以本文使用该空间的次佳特征。但如果只使用该判别规则,可能把某些红色分量没有占据主要比重的像素也提取进来,故同时对红色分量进行限制,从而提取类似火焰颜色的区域。具体判别如下

(1)

(2)

式中:I为Otha颜色空间的次佳特征;Rt为红色分量阈值,取值范围一般在160~200之间;R和B分别为RGB空间的红色分量和蓝色分量值。

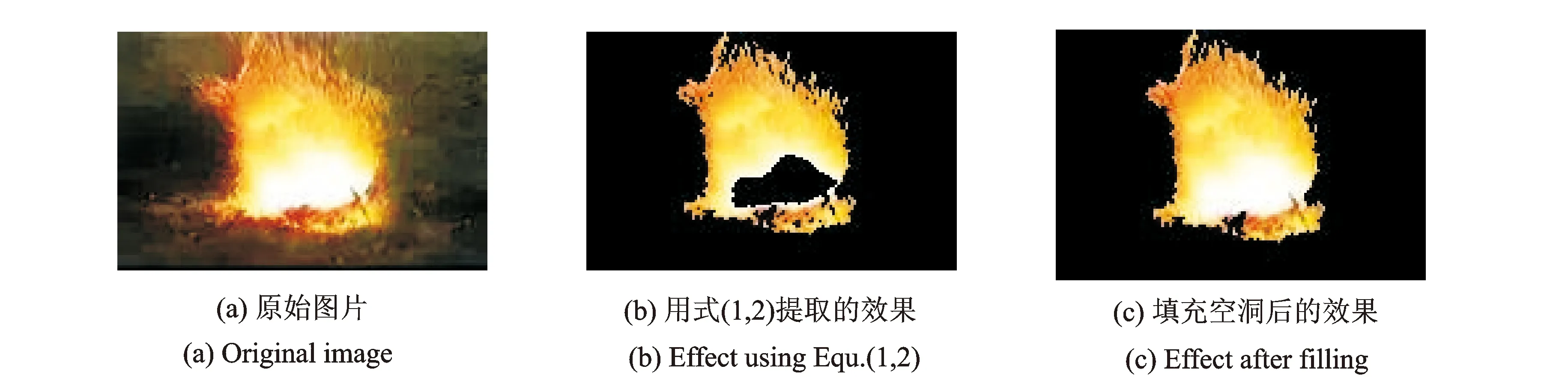

当火焰内部为白色时,使用该颜色模型得到的区域一般会产生空洞,但由于高温的白色区域一般被外部温度较低的黄-红区域包围,形成空洞,这时如果用空洞填充方法就能填充区域的空洞,从而提取较为完整的疑似火焰区域,效果如图1所示。

图1 基于颜色特征的疑似火焰区域提取Fig.1 Flame candidates extraction based on color feature

2 运动区域和闪烁特征提取

由于受气体羽流卷吸及自身辐射的影响,火苗会出现无序闪动,具体表现为一种持续的高频时序变化。大量研究表明,这种闪烁频率主要在7~12Hz动态范围内[7]。火焰闪烁的一个显著特征是火焰边缘的像素灰度值在帧与帧之间发生较为明显的变化,而运动区域的提取一般也是基于帧间像素灰度值的变化,所以火焰的闪烁特征其实也体现着火焰的运动。虽然火焰的闪烁特性分析是基于连续多帧图像的,但考虑到火焰在短时间内基本上是在同一位置抖动,所以可利用闪烁特征来提取火焰的运动区域,即将闪烁分析与运动区域提取合二为一,这样提取出的运动区域同时也具有火焰的闪烁特性。

在对火焰的闪烁特性进行分析时,当前主流的方法有空间域向频率域的转化和基于某个像素在多帧之间的亮度或红色分量变化次数两种。由于空间域向频率域转化较费时,本文选择第二种方法。如文献[3]一样,许多研究者将某个像素在帧间的亮度差取绝对值,根据该绝对值的大小及变化次数,判断是否为火焰。为了更好地说明火焰的闪烁特性,本文进行运动提取与闪频分析的方法如下。

首先建立两个与原图分辨率相同的计数矩阵map1和map2,t时刻,当某个像素(x,y)当前帧与前一帧红色分量差值大于某个阈值T,将map1(x,y,t)在前一帧map1(x,y,t-1)的基础上加1进行累加,map2(x,y,t)加0;当(x,y)当前帧与前一帧红色分量差值小于某个阈值负T,将map2(x,y,t)加1,map1(x,y,t)加0;如果不是以上两种情况,map1(x,y,t)和map2(x,y,t)都加0。

(3)

(4)

(5)

(6)

式中:T为一个正实数,用于消除系统噪声等因素对像素红色分量值产生的影响。T值一般在5~20之间,可以取固定值,也可以用Turgay Celik[8]提出的动态阈;R(x,y,t)和R(x,y,t-1)分别为t时刻与t-1时刻(x,y)像素的红色分量值。在监控视频图像序列中,静止的目标区域红色分量值基本不变,运动的车灯会让像素的红色分量有较大变化,但这些变化持续的时间比较短,并且一般是持续增加或减少,而火焰像素的红色分量会在增加与减少之间反复多次出现,map1(x,y,t)和map2(x,y,t)的变化都会超出某一阈值。如果某个像素(x,y)在某段时间内map1(x,y,t)和map2(x,y,t)的变化都超出某个阈值,则这个像素可能就是火焰的边缘像素。火焰闪烁特性如式(7~9)所示

map1(x,y,t)=1map1(x,y,t)-map1(x,y,t-N)≥COUNT

(7)

map2(x,y,t)=1map2(x,y,t)-map2(x,y,t-N)≥COUNT

(8)

MAP=MAP1⊗MAP2

(9)

式中:MAP1,MAP2和MAP均为与原图像分辨率相同的二值矩阵,符号⊗表示二值与运算;N为累加时间窗,大小与视频采集的速率相当[9],本文取19;COUNT为判断像素是否闪烁的阈值,其值既与累加时间窗N有关,又与视频采集速率有关,由于视频采集速率一般为25 fps,火焰的闪烁频率为7~12 Hz,这样在20帧内大概闪烁了6次,所以本文COUNT取值为3;map1(x,y,t),map2(x,y,t)和map1(x,y,t-N)、map2(x,y,t-N)分别为t和t-N时刻像素(x,y)的计数值。上式得到的二值图map中为1的像素即为火焰的闪烁像素,同时也是火焰在时刻t的边缘近似运动区域。为了去除图像中存在的噪声点并连接邻近像素,本文使用二值形态学运算对二值图MAP进行处理。实验选取半径分别为l和3的圆盘状结构元素对图像进行腐蚀和膨胀,效果如图2所示。

图2 运动区域的提取Fig.2 Motion region extraction

从图2可以看出,用混合高斯模型提取的运动区域包含走动的人和运动的车灯等干扰物,但用本文方法提取的运动区域能将上述干扰物排除,因为它们都不具备火焰的闪烁特性。

3 火焰的判别

由于本文提取的运动区域是基于前面几帧图像提取的,所以t时刻本文提取的运动区域与火焰的真实运动区域有点差别,但由于短时间内火焰基本上在同一个位置重复运动,因此提取的区域还是火焰的近似运动区域。

火焰判别算法流程如图3所示。考虑到本文得到的颜色区域相对运动区域较为准确,它能刻画火焰的外形、大小等特征,故本文先以颜色特征提取疑似火焰的区域,得到颜色图。为避免运动区域因使用形态学算法使边缘超出颜色区域,本文以颜色图BW与运动图MAP的交集MIX作为运动图,该图中的各个区域既具有火焰的颜色,又具有运动和闪烁特性。将颜色二值图BW和交集图MIX中的像素分别进行8邻域连接形成连通区域,并对两张图中各个连通区域进行标记。对于每个颜色区域,如果它包含一个相交区域,并且该相交区域的面积达到颜色区域面积的一定程度P,则判定该颜色区域为火焰,该火焰判别方法能弥补运动区域提取不完全的缺陷,如式(10~11)所示,即

MIX=BW⊗MAP

(10)

BW(i)=1 MIX(j)⊆BW(i)&MIX(j).Area/BW(i).Area≥Pi=1,2,…,n;j⊂[1,m]

(11)

式中:i,j代表用连通区域标记法标记的某个连通区域;n为颜色图总的连通区域个数;m为交集图总的连通区域个数;MIX(j).Area代表某个相交区域的面积;BW(i).Area代表第i个颜色区域的面积;1代表该颜色区域为火焰,0代表该颜色区域为非火焰;P为区域频闪特性的判断阈值[9],MIX(j).Area/BW(i).Area≥P说明火焰中心相对稳定,边缘随机运动剧烈,区域变化像素点总数应稳定于一定的范围内,P太大可能造成火焰的漏检率增大,P太小可能使非火焰的误检率增大,为保证检测率和减少漏检率,P取0.1。

4 实验结果及分析

本文在CPU为Inteli5,主频为2.50GHz,内存为4.00GB的实验环境下用MatlabR2012b进行测试。选取Bilkent大学火灾视频库(http://signal.ee.bilkent.edu.tr/VisiFire/index.html)的4段火焰视频和2段非火焰视频(描述如表1所示)进行测试,并与别的方法对比分析。

表1 视频情况描述

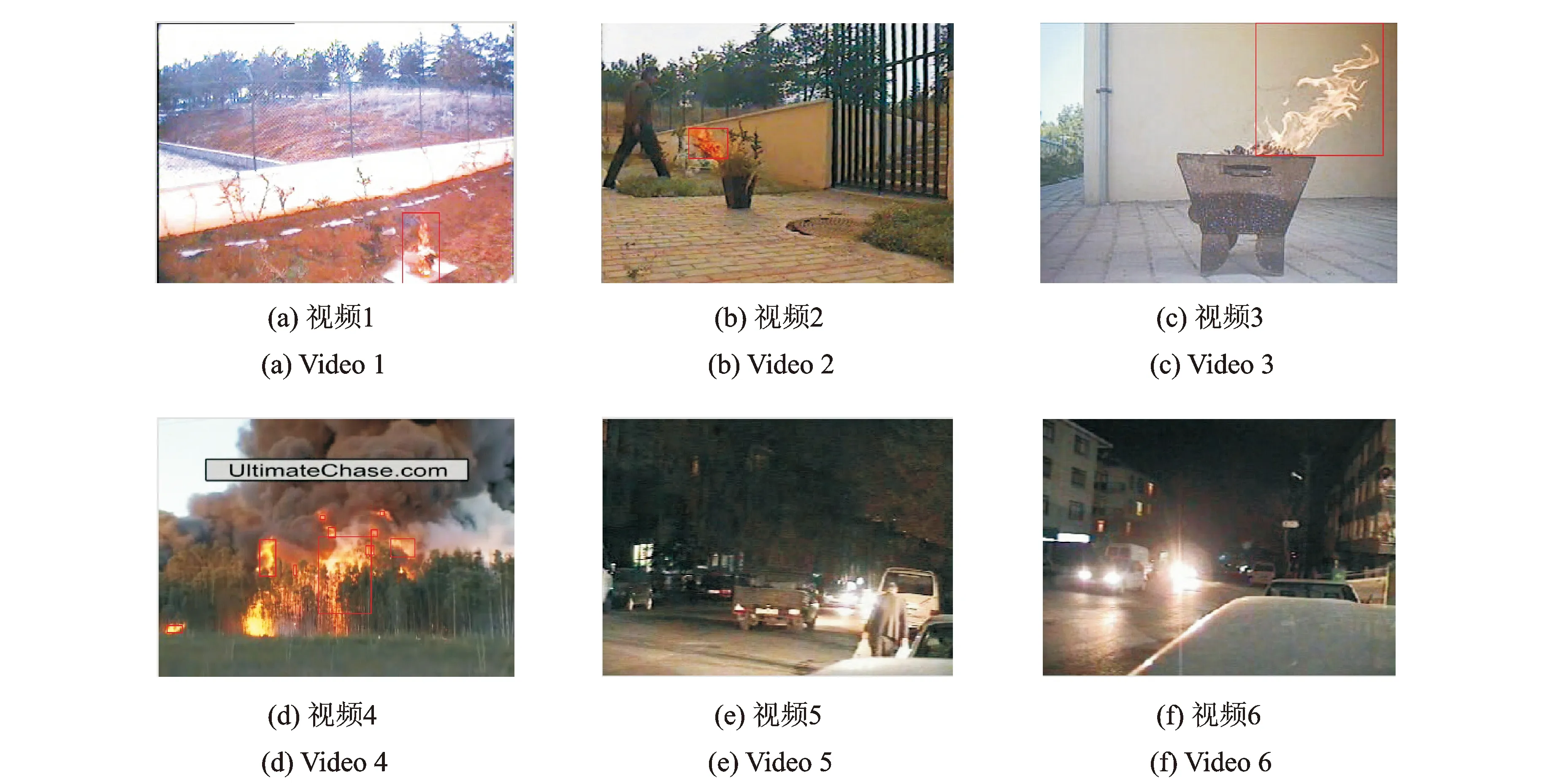

样本实例及检测结果如图4所示,火焰视频和非火焰视频检测结果与文献[10~12]对比情况如表2,3所示。由于本文的运动提取和闪频分析是通过20帧累积的,所以视频前19帧无法作判断,为此在与文献[10~12]比较时,检测帧数也相应地去掉前19帧,计算得到它们新的检测数据。

从表2和表3可以看出,文献[11]对于森林火焰有较高的准确率,而对于其他类型的火焰,尤其是当非火焰干扰时准确率大幅度降低,这是因为它只用森林的火焰样本进行统计分析,在其他场景的适用性较低;又因为其检测步骤过于简单,对火焰的一些主要特征缺少分析,所以对车灯等具有类似火焰颜色的运动物体误检率高。文献[10]采用双差法并结合HSI空间中的3个颜色公式检测运动目标,虽然基于多阈值判定的双差法在火焰视频中检测结果较好,但也容易误检类似火焰颜色的运动物体,所以对于车灯的干扰误检率极高。文献[12]既用了火焰颜色与运动特征,又将火焰的表面粗糙度和边界粗糙度等参数输入BP神经网络训练,所以准确率相比前面的文献高。本文虽然在视频5的误检率较高,但相比其他文献在各种场景的准确率几乎都有提高,视频5由于双向都有车灯,光线复杂,且卡车后车灯在大部分时间内具有与火焰相似的闪烁特性,所以误检率较高。

图4 视频样本示例及检测效果Fig.4 Video examples and detection results

视频总帧数火焰帧数文献[10]文献[9]文献[11]本文算法准确率/%漏检率/%准确率/%漏检率/%准确率/%漏检率/%准确率/%漏检率/%136336358.341.790.79.390.79.31000.0261661682.018.093.36.777.922.188.111.9342042074.825.298.31.791.28.893.36.7420020095.54.596.04.090.59.599.50.5

表3 非火焰视频检测结果

5 结束语

本文用Ohta颜色空间提取火焰的颜色区域,并对区域可能出现的空洞进行填充,然后基于帧间的累积将运动区域提取与闪烁特性分析合二为一,最后结合运动和闪烁特性对每一个颜色区域进行判断,看其是否为真实的火焰。实验结果表明,本文提出的算法对不同场景具有较高的检测率和较强的鲁棒性。然而对于燃烧稳定的火焰,闪烁特征将不那么明显,本文的算法性能会下降,今后将考虑把火焰的其他静态和动态特征融入火焰的检测中,以提高检测的准确率和抗干扰性。

[1] 李正周, 方朝阳, 顾园山, 等. 基于无线多传感器信息融合的火灾检测系统[J]. 数据采集与处理, 2014,29(5):694-699.

Li Zhengzhou, Fang Chaoyang, Gu Yuanshan, et al. Fire detection system based on wireless multi-sensor information fusion[J]. Journal of Data Acquisition and Processing, 2014,29(5):694-699.

[2] 严云洋, 吴茜茵, 杜静, 等. 基于色彩和闪频特征的视频火焰检测[J]. 计算机科学与探索, 2014,8(10):1271-1279.

Yan Yunyang, Wu Xiyin, Du Jing. et al. Video fire detection based on color and flicker frequency feature[J]. Journal of Frontiers of Computer Science and Technology, 2014,8(10):1271-1279.

[3] Chen Juan, He Yaping, Wang Jian. Multi-feature fusion based fast video flame detection[J]. Building and Environment, 2010,45(5):1113-1122.

[4] 谢迪, 童若锋, 唐敏, 等. 具有高区分度的视频火焰检测方法[J]. 浙江大学学报(工学版), 2012,46(4):698-704.

Xie Di, Tong Ruofeng, Tang Min, et al. Distinguishable method for video fire detection[J]. Journal of Zhejiang University(Engineering Science), 2012,46(4):698-704.

[5] Wang Liqiang, Ye Mao, Ding Jian, et al. Hybrid fire detection using hidden Markov model and luminance map[J]. Computers & Electrical Engineering, 2011,37(6):905-915.

[6] Yan Yunyang, Guo Zhibo, Wang Hongyan. Fire detection based on feature of flame color[C]∥ Proceedings of the 2009 Chinese Conference on Pattern Recognition. Washington D C, USA: IEEE Computer Society Press, 2009:349-353.

[7] 安患伟, 袁宏永, 屈玉贵. 数据采集在火焰闪烁频率的测量研究及分析中的应用[J]. 火灾科学, 2000,9(2):43-47.

An Huanwei, Yuan Hongyong, Qu Yugui. Data collection on the research of fire flash frequency[J]. Fire Safety Science, 2000,9(2):43-47.

[8] Celik T. Fast and efficient method for fire detection using image processing[J]. Etri Journal, 2010,32(6):881-890.

[9] 胡国良, 江熹, 王少龙. 基于多特征融合的视频火焰检测技术研究[J]. 机械设计与制造, 2012(7):213-215.

Hu Guoliang, Jiang Xi, Wang Shaolong. Research of video flame detecion based on multi-feature integration technology[J]. Machinery Design & Manufacture, 2012(7):213-215.

[10]Chen T H, Wu P H, Chiou Y C. An early fire-detection method based on image processing[C]∥Proceedings of the 2004 IEEE International Conference on Image Processing(ICIP04). Washington D C, USA: IEEE Computer Society Press, 2004:1707-1710.

[11]Celik T, Demirel H. Fire detection in video sequences using a generic color model[J]. Fire Safety Journal, 2009,44(2):147-158.

[12]Rong Jianzhong, Zhou Dechuang, Yao Wei, et al. Fire flame detection based on GICA and target tracking[J]. Optics & Laser Technology, 2013,47:283-291.

Fire Detection Based on Parallel Computing of Motion and Flicker Frequency Feature

Chen Chuixiong1,2, Yan Yunyang1,2, Liu Yi′an1, Gao Shangbing2, Zhou Jingbo2

(1.School of Internet of Things Engineering, Jiangnan University, Wuxi, 214122, China;2.Faculty of Computer Engineering, Huaiyin Institute of Technology, Huaian, 223003, China)

The extraction of motion regions and analysis of flicker are carried out separately in flame detection usually. A novel method is proposed here. Flicker of flame is detected while the motion regions are extracted. Firstly, candidate fire regions were detected based on Ohta color space with a color model of flame. Then, the motion regions with flicker frequency feature were extracted according to the degree and times of changes over a period at a certain position. Finally, the status whether the connected region is in flames or not was determined according to the intersection between the flame color region and the motion region. Experimental results show that the proposed method can ignore the regions which do not have the feature of flame flicker after the motion regions were extracted.It also performs well with high flame detection rate and lower false detection rate even if the motion region is incomplete.

motion region; analysis of flicker; flame detection; region area; incomplete motion region

国家自然科学基金(61402192)资助项目;教育部科学技术研究重大(311024)资助项目;江苏省“六大人才高峰”(2013DZXX-023)资助项目;江苏省“333工程”(BRA2013208)资助项目;江苏省“青蓝工程”资助项目;淮安市“533工程”资助项目;淮安市科技计划(HAG2013057,HAG2013059)资助项目。

2015-05-20;

2015-07-20

TP391.41

A

陈垂雄(1988-),男,硕士研究生,研究方向: 数字图像处理、模式识别,E-mail:494231126@qq.com。

高尚兵(1981-),男,博士、副教授,研究方向:数字图像处理、模式识别。

严云洋(1967-),男,博士、教授,研究方向:数字图像处理、模式识别。

周静波(1983-),男,博士,研究方向:数字图像处理、模式识别。

刘以安(1963-),男,博士、教授,研究方向:模式识别、数据融合。