激光点云在无人驾驶路径检测中的应用

2016-12-20张永博李必军

陈 诚,张永博,李必军

(武汉大学测绘遥感信息工程国家重点实验室,湖北 武汉 430079)

激光点云在无人驾驶路径检测中的应用

陈 诚,张永博,李必军

(武汉大学测绘遥感信息工程国家重点实验室,湖北 武汉 430079)

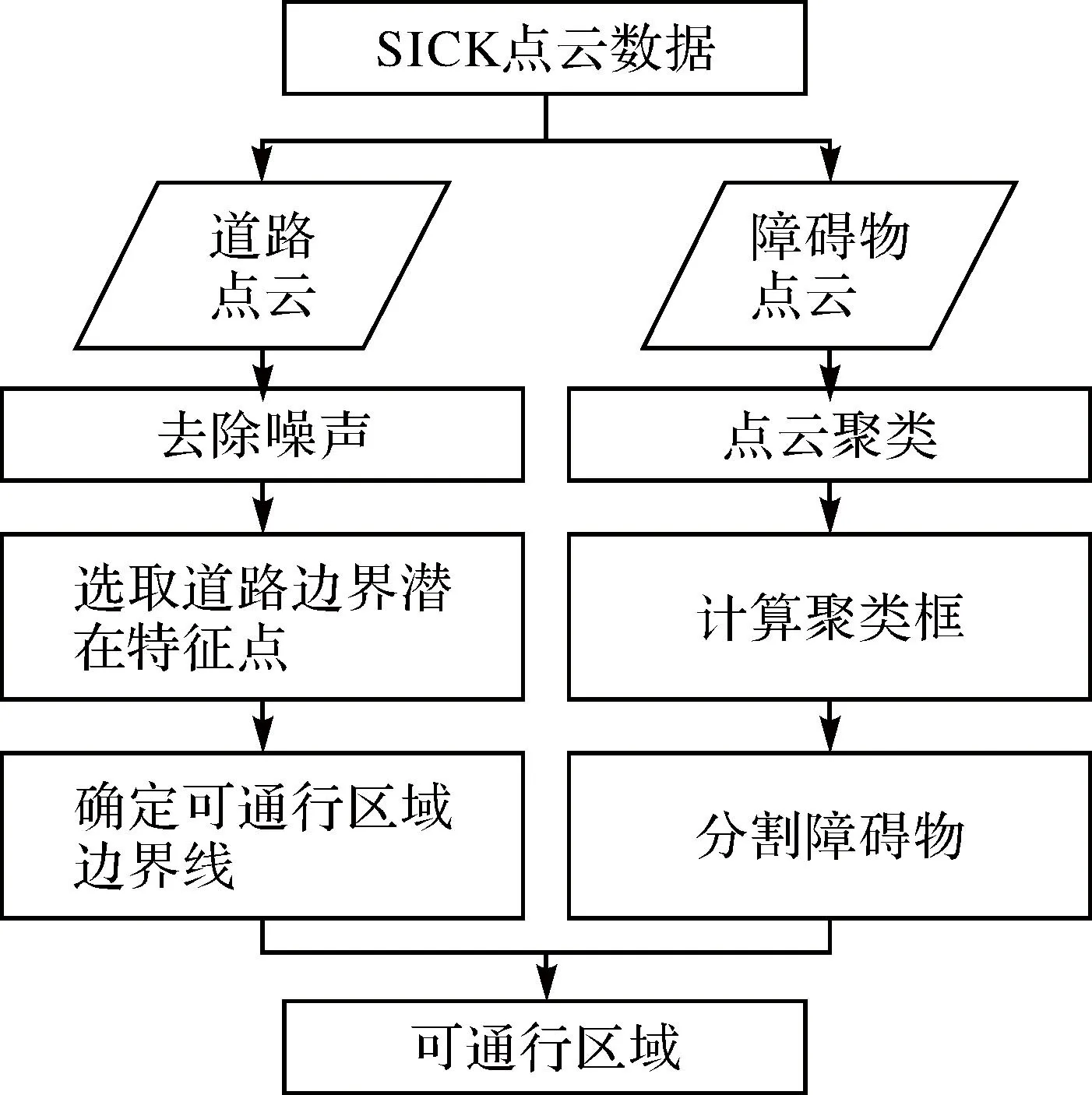

针对室外自然环境下无人自主地面智能车辆的可通行区域检测问题,提出了一种基于激光点云的道路可通行区域检测算法,包括倾斜检测道路边界和水平探测前方障碍物。道路边界检测主要依据道路区域与非路区域之间存在的高度差异来筛选道路边界特征点,结合通行宽度阈值提取道路边界线;前方障碍物检测则依据扫描点间距离聚类成不同的点云簇,对点云簇进行识别和定位,从而确定障碍物位置和大小。结合道路边界和障碍物信息提取车辆的可通行区域,为无人车路径规划提供依据。试验表明,该算法能够较好地检测出无人车的可通行区域。

激光点云;路径检测;点云处理;无人驾驶

随着汽车行业的不断发展,无人驾驶技术已成为智能交通和自动化领域的一个研究热点,其发展将大大提高交通系统的效率和安全性,有非常广阔的应用场景,对现代交通系统的发展有着重要意义。一般来说,一个完整的无人驾驶系统由视觉识别模块(车道线识别和交通标志识别)、障碍物识别模块(车辆识别和行人识别)、定位和地图模块(GPS和GIS)、路径规划模块和跟踪模块等组成。其中,无人车可通行区域检测是无人驾驶系统中极为重要的一个部分。

可通行区域的检测主要针对车辆周围局部环境的道路边界检测和障碍物检测,防止危险状况发生[1],是无人驾驶车辆安全行驶的保障。大部分的检测系统和算法都用到多种传感器,以精确感知汽车周围的环境,如美国Iteris公司研制的AutoVue、卡内基梅隆大学研制的SCARF[2]、LOIS[3]。许多技术集中在道路边沿检测和跟踪[4-9],认为可通行区域包括道路边沿之间的区域,但是需要相机和昂贵激光雷达的辅助,有些则假定道路含有明确的界限和白色车道线。这些系统和算法所针对的场景较为单一,不能适应较复杂的路面环境。

在大部分的无人车系统中,激光雷达是不可或缺的传感器。激光雷达不受纹理光照等外界因素的影响,具有很宽的扫描范围,以及较高的分辨率和精度,在恶劣天气下相比其他传感器有较好的稳定性,能够很好地应用于道路和障碍物检测。因此,本文尝试利用4个单线激光测距仪探测可通行区域。对于道路边界探测,首先利用阈值剔除点云数据的异常值和噪声,用自适应标准差滤波器平滑和平均数据;然后计算每一扫描点周围9个邻近点的高度标准差,并选择标准差超过固定阈值的点作为道路边沿候选点;最终从道路边沿候选点得到道路边沿线,边沿线之间区域则认为是最佳可通行区域。对于障碍物信息提取,将点云数据依据聚集程度分簇,每簇点云数据设置一个边界框,根据边界框的大小对障碍物进行分类和检测;并在此基础上,重新规划可通行区域以实现安全自动驾驶。

根据上面所讨论的,本文算法具有以下优点:①不需要任何其他传感器的参与;②直接处理范围内的点云数据找到可通行区域,计算简单;③能较好处理移动和静止障碍物,对于点云数据中的噪声有较强的鲁棒性。

一、点云数据采集

点云数据由4个SICK LMS291单线激光雷达集成采集,激光雷达角度分辨率均为0.25°,检测角度范围均设为100°。一个雷达倾斜固定在汽车顶部,扫描车头前方8 m的范围;一个雷达倾斜固定在保险杠中间,扫描车头前方3 m的范围;两个水平安装于车前两侧,用于检测障碍物。单线激光雷达虽然在检测精度、范围、距离等方面不如4线、32线和64线激光雷达,但其扫描数据量适中,可较好地满足无人驾驶车辆在实时性方面的要求,同时价格低廉,有较好的实用价值。

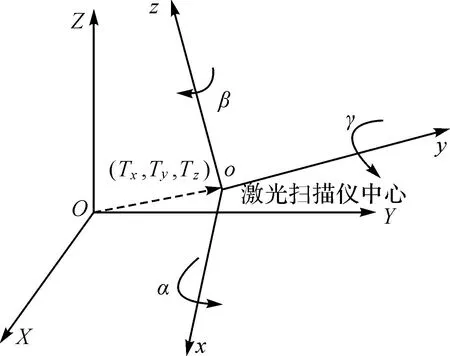

由于车上装载多台激光雷达,每台激光雷达的姿态位置各不相同,且每个激光雷达测得的数据所对应的原点均不相同。因此,本文统一坐标系为车辆坐标系,将激光扫描仪提供的极坐标下的角度和距离归算到车辆坐标系下,后续处理都是在车辆坐标系下进行的。车辆坐标系定义为:以车前顶端保险杠中心位置为坐标原点,前进方向为Y方向,由原点向车身右侧方向为X方向,垂直于车底盘面为Z方向(如图1所示)。激光扫描仪坐标系定义为:扫描中心为原点,扫描起始线为X轴,扫描面上与X轴垂直的方向为Y轴,Z轴与X轴、Y轴构成右手坐标系。通过式(1)将点云数据归算至车辆坐标系下,车辆坐标系与激光扫描仪坐标系的相互关系如图2所示。

图1 车辆坐标系示意图

图2 车辆坐标系与激光扫描仪坐标系相互关系

(1)

二、道路边沿探测

1. 数据预处理

车辆在行驶过程中伴随一定的起伏,导致扫描点在行驶方向上有较多异常值,因此首先要对这部分数据进行预处理。检查单条扫描线中每一扫描点的Y方向数值,若超出经验阈值则以前一扫描点的Y方向数值代替。给定单条扫描线数据S={p1,p2,…,pn},其与坐标原点的水平距离为D={d1,d2,…,dn},对于每个di,如果di

(2)

2. 道路边界点探测

道路区域与非道路区域的交界处通常存在道路边界,使扫描点的空间分布存在明显的高度差异,激光器以一定角度对道路进行扫描时利用此特征可筛选出单条扫描线中道路边界的潜在特征点。给定单条扫描线数据S={p1,p2,…,pn},除前面4个点和尾部4个点外,对每个扫描点pi根据式(3)、式(4)计算邻近9个扫描点高度值的标准差,即

(3)

(4)

如果σi大于阈值,则将pi认定为道路边界的潜在特征点。对于阈值的设定,来源于大量试验的效果分析,若设定太大,则导致探测不到道路边界;若设定太小,则导致路面上凹凸处的误探。

3. 最佳道路段探测

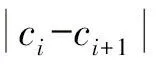

理论上,道路的可通行区域与道路等级有关,由于通常小客车总宽为1.8 m,本文设定道路的最小可通行宽度为2.5 m,远高于公路等级中3~3.75 m车道宽度的要求。本文试验车辆总宽为1.765 m,可以轻松通过2.5 m及以上宽度的道路。因此,对于单条扫描线中的两个连续道路边界潜在特征点ci和ci+1,根据式(5)进行可通行区域筛选,若两个特征点的距离大于设定的阈值,则认为无人驾驶车辆可从两个特征点中间通过,而两点连线形成的线段则为备选道路段。

(5)

(6)

式中,Lroad为根据道路扫描线筛选出的最佳可通行区域备选道路段。

整体算法如下:

ifunm(L)=1 then

Lbelongs to drivable-region line

else

for allLido

end if

end for

end if

end for

两个雷达分别探测前方3 m和8 m的道路状况,提取到两条最佳道路段,找到道路左右两边的边界点可以拟合出道路边沿,可通行区域只存在于车道之内,接下来根据车道内障碍物的尺寸调整可通行区域。整个算法流程如图3所示。

图3 算法流程

三、道路障碍物提取

调整和重新规划无人车可通行区域的前提条件是确定道路上障碍物的位置和尺寸大小。本文选取在城市道路中经常出现的类似车辆障碍物和行人为研究对象。选取类似车辆障碍物而非真实车辆的原因是SICK激光雷达只能探测到真实车辆的一部分,并且规则障碍物可以代表车辆特征。如户外垃圾桶、道路两侧的建筑物都是棱角分明的,车辆障碍物也类似。本文将应用聚类分析和主成分分析来探测和分离各种障碍物[10]。

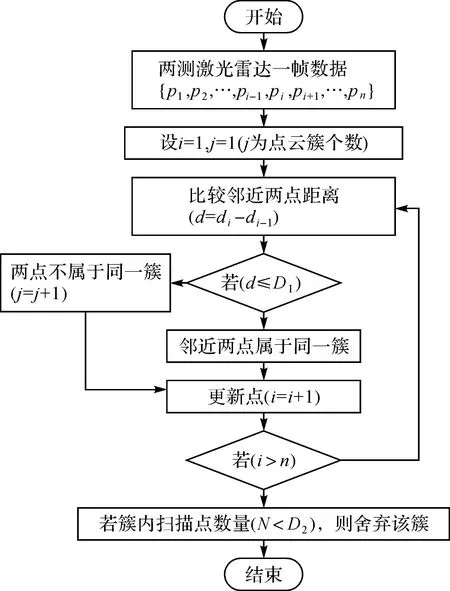

1. 点云聚类

车前两侧的单线激光雷达依据扫描顺序对无人车前方环境实行等角度扫描来获得障碍物的点云数据,而扫描范围内障碍物的位置则由数据之间的关系所反映。点云数据经过预处理后[11],再通过最近邻聚类的原理进行聚类,将车体四周障碍物提取处理。最近邻聚类的原理是基于同一物体表面的连续性。在一帧数据中,同一物体表面反射的数据往往表现为连续的点集,这些数据点位置较为邻近,若相邻两点间的位置突变,往往表明该两点分别属于两个不同物体的表面。因此,通过相邻两点的位置关系来判断该两点是否属于同一簇,如果两者的位置接近,则属于同一物体的可能性大,反之则比较小。将障碍物点云数据分成不同的簇:如果连续两点距离小于某一阈值,则认为是同一物体的点云,否则分属不同物体。如果相邻点的数量超过某一阈值,则认为它们属于同一障碍物,将其看作同一点云数据簇;同时,舍弃剩余的、分散的点云数据。为每簇点云数据分配边界框并进行标记,框内的点云数据距离框边界越近越好。最后,对边界框的几何特征进行描述和记录。如图4所示。

图4 点云聚类算法流程

2. 障碍物识别和定位

每簇点云数据所标记的边界框呈现“L”形状,行人或类似车辆障碍物都被一个矩形边界框标记。然而,行人障碍物的边界框和类似车辆障碍物的边界框有着不同的尺寸。因此,根据尺寸分成两类障碍物,0.5m代表行人,2m代表真实车辆。应用主成分分析计算边界框的长度、宽度、朝向和几何位置。将探测提取出的障碍物信息和可通行区域线信息融合在一起,得到最终的无人车可通行区域。

四、试 验

程序基于VS2010开发,运行环境为Windows7,处理帧率为15帧/秒。试验所选取的校园道路约2000m,道路上车辆行人较多,并且校园道路缺少清晰的车道线,增加了可通行区域探测的难度。

1. 点云数据采集

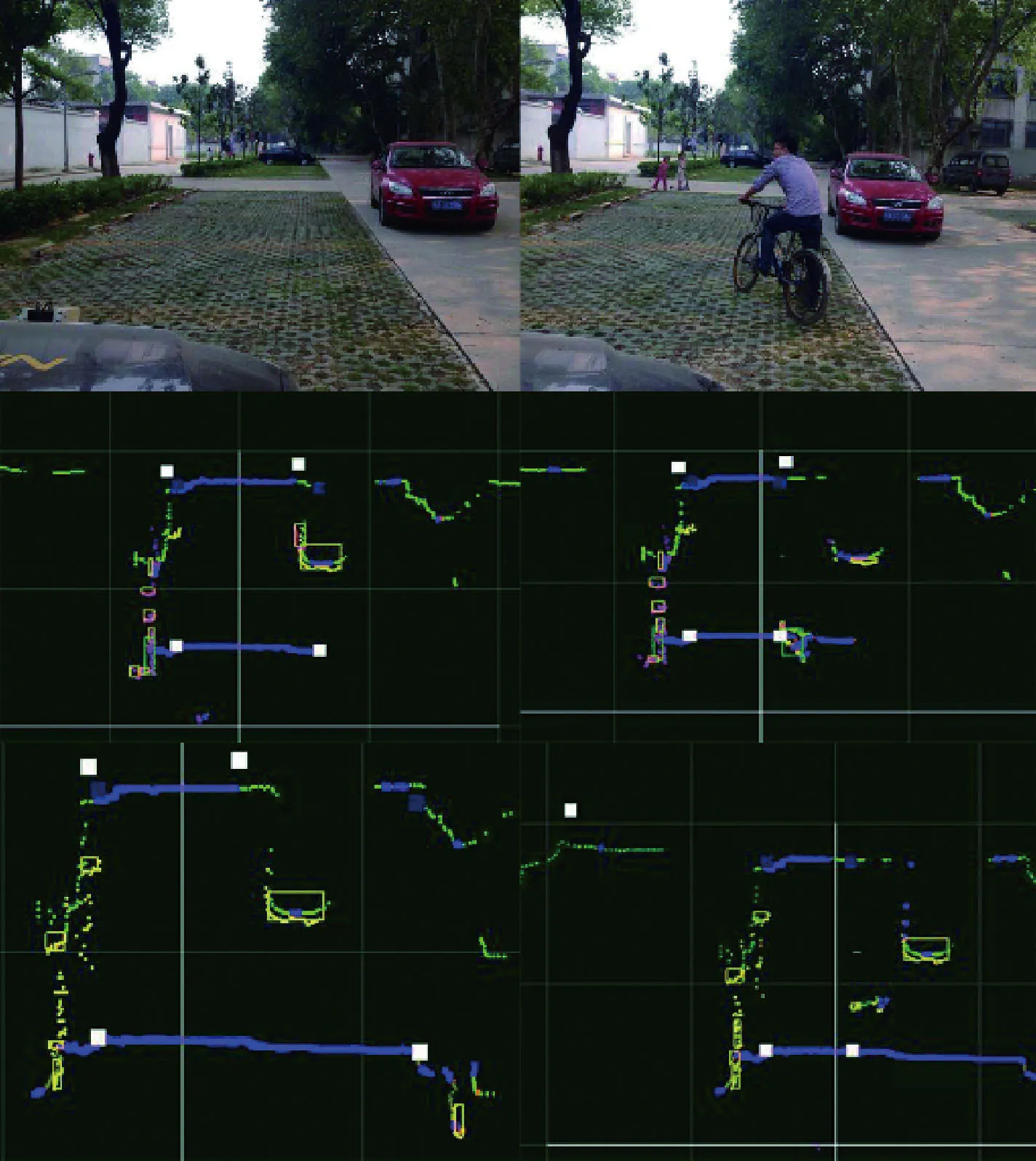

在试验中,将扫描点角度分辨率分别设为180°和100°,并设置4组包含行人、车辆、交叉口的道路场景作为测试环境。应用180°/0.25°和100°/0.25°两种分辨率采集数据并探测可通行区域,结果如图5所示。

图5 点云数据采集示意图

在100°/0.25°分辨率下(中间一行),即使在车辆、行人遮挡或复杂交叉口的情况下,道路边沿也能成功提取,通过可通行区域的调整,可以有效地避开这些障碍物。而在180°/0.25°分辨率下(下面一行),扫描范围更宽,道路不能被检测或正确检测(多数情况下,检测到的道路两边界间距离太长,或是不能检测到道路边界)。因此,试验中选择100°/0.25°分辨率进行点云数据采集。

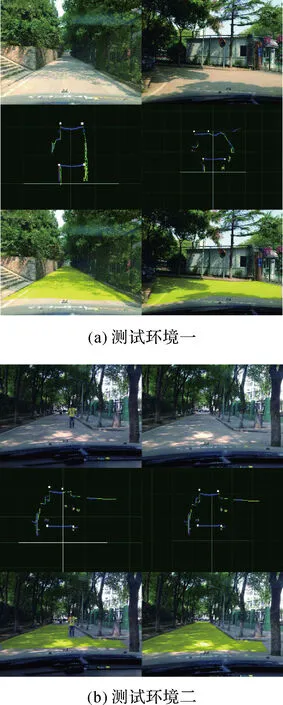

2. 道路场景检测结果

无人车在测试场景中行驶一圈,行驶路线如图6所示。路线中包括较为复杂的道路信息:丁字口、行人和车辆障碍物和不清晰的车道线。

图6 测试过程中无人车行驶路线

结果如图7所示,第一行为原始影像,第二行为处理后的点云数据。从中可清晰看到道路边沿、道路线、探测和分离出来的障碍物;第三行为标记的最终可通行区域,很明显,可通行区域包括了大部分的实际道路,并很好地避开了障碍物。试验结果显示,本算法对于结构化的道路环境有较好的识别率,验证了算法的鲁棒性和有效性。

图7

五、结束语

本文提出了一种结合道路边沿探测和障碍物识别的可通行区域检测方法,在道路边沿检测中首先使用了高度方差筛选出路沿特征点,再基于高度、宽度和距离3个因子提取了最佳道路,最后与障碍物信息结合提取了可通行区域。与相关研究不同的是,本算法除点云数据外不需要其他传感器的参与,对道路情况没有任何要求,可以保证算法适应于复杂路况,尤其是田间道路和车道线不清晰道路。

[1]LIJ,LIUR.A3-DReal-timeRoadEdgeDetectionSystemforAutomatedSmartCarControl[C]∥Proceedingsofthe2006IEEEInternationalConferenceonNetworking,SensingandControl.[S.l.]:[s.n.],2006:837-841.

[2]POMERLEAUD,THORPEC,EMERYL.PerformanceSpecificationDevelopmentforRoadwayDepartureCollisionAvoidanceSystems[C]∥Proceedingsof4thWorldCongressonIntelligentTransportSystems.Berlin:[s.n.],1997.

[3]KLUGEK,LAKSHMANANS.ADeformable-templateApproachtoLaneDetection[C]∥ProceedingsofIEEEIntelligentVehicles’95Symposium.[S.l.]:[s.n.],1995:54 -59.

[4] 肖已达, 王冰, 杨明,等. 基于激光雷达的道路可通行区域检测[J]. 机电一体化, 2013, 19(2): 62-66.

[5]WANGR,XUY,LIB,etal,AVision-basedRoadEdgeDetectionAlgorithm[C]∥ProceedingsofIEEEIntelligentVehicleSymposium. [S.l.]:[s.n.],2002:141-147.

[6] 周智, 蔡自兴, 余伶俐. 基于直线特征提取的自主车辆可通行区域检测[J]. 华中科技大学学报(自然科学版), 2011, 39(S2):188-191.

[7]WILSONMB,DICKSONS.Poppet:ARobustRoadBoundaryDetectionandTrackingAlgorithm[C]∥Proceedingsofthe10thBritishMachineVisionConference. [S.l.]:[s.n.], 1999:352-361.

[8]WIJESOMAWS,KODAGODAKRS,BALASURIYAAP,etal.LaserandCameraforRoadEdgeandMid-lineDetection[C]∥ProceedingsoftheSecondInternationalWorkshoponRobotMotionandControl.[S.l.]:IEEE, 2001:269-274.

[9]ZHANGL,LIQ,LIM,etal.MultipleVehicle-likeTargetTrackingBasedontheVelodyneLidar[J].IntelligentAutonomousVehicles, 2013, 8(1):126 -131.

[10] 张蕊, 李广云, 李明磊,等. 利用PCA-BP算法进行激光点云分类方法研究[J]. 测绘通报, 2014(7):23-26.

[11] 李广云, 李明磊, 王力,等. 地面激光扫描点云数据预处理综述[J]. 测绘通报, 2015(11):1-3.

Application of LiDAR Point Clouds in Unmanned Path Detection

CHEN Cheng,ZHANG Yongbo,LI Bijun

2016-01-31

国家自然科学基金重点项目(41531177)

陈 诚(1991—),男,硕士生,研究方向为智能交通和3S集成。E-mail:lee@whu.edu.cn

李必军

陈诚,张永博,李必军.激光点云在无人驾驶路径检测中的应用[J].测绘通报,2016(11):67-71.

10.13474/j.cnki.11-2246.2016.0368.

P237

B

0494-0911(2016)11-0067-05