结合三帧差分和肤色椭圆模型的动态手势分割

2016-09-29袁敏,姚恒,刘牮

袁 敏,姚 恒,刘 牮

结合三帧差分和肤色椭圆模型的动态手势分割

袁 敏,姚 恒,刘 牮

( 上海理工大学 光电信息与计算机工程学院,上海 200093 )

针对手势识别系统中的手势分割部分提出了一种改进的结合三帧差分法和肤色椭圆边界模型的动态手势分割方法。运用三帧差分法提取动态手势的运动特征,初步确定手势所在区域,然后运用肤色椭圆边界模型对该区域进行肤色判别从而确定目标。通过提取双特征,可有效解决复杂背景下大面积肤色背景被误检的问题。通过合理设置运动检测过程中的阈值,可有效去除运动幅度较小的人脸和裸露手臂部分。同时针对三帧差分法不能检测静态手势进行了改进,使提出算法对视频流中手势的短暂停留具有极强的鲁棒性。实验结果表明,提出算法能准确高效的检测出动态手势,适用于动态手势识别等实时系统中。

动态手势分割;三帧差分法;肤色椭圆边界模型;手势识别系统

0 引 言

随着计算机的普及,人与计算机之间的信息交互技术备受关注。手势识别是人机交互技术中占据重要地位的研究课题。手势识别可简单概括为三个部分:分割、跟踪、识别[1]。手势分割作为第一步工作,为后续两个部分提供操作对象,分割的效果直接决定着整个工程的成败,是手势识别的关键所在。手势分割即提取手势特征从而将其与周围环境区分出来。手势特征包括肤色、轮廓、指尖、运动和纹理等。由于光照、形变和复杂背景环境等因素的影响,手势分割方法的精确度和稳定性受到极大挑战。围绕这一问题,研究人员展开了大量的研究工作,提出了多类手势分割方法。阈值模型[2]给定各参数一个阈值,在范围内判定为肤色目标。边界模型对肤色分布进行建模从而检测肤色,如椭圆边界模型[3]和高斯模型[4]等。此两种方法分割时间复杂度最优,但分割准确度非常低,对背景要求较高。基于Meanshift算法的分割方法[5],需预先获得分割目标颜色直方图,且随搜索迭代次数增加而分割时间大大增加。基于训练分类器的方法[6-7],需要大量的正、负样本,同时训练分类器耗时长。采用Kinect深度摄像头获得RGB-D图像,利用深度信息分割的方法[8],该方法对摄像头要求较高。

本文提出一种改进的结合三帧差分法和肤色椭圆边界模型的动态手势分割方法,用三帧差分法提取手势运动特征,初步确定目标区域,再利用肤色椭圆边界模型对目标区域进行肤色检测,最终确定目标手势。实验证明,该方法具有极高的准确率和接近实时的分割效率。

1 算法思路

动态手势最明显的两个特征分别是运动和肤色。分别提取运动和肤色特征,层次递进确定目标是本文的基本思想。在文中,对特征提取算法的选择、算法时间复杂度、视频流中手势短暂停留问题,人脸和手臂等干扰肤色块的去除问题进行了重点研究并提出相应改进算法。

1.1 提取运动特征

帧间差分法以其计算复杂度低、时间利用率高等优点成为运动特征提取常用算法之一。三帧差分法[9]是在常规的两帧差分法的基础上提出的一种改进算法,该算法在相邻三帧之间进行差分,再将差分结果进行按位逻辑与操作,克服了两帧差分的“双影”现象,对差分后出现的“空洞”现象有一定程度的改善,同时比两帧差分法对慢速运动的检测具有更强的鲁棒性。三帧差分法流程图如图1所示。

图1 三帧差分法流程图

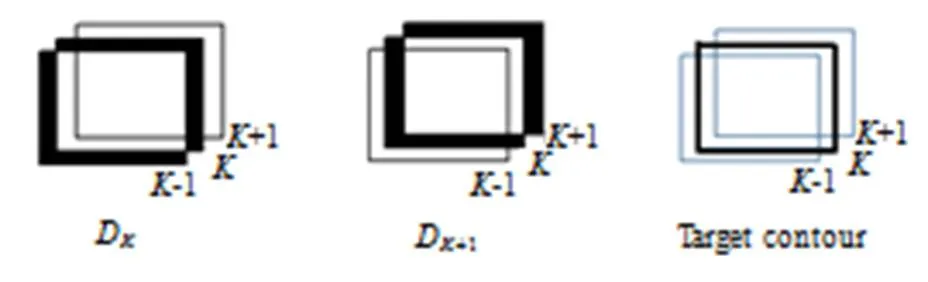

首先从视频流中取第-1、和1连续三帧图像,分别记作I-1、I和I+1。将彩色图像转为灰度图像后,对相邻两帧分别做逐像素减法,结果取绝对值后与设定阈值比较,大于阈值置为1,小于置为0。依此方法,分别得到I-1与I的差分图像D,和I与I+1的差分图像D+1。对D和D+1做形态学处理后进行按位与运算得到目标轮廓。算法示意简图如图2所示。

图2 三帧差分法示意简图

1.2 提取肤色特征

肤色椭圆边界模型是基于YCrCb色彩空间的肤色分割模型。基于此色彩空间的肤色模型包括:阈值边界模型、高斯模型和肤色椭圆边界模型等。阈值边界模型中,满足133<<173且77<<127的待判像素即被认为是肤色,漏检和误检的可能性较大。高斯模型和肤色椭圆边界模型具有相对精确的肤色判断依据,然而后者比前者具有更高的分割精度和更低的时间复杂度[10]。因此本文选择肤色椭圆边界模型进行肤色检测。经大量的统计数据发现,肤色在CbCr子空间上的投影近似一个椭圆[11],只需计算出椭圆相关参数,拟合该椭圆,就可以成为肤色分割的重要依据。本文选取Hsu等人提出的经典椭圆肤色模型[12],如式(1):

其中:

Hsu等人经过大量统计实验,根据肤色点在CbCr子空间的聚类特性计算得出:C=109.38,C=152.02,=2.53 rad,eC=1.60,eC=2.41,=25.39,=14.03。当待判定肤色点的颜色分量、值符合该模型时,则判定该点为肤色点。

1.3 视频流中手势短暂停留丢失问题

在视频流中,手势可能在某一位置作短暂停留,此时三帧差分法由于检测不到运动而不能准确的对该手势进行分割,从而在手势跟踪时丢失目标。

为了解决这一问题,本文对算法进行以下改进。经过分析,造成目标色块减少的原因有以下三种可能,手位移出摄像头视野范围、手短暂停留和手被遮挡。记上一次算法分割得目标色块数为N-1,初始值置为0,记当前帧检测到目标色块数为N。当N小于N-1时,即至少有一个目标色块丢失,此时对当前帧肤色检测后结果与上一帧分割结果做按位或操作,最大可能保存肤色块可能存在的区域,再对或运算后的区域做二次肤色检测,所得结果作为当前帧的最终结果。

1.4 人脸及手臂等干扰色块的去除问题

当人体处于摄像头视野中时,手臂、人脸等由于微小的运动被误检为目标色块而被分割出来,对后续的跟踪和识别造成干扰。三帧差分法公式表示为

阈值表征为运动检测的灵敏度,通过设置合理的,允许人体微小的运动而不被误检。越小,算法对运动越敏感,背景中的物体会因为微小的震动而被误检,这不符合本文目的。反之越大,手势运动幅度较小时又会被漏检,因此,选定一个合理的阈值是本算法的关键。本文通过选取不同的阈值进行大量对比试验,从中选取最优阈值取值,具体讨论见2.3。

1.5 算法流程

三帧差分法可高效准确的分割运动目标,从而缩小分割范围到运动目标区域,肤色椭圆边界模型对运动区域进行肤色检测,最终确定具有运动和肤色双重特征的动态手势。图3为算法运行拆分图。

图3 算法运行拆分图

以图3(a)运动图像为例,首先采用三帧差分法对连续三帧图片进行处理,得到运动目标的轮廓,具体计算步骤如1.1节所述。此时轮廓不连续且内部出现空洞,如图3(b)所示。对轮廓采用多次膨胀操作填充轮廓,填充区域即为运动区域,运动区域如图3(c)所示。然后,运用肤色椭圆边界模型对运动区域所确定的原图像对应区域做逐像素肤色判别从而得到目标色块,肤色块如图3(d)所示。采用1.3所述方法判断是否存在目标色块丢失问题,如果不存在,则直接输出结果。否则,对当前帧肤色检测后结果与上一帧分割结果做按位或操作,最大可能保存肤色块可能存在的区域,再对或运算后的区域做二次肤色检测,所得结果作为当前帧分割的最终结果,图3(e)所示。手势分割算法流程如图4所示。

图4 手势分割算法流程图

2 实验结果及数据分析

2.1 分割准确度

为了验证本文提出的改进的动态手势分割方法,分别对阈值模型[2],椭圆边界模型[3],基于Meanshift算法的分割方法[5],训练类Haar分类器的方法[6]和提出方法进行对比实验,图5(a)为阈值模型分割效果图,图5(b)为椭圆边界模型分割效果图,此两种方法简单提取肤色特征,要求背景单一无大面积类肤色块,本实验背景中门、窗等复杂背景,均被错误分割为目标。图5(c)为基于Meanshift算法的分割效果图,图5(d)为训练类Haar分类器分割效果图,图5(e)为本文提出方法分割效果图,此三种方法均能准确的对动态手势进行分割。

2.2 分割时间

算法程序在VS2010和OpenCV2.3下开发,性能测试在Intel Core(TM)2 Duo CPU T6570@2.10 GHz,64位windows8.1系统,4G内存的计算机上运行。实验2.1中各种方法分割时间如表1,每种方法分别取7次完整分割,最后求取平均值作柱状图如图6。其中阈值模型和椭圆边界模型分割时间最优。基于Meanshift算法的分割方法由于分割时间随搜索迭代次数的增加而增加,分割时间最长,为52 ms。训练Haar-like分类器分割时间为32 ms,但其离线训练时间较长,本文利用3 000个正样本,5 000个负样本训练Haar-like分类器,离线训练时长约为6 h。提出方法分割时间为27 ms,在保证准确度的情况下,分割时间最优。

表1 五种分割算法的分割时间对比

图6 五种分割算法分割平均时间对比

2.3 阈值选取实验

实验分别选取为1,2,3,..,19,20进行实验,视频帧率为30 f/s。其中设为1和7之间分割效果相差不大,均分割出人脸;设置为14和20之间分割手势失败或部分分割;设置约为10,效果最佳。图7为不同阈值下人体处于摄像头视野分割效果对比,其中7(a)为取5时分割效果,7(b)为取10时分割结果。通过对比发现,取5时出现大面积人脸误检,取10时可以较精确进行手势分割。

图7 人体处于摄像头视野分割效果图

3 结 论

本文在传统肤色分割方法的基础上,提出的改进三帧差分法结合肤色椭圆边界模型的动态手势分割方法能有效的在视频流中进行动态手势分割。算法对复杂背景下分割动态手势具有较强的鲁棒性,因为选择的特征提取算法均为同类算法中时间复杂度最低的,所以文中提出方法分割耗时少,实时性高。实验结果表明,本文提出的方法能准确高效的检测出动态手势,适用于动态手势识别等实时系统中。

[1] Rautaray S S,Agrawal A. Vision based hand gesture recognition for human computer interaction:a survey [J]. Artificial Intelligence Review(S0269-2821),2015,43(1):1-54.

[2] Priyal S P,Bora P K. A robust static hand gesture recognition system using geometry based normalizations and Krawtchouk moments [J]. Pattern Recognition(S0031-3203),2013,46(8):2202–2219.

[3] GAO Jianpo. An Elliptical Model Based on KL Transform for Skin Color Detection [J]. Journal of Electronics & Information Technology(S1009-5896),2007,29(7):1739-1743.

[4] Greggio N,Bernardino A,Laschi C,. Fast estimation of Gaussian mixture models for image segmentation [J]. Machine Vision & Applications(S0932-8092),2012,23(4):773-789.

[5] Subašić M,Lončarić S,Heđi A. Segmentation and labeling of face images for electronic documents [J]. Expert Systems with Applications(S0957-4174),2012,39(5):5134–5143.

[6] Viola P,Jones M J. Robust Real-Time Face Detection [J]. International Journal of Computer Vision(S0920-5691),2004,57(2):137-154.

[7] 文学志,方巍,郑钰辉. 一种基于类Haar特征和改进AdaBoost分类器的车辆识别算法 [J]. 电子学报,2011,39(5):1121-1126.

WEN Xuezhi,FANG Wei,ZHENG Yuhui. An Algorithm Based on Haar-Like Features and Improved AdaBoost Classifier for Vehicle Recognition [J]. Acta Electronica Sinica(S0372-2112),2011,39(5):1121-1126.

[8] REN Zhou,YUAN Junsong,MENG Jingjing,. Robust Part-Based Hand Gesture Recognition Using Kinect Sensor [J]. IEEE Transactions on Multimedia(S1520-9210),2013,15(5):1110-1120.

[9] YIN Hongpeng,CHAI Yi,YANG Xiaoyan,. Fast-moving target tracking based on mean shift and frame-difference methods [J]. Journal of Systems Engineering and Electronics(S1004-4132),2011,22(4):587-592.

[10] Elgammal A,Muang C,Hu D. Skin Detection - a Short Tutorial [C]// Encyclopedia of Biometrics,New York,America,July 20,2009:1218-1224.

[11] Hsu R L,Abdel-Mottaleb M,Jain A K. Face Detection in Color Images [J]. IEEE Transactions on Pattern Analysis & Machine Intelligence(S0162-8828),2002,24(5):696-706.

[12] YUAN Yao,YUN Fu. Contour Model-Based Hand-Gesture Recognition Using the Kinect Sensor [J]. IEEE Transactions on Circuits & Systems for Video Technology(S1051-8215),2014,24(11):1935-1944.

Dynamic Gesture Segmentation Combining Three-frame Difference Method and Skin-color Elliptic Boundary Model

YUAN Min,YAO Heng,LIU Jian

( School of Optical-Electrical and Computer Engineering, University of Shanghai for Science and Technology, Shanghai 200093, China )

A novel dynamic gesture segmentation method is proposed by combining three-frame difference method and skin-color elliptic boundary model. Firstly, the possible dynamic gesture region is determined by extracting the target property of movement via three-frame difference method, and then the target area is gotten by skin-color detection in the possible region using skin-color elliptic boundary model. By extracting double features of dynamic hand gestures, the proposed method can effectively solve the problem that the large area of skin-color background was mistakenly identified as hands. The area of face and bare arms are removed by setting a reasonable threshold. Furthermore, for overcoming the shortcoming of traditional three-frame difference method that cannot detect static gestures, the proposed method has been improved and shown robustness on relative static gestures. The experimental results demonstrate the efficiency for dynamic hand gestures segmentation and the proposed method is suitable for real-time systems such as dynamic gesture recognition.

dynamic gesture segmentation; three-frame difference; skin-color elliptic boundary model; gesture recognition systems

1003-501X(2016)06-0051-06

TP274.2

A

10.3969/j.issn.1003-501X.2016.06.009

2015-06-29;

2015-11-14

国家自然科学基金(61303203);沪江基金(B14002/D14002);上海高校青年教师培养计划资助

袁敏(1992-),男(汉族),安徽安庆人。硕士研究生,主要研究图像处理与计算机视觉。E-mail: yuanmin_2013@126.com。