法庭说话人识别语音数据库的构建

2016-03-06张翠玲GeoffreyStewartMorrison

张翠玲Geoffrey Stewart Morrison

(1西南政法大学 重庆市高校物证技术工程研究中心 重庆 401120;2阿尔伯塔大学 加拿大 阿尔伯塔 T6G 2E7)

法庭说话人识别语音数据库的构建

张翠玲1Geoffrey Stewart Morrison2

(1西南政法大学 重庆市高校物证技术工程研究中心 重庆 401120;2阿尔伯塔大学 加拿大 阿尔伯塔 T6G 2E7)

为建立具有代表性的法庭话者识别相关背景人群语音数据库,促进法庭语音数据的资源共享,从法庭话者识别的研究和实践出发,提出了一套基于汉语的法庭语音数据库构建方案,对语音数据的采集、处理和应用也提出了相关建议。这样的数据库更贴近典型案件条件,更适合法庭语音研究及应用,也适合其他自然口语语音研究。

法庭说话人识别 相关背景人群 语音数据库

近年来,随着视听证据法律地位的确立,录音证据在各类刑事、民事案件中的出现率显著递增。特别是在绑架勒索、爆炸恐怖威胁等重大案件中,录音不仅是重要的证据,往往还是唯一的证据。因此,分析录音中说话人的语音特征,特别是鉴别说话人的身份,对于查清案件事实、揭露和证实犯罪具有重要意义。

法庭话者识别是指将罪犯的语音(检材)与犯罪嫌疑人的语音(样本)进行比较鉴别,通过对两者同源性的判断评估为法庭提供线索和证据的一门技术。语音具有特异性和相对稳定性,但也具有变异性。一个人的语音在不同场景下会产生变化,不同人的语音也具有一定的相似性。而语音在不同环境下的变化性、不同人语音之间的差异性,检材与样本特征的相似性及其在相关背景人群中的典型性等都是法庭话者识别的关键问题。这些问题只有通过对大量语音数据的量化分析和统计评估才能解决,而拥有较大规模的、能够代表案件实际条件的相关背景人群语音数据库则是开展这些工作前提和基础。

目前,国际国内在法庭说话人识别语音数据库方面已经取得了一定成果,特别是针对自动识别系统开展的数据库建设[1-3]。然而,在语音数据的采集内容和方式上还存在一定问题,例如,以朗读语体为主(如读一段报纸),与实际交流的自然口语语体不符;以发音人自述为主(如自我介绍),与实际对话交流的语用场景不符;以同期语音为主,与检材和样本的非同时性不符等。由于这样的数据不符合法庭语音的实际场景条件,缺乏代表性和典型性,因此,其发挥的作用也有限。

本文从法庭话者识别的研究和实践应用出发,结合案件语音的特点,提出一套基于汉语的法庭语音数据库构建方案,并对语音数据的采集、处理和应用提出了相关建议。该数据库构建方案也适用于相近研究目的和其它语种语音数据的采集。

1 案件语音的特点

鉴于发生场景的特殊性,案件语音主要表现为以下特点:

(1)录音检材低质化。录音条件的复杂性和不可控性导致检材质量低下是案件语音的最大特点。其原因涉及到发音及录音的各个层面,如录音场合、讲话环境、情绪状态、录音设备、传输信道、录音方式、格式压缩等。而这些因素往往混杂交织在一起,因此,增加了分析检验的难度。

(2)检材与样本语音条件不匹配。这是案件语音的典型场景问题。由于检材语音和样本语音在采集的时间、场合、设备条件、发音人状态等方面的差异,导致两者整体语音条件不匹配。这直接导致检材和样本之间的差异程度增大,进一步加大了说话人识别的难度。

2 建库原则及要求

法庭语音数据库应考虑典型案件的语音特点,采集具有代表性的语音。其原则及要求如下:

(1)数据库中应包含发音人至少两次的非同期录音。这是基于对实际案件中检材录音与样本录音采集的非同时性考虑。一般情况下,样本的采集总是滞后于检材,有时甚至会相隔几年。语音建库时必须考虑语音的历时性变化,采集发音人不同时间场合的语音,因为同期录音往往会低估语音的变异程度。考虑到采集的时效性,可以分2次或3次采集发音人的录音,时间间隔可以是几个星期或几个月。

(2)数据库中的言语风格应该代表典型案件的语音特点。典型案件中的语音检材有部分来源于当事人双方(或多方)面对面的交谈录音,而大部分来源于当事人双方的电话通话录音。这些都属于自然交谈的口语形式,但由于案件性质的不同有时讲话的内容和方式有所差别。例如,在诈骗案件中可能涉及到银行账号等信息,表达这些信息时人们一般采用“照单宣读”的(半)朗读语体。而样本的采集一般是通过办案人员对犯罪嫌疑人进行询问而录制的,因此,样本一般多为被动的“问答”风格。有时也让犯罪嫌疑人照读按照事先准备好的(检材)内容。为此,本文设计了自由交谈、信息核对和模拟警察询问等代表上述情形的3项任务。

(3)数据库必须具有实用性,要考虑到检材和样本录音条件的不匹配性。实际案件中,检材与样本录音条件的不匹配突出表现在录音设备和传输信道方面,此外,还有噪声和混响等。为此,我们采集高质量的麦克录音,目的是为了后期可以根据不同的案件条件设计滤波器,模拟不同的传输信道,还可以进行案件噪声和混响的加载模拟,进而分析各种失配条件下的语音差异及其对话者识别的影响。而如果采集低质录音则不利于各种因素的分析。当然,也可以考虑几种设备信道同步录音,只是后期处理的任务较重。

3 录音设备、方法与内容

3.1 录音设备

应选取高保真的专业录音设备,提取高质量的语音信号。另外,不同地区和部门采用设备条件应尽可能一致,以便实现各部门数据库之间的资源共享。声卡:日本生产的罗兰声卡(外置)(RolandVR UA-25EX, Roland Corporation,Hamamatsu,Japan)。麦克:德国生产的森海塞尔领夹式麦克(Flat-frequency-response lapel microphones,Sennheiser MKE 2 P-C,Sennheiser electronicGmbH&Co.KG,Wedemark,Germany)。耳机:奥地利生产的专业监听耳机(头戴式AKGⓇ K701)。录音软件:Cooledit Pro 2.1。

3.2 录音方法

录音地点选择在专业录音室(或隔音间),发音人A和B每人戴一个麦克,分别在两个房间通过电话与对方交谈,研究人员在外面的监控室(第3个房间)进行实时录音监控。两个麦克与监控室的声卡(左右声道)和计算机相连。利用Cooledit软件进行左(发音人A)右声道(发音人B)同时录音。采样率设为44.1KHz,量化精度为16位。录音采集方法[4]如图1和图2所示。

图1 录音采集示意图

图2 左右声道语音同时采集

3.3 录音内容

录音内容共3项,每项任务的时间为10分钟。

(1)自由交谈。每组发音人两个:A和B(两人最好熟悉,如同学、同事、师生、亲人或朋友),A给B打电话,两人通过电话自由交谈,话题自选。这项任务的设计主要是出于案件语音话题的开放性考虑。实际案件中,由于案情各异,谈话的主题各种各样,五花八门。自由对话可以展示发音人的自然讲话状态、讲话特点和言语习惯,还可以涵盖各种常用词汇和高频音节。

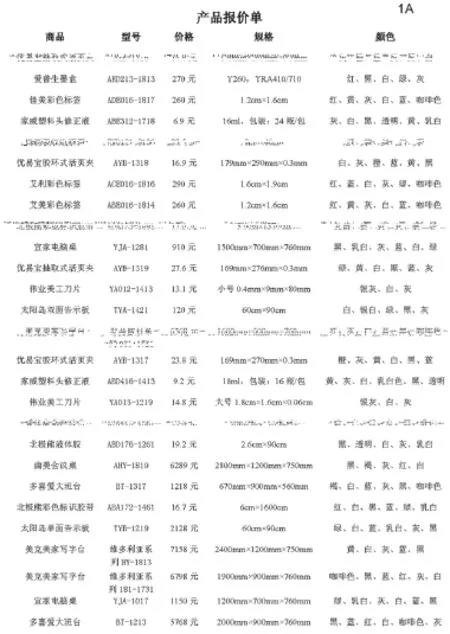

(2)信息核对。自由对话结束以后,给两位发音人(A和B)每人一份产品报价单传真件。两份单子内容相同,但是由于传真效果不好,上面各有几行不清楚。两人还是通过电话交谈,对照确认各自传真上的模糊信息,并写在报价单的相应位置。这项任务的设计是考虑有些案件中会涉及到个人信息的提供,如姓名、身份证号码、住址、银行账户信息等。采用信息核对方式是模拟这些信息提供时的朗读风格。此外,报价单的内容是在综合考察汉语普通话音节的各类辅音-元音搭配、声调、数字、字母等基础上设计挑选的。之所以让发音人将模糊信息记录下来,是因为这样可以出现相同音节的多次重复和汉字的拼写确认,更符合实际场景,而且多个重复音节也有利于法庭语音分析。

产品报价单的样例如图3所示。

图3 模糊的产品报价单传真样例(发音人A)

(3)模拟警察询问。在传真核对任务完成以后,由研究人员分别对每位发音人进行面对面的提问(不用电话),发音人(仍戴着麦克)进行回答。这是模拟警察对犯罪嫌疑人进行询问的场景,但是不需要角色扮演,询问的内容也不涉及任何案件。例如,可以询问发音人某天从早到晚一天的活动情况。首先让发音人自行陈述,内容越详细越好。然后,研究人员就其自述内容进行细节盘问,发音人回答。由于实际案件中经常会出现“不知道”、“不清楚”、“不是”等否定性应答,因此,可以就其回答的细节进行反复盘问,引导发音人进行多次的确认或否认回答。当然,这需要研究人员有一定的问话技巧。

4 数据处理和应用

4.1 录音处理

(1)语音切分及命名保存。由于3项任务的录音是连续进行的,因此,2人一组整段录音的时长至少在30~40分钟以上。研究人员首先将整段录音保存为“PCM.wav”格式的立体声文件,命名按照录音日期、(左右声道)发音人身份编号和录音次数顺序进行。例如,文件名“2015-03-15_003(1)_004(1).wav”表明这是发音人003和004在2015年3月15日进行的第1次录音。其中,指定前10个字符“2015-03-15”代表录制日期,第1个下划线“_”后的3位数字“003”代表左声道发音人A的身份编号,括号中的数字“(1)”代表第1次录音,第2个下划线后连的右声道发音人B的身份编号“004”和录音次数“第1次”。

接下来要将两个人的3项任务录音分别进行切分保存。研究人员通过监听,进行人工定位和手动切分。首先,将整段录音切分为自由对话(cnv)、传真核对(fax)和警察询问(int)3个立体声文件保存,命名规则是在整段录音文件名基础上添加下划线“_”和任务种类,例如:“2015-03-15_003(1)_004(1)_cnv.wav”、“2015-03-15_003(1)_004(1)_fax.wav”、“2015-03-15_003 (1)_004(1)_int.wav”。然后,将它们分为左右声道分别保存,命名规则是在任务命名基础上再添加下划线“_”和左(L)右(R)声道信息,例如,“2015-03-15_03 (1)_004(1)_cnv_L.wav”和“2015-03-15_003(1)_004(1) _cnv_R.wav”。

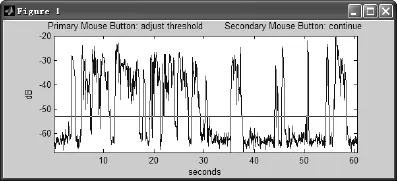

(2)静音段剔除。经过上述切分,每位发音人每项任务的录音时长约为10分钟,而其实际上的发音时间仅占一半左右,录音中还有一些静音段(无声间歇段)。由于长声音文件不便于声学-语音学分析,因此,需要将这些静音段(可能含一定噪音)剔除,将整段声音文件切分为很多小语音段,存放在一个文件夹中。采用语音编辑软件“Sound File CutterUpper”按照“呼吸群”进行有声语段的自动切分(也可以采用Adobe Audition等通用软件进行切分)。首先计算整段录音运行振幅的均方根(RMS),然后查找并保存超过幅度阈值的录音部分,低于阈值的部分则被忽略。总的有效参数设置为:使用100ms宽的Hamming窗测量RMS的分贝值,阈值设置为最大与最小振幅之间幅程的1/3。忽略的声音最长为100ms,忽略的静音段最长为50ms。录音从高于阈值上升的前100ms开始保存,于低于阈值下降后的100ms结束。操作时一般采用预设参数就可以,个别时候需要进行参数调整。剔除静音段以后的多个短文件被自动保存在文件夹中(与原文件同名,只是去除了扩展名)。文件夹中每个文件用其相对于原文件的时间来命名,例如,“00-02-37_00-03-76.wav”,其中,前半部分和后半部分分别代表录音的起始时间和结束时间,即从源文件的2分37秒到3分76秒。

图4 录音切分和静音段剔除

(3)噪音去除。剔除静音段后的录音也不全是我们需要的语音段,有时还包含一些噪音或研究人员的语音,这些也都需要去除。可以利用“Adobe Audition等通用软件进行这些“噪音”的人工辨听和手工去除。其中,对于整段噪音的文件可以直接进行删除,对于一段录音中含有的部分噪音则采取将其振幅归零的方式去除,这样可以完整保留文件的时间序列,便于进行以时间为线索的文件批处理。

4.2 数据库应用

法庭话者识别的难点就在于语音具有较大的变异性,而客观评估话者自身变异和话者之间差异一直都是法庭语音学家关心的问题。利用这样的语音数据库可以更好地开展此类研究。例如,可以对相关背景人群的语音进行特征提取和定量测量,建立特征统计模型,定量分析和评估参数特征的变化性、相似性和典型性。此外,还可以通过话者识别测试,对各种参数特征、提取方法、统计模型、计算方法和特征系统的有效性进行分析评测,为其实践应用提供数据和方法支持。

此外,如何对不匹配条件下的检材语音与样本语音的进行比较分析和特征补偿,对于提高法庭话者识别的可靠性和准确性具有重要意义。这样的数据库既可用于信道补偿方面的研究,也可作为案件检验的相关背景人群数据库使用。例如,可以根据具体的案件语音条件,设定滤波器,对高质量语音信号进行(信道、噪声及混响等)案件条件模拟。这样,不仅可以分析典型案件条件下的语音变化规律,评估各种因素对话者识别的影响,还可以对检材和样本声学特征的相似性和(在反映案件条件的相关背景人群中的)典型性进行评估,进而对语音证据的价值进行量化评估。

5 结语

该语音数据库建库方案主要为法庭话者识别的科研和办案而设计,它克服了以往同类数据库与实际案件条件不符、缺乏代表性的问题,语音数据更贴近典型案件条件,更适合法庭语音分析及应用。此外,这是国际通用方案,适用于包括汉语在内的所有语种的语音数据采集(信息核对的内容依语种而变)。目前,国际上已有部分语音数据库项目采用了该建库方案,如东北汉语普通话、澳大利亚英语、澳大利亚英语、半岛西班牙语、葡萄牙语、粤语和智利西班牙语等。

多年以来,法庭语音工作者们一直希望能拥有一个强大的语音数据库资源。然而,数据库的建设是一项繁杂的长期任务,需要多方共同努力与协作。希望该方案能为法庭语音数据库的建设提供参考和借鉴,推动和促进我国法庭语音数据的资源共享和法庭语音技术的进步。

[1]Orte ga-García J,González-Rodríguez J, Marrero-Aguilar V.AHUMADA:A large speech corpus in Spanish for speaker characterization and identification [J].Speech Communication,2000(2-3):255-264.

[2]Nolan F,McDougallK,de JongG,et al.The DyVis database:Style-controlled recordingsof 100 homogeneous speakers for forensic phonetic research[J].International JournalofSpeech,LangandtheLaw,2009(1):31-57.

[3]李敬阳,胡国平,王莉.声纹自动识别技术与声纹库建设应用[J].警察技术,2012(4):66-69.

[4]Morrison G S,Rose P,Zhang C.Protocol for the collection of databases of recordings for forensic-voice-comparison research and practice[J].Australian Journal of Forensic Science,2012(2):155-167.

(责任编辑:于 萍)

H017

A

2095-7939(2016)04-0061-04

10.14060/j.issn.2095-7939.2016.04.013

2016-11-16

国家社科基金重点项目(编号:16AYY015);2015年西南政法大学科研资助项目(编号:2015-XZRCXM003)。

张翠玲(1972-),女,辽宁沈阳人,西南政法大学刑事侦查学院教授,博士,主要从事公安视听技术研究。